Created by Wan

テキスト埋め込みとリランキングは、最新の検索エンジン、レコメンデーションシステム、検索拡張生成 (RAG) パイプライン、さらにはエージェンティック AI を実現するための自然言語処理 (NLP) の基盤技術です。

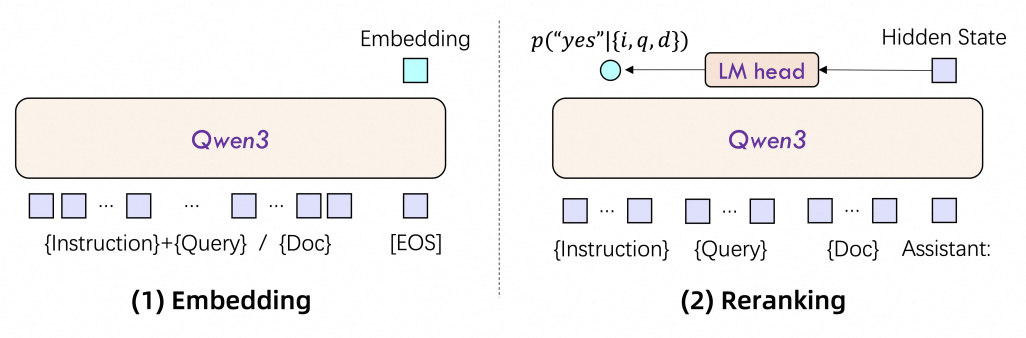

テキスト埋め込みは、非構造化テキストを、意味論的意味を捕捉する密な数値ベクトル (例えば、数値の配列) に変換することです。 これらのベクトルにより、マシンはテキスト間の類似性を測定し、意味検索、クラスタリング、分類などのタスクをサポートできます。 例えば、_「金融業界向けの最良の LLM」_のようなクエリは、その意図と一致する LLM (Large Language Model) 記述または記事と照合することができます。

リランキングは、よりきめの細かい関連性スコアに基づいて候補を並べ替えることによって、初期検索ステップの結果を精緻化することです。 埋め込みモデルは幅広い一致を取得しますが、リランカーはコンテキストに最も関連性のある結果を優先します。 たとえば、検索エンジンは、最初に埋め込みを使用して 100 件のドキュメントを取得し、次にリランカーを適用して、最も関連性の高い上位 10 件のドキュメントを選択します。

主な用途:

Qwen3 のモデルに基づいて構築された Qwen3 Embedding シリーズは、テキスト表現学習の飛躍的な進歩を象徴しています。 埋め込みモデル (テキストのベクトル化) とリランキングモデル (検索結果の精緻化) があり、パラメーターサイズは 0.6B、4B、および 8B です。

1. 非常に高い多用途性

2. 包括的な柔軟性:

3. 多言語に習熟

リランキングモデルの評価結果:

リランキングモデルの評価結果:

| モデル | パラメーター | MTEB-R | CMTEB-R | MMTEB-R | MLDR | MTEB-Code | FollowIR |

|---|---|---|---|---|---|---|---|

| Qwen3-Embedding-0.6B | 0.6B | 61.82 | 71.02 | 64.64 | 50.26 | 75.41 | 5.09 |

| Jina-multilingual-reranker-v2-base | 0.3B | 58.22 | 63.37 | 63.73 | 39.66 | 58.98 | -0.68 |

| gte-multilingual-reranker-base | 0.3B | 59.51 | 74.08 | 59.44 | 66.33 | 54.18 | -1.64 |

| BGE-reranker-v2-m3 | 0.6B | 57.03 | 72.16 | 58.36 | 59.51 | 41.38 | -0.01 |

| Qwen3-Reranker-0.6B | 0.6B | 65.80 | 71.31 | 66.36 | 67.28 | 73.42 | 5.41 |

| Qwen3-Reranker-4B | 4B | 69.76 | 75.94 | 72.74 | 69.97 | 81.20 | 14.84 |

| Qwen3-Reranker-8B | 8B | 69.02 | 77.45 | 72.94 | 70.19 | 81.22 | 8.05 |

性能:

効率:

カスタマイズ:

リソース要件:

遅延:

モデルの概要:

| モデルタイプ | モデル | サイズ | レイヤー | シーケンス長 | 埋め込みディメンション | MRL サポート | 指示認識 |

|---|---|---|---|---|---|---|---|

| テキスト埋め込み | Qwen3-Embedding-0.6B | 0.6B | 28 | 32K | 1024 | 対応 | 対応 |

| Qwen3-Embedding-4B | 4B | 36 | 32K | 2560 | 対応 | 対応 | |

| Qwen3-Embedding-8B | 8B | 36 | 32K | 4096 | 対応 | 対応 | |

| テキストのリランキング | Qwen3-Reranker-0.6B | 0.6B | 28 | 32K | - | - | 対応 |

| Qwen3-Reranker-4B | 4B | 36 | 32K | - | - | 対応 | |

| Qwen3-Reranker-8B | 8B | 36 | 32K | - | - | 対応 |

注:MRL サポートは、埋め込みモデルが最終的な埋め込みのカスタムディメンションをサポートしているかどうかを示します。 指示認識は、埋め込みモデルまたはリランキングモデルが、異なるタスクに対して入力指示のカスタマイズをサポートしているかどうかを示しています。

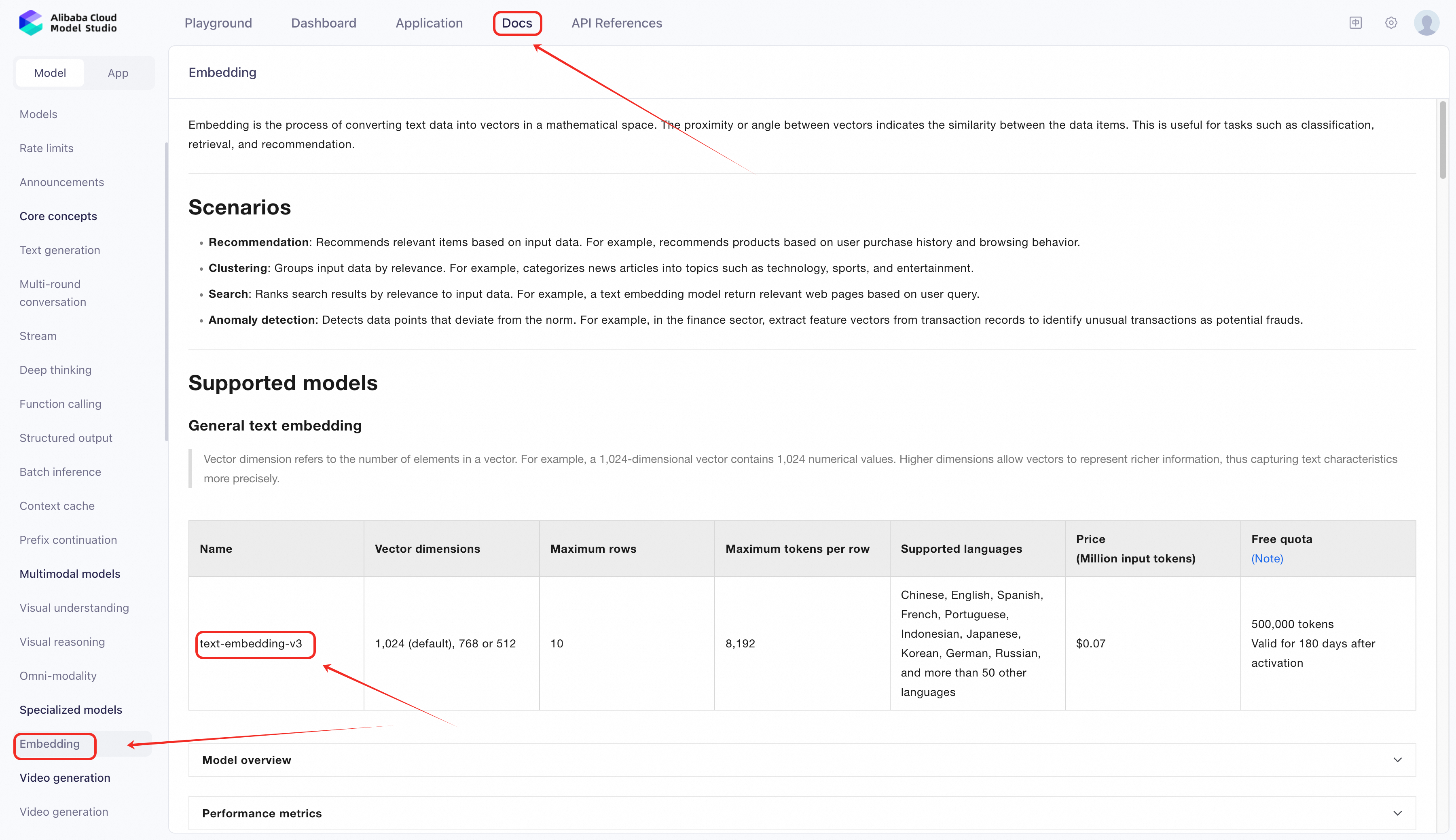

Alibaba Cloud では、2 つの方法で埋め込みモデルを呼び出すことができます。

Alibaba Cloud の Model Studio では、text-embedding-v3 を含む事前トレーニング済みのオープンソースおよびプロプライエタリモデルに簡単にアクセスできます。デプロイまたはインフラストラクチャの管理は不要です。

1. Model Studio にアクセス:

2. OpenAI 互換 API 経由でモデルを呼び出す:

import os

from openai import OpenAI

client = OpenAI(

api_key=os.getenv("DASHSCOPE_API_KEY"), # 環境変数を設定していない場合は、API キーに置き換えます

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1" # Model Studio のベース URL

)

completion = client.embeddings.create(

model="text-embedding-v3",

input='The quality of the clothes is excellent, very beautiful, worth the wait, I like it and will buy here again',

dimensions=1024,

encoding_format="float"

)

print(completion.model_dump_json())カスタマイズ (ドメイン固有のファインチューニングなど) が必要な高度なユースケースでは、Qwen3-Embedding-8B またはその他の Qwen3 バリアントを PAI-EAS (Elastic Accelerated Service) にデプロイします。 以下は、最新の PAI ツールとインターフェイスに基づいたステップバイステップガイドです。

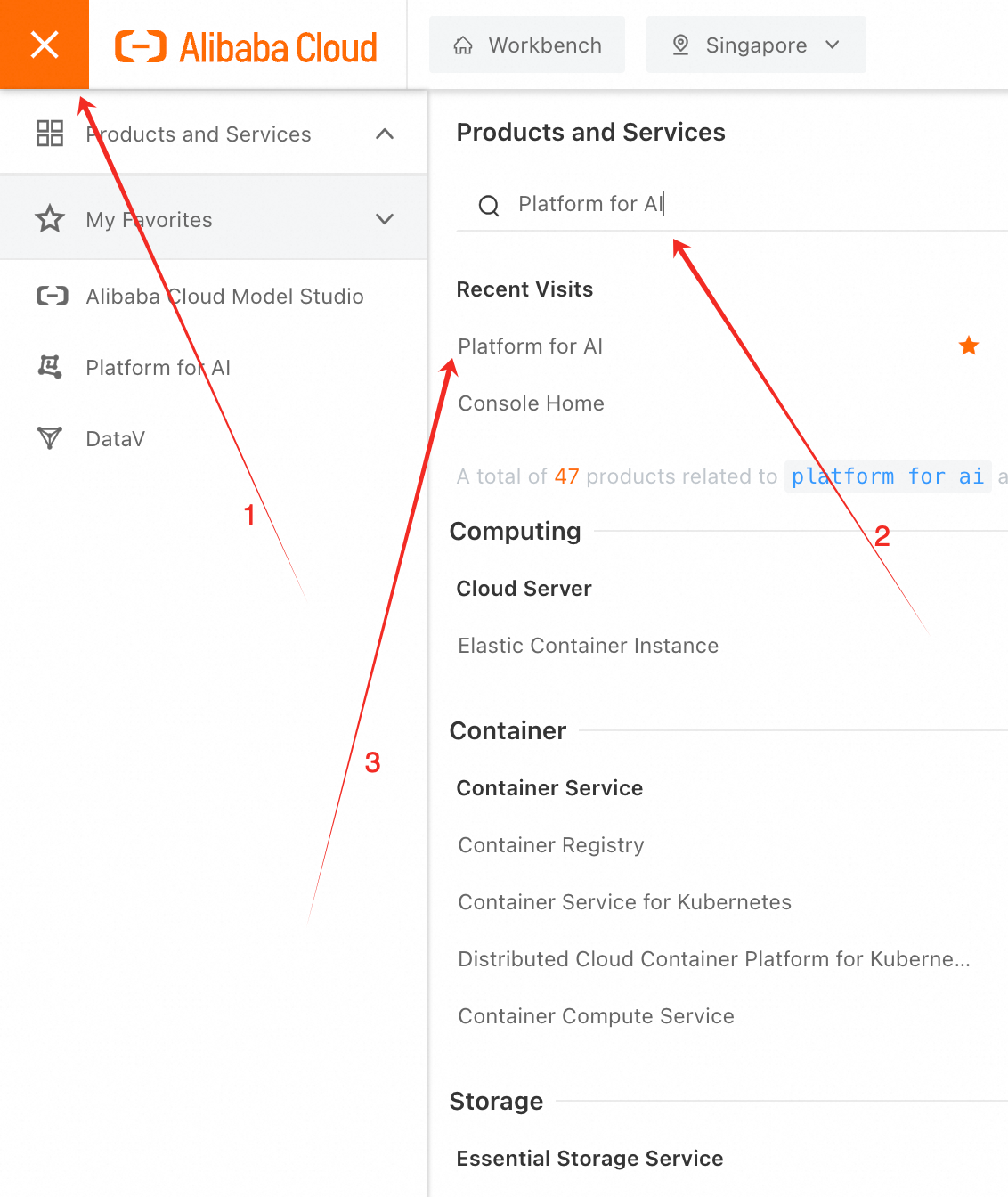

1. PAI コンソールにログインします。

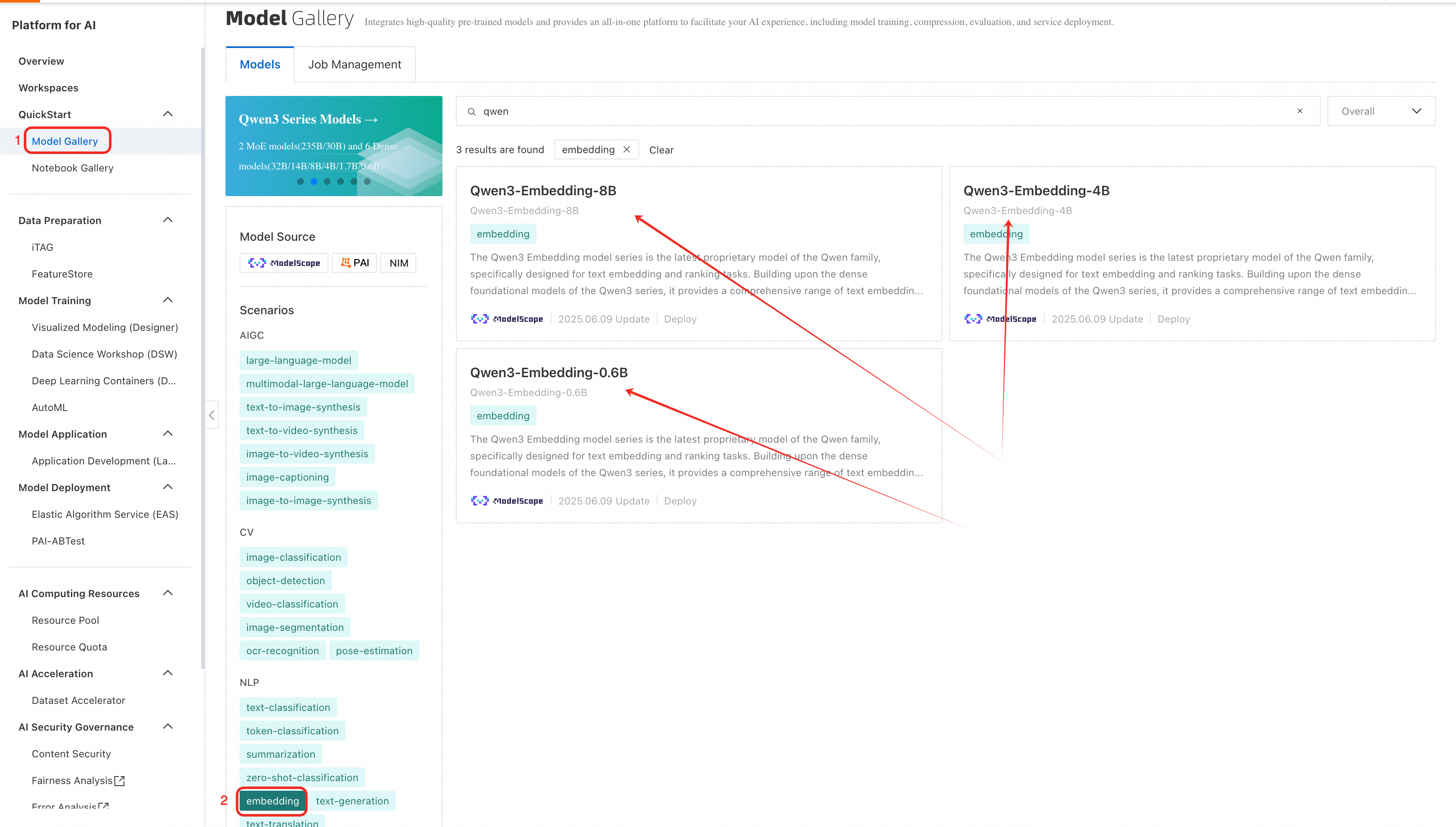

2. [Workspaces] を選択し、_[QuickStart] > [Model Gallery] > [NLP] > [embedding]_ を選択し、Qwen3-Embedding モデルを確認または検索します。

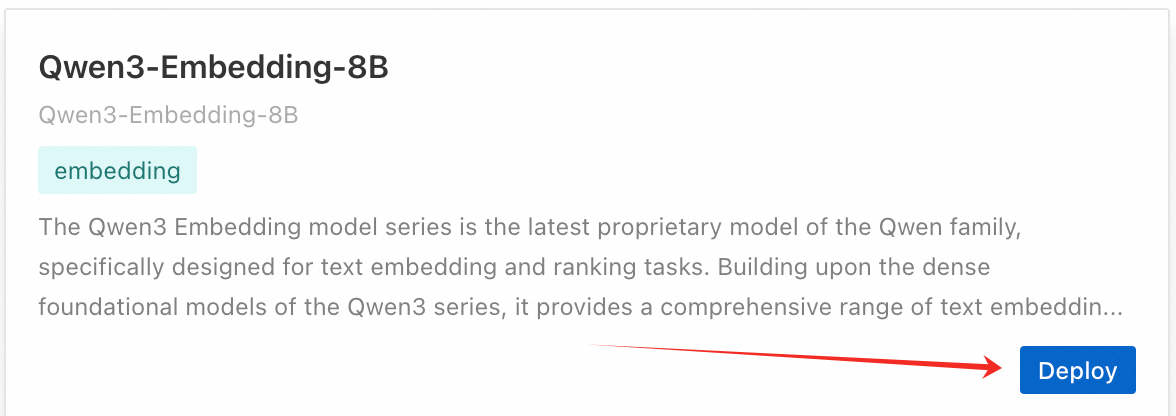

3. 目的のモデル (Qwen3-Embedding-8B など) の横に表示されている [Deploy] をクリックします。

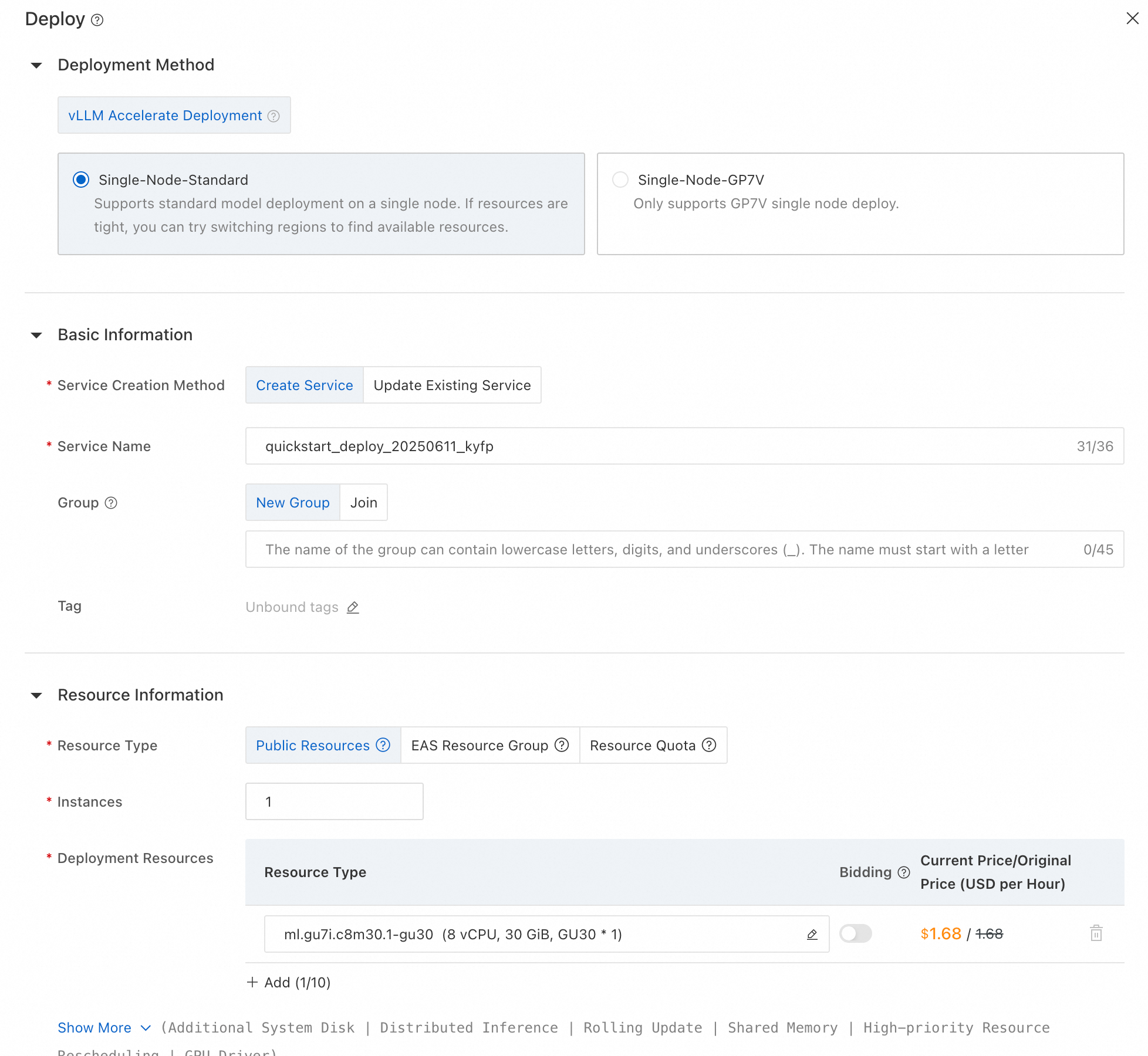

4. インスタンスタイプ、自動スケーリング、およびその他のパラメーターを設定します。

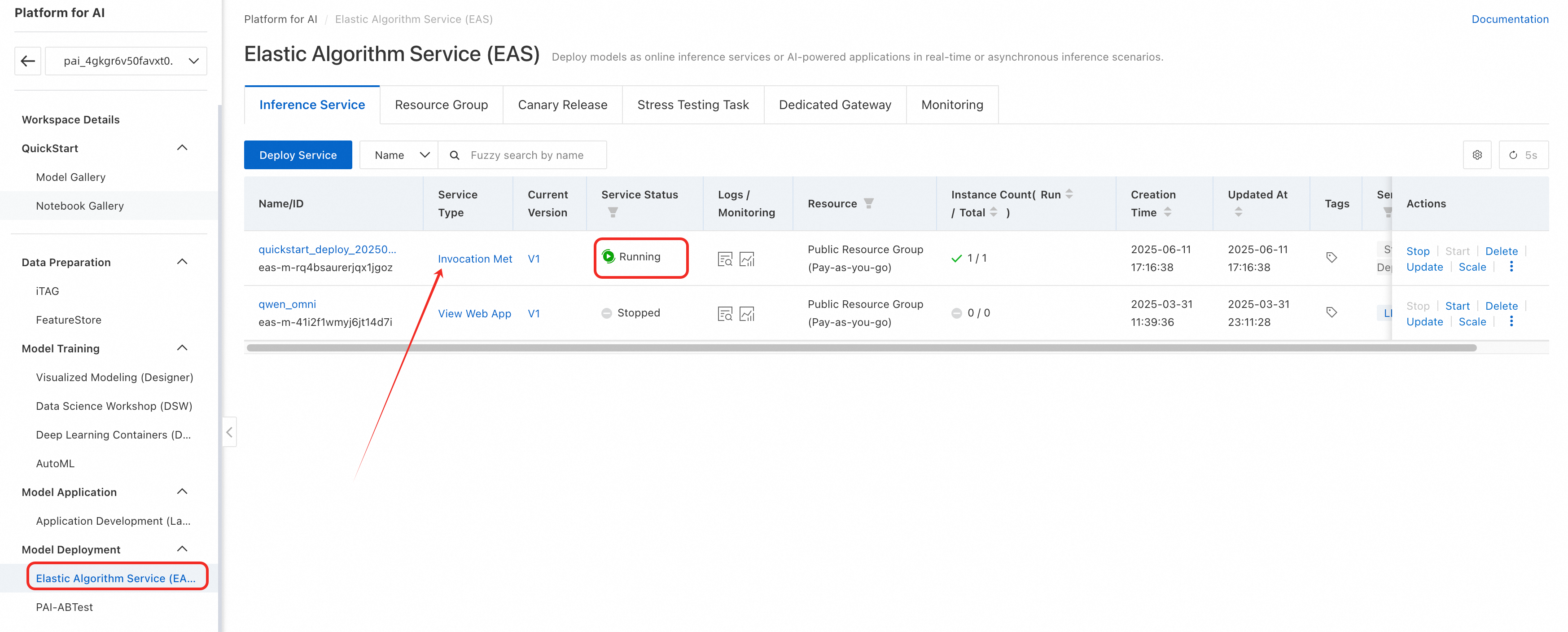

5. 最近デプロイされたモデルにアクセスするには、[Model Deployment] セクションに移動し、[Elastic Algorithm Service (EAS)] を選択します。 [Service Status] が “Running” になると、モデルの使用を開始できます。

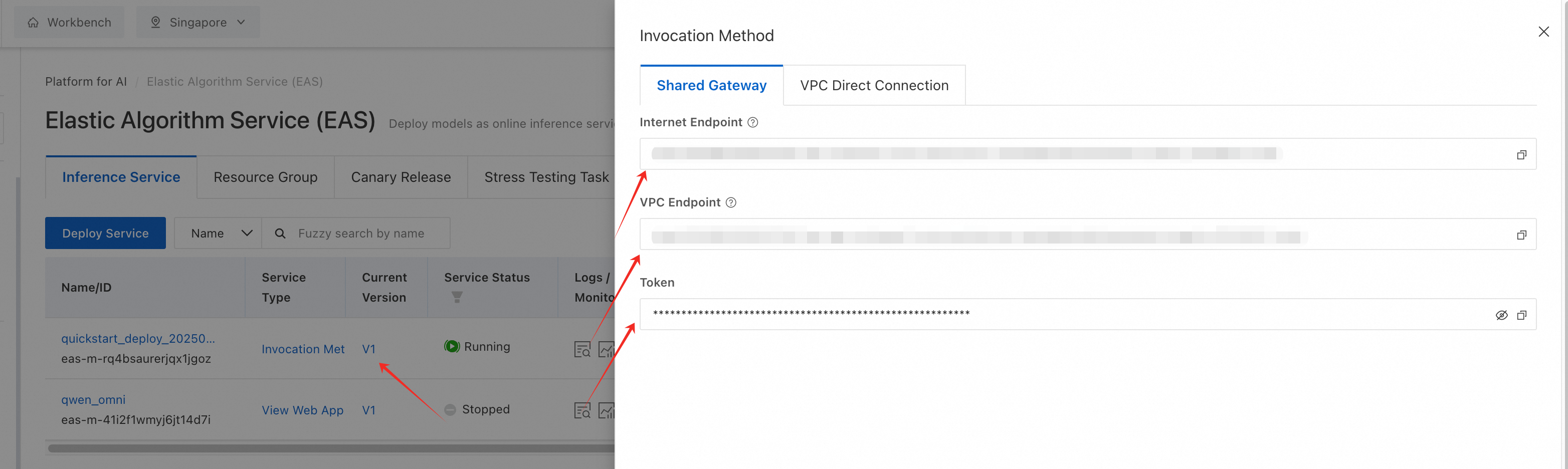

6. [Invocation Method] をクリックし、生成された API エンドポイントをコピーして統合します。

この合理化されたワークフローでは、高度なカスタマイズの柔軟性を維持しながら迅速にデプロイできます。

PAI-EAS では OpenAI の API 形式がネイティブにサポートされているため、langchain や openai などのツールとシームレスに統合できます。

from openai import OpenAI

# PAI-EAS のエンドポイントを使用してクライアントを初期化

client = OpenAI(

base_url="https://<pai-eas-endpoint>/v1",

api_key="<your-pai-api-key>"

)

# 埋め込み生成

embedding = client.embeddings.create(

input="How should I choose best LLM for the finance industry?",

model="qwen3-embedding-8b"

)

print(embedding.data[0].embedding) # 4096D ベクトルを出力

# 検索結果のリランキング

rerank = client.rerank.create(

query="Renewable energy solutions",

documents=[

"Solar power adoption surged by 30% in 2024.",

"Wind energy faces challenges in urban areas.",

"Hydrogen fuel cells offer zero-emission transportation."

],

model="qwen3-reranker-4b"

)

print(rerank.results) # 関連性スコアを返す 1. 直接 API 呼び出し (オプション)

低レベル制御の場合、生の HTTPリクエスト を送信します。

import requests

# リクエストの例

url = "<pai-eas-endpoint>/v1/embeddings"

headers = {"Authorization": "Bearer <your-api-key>"}

payload = {

"input": ["Quantum computing will revolutionize cryptography."],

"model": "qwen3-embedding-8b"

}

response = requests.post(url, headers=headers, json=payload)

print(response.json()) | ユースケース | Model Studio | PAI-EAS |

|---|---|---|

| 迅速なプロトタイピング | ✅ コーディング不要、即時アクセス | ❌ デプロイのセットアップが必要 |

| ドメイン固有のカスタマイズ | ❌ 事前トレーニング済みモデルに限定 | ✅ ファインチューニングとカスタムモデルをサポート |

| 費用対効果 | ✅ トークンごとの課金 | ✅ 柔軟な GPU インスタンス料金 |

| OpenAI SDK との統合 | ✅ OpenAI 互換 API をサポート | ✅ OpenAI 互換 API をサポート |

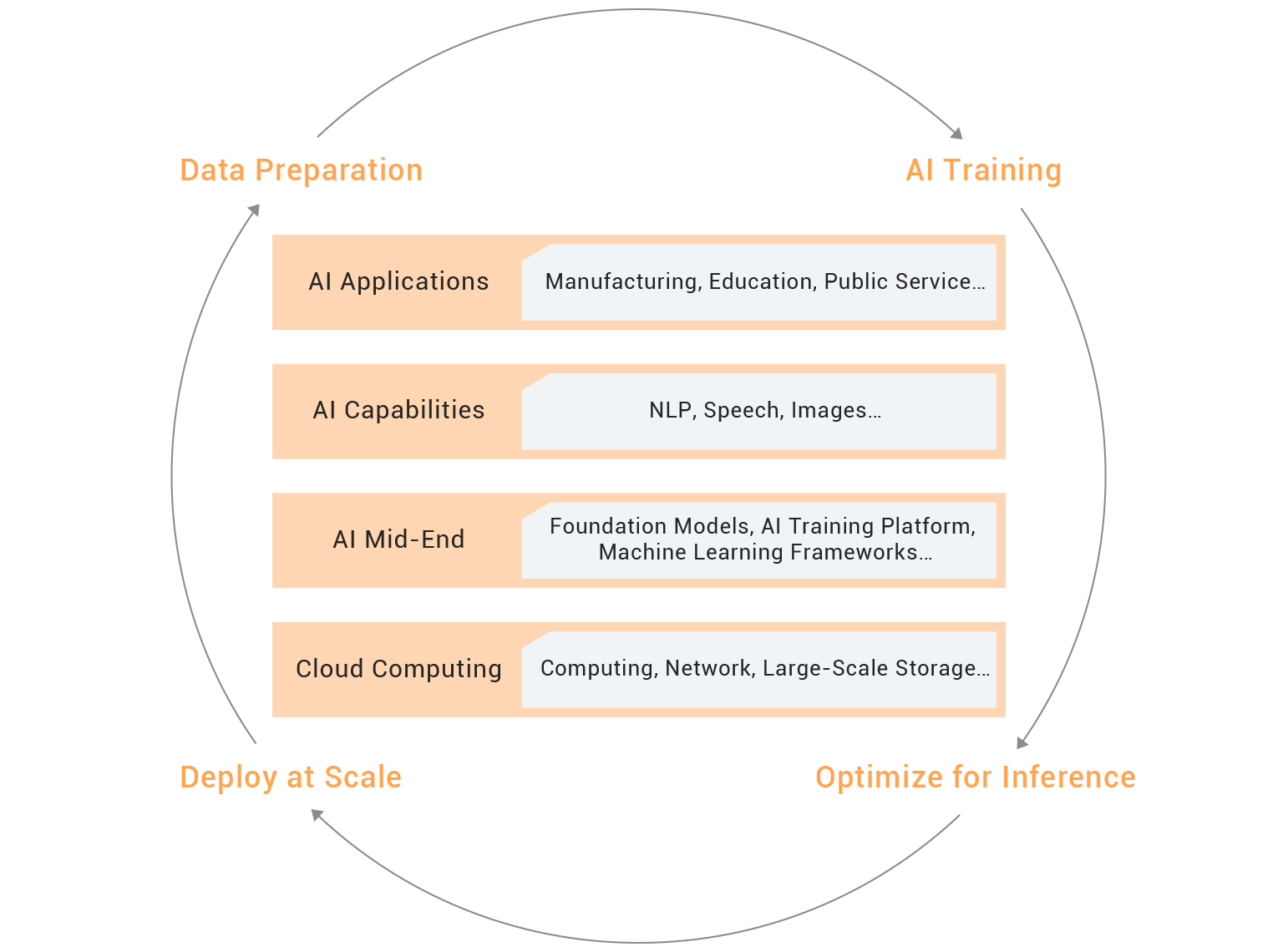

Qwen3 の埋め込みおよびリランキングモデルは、さまざまな業界で比類のない柔軟性とパフォーマンスを提供します。 Alibaba Cloud の PAI エコシステムを活用することで、これらのモデルをデプロイしてファインチューニングし、財務リスク分析から医学研究まで、ドメイン固有の課題に対処できます。 今後の作業には、マルチモーダル機能の拡張 (たとえば、画像とテキストのクロスモーダル検索) とエッジデバイスの最適化が含まれます。

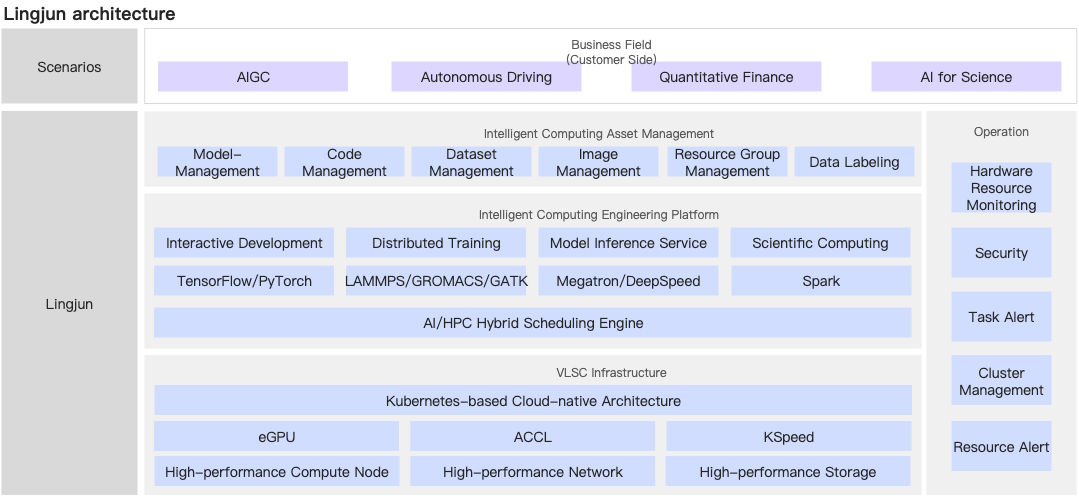

AI の世界では、1 つのサイズがすべてに適合するわけではありません。 Qwen3 の埋め込みおよびリランキングモデルは、多言語テキスト理解からコード検索までの一般的なタスクに習熟するために事前にトレーニングされていますが、金融、医療、法律などのドメインに合わせて調整することで、その真の可能性が発揮されます。 ここで、Alibaba Cloud の大規模なトレーニングプラットフォームである PAI-Lingjun が変革の触媒として登場します。

まれな病気と一致するものを見つけるために、何百万回もの臨床試験をふるいにかけている製薬研究者、または特定の条項について何千もの契約を調査している弁護士を想像してみてください。 一般的なモデルは強力ですが、ドメイン固有の言語の微妙さを見逃すことがよくあります。“EBITDA”、“心筋梗塞 (myocardial infarction)”、“不可抗力 (force majeure)” などの用語には精度が要求されます。 ファインチューニングはこのギャップを埋め、Qwen3 のアーキテクチャを採用して、創薬から金融リスク評価までの専門的なタスクのニュアンスを把握できるようにします。

PAI-Lingjun は Qwen3 モデルを洗練するための計算需要を取り扱うための強力なツールです。 GPU / TPU 間の分散トレーニングがサポートされ、組織は 0.6B ~8B のパラメーターモデルにスケールできます。そのため、最も複雑なドメインでも速度と精度の理想的なバランスを見つけることができます。

ワークフローの主なコンポーネント:

1. 弱い教師あり事前トレーニング:

ここでは、Qwen3 はドメインのリズムを学習します。 融資申請用のクエリの作成や法的な専門用語の模倣などの合成データを生成することにより、リソースの少ないシナリオでも理解の基盤を構築できます。

2. 教師ありファインチューニング:

キュレーションされたデータで、モデルはその専門知識を磨きます。 銀行では 1,200 万件の財務文書で訓練し、極めて高い精度で融資申請の危険信号を発見するように教えることもできます。

3. モデルマージ:

パレット上で色を混ぜるように、球面線形補間 (SLERP) でチェックポイントをマージし、一般化と特殊化のバランスを取ります。 その結果、 幅と深さを両立したモデルが得られます。

Qwen3-Embedding-8B のトレーニングは、気弱な人には向いていません。 NVIDIA A100 GPU 8 基と、3 日 ~ 5 日間のトレーニング期間が必要です。 それでも、見返りは途方もないものです。検索の精度は 72% から 89% に跳ね上がり、ドメインのカバレッジは 93% に急上昇します。 Qwen3-Reranker-0.6B のような小さなモデルでは、リアルタイムのスコアリングのための敏捷性が得られ、パワーが必ずしもサイズに依存するものではないことが証明されます。

| モデルパラメーターの数 | 全パラメーターのトレーニングに必要なリソース | 最小推論リソース | Megatron に基づくトレーニングの場合のモデル並列 |

|---|---|---|---|

| 70 億 | gu7xf GPU 8 基または gu7ef GPU 8 基 | NVIDIA V100 GPU (32 GB メモリ) 1 基または NVIDIA A10 GPU (24 GB メモリ) 1 基 | TP1 および PP1 |

| 140 億 | gu7xf GPU 8 基または gu7ef GPU 8 基 | NVIDIA V100 GPU (32 GB メモリ) 2 基または NVIDIA A10 GPU (24 GB メモリ) 2 基 | TP2 および PP1 |

| 720 億 | gu7xf GPU 8 基または gu7ef GPU 8 基を搭載したサーバー 4 台 | NVIDIA V100 GPUs (32 GB メモリ) 6 基または gu7xf GPU 2 基 | TP8 および PP2 |

解決策:

解決策:

解決策:

解決策:

解決策:

PAI-Lingjun と Qwen3 を使用すれば、業界を変革する力を容易に得ることができます。 財務リスクモデルを最適化する場合でも、医療のブレークスルーを加速する場合でも、Qwen3 の埋め込みおよびリランキング機能は比類のない精度でお応えします。 何ができるのか、を一緒に再定義しましょう。

_ご不明な点がございましたら、 当社チームにご連絡いただくか、または_「PAI-Lingjun」_を探索して無料トライアルを始めましょう_。

Qwen3 のファインチューニングは単なる技術的なプロセスではなく、戦略的な飛躍です。 金融、ヘルスケア、または材料科学に革命を起こそうとしているかどうかにかかわらず、PAI-Lingjun は AI の潜在能力を最大限に引き出すことができます。

Qwen3 Embedding シリーズは、テキスト表現学習の大幅な飛躍を代表するものです。 しかし、大規模言語モデル (LLM) の継続的な進歩により、新しいフロンティアが開かれます。 以下は、指示認識埋め込みと MRL (マトリョーシカ表現学習) に重点を置いた、今後の開発における重要な領域です。

従来のモデルでは、新しいタスクに適応するために再トレーニングが必要ですが、Qwen3 の指示認識アーキテクチャでは、タスク固有のプロンプトによる動的な適応が可能です。 ドメイン固有のファインチューニングが不要になり、費用と複雑さが軽減されます。

主な概念:

Qwen3 Embedding のモデルは、明示的な指示を入力として受け入れ、モデルが特定のタスクに合わせた埋め込みを生成するように導きます。 例:

def get_detailed_instruct(task_description: str, query: str) -> str:

return f'Instruct: {task_description}\nQuery: {query}'

# 例:地政学的リスク要因を含むローン申請をフラグ付け

task = "Identify loan applications with geopolitical risk factors"

query = "Loan application for a tech firm in Southeast Asia"

input_text = get_detailed_instruct(task, query) この方法では、指示を入力コンテキストに埋め込み、モデルの再トレーニングを必要とせずに、ドメイン固有のニュアンス (“地政学的リスク” など) に焦点を合わせることができます。

タスク固有の指示をクエリに追加することで、Qwen3 を最小限のラベル付きデータで新しいドメインに適応されることができます。 たとえば、化学リランカーは、以下のような指示を追加することにより、特定の薬剤標的に関連する分子に優先順位を付けることができます。

task = "Find molecules similar to aspirin for anti-inflammatory use"

query = "C1CC(=O)NC(=O)C1" # Aspirin's SMILES string MRL では、推論中の埋め込みディメンションを動的に調整でき、再トレーニングなしで柔軟性が得られます。 この革新により、単一のモデルを複数のシナリオ (軽量エッジデバイスと高精度サーバー) で利用することが可能になりました。

MRL のしくみ

Qwen3 Embedding のモデルは、カスタマイズ可能なディメンション (1024D、2560D、または 4096D など) で埋め込みを生成します。

推論中に、output_dimension パラメーターを使用して目的のディメンションを指定できます。

# 金融リスク分析用の 2560D ベクトルを生成

embeddings = model.encode(queries, output_dimension=2560) MRL の特長:

例:ヘルスケアでの MRL

製薬研究者は、正確な分子スクリーニングのために 4096D の埋め込みを生成できる一方、リアルタイムの患者記録クラスタリングのために 1024D に切り替えることができます。

# 高精度の分子埋め込み

molecule_embedding = model.encode("C1CC(=O)NC(=O)C1", output_dimension=4096)

# 軽量の患者記録クラスタリング

patient_notes_embedding = model.encode("Patient presents with chest pain", output_dimension=1024) • 課題:融資申請を危険信号 (滞納履歴など) で優先順位付けする。

• 解決策:

task = "Identify loans with delinquency risks"

query = "Loan application for a tech startup in India"

input_text = get_detailed_instruct(task, query) • パフォーマンスメトリクス:

| メトリック | ベースライン | 最適化後 |

|---|---|---|

| 検索精度 | 72% | 89% |

| リランキングの精度@10 | 65% | 84% |

解決策:

# 臨床記録の埋め込みを生成

embedings=model.encode(clinical_notes, output_dimension=256)

# HDBSCAN を使用したクラスターノート

clusterer = HDBSCAN(min_cluster_size=50)

labels = clusterer.fit_predict (embeddings) 解決策:

| モデル | MTEB-Code スコア | クエリ遅延 (ミリ秒) |

|---|---|---|

| Qwen3-Embedding-8B | 80.68 | 150 |

| Qwen3-Embedding-8B (MRL) | 85.21 (4096D) | 160 (高精度) |

解決策:Qwen3 の指示認識設計により、開発者は推論時にタスク固有の命令を定義できます。

メリット:

解決策:MRL では、ディメンションの動的な調整が可能です。

メリット:

Qwen3 Embedding のモデルでは、指示認識埋め込みと MRL サポートを組み合わせることで柔軟性を再定義し、ドメイン固有のファインチューニングの必要性を排除しています。

これらのイノベーションを活用することにより、組織は以下を実現できます。

関連ドキュメント:

コードリポジトリ:

連絡先:コラボレーションやお問い合わせについては、Alibaba Cloud までお問い合わせください。

歴史上初めて、機械がサンスクリット語の詩、Python 関数、医療診断の間の遺伝的関係を解読できるようになりました。これは、オープンソースのイノベーションを通じてすべての人がアクセスできるようになった画期的な出来事です。 DNA シーケンシングが生命の普遍的なコードを明らかにすることによって生物学に革命をもたらしたように、Qwen3 Embedding は、意味自体の分子構造をマッピングすることによって AI を大きく変えました。 このテクノロジーは、言語、文化、分野を超えて、AI システムが情報を理解して取得する方法を再定義する隠されたつながりを明らかにしました。

従来の AI 検索は、キーワードマッチングロボットのように動作し、表面レベルのテキストマッチに限定されます。 しかし、Qwen3 Embedding は、言語の DNA シーケンサーとして機能し、250 を超える言語とプログラミングのパラダイムにわたる概念の間の深い意味的関係を捕捉します。 医学診断、法的契約、または量子コンピューティングアルゴリズムを分析するかどうかにかかわらず、Qwen3 は意味の遺伝暗号を解読し、機械がニュアンス、コンテキスト、および学際的リンクを把握できるようにします。 これは単なる漸進的な改善ではなく、パラダイムシフトです。

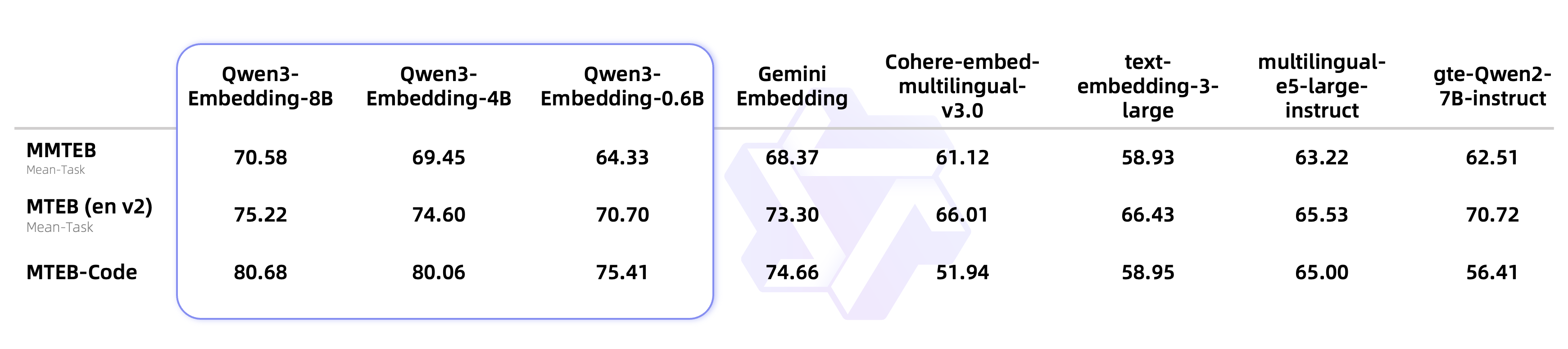

Qwen3 Embedding のマルチステージトレーニングパイプラインは、合成データの生成、教師ありファインチューニング、モデルマージを組み合わせて、最先端のパフォーマンスを実現します。 Qwen3 のスコアは MTEB Multilingual で 70.58、MTEB Code で 80.68 と、GoogleのGemini-Embedding のような独自の巨人を上回り、オープンソースのイノベーションが閉鎖的なエコシステムを上回ることができることを証明しています。 アリババは、Apache 2.0 ライセンスでモデルをオープンソース化することにより、この意味の遺伝暗号へのアクセスを民主化し、世界中の開発者による、さらにスマートで直感的なシステムの構築を可能にします。

Qwen3 の真の力は、その技術仕様だけでなく、世界を橋渡しする能力にもあります。

これらは架空のシナリオではありません。Qwen3 の遺伝子レベルの意味の理解によってすでに形作られている現実です。

AI が進化するにつれて、Qwen3 Embedding は、テキストだけでなく、同じ遺伝子レンズを介して画像、オーディオ、およびビデオをデコードするマルチモーダルシステムの舞台を設定します。 生物医学の論文を理解し、3D タンパク質モデルでその意味を視覚化し、その動作をシミュレートするコードを生成する AI を想像してみてください。

さらに、軽量の 0.6B モデルから高性能の 8B バリアントまで、Qwen3 の効率性により、エッジデバイスとクラウド規模のアプリケーションの両方に適応できます。 未来は生物のように学ぶシステムに属し、多様なデータ生態系への露出を通じて進化します。 Qwen3 Embedding は単なるツールではありません。これは進化の青写真です。

意味の遺伝暗号はすぐ手の届くところにあります。 Hugging Face と ModelScope で、Qwen3 Embedding とリランキングモデルをご覧ください。 Alibaba Cloud の PAI エコシステムにデプロイするか、またはニッチドメインに合わせてファインチューニングしてみましょう。 あなたが研究者、開発者、または企業であるかどうかにかかわらず、遺伝的 AI 理解の時代は今日から始まります。

_連絡先_:コラボレーションやお問い合わせについては、Alibaba Cloud までお問い合わせください

この記事は英語から翻訳されました。 元の記事はこちらからご覧いただけます。

Menguasai Penyematan Teks dan Pemeringkat Ulang dengan Qwen3

129 posts | 4 followers

FollowRegional Content Hub - February 26, 2024

Regional Content Hub - May 7, 2025

Regional Content Hub - April 21, 2025

Fuji - February 26, 2025

Alibaba Cloud Native Community - February 26, 2025

Regional Content Hub - February 9, 2026

129 posts | 4 followers

Follow Qwen

Qwen

Full-range, open-source, multimodal, and multi-functional

Learn More Alibaba Cloud Model Studio

Alibaba Cloud Model Studio

A one-stop generative AI platform to build intelligent applications that understand your business, based on Qwen model series such as Qwen-Max and other popular models

Learn More Platform For AI

Platform For AI

A platform that provides enterprise-level data modeling services based on machine learning algorithms to quickly meet your needs for data-driven operations.

Learn More AI Acceleration Solution

AI Acceleration Solution

Accelerate AI-driven business and AI model training and inference with Alibaba Cloud GPU technology

Learn MoreMore Posts by Regional Content Hub