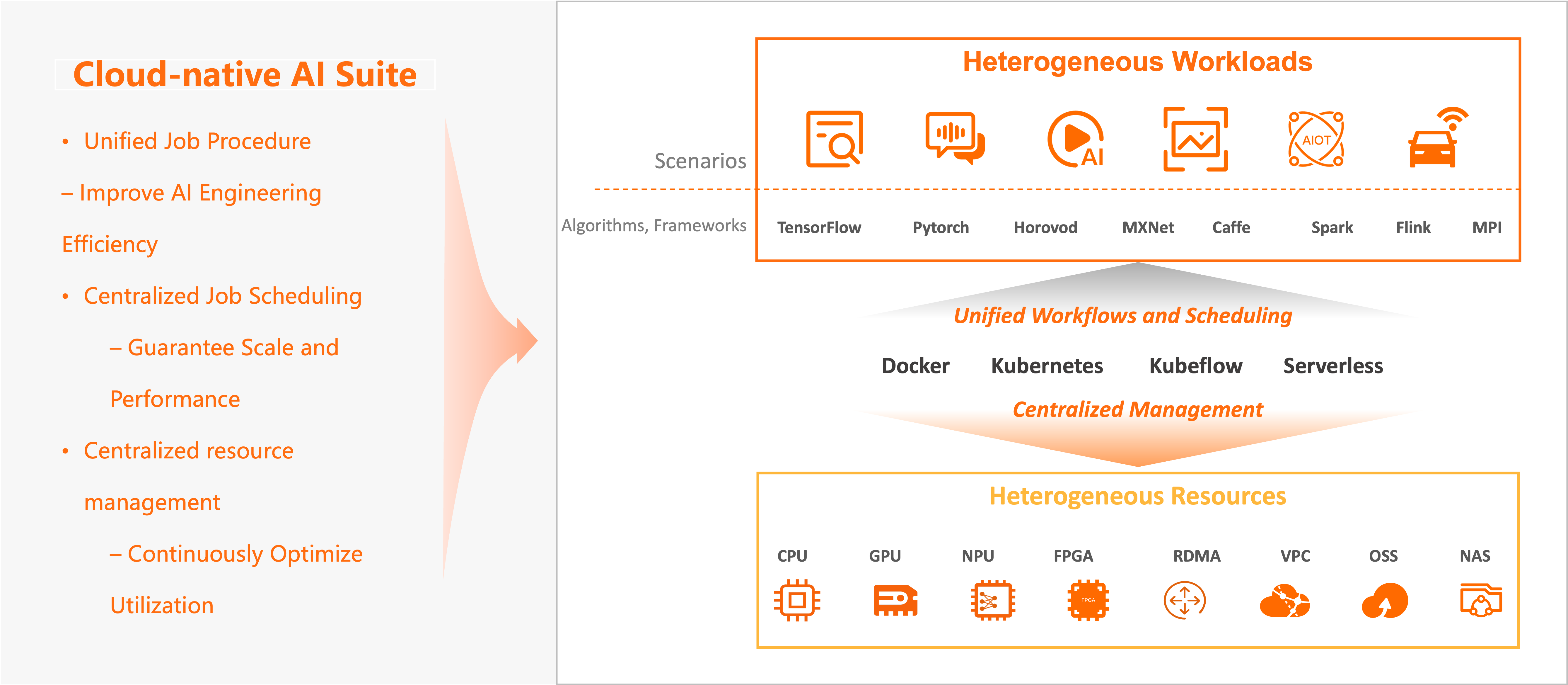

Suite AI cloud-native adalah solusi Container Service for Kubernetes (ACK) yang menyediakan infrastruktur full-stack untuk membangun dan mengoperasikan workload AI dan machine learning di Kubernetes. Suite ini menangani manajemen sumber daya, penjadwalan job, akselerasi data, dan tooling siklus hidup sehingga tim Anda dapat fokus pada pengembangan dan pelatihan model, bukan pada manajemen kluster.

Suite ini mengekspos semua kemampuan melalui CLI, SDK multi-bahasa, dan Konsol ACK, serta terintegrasi dengan layanan AI Alibaba Cloud, framework open source, dan alat AI pihak ketiga melalui antarmuka yang sama.

Workload yang didukung

Suite AI cloud-native mendukung jenis workload AI/ML berikut:

| Workload | Alat yang didukung |

|---|---|

| Distributed model training | TensorFlow, PyTorch, DeepSpeed, Horovod, Kubeflow |

| Batch (offline) inference | Apache Spark, Apache Flink |

| Real-time inference | vLLM, Triton Inference Server, KServe |

| ML pipeline orchestration | Kubeflow Pipelines, Argo Workflows |

| Interactive model development | Jupyter notebooks, PAI Data Science Workshop (DSW) |

| Self-managed engines | Any custom runtime or framework |

Arsitektur

Dibangun di atas Container Service for Kubernetes (ACK), suite AI cloud-native mengelola sumber daya komputasi, penyimpanan, dan jaringan heterogen di lapisan bawah serta mengekspos kluster dan API Kubernetes standar di lapisan atas. Di atas fondasi ini, suite tersebut menyediakan komponen penjadwalan, orkestrasi data, alur kerja, dan siklus hidup yang dibutuhkan oleh workload AI Anda.

Integrasi PAI. Suite ini terintegrasi dengan Platform for AI (PAI) untuk membentuk platform AI berkinerja tinggi dan elastis. ACK meningkatkan elastisitas dan efisiensi layanan PAI seperti Data Science Workshop (DSW), Deep Learning Containers (DLC), dan Elastic Algorithm Service (EAS). Deploy Lightweight Platform for AI di kluster ACK Anda hanya dengan beberapa klik untuk membawa algoritma dan engine PAI yang telah dioptimalkan secara mendalam ke dalam workload kontainer dan mempercepat proses pelatihan maupun inferensi. Untuk informasi lebih lanjut, lihat Apa itu PAI?

Fitur utama

| Fitur | Deskripsi | Referensi |

|---|---|---|

| Heterogeneous resource management | Menjadwalkan dan mengelola GPU NVIDIA, NPU, FPGA, VPU, dan RDMA secara terpusat bersama sumber daya ACK standar. Pantau alokasi, pemanfaatan, dan kondisi GPU dalam berbagai dimensi. Aktifkan GPU sharing, isolasi memori GPU, dan penjadwalan GPU yang mempertimbangkan topologi untuk meningkatkan pemanfaatan sumber daya. | Overview of ACK clusters for heterogeneous computing, Enable GPU monitoring for an ACK cluster, GPU sharing |

| AI job scheduling | Memperluas framework penjadwalan native Kubernetes untuk job pelatihan terdistribusi. Kebijakan yang didukung mencakup gang scheduling (coscheduling), penjadwalan First In First Out (FIFO), capacity scheduling, fair sharing, serta bin packing dan spread. Konfigurasikan antrian job berbasis prioritas dan kuota elastis per tenant. Orkestrasikan pipeline kompleks dengan Kubeflow Pipelines atau Argo Workflows. | GPU sharing, Scheduling of AI workloads |

| Elastic scheduling | Secara dinamis mengubah jumlah worker dan node selama job pembelajaran mendalam terdistribusi tanpa mengganggu pelatihan atau memengaruhi presisi model. Worker ditambahkan saat sumber daya idle tersedia dan dilepas saat sumber daya langka, membantu menghindari kegagalan node, mengurangi waktu tunggu peluncuran job, dan meningkatkan pemanfaatan kluster secara keseluruhan. | Kubernetes-based elastic training |

| AI data orchestration and acceleration | Fluid memperkenalkan abstraksi dataset di atas backend penyimpanan heterogen. ack-fluid mengingesti data dari berbagai layanan penyimpanan dan menggabungkannya menjadi dataset terpadu, mendukung penyimpanan on-cloud maupun on-premises di lingkungan cloud hibrida. Layanan cache terdistribusi per-dataset memungkinkan pemanasan dataset, pemantauan kapasitas cache, dan skalabilitas elastis, sehingga mengurangi overhead ingesti data jarak jauh dan meningkatkan efisiensi komputasi GPU. | Elastic datasets, Accelerate data access in serverless cloud computing |

| AI job lifecycle management | Arena mencakup seluruh alur kerja produksi: manajemen data, pengembangan model, pelatihan, dan penerapan layanan inferensi, sekaligus mengabstraksikan penjadwalan sumber daya, konfigurasi lingkungan, dan pemantauan. Kompatibel dengan stack AI utama seperti TensorFlow dan PyTorch, serta mendukung SDK multi-bahasa. ack-arena adalah instalasi Arena yang telah dioptimalkan yang dapat Anda deploy langsung ke kluster ACK dari Konsol. Dasbor visual dan AI Developer Console memungkinkan Anda memantau status kluster dan mengirimkan job pelatihan tanpa menggunakan CLI. | Configure the Arena client, Access AI Dashboard, Log on to AI Developer Console |

Kasus penggunaan

Maksimalkan pemanfaatan sumber daya heterogen

Suite ini mengabstraksikan semua sumber daya heterogen di cloud — komputasi (CPU, GPU, NPU, VPU, FPGA), penyimpanan (Object Storage Service (OSS), Apsara File Storage NAS, Cloud Parallel File Storage (CPFS), HDFS), dan jaringan (TCP dan RDMA) — ke dalam lapisan manajemen terpadu. Alokasi terpusat, penskalaan, dan optimasi perangkat lunak/perangkat keras menjaga pemanfaatan tetap tinggi secara berkelanjutan.

Jalankan workload AI heterogen dalam skala besar

Suite ini kompatibel dengan mesin open source utama termasuk TensorFlow, PyTorch, DeepSpeed, Horovod, Apache Spark, Flink, Kubeflow, KServe, vLLM, dan Triton Inference Server, serta mesin dan runtime yang dikelola sendiri. Suite ini terus mengoptimalkan performa, efisiensi, dan biaya pelatihan sekaligus meningkatkan pengalaman pengembangan dan operasi.

Peran pengguna

| Role | Tanggung jawab |

|---|---|

| O&M administrator | Membangun infrastruktur AI dan menangani administrasi harian. Lihat Deploy the cloud-native AI suite, Manage users, Manage elastic quota groups, dan Manage datasets. |

| Algorithm engineer and data scientist | Mengembangkan model, menjalankan pekerjaan pelatihan, dan men-deploy layanan inferensi. Lihat Pelatihan model di kluster Kubernetes, Mengelola model di MLflow Model Registry, dan Menganalisis dan mengoptimalkan model. |

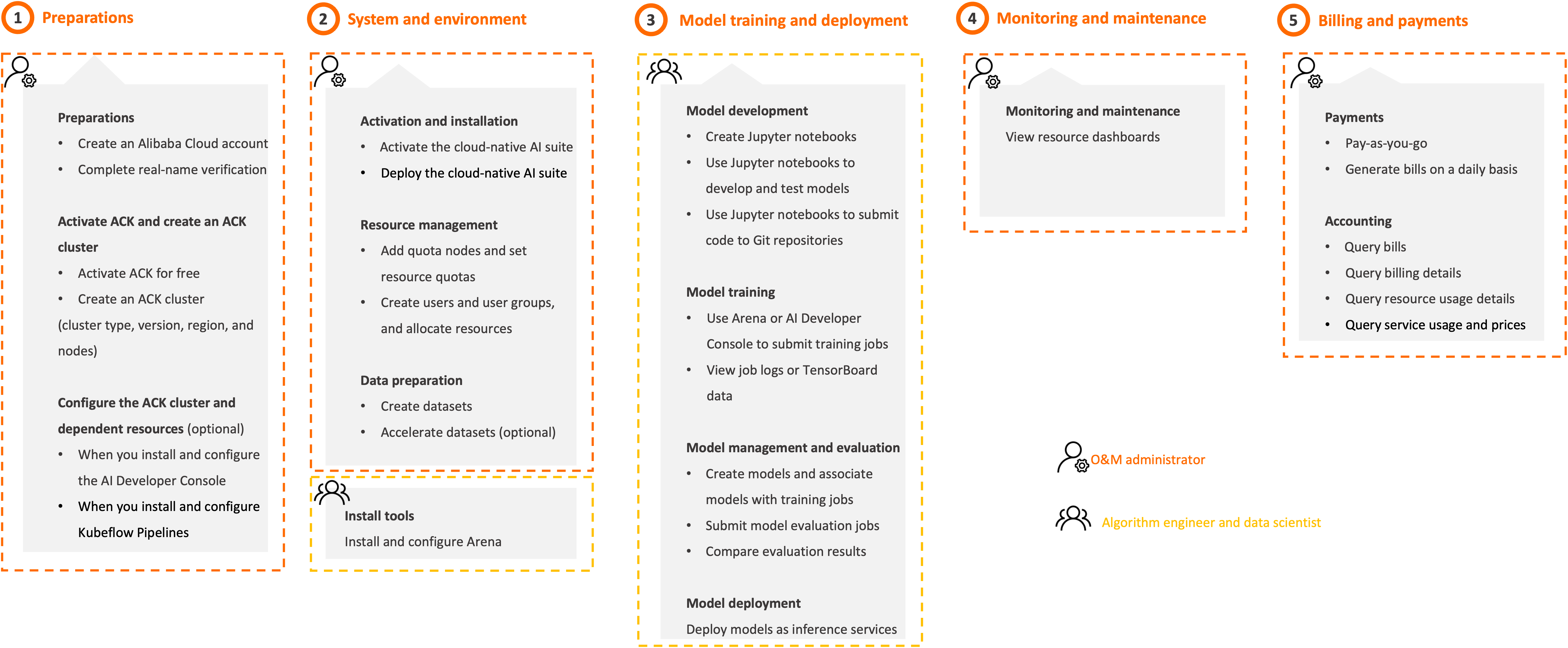

Mulai menggunakan

Ikuti langkah-langkah berikut sesuai peran Anda.

Langkah 1: Persiapan (O&M administrator)

Buat Akun Alibaba Cloud

Buat akun Alibaba Cloud dan lengkapi verifikasi nama asli. Lihat Create an Alibaba Cloud account. Kunjungi halaman pendaftaran Alibaba Cloud untuk memulai.

Buat kluster ACK

Aktifkan ACK dan buat kluster dengan konfigurasi berikut. Lihat Create an ACK managed cluster.

Jenis kluster: Kluster ACK Pro, kluster ACK Serverless Pro, atau kluster ACK Edge Pro

Versi Kubernetes: 1.18 atau lebih baru

Wilayah: wilayah tempat Anda mengaktifkan ACK

Kunjungi Konsol ACKKonsol ACKKonsol ACK untuk membuat kluster.

(Opsional) Konfigurasikan dependensi kluster

Konfigurasikan dependensi berikut sebelum menerapkan komponen suite.

AI Dashboard dan AI Developer Console

Instal agen Prometheus dan Logtail di kluster.

Buat kebijakan Resource Access Management (RAM) untuk kluster. Lihat Authorization.

Untuk mengakses AI Dashboard dan AI Developer Console melalui nama domain, instal controller NGINX Ingress dan aktifkan akses internal atau publik.

Untuk menggunakan database MySQL pra-instal sebagai penyimpanan, sambungkan SSD Perusahaan (ESSD) ke node kluster.

Untuk menggunakan ApsaraDB RDS sebagai penyimpanan, beli instans ApsaraDB RDS dan buat Secret bernama

kubeai-rdsdi namespacekube-ai.

Lihat Install and configure AI Dashboard and AI Developer Console untuk panduan penyiapan lengkap.

Kubeflow Pipelines

Untuk menggunakan MinIO pra-instal sebagai penyimpanan, sambungkan ESSD ke node kluster.

Untuk menggunakan Object Storage Service (OSS) sebagai penyimpanan, aktifkan OSS, beli bucket, dan buat Secret bernama

kubeai-ossdi namespacekube-ai. Lihat Activate OSS dan Install and configure Kubeflow Pipelines.

Langkah 2: Sistem dan lingkungan (O&M administrator)

Aktifkan dan instal suite AI cloud-native

Kunjungi halaman aktivasi untuk mengaktifkan suite.

Instal suite dan komponennya. Lihat Deploy the cloud-native AI suite dan Component introduction and release notes.

Kunjungi Konsol ACKKonsol ACKKonsol ACK untuk mengelola instalasi.

Kelola pengguna dan kuota

Tambahkan node kuota dan atur kuota sumber daya.

Buat pengguna dan grup pengguna, alokasikan sumber daya, dan asosiasikan grup kuota. Lihat Manage users, Manage user groups, dan Manage elastic quota groups.

Buat File kubeconfig dan token logon untuk setiap pengguna baru. Lihat Membuat File kubeconfig dan token logon untuk pengguna yang baru dibuat.

Gunakan AI Dashboard dan kubectl untuk menyelesaikan tugas-tugas ini.

AI Console (AI Dashboard dan AI Developer Console) diluncurkan melalui daftar putih mulai 22 Januari 2025. Penerapan yang sudah ada sebelum tanggal tersebut tidak terpengaruh. Jika akun Anda tidak masuk daftar putih, instal dan konfigurasikan AI Console melalui komunitas open-source. Lihat Open-source AI Console untuk petunjuknya.

Persiapkan data

Buat dataset.

(Opsional) Akselerasi dataset. Lihat Elastic datasets.

Langkah 3: Pelatihan dan penerapan model (Algorithm engineer dan data scientist)

Instal CLI Arena atau AI Developer Console untuk memulai. Lihat Configure the Arena client dan Install and configure AI Dashboard and AI Developer Console.

AI Console (AI Dashboard dan AI Developer Console) diluncurkan melalui daftar putih mulai 22 Januari 2025. Penerapan yang sudah ada sebelum tanggal tersebut tidak terpengaruh. Jika akun Anda tidak masuk daftar putih, instal dan konfigurasikan AI Console melalui komunitas open-source. Lihat Open-source AI Console untuk petunjuknya.

Sebagai alternatif, gunakan Lightweight Platform for AI.

Kembangkan model

Buat dan gunakan notebook Jupyter. Lihat Create and use a Jupyter notebook.

Kembangkan dan uji model di notebook tersebut.

Kirim kode ke repositori Git dari notebook.

Melatih model

Kirim job pelatihan menggunakan AI Developer Console atau Arena.

Lihat log job atau data TensorBoard.

Lihat Model training untuk detailnya.

Kelola model

Buat model dan asosiasikan dengan job pelatihan.

Kelola model menggunakan AI Developer Console atau CLI Arena. Lihat Manage models in MLflow Model Registry.

Terapkan model

Terapkan model sebagai layanan inferensi. Lihat Deploy AI services.

Gunakan AI Developer Console dan Arena untuk tugas pelatihan dan penerapan.

Langkah 4: Pemantauan dan maintenance (O&M administrator)

Gunakan AI Dashboard untuk semua tugas pemantauan dan manajemen.

Pantau sumber daya

Lihat dasbor untuk kluster, node, job pelatihan, dan kuota sumber daya. Lihat Work with cloud-native AI dashboards.

Kelola kuota

Buat, kueri, perbarui, dan hapus grup kuota beserta sumber dayanya. Ubah jenis sumber daya sesuai kebutuhan. Lihat Manage elastic quota groups.

Kelola pengguna

Buat, kueri, perbarui, dan hapus pengguna serta grup pengguna. Lihat Manage users dan Manage user groups.

Kelola dataset

Buat, kueri, perbarui, dan hapus dataset serta datanya. Akselerasi dataset sesuai kebutuhan. Lihat Manage datasets dan Elastic datasets.

Mengelola Elastic Jobs

Lihat job elastis dan detail job-nya. Lihat View elastic jobs.

Langkah 5: Penagihan (O&M administrator)

Suite AI cloud-native telah gratis sejak pukul 00.00.00 (UTC+8) pada 6 Juni 2024. Lihat Billing of the cloud-native AI suite untuk detailnya.

Kunjungi Biaya dan Pengeluaran untuk menanyakan tagihan, detail penagihan, penggunaan sumber daya, dan harga layanan.

Penagihan

Suite AI cloud-native gratis. Lihat Billing of the cloud-native AI suite.

Sumber daya terkait

| Referensi | Deskripsi |

|---|---|

| Cloud-native AI suite developer guide dan Cloud-native AI suite O&M guide | Praktik end-to-end untuk pekerjaan pengembangan dan operasi |

| Release notes | Catatan rilis untuk suite AI cloud-native |