Hadoop でインタラクティブなビッグデータ分析やクエリを実行する際にレイテンシーが高い場合は、データを Alibaba Cloud Elasticsearch に同期することで、クエリと分析を高速化できます。Elasticsearch は、特にアドホッククエリなど、複数のタイプのクエリに数秒で応答できます。このトピックでは、DataWorks のデータ統合サービスを使用して、Hadoop から Alibaba Cloud ES に大量のデータを同期する方法について説明します。

背景情報

DataWorks は、データ開発、タスクスケジューリング、データ管理などの機能を統合した、ビッグデータ開発とガバナンスのための包括的なプラットフォームです。DataWorks の同期タスクを使用すると、さまざまなデータソースから Alibaba Cloud ES にデータを迅速に移動できます。

サポートされているデータソースは次のとおりです:

Alibaba Cloud データベース: ApsaraDB for RDS (MySQL、PostgreSQL、SQL Server)、ApsaraDB for MongoDB、および ApsaraDB for HBase

Alibaba Cloud PolarDB-X (DRDS からアップグレード)

Alibaba Cloud MaxCompute

Alibaba Cloud Object Storage Service (OSS)

Alibaba Cloud Tablestore

HDFS、Oracle、FTP、DB2 などの自己ホスト型データソース。

シナリオ:

データベースまたはテーブルから Alibaba Cloud Elasticsearch にビッグデータをオフラインモードで同期します。詳細については、「データベース内のすべてのデータを Elasticsearch に同期するバッチ同期タスクを作成する」をご参照ください。

完全なビッグデータと増分ビッグデータを Alibaba Cloud Elasticsearch にリアルタイムで同期します。詳細については、「MySQL データベース全体を Elasticsearch にリアルタイムで同期する」をご参照ください。

前提条件

Alibaba Cloud Elasticsearch クラスターが作成され、クラスターの自動インデックス作成機能が有効になっていること。詳細については、「Alibaba Cloud Elasticsearch クラスターの作成」および「YML ファイルの設定」をご参照ください。

説明データを同期できるのは Alibaba Cloud ES インスタンスのみです。セルフマネージド Elasticsearch クラスターはサポートされていません。

DataWorks ワークスペースが作成されていること。詳細については、「ワークスペースの作成」をご参照ください。

Hadoop クラスターが存在し、データが含まれていること。

Hadoop クラスター、ES インスタンス、および DataWorks ワークスペースは、同じリージョンにある必要があります。

Hadoop クラスター、ES インスタンス、および DataWorks ワークスペースは、同じタイムゾーンにある必要があります。そうでない場合、時間関連のデータを同期すると、ソースと宛先のデータにタイムゾーンの差が生じる可能性があります。

課金

ES インスタンス料金の詳細については、「ES の課金項目」をご参照ください。

データ統合専用リソースグループの課金の詳細については、「データ統合専用リソースグループの課金 (サブスクリプション)」をご参照ください。

手順

ステップ 1: 専用リソースグループの購入と作成

データ統合専用リソースグループを購入し、リソースグループを VPC とワークスペースに関連付けます。専用リソースグループは、高速で安定したデータ転送を保証します。

DataWorks コンソールにログインします。

上部のナビゲーションバーでリージョンを選択します。左側のナビゲーションウィンドウで、[リソースグループ] をクリックします。

[専用リソースグループ] タブで、 をクリックします。

[DataWorks 専用リソース (サブスクリプション)] 購入ページで、[専用リソースタイプ] を [データ統合専用リソース] に設定し、リソースグループ名を入力して、[今すぐ購入] をクリックします。

詳細については、「ステップ 1: データ統合専用リソースグループを作成する」をご参照ください。

作成した専用リソースグループの [アクション] 列で、[ネットワーク設定] をクリックして、仮想プライベートクラウド (VPC) をリソースグループにアタッチします。詳細については、「VPC のアタッチ」をご参照ください。

説明この例では、データ統合専用リソースグループを使用して VPC 経由でデータを同期します。データ統合専用リソースグループを使用してインターネット経由でデータを同期する方法については、「IP アドレスホワイトリストの設定」をご参照ください。

専用リソースグループは、Hadoop クラスターが存在する VPC と Elasticsearch クラスターが存在する VPC に接続する必要があります。これにより、専用リソースグループを使用してデータを同期できます。したがって、専用リソースグループを Hadoop クラスターと Elasticsearch クラスターの [VPC]、[ゾーン]、および [vSwitch] に関連付ける必要があります。Elasticsearch クラスターの VPC、ゾーン、および vSwitch を表示する方法については、「クラスターの基本情報を表示する」をご参照ください。

重要VPC をアタッチした後、VPC の [vSwitch CIDR ブロック] を Hadoop クラスターと ES インスタンスの内部向けアクセスホワイトリストに追加する必要があります。詳細については、「ES インスタンスのパブリックまたはプライベートアクセスホワイトリストを設定する」をご参照ください。

ページの左上隅にある戻るアイコンをクリックして、[リソースグループ] ページに戻ります。

作成した専用リソースグループの [アクション] 列で、[ワークスペースのアタッチ] をクリックして、リソースグループをターゲットワークスペースにアタッチします。

詳細については、「ステップ 2: データ統合専用リソースグループをワークスペースに関連付ける」をご参照ください。

ステップ 2: データソースの追加

DataWorks の [データ統合] ページに移動します。

DataWorks コンソールにログインします。

左側のナビゲーションウィンドウで、[ワークスペース] をクリックします。

ターゲットワークスペースの [操作] 列で、 を選択します。

左側のナビゲーションウィンドウで、[データソース] をクリックします。

Hadoop 分散ファイルシステム (HDFS) データソースを追加します。

[データソース] ページで、[データソースの追加] をクリックします。

[データソースの追加] ダイアログボックスで、[HDFS] を検索して選択します。

[HDFS データソースの追加] ページで、データソースパラメーターを設定します。

詳細については、「HDFS データソースの追加」をご参照ください。

[接続テスト] をクリックします。[接続済み] のステータスは、接続が成功したことを示します。

[完了] をクリックします。

同様に Elasticsearch データソースを追加します。詳細については、「Elasticsearch データソースの追加」をご参照ください。

ステップ 3: バッチデータ同期タスクの設定と実行

バッチ同期タスクは、専用リソースグループを使用して実行されます。リソースグループは、ソースからデータを取得し、ES インスタンスにデータを書き込みます。

コードレス UI またはコードエディタを使用して、バッチ同期タスクを設定できます。この例では、コードレス UI を使用します。コードエディタを使用してバッチ同期タスクを設定する方法については、「コードエディタを使用したバッチ同期タスクの設定」および「Elasticsearch Writer」をご参照ください。

このトピックでは、レガシーデータ開発 (DataStudio) ページを例として、オフライン同期タスクを作成する方法を説明します。

DataWorks のデータ開発ページに移動します。

DataWorks コンソールにログインします。

左側のナビゲーションウィンドウで、[ワークスペース] をクリックします。

宛先ワークスペースの [操作] 列で、 を選択します。

オフライン同期タスクを作成します。

左側のナビゲーションウィンドウのデータ開発 (

アイコン) タブで、 を選択し、画面の指示に従ってワークフローを作成します。

アイコン) タブで、 を選択し、画面の指示に従ってワークフローを作成します。作成したワークフローを右クリックし、 を選択します。

[ノードの作成] ダイアログボックスで、ノード名を入力し、[確認] をクリックします。

ネットワークとリソースを設定します。

[データソース] セクションで、[データソース] を HDFS に設定し、[データソース名] を同期するデータソースの名前に設定します。

[マイリソースグループ] セクションで、専用リソースグループを選択します。

[データ宛先] セクションで、[データ宛先] を ES に設定し、[データソース名] を同期するデータソースの名前に設定します。

次へをクリックします。

タスクを設定します。

[ソース] セクションで、データを同期するテーブルを選択します。

[データ宛先] セクションで、パラメーターを設定します。

[フィールドマッピング] セクションで、[ソースフィールド] を [宛先フィールド] にマッピングします。

[チャネルコントロール] セクションで、チャネルパラメーターを設定します。

詳細については、「コードレス UI を使用してオフライン同期タスクを設定する」をご参照ください。

タスクを実行します。

(オプション) タスクのスケジューリングプロパティを設定します。ページの右側で [スケジューリング設定] をクリックし、必要に応じてスケジューリングパラメーターを設定します。パラメーターの詳細については、「スケジューリング設定」をご参照ください。

ノード設定タブの左上隅にある保存アイコンをクリックして、タスクを保存します。

ノード設定タブの左上隅にある送信アイコンをクリックして、タスクを送信します。

タスクのスケジューリングプロパティを設定した場合、タスクはスケジュールされた間隔で自動的に実行されます。ノード設定タブの左上隅にある実行アイコンをクリックして、タスクをすぐに実行することもできます。

実行ログに

Shell run successfully!メッセージが表示された場合、タスクは正常に実行されています。

ステップ 4: データ同期結果の確認

宛先の Alibaba Cloud ES インスタンスの Kibana コンソールにログインします。

詳細については、「Kibana コンソールへのログイン」をご参照ください。

左側のナビゲーションウィンドウで、[Dev Tools] をクリックします。

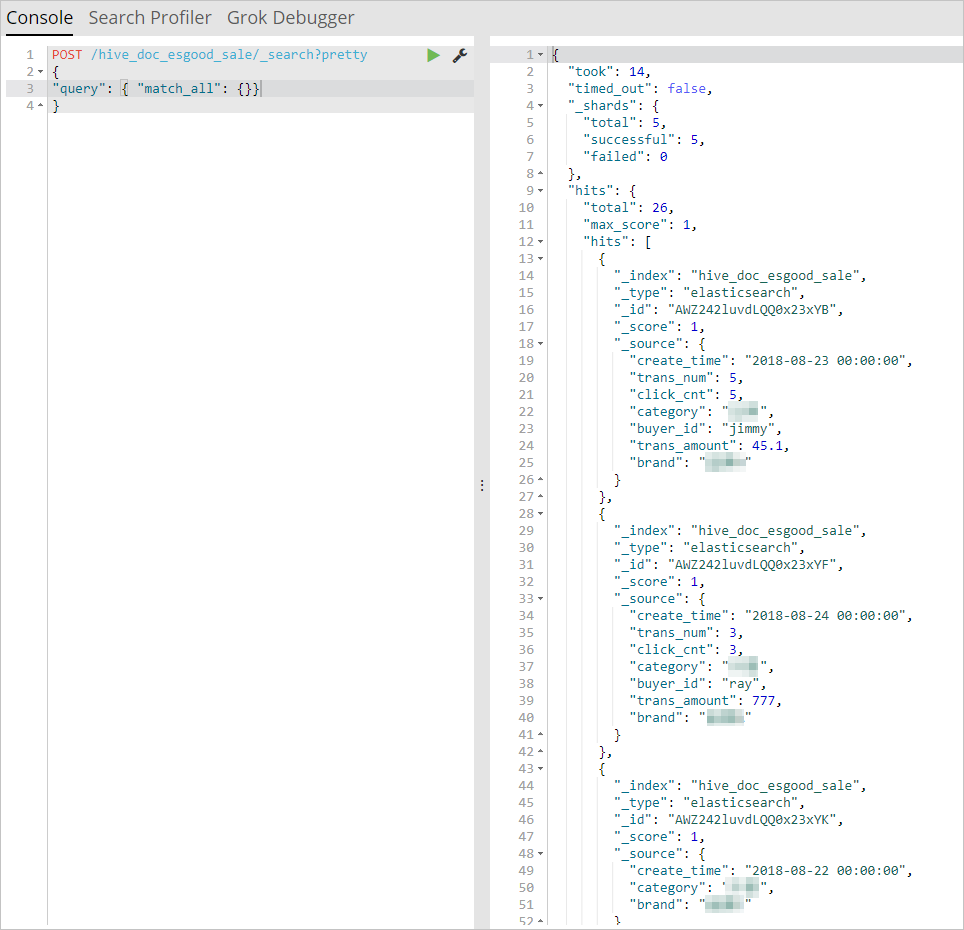

[コンソール] で、次のコマンドを実行して同期されたデータを表示します:

POST /hive_esdoc_good_sale/_search?pretty { "query": { "match_all": {}} }説明hive_esdoc_good_saleは、データ同期スクリプトのindexフィールドに設定した値です。データが同期されると、次の結果が返されます。