Chatbox 是一款 AI 用戶端應用和智能助手,您無需配置計算環境即可通過 Chatbox 與大模型進行對話。

前提條件

1. 開啟 Chatbox

前往Chatbox,根據您的裝置下載並安裝合適的版本,或直接啟動網頁版。

2. 配置模型與 API Key

2.1. 選擇自訂提供方

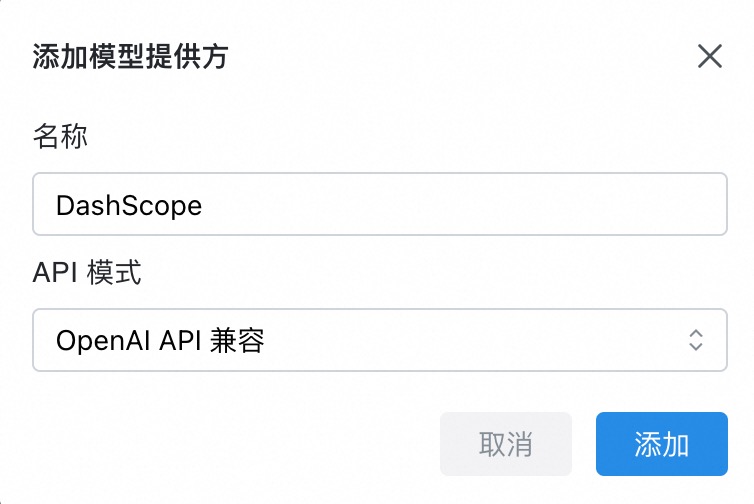

單擊 Chatbox 頁面左下方的設定,單擊模型提供方,單擊底部的添加。

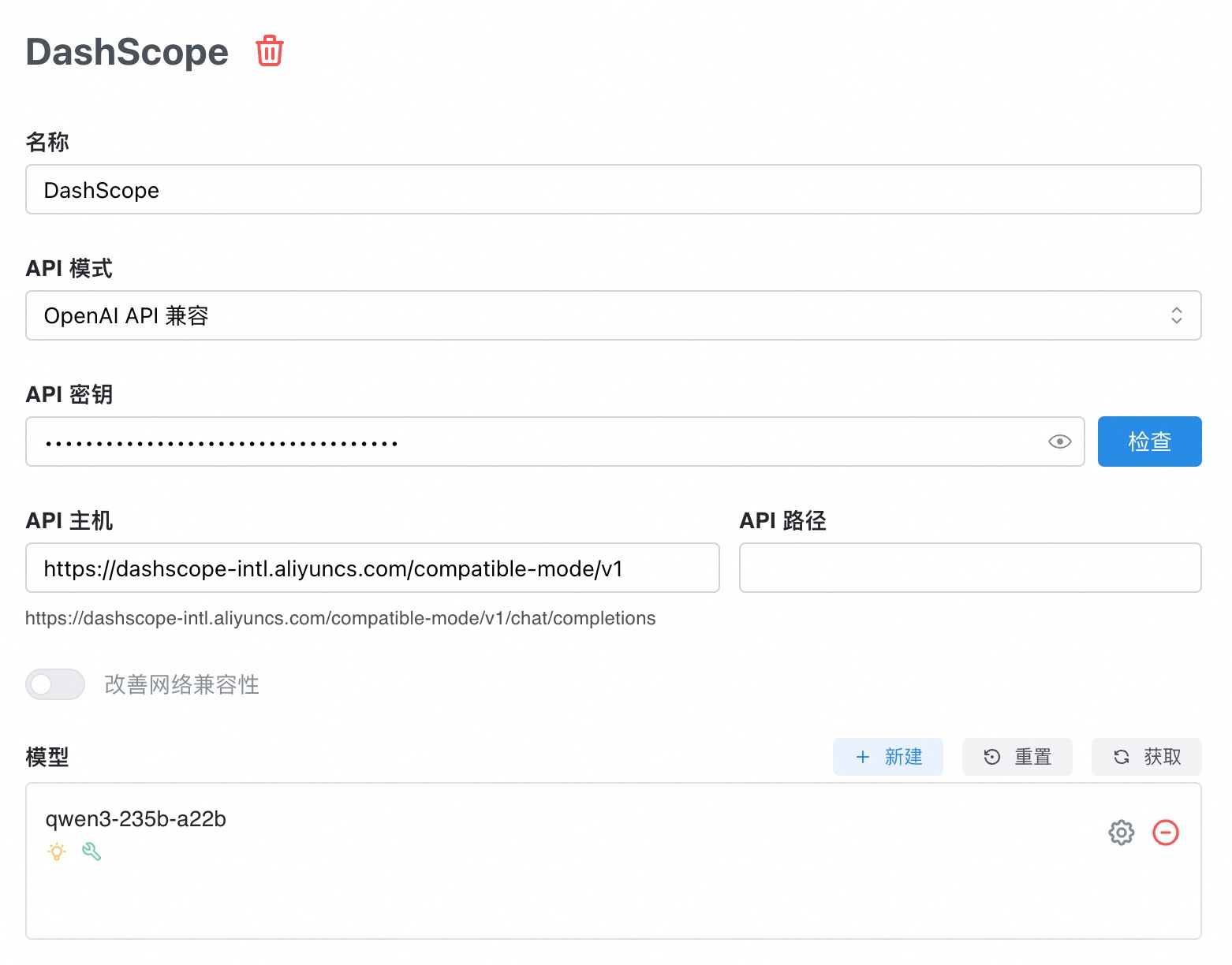

在彈窗中進行編輯。名稱輸入“DashScope”,API 模式選擇 OpenAI API 相容,單擊添加。

2.2. 配置模型與 API 金鑰

|

|

2.3. 對話設定

完成模型與 API 金鑰配置後,單擊設定頁面左側的對話設定。在彈窗設定內容相關的訊息數量上限與溫度參數:

內容相關的訊息數量上限

每次提問後,大模型參考的歷史對話輪數。對於日常聊天對話情境,建議設為5-10。過多的上下文訊息數量可能導致報錯:

Range of input length should be [1, xxx]。溫度

用於控制大模型產生文本的多樣性。

溫度越高,產生的文本更多樣,適合內容創作、頭腦風暴等情境;

溫度越低,產生的文本更確定。適合代碼撰寫、數學推理等情境。

請設定為小於2的數,否則會報錯

'temperature' must be Float。Top P

與溫度參數作用類似,用於控制產生文本的多樣性。

請設定為不大於1的數,否則會報錯"xx is greater than the maximum of 1 - 'top_p'"。

3. 對話

在對話方塊輸入問題,即可開始對話。

當前無法傳入的視訊或音頻檔案進行對話。

普通對話

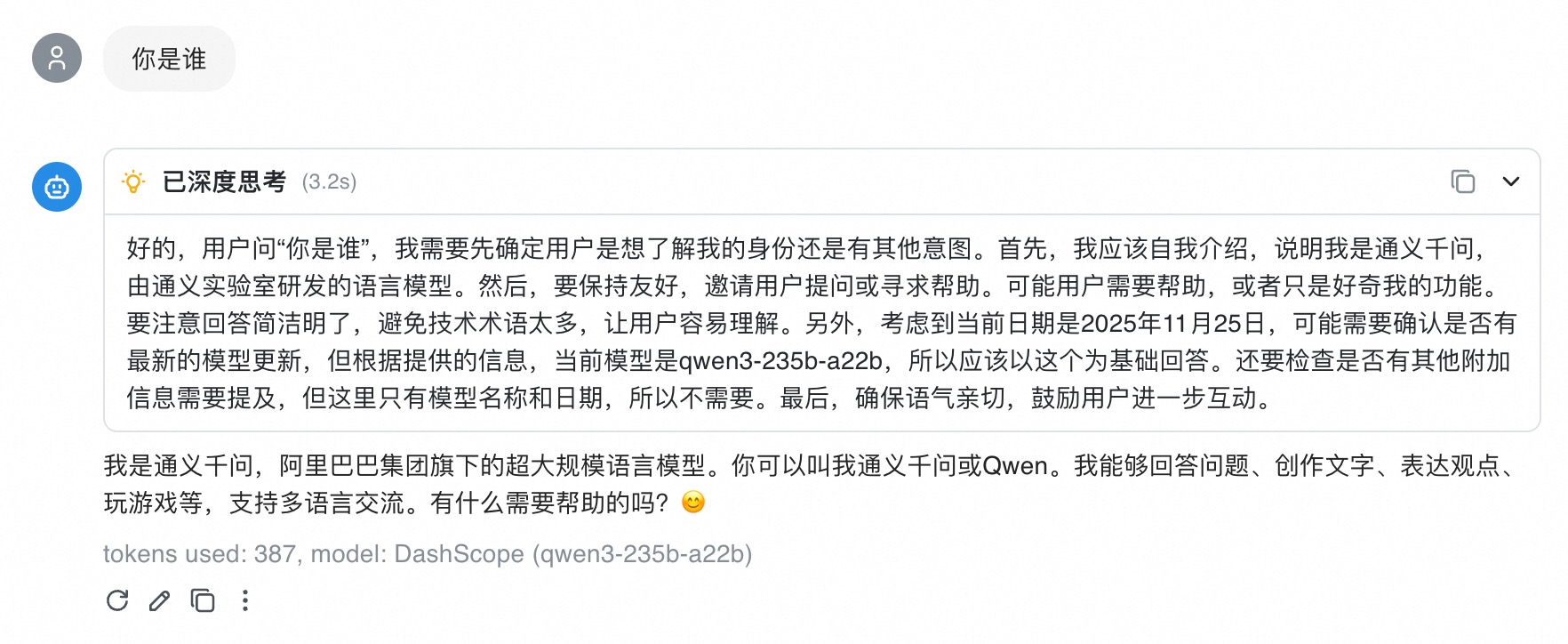

在輸入框輸入“你是誰?”進行測試:

Chatbox 能夠將 Qwen3 模型的思考過程與回複內容進行展示。

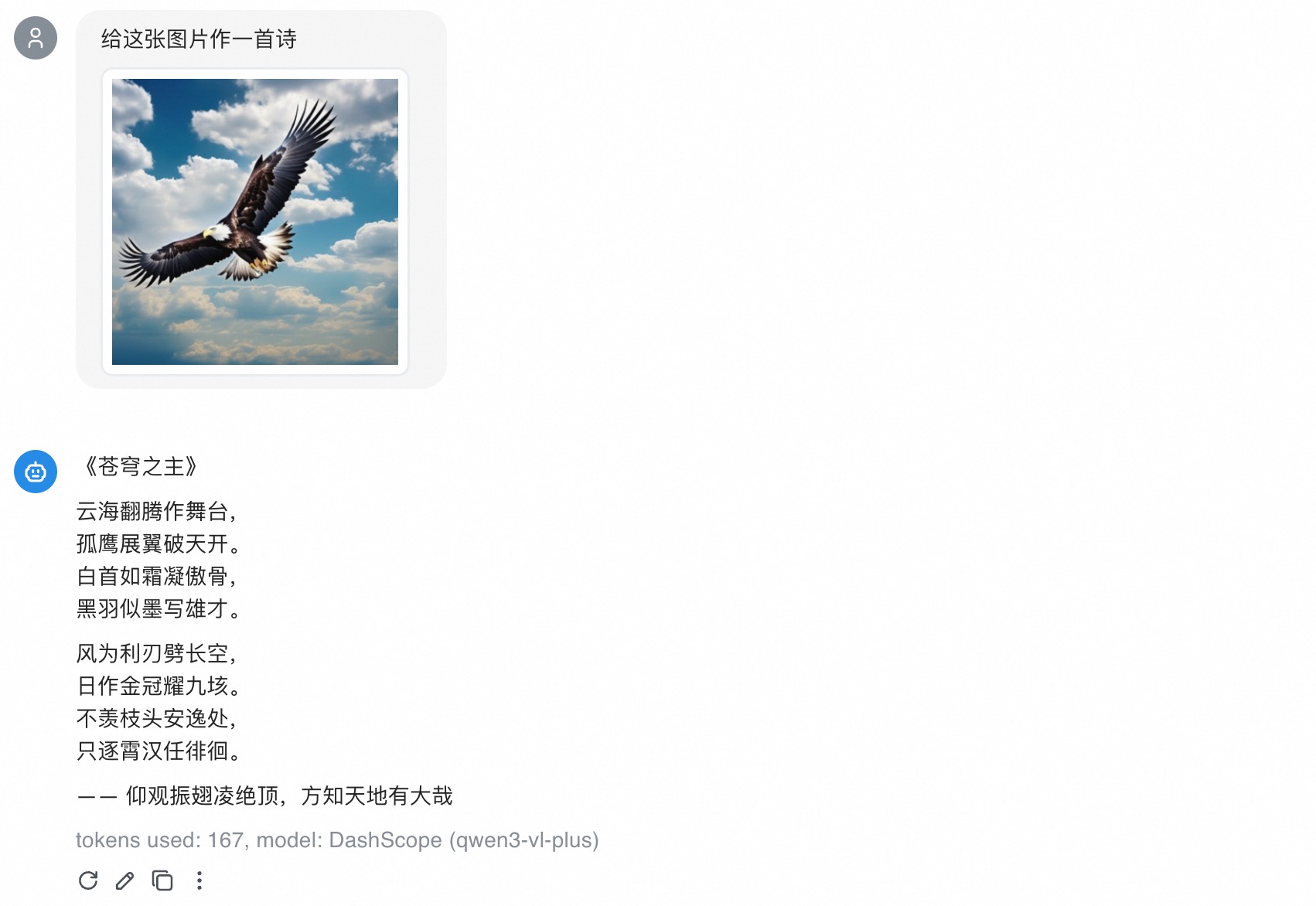

傳入圖片

1. 選擇模型

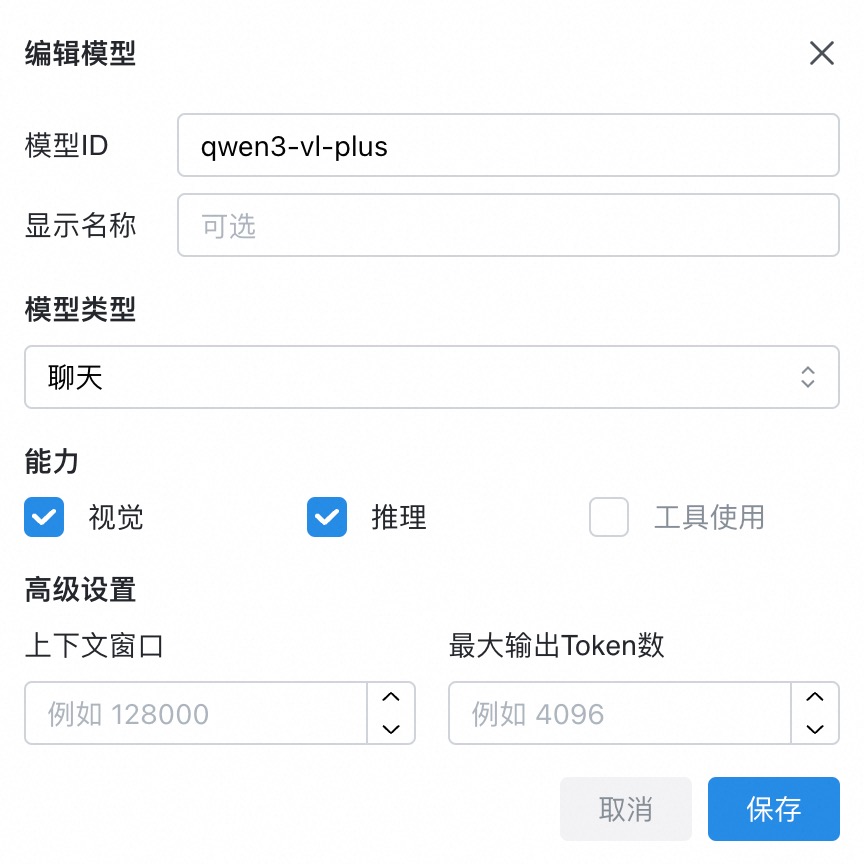

圖片問答需要使用具有視覺能力的模型,您可以在配置時選擇Qwen-VL、QVQ 或 Qwen-Omni模型。

參見2.2. 配置模型與 API 金鑰,在模型處添加您需要使用的視覺模型,並勾選視覺能力。

2. 對話

在發送按鈕旁選擇視覺模型![]() ,在輸入框中輸入問題,並單擊

,在輸入框中輸入問題,並單擊![]() ,選擇添加圖片傳入圖片。

,選擇添加圖片傳入圖片。

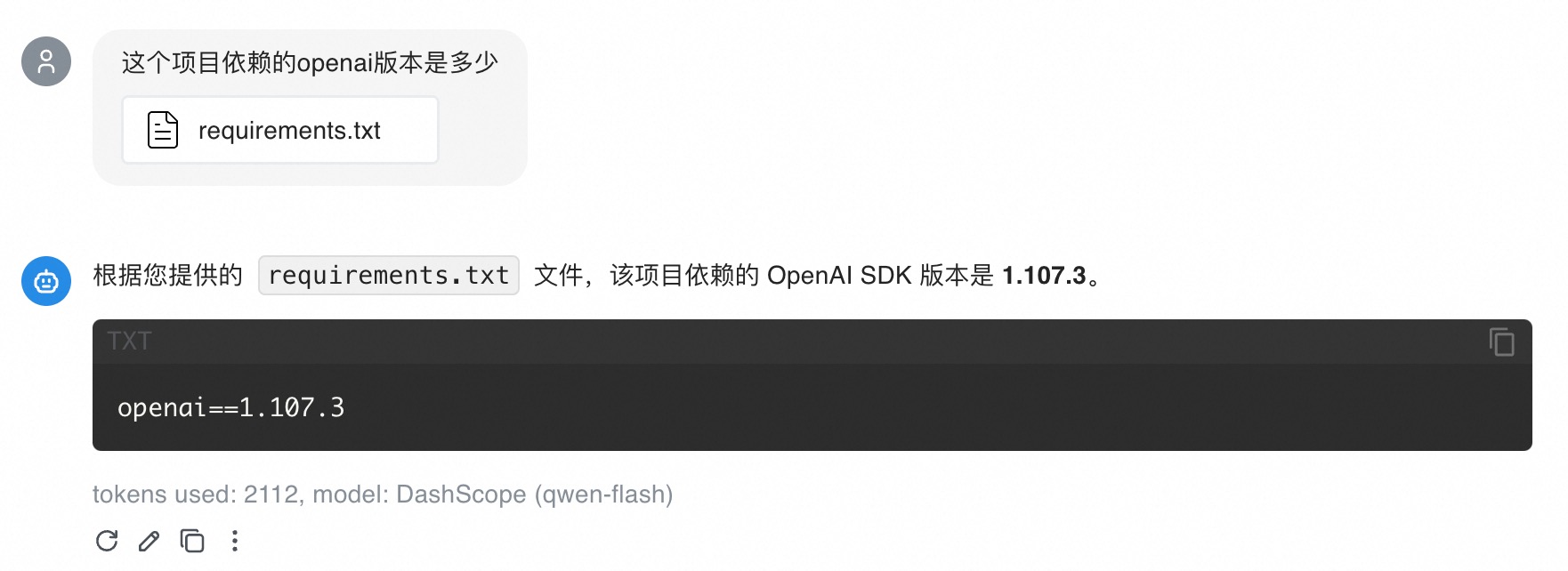

傳入文檔

Chatbox 支援傳入pdf、docx、txt等類型的檔案,使模型基於文檔進行回答。

Chatbox 暫時無法解析文檔中的圖片資訊。

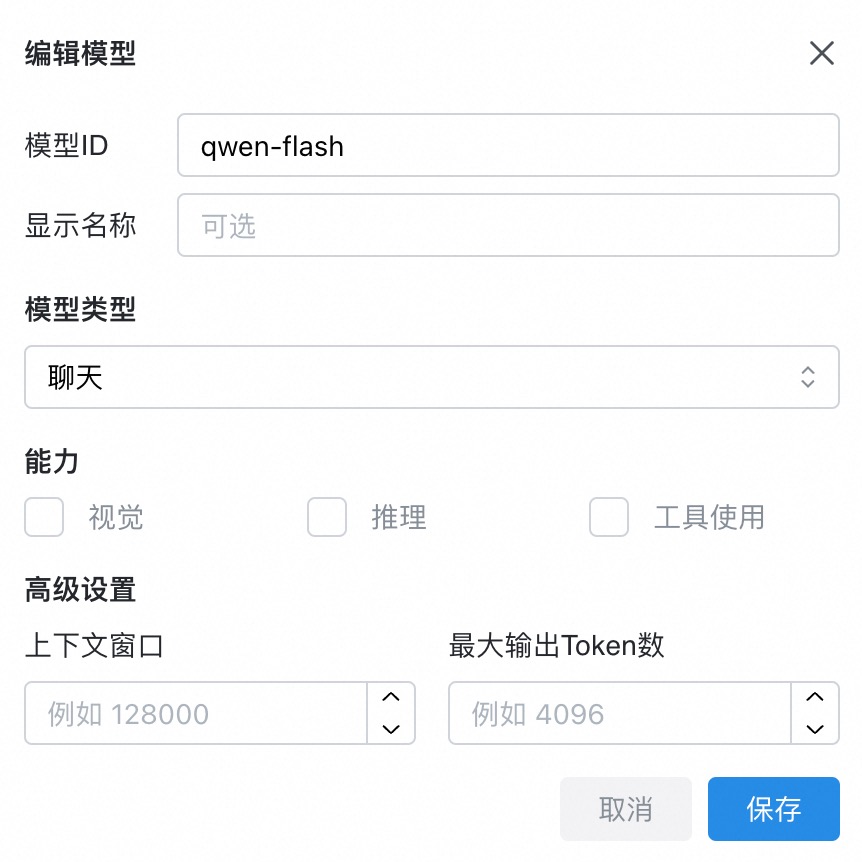

1. 選擇模型

擁有較長上下文處理能力的模型適合用於文檔問答情境,建議您選擇Qwen-Flash、Qwen-Long或qwen2.5-14b-instruct-1m、qwen2.5-7b-instruct-1m,這些模型具有百萬層級 Token 的處理能力與較低的價格。

參見2.2. 配置模型與 API 金鑰,在模型處添加您需要使用的模型。此處以 qwen-flash 為例。

2. 對話

在發送按鈕旁選擇添加的模型![]() ,在輸入框中輸入問題,並單擊

,在輸入框中輸入問題,並單擊![]() ,點擊選擇檔案。

,點擊選擇檔案。

基於文檔的連續提問可能造成大量的 Token 消耗,為了節省成本,您可以:降低內容相關的訊息數量上限,減少輸入的 Token 數;或優先選擇 qwen-flash 模型,該模型支援上下文緩衝,可以在多輪對話中降低輸入 Token 的費用。

常見問題

Q:如何計費?

A:阿里雲百鍊對模型輸入與輸出的 Token 進行計費,模型 Token 的費用請參見模型列表。

多輪對話會帶入歷史對話記錄,從而消耗較多 Token。您可以新開對話或降低內容相關的訊息數量上限,減少不必要的 Token 消耗。日常聊天建議設定內容相關的訊息數量上限為5-10。

Q:Chatbox 報錯:“串連 Custom Provider 失敗”怎麼辦?

A:請您根據報錯資訊進行排查:

Range of input length should be [1, xxx]

可能是您輸入的內容過長,或多輪對話累積的上下文超過模型最大上下文長度。請您根據您的使用方式進行排查:

首次對話即報錯

有可能是您輸入的文本過長,或傳入的檔案包含較多 Token,您可以使用 qwen-flash、qwen-long等上下文長度達到 1,000,000的模型來處理您的請求。

多輪對話後報錯

有可能是多輪對話累積的 Token 超過了模型的最大上下文長度,您可以參考以下方法:

新開對話

大模型回複時將不再參考歷史對話。

減少內容相關的訊息數量上限

使大模型回複時僅參考一定範圍內的對話記錄,避免輸入所有歷史對話。

更換模型

更換為qwen-flash、qwen-long等上下文長度達到 1,000,000的模型以處理更長的上下文,從而進行更多輪的對話。

'temperature' must be Float

模型的

temperature參數需要小於2,您可以將溫度(Temperature)參數設為小於2的數。

如果您的問題不在上述範圍,請參見錯誤資訊進行排查。

Q:傳入的圖片和文檔有什麼限制?

A:

圖片:傳入圖片的限制請參見映像與視頻理解;

文檔:Chatbox 會對傳入的文檔進行解析,解析產生的文本與內容相關的 Token 長度不高於模型最大上下文長度即可。