Retrieval-Augmented Generation(RAG)ベースの大規模言語モデル(LLM)チャットボットを Platform for AI(PAI)にデプロイする場合、ベクトルデータベースとして Tablestore を使用できます。このトピックでは、JSON 構成を使用してデプロイされた RAG ベースの LLM チャットボットのベクトルデータベースとして Tablestore を使用する方法について説明します。

背景情報

EAS

PAI は、モデルの開発とデプロイのためのワンストッププラットフォームを提供します。PAI の Elastic Algorithm Service(EAS) モジュールを使用すると、パブリックリソースグループまたは専用リソースグループを使用して、モデルをオンライン推論サービスとしてデプロイできます。モデルは、リアルタイムの応答を生成するために、異種ハードウェア(CPU および GPU)にロードされます。

Tablestore

Tablestore は、大規模データのストレージと取得のための費用対効果が高く、高性能なシステムです。サービスの安定性とセキュリティ(専用 VPC、99.99% の可用性、12 ナインのデータ信頼性)を確保するために、高い取得率(マルチモーダル取得、スカラーとベクトルの混合取得)と高性能(リアルタイムインデックス作成、ミリ秒単位のクエリ、テーブルあたり最大 100 億ベクトルのサポート)を備えたベクトル取得機能を提供します。

RAG

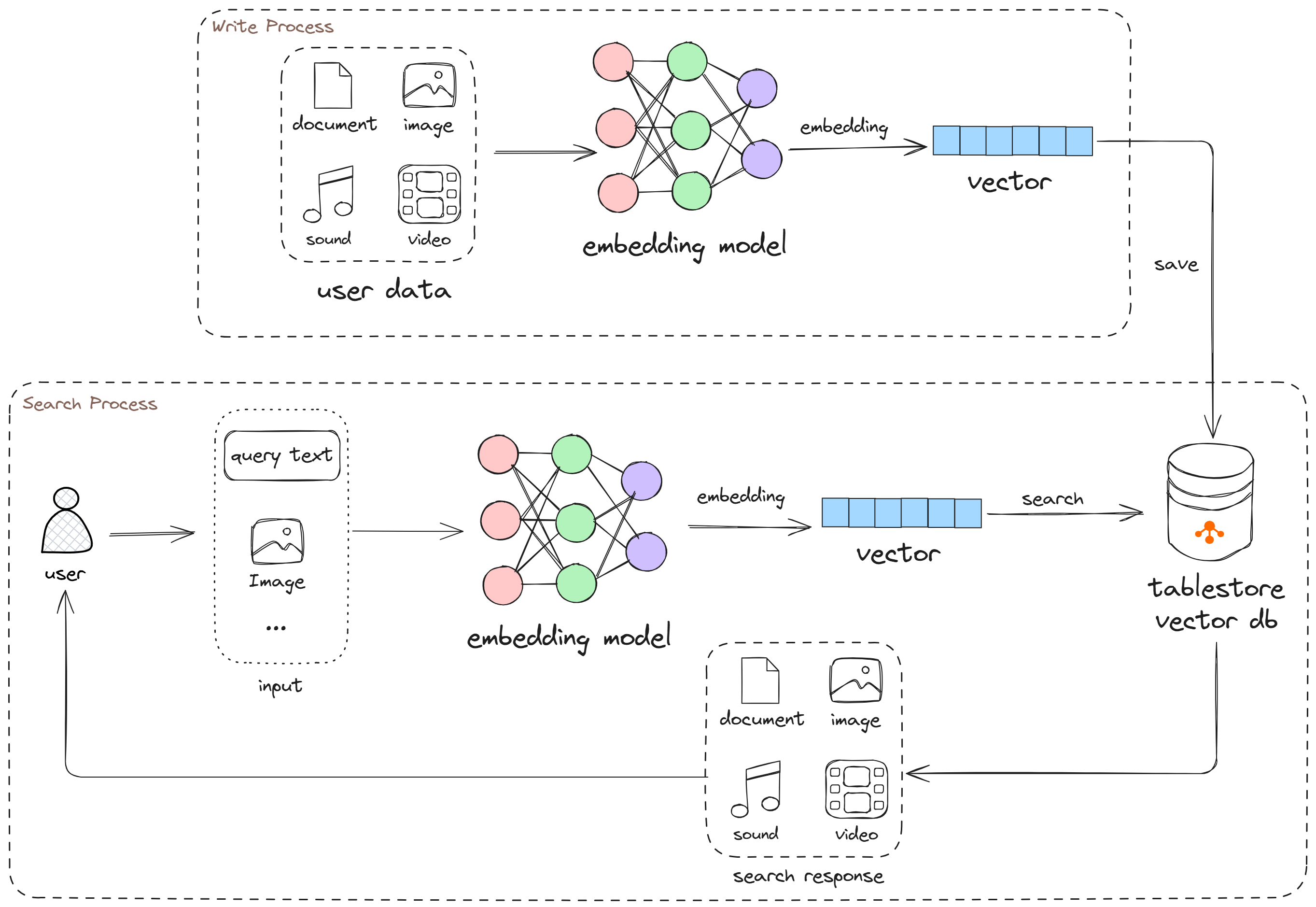

RAG は、外部ナレッジベースから関連情報を取得し、その情報をユーザー入力と組み合わせ、次に組み合わせた入力を LLM に渡します。これにより、特定のドメインにおける LLM の知識ベースの Q&A 機能が強化されます。次の図は、Tablestore を RAG アプリケーションのベクトルデータベースとして使用する場合のナレッジベースファイルのアップロード、保存、および取得方法を示しています。

注意事項

この例では、LLM モデル DeepSeek-R1-Distill-Qwen-1.5B は ecs.gn7i-c16g1.4xlarge タイプのインスタンスにデプロイされています。EAS の課金方法については、「EAS の課金」をご参照ください。

デプロイプロセスのみをテストする場合は、リソースの予期しない課金を防ぐために、デプロイ後すぐにデプロイされたサービスを削除する必要があります。

手順

ステップ 1:Tablestore ベクトルデータベースを準備する

Tablestore を有効にする

Tablestore が有効になっている場合は、このステップをスキップします。

製品詳細ページ にログインします。

[Get It Free] をクリックします。

[Table Store (Pay-As-You-Go)] ページで、[Buy Now] をクリックします。

[Confirm Order] ページで、契約をよく読んで、[I Have Read And Agree To Table Store (Pay-As-You-Go) Agreement Of Service] を選択し、[Activate Now] をクリックします。

Tablestore を有効にした後、[Console] をクリックして Tablestore コンソールに移動します。

Tablestore インスタンスを作成する

既存のインスタンスをベクトルデータベースとして選択することもできます。この場合、インスタンス名、Virtual Private Cloud(VPC)エンドポイント、インスタンスへのアクセス権限を持つ AccessKey ペアなどの情報を準備する必要があります。

Tablestore コンソール にログインします。

上部のナビゲーションバーで、リソースグループとリージョンを選択し、[インスタンスの作成] をクリックします。

[課金方法] ダイアログボックスで、[インスタンス名] と [インスタンスタイプ] を指定し、[OK] をクリックします。

接続情報を取得する

インスタンス名または [インスタンスの管理] をクリックして、[インスタンスの詳細] タブに移動します。 [インスタンスの詳細] タブで、インスタンスアクセス URL とインスタンス名を確認できます。

説明VPC エンドポイントをインスタンスアクセス URL として使用します。

Tablestore へのアクセス権限を持つ Alibaba Cloud アカウントまたは RAM ユーザーの AccessKey ペアを作成します。

ステップ 2: EAS を使用して RAG ベースの LLM チャットボットをデプロイする

PAI を有効にし、デフォルトのワークスペースを作成します。

重要Tablestore インスタンスと同じリージョンで PAI を有効にする必要があります。

PAI コンソール の左側のナビゲーションウィンドウで、[モデルのデプロイ] > [Elastic Algorithm Service (EAS)] を選択します。

[Elastic Algorithm Service (EAS)] ページで、[サービスのデプロイ] をクリックします。表示されるページで、[JSON デプロイ] をクリックします。

[JSON デプロイ] ページで、デプロイ構成を入力し、[デプロイ] をクリックします。表示されるメッセージで、[OK] をクリックします。

上記の手順を完了すると、システムはすぐに RAG ベースの LLM チャットボットのデプロイを開始します。デプロイプロセス全体には約 5 分かかります。デプロイが完了すると、サービスステータスが [実行中] に変わります。

指定されたベクトルデータテーブルが存在しない場合、システムはデプロイ中に自動的にデータテーブルを作成し、Tablestore インスタンスの検索インデックスを構成します。

ステップ 3:RAG ベースの LLM チャットボットを使用する

サービスリストで、デプロイされたサービスを見つけ、サービスの種類 列の [Web アプリの表示] をクリックします。表示されるダイアログボックスで、[Web アプリ] をクリックします。

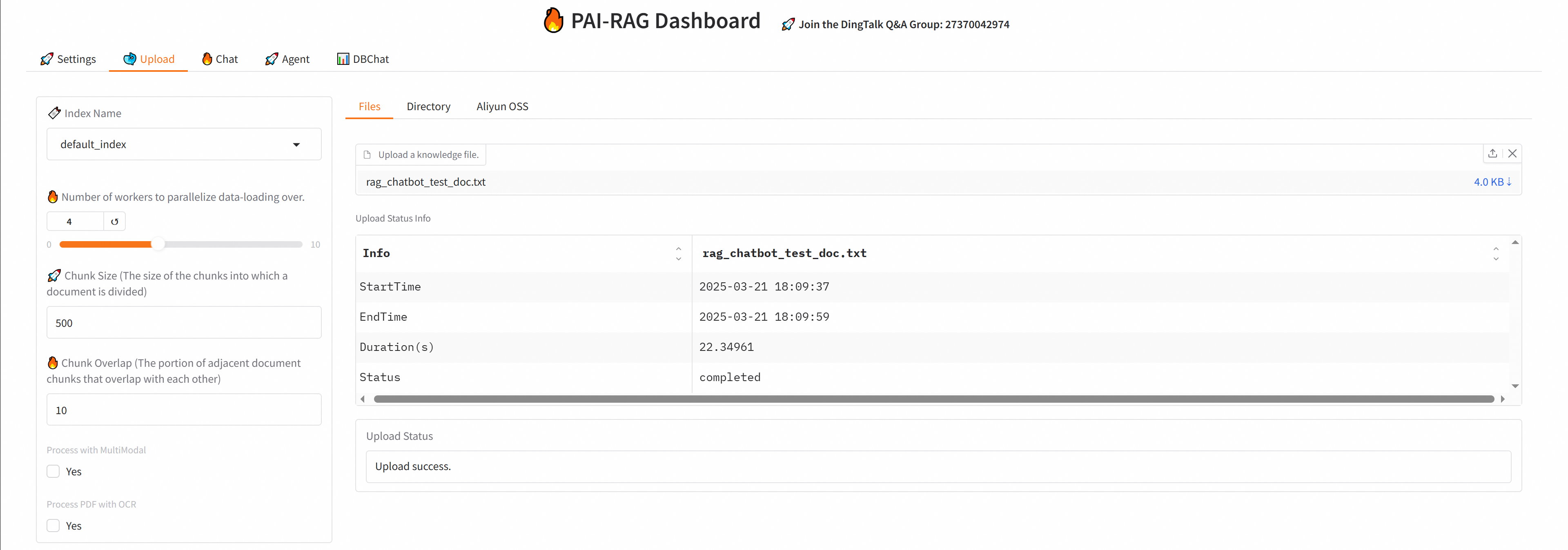

PAI-RAG ダッシュボードの [アップロード] タブで、ナレッジベースファイルをアップロードします。

ナレッジベースファイルが解析されてアップロードされると、Tablestore コンソール でファイルに書き込まれたベクトルデータを表示できます。

PAI-RAG ダッシュボードの [チャット] タブで、質問を入力し、[送信] をクリックして会話を開始します。

ベクトルデータベース、LLM、ナレッジベースでサポートされているファイルタイプの変更など、Web UI デバッグの詳細については、「RAG ベースの LLM チャットボット」をご参照ください。