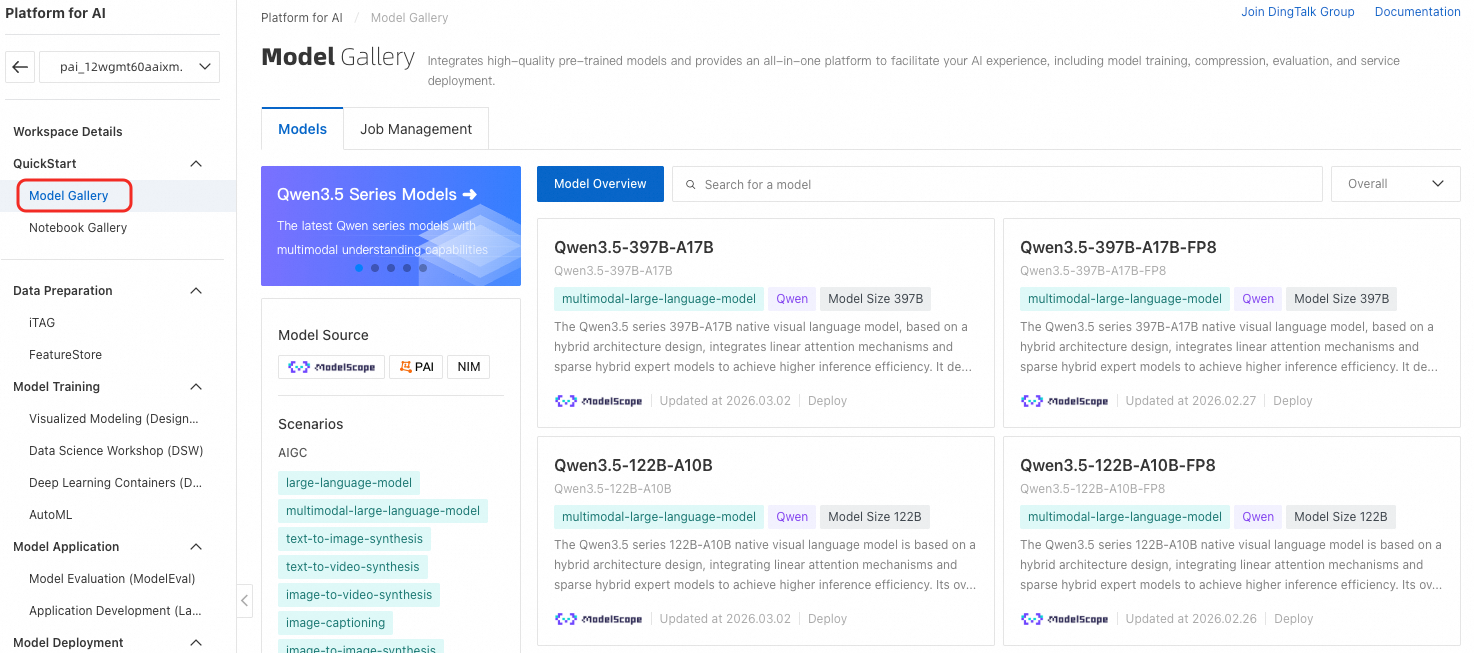

モデルギャラリーは、モデルの迅速なデプロイとトレーニングに役立つ、さまざまな事前学習済みモデルを提供します。

ビジネスに適したモデルの選択

モデルギャラリーは、ビジネス上の問題を解決するための幅広いモデルを提供しています。 ご利用のニーズに最適なモデルを見つけるには、次の点を考慮してください:

ドメインとタスクによる検索: アプリケーションのドメインと実行する必要があるタスクに基づいてモデルを検索します。

事前学習済みデータセットの確認: ほとんどのモデルには、事前学習に使用されたデータセットが記載されています。 事前学習済みデータセットがご利用のユースケースと密接に一致する場合、パフォーマンスは向上します。 事前学習済みデータセットに関する詳細は、モデルの製品ページで確認できます。

モデルサイズの考慮: 通常、パラメーター数が多いモデルほどパフォーマンスは高くなります。 しかし、その分サービス提供コストが高くなり、ファインチューニングにはより多くのデータが必要になります。

モデルを検索するには、次の手順を実行します:

モデルギャラリーページに移動します。

PAI コンソールにログインします。

左側のナビゲーションウィンドウで Workspaces をクリックし、対象のワークスペースを選択します。

左側のナビゲーションウィンドウで、QuickStart > Model Gallery をクリックします。

ビジネスに適したモデルを検索します。

その後、モデルをデプロイし、オンラインでデバッグし、その推論をテストできます。 詳細については、「モデルのデプロイ」および「モデルのファインチューニング」をご参照ください。

モデルのデプロイ

Qwen3-0.6B モデルのデプロイ例については、「モデルギャラリークイックスタート - モデルのデプロイ」をご参照ください。

モデルのファインチューニング

Qwen3-0.6B モデルのファインチューニング例については、「モデルギャラリークイックスタート - モデルのファインチューニング」をご参照ください。

ファインチューニング詳細ページでは、次のパラメーターを設定できます。

設定可能なパラメーターはモデルによって異なる場合があります。 ご利用の特定のモデルに基づいてパラメーターを設定してください。

課金

モデルギャラリーは無料で使用できます。 ただし、モデルのデプロイとトレーニングに使用される Elastic Algorithm Service (EAS) および Deep Learning Containers (DLC) のリソースに対して課金されます。 詳細については、「Elastic Algorithm Service (EAS) の課金」および「Deep Learning Containers (DLC) の課金」をご参照ください。

をクリックし、データセットの OSS パスを選択します。 Select OSS folder or file ダイアログボックスで、既存のデータファイルを選択するか、Upload file をクリックします。

をクリックし、データセットの OSS パスを選択します。 Select OSS folder or file ダイアログボックスで、既存のデータファイルを選択するか、Upload file をクリックします。 をクリックして、既存のデータセットを選択します。 データセットがない場合は、「

をクリックして、既存のデータセットを選択します。 データセットがない場合は、「