このトピックでは、PAI コンソール内の LangStudio を使用して、Web 検索機能を備えたインテリジェントチャットアプリケーションを迅速に構築する方法について説明します。このチュートリアルに従うことで、アプリケーションの作成、ワークフローの構築とテスト、パフォーマンス評価、オンラインサービスとしてのデプロイ、および運用監視に至るまでのエンドツーエンドの開発プロセスを学習できます。

ステップ 1:アプリケーションとランタイムの作成

まず、アプリケーションを作成し、開発とデバッグのためのランタイム環境を準備する必要があります。

PAI コンソールにログインします。上部ナビゲーションバーで、ターゲットリージョン(例:中国 (杭州))を選択します。

左側のナビゲーションウィンドウで、Model Application > Application Development (LangStudio) を選択し、対象のワークスペースを選択します。

Applications タブで、Create Application をクリックし、ドロップダウンリストから Workflow を選択します。

Create Application ページで、次のパラメーターを設定します。

Creation Method: Create by Type を選択し、その後 Chat Type を選択します。

Name: アプリケーション名を入力します(例:Web Search Chat Assistant)。

Select Runtime: ランタイムは、ワークフローの実行およびデバッグに必要なコンピューティング環境を提供します。デバッグを行う前に、ランタイムを設定する必要があります。

Existing runtime: ドロップダウンリストからランタイムを選択します。

No available runtime: New Runtime をクリックして、デフォルト設定でランタイムを作成します。ランタイムは開発およびデバッグ専用であり、最終的にデプロイされるサービスには影響しません。

Working Path: ワークフローの構成、ログ、デバッグ中に生成される一時ファイルを保存するための OSS バケットパスです。ランタイムを選択すると、このディレクトリが自動的に読み込まれます。

Description(任意): アプリケーションの目的に関する簡単な説明を入力します。

Confirm をクリックします。ワークフロー編集キャンバスに自動的に移動します。

ステップ 2:ワークフローの構築

キャンバス上には、Start node、Large Language Model (LLM) node、および End node で構成されたデフォルトのワークフローが表示されます。Web 検索機能を有効にするには、このワークフローに検索ノードを追加します。

ワークフローは、順序どおりに接続された複数のノードで構成されます。各ノードは特定のタスクを実行します。

2.1 ノードの追加と接続

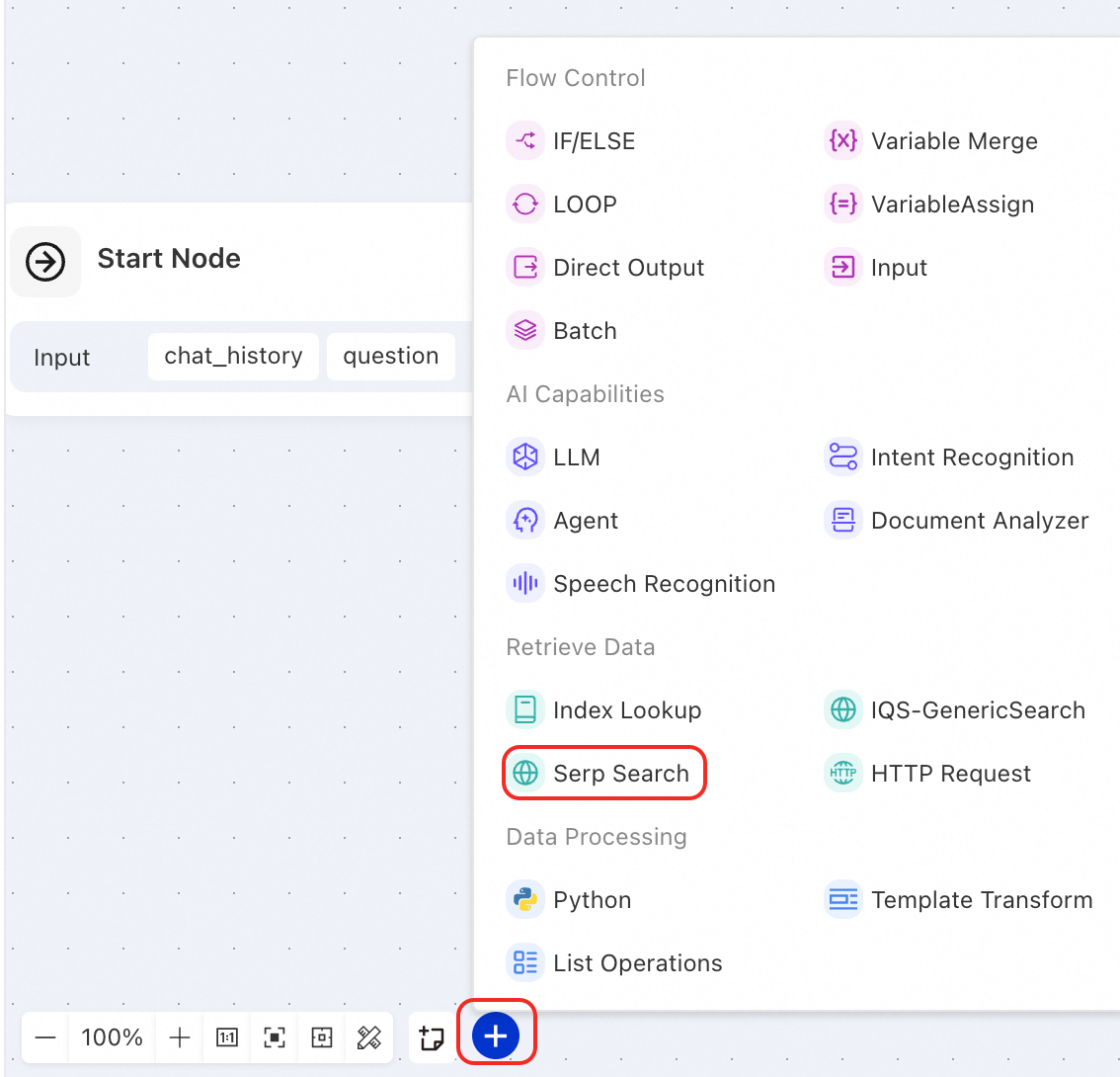

キャンバス下部でノード追加アイコンをクリックし、SerpAPI - Web Search を選択します。

Start node と LLM node の間の接続を削除します。

ノードを次の順序で接続します:Start node → SerpAPI - Web Search → LLM node。

2.2 ノードの構成

Start node: ワークフローのエントリーポイントであり、特別な構成は不要です。デフォルトで、ユーザークエリを受け取るための 2 つの入力パラメーター—

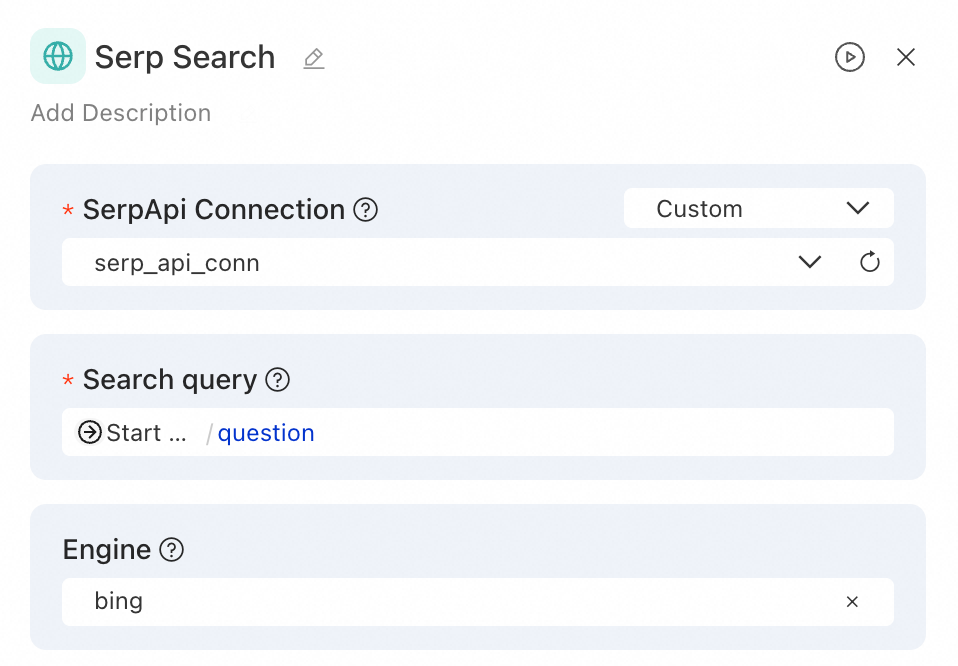

chat_historyおよびquestion—を提供します。SerpAPI - Web Search: このノードはユーザーの質問を検索キーワードとして受け取り、SerpAPI を呼び出して Web 検索を実行し、結果を次のノードに渡します。

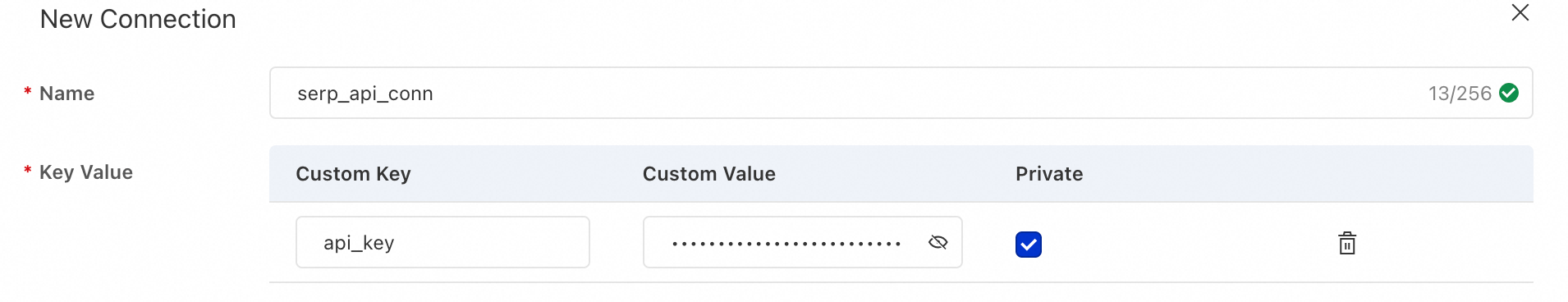

SerpAPI Connection: 事前構成済みの接続を選択します。存在しない場合は、 を選択します。Custom Key に

api_keyを入力し、Custom Value に SerpAPI から提供された API キーを入力し、Private を選択して安全に保存します。SerpAPI は無料クォータを提供しています。アカウントをお持ちでない場合は、登録してください。

Search Keywords: Start node の

question変数を選択します。

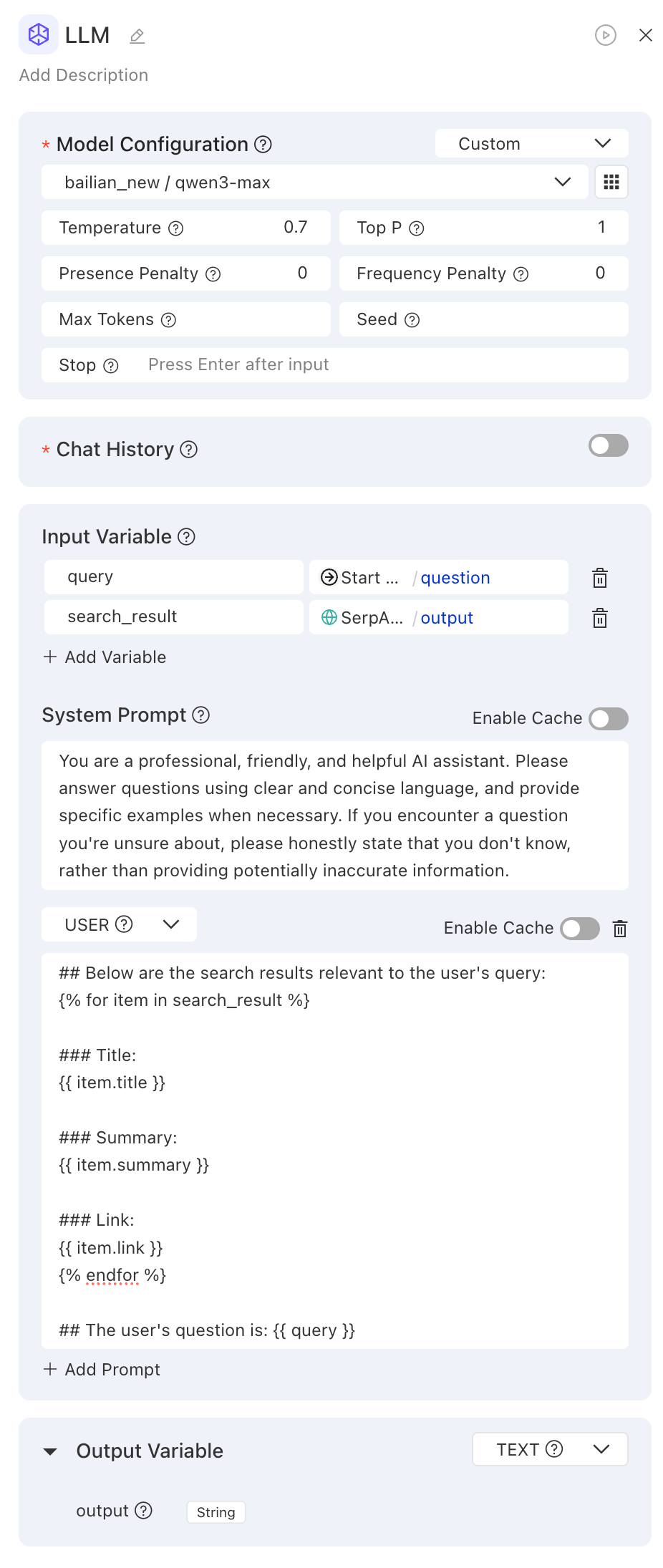

LLM node: このノードは元の質問と検索結果を受け取り、慎重に設計されたプロンプトを使用して、より正確かつ最新の応答を生成します。

Model settings: Alibaba Cloud Model Studio などのモデルサービスの接続を選択します(例:

qwen3-max)。説明接続は、LLM API などの外部サービスにアクセスするために必要な認証情報を安全に保存・管理します。接続をまだ構成していない場合は、作成する必要があります。詳細については、「Connection Configuration」をご参照ください。

Input Variable: Add Variable をクリックします。変数名を

search_resultに設定し、値を SerpAPI - Web Search ノードのoutput変数に設定します。System Prompt:

userのプロンプトテンプレートを修正し、検索ノードの出力を含めます。重要プロンプトテンプレートは、LLM ノードで定義された入力変数を参照する必要があります。

## Below are search results related to the user's question: {% for item in search_result %} ### Title: {{ item.title }} ### Content: {{ item.summary }} ### Link: {{ item.link }} {% endfor %} ## User's question: {{ query }}

ステップ 3:デバッグとトレースの確認

ワークフローを構築した後、デバッグ機能を使用してテストを行い、Tracing Analysis を使用してその実行を分析できます。

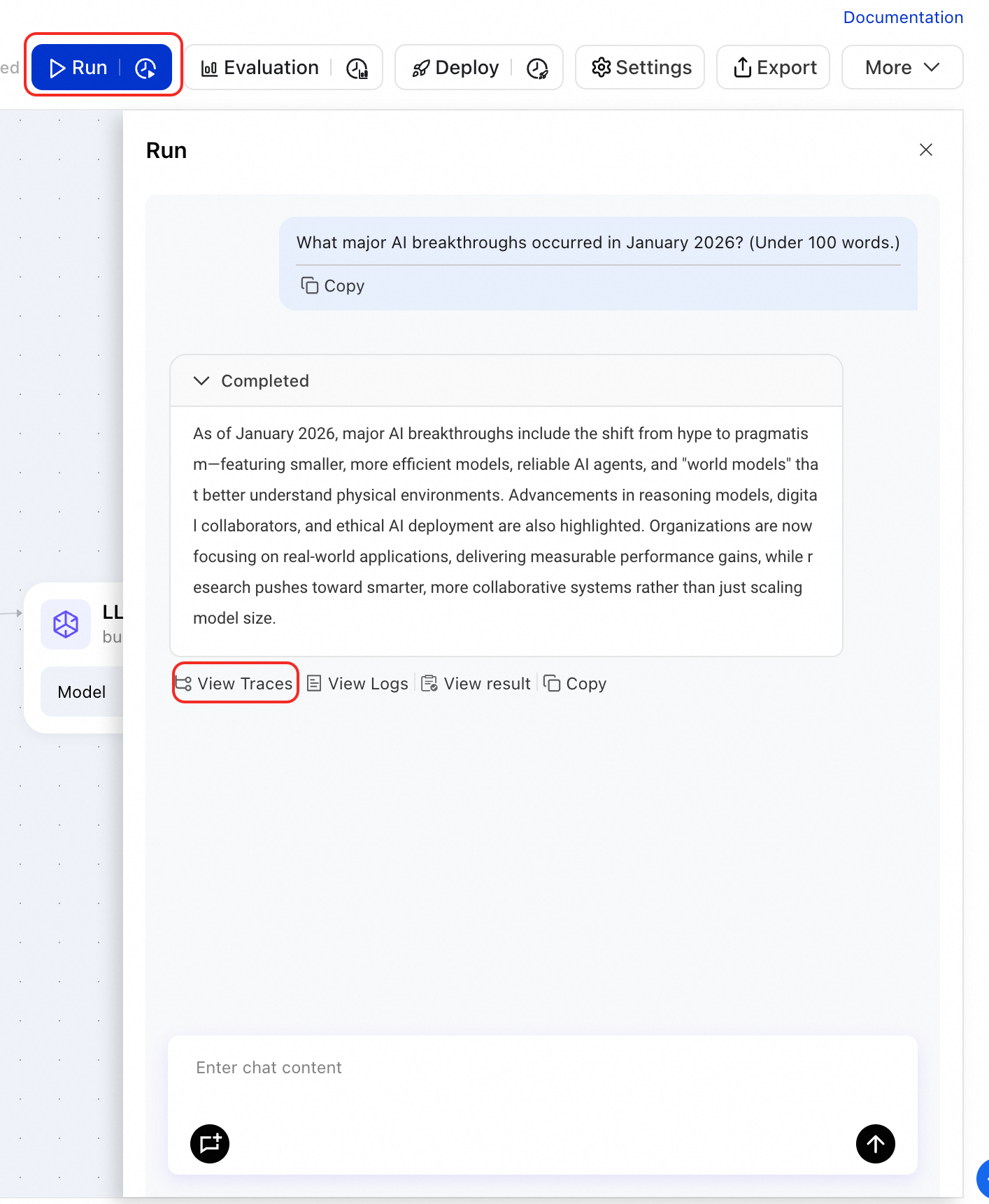

アプリケーションフローのキャンバス右上隅で、Run をクリックしてデバッグパネルを開きます。

デバッグパネルで質問を入力し、送信します(例:2026 年 1 月に発生した主な AI のブレークスルーは何ですか? 回答は 100 文字以内にしてください)。

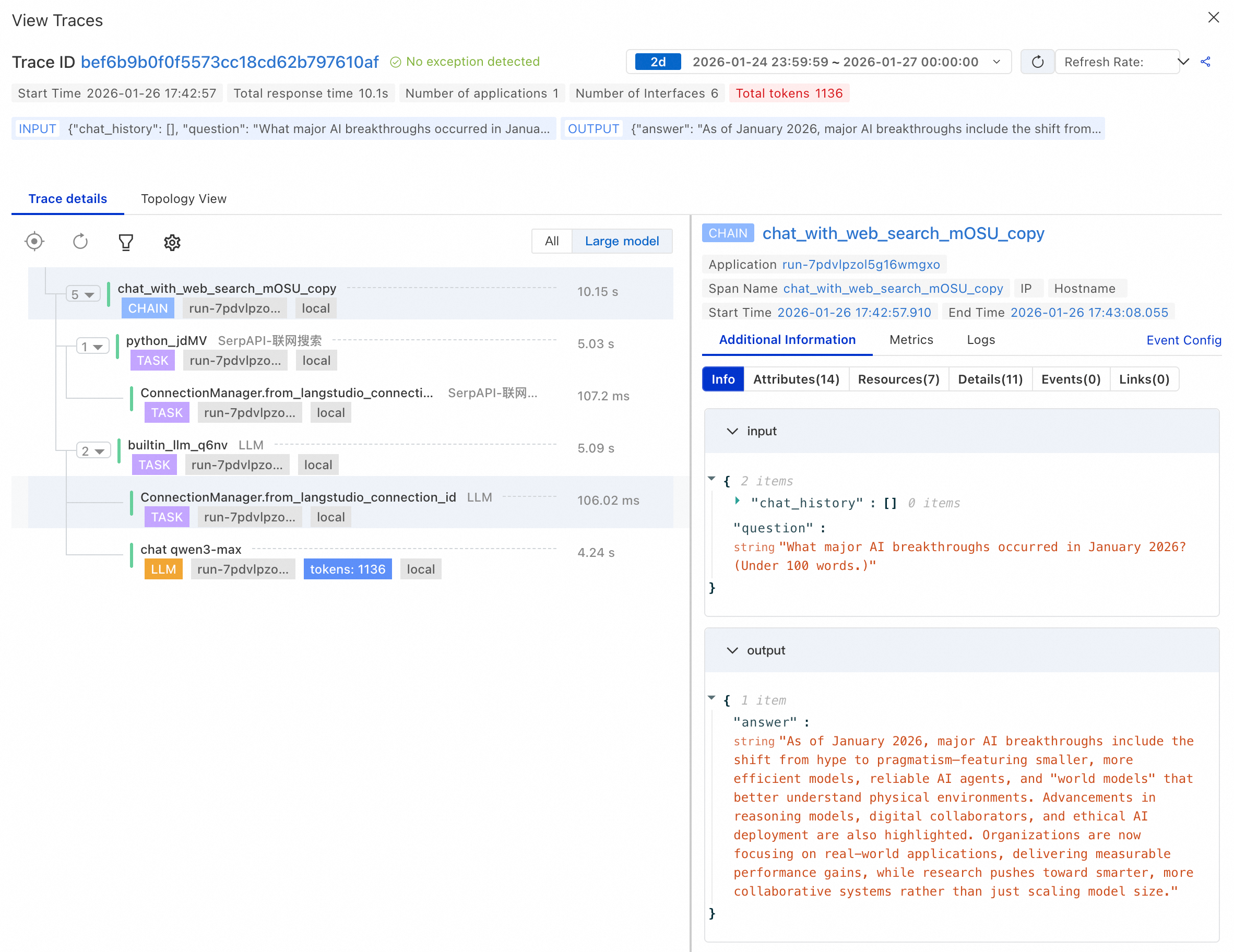

応答が表示されたら、応答の下にある View Traces をクリックして、トレースの詳細またはトポロジーを表示します。トレース詳細ページでは、以下の内容を分析できます。

ノードの入力および出力の確認: 各ノードを展開して、具体的な入力および出力内容を確認します。

デバッグのヒント: LLM node の詳細を展開して rendered prompt を確認します。これは、変数置換後に LLM に送信される完全なリクエストです。この内容を確認することが、プロンプト関連の問題をトラブルシューティングする最も効果的な方法です。

パフォーマンスの分析: 各ノードの実行時間を確認し、パフォーマンスボトルネックを特定します。

エラーのトラブルシューティング: ワークフロー実行中にエラーや異常が発生していないかを確認します。

ステップ 4:パフォーマンスの評価

アプリケーションのパフォーマンスを客観的に評価するには、評価機能を使用して一括でテスト質問を実行し、その有効性を定量化するメトリックを計算します。

評価データセットの準備。

.jsonl形式のデータセットを準備し、OSS にアップロードします。各行は、サンプル質問と対応する正解を含む JSON オブジェクトである必要があります。サンプルファイル:langstudio_eval_demo.jsonl。評価タスクの作成。

アプリケーションフローキャンバスの右上隅で、Evaluation をクリックします。

[評価タスクの作成] ページで、次のコアパラメーターを設定します:

Evaluation Dataset: アップロードした

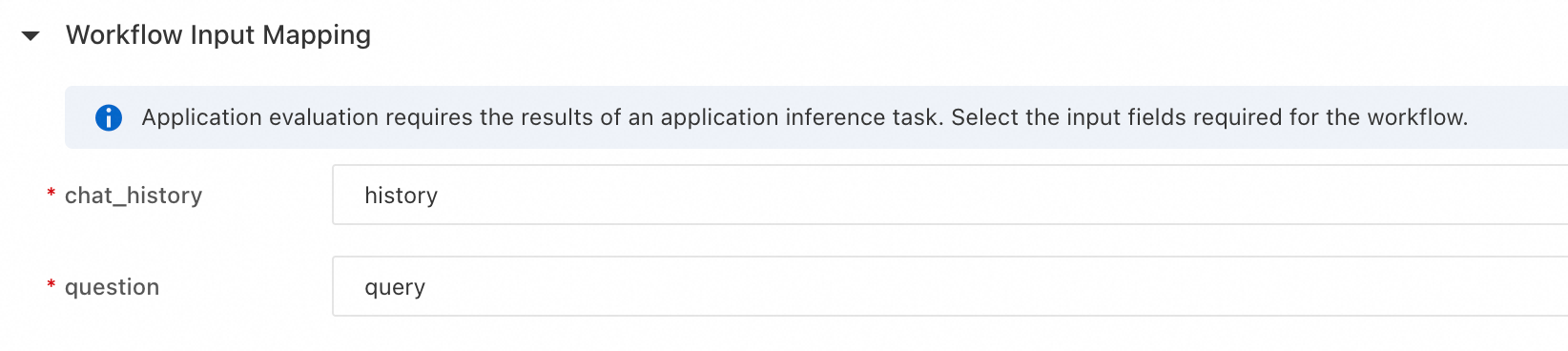

.jsonlファイルの OSS パスを選択します。Workflow Input Mapping: ワークフローの入力 (

question) を評価データセット内のqueryフィールドにマッピングします。

Evaluation Configuration: Answer Consistency Rate などの評価メトリックを選択します。

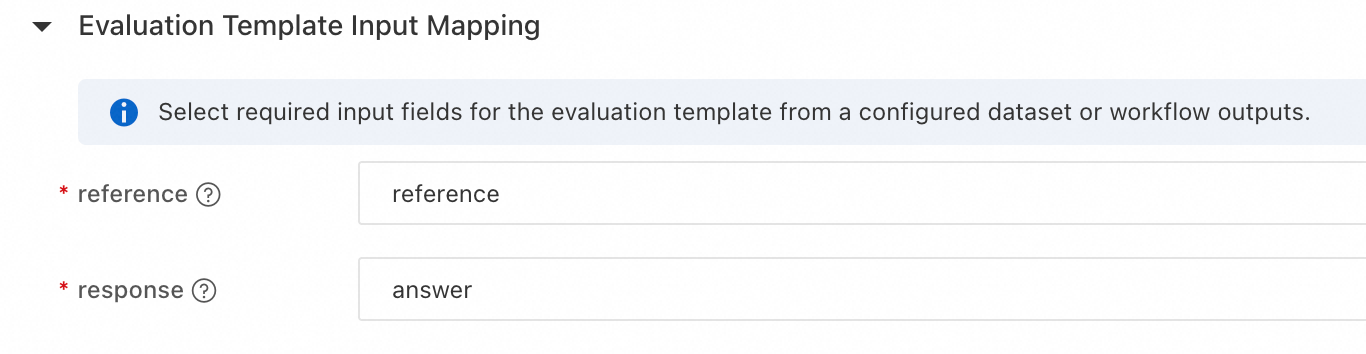

Evaluation Template Input Mapping:

reference: 評価データセットの正解フィールド

referenceを指定します。response: ワークフローの出力フィールドを選択します。

Confirm をクリックして評価タスクを送信します。

評価結果の確認。 タスクを送信すると、タスクの Overview ページに移動します。Metrics タブに切り替えて、Answer Consistency Rate などのメトリックのスコアを確認し、アプリケーションのパフォーマンスを評価します。

ステップ 5:オンラインサービスとしてのデプロイ

開発および評価が完了したら、ワークフローを標準的な PAI-EAS オンラインサービスとしてデプロイし、API 統合を行います。

サービスのデプロイ

アプリケーションフローキャンバスの右上隅で、Deploy をクリックします。

デプロイページで、サービス名、リソースグループ、ネットワーク設定(VPC、vSwitch)などのパラメーターを設定し、Confirm をクリックします。

重要ご利用のワークフローは、Alibaba Cloud Model Studio の LLM サービスや Web 検索サービスなど、パブリックネットワークアクセスを必要とするサービスを使用しています。EAS サービスはデフォルトでパブリックネットワークアクセスを持ちません。そのため、パブリックネットワークにアクセス可能な VPC および vSwitch を必ず構成する必要があります。たとえば、NAT Gateway に関連付けることができます。これを行わないと、サービス呼び出しが失敗します。詳細については、「Access Public or Private Network Resources from EAS」をご参照ください。

デプロイ進行状況ページで、Submit deployment をクリックします。

右上隅の Go to EAS をクリックして、EAS サービス詳細ページを開きます。サービスステータスが Running に変わるまで待ちます(5~10 分程度かかる場合があります)。

サービスの呼び出し

LangStudio アプリケーションサービスは、基本モードおよびフルモードの両方の呼び出しをサポートしています。以下は基本モード呼び出しの例です。詳細については、「Call a Deployed Application Flow」をご参照ください。

リクエスト本文の説明: JSON オブジェクトで、key はアプリケーションフローの Start node で定義された入力パラメーター(例:question)と一致している必要があります。

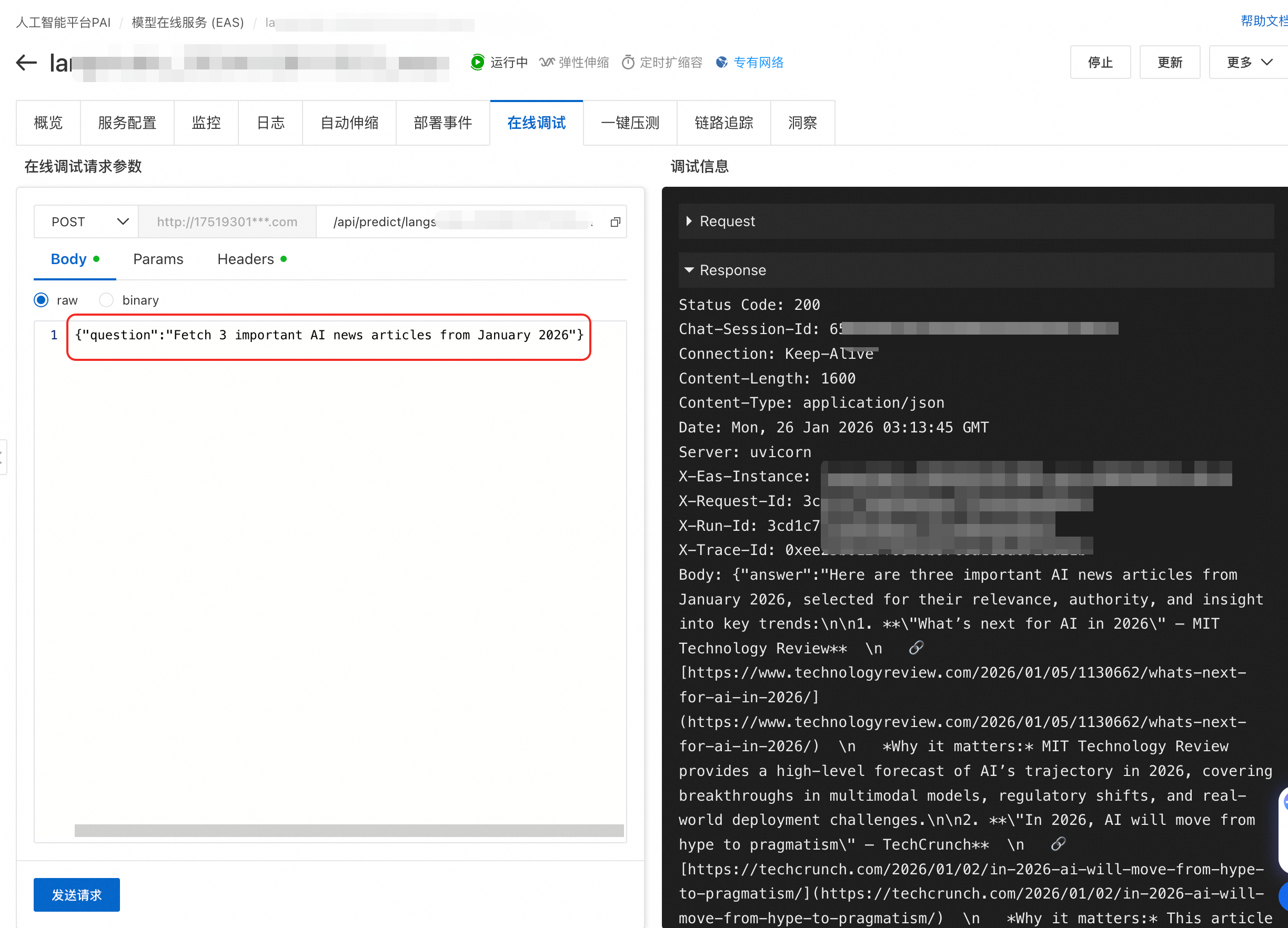

オンラインデバッグ

EAS サービス詳細ページの Online Debugging タブで呼び出しをテストすることを推奨します。

curl 呼び出し

EAS サービス詳細ページの Overview タブで、Basic Information、続いて View Endpoint Information をクリックして、エンドポイントおよび認証トークンを取得します。

# <EAS_ENDPOINT> と <EAS_TOKEN> をご自身のサービスエンドポイントと認証トークンに置き換えてください

curl -X POST '<EAS_ENDPOINT>' \

-H 'Authorization: <EAS_TOKEN>' \

-H 'Content-Type: application/json' \

-d '{

"question":"Get 3 important AI news items from January 2026"

}'ステップ 6:監視とオブザーバビリティ

デプロイ後、以下の操作が可能です。

EAS サービス詳細ページの Monitoring タブで、リクエスト数、成功率、エラー率、P95/P99 応答レイテンシなどの主要メトリックを確認します。

EAS の Logs タブでエラーログを確認し、問題のあるノードを特定します。

EAS の Tracing Analysis タブで呼び出しトレースを確認し、アプリケーションのパフォーマンスを評価します。

リソースのクリーンアップ

不要な課金を回避するため、実験完了後は作成したすべてのリソースをクリーンアップしてください。

PAI-EAS オンラインサービス: PAI-EAS コンソールでデプロイされたアプリケーションサービスを停止および削除します。

LangStudio ランタイム: LangStudio の Runtime タブで、ランタイムインスタンスを停止および削除できます。

OSS バケットに保存されたファイルは、アプリケーションを削除しても自動的には削除されません。ストレージ料金が発生しないよう、これらのファイルは手動で管理する必要があります。

次のステップ

以下の機能を試すことができます。

ドキュメント解析や条件付きブランチなどのノードをワークフローに追加して、より複雑なビジネスロジックをサポートします。詳細については、「Node Types and Configuration」をご参照ください。

Knowledge Base Management などの高度な LangStudio 機能。