OpenClaw は、さまざまなメッセージングチャンネルを通じて AI との対話をサポートする、オープンソースのパーソナル AI アシスタントプラットフォームです。Alibaba Cloud Model Studio の Qwen シリーズモデルと連携するように設定できます。

OpenClaw は以前、Moltbot/Clawdbot として知られていました。一部のコマンドはまだ移行されていない場合があります。新しいコマンド(例: openclaw dashboard)を使用した際に、command not found: openclaw エラーが発生した場合は、古いコマンド(例: clawdbot dashboard または moltbot dashboard)に切り替えて、操作を実行してください。

モデルのサポートと選択

OpenClaw は、OpenAI 互換インターフェイスを通じて Alibaba Cloud Model Studio のテキスト生成モデルをサポートしています。サポートされているモデルのリストは次のとおりです。

テキスト生成 - Qwen | |

テキスト生成 - Qwen - オープンソース | |

テキスト生成 - サードパーティモデル |

サードパーティのテキスト生成モデルは、中国 (北京) リージョンでのみ利用可能です。中国 (北京) リージョンのベース URL と API キーを使用してください。詳細については、「Alibaba Cloud Model Studio モデルの設定

OpenClaw を頻繁に使用する場合やコストを削減したい場合は、次のいずれかのプランにサブスクライブすることを推奨します。

Coding Plan の概要:月額固定のサブスクリプションプランで、月に最大 90,000 リクエストまで利用でき、頻繁なコーディングニーズに適しています。

設定手順

1. Alibaba Cloud Model Studio の有効化

アカウントを作成する: Alibaba Cloud アカウントをお持ちでない場合は、まず アカウントを作成します。

問題が発生した場合は、「Alibaba Cloud アカウントの作成」をご参照ください。

Alibaba Cloud Model Studio の有効化: ご自分の Alibaba Cloud アカウント を使用して、 Alibaba Cloud Model Studio プラットフォーム にアクセスします。サービス利用規約を読み、同意すると、Alibaba Cloud Model Studio が自動的に有効化されます。サービス利用規約が表示されない場合は、すでに有効化済みです。

サービスを有効にする際に「本人確認が完了していません」というメッセージが表示された場合は、まず本人確認を完了してください。

Alibaba Cloud Model Studio を初めて有効にすると、モデル推論サービスで利用できる新規ユーザー無料クォータ (Alibaba Cloud Model Studio の有効化後 90 日間有効) を申請できます。無料クォータの申請方法の詳細については、「新規ユーザー無料クォータ」ページをご参照ください。

クォータまたは有効期間を超過すると料金が発生します。このような状況で課金されないようにするには、利用限度額機能を有効にしてください。具体的な費用については、コンソールでの実際の見積もりと最終的な請求書をご参照ください。

2. OpenClaw のインストール

環境要件

OpenClaw には Node.js 22 以降が必要です。次のコマンドを使用して、ご利用の Node.js のバージョンを確認してください。

node --versionNode.js がインストールされていない、またはバージョンが古い場合は、Node.js の公式サイトにアクセスしてダウンロードし、インストールしてください。

インストール方法

macOS / Linux

公式のインストールスクリプトを使用します。

curl -fsSL https://openclaw.ai/install.sh | bashまたは、npm を介してグローバルにインストールします。

npm install -g openclaw@latestWindows

PowerShell で実行します。

iwr -useb https://openclaw.ai/install.ps1 | iexまたは、npm を使用してグローバルにインストールすることもできます。

npm install -g openclaw@latest初期設定ウィザードの完了

最初のインストール後、OpenClaw は自動的に構成ウィザードを起動して、初期設定をすばやく完了するのを支援します。また、openclaw onboard コマンドを手動で実行して設定することもできます。

設定項目 | 推奨設定 |

これは強力であり、本質的にリスクを伴うことを理解しています。続行しますか? | [はい] を選択します |

オンボーディングモード | [クイックスタート] を選択します |

モデル/認証プロバイダー | [今回はスキップ] を選択します(後で Alibaba Cloud Model Studio モデルを設定します) |

プロバイダーでモデルをフィルタリング | [すべてのプロバイダー] を選択します |

デフォルトモデル | [現在の設定を維持] を選択します |

チャンネルを選択(クイックスタート) | [今回はスキップ] を選択します(後でチャンネルを設定します) |

今すぐスキルを設定しますか?(推奨) | [いいえ] を選択します |

フックを有効にしますか? | Space キーを押してオプションを選択し、Enter キーを押して続行します。 |

ボットをどのように起動しますか? | [後で実行] を選択します |

次に、OpenClaw に Alibaba Cloud Model Studio モデルを設定して、AI チャット機能を有効にします。

3. Alibaba Cloud Model Studio モデルの設定

OpenClaw を Alibaba Cloud Model Studio のモデルサービスと連携させるには、次のパラメーターを設定します。

ベース URL、API キー、およびモデルが同じリージョンに属していることを確認してください。

ベース URL | リージョンによって異なります:

|

API キー | 本人確認と課金に使用される Model Studio アクセス認証情報は、[APIキー管理 (北京)] ページ、[APIキー管理 (シンガポール)] ページ、または [APIキー管理 (バージニア)] ページで入手できます。 |

モデル ID | 統合するモデルを指定します(例: サポートされているモデルはリージョンによって異なります。たとえば、米国(バージニア州)リージョンでは、現在 |

パラメーターを設定する際は、思考モードを無効化します("reasoning": false)。そうしないと、応答内容が Empty になります。

OpenClaw は 2 つの設定方法を提供しています。Web コンソールでの設定を推奨します。

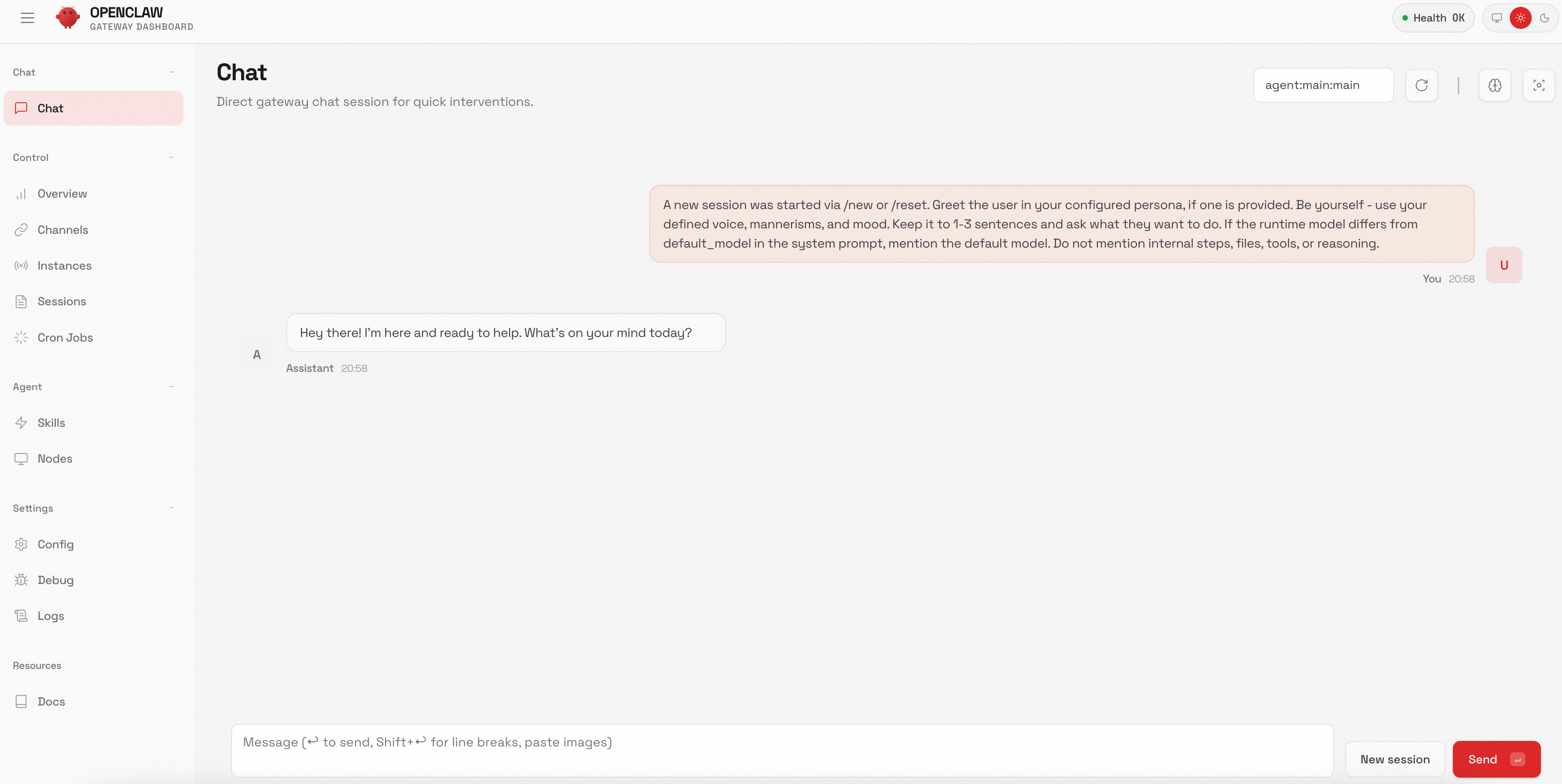

方法 1:Web コンソールでの設定

OpenClaw は、openclaw.json 構成ファイルを変更するための Web ベースのエディターを提供します。

Web コンソールの起動

ターミナルで次のコマンドを実行します。

openclaw dashboardブラウザが自動的に OpenClaw コンソールページ(通常は

http://127.0.0.1:18789)を開きます。ブラウザが自動的に開かない場合は、このアドレスに手動でアクセスしてください。

設定ページに移動

左側のナビゲーションウィンドウで、Configuration > RAW (または Config > RAW) を選択します。

Model Studio の設定を追加

左側のナビゲーションウィンドウで、[構成] > [RAW](または [Config] > [RAW])を選択します。以下の構成情報をコピーします。「

"agents": {...},」セクションを元のものから置き換えます。DASHSCOPE_API_KEYを、お客様の Alibaba Cloud Model Studio API キー に置き換えます。重要このドキュメントは、従量課金モードにのみ適用されます。Coding Plan では、アクセスに専用のベース URL と API キーが必要であり、特定のモデルのみをサポートしています。詳細については、「OpenClaw Coding Plan ドキュメント」をご参照ください。

以下の構成では、

qwen3.5-plusおよびqwen3-coder-nextモデルを、 シンガポール リージョンで使用します。 ベース URL および API キー のリージョンが一致していることを確認してください。他のモデルを使用するには、

providers.bailian.modelsにモデル定義を追加します (reasoningパラメーターをfalseに設定します)。agents.defaults.modelsに"bailian/Model ID": {}エントリを追加します。 各リージョンにおける従量課金モードでサポートされているモデルについては、「モデル一覧」をご参照ください。"models": { "mode": "merge", "providers": { "bailian": { "baseUrl": "https://dashscope-intl.aliyuncs.com/compatible-mode/v1", "apiKey": "DASHSCOPE_API_KEY", "api": "openai-completions", "models": [ { "id": "qwen3.5-plus", "name": "qwen3.5-plus", "reasoning": false, "input": ["text", "image"], "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "qwen3-coder-next", "name": "qwen3-coder-next", "reasoning": false, "input": ["text"], "contextWindow": 262144, "maxTokens": 65536 } ] } } }, "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" }, "models": { "bailian/qwen3.5-plus": {}, "bailian/qwen3-coder-next": {} } } },設定の保存と適用

設定後、右上の [Save] をクリックして設定を保存します。次に [Update] をクリックします。

方法 2:設定ファイルの編集

構成ファイルを直接編集する場合は、次の手順に従ってください。構成ファイルは、~/.openclaw/openclaw.json にあります。OpenClaw は起動時に自動的にこのファイルを読み込みます。

設定ファイルを開く

テキストエディターを使用して設定ファイルを開きます。ファイルが存在しない場合、エディターは自動的にファイルを作成します。

# vim など、他のエディターも使用できます。 # vim ~/.openclaw/openclaw.json nano ~/.openclaw/openclaw.jsonModel Studio の設定を追加

次の構成内容をコピーして貼り付けます。

DASHSCOPE_API_KEYを Alibaba Cloud Model Studio API キーに置き換えます。重要このドキュメントは、従量課金モードにのみ適用されます。Coding Plan では、アクセスに専用のベース URL と API キーが必要であり、特定のモデルのみをサポートしています。詳細については、「OpenClaw Coding Plan ドキュメント」をご参照ください。

以下の構成では、 シンガポール リージョンで

qwen3.5-plusおよびqwen3-coder-nextモデルを使用します。ベース URL と API キー のリージョンが一致していることを確認してください。他のモデルを使用するには、

reasoningパラメーターをfalseに設定し、providers.bailian.modelsにモデル定義を追加します。agents.defaults.modelsに"bailian/Model ID": {}エントリを追加します。 従量課金モードで各リージョンでサポートされているモデルについては、「モデルリスト」をご参照ください。{ "meta": { "lastTouchedVersion": "2026.2.1", "lastTouchedAt": "2026-02-03T08:20:00.000Z" }, "models": { "mode": "merge", "providers": { "bailian": { "baseUrl": "https://dashscope-intl.aliyuncs.com/compatible-mode/v1", "apiKey": "DASHSCOPE_API_KEY", "api": "openai-completions", "models": [ { "id": "qwen3.5-plus", "name": "qwen3.5-plus", "reasoning": false, "input": ["text", "image"], "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "qwen3-coder-next", "name": "qwen3-coder-next", "reasoning": false, "input": ["text"], "contextWindow": 262144, "maxTokens": 65536 } ] } } }, "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" }, "models": { "bailian/qwen3.5-plus": {}, "bailian/qwen3-coder-next": {} } } }, "gateway": { "mode": "local", "auth": { "mode": "token", "token": "test123" } } }設定ファイルの保存

nano エディターを使用している場合:

Ctrl+Xを押してエディターを終了します。保存を求められたら、

Yを押して確認します。ファイル名を確認するため、

Enterを押します。

vim エディターを使用している場合:

Escキーを押して、挿入モードから確実に退出します。:wqを入力し、Enterキーを押して保存して終了します。

設定の確認

次のコマンドを使用して設定ファイルの内容を表示し、設定が正しいことを確認します。

cat ~/.openclaw/openclaw.json

4. 対話の開始

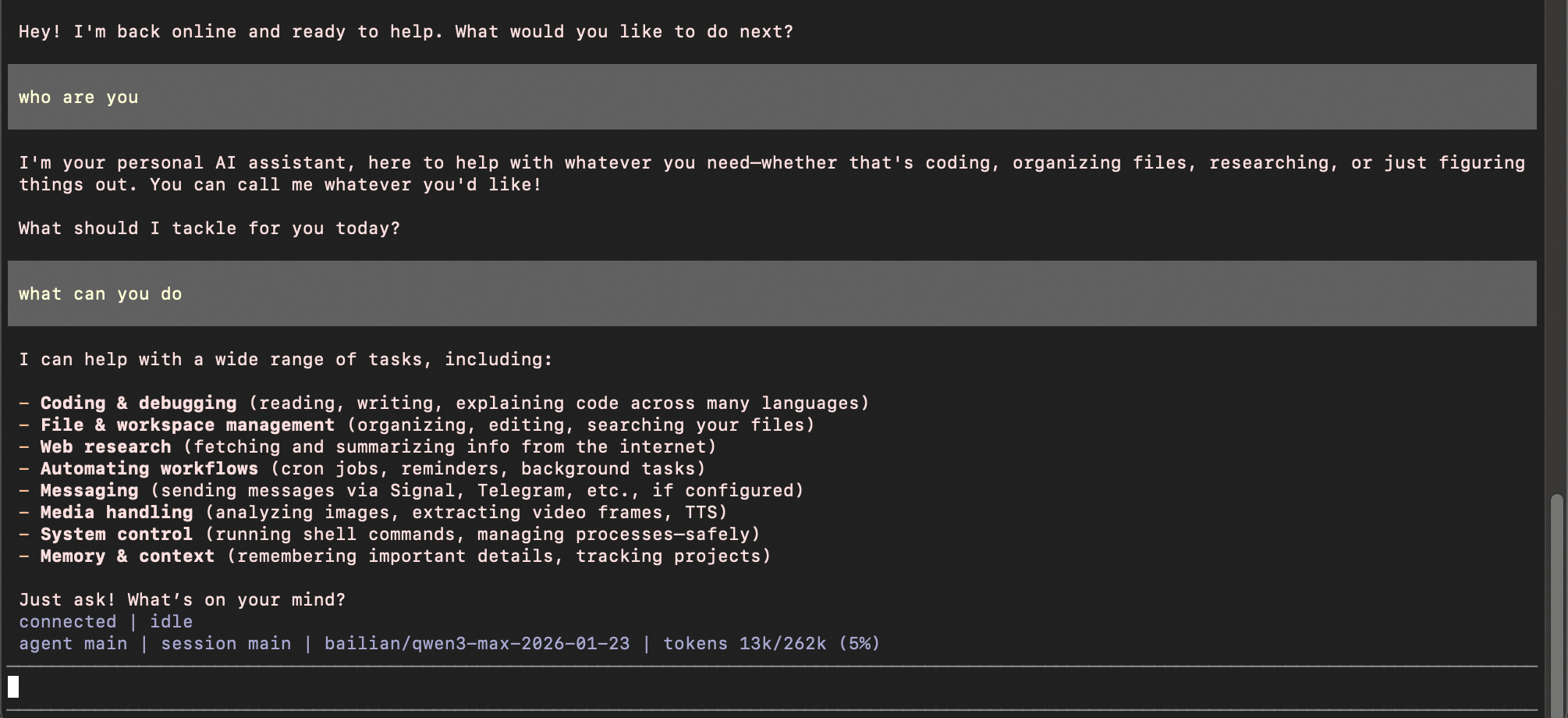

コマンドライン

クラウドサーバーまたはローカルターミナルで次のコマンドを実行して、コマンドライン経由で対話を開始します。

openclaw tui

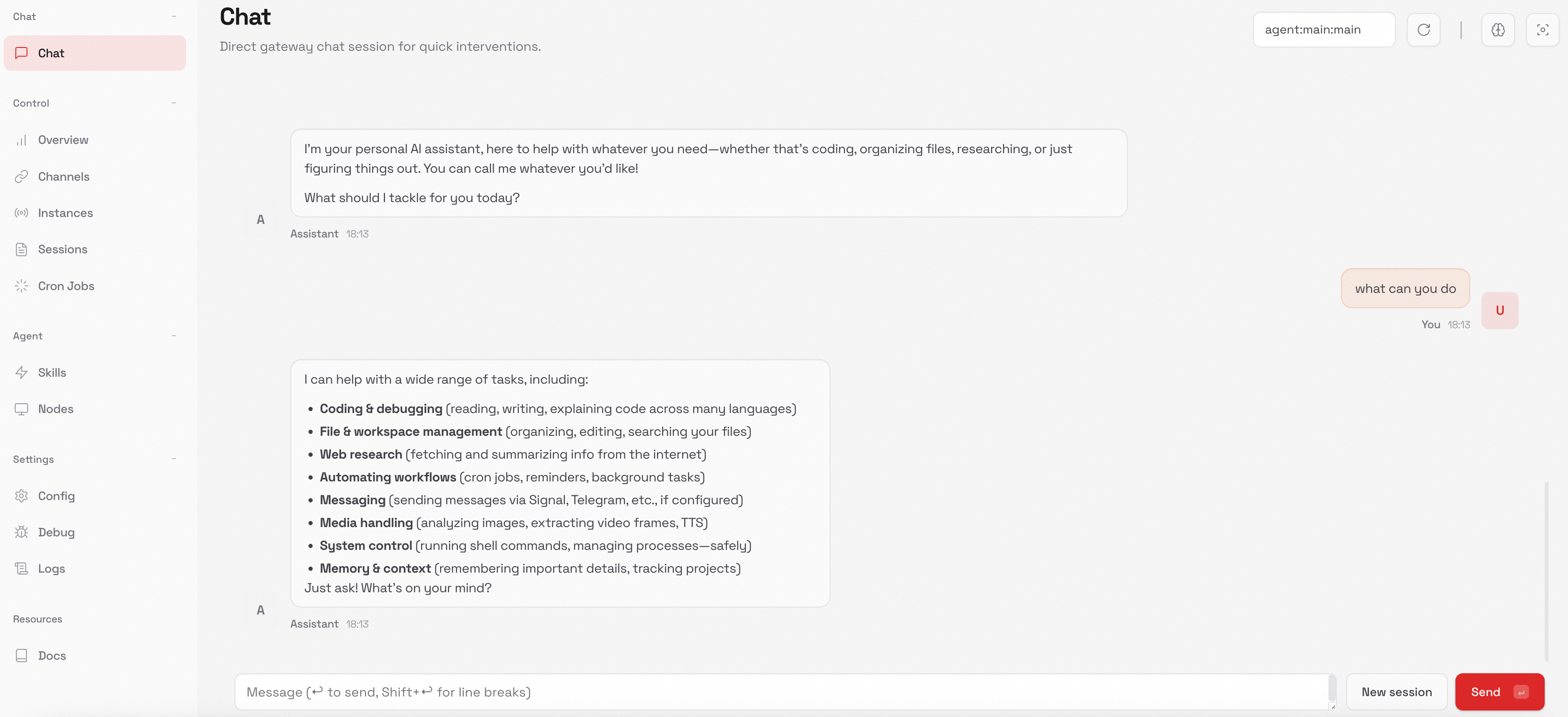

Web インターフェイス

クラウドサーバーまたはローカルターミナルで次のコマンドを実行して、Web インターフェイス経由で対話を開始します。

openclaw dashboard

モデルの切り替え

現在のセッションでモデルを切り替える (一時的)

ターミナルで

openclaw tuiを入力して、[TUI インターフェイス] に入ります。現在のセッションでモデルを切り替えるには、/model <model name>を使用します。/model qwen3-coder-nextインターフェイスは「model set to qwen3-coder-next」を返し、変更を確認します。

デフォルトモデルを切り替える (恒久的)

新規セッションごとに特定のモデルを使用するには、

agents.defaults.model.primaryフィールドを目的のモデルに変更します。{ "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" } } } }

よくある質問

問題 1:モデルが見つからない、または応答が空になる

次の点を確認してください。

モデル ID のスペルが正しいこと。

構成の

provider名は、リファレンスで使用されている名前と一致している必要があります (例: 構成にbailianが指定されている場合、リファレンスではbailian/qwen3.5-plusを使用します)。構成の

reasoningパラメーターは、falseに設定する必要があります。

問題 2:「openclaw」コマンド実行時に「command not found」エラーが発生する

これには、次の理由が考えられます。

OpenClaw のインストールが失敗しました。クラウドサーバーまたはローカル端末で

openclaw --versionを実行します。バージョン番号が表示された場合、インストールは成功しています。OpenClaw の名称変更プロセス中に、一部のコマンドが完全に移行されていない可能性があります。次のことを試してください。

古いコマンド

moltbotまたはclawdbotを代わりに使用してください。最新バージョンを再インストールします:

npm install -g openclaw@latest。