Alibaba Cloud Model Studio を使用して、OpenAI 互換 API または DashScope SDK から DeepSeek モデルを呼び出します。

モデルの可用性

ハイブリッド思考モデル(

enable_thinkingパラメーターで制御):deepseek-v3.2、deepseek-v3.2-exp、および deepseek-v3.1思考専用モデル(応答前に必ず思考処理を実行):deepseek-r1 および deepseek-r1-0528

非思考モデル:deepseek-v3

deepseek-v3.2 は、最新の DeepSeek モデルです。コーディングおよび数学のタスクに優れており、最も低価格で、より緩やかな レート制限 を提供します。デフォルトの選択肢としてご使用いただくことをおすすめします。

現在、international(シンガポール)リージョンでは、deepseek-v3.2 モデルのみが利用可能です。詳細については、「モデル一覧」をご参照ください。

モデル | コンテキストウィンドウ | 最大入力 | 最大 CoT | 最大応答 |

(トークン) | ||||

deepseek-v3.2 685B サイズ | 131,072 | 98,304 | 32,768 | 65,536 |

deepseek-v3.2-exp 685B サイズ | ||||

deepseek-v3.1 685B サイズ | ||||

deepseek-r1 685B サイズ | 16,384 | |||

deepseek-r1-0528 685B サイズ | ||||

deepseek-v3 671B サイズ | 131,072 | - | ||

Max CoT は、思考モードにおける思考プロセスの最大トークン数です。

上記のモデルは、統合された第三者サービスではなく、すべて Model Studio サーバー上で展開されています。

同時リクエスト制限については、「DeepSeek のレート制限」をご参照ください。

クイックスタート

deepseek-v3.2 は DeepSeek シリーズの最新モデルです。enable_thinking パラメーターを使用して、思考モードとノンシンキングモードを切り替えます。以下の例では、思考モードで deepseek-v3.2 を呼び出す方法を示します。

開始する前に、API キーを取得し、環境変数としてエクスポートしてください。SDK を使用してモデルを呼び出す場合は、OpenAI または DashScope SDK をインストールしてください。

OpenAI 互換

enable_thinking パラメーターは OpenAI の標準パラメーターではありません。OpenAI Python SDK では、このパラメーターを extra_body に渡します。Node.js SDK では、最上位レベルのパラメーターとして渡します。

Python

サンプルコード

from openai import OpenAI

import os

# OpenAI クライアントを初期化

client = OpenAI(

# 環境変数が設定されていない場合は、Model Studio API キーを置き換えます:api_key="sk-xxx"

api_key=os.getenv("DASHSCOPE_API_KEY"),

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

)

messages = [{"role": "user", "content": "あなたは誰ですか"}]

completion = client.chat.completions.create(

model="deepseek-v3.2",

messages=messages,

# 思考モードを有効にするには、extra_body に enable_thinking を設定します

extra_body={"enable_thinking": True},

stream=True,

stream_options={

"include_usage": True

},

)

reasoning_content = "" # 完全な思考プロセス

answer_content = "" # 完全な応答

is_answering = False # 応答フェーズが開始されたかどうかを示す

print("\n" + "=" * 20 + "思考プロセス" + "=" * 20 + "\n")

for chunk in completion:

if not chunk.choices:

print("\n" + "=" * 20 + "トークン使用量" + "=" * 20 + "\n")

print(chunk.usage)

continue

delta = chunk.choices[0].delta

# 思考コンテンツのみを収集

if hasattr(delta, "reasoning_content") and delta.reasoning_content is not None:

if not is_answering:

print(delta.reasoning_content, end="", flush=True)

reasoning_content += delta.reasoning_content

# コンテンツを受信したときに応答を開始

if hasattr(delta, "content") and delta.content:

if not is_answering:

print("\n" + "=" * 20 + "完全な応答" + "=" * 20 + "\n")

is_answering = True

print(delta.content, end="", flush=True)

answer_content += delta.content応答

====================思考プロセス====================

ユーザーが「あなたは誰ですか」と尋ねています。これは非常に一般的なオープニング質問です。私は自分の ID と機能を簡潔かつ明確に紹介する必要があります。会社の背景とコア機能から始めることで、ユーザーが素早く理解できるようにします。

無料で利用できることやテキストベースの強みを強調しますが、詳細には立ち入りません。最後にオープンエンドの質問で会話を誘導することで、アシスタントとしての性質に合致させます。

企業向け AI アシスタントとしてのポジショニングは、プロフェッショナルでありながらフレンドリーです。括弧内の絵文字は親しみやすさを加えます。

====================完全な応答====================

こんにちは!私は DeepSeek という AI アシスタントで、DeepSeek 社によって開発されました。

私はテキストのみを扱うモデルです。マルチモーダル認識はサポートしていませんが、画像、txt、pdf、ppt、word、excel などのファイルをアップロードして処理し、そのテキスト情報を読み取ってお手伝いすることが可能です。完全に無料で利用でき、128K のコンテキストウィンドウを備えており、Web 検索(Web/アプリで手動で有効化が必要)もサポートしています。

私の知識は 2024 年 7 月まで更新されています。情熱と配慮を持ってお手伝いいたします。アプリは公式アプリストアからダウンロードできます。

何かお手伝いできることがあれば、ぜひお知らせください。学業、仕事、日常生活に関するご質問でも、喜んでお答えします! ✨

====================トークン使用量====================

CompletionUsage(completion_tokens=238, prompt_tokens=5, total_tokens=243, completion_tokens_details=CompletionTokensDetails(accepted_prediction_tokens=None, audio_tokens=None, reasoning_tokens=93, rejected_prediction_tokens=None), prompt_tokens_details=None)Node.js

サンプルコード

import OpenAI from "openai";

import process from 'process';

// OpenAI クライアントを初期化

const openai = new OpenAI({

// 環境変数が設定されていない場合は、Model Studio API キーを置き換えます:apiKey: "sk-xxx"

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1'

});

let reasoningContent = ''; // 完全な思考プロセス

let answerContent = ''; // 完全な応答

let isAnswering = false; // 応答フェーズが開始されたかどうかを示す

async function main() {

try {

const messages = [{ role: 'user', content: 'あなたは誰ですか' }];

const stream = await openai.chat.completions.create({

model: 'deepseek-v3.2',

messages,

// 注意:Node.js SDK では、enable_thinking などの非標準パラメーターは最上位レベルのプロパティとして渡すため、extra_body に含める必要はありません。

enable_thinking: true,

stream: true,

stream_options: {

include_usage: true

},

});

console.log('\n' + '='.repeat(20) + '思考プロセス' + '='.repeat(20) + '\n');

for await (const chunk of stream) {

if (!chunk.choices?.length) {

console.log('\n' + '='.repeat(20) + 'トークン使用量' + '='.repeat(20) + '\n');

console.log(chunk.usage);

continue;

}

const delta = chunk.choices[0].delta;

// 思考コンテンツのみを収集

if (delta.reasoning_content !== undefined && delta.reasoning_content !== null) {

if (!isAnswering) {

process.stdout.write(delta.reasoning_content);

}

reasoningContent += delta.reasoning_content;

}

// コンテンツを受信したときに応答を開始

if (delta.content !== undefined && delta.content) {

if (!isAnswering) {

console.log('\n' + '='.repeat(20) + '完全な応答' + '='.repeat(20) + '\n');

isAnswering = true;

}

process.stdout.write(delta.content);

answerContent += delta.content;

}

}

} catch (error) {

console.error('エラー:', error);

}

}

main();応答

====================思考プロセス====================

ユーザーが「あなたは誰ですか」と尋ねています。これは非常に基本的な自己紹介の質問です。私は自分の ID とコア機能を簡潔かつ明確に述べる必要があります。複雑さを避け、会社の背景と基本的なポジショニングから始め、ユーザーが素早く理解できるようにします。

ユーザーが初心者である可能性を考慮し、無料であること、長いコンテキスト、ファイル処理といった代表的な機能や特徴を追加します。フレンドリーな姿勢で助けを提供するオープンエンドの質問で締めくくります。

技術的な詳細は不要で、使いやすさと実用性に焦点を当てます。

====================完全な応答====================

こんにちは!私は DeepSeek という AI アシスタントで、DeepSeek 社によって開発されました。

私はテキストのみを扱うモデルで、128K のコンテキストウィンドウを備えており、質問への回答、会話、テキストベースのタスクのお手伝いが可能です。マルチモーダル認識はサポートしていませんが、画像、txt、pdf、ppt、word、excel などのファイルをアップロードして処理し、そのテキスト情報を読み取ってお手伝いすることが可能です。

完全に無料で利用でき、音声機能はありませんが、アプリは公式アプリストアからダウンロードできます。Web 検索を利用するには、Web またはアプリで手動で有効化する必要があります。

私の知識は 2024 年 7 月まで更新されています。情熱と配慮を持ってお手伝いいたします。ご質問やお手伝いが必要な場合は、いつでもお知らせください!喜んでお答えします。 ✨

====================トークン使用量====================

{

prompt_tokens: 5,

completion_tokens: 243,

total_tokens: 248,

completion_tokens_details: { reasoning_tokens: 83 }

}HTTP

サンプルコード

curl

curl -X POST https://dashscope-intl.aliyuncs.com/compatible-mode/v1/chat/completions \

-H "Authorization: Bearer $DASHSCOPE_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "deepseek-v3.2",

"messages": [

{

"role": "user",

"content": "あなたは誰ですか"

}

],

"stream": true,

"stream_options": {

"include_usage": true

},

"enable_thinking": true

}'DashScope

Python

サンプルコード

import os

import dashscope

from dashscope import Generation

dashscope.base_http_api_url = "https://dashscope-intl.aliyuncs.com/api/v1"

# リクエストパラメーターを初期化

messages = [{"role": "user", "content": "あなたは誰ですか?"}]

completion = Generation.call(

# 環境変数が設定されていない場合は、Model Studio API キーを置き換えます:api_key="sk-xxx"

api_key=os.getenv("DASHSCOPE_API_KEY"),

model="deepseek-v3.2",

messages=messages,

result_format="message", # 結果フォーマットを message に設定

enable_thinking=True,

stream=True, # ストリーミング出力を有効化

incremental_output=True, # 増分出力を有効化

)

reasoning_content = "" # 完全な思考プロセス

answer_content = "" # 完全な応答

is_answering = False # 応答フェーズが開始されたかどうかを示す

print("\n" + "=" * 20 + "思考プロセス" + "=" * 20 + "\n")

for chunk in completion:

message = chunk.output.choices[0].message

# 思考コンテンツのみを収集

if "reasoning_content" in message:

if not is_answering:

print(message.reasoning_content, end="", flush=True)

reasoning_content += message.reasoning_content

# コンテンツを受信したときに応答を開始

if message.content:

if not is_answering:

print("\n" + "=" * 20 + "完全な応答" + "=" * 20 + "\n")

is_answering = True

print(message.content, end="", flush=True)

answer_content += message.content

print("\n" + "=" * 20 + "トークン使用量" + "=" * 20 + "\n")

print(chunk.usage)応答

====================思考プロセス====================

ああ、ユーザーが「あなたは誰ですか」と尋ねています。これは非常に基本的な自己紹介の質問です。私は自分の ID と機能を簡潔かつ明確に述べる必要があります。複雑さを避け、会社のバックグラウンドとコア機能から始めることで、ユーザーが素早く理解できるようにします。

ユーザーが初心者である可能性を考慮し、無料であること、長いコンテキスト、ファイル処理といった代表的な機能や特徴を追加します。フレンドリーな姿勢で助けを提供するオープンエンドの招待で締めくくります。

技術的な詳細は不要で、使いやすさと実用性に焦点を当てます。

====================完全な応答====================

こんにちは!私は DeepSeek という AI アシスタントで、DeepSeek 社によって開発されました。

私はテキストのみを扱うモデルです。マルチモーダル認識はサポートしていませんが、画像、txt、pdf、ppt、word、excel などのファイルをアップロードして処理し、そのテキスト情報を読み取って分析することが可能です。完全に無料で利用でき、128K のコンテキストウィンドウを備えており、Web 検索(手動で有効化が必要)もサポートしています。

私の知識は 2024 年 7 月まで更新されています。情熱と配慮を持ってお手伝いいたします。アプリは公式アプリストアからダウンロードできます。

ご質問やお手伝いが必要な場合は、いつでもお知らせください!さまざまなタスクについて、喜んでお答えし、お手伝いいたします。 ✨

====================トークン使用量====================

{"input_tokens": 6, "output_tokens": 240, "total_tokens": 246, "output_tokens_details": {"reasoning_tokens": 92}}Java

サンプルコード

DashScope Java SDK のバージョン 2.19.4 以降を使用してください。

// DashScope SDK のバージョンは 2.19.4 以降である必要があります。

import com.alibaba.dashscope.aigc.generation.Generation;

import com.alibaba.dashscope.aigc.generation.GenerationParam;

import com.alibaba.dashscope.aigc.generation.GenerationResult;

import com.alibaba.dashscope.common.Message;

import com.alibaba.dashscope.common.Role;

import com.alibaba.dashscope.exception.ApiException;

import com.alibaba.dashscope.exception.InputRequiredException;

import com.alibaba.dashscope.exception.NoApiKeyException;

import io.reactivex.Flowable;

import java.lang.System;

import java.util.Arrays;

public class Main {

private static StringBuilder reasoningContent = new StringBuilder();

private static StringBuilder finalContent = new StringBuilder();

private static boolean isFirstPrint = true;

private static void handleGenerationResult(GenerationResult message) {

String reasoning = message.getOutput().getChoices().get(0).getMessage().getReasoningContent();

String content = message.getOutput().getChoices().get(0).getMessage().getContent();

if (reasoning != null && !reasoning.isEmpty()) {

reasoningContent.append(reasoning);

if (isFirstPrint) {

System.out.println("====================思考プロセス====================");

isFirstPrint = false;

}

System.out.print(reasoning);

}

if (content != null && !content.isEmpty()) {

finalContent.append(content);

if (!isFirstPrint) {

System.out.println("\n====================完全な応答====================");

isFirstPrint = true;

}

System.out.print(content);

}

}

private static GenerationParam buildGenerationParam(Message userMsg) {

return GenerationParam.builder()

// 環境変数が設定されていない場合は、Model Studio API キーを置き換えます: .apiKey("sk-xxx")

.apiKey(System.getenv("DASHSCOPE_API_KEY"))

.model("deepseek-v3.2")

.enableThinking(true)

.incrementalOutput(true)

.resultFormat("message")

.messages(Arrays.asList(userMsg))

.build();

}

public static void streamCallWithMessage(Generation gen, Message userMsg)

throws NoApiKeyException, ApiException, InputRequiredException {

GenerationParam param = buildGenerationParam(userMsg);

Flowable<GenerationResult> result = gen.streamCall(param);

result.blockingForEach(message -> handleGenerationResult(message));

}

public static void main(String[] args) {

try {

Generation gen = new Generation("http", "https://dashscope-intl.aliyuncs.com/api/v1");

Message userMsg = Message.builder().role(Role.USER.getValue()).content("あなたは誰ですか?").build();

streamCallWithMessage(gen, userMsg);

} catch (ApiException | NoApiKeyException | InputRequiredException e) {

System.err.println("例外が発生しました:" + e.getMessage());

}

}

}応答

====================思考プロセス====================

ふむ、ユーザーがシンプルな自己紹介の質問をしています。これはよくある問い合わせなので、私は自分の ID と機能を明確かつ迅速に述べる必要があります。リラックスしたフレンドリーなトーンで、DeepSeek 社によって作成された DeepSeek-V3 というインテリジェントアシスタントであると自己紹介します。また、質問への回答、提案、情報検索、会話など、どのようなお手伝いができるかも伝えます。最後に、より親しみやすい印象を与えるために絵文字を追加します。簡潔かつ明瞭に保つことが重要です。

====================完全な応答====================

私は DeepSeek-V3 という、DeepSeek 社が開発したインテリジェントアシスタントです!さまざまな質問への回答、提案、情報検索、さらには会話も可能です!学業、仕事、日常生活に関するご質問は、何でもお気軽にお尋ねください。どのようにお手伝いしましょうか?HTTP

サンプルコード

curl

curl -X POST "https://dashscope-intl.aliyuncs.com/api/v1/services/aigc/text-generation/generation" \

-H "Authorization: Bearer $DASHSCOPE_API_KEY" \

-H "Content-Type: application/json" \

-H "X-DashScope-SSE: enable" \

-d '{

"model": "deepseek-v3.2",

"input":{

"messages":[

{

"role": "user",

"content": "あなたは誰ですか?"

}

]

},

"parameters":{

"enable_thinking": true,

"incremental_output": true,

"result_format": "message"

}

}'その他の特徴

モデル | |||||

deepseek-v3.2 | |||||

deepseek-v3.2-exp | ノンシンキングモードでのみ対応。 | ||||

deepseek-v3.1 | ノンシンキングモードでのみ対応。 | ||||

deepseek-r1 | |||||

deepseek-r1-0528 | |||||

deepseek-v3 | |||||

蒸留モデル |

デフォルトパラメーター値

モデル | 温度 | top_p | repetition_penalty | presence_penalty | max_tokens | thinking_budget |

deepseek-v3.2 | 1.0 | 0.95 | - | - | 65,536 | 32,768 |

deepseek-v3.2-exp | 0.6 | 0.95 | 1.0 | - | 65,536 | 32,768 |

deepseek-v3.1 | 0.6 | 0.95 | 1.0 | - | 65,536 | 32,768 |

deepseek-r1 | 0.6 | 0.95 | - | 1 | 16,384 | 32,768 |

deepseek-r1-0528 | 0.6 | 0.95 | - | 1 | 16,384 | 32,768 |

蒸留モデル | 0.6 | 0.95 | - | 1 | 16,384 | 16,384 |

deepseek-v3 | 0.7 | 0.6 | - | - | 16,384 | - |

ハイフン(-)は、該当パラメーターにデフォルト値がなく、設定できないことを示します。

deepseek-r1、deepseek-r1-0528、および蒸留モデルは、これらのパラメーターをサポートしません。

パラメーター定義の詳細については、「OpenAI Chat」をご参照ください。

課金

課金は、入力トークンおよび出力トークンの数に基づいて行われます。料金の詳細については、「モデル一覧および料金」をご参照ください。

思考モードでは、CoT トークンは出力トークンとして課金されます。

よくある質問

画像やドキュメントをアップロードして質問することは可能ですか?

DeepSeek モデルはテキスト入力のみを受け付けます。画像やドキュメントの入力はサポートしていません。Qwen-VL は画像入力をサポートし、Qwen-Long はドキュメント入力をサポートしています。

トークン使用量および呼び出し回数を確認するにはどうすればよいですか?

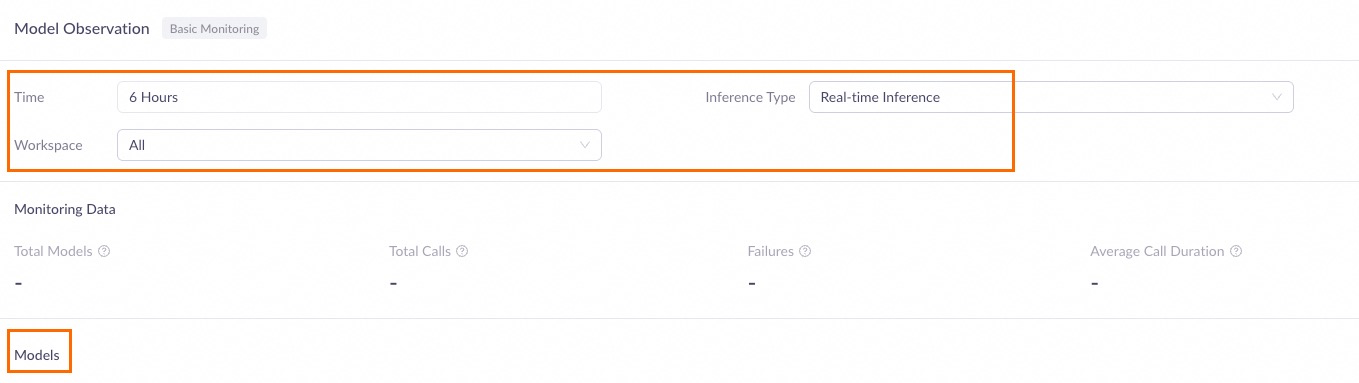

モデルを呼び出してから1時間後、モニタリング ページに移動し、フィルター(時間範囲、ワークスペース)を設定して、Models 一覧でご自分のモデルを特定し、監視 を Actions 列でクリックして統計情報を表示します。詳細については、「使用状況およびパフォーマンスモニタリング」をご参照ください。

データは 1 時間ごとに更新されます。ピーク時刻には、最大 1 時間の遅延が発生する場合があります。

エラーコード

エラーが発生した場合は、「エラーメッセージ」をご参照のうえトラブルシューティングを行ってください。