Fitur Agentic SOC memungkinkan Anda mengumpulkan log secara terpusat dari berbagai saluran, seperti Kafka, Amazon S3, dan Alibaba Cloud Object Storage Service (OSS), sehingga membantu membangun pusat analisis log dan operasi keamanan terpadu untuk manajemen keamanan yang konsisten di seluruh lingkungan cloud.

Alur Kerja

Memilih solusi

Sebelum memulai, pilih saluran impor log yang paling sesuai berdasarkan jenis sumber data, biaya, dan kebutuhan data waktu nyata Anda.

Saluran impor | Kasus Penggunaan | Fitur |

Kafka |

|

|

S3 (atau penyimpanan objek kompatibel S3) |

|

|

OSS (Alibaba Cloud Object Storage Service) | Data log sudah disimpan di Alibaba Cloud OSS. | Sangat terintegrasi dengan ekosistem Alibaba Cloud, sehingga menyederhanakan konfigurasi. |

Kirimkan log ke saluran perantara

Fitur impor Agentic SOC mengambil data dari saluran seperti Kafka, S3, atau OSS. Oleh karena itu, Anda harus terlebih dahulu mengirimkan data log sumber ke saluran perantara yang dipilih.

Contoh metode pengiriman:

OSS: Simpan data log di bucket Alibaba Cloud OSS. Untuk informasi selengkapnya, lihat OSS Quick Start.

Huawei Cloud: Gunakan fitur log dump dari Huawei Cloud Log Tank Service (LTS) untuk menyimpan data di Kafka atau Object Storage Service (OBS). Untuk informasi selengkapnya, lihat Impor data log Huawei Cloud.

Tencent Cloud: Gunakan fitur log dump dari Tencent Cloud Log Service (CLS) untuk menyimpan data di Kafka atau Cloud Object Storage (COS). Untuk informasi selengkapnya, lihat Impor data log Tencent Cloud.

Azure: Anda dapat menggunakan kompatibilitas Azure Event Hubs dengan protokol Apache Kafka untuk memperlakukan Event Hub sebagai layanan Kafka yang dapat diambil datanya oleh Agentic SOC. Untuk informasi selengkapnya, lihat Impor data log Azure.

Simpan informasi akses: Simpan secara aman kredensial akses Anda, seperti pasangan AccessKey dan password, serta informasi titik akhir seperti endpoint dan nama bucket.

Berikan izin Security Center untuk mengakses layanan pihak ketiga

Jika Anda menggunakan saluran data pihak ketiga, Anda harus memberikan izin Agentic SOC untuk mengakses resource tersebut agar dapat membaca data log dari saluran tersebut.

Kafka dan S3 (Object Storage Service)

Masuk ke Konsol Security Center dan navigasikan ke Pengaturan Sistem > Pengaturan Fitur. Di pojok kiri atas halaman, pilih wilayah tempat aset Anda berada: Chinese Mainland atau Outside Chinese Mainland.

Pada tab Multi-cloud Configuration Management, pilih Multi-cloud Assets, lalu klik Grant Permission. Pada panel yang muncul, pilih IDC dari daftar drop-down dan konfigurasikan parameter berikut:

CatatanUntuk nilai spesifik item konfigurasi, seperti endpoint, lihat dokumentasi resmi masing-masing penyedia cloud.

Pada versi saat ini, ketika Anda mengonfigurasi layanan penyimpanan Kafka atau kompatibel S3 generik, seperti AWS S3, Tencent Cloud COS, atau Huawei Cloud OBS, pilih IDC. Pemilihan ini hanya untuk klasifikasi UI dan tidak memengaruhi fungsionalitas fitur.

Kafka

Service Provider: Pilih Apache.

Service: Pilih Kafka.

Endpoint: Titik akhir publik untuk Kafka.

CatatanEndpoint Event Hub adalah

<YOUR-NAMESPACE>.servicebus.windows.net:9093.Username/Password: Username dan password untuk Kafka.

CatatanUsername Kafka default untuk Event Hub adalah

$ConnectionString, dan password-nya adalah primary connection string.Communication Protocol: `security.protocol` dalam konfigurasi Kafka. Nilai yang didukung adalah plaintext (default), sasl_plaintext, sasl_ssl, dan ssl.

SASL Authentication Mechanism: `sasl.mechanism` dalam konfigurasi Kafka. Nilai yang didukung adalah plain, SCRAM-SHA-256, dan SCRAM-SHA-512.

S3

Service Provider: Anda dapat memilih AWS-S3.

Service: Pilih S3.

Endpoint: Titik akhir untuk layanan penyimpanan objek.

Access Key Id/Secret Access Key: Masukkan pasangan AccessKey yang digunakan untuk mengakses S3.

Konfigurasikan kebijakan sinkronisasi

AK Service Status Check: Menentukan interval pemeriksaan otomatis oleh Security Center terhadap validitas pasangan AccessKey Anda. Anda dapat memilih Disable untuk menonaktifkan pemeriksaan ini.

OSS

Buka halaman Cloud Resource Access Authorization dan klik Confirm Authorization untuk memberikan izin role sistem mengakses resource OSS.

Jika Anda adalah pengguna Resource Access Management (RAM), Anda juga harus mengonfigurasi izin berikut. Untuk informasi selengkapnya, lihat Buat kebijakan kustom dan Kelola izin pengguna RAM.

{ "Statement": [ { "Effect": "Allow", "Action": "ram:PassRole", "Resource": "acs:ram:*:*:role/aliyunlogimportossrole" }, { "Effect": "Allow", "Action": "oss:GetBucketWebsite", "Resource": "*" }, { "Effect": "Allow", "Action": "oss:ListBuckets", "Resource": "*" } ], "Version": "1" }

Buat tugas impor data

Buat sumber data

Buat sumber data Agentic SOC khusus untuk data log Anda. Anda dapat melewati langkah ini jika sumber data sudah ada.

Masuk ke Konsol Security Center dan navigasikan ke Agentic SOC > Integration Center. Di pojok kiri atas halaman, pilih wilayah tempat aset Anda berada: Chinese Mainland atau Outside Chinese Mainland.

Pada tab Data Source, buat sumber data untuk menerima log. Untuk informasi selengkapnya, lihat Buat sumber data untuk Simple Log Service (SLS).

Source Data Source Type: Pilih Agentic SOC Dedicated Collection Channel (Direkomendasikan) atau User Log Service.

Add Instances: Kami menyarankan Anda membuat Logstore baru untuk mengisolasi data.

Pada tab Data Import, klik Add Data. Pada panel yang muncul, konfigurasikan pengaturan berikut berdasarkan Data Source Type:

CatatanUntuk nilai spesifik item konfigurasi, lihat dokumentasi resmi masing-masing penyedia cloud.

Kafka

Endpoint: Pilih titik akhir publik Kafka yang Anda masukkan saat memberikan izin Security Center mengakses layanan pihak ketiga.

Topics: Pilih topik Kafka tempat log disimpan.

CatatanNama Event Hub adalah topik Kafka.

Value Type: Format penyimpanan log.

Format penyimpanan pihak ketiga

Value Type

Format JSON

json

Format log mentah

text

S3

Endpoint: Titik akhir untuk bucket S3.

S3 Bucket: ID bucket S3.

File Path Prefix Filter: Memfilter objek S3 berdasarkan awalan path file untuk menemukan objek spesifik yang ingin Anda impor. Misalnya, jika objek S3 yang ingin Anda impor disimpan di direktori csv/, atur parameter ini menjadi csv/.

PeringatanAnda harus mengatur parameter ini. Jika Anda membiarkannya kosong, sistem akan melakukan traversal seluruh bucket S3. Jika bucket berisi banyak file, traversal penuh dapat sangat menurunkan performa impor.

File Path Regex Filter: Memfilter file menggunakan ekspresi reguler untuk menemukan file spesifik yang ingin Anda impor. Secara default, parameter ini kosong, artinya tidak ada pemfilteran. Misalnya, jika file S3 berada di

testdata/csv/bill.csv, Anda dapat mengatur ekspresi reguler menjadi(testdata/csv/)(.*).CatatanKami menyarankan Anda mengonfigurasi parameter ini bersama dengan File Path Prefix Filter untuk meningkatkan efisiensi. Parameter ini dan File Path Prefix Filter dievaluasi dengan logika AND.

Untuk informasi selengkapnya tentang cara men-debug ekspresi reguler, lihat Cara men-debug ekspresi reguler.

Data Format: Format penguraian file. Opsi dijelaskan di bawah ini.

CSV: File teks yang menggunakan pemisah untuk membatasi data. Anda dapat menentukan baris pertama file sebagai nama field atau menentukan nama field secara manual. Setiap baris, kecuali baris nama field, diurai sebagai nilai field log.

JSON: Membaca file S3 baris demi baris dan mengurai setiap baris sebagai objek JSON. Setelah diurai, field dalam objek JSON sesuai dengan field log.

Text: Mengurai setiap baris dalam file S3 sebagai satu entri log.

Multi-line Text: Mode multi-baris yang mendukung penguraian log dengan menentukan ekspresi reguler untuk baris pertama atau terakhir.

Jika Anda memilih CSV atau Multi-line Text, Anda harus mengatur parameter tambahan yang dijelaskan di bawah ini.

CSV

Parameter

Deskripsi

Separator

Atur pemisah untuk log. Nilai default adalah koma (,).

Quote character

Karakter quote yang digunakan dalam string CSV.

Escape Character

Konfigurasikan karakter escape untuk log. Nilai default adalah backslash (\).

Max Line Span

Saat entri log mencakup beberapa baris, tentukan jumlah maksimum baris. Nilai default adalah 1.

First Row as Header

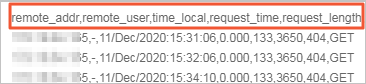

Jika Anda mengaktifkan sakelar ini, baris pertama file CSV digunakan sebagai nama field. Misalnya, baris pertama pada gambar berikut diekstraksi sebagai nama field log.

Skip rows

Tentukan jumlah baris log yang dilewati. Misalnya, jika Anda mengatur nilainya menjadi 1, pengumpulan log dimulai dari baris kedua file CSV.

Multi-line Text

Parameter

Deskripsi

Regex Match Position

Atur posisi pencocokan ekspresi reguler, seperti dijelaskan di bawah ini:

Prefix Regex: Menggunakan ekspresi reguler untuk mencocokkan baris pertama entri log. Baris berikutnya yang tidak cocok dengan ekspresi dianggap bagian dari entri log tersebut hingga jumlah maksimum baris tercapai.

Suffix Regex: Menggunakan ekspresi reguler untuk mencocokkan akhir baris entri log. Bagian yang tidak cocok dianggap bagian dari entri log berikutnya hingga jumlah maksimum baris tercapai.

Regex

Atur ekspresi reguler yang benar berdasarkan konten log. Untuk informasi selengkapnya, lihat Cara men-debug ekspresi reguler.

Max Lines

Jumlah maksimum baris untuk satu entri log.

Encoding Format: Format encoding file S3 yang akan diimpor. Format yang didukung adalah GBK dan UTF-8.

Compression format: Sistem secara otomatis mendeteksi format kompresi berdasarkan pengaturan kompresi data S3.

Modified Time: Mengimpor semua file yang dimodifikasi mulai 30 menit sebelum tugas dimulai, termasuk file yang baru ditambahkan.

New File Check Cycle: Interval tugas impor memindai file baru secara berkala. Tugas tersebut secara otomatis memindai dan mengimpor file baru pada interval yang ditentukan.

OSS

PentingSaat ini, Anda hanya dapat mengimpor file OSS yang ukurannya maksimal 5 GB. Ukuran file terkompresi dihitung berdasarkan ukuran setelah dikompresi.

OSS Region: Wilayah tempat data OSS disimpan.

CatatanAkses lintas wilayah menimbulkan biaya transfer data. Biaya ini dikenakan oleh layanan OSS. Untuk informasi selengkapnya, lihat Detail penagihan.

Bucket: Bucket OSS yang berisi file yang akan diimpor.

File Path Prefix Filter: Memfilter objek OSS berdasarkan awalan path file untuk menemukan objek spesifik yang ingin Anda impor. Misalnya, jika file yang ingin Anda impor disimpan di direktori csv/, atur parameter ini menjadi csv/.

PeringatanAnda harus mengatur parameter ini. Jika Anda membiarkannya kosong, sistem akan melakukan traversal seluruh bucket OSS. Jika bucket berisi banyak file, traversal penuh dapat menurunkan performa impor dan menimbulkan biaya yang tidak perlu.

File Path Regex Filter: Menentukan ekspresi reguler untuk memfilter file dan menemukan file spesifik yang ingin Anda impor. Secara default, parameter ini kosong, artinya tidak ada pemfilteran. Misalnya, jika file OSS berada di

testdata/csv/bill.csv, Anda dapat mengatur ekspresi reguler menjadi(testdata/csv/)(.*).CatatanKami menyarankan Anda mengonfigurasi parameter ini bersama dengan File Path Prefix Filter untuk meningkatkan efisiensi. Parameter ini dan File Path Prefix Filter dievaluasi menggunakan logika AND.

Untuk informasi selengkapnya tentang cara men-debug ekspresi reguler, lihat Cara men-debug ekspresi reguler.

Modified Time: Menetapkan waktu mulai 30 menit sebelum tugas diinisiasi. Semua file yang dimodifikasi setelah waktu ini, termasuk file yang baru ditambahkan, akan diimpor.

Data Format: Format yang digunakan untuk mengurai file. Opsi dijelaskan di bawah ini.

CSV: File teks yang menggunakan pemisah untuk membatasi data. Anda dapat menentukan baris pertama file sebagai nama field atau menentukan nama field secara manual. Setiap baris, kecuali baris nama field, diurai sebagai nilai field log.

Single-Line JSON: Membaca file OSS baris demi baris dan mengurai setiap baris sebagai objek JSON. Field dalam objek JSON adalah field log.

Text: Mengurai setiap baris dalam file OSS sebagai satu entri log.

Multi-line Text: Mode multi-baris yang mendukung penguraian log berdasarkan ekspresi reguler yang ditentukan untuk baris pertama atau terakhir.

ORC: Format file ORC. Tidak diperlukan konfigurasi. File secara otomatis diurai ke dalam format log.

Parquet: Format file Parquet. Tidak diperlukan konfigurasi. File secara otomatis diurai ke dalam format log.

OSS Access Log: Format untuk log akses Alibaba Cloud OSS. Untuk informasi selengkapnya, lihat Penyimpanan log.

Download Alibaba Cloud CDN logs: Format log unduhan untuk Alibaba Cloud CDN. Untuk informasi selengkapnya, lihat Quick Start.

Jika Anda memilih CSV atau Multi-line Text, Anda perlu mengatur parameter tambahan seperti dijelaskan di bawah ini.

CSV

Parameter

Deskripsi

Separator

Atur pemisah untuk log. Nilai default adalah koma (,).

Quote character

Karakter quote yang digunakan dalam string CSV.

Escape Character

Konfigurasikan karakter escape untuk log. Nilai default adalah backslash (\).

Max Line Span

Saat entri log mencakup beberapa baris, tentukan jumlah maksimum baris. Nilai default adalah 1.

First Row as Header

Jika Anda mengaktifkan sakelar ini, baris pertama file CSV digunakan sebagai nama field. Misalnya, baris pertama pada gambar berikut diekstraksi sebagai nama field log.

Skip rows

Tentukan jumlah baris log yang dilewati. Misalnya, jika Anda mengatur nilainya menjadi 1, pengumpulan log dimulai dari baris kedua file CSV.

Multi-line Text

Parameter

Deskripsi

Regex Match Position

Atur posisi pencocokan ekspresi reguler, seperti dijelaskan di bawah ini:

Prefix Regex: Menggunakan ekspresi reguler untuk mencocokkan baris pertama entri log. Baris berikutnya yang tidak cocok dengan ekspresi dianggap bagian dari entri log tersebut hingga jumlah maksimum baris tercapai.

Suffix Regex: Menggunakan ekspresi reguler untuk mencocokkan akhir baris entri log. Bagian yang tidak cocok dianggap bagian dari entri log berikutnya hingga jumlah maksimum baris tercapai.

Regex

Atur ekspresi reguler yang benar berdasarkan konten log. Untuk informasi selengkapnya, lihat Cara men-debug ekspresi reguler.

Max Lines

Jumlah maksimum baris untuk satu entri log.

Encoding Format: Format encoding file OSS yang akan diimpor. Format yang didukung adalah GBK dan UTF-8.

Compression format: Sistem secara otomatis mendeteksi format kompresi berdasarkan format kompresi data OSS yang dikonfigurasi.

New File Check Cycle: Interval tugas impor memindai file baru secara berkala. Tugas tersebut kemudian secara otomatis memindai dan mengimpor file yang baru ditambahkan.

Konfigurasikan sumber data tujuan

Data Source Name: Pilih sumber data yang Anda buat pada Langkah 1.

Target Logstore: Logstore yang Anda atur pada Langkah 1.

Klik OK untuk menyimpan konfigurasi. Security Center kemudian secara otomatis menarik log dari saluran impor data.

Analisis data yang diimpor

Setelah data berhasil diingest, Anda harus mengonfigurasi aturan parsing dan deteksi agar Security Center dapat menganalisis log tersebut.

Buat Kebijakan Akses Baru

Untuk informasi selengkapnya, lihat Integrasi produk. Buat kebijakan integrasi baru dan konfigurasikan parameter berikut:

Data Source: Pilih sumber data tujuan yang Anda konfigurasi dalam tugas impor data.

Standardized Rule: Agentic SOC menyediakan aturan standar bawaan untuk beberapa produk cloud yang dapat Anda gunakan langsung.

Standardization Method: Saat mengonversi log akses menjadi log alert, hanya metode Real-time Consumption yang didukung.

Konfigurasikan aturan deteksi ancaman

Berdasarkan kebutuhan keamanan Anda, Anda harus mengaktifkan atau membuat aturan deteksi log dalam manajemen aturan untuk menganalisis log, menghasilkan alert, dan membuat event keamanan. Untuk informasi selengkapnya, lihat Aturan Deteksi.

Biaya dan pengeluaran

Penagihan Agentic SOC dan SLS: Pihak yang bertanggung jawab atas biaya tergantung pada metode penyimpanan data yang Anda pilih.

CatatanUntuk petunjuk penagihan Agentic SOC, lihat Langganan Agentic SOC dan Agentic SOC bayar sesuai penggunaan.

Untuk informasi selengkapnya tentang penagihan Simple Log Service (SLS), lihat Ikhtisar penagihan.

Jenis Sumber Data

Agentic SOC Billable Items

Item yang dapat ditagih SLS

Instruksi khusus

Agentic SOC Dedicated Collection Channel

Biaya ingest log.

Biaya penyimpanan dan penulisan log.

CatatanItem di atas mengonsumsi Log Ingestion Traffic.

Biaya selain penyimpanan dan penulisan log (seperti Lalu lintas internet).

Agentic SOC membuat dan mengelola resource SLS. Oleh karena itu, Agentic SOC ditagih untuk biaya penyimpanan dan penulisan Logstore.

User Log Service

Biaya ingest log dikenakan dengan mengonsumsi Log Ingestion Traffic.

Semua biaya terkait log (termasuk penyimpanan dan penulisan log, biaya transfer data, dll.).

Semua resource log dikelola oleh Simple Log Service (SLS). Oleh karena itu, SLS ditagih untuk semua biaya terkait log.

Biaya terkait OSS: Saat Anda mengimpor data dari OSS, OSS mengenakan biaya untuk traffic dan permintaan. Untuk informasi harga item yang dapat ditagih ini, lihat Harga OSS.

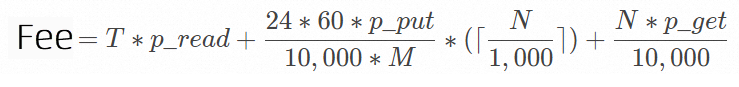

Rumus perhitungan biaya

Field

Deskripsi

NJumlah file yang diimpor per hari.

TTotal volume data yang diimpor per hari, dalam GB.

p_readBiaya traffic per GB data.

Saat Anda mengimpor data dalam wilayah yang sama, lalu lintas keluar melalui jaringan internal dihasilkan dari OSS. Lalu lintas ini gratis.

Saat Anda mengimpor data lintas wilayah, lalu lintas keluar melalui Internet dihasilkan dari OSS.

p_putBiaya per 10.000 permintaan PUT.

Simple Log Service menggunakan operasi API ListObjects untuk mendapatkan daftar file di bucket tujuan. OSS mengenakan biaya untuk operasi ini sebagai permintaan PUT. Operasi ini mengembalikan maksimal 1.000 entri data sekaligus. Oleh karena itu, jika Anda memiliki 1.000.000 file baru, Anda perlu melakukan 1.000.000/1.000 = 1.000 permintaan.

p_getBiaya per 10.000 permintaan GET.

MInterval pemeriksaan file baru, dalam menit.

Anda dapat mengatur parameter Check for New Files Interval saat membuat konfigurasi impor data.

Contoh penagihan

Biaya pihak ketiga: