Anda dapat mengimpor file log dari bucket OSS ke Simple Log Service menggunakan fitur impor data untuk kueri, analisis, pemrosesan, dan operasi lainnya. Simple Log Service mendukung file hingga 5 GB; untuk file terkompresi, batas ini berlaku pada ukuran terkompresinya.

Penagihan

SLS tidak membebankan biaya untuk fitur impor data. Namun, karena fitur ini memanggil API OSS, biaya lalu lintas dan permintaan OSS akan dikenakan. Untuk detail harga item yang dapat ditagih terkait, lihat Harga OSS. Biaya harian OSS yang dihasilkan saat Anda mengimpor data dari OSS dihitung menggunakan rumus berikut:

![]()

Prasyarat

File log telah diunggah ke bucket OSS. Untuk informasi selengkapnya, lihat Upload objects.

Proyek dan Logstore telah dibuat. Untuk informasi selengkapnya, lihat Manage projects dan Create a Logstore.

Anda telah menyelesaikan Cloud Resource Access Authorization. Ini memberikan izin kepada Simple Log Service untuk mengasumsikan role AliyunLogImportOSSRole guna mengakses resource OSS Anda.

Akun Anda memiliki izin oss:ListBuckets untuk mengakses bucket OSS. Untuk informasi selengkapnya, lihat Attach a custom policy to a RAM user.

Jika Anda menggunakan RAM user, berikan izin PassRole kepada RAM user tersebut. Gunakan kebijakan berikut. Untuk informasi selengkapnya, lihat Create custom policies dan Grant permissions to a RAM user.

{ "Statement": [ { "Effect": "Allow", "Action": ["ram:PassRole", "ram:GetRole"], "Resource": "acs:ram:*:*:role/aliyunlogimportossrole" }, { "Effect": "Allow", "Action": "oss:GetBucketWebsite", "Resource": "*" }, { "Effect": "Allow", "Action": "oss:ListBuckets", "Resource": "*" } ], "Version": "1" }

Buat konfigurasi impor data

Jika objek OSS diperbarui setelah diimpor, tugas impor data akan mengimpor ulang seluruh data dari objek tersebut. Misalnya, jika data baru ditambahkan ke objek yang sudah diimpor, seluruh objek akan diimpor ulang.

Masuk ke Konsol Simple Log Service.

Di bagian Data Ingestion, klik tab Data Import. Lalu, klik OSS - Data Import.

Pilih proyek dan Logstore tujuan, lalu klik Next.

Konfigurasikan pengaturan impor.

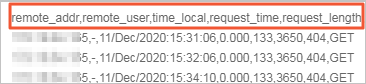

Pada langkah Import Configuration, konfigurasikan parameter berikut.

Klik Preview untuk melihat pratinjau hasil impor.

Setelah Anda mengonfirmasi hasilnya, klik Next.

Buat indeks dan pratinjau data. Lalu, klik Next. Secara default, indeks teks penuh diaktifkan di Simple Log Service. Anda juga dapat membuat indeks bidang secara manual untuk log yang dikumpulkan atau klik Automatic Index Generation. Dengan demikian, Simple Log Service akan menghasilkan indeks bidang. Untuk informasi selengkapnya, lihat Create indexes.

PentingJika Anda ingin mengkueri semua field dalam log, kami sarankan menggunakan indeks teks penuh. Jika Anda hanya ingin mengkueri field tertentu, kami sarankan menggunakan indeks bidang untuk mengurangi trafik indeks. Jika Anda ingin menganalisis field, Anda harus membuat indeks bidang dan menyertakan pernyataan SELECT dalam kueri Anda.

Klik Query Log. Di halaman kueri dan analisis, verifikasi bahwa data OSS telah diimpor.

Tunggu sekitar 1 menit. Jika data OSS yang diharapkan muncul, impor berhasil.

Operasi terkait

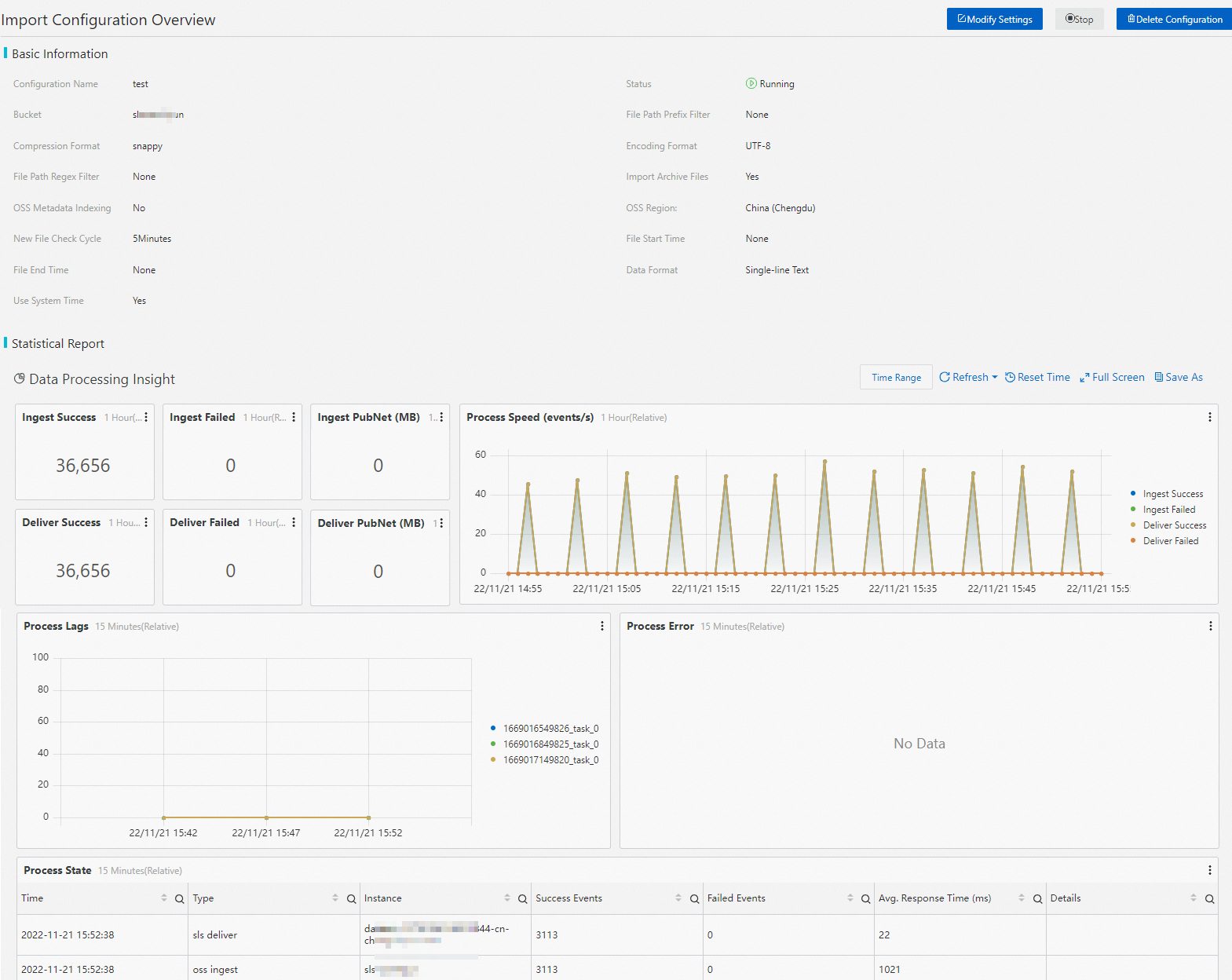

Setelah membuat konfigurasi impor data, Anda dapat melihat konfigurasi dan laporan statistiknya di konsol.

Di bagian Projects, klik proyek tersebut.

Di tab , buka . Lalu klik nama konfigurasi.

View Task

Di halaman Import Configuration Overview, Anda dapat melihat informasi dasar dan laporan statistik.

Modify Job

Untuk memodifikasi konfigurasi, klik Edit Configurations. Untuk informasi selengkapnya, lihat Create a data import configuration.

Delete a Job

Untuk menghapus konfigurasi, klik Delete Configuration.

PeringatanKonfigurasi tidak dapat dipulihkan setelah dihapus. Lakukan dengan hati-hati.

Stop a Job

Untuk menghentikan tugas, klik Stop.

Start the data import job

Untuk memulai tugas, klik Start.

FAQ

Masalah | Kemungkinan penyebab | Solusi |

Pratinjau data tidak tersedia untuk file yang diimpor dari direktori Hadoop Distributed File System (HDFS) bucket. | Mengimpor file dari direktori HDFS tidak didukung. | Aktifkan fitur OSS-HDFS untuk bucket tersebut. Secara default, direktori .dlsdata dibuat di direktori OSS. Anda dapat mengimpor file dari direktori .dlsdata. |

Tidak ada data yang ditampilkan selama pratinjau. | Bucket OSS tidak berisi objek, objek tidak berisi data, atau tidak ada objek yang memenuhi kondisi filter. |

|

Terdapat karakter acak (garbled). | Format data, format kompresi, atau format encoding salah konfigurasi. | Verifikasi format aktual objek OSS. Lalu sesuaikan Data Format, Compression Format, atau Encoding Format. Untuk memperbaiki data garbled yang sudah ada, Anda harus membuat Logstore baru dan konfigurasi impor baru. |

Waktu log yang ditampilkan di Simple Log Service berbeda dari waktu log sebenarnya. | Tidak ada field waktu yang ditentukan dalam konfigurasi impor, atau format waktu atau zona waktunya tidak valid. | Tentukan field waktu serta format waktu dan zona waktu yang valid. Untuk informasi selengkapnya, lihat Create a data import configuration. |

Data tidak dapat dikueri atau dianalisis setelah diimpor. |

|

|

Jumlah entri data yang diimpor lebih sedikit dari yang diharapkan. | Beberapa file berisi baris yang lebih besar dari 3 MB. Baris-baris ini dibuang selama proses impor. Untuk informasi selengkapnya, lihat Collection limits. | Saat menulis data ke objek OSS, pastikan tidak ada baris yang melebihi 3 MB. |

Kecepatan impor lebih lambat dari yang diharapkan (biasanya hingga 80 MB/detik) meskipun jumlah file dan volume data total besar. | Logstore memiliki terlalu sedikit shard. Untuk informasi selengkapnya, lihat Performance limits. | Jika Logstore hanya memiliki beberapa shard, Anda dapat menambah jumlah shard menjadi 10 atau lebih lalu memantau latensi. Untuk informasi selengkapnya, lihat Manage shards. |

Anda tidak dapat memilih bucket OSS saat membuat konfigurasi impor data. | Otorisasi untuk role AliyunLogImportOSSRole tidak lengkap. | Lengkapi otorisasi seperti yang dijelaskan di bagian Prasyarat. |

Beberapa file tidak diimpor. | Kondisi filter salah konfigurasi, atau beberapa file melebihi 5 GB. Untuk informasi selengkapnya, lihat Collection limits. |

|

Objek arsip tidak diimpor. | Sakelar Import Archive Files dimatikan. Untuk informasi selengkapnya, lihat Collection limits. |

|

Terjadi error saat mengurai log teks multi-baris. | Ekspresi reguler untuk mencocokkan baris pertama atau terakhir tidak valid. | Verifikasi bahwa ekspresi reguler yang digunakan untuk mencocokkan baris pertama atau terakhir sudah benar. |

File baru memerlukan waktu lebih lama dari yang diharapkan untuk diimpor. | Terlalu banyak file yang sesuai dengan kondisi filter awalan path file, dan OSS Metadata Indexing dinonaktifkan dalam konfigurasi impor. | Jika lebih dari satu juta file sesuai dengan kondisi filter awalan path file, aktifkan OSS Metadata Indexing dalam konfigurasi impor. Jika tidak, penemuan file baru tidak efisien. |

Terjadi error izin terkait STS saat membuat konfigurasi. | RAM user tidak memiliki izin yang diperlukan. |

|

Penanganan error

Error | Deskripsi |

File read failure | Jika file gagal dibaca sepenuhnya karena pengecualian jaringan atau kerusakan, tugas impor akan mencoba ulang secara otomatis. Jika gagal setelah tiga kali percobaan, file tersebut dilewati. Interval percobaan ulang sesuai dengan New File Check Cycle. Jika New File Check Cycle diatur ke Never Check, interval percobaan ulang adalah 5 menit. |

Compression format parsing error | Jika file memiliki format kompresi yang tidak valid, tugas impor akan melewatkannya selama dekompresi. |

Data format parsing error |

|

Bucket OSS yang ditentukan tidak ada. | Tugas impor mencoba ulang secara berkala. Setelah bucket dibuat ulang, tugas akan dilanjutkan secara otomatis. |

Permission error | Jika terjadi error izin saat membaca dari bucket OSS atau menulis ke Logstore Simple Log Service, tugas impor akan mencoba ulang secara berkala. Setelah error diperbaiki, tugas akan dilanjutkan secara otomatis. Jika terjadi error izin, tugas tidak melewatkan file apa pun. Setelah error diperbaiki, tugas akan mengimpor data dari file yang belum diproses di bucket ke Logstore. |

Operasi API OSS untuk impor data

Action | API |

Create an OSS data import job | |

Modify an OSS data import job | |

Query an OSS data import job | |

Delete an OSS data import job | |

Start an OSS data import job | |

Stop an OSS data import job |