Anda dapat mengimpor log Azure ke Security Center (Agentic SOC) untuk memusatkan ingestion log serta mengaktifkan parsing dan deteksi ancaman terpadu, sehingga meningkatkan efisiensi operasi keamanan multi-cloud. Solusi ini memanfaatkan kompatibilitas Kafka dari Azure Event Hubs untuk mengonsumsi log melalui endpoint, topik, dan string koneksi primary sebagai kredensial otentikasi. Selanjutnya, Anda dapat mengonfigurasi tugas impor, Logstore tujuan, serta aturan parsing dan deteksi di Security Center.

Cara kerja

Solusi ini memanfaatkan kompatibilitas antara Azure Event Hubs dan protokol Apache Kafka, sehingga Event Hub dapat berfungsi sebagai layanan Kafka. Security Center bertindak sebagai klien Kafka yang menggunakan endpoint, topik, dan kredensial tertentu untuk mengambil data log dari Event Hub. Data yang diambil kemudian dinormalisasi, diparse, dan digunakan untuk deteksi ancaman terpadu. Proses konfigurasinya adalah sebagai berikut:

Persiapkan Event Hub di Azure

Untuk informasi lebih lanjut, lihat dokumen resmi Azure Buat event hub menggunakan portal Azure.

Langkah 1: Buat resource group

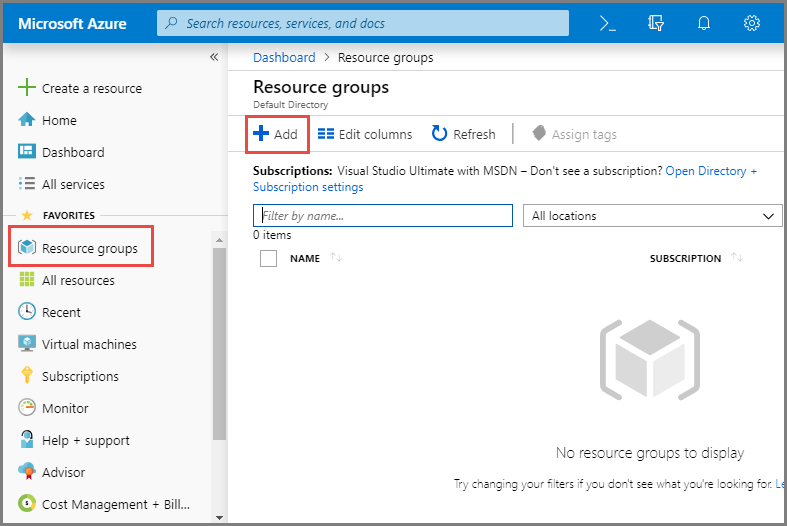

Masuk ke Azure portal.

Pada panel navigasi di sebelah kiri, pilih Resource groups, lalu klik Create.

Pada halaman Create a resource group, atur parameter berikut, lalu klik Review + create.

Subscription: Pilih langganan Azure untuk resource group tersebut.

Resource group: Masukkan nama unik untuk resource group.

Region: Pilih wilayah untuk resource group.

Setelah mengonfirmasi informasi, klik Create.

Langkah 2: Buat namespace Event Hubs

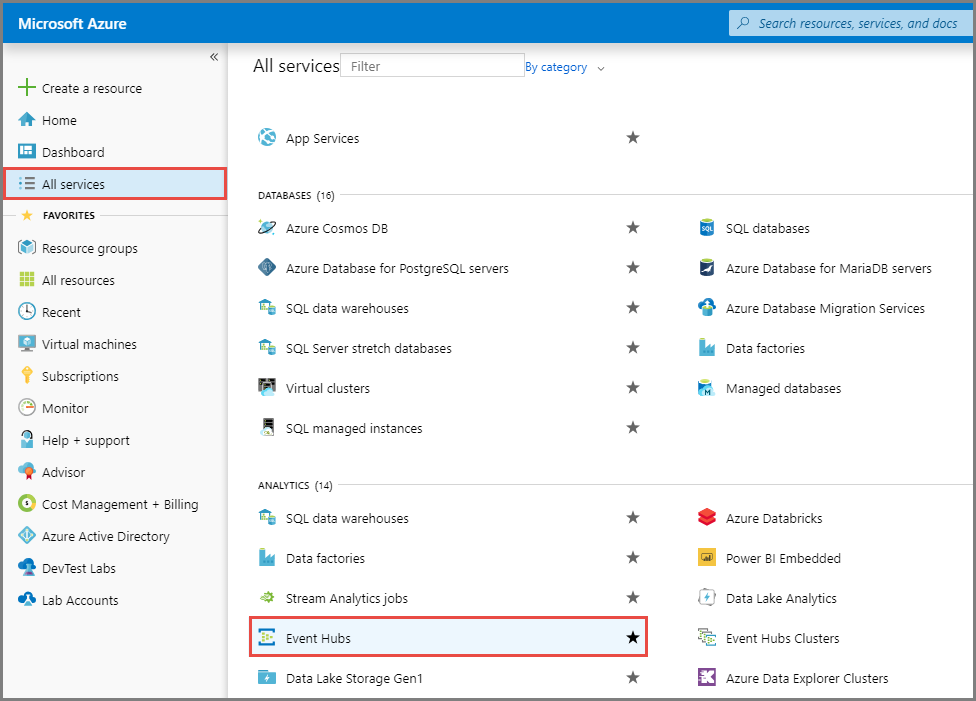

Pada panel navigasi di sebelah kiri, klik All services. Di area layanan Analytics, klik Event Hubs.

Pada halaman Event Hubs, klik Create dan konfigurasi parameter berikut.

Subscription: Pilih langganan yang Anda tentukan di Langkah 1.

Resource group: Pilih resource group yang Anda buat di Langkah 1.

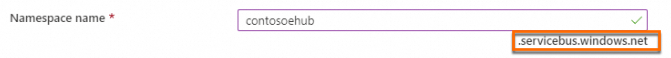

Namespace name: Masukkan nama untuk namespace. Endpoint yang sesuai (alamat broker Kafka) akan muncul di bawah kotak teks.

Region: Pilih wilayah yang sama dengan resource group yang Anda buat di Langkah 1.

Pricing tier: Pilih tier harga sesuai kebutuhan. Nilai default-nya adalah Basic. Untuk membatasi akses ke namespace Event Hubs hanya untuk Agentic SOC, pilih Standard, Premium, atau Dedicated. Untuk informasi lebih lanjut, lihat Konfigurasi daftar putih Event Hubs (opsional).

CatatanUntuk informasi selengkapnya tentang perbedaan antar tier, lihat Kuota dan batasan, Event Hubs Premium, dan Event Hubs Dedicated.

Throughput units / Processing units (tier Premium): Pertahankan konfigurasi default.

CatatanUntuk informasi lebih lanjut tentang throughput units atau processing units, lihat Skalabilitas Event Hubs.

Auto-inflate: Aktifkan fitur ini sesuai kebutuhan.

Pada tab Networking, atur Network connectivity ke Public access, lalu klik Review + create di bagian bawah halaman.

PentingUntuk memungkinkan akses eksklusif oleh Agentic SOC ke namespace Event Hubs, Anda harus mengonfigurasi daftar putih jaringan di Azure. Untuk informasi lebih lanjut, lihat Konfigurasi daftar putih Event Hubs (opsional).

Setelah mengonfirmasi konfigurasi, klik Create dan tunggu hingga penerapan selesai.

Pada halaman Your deployment is complete, klik Go to resource untuk melihat halaman detail namespace.

CatatanAlternatifnya, pada halaman utama Event Hubs, Anda dapat mengklik nama namespace dalam daftar untuk membuka halaman detailnya.

Langkah 3: Buat event hub

Pada halaman detail namespace yang Anda buat di Langkah 2, klik + Event Hub.

Pada halaman pembuatan, masukkan informasi yang diperlukan lalu klik Review + create.

Name: Masukkan nama untuk Event Hub.

PentingNama Event Hub ini sesuai dengan topik dalam konfigurasi Kafka. Kami menyarankan Anda menggunakan nama yang deskriptif dan mudah dipahami.

Konfigurasi lainnya: Pertahankan pengaturan default.

Pada halaman konfirmasi, klik Create dan tunggu hingga tugas selesai.

Kembali ke halaman utama namespace untuk melihat data yang baru dibuat di bagian Event Center.

Langkah 4: Dapatkan primary connection string

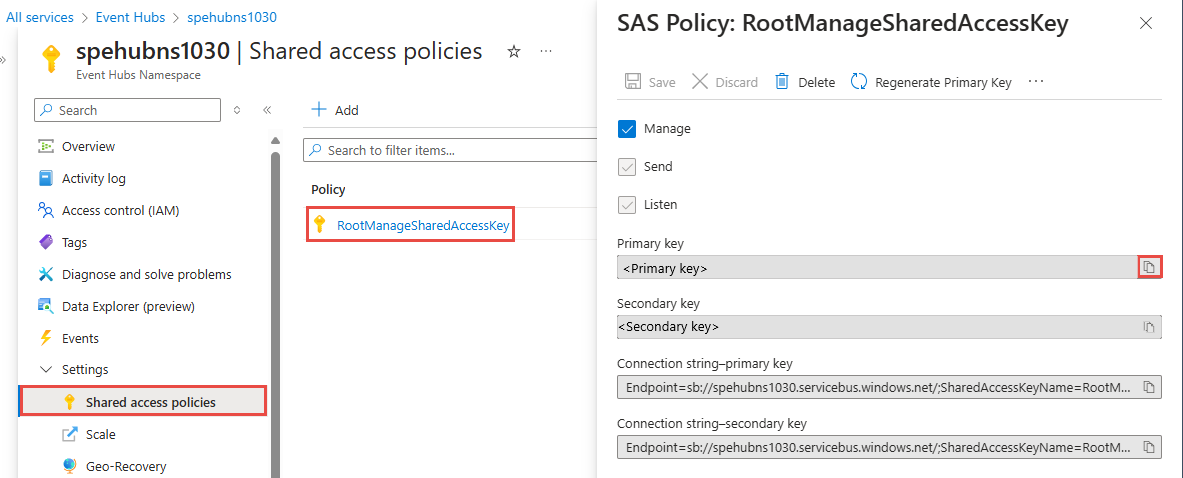

Pada halaman namespace, di panel navigasi kiri, di bawah Settings, klik Shared access policies.

Klik kebijakan primary,

RootManageSharedAccessKey. Di panel detail kebijakan, salin primary connection string.PentingPrimary connection string merupakan kredensial (password) untuk impor Kafka.

Langkah 5: Tulis data ke event hub

Ikuti petunjuk dalam dokumentasi resmi Azure untuk menulis data yang ingin Anda analisis ke event hub yang Anda buat di Langkah 3. Untuk informasi lebih lanjut, lihat dokumen berikut:

Konfigurasi impor data di Security Center

Langkah 1: Berikan otorisasi kepada Security Center untuk mengakses Event Hub

Buka Konsol Security Center > Pengaturan Sistem > Pengaturan Fitur. Di pojok kiri atas halaman, pilih wilayah tempat aset Anda berada: Chinese Mainland atau Outside Chinese Mainland.

Pada tab Multi-cloud Configuration Management, klik Multi-cloud Assets. Lalu, klik Grant Permission dan pilih IDC dari daftar drop-down. Di panel yang muncul, konfigurasi parameter berikut:

Service Provider: Pilih Apache.

Connection Type: Pilih Kafka.

Endpoint:

<YOUR-NAMESPACE>.servicebus.windows.net:9093.CatatanGanti

<YOUR-NAMESPACE>dengan nama namespace Event Hubs.Username: Nilainya tetap

$ConnectionStringdan tidak dapat diubah.Password: primary connection string dari namespace Event Hubs.

Communication Protocol:

sasl_ssl.SASL Authentication Mechanism:

plain.

Konfigurasi kebijakan sinkronisasi

AK Service Status Check: Parameter ini tidak berlaku. Lewati langkah ini.

Langkah 2: Buat tugas impor data

Buat sumber data

Buat sumber data untuk data log Azure. Jika sudah membuatnya, lewati langkah ini.

Masuk ke Konsol Security Center dan navigasikan ke Agentic SOC > Pusat Integrasi. Di pojok kiri atas halaman, pilih wilayah tempat aset Anda berada: Chinese Mainland atau Outside Chinese Mainland.

Pada tab Data Source, buat sumber data untuk menerima log. Untuk informasi lebih lanjut, lihat Buat sumber data untuk Simple Log Service (SLS).

Source Data Source Type: Pilih Agentic SOC Dedicated Collection Channel (Direkomendasikan) atau User Log Service.

Add Instances: Kami menyarankan Anda membuat Logstore baru untuk mengisolasi data.

Pada tab Data Import, klik Add Data. Di panel yang muncul, konfigurasi parameter berikut:

Data Source Type: Kafka.

Endpoint:

<YOUR-NAMESPACE>.servicebus.windows.net:9093, dengan<YOUR-NAMESPACE>sebagai nama namespace Event Hubs.Topics: Nama Event Hub yang Anda atur saat membuat event hub.

Value Type: json.

Konfigurasi sumber data tujuan

Data Source Name: Pilih sumber data yang Anda buat pada langkah Buat sumber data di bagian ini.

Destination Logstore: Pilih Logstore yang Anda atur pada langkah Buat sumber data di bagian ini.

Klik OK untuk menyimpan konfigurasi. Setelah tugas impor data dikonfigurasi, Security Center secara otomatis mengambil log dari Azure Event Hubs.

Konfigurasi daftar putih Event Hubs (opsional)

Tier Basic tidak mendukung konfigurasi daftar putih jaringan.

Untuk informasi lebih lanjut, lihat dokumen resmi Azure: Konfigurasi aturan firewall IP untuk namespace yang ada.

Pada halaman namespace Event Hubs, klik Networking di bawah Settings pada panel navigasi kiri.

Pada halaman Network, buka tab Public Access dan klik tombol Manage di area Public network access.

Pada halaman konfigurasi akses jaringan publik, pada bagian Default action, pilih Enable from selected networks.

Pada bagian IP Addresses, masukkan alamat IP yang akan ditambahkan ke daftar putih, lalu klik Save. Contoh berikut menunjukkan cara melakukan operasi ini dan mencantumkan alamat IP yang masuk daftar putih:

Alamat IP wilayah tempat proyek SLS Anda berada:

Wilayah

Daftar putih alamat IP VPC

Daftar putih alamat IP publik

Tiongkok (Hangzhou)

100.104.0.0/16

114.55.8.190

47.99.57.53

114.55.85.98

47.99.212.49

120.26.169.131

118.178.236.24

47.98.173.126

Tiongkok (Shanghai)

100.104.0.0/16

101.133.151.144

47.102.141.56

106.15.248.175

47.102.99.12

Tiongkok (Qingdao)

100.104.0.0/16

47.104.146.34

120.27.20.55

Tiongkok (Beijing)

100.104.0.0/16

59.110.6.146

39.105.19.110

47.93.61.189

182.92.187.76

Tiongkok (Zhangjiakou)

100.104.0.0/16

8.142.80.93

47.92.90.166

8.142.152.234

39.100.37.56

Tiongkok (Hohhot)

100.104.0.0/16

39.104.61.213

Tiongkok (Ulanqab)

100.104.0.0/16

8.130.10.99

39.101.66.131

Tiongkok (Shenzhen)

100.104.0.0/16

120.76.47.88

119.23.150.175

Tiongkok (Heyuan)

100.104.0.0/16

47.113.195.162

47.113.192.163

Tiongkok (Guangzhou)

100.104.0.0/16

8.134.56.134

Tiongkok (Chengdu)

100.104.0.0/16

47.108.26.166

Tiongkok (Hong Kong)

100.104.0.0/16

8.210.69.249

47.52.240.106

Singapura

100.104.0.0/16

47.241.44.82

47.88.153.120

Korea Selatan (Seoul)

100.104.0.0/16

8.213.130.255

Jepang (Tokyo)

100.104.0.0/16

47.74.56.187

Malaysia (Kuala Lumpur)

100.104.0.0/16

47.254.195.145

Indonesia (Jakarta)

100.104.0.0/16

149.129.233.70

Filipina (Manila)

100.104.0.0/16

8.212.131.139

Thailand (Bangkok)

100.104.0.0/16

8.213.194.187

Jerman (Frankfurt)

100.104.0.0/16

47.91.76.65

47.91.89.173

Inggris (London)

100.104.0.0/16

8.208.86.103

8.208.3.16

AS (Virginia)

100.104.0.0/16

47.253.208.218

47.90.252.237

AS (Silicon Valley)

100.104.0.0/16

47.88.8.7

47.88.7.168

Agentic SOC alamat IP wilayah:

Wilayah

Daftar putih IP publik

Chinese Mainland

106.14.241.32

Outside Chinese Mainland

8.222.217.173

Analisis data yang diimpor

Setelah data diingest, Anda harus mengonfigurasi aturan parsing dan deteksi agar Security Center dapat menganalisis log tersebut.

Buat Kebijakan Akses Baru

Untuk informasi lebih lanjut, lihat Integrasi produk. Buat kebijakan integrasi baru dan konfigurasi parameter berikut:

Data Source: Pilih sumber data target yang Anda konfigurasi dalam tugas impor data.

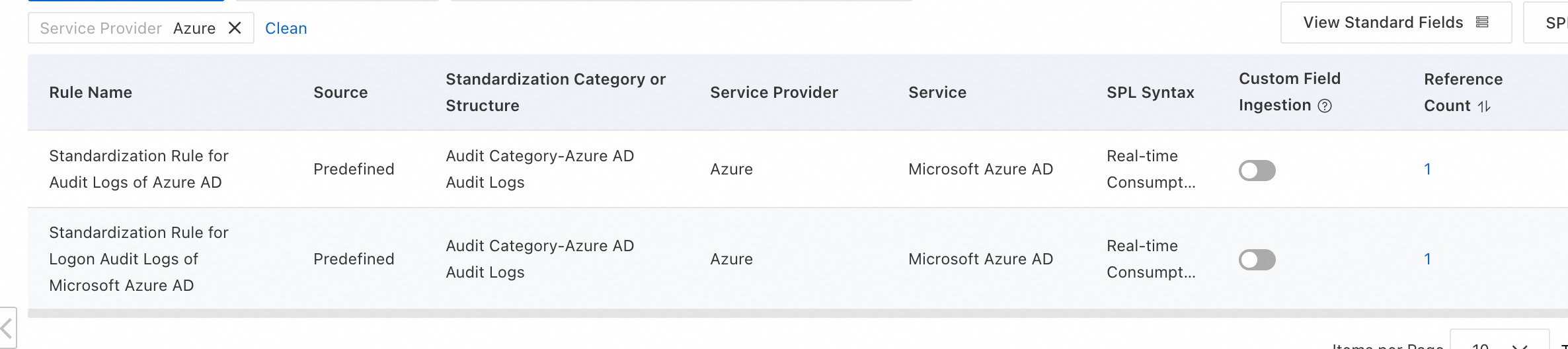

Standardized Rule: Agentic SOC menyediakan aturan terstandarisasi bawaan untuk beberapa produk cloud yang dapat Anda gunakan langsung.

Standardization Method: Saat mengonversi log akses menjadi log alert, hanya metode Real-time Consumption yang didukung.

Konfigurasi aturan deteksi ancaman

Berdasarkan kebutuhan keamanan Anda, Anda harus mengaktifkan atau membuat aturan deteksi log di manajemen aturan untuk menganalisis log, menghasilkan alert, dan membuat event keamanan. Untuk informasi lebih lanjut, lihat Aturan Deteksi.

Biaya dan pengeluaran

Solusi ini menimbulkan biaya dari layanan berikut. Sebelum melanjutkan, tinjau dokumentasi penagihan untuk setiap produk guna memperkirakan biaya Anda.

Azure: Harga Event Hubs.

Di sisi Alibaba Cloud: Biaya tergantung pada metode penyimpanan data yang Anda pilih.

CatatanUntuk informasi tentang penagihan Agentic SOC, lihat Detail penagihan dan Penagihan pay-as-you-go untuk Analisis dan Respons Ancaman.

Untuk informasi tentang penagihan Simple Log Service (SLS), lihat Ikhtisar penagihan SLS.

Jenis sumber data

Agentic SOC Billable Items

Item yang dapat ditagih SLS

Catatan

Agentic SOC Dedicated Collection Channel

Biaya ingestion log.

Biaya penyimpanan dan penulisan log.

CatatanKedua item tersebut mengonsumsi Log Ingestion Traffic.

Biaya untuk item selain penyimpanan dan penulisan log (seperti traffic jaringan publik).

Agentic SOC membuat dan mengelola resource SLS. Oleh karena itu, biaya penyimpanan dan penulisan Logstore ditagih melalui Agentic SOC.

User Log Service

Biaya ingestion log, yang mengonsumsi Log Ingestion Traffic.

Semua biaya terkait log (termasuk penyimpanan, penulisan, traffic jaringan publik, dll.).

Semua resource log dikelola oleh Simple Log Service (SLS). Oleh karena itu, semua biaya terkait log ditagih melalui SLS.