DeepSeek-R1 adalah model yang dikembangkan oleh DeepSeek yang unggul dalam tugas matematika, pemrograman, dan penalaran. Topik ini menggunakan model distill DeepSeek-R1-Distill-Qwen-7B sebagai contoh untuk menjelaskan cara melakukan fine-tuning pada model dalam seri ini.

Model yang didukung

Model Gallery mendukung LoRA supervised fine-tuning (SFT) untuk enam model distill. Tabel berikut mencantumkan konfigurasi sumber daya komputasi minimum yang direkomendasikan saat Anda menggunakan hiperparameter default dan dataset yang disediakan.

Distill Model | Base Model | Metode Pelatihan yang Didukung | Konfigurasi Minimum |

DeepSeek-R1-Distill-Qwen-1.5B | LoRA supervised fine-tuning | 1 × A10 (memori video 24 GB) | |

DeepSeek-R1-Distill-Qwen-7B | 1 × A10 (memori video 24 GB) | ||

DeepSeek-R1-Distill-Llama-8B | 1 × A10 (memori video 24 GB) | ||

DeepSeek-R1-Distill-Qwen-14B | 1 × GU8IS (memori video 48 GB) | ||

DeepSeek-R1-Distill-Qwen-32B | 2 × GU8IS (memori video 48 GB) | ||

DeepSeek-R1-Distill-Llama-70B | 8 × GU100 (memori video 80 GB) |

Panduan Cepat Mulai

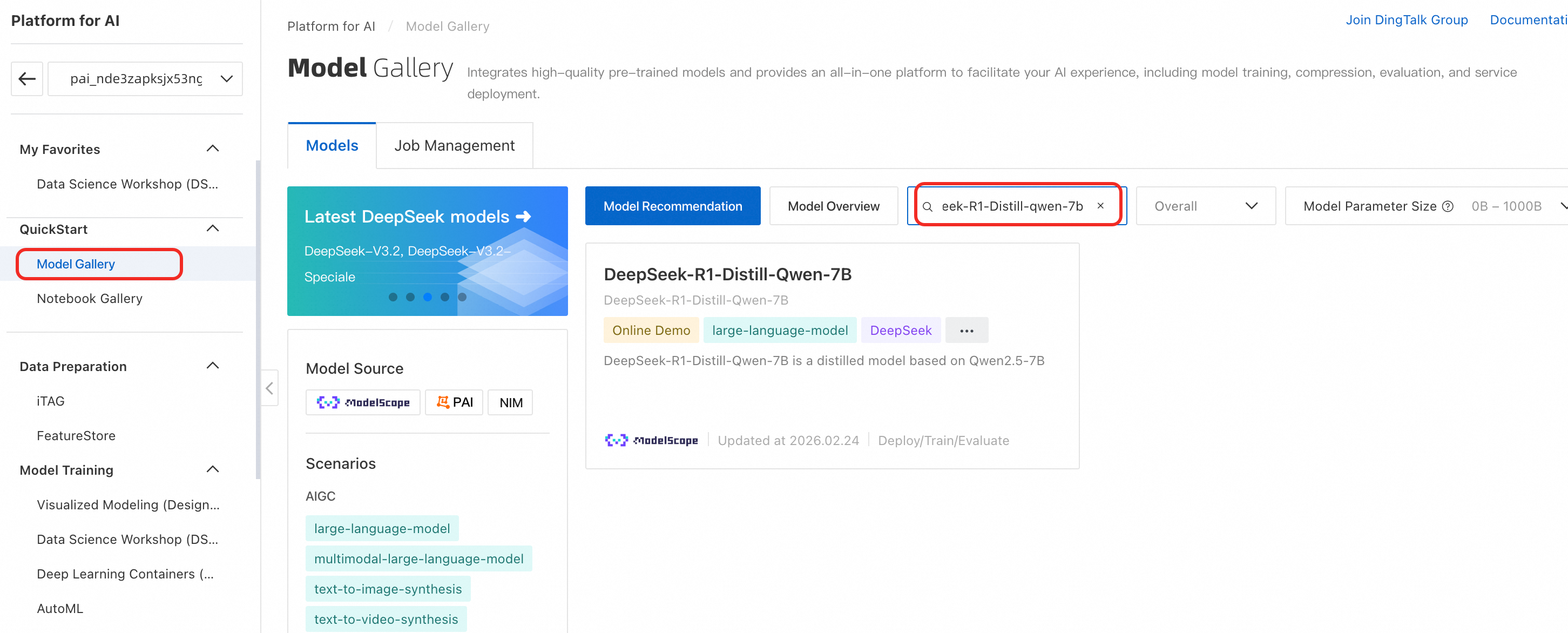

Buka halaman Model Gallery.

Masuk ke PAI console. Di panel navigasi sebelah kiri, pilih Workspace yang dituju.

Di panel navigasi kiri, pilih QuickStart > Model Gallery.

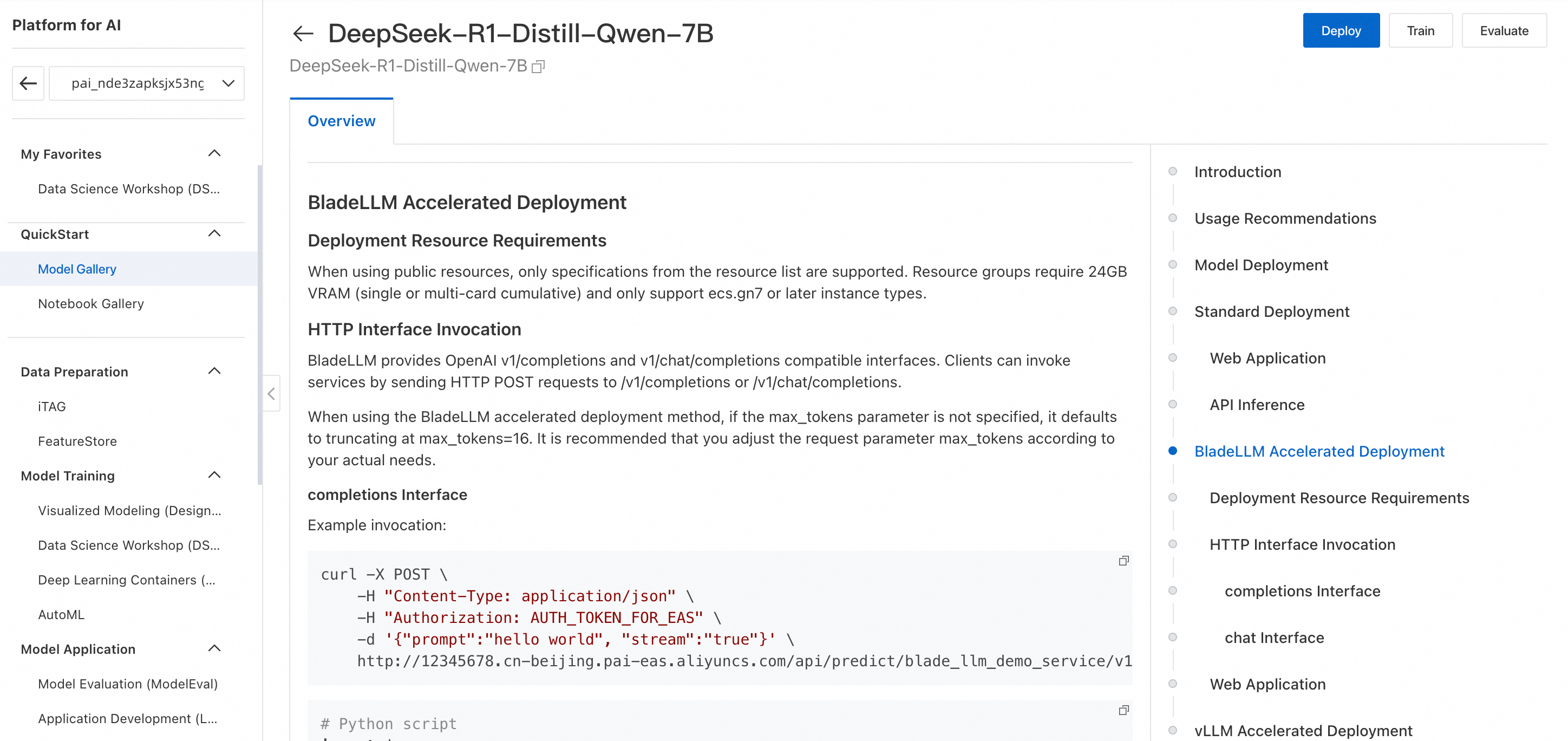

Di halaman Model Gallery, cari dan klik kartu model DeepSeek-R1-Distill-Qwen-7B untuk membuka halaman detail model. Halaman ini menyediakan informasi tentang pelatihan dan penerapan model, termasuk format data yang diperlukan untuk SFT dan metode pemanggilan model.

Klik Train di pojok kanan atas. Konfigurasikan parameter utama berikut:

Dataset configuration: Contoh ini menggunakan dataset default. Anda juga dapat menyiapkan dataset kustom sesuai persyaratan format di halaman detail model dan mengunggahnya ke bucket Object Storage Service (OSS).

Model output path: Pilih path OSS untuk menyimpan model hasil fine-tuning.

Computing Resources: Untuk Source, pilih public resource. Untuk Instance type, pilih

ecs.gn7i-c16g1.4xlarge.Hyperparameters: Tabel berikut menjelaskan hiperparameter yang didukung untuk LoRA supervised fine-tuning. Anda dapat menyesuaikannya sesuai kebutuhan. Untuk informasi lebih lanjut, lihat Panduan fine-tuning untuk model bahasa besar.

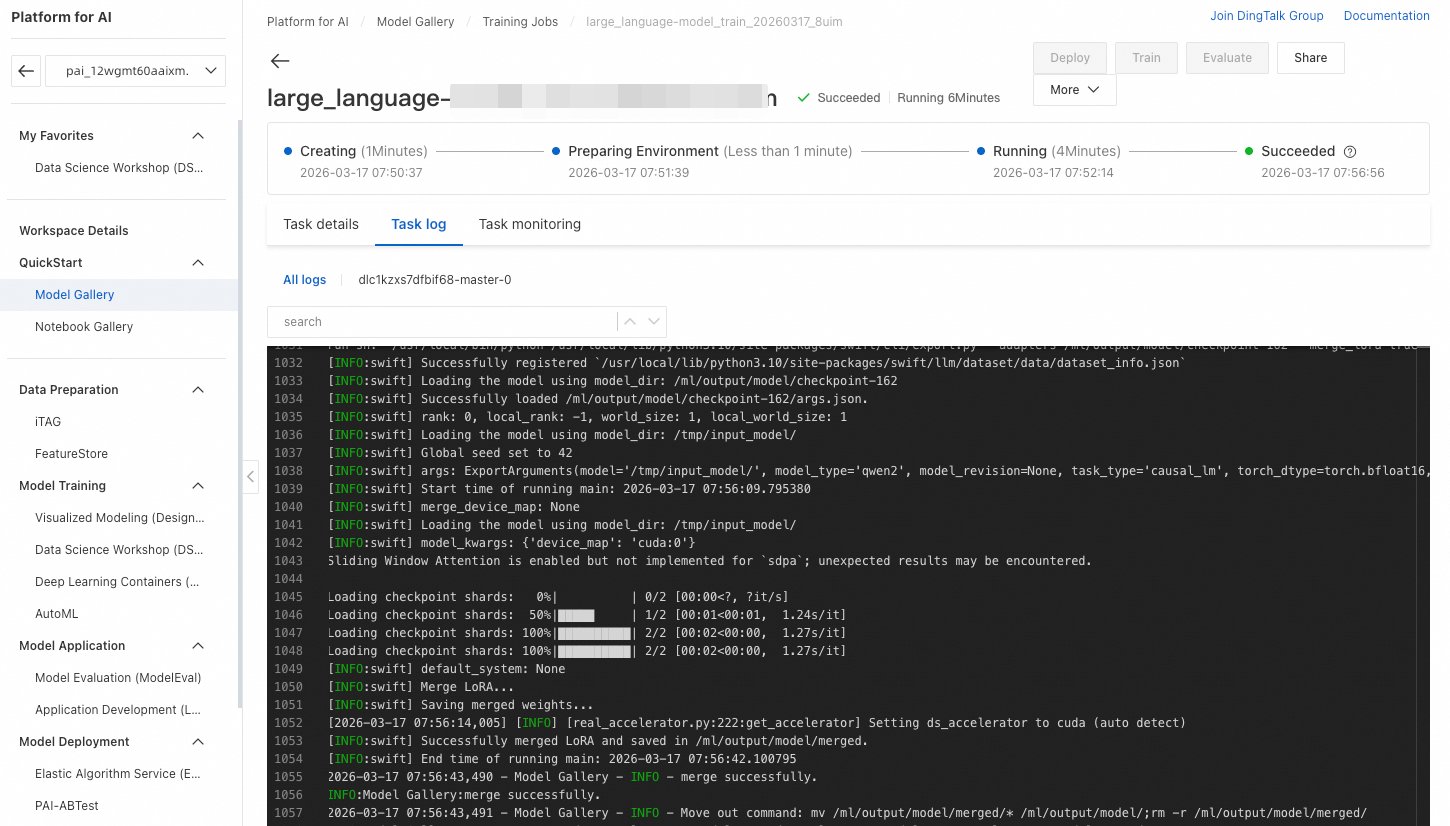

Klik Train. PAI secara otomatis mengalihkan Anda ke halaman pekerjaan pelatihan tempat Anda dapat memantau status pekerjaan dan melihat log.

Saat pekerjaan pelatihan berhasil, sistem secara otomatis mendaftarkan model hasil fine-tuning di AI Asset Management - Models. Anda kemudian dapat melihat atau menerapkan model tersebut. Untuk detailnya, lihat Daftarkan dan kelola model.

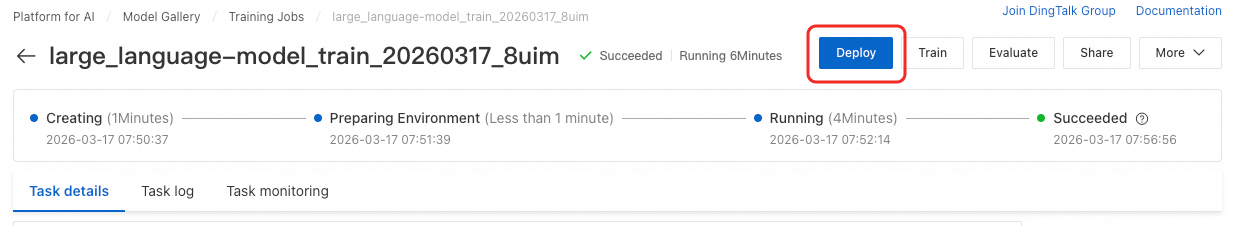

Setelah pelatihan selesai, klik Deploy di pojok kanan atas untuk menerapkan model hasil fine-tuning sebagai layanan EAS. Metode pemanggilannya sama dengan model distill aslinya. Untuk informasi lebih lanjut, lihat halaman detail model atau Terapkan model DeepSeek-V3 dan DeepSeek-R1.

Tagihan

Pelatihan model di Model Gallery menggunakan DLC. DLC ditagih berdasarkan durasi pekerjaan pelatihan. Untuk informasi lebih lanjut, lihat Tagihan untuk DLC.

FAQ

T: Bagaimana cara mengatasi pekerjaan pelatihan yang gagal?

Atur

max_lengthyang sesuai dalam konfigurasi pelatihan. Algoritma pelatihan akan membuang data yang melebihimax_lengthdan mencatat tindakan tersebut di log tugas: Jika terlalu banyak data dibuang, set data pelatihan atau validasi bisa menjadi kosong, sehingga menyebabkan pekerjaan pelatihan gagal:

Jika terlalu banyak data dibuang, set data pelatihan atau validasi bisa menjadi kosong, sehingga menyebabkan pekerjaan pelatihan gagal:

Log error

failed to compose dlc job specs, resource limiting triggered, you are trying to use more GPU resources than the thresholdmenunjukkan bahwa pekerjaan telah memicu batas sumber daya. Secara default, maksimal 2 GPU dapat berjalan secara bersamaan untuk pekerjaan pelatihan. Tunggu hingga pekerjaan yang sedang berjalan selesai sebelum memulai yang baru, atau ajukan tiket untuk meminta peningkatan kuota.Log error

the specified vswitch vsw-**** cannot create the required resource ecs.gn7i-c32g1.8xlarge, zone not matchmenunjukkan bahwa tipe instans yang ditentukan kehabisan stok di zona ketersediaan tempat VSwitch berada. Anda dapat mencoba solusi berikut: 1. Jangan tentukan VSwitch. DLC akan secara otomatis memilih VSwitch di zona ketersediaan dengan stok yang cukup. 2. Ganti ke tipe instans lain.

T: Apakah saya dapat mengunduh model setelah pelatihan?

Ya. Saat membuat pekerjaan pelatihan, Anda dapat mengatur path output model ke direktori OSS. Setelah pekerjaan selesai, Anda dapat mengunduh model dari path OSS yang ditentukan.

T: Apa yang harus saya lakukan jika kinerja model buruk?

Pertimbangkan solusi berikut:

Gunakan model dengan kinerja dasar yang lebih baik, seperti model dari seri DeepSeek atau Qwen3 dengan jumlah parameter yang lebih tinggi.

Perbaiki prompt Anda.

Tingkatkan nilai

max_tokens.Pecah tugas kompleks menjadi sub-tugas yang lebih kecil agar dapat ditangani model secara terpisah.