Untuk mengintegrasikan kemampuan dari seri model bahasa besar (LLM) DeepSeek, Anda memerlukan layanan model backend yang stabil dan skalabel. Topik ini menjelaskan cara menyebar DeepSeek-V3 dan DeepSeek-R1 menggunakan Model Gallery pada Platform for AI (PAI). Metode ini menciptakan layanan model standar yang kompatibel dengan API, menghilangkan kebutuhan untuk mengelola infrastruktur dasar seperti konfigurasi lingkungan, pemuatan model, dan optimasi inferensi. Anda kemudian dapat mengintegrasikan titik akhir ini langsung ke dalam aplikasi Anda.

Arsitektur solusi

Solusi ini dibangun di atas PAI dan mencakup komponen inti berikut:

Model Gallery: Bertindak sebagai titik masuk untuk distribusi dan penyebaran model. Ini menyediakan model DeepSeek yang telah dikonfigurasi sebelumnya dan konfigurasi penyebaran yang sesuai.

Elastic Algorithm Service (EAS): Layanan inti yang menampung penyebaran model dan inferensi. Secara otomatis mengelola sumber daya komputasi dasar, seperti GPU, dan memulai instans layanan model berdasarkan konfigurasi Anda.

Mesin Percepatan Inferensi (SGLang, vLLM, atau BladeLLM): Mesin ini digunakan untuk mengoptimalkan kinerja inferensi model.

SGLang/vLLM: Menyediakan antarmuka yang sepenuhnya kompatibel dengan API OpenAI, yang menyederhanakan migrasi aplikasi yang ada.

BladeLLM: Kerangka kerja inferensi berkinerja tinggi milik Alibaba Cloud yang memberikan kinerja inferensi unggul dalam skenario tertentu.

Gerbang API: EAS mengekspos layanan model yang diterapkan melalui Gerbang API yang aman, menyediakan titik akhir layanan dan token otentikasi.

Langkah 1: Rencanakan model dan sumber daya

1. Pilih mesin inferensi

Disarankan: SGLang. Memberikan kinerja tinggi sambil tetap sepenuhnya kompatibel dengan standar API OpenAI, menjadikannya cocok untuk ekosistem aplikasi arus utama. Dalam sebagian besar skenario, mendukung panjang konteks maksimum lebih lama daripada vLLM.

Alternatif: vLLM. Sebagai kerangka kerja populer di industri, juga menawarkan kompatibilitas API yang sangat baik.

Untuk Skenario Tertentu: BladeLLM. Pilih BladeLLM, kerangka kerja inferensi berkinerja tinggi yang dikembangkan oleh Alibaba Cloud PAI, hanya jika Anda memprioritaskan kinerja inferensi maksimum dan dapat bekerja dengan API yang berbeda dari standar OpenAI. Misalnya, tidak mendukung

client.models.list(), dan parametermax_tokensmemiliki perilaku pemotongan default.

2. Pilih model dan sumber daya

Pilihan model Anda menentukan sumber daya komputasi yang diperlukan dan biaya penyebaran. Model DeepSeek tersedia dalam versi "full-version" dan "distilled", yang memiliki kebutuhan sumber daya yang sangat berbeda.

Pengembangan dan Pengujian: Gunakan model distilled, seperti

DeepSeek-R1-Distill-Qwen-7B. Model-model ini memiliki jejak sumber daya yang lebih kecil, biasanya satu GPU dengan 24 GB Memori GPU, menyebar dengan cepat, dan hemat biaya, menjadikannya ideal untuk validasi fitur cepat.Lingkungan Produksi: Evaluasi berdasarkan keseimbangan performa dan biaya. Model

DeepSeek-R1-Distill-Qwen-32Bmemberikan keseimbangan yang baik antara efektivitas dan biaya. Jika Anda memerlukan performa model yang lebih tinggi, pilih model full-version. Ini memerlukan beberapa GPU kelas atas, seperti delapan GPU dengan 96 GB Memori GPU masing-masing, yang secara signifikan meningkatkan biaya.

Tabel berikut mencantumkan konfigurasi minimum untuk versi model yang berbeda dan jumlah token maksimum yang didukung oleh tipe instans dan mesin inferensi yang berbeda.

Model full-version

Model | Metode penyebaran | Jumlah token maksimum (input + output) | Konfigurasi minimum | |

SGLang (Disarankan) | vLLM | |||

DeepSeek-R1 | Single-node - NVIDIA GPU | 56.000 | 65.536 | Single-node 8 × GU120 (8 × 96 GB Memori GPU) |

Single-node - Tipe instans GP7V | 56.000 | 16.384 | ||

Distributed - Sumber daya Lingjun | 163.840 | 163.840 | ||

DeepSeek-V3 | Single-node - NVIDIA GPU | 56.000 | 65.536 | Single-node 8 × GU120 (8 × 96 GB Memori GPU) |

Single-node - Tipe instans GP7V | 56.000 | 16.384 | ||

Distributed - Sumber daya Layanan Komputasi Cerdas Lingjun | 163.840 | 163.840 | ||

Catatan Tipe Instans Penyebaran Single-Node:

NVIDIA GPU:

ml.gu8v.c192m1024.8-gu120,ecs.gn8v-8x.48xlarge: Tersedia sebagai Sumber Daya Publik, namun ketersediaannya mungkin terbatas.ecs.ebmgn8v.48xlarge: Tipe instans ini tidak dapat digunakan sebagai sumber daya publik. Beli Sumber Daya EAS Khusus.

Tipe Instans GP7V:

ml.gp7vf.16.40xlargetersedia sebagai sumber daya publik dan hanya dapat digunakan sebagai instans preemptible. Jika sumber daya GPU NVIDIA langka, beralihlah ke wilayah China (Ulanqab) untuk menemukan sumber daya GP7V. Konfigurasikan VPC saat menyebar.

Deskripsi Tipe Instans Penyebaran Terdistribusi (disarankan ketika kinerja tinggi diperlukan):

Penyebaran terdistribusi bergantung pada jaringan berkecepatan tinggi dan harus menggunakan Layanan Komputasi Cerdas Lingjun PAI, yang menyediakan daya komputasi heterogen elastis berkinerja tinggi. Anda juga harus mengonfigurasi VPC selama penyebaran. Untuk menggunakan Layanan Komputasi Cerdas Lingjun PAI, ubah wilayah ke China (Ulanqab).

Sumber Daya Publik Lingjun:

ml.gu7xf.8xlarge-gu108: Memerlukan empat mesin untuk penyebaran instans tunggal dan hanya dapat digunakan sebagai Instans Preemptible.Tipe Instans GP7V: Memerlukan dua mesin untuk penyebaran instans tunggal.

Sumber Daya Prabayar Lingjun: Memerlukan persetujuan daftar putih. Hubungi manajer penjualan Anda atau ajukan tiket untuk konsultasi.

Model distilled

Model | Jumlah token maksimum (input + output) | Konfigurasi minimum | ||

SGLang (Disarankan) | vLLM | BladeLLM | ||

DeepSeek-R1-Distill-Qwen-1.5B | 131.072 | 131.072 | 131.072 | 1 × A10 GPU (24 GB Memori GPU) |

DeepSeek-R1-Distill-Qwen-7B | 131.072 | 32.768 | 131.072 | 1 × A10 GPU (24 GB Memori GPU) |

DeepSeek-R1-Distill-Llama-8B | 131.072 | 32.768 | 131.072 | 1 × A10 GPU (24 GB Memori GPU) |

DeepSeek-R1-Distill-Qwen-14B | 131.072 | 32.768 | 131.072 | 1 × GPU L (48 GB Memori GPU) |

DeepSeek-R1-Distill-Qwen-32B | 131.072 | 32.768 | 131.072 | 2 × GPU L (2 × 48 GB Memori GPU) |

DeepSeek-R1-Distill-Llama-70B | 131.072 | 32.768 | 131.072 | 2 × GU120 (2 × 96 GB Memori GPU) |

Langkah 2: Menyebar layanan model

Masuk ke Konsol PAI, pilih wilayah target di pojok kiri atas, navigasikan ke Workspaces dari panel navigasi di sebelah kiri, dan pilih ruang kerja target.

Di dalam ruang kerja, navigasikan ke QuickStart > Model Gallery.

Dalam daftar model, cari dan pilih model target, seperti

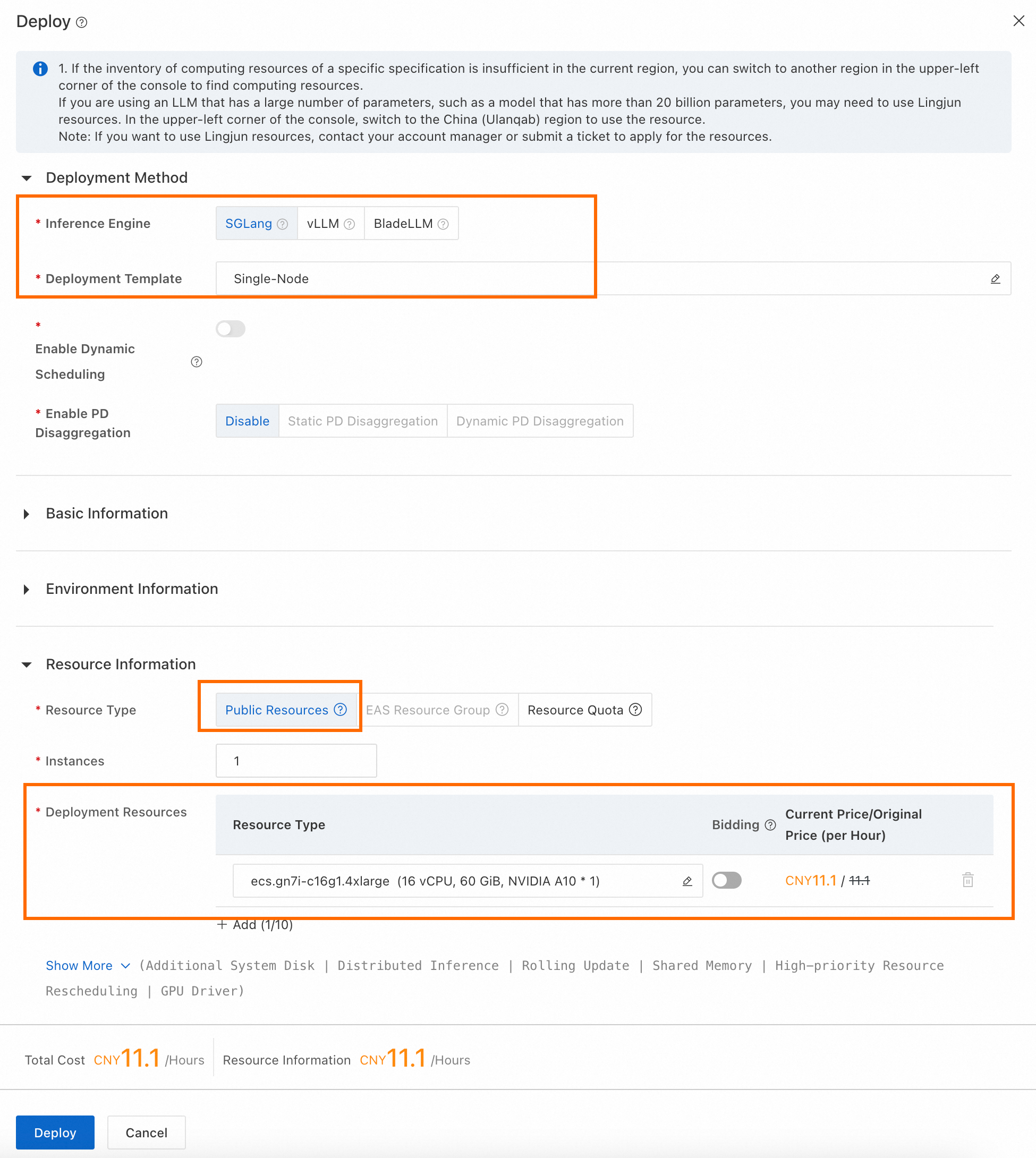

DeepSeek-R1-Distill-Qwen-7B, untuk pergi ke halaman detail model.Klik Deploy di pojok kanan atas. Di halaman konfigurasi penyebaran, atur parameter berikut berdasarkan rencana Anda dari Langkah 1.

Mesin Inferensi: SGLang atau vLLM disarankan.

Sumber Daya untuk Penyebaran: Pilih Sumber Daya Publik atau Sumber Daya Khusus, dan pilih spesifikasi GPU yang sesuai berdasarkan kebutuhan model.

Secara default, sumber daya publik digunakan, dan spesifikasi yang direkomendasikan disediakan. Jika ketersediaan tidak mencukupi, coba beralih ke wilayah lain.

PentingKetika Anda menyebar menggunakan sumber daya publik, penagihan dimulai begitu layanan memasuki status Berjalan dan ditagih berdasarkan durasi, bahkan jika tidak ada panggilan. Hentikan layanan segera setelah pengujian.

Jika Anda memilih Kuota Sumber Daya, Anda harus memilih mesin inferensi dan templat penyebaran yang sesuai dengan tipe instans yang dipilih. Misalnya, jika Anda menggunakan tipe instans GP7V, pilih SGLang sebagai mesin inferensi dan Single-node - GP7V Instance Type sebagai templat penyebaran.

Setelah memastikan semua konfigurasi benar, klik Deploy. Sistem mulai membuat layanan.

CatatanUntuk model dengan parameter besar, seperti full-version DeepSeek-R1, proses pemuatan model mungkin memakan waktu 20 hingga 30 menit.

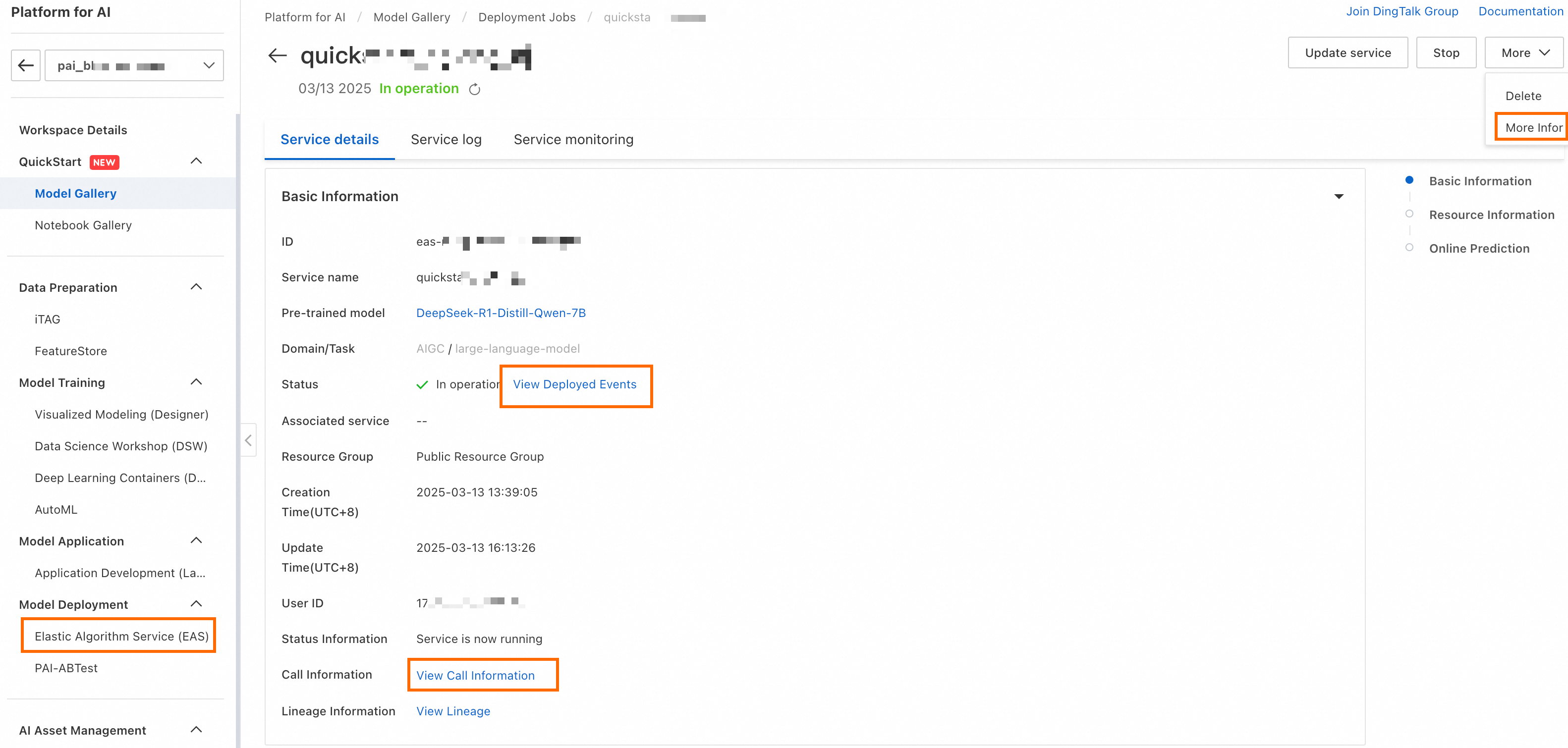

Lihat status tugas penyebaran di halaman Model Gallery > Task Management > Deployment Tasks. Klik nama layanan untuk pergi ke halaman detail layanan. Anda juga dapat mengklik More Information di pojok kanan atas untuk menavigasi ke halaman detail layanan model PAI-EAS untuk informasi lebih lanjut.

Langkah 3: Debug online

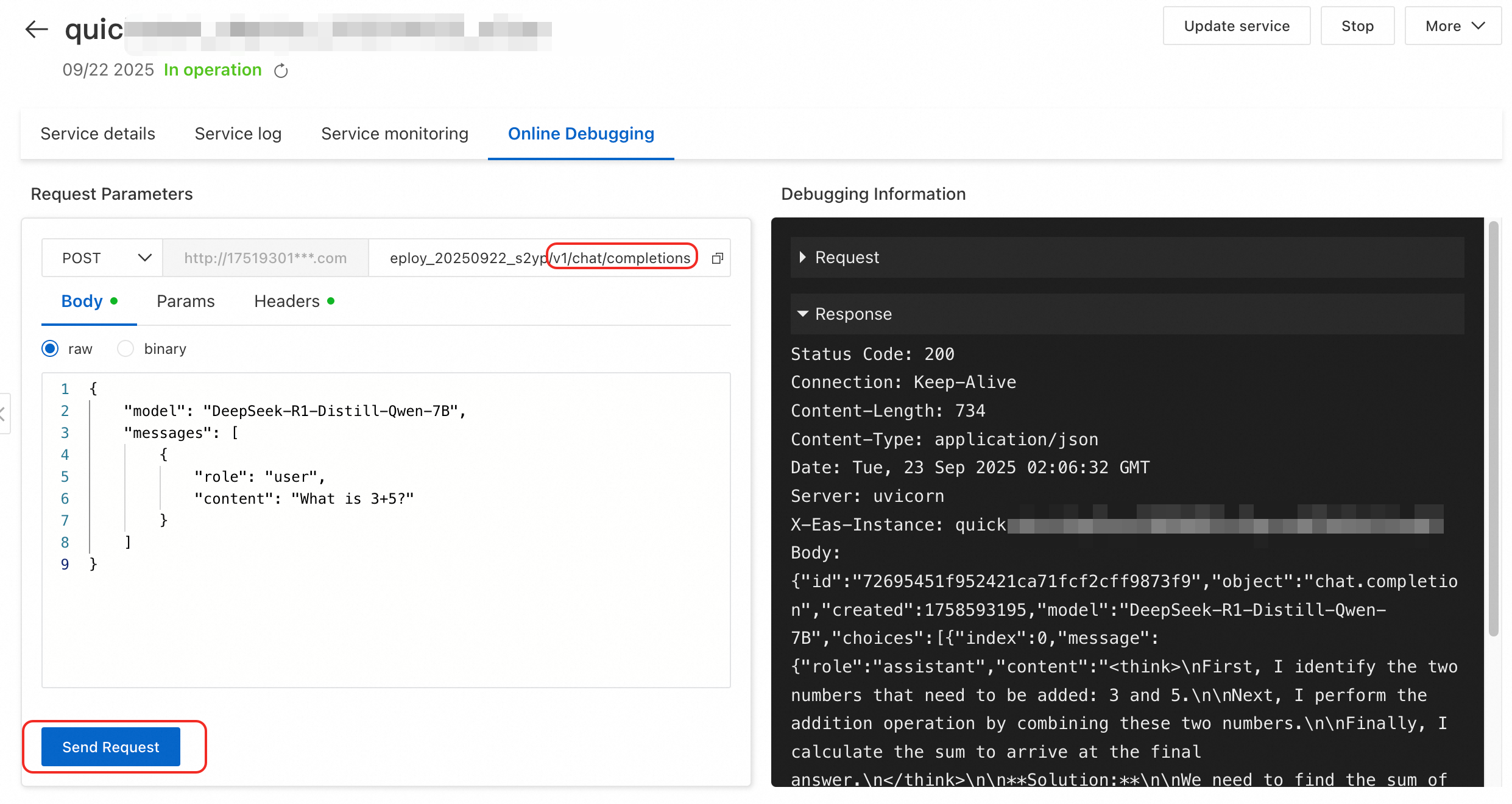

Navigasikan ke halaman Model Gallery > Task Management > Deployment Tasks dan klik nama layanan yang telah diterapkan.

Di bagian Online Test, temukan alat debugging online.

Untuk penyebaran SGLang/vLLM, Anda bisa mendapatkan file deskripsi API layanan dari <EAS_ENDPOINT>/openapi.json. Langkah-langkah berikut menguji titik akhir penyelesaian percakapan POST <EAS_ENDPOINT>/v1/chat/completions.

Tambahkan Jalur API. Alat pengujian online mengisi endpoint URL secara otomatis. Tambahkan jalur API spesifik, yaitu

v1/chat/completions.Buat Badan Permintaan.

Jika prompt adalah: Berapa 3+5?

Format badan permintaan adalah sebagai berikut. Nilai untuk parameter

modeladalah nama model yang diperoleh dari endpoint<EAS_ENDPOINT>/v1/models. Contoh ini menggunakanDeepSeek-R1-Distill-Qwen-7B.{ "model": "DeepSeek-R1-Distill-Qwen-7B", "messages": [ { "role": "user", "content": "Berapa 3 + 5?" } ] }Kirim Permintaan.

Langkah 4: Panggil layanan model

Rekomendasi penggunaan resmi untuk seri model DeepSeek-R1 adalah sebagai berikut:

Atur

temperatureantara 0,5 dan 0,7. Nilai yang disarankan adalah 0,6 untuk mencegah output berulang atau tidak koheren.Jangan tambahkan prompt sistem. Tempatkan semua instruksi dalam prompt pengguna.

Untuk pertanyaan terkait matematika, disarankan untuk menyertakan "Silakan beri alasan langkah demi langkah dan letakkan jawaban akhir dalam \boxed{}." dalam prompt.

Untuk mencegah pemotongan output yang tidak terduga saat menggunakan BladeLLM, Anda harus menentukan parameter max_tokens dalam permintaan. Jika parameter ini dihilangkan, mesin BladeLLM memotong output menjadi 16 token secara default.

Panggilan API

Dapatkan titik akhir layanan dan token.

Di halaman Model Gallery > Task Management > Deployment Tasks, klik nama layanan yang diterapkan untuk pergi ke halaman detail layanan.

Klik View Call Information untuk mendapatkan titik akhir layanan dan token.

Gunakan contoh panggilan API chat.

Ganti

<EAS_ENDPOINT>dengan titik akhir layanan dan<EAS_TOKEN>dengan token layanan.OpenAI SDK

Catatan:

Tambahkan

/v1di akhir endpoint.Penyebaran yang dipercepat dengan BladeLLM tidak mendukung

client.models.list(). Sebagai solusi, atur parametermodelke string kosong ("").

Penyebaran yang dipercepat SGLang/vLLM

from openai import OpenAI # 1. Konfigurasikan klien # Ganti <EAS_ENDPOINT> dan <EAS_TOKEN> dengan endpoint dan token sebenarnya dari layanan Anda. openai_api_key = "<EAS_TOKEN>" openai_api_base = "<EAS_ENDPOINT>/v1" client = OpenAI( api_key=openai_api_key, base_url=openai_api_base, ) # 2. Dapatkan nama model try: model = client.models.list().data[0].id print(model) except Exception as e: print(f"Gagal mendapatkan daftar model. Periksa endpoint dan token Anda. Kesalahan: {e}") # 3. Buat dan kirim permintaan stream = True chat_completion = client.chat.completions.create( messages=[ {"role": "user", "content": "Halo, tolong perkenalkan dirimu."} ], model=model, max_tokens=2048, stream=stream, ) if stream: for chunk in chat_completion: print(chunk.choices[0].delta.content, end="") else: result = chat_completion.choices[0].message.content print(result)Penyebaran yang dipercepat BladeLLM

from openai import OpenAI ##### Konfigurasi API ##### # Ganti <EAS_ENDPOINT> dengan endpoint layanan yang diterapkan dan <EAS_TOKEN> dengan token layanan yang diterapkan. openai_api_key = "<EAS_TOKEN>" openai_api_base = "<EAS_ENDPOINT>/v1" client = OpenAI( api_key=openai_api_key, base_url=openai_api_base, ) # Penyebaran yang dipercepat BladeLLM saat ini tidak mendukung penggunaan client.models.list() untuk mendapatkan nama model. Anda dapat mengatur nilai model ke "" untuk kompatibilitas. model="" stream = True chat_completion = client.chat.completions.create( messages=[ {"role": "user", "content": "Halo, tolong perkenalkan dirimu."} ], model=model, max_tokens=2048, stream=stream, ) if stream: for chunk in chat_completion: print(chunk.choices[0].delta.content, end="") else: result = chat_completion.choices[0].message.content print(result)HTTP

Penyebaran yang dipercepat SGLang/vLLM

Ganti <model_name> dengan nama model yang diperoleh dari API daftar model

<EAS_ENDPOINT>/v1/models.curl -X POST \ -H "Content-Type: application/json" \ -H "Authorization: <EAS_TOKEN>" \ -d '{ "model": "<model_name>", "messages": [ { "role": "user", "content": "halo!" } ] }' \ <EAS_ENDPOINT>/v1/chat/completionsimport json import requests # Ganti <EAS_ENDPOINT> dengan endpoint layanan yang diterapkan dan <EAS_TOKEN> dengan token layanan yang diterapkan. EAS_ENDPOINT = "<EAS_ENDPOINT>" EAS_TOKEN = "<EAS_TOKEN>" url = f"{EAS_ENDPOINT}/v1/chat/completions" headers = { "Content-Type": "application/json", "Authorization": EAS_TOKEN, } # Ganti <model_name> dengan nama model yang diperoleh dari API daftar model <EAS_ENDPOINT>/v1/models. model = "<model_name>" stream = True messages = [ {"role": "user", "content": "Halo, tolong perkenalkan dirimu."}, ] req = { "messages": messages, "stream": stream, "temperature": 0.6, "top_p": 0.5, "top_k": 10, "max_tokens": 300, "model": model, } response = requests.post( url, json=req, headers=headers, stream=stream, ) if stream: for chunk in response.iter_lines(chunk_size=8192, decode_unicode=False): msg = chunk.decode("utf-8") if msg.startswith("data"): info = msg[6:] if info == "[DONE]": break else: resp = json.loads(info) print(resp["choices"][0]["delta"]["content"], end="") else: resp = json.loads(response.text) print(resp["choices"][0]["message"]["content"])Penyebaran yang dipercepat BladeLLM

curl -X POST \ -H "Content-Type: application/json" \ -H "Authorization: <EAS_TOKEN>" \ -d '{ "messages": [ { "role": "user", "content": "halo!" } ] }' \ <EAS_ENDPOINT>/v1/chat/completionsimport json import requests # Ganti <EAS_ENDPOINT> dengan endpoint layanan yang diterapkan dan <EAS_TOKEN> dengan token layanan yang diterapkan. EAS_ENDPOINT = "<EAS_ENDPOINT>" EAS_TOKEN = "<EAS_TOKEN>" url = f"{EAS_ENDPOINT}/v1/chat/completions" headers = { "Content-Type": "application/json", "Authorization": EAS_TOKEN, } stream = True messages = [ {"role": "user", "content": "Halo, tolong perkenalkan dirimu."}, ] # Saat menggunakan BladeLLM untuk penyebaran yang dipercepat, jika Anda tidak menentukan parameter max_tokens, output akan dipotong menjadi 16 token secara default. Kami sarankan Anda menyesuaikan parameter permintaan max_tokens sesuai kebutuhan. req = { "messages": messages, "stream": stream, "temperature": 0.6, "top_p": 0.5, "top_k": 10, "max_tokens": 300, } response = requests.post( url, json=req, headers=headers, stream=stream, ) if stream: for chunk in response.iter_lines(chunk_size=8192, decode_unicode=False): msg = chunk.decode("utf-8") if msg.startswith("data"): info = msg[6:] if info == "[DONE]": break else: resp = json.loads(info) if resp["choices"][0]["delta"].get("content") is not None: print(resp["choices"][0]["delta"]["content"], end="", flush=True) else: resp = json.loads(response.text) print(resp["choices"][0]["message"]["content"])Model dan kerangka kerja penyebaran yang berbeda memiliki perilaku yang berbeda saat menggunakan layanan inferensi. Temukan instruksi lebih rinci tentang panggilan API di halaman pengenalan model di Model Gallery.

Buat WebUI lokal

Gradio adalah pustaka Python yang ramah pengguna untuk dengan cepat membuat antarmuka interaktif untuk model pembelajaran mesin. Ikuti langkah-langkah berikut untuk menjalankan WebUI Gradio secara lokal.

Unduh Kode: Unduh kode yang sesuai berdasarkan mesin inferensi yang Anda pilih selama penyebaran. Gunakan tautan GitHub jika Anda memiliki akses jaringan stabil ke GitHub. Jika tidak, gunakan tautan OSS.

vLLM, SGLang: vLLM/SGLang_github, vLLM/SGLang_oss

BladeLLM: BladeLLM_github, BladeLLM_oss

Siapkan Lingkungan: Python 3.10 atau yang lebih baru diperlukan. Instal dependensi:

pip install openai gradio.Mulai Aplikasi Web: Jalankan perintah berikut di terminal Anda. Ganti

<EAS_ENDPOINT>dan<EAS_TOKEN>dengan Endpoint dan Token layanan Anda.python webui_client.py --eas_endpoint "<EAS_ENDPOINT>" --eas_token "<EAS_TOKEN>"Setelah aplikasi berhasil dimulai, URL lokal (biasanya

http://127.0.0.1:7860) dicetak ke konsol Anda. Buka URL ini di browser Anda untuk mengakses WebUI.

Integrasi aplikasi pihak ketiga

Untuk terhubung ke Chatbox, Dify, atau Cherry Studio, lihat Integrasi Klien Pihak Ketiga.

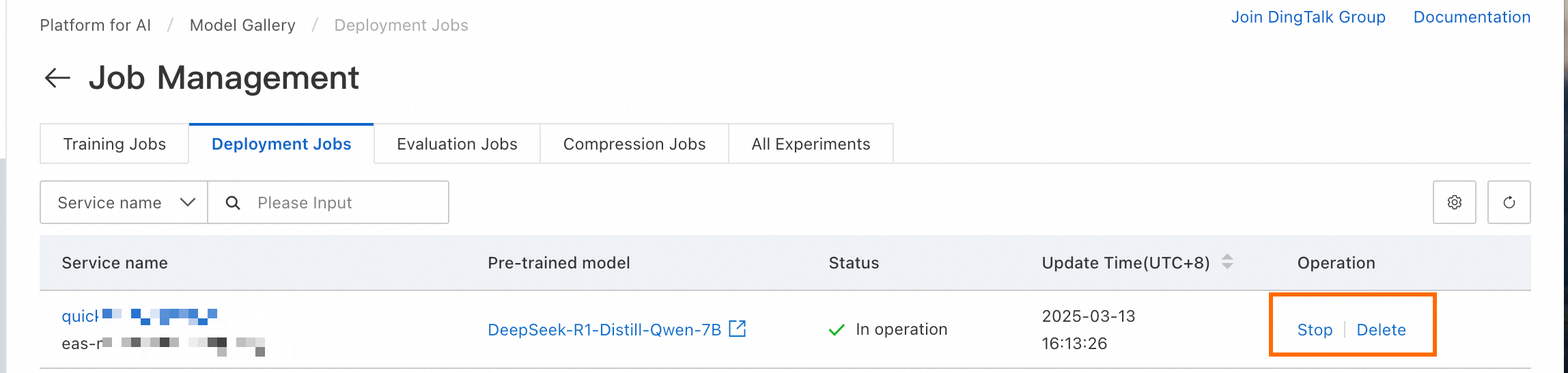

Langkah 5: Bersihkan sumber daya

Untuk layanan yang diterapkan menggunakan Sumber Daya Publik, penagihan dimulai dari saat layanan berhasil dibuat dan didasarkan pada durasi waktu prosesnya. Untuk mencegah biaya lebih lanjut, hentikan atau hapus layanan ketika tidak lagi diperlukan.

Kembali ke halaman Manajemen Tugas > Tugas Penyebaran.

Temukan layanan yang ingin Anda hentikan dan klik Hentikan atau Hapus di kolom Tindakan.

Hentikan: Instans layanan dilepaskan, dan penagihan berhenti. Konfigurasi layanan disimpan, memungkinkan Anda memulainya kembali nanti.

Hapus: Baik konfigurasi layanan maupun instans dihapus secara permanen.

Biaya dan risiko

Rincian biaya

Layanan yang diterapkan menggunakan Sumber Daya Publik ditagih per menit dari pembuatan (ketika status menjadi "Berjalan") hingga dihentikan atau dihapus, dengan tagihan diselesaikan setiap jam. Penagihan berlanjut bahkan jika layanan tidak aktif. Menghentikan layanan menghentikan penagihan.

Untuk informasi lebih lanjut, lihat Penagihan Elastic Algorithm Service (EAS).

Rekomendasi pengendalian biaya

Bersihkan Segera: Setelah pengembangan dan pengujian, Hentikan atau Hapus layanan segera untuk mengendalikan biaya.

Pilih Model yang Sesuai: Di lingkungan non-produksi, prioritaskan penggunaan model distilled yang lebih hemat biaya.

Gunakan Sumber Daya Preemptible: Untuk tugas non-produksi, aktifkan mode preemptible selama penyebaran. Perhatikan bahwa kondisi tertentu harus dipenuhi untuk penawaran yang sukses, dan ada risiko ketidakstabilan sumber daya.

Manfaatkan Diskon Penggunaan Jangka Panjang: Untuk layanan produksi jangka panjang, kurangi biaya dengan membeli rencana penghematan atau sumber daya prabayar.

Risiko utama

Biaya Tak Terduga: Lupa menghentikan layanan mengakibatkan penagihan terus-menerus. Selalu bersihkan sumber daya segera setelah digunakan.

Pemotongan Output dengan BladeLLM: Saat menggunakan mesin BladeLLM, jika

max_tokenstidak ditentukan dalam permintaan API, output dipotong menjadi 16 token, yang dapat menyebabkan perilaku tak terduga atau kegagalan fungsi.Spesifikasi Panggilan API yang Salah:

Memasukkan

systemprompt dalammessagessaat memanggil model seri DeepSeek-R1 dapat menyebabkan perilaku tak terduga.URL permintaan API harus diakhiri dengan jalur seperti

/v1/chat/completions; jika tidak, akan mengembalikan kesalahan 404.

Ketersediaan Sumber Daya: Saat menyebar LLM, terutama versi lengkap, sumber daya GPU kelas atas di wilayah tertentu mungkin memiliki ketersediaan terbatas, yang mengarah pada kegagalan penyebaran atau waktu tunggu lama. Coba beralih ke wilayah lain.

FAQ penyebaran model

Layanan macet dalam keadaan menunggu setelah saya klik deploy

Alasan yang mungkin termasuk:

Sumber daya mesin tidak mencukupi di wilayah saat ini.

Model besar, dan memuatnya memerlukan waktu lama. Untuk LLM seperti DeepSeek-R1 dan DeepSeek-V3, proses ini bisa memakan waktu 20-30 menit.

Anda bisa menunggu dan mengamati sejenak. Jika layanan masih gagal dimulai setelah periode yang lama, coba langkah-langkah berikut:

Pergi ke halaman Task Management > Deployment Tasks untuk melihat detail tugas penyebaran. Di pojok kanan atas halaman, klik untuk menavigasi ke halaman detail layanan model PAI-EAS dan periksa status instans layanan.

Hentikan layanan saat ini dan beralih ke wilayah lain di pojok kiri atas konsol untuk menyebar ulang.

CatatanModel ultra-besar-parameter seperti DeepSeek-R1 dan DeepSeek-V3 memerlukan setup 8-GPU untuk memulai layanan, dan ketersediaan sumber daya terbatas. Pertimbangkan untuk menyebar model distilled yang lebih kecil seperti

DeepSeek-R1-Distill-Qwen-7B, untuk mana sumber daya lebih mudah tersedia.

FAQ panggilan model

Mengapa saya mendapatkan kesalahan 404 saat memanggil API?

Periksa apakah sufiks API OpenAI, seperti v1/chat/completions, telah ditambahkan ke URL yang Anda panggil. Untuk detailnya, lihat instruksi panggilan API di halaman beranda model.

Jika Anda menggunakan penyebaran yang dipercepat vLLM, periksa apakah parameter model dalam badan permintaan panggilan API chat diisi dengan nama model yang benar. Anda bisa mendapatkan nama model dengan memanggil endpoint /v1/models.

Permintaan terlalu lama dan menyebabkan timeout gateway

Timeout permintaan default untuk gateway yang digunakan selama penyebaran adalah 180 detik. Jika Anda perlu memperpanjang timeout ini, konfigurasikan Gateway Khusus dan ajukan tiket untuk menyesuaikan timeout permintaan untuk Gateway Khusus. Timeout maksimum yang dapat disesuaikan adalah 600 detik.

Mengapa tidak ada fitur "pencarian web"?

Fitur "pencarian web" tidak dapat diimplementasikan hanya dengan menyebar layanan model. Anda harus membangun aplikasi AI (Agent) berdasarkan layanan model.

Apa yang harus saya lakukan jika model melewati proses berpikir?

Jika Anda menyebar model DeepSeek-R1 dan menghadapi situasi di mana model kadang-kadang melewati proses berpikirnya, gunakan template obrolan terbaru dari DeepSeek yang memaksa berpikir. Untuk menggunakannya:

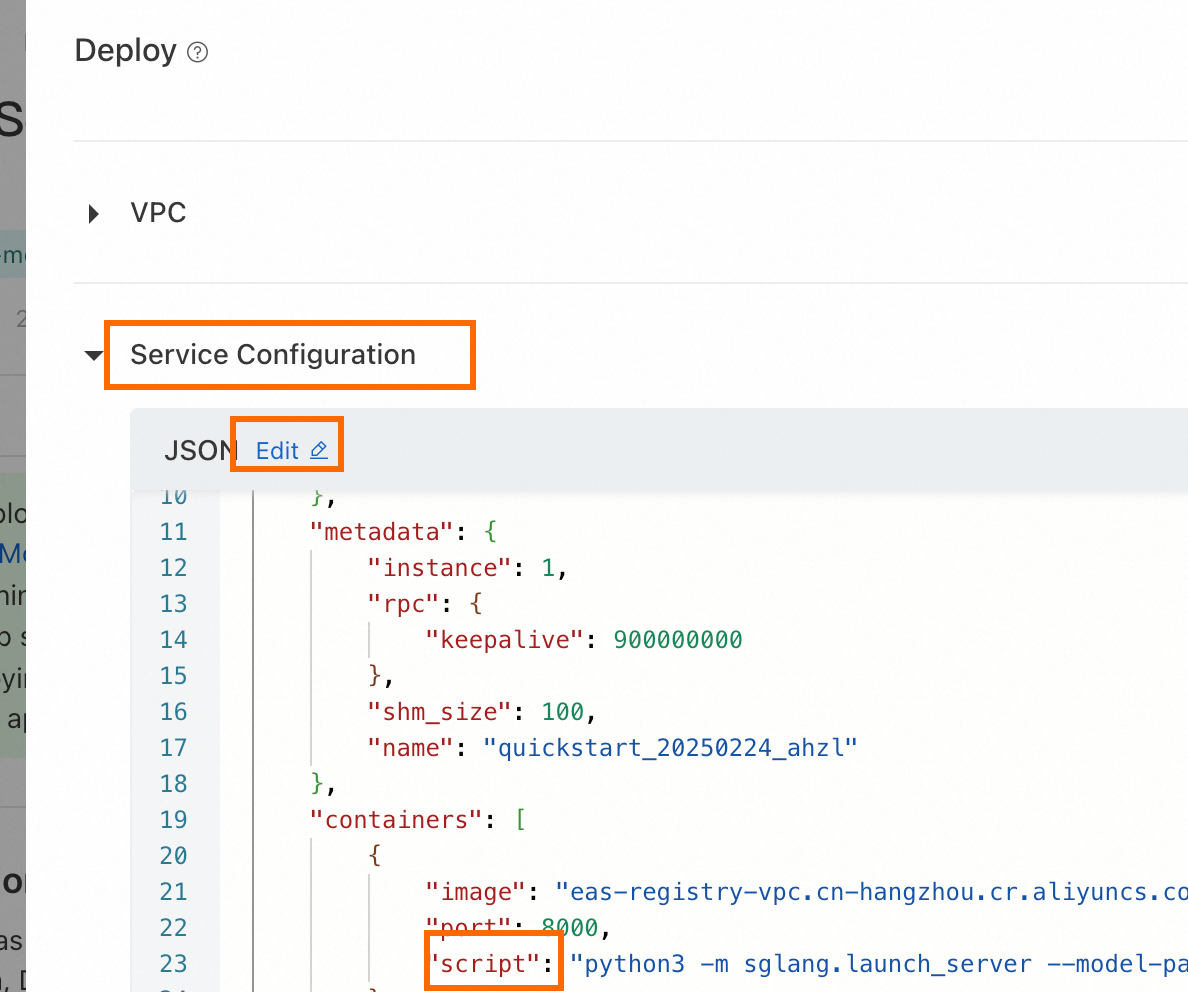

Ubah Perintah Startup.

Seperti yang ditunjukkan pada gambar, edit konfigurasi layanan dengan mengedit JSON Configuration. Ubah bidang

containers-scriptuntuk menambahkan"--chat-template /model_dir/template_force_thinking.jinja"(Anda dapat menambahkannya setelah"--served-model-name DeepSeek-R1").

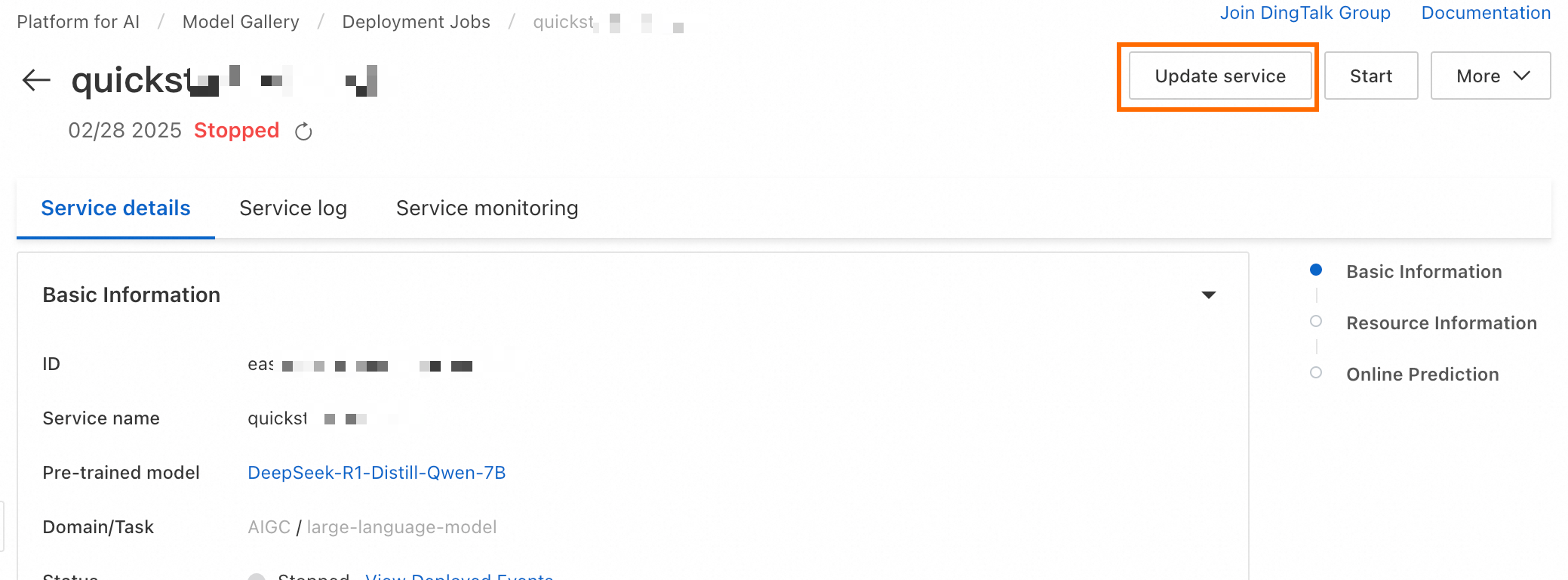

Jika layanan sudah diterapkan, pergi ke Model Gallery > Task Management > Deployment Tasks, klik nama layanan yang diterapkan, dan kemudian klik Update Service di pojok kanan atas halaman detail untuk mengakses halaman konfigurasi yang sama.

Ubah Badan Permintaan. Dalam setiap permintaan, tambahkan

{"role": "assistant", "content": "<think>\n"}di akhir arraymessages.

Bisakah saya menonaktifkan mode berpikir untuk DeepSeek-R1?

Seri model DeepSeek-R1 saat ini tidak mendukung menonaktifkan proses berpikir.

Bagaimana cara mengimplementasikan percakapan multi-putaran?

Layanan model itu sendiri tidak menyimpan riwayat percakapan. Aplikasi klien bertanggung jawab untuk menyimpan riwayat dan menyertakannya dalam permintaan berikutnya ke model. Berikut adalah contohnya untuk layanan yang diterapkan dengan SGLang.

curl -X POST \

-H "Content-Type: application/json" \

-H "Authorization: <EAS_TOKEN>" \

-d '{

"model": "<model_name>",

"messages": [

{

"role": "user",

"content": "Halo"

},

{

"role": "assistant",

"content": "Halo! Senang bertemu denganmu. Apa yang bisa saya bantu?"

},

{

"role": "user",

"content": "Apa pertanyaan saya sebelumnya?"

}

]

}' \

<EAS_ENDPOINT>/v1/chat/completions