Panggil model DeepSeek di Alibaba Cloud Model Studio menggunakan API yang kompatibel dengan OpenAI atau SDK DashScope.

Ketersediaan model

Model hybrid-thinking (dikontrol oleh parameter

enable_thinking): deepseek-v3.2, deepseek-v3.2-exp, dan deepseek-v3.1Model thinking-only (selalu berpikir sebelum merespons): deepseek-r1 dan deepseek-r1-0528

Model non-thinking: deepseek-v3

deepseek-v3.2 adalah model DeepSeek terbaru. Model ini unggul dalam tugas pemrograman dan matematika, menawarkan harga termurah, serta memiliki batas laju yang lebih longgar. Kami merekomendasikannya sebagai pilihan utama Anda.

Saat ini, hanya model deepseek-v3.2 yang tersedia di wilayah internasional (Singapura). Lihat Daftar model untuk detail selengkapnya.

Model | Jendela konteks | Input maks | Max CoT | Respons maks |

(token) | ||||

deepseek-v3.2 Ukuran 685B | 131.072 | 98.304 | 32.768 | 65.536 |

deepseek-v3.2-exp Ukuran 685B | ||||

deepseek-v3.1 Ukuran 685B | ||||

deepseek-r1 Ukuran 685B | 16.384 | |||

deepseek-r1-0528 Ukuran 685B | ||||

deepseek-v3 Ukuran 671B | 131.072 | - | ||

CoT maks adalah jumlah maksimum token untuk proses berpikir dalam mode berpikir.

Model-model yang tercantum di atas bukan layanan pihak ketiga yang terintegrasi. Semuanya di-deploy di server Model Studio.

Untuk batas permintaan konkuren, lihat Batas laju DeepSeek.

Mulai

deepseek-v3.2 adalah model terbaru dalam seri DeepSeek. Gunakan parameter enable_thinking untuk beralih antara mode berpikir dan non-berpikir. Contoh berikut menunjukkan cara memanggil deepseek-v3.2 dalam mode berpikir.

Sebelum memulai, dapatkan Kunci API dan ekspor sebagai Variabel lingkungan. Jika Anda menggunakan SDK untuk memanggil model, instal SDK OpenAI atau DashScope.

Kompatibel dengan OpenAI

Parameter enable_thinking bukan parameter standar OpenAI. Di SDK Python OpenAI, teruskan parameter ini dalam extra_body. Di SDK Node.js, teruskan sebagai parameter tingkat atas.

Python

Kode contoh

from openai import OpenAI

import os

# Inisialisasi klien OpenAI

client = OpenAI(

# Jika variabel lingkungan tidak disetel, ganti dengan Kunci API Model Studio Anda: api_key="sk-xxx"

api_key=os.getenv("DASHSCOPE_API_KEY"),

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

)

messages = [{"role": "user", "content": "Who are you"}]

completion = client.chat.completions.create(

model="deepseek-v3.2",

messages=messages,

# Setel enable_thinking di extra_body untuk mengaktifkan mode berpikir

extra_body={"enable_thinking": True},

stream=True,

stream_options={

"include_usage": True

},

)

reasoning_content = "" # Proses berpikir lengkap

answer_content = "" # Respons lengkap

is_answering = False # Menunjukkan apakah fase respons telah dimulai

print("\n" + "=" * 20 + "Proses berpikir" + "=" * 20 + "\n")

for chunk in completion:

if not chunk.choices:

print("\n" + "=" * 20 + "Penggunaan token" + "=" * 20 + "\n")

print(chunk.usage)

continue

delta = chunk.choices[0].delta

# Kumpulkan hanya konten berpikir

if hasattr(delta, "reasoning_content") and delta.reasoning_content is not None:

if not is_answering:

print(delta.reasoning_content, end="", flush=True)

reasoning_content += delta.reasoning_content

# Mulai merespons saat konten diterima

if hasattr(delta, "content") and delta.content:

if not is_answering:

print("\n" + "=" * 20 + "Respons lengkap" + "=" * 20 + "\n")

is_answering = True

print(delta.content, end="", flush=True)

answer_content += delta.contentRespons

====================Proses berpikir====================

Ah, pengguna bertanya siapa saya. Ini pertanyaan pembuka yang sangat umum. Saya perlu memperkenalkan identitas dan fungsi saya secara sederhana dan jelas. Saya bisa mulai dari latar belakang perusahaan dan kemampuan inti untuk membantu pengguna memahami dengan cepat.

Saya harus menyoroti sifat gratis dan kekuatan berbasis teks, tetapi hindari penjelasan terlalu rinci. Terakhir, saya akan mengarahkan percakapan dengan pertanyaan terbuka, sesuai dengan sifat asisten.

Saya akan memposisikan diri sebagai asisten AI tingkat enterprise, yang profesional sekaligus ramah. Emoji dalam tanda kurung dapat menambah kesan ramah.

====================Respons lengkap====================

Halo! Saya DeepSeek, asisten AI yang dibuat oleh DeepSeek.

Saya adalah model berbasis teks saja. Meskipun saya tidak mendukung pengenalan multimodal, saya memiliki fitur unggah file yang dapat membantu Anda memproses berbagai file seperti gambar, txt, pdf, ppt, word, dan excel, serta membaca informasi teks darinya untuk membantu Anda. Saya sepenuhnya gratis digunakan, memiliki jendela konteks 128K, dan mendukung pencarian web (Anda perlu mengaktifkannya secara manual di Web/Aplikasi).

Pengetahuan saya mutakhir hingga Juli 2024, dan saya akan membantu Anda dengan antusiasme dan perhatian. Anda dapat mengunduh aplikasi saya dari toko aplikasi resmi.

Adakah yang bisa saya bantu? Baik itu pertanyaan tentang studi, pekerjaan, atau kehidupan sehari-hari, saya dengan senang hati membantu Anda! ✨

====================Penggunaan token====================

CompletionUsage(completion_tokens=238, prompt_tokens=5, total_tokens=243, completion_tokens_details=CompletionTokensDetails(accepted_prediction_tokens=None, audio_tokens=None, reasoning_tokens=93, rejected_prediction_tokens=None), prompt_tokens_details=None)Node.js

Kode contoh

import OpenAI from "openai";

import process from 'process';

// Inisialisasi klien OpenAI

const openai = new OpenAI({

// Jika variabel lingkungan tidak disetel, ganti dengan Kunci API Model Studio Anda: apiKey: "sk-xxx"

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1'

});

let reasoningContent = ''; // Proses berpikir lengkap

let answerContent = ''; // Respons lengkap

let isAnswering = false; // Menunjukkan apakah fase respons telah dimulai

async function main() {

try {

const messages = [{ role: 'user', content: 'Who are you' }];

const stream = await openai.chat.completions.create({

model: 'deepseek-v3.2',

messages,

// Catatan: Di SDK Node.js, parameter non-standar seperti enable_thinking diteruskan sebagai properti tingkat atas dan tidak perlu ditempatkan di extra_body.

enable_thinking: true,

stream: true,

stream_options: {

include_usage: true

},

});

console.log('\n' + '='.repeat(20) + 'Proses berpikir' + '='.repeat(20) + '\n');

for await (const chunk of stream) {

if (!chunk.choices?.length) {

console.log('\n' + '='.repeat(20) + 'Penggunaan token' + '='.repeat(20) + '\n');

console.log(chunk.usage);

continue;

}

const delta = chunk.choices[0].delta;

// Kumpulkan hanya konten berpikir

if (delta.reasoning_content !== undefined && delta.reasoning_content !== null) {

if (!isAnswering) {

process.stdout.write(delta.reasoning_content);

}

reasoningContent += delta.reasoning_content;

}

// Mulai merespons saat konten diterima

if (delta.content !== undefined && delta.content) {

if (!isAnswering) {

console.log('\n' + '='.repeat(20) + 'Respons lengkap' + '='.repeat(20) + '\n');

isAnswering = true;

}

process.stdout.write(delta.content);

answerContent += delta.content;

}

}

} catch (error) {

console.error('Error:', error);

}

}

main();Respons

====================Proses berpikir====================

Ah, pengguna bertanya siapa saya. Ini pertanyaan pembuka yang sangat umum. Saya perlu memperkenalkan identitas dan fungsi inti saya secara sederhana dan jelas, tanpa terlalu banyak detail.

Saya bisa mulai dari latar belakang perusahaan dan posisi dasar, lalu menyebutkan beberapa kemampuan utama agar pengguna cepat memahami apa yang bisa saya lakukan. Saya akan mengakhiri dengan pertanyaan terbuka agar pengguna mudah melanjutkan.

Saya harus menyoroti fitur praktis seperti gratis, konteks panjang, dan pemrosesan file. Saya akan menjaga nada ramah namun terkendali, tanpa menggunakan emoji.

====================Respons lengkap====================

Halo! Saya DeepSeek, asisten AI yang dibuat oleh DeepSeek.

Saya adalah model berbasis teks saja dengan jendela konteks 128K, dan saya dapat membantu Anda menjawab pertanyaan, berdialog, serta membantu tugas berbasis teks. Meskipun saya tidak mendukung pengenalan multimodal, saya dapat memproses file yang Anda unggah, seperti gambar, txt, pdf, ppt, word, dan excel, serta membaca informasi teks darinya untuk membantu Anda.

Saya sepenuhnya gratis digunakan dan tidak memiliki fungsi suara, tetapi Anda dapat mengunduh aplikasi saya dari toko aplikasi resmi. Untuk menggunakan pencarian web, ingatlah untuk mengaktifkannya secara manual di Web atau Aplikasi.

Pengetahuan saya mutakhir hingga Juli 2024, dan saya akan membantu Anda dengan antusiasme dan perhatian. Jika Anda memiliki pertanyaan atau butuh bantuan, beri tahu saja! Saya dengan senang hati membantu. ✨

====================Penggunaan token====================

{

prompt_tokens: 5,

completion_tokens: 243,

total_tokens: 248,

completion_tokens_details: { reasoning_tokens: 83 }

}HTTP

Kode contoh

curl

curl -X POST https://dashscope-intl.aliyuncs.com/compatible-mode/v1/chat/completions \

-H "Authorization: Bearer $DASHSCOPE_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "deepseek-v3.2",

"messages": [

{

"role": "user",

"content": "Who are you"

}

],

"stream": true,

"stream_options": {

"include_usage": true

},

"enable_thinking": true

}'DashScope

Python

Kode contoh

import os

import dashscope

from dashscope import Generation

dashscope.base_http_api_url = "https://dashscope-intl.aliyuncs.com/api/v1"

# Inisialisasi parameter permintaan

messages = [{"role": "user", "content": "Who are you?"}]

completion = Generation.call(

# Jika variabel lingkungan tidak disetel, ganti dengan Kunci API Model Studio Anda: api_key="sk-xxx"

api_key=os.getenv("DASHSCOPE_API_KEY"),

model="deepseek-v3.2",

messages=messages,

result_format="message", # Atur format hasil menjadi message

enable_thinking=True,

stream=True, # Aktifkan keluaran streaming

incremental_output=True, # Aktifkan keluaran inkremental

)

reasoning_content = "" # Proses berpikir lengkap

answer_content = "" # Respons lengkap

is_answering = False # Menunjukkan apakah fase respons telah dimulai

print("\n" + "=" * 20 + "Proses berpikir" + "=" * 20 + "\n")

for chunk in completion:

message = chunk.output.choices[0].message

# Kumpulkan hanya konten berpikir

if "reasoning_content" in message:

if not is_answering:

print(message.reasoning_content, end="", flush=True)

reasoning_content += message.reasoning_content

# Mulai merespons saat konten diterima

if message.content:

if not is_answering:

print("\n" + "=" * 20 + "Respons lengkap" + "=" * 20 + "\n")

is_answering = True

print(message.content, end="", flush=True)

answer_content += message.content

print("\n" + "=" * 20 + "Penggunaan token" + "=" * 20 + "\n")

print(chunk.usage)Respons

====================Proses berpikir====================

Oh, pengguna bertanya siapa saya. Ini pertanyaan perkenalan diri yang sangat mendasar. Saya perlu menyatakan identitas dan fungsi saya secara ringkas dan jelas, menghindari kompleksitas. Saya bisa mulai dari latar belakang perusahaan dan kemampuan inti untuk membantu pengguna memahami dengan cepat.

Mengingat pengguna mungkin baru, saya bisa menambahkan beberapa kasus penggunaan dan fitur khas, seperti gratis, konteks panjang, dan pemrosesan file. Saya akan mengakhiri dengan undangan terbuka untuk bantuan, menjaga sikap ramah.

Tidak perlu terlalu banyak detail teknis, fokus pada kemudahan penggunaan dan kepraktisan.

====================Respons lengkap====================

Halo! Saya DeepSeek, asisten AI yang dibuat oleh DeepSeek.

Saya adalah model berbasis teks saja. Meskipun saya tidak mendukung pengenalan multimodal, saya memiliki fitur unggah file yang dapat membantu Anda memproses file seperti gambar, txt, pdf, ppt, word, dan excel dengan membaca informasi teks untuk analisis. Saya sepenuhnya gratis digunakan, memiliki jendela konteks 128K, dan mendukung pencarian web (Anda perlu mengaktifkannya secara manual).

Pengetahuan saya mutakhir hingga Juli 2024, dan saya akan membantu Anda dengan antusiasme dan perhatian. Anda dapat mengunduh aplikasi saya dari toko aplikasi resmi.

Jika Anda memiliki pertanyaan atau butuh bantuan, tanyakan saja! Saya dengan senang hati menjawab pertanyaan Anda dan membantu berbagai tugas. ✨

====================Penggunaan token====================

{"input_tokens": 6, "output_tokens": 240, "total_tokens": 246, "output_tokens_details": {"reasoning_tokens": 92}}Java

Kode contoh

Gunakan SDK Java DashScope versi 2.19.4 atau lebih baru.

// Versi SDK DashScope harus 2.19.4 atau lebih baru.

import com.alibaba.dashscope.aigc.generation.Generation;

import com.alibaba.dashscope.aigc.generation.GenerationParam;

import com.alibaba.dashscope.aigc.generation.GenerationResult;

import com.alibaba.dashscope.common.Message;

import com.alibaba.dashscope.common.Role;

import com.alibaba.dashscope.exception.ApiException;

import com.alibaba.dashscope.exception.InputRequiredException;

import com.alibaba.dashscope.exception.NoApiKeyException;

import io.reactivex.Flowable;

import java.lang.System;

import java.util.Arrays;

public class Main {

private static StringBuilder reasoningContent = new StringBuilder();

private static StringBuilder finalContent = new StringBuilder();

private static boolean isFirstPrint = true;

private static void handleGenerationResult(GenerationResult message) {

String reasoning = message.getOutput().getChoices().get(0).getMessage().getReasoningContent();

String content = message.getOutput().getChoices().get(0).getMessage().getContent();

if (reasoning != null && !reasoning.isEmpty()) {

reasoningContent.append(reasoning);

if (isFirstPrint) {

System.out.println("====================Proses berpikir====================");

isFirstPrint = false;

}

System.out.print(reasoning);

}

if (content != null && !content.isEmpty()) {

finalContent.append(content);

if (!isFirstPrint) {

System.out.println("\n====================Respons lengkap====================");

isFirstPrint = true;

}

System.out.print(content);

}

}

private static GenerationParam buildGenerationParam(Message userMsg) {

return GenerationParam.builder()

// Jika variabel lingkungan tidak disetel, ganti dengan Kunci API Model Studio Anda: .apiKey("sk-xxx")

.apiKey(System.getenv("DASHSCOPE_API_KEY"))

.model("deepseek-v3.2")

.enableThinking(true)

.incrementalOutput(true)

.resultFormat("message")

.messages(Arrays.asList(userMsg))

.build();

}

public static void streamCallWithMessage(Generation gen, Message userMsg)

throws NoApiKeyException, ApiException, InputRequiredException {

GenerationParam param = buildGenerationParam(userMsg);

Flowable<GenerationResult> result = gen.streamCall(param);

result.blockingForEach(message -> handleGenerationResult(message));

}

public static void main(String[] args) {

try {

Generation gen = new Generation("http", "https://dashscope-intl.aliyuncs.com/api/v1");

Message userMsg = Message.builder().role(Role.USER.getValue()).content("Who are you?").build();

streamCallWithMessage(gen, userMsg);

} catch (ApiException | NoApiKeyException | InputRequiredException e) {

System.err.println("Terjadi kesalahan: " + e.getMessage());

}

}

}Respons

====================Proses berpikir====================

Hmm, pengguna mengajukan pertanyaan perkenalan diri yang sederhana. Ini pertanyaan umum, jadi saya perlu menyatakan identitas dan fungsi saya dengan jelas dan cepat. Saya akan menggunakan nada santai dan ramah untuk memperkenalkan diri sebagai DeepSeek-V3, yang dibuat oleh DeepSeek. Saya juga bisa menyebutkan jenis bantuan yang bisa saya berikan, seperti menjawab pertanyaan, mengobrol, dan memberi bimbingan. Terakhir, saya akan menambahkan emoji agar lebih mudah didekati. Saya harus menjaga agar tetap ringkas dan jelas.

====================Respons lengkap====================

Saya DeepSeek-V3, asisten cerdas yang dibuat oleh DeepSeek! Saya dapat membantu Anda menjawab berbagai pertanyaan, memberikan saran, mencari informasi, bahkan mengobrol dengan Anda! Jangan ragu untuk bertanya apa pun tentang studi, pekerjaan, atau kehidupan sehari-hari Anda. Bagaimana saya bisa membantu Anda?HTTP

Kode contoh

curl

curl -X POST "https://dashscope-intl.aliyuncs.com/api/v1/services/aigc/text-generation/generation" \

-H "Authorization: Bearer $DASHSCOPE_API_KEY" \

-H "Content-Type: application/json" \

-H "X-DashScope-SSE: enable" \

-d '{

"model": "deepseek-v3.2",

"input":{

"messages":[

{

"role": "user",

"content": "Who are you?"

}

]

},

"parameters":{

"enable_thinking": true,

"incremental_output": true,

"result_format": "message"

}

}'Fitur lainnya

Model | |||||

deepseek-v3.2 | |||||

deepseek-v3.2-exp | Hanya didukung dalam mode non-berpikir. | ||||

deepseek-v3.1 | Hanya didukung dalam mode non-berpikir. | ||||

deepseek-r1 | |||||

deepseek-r1-0528 | |||||

deepseek-v3 | |||||

Model hasil penyulingan |

Nilai parameter default

Model | suhu | top_p | repetition_penalty | presence_penalty | max_tokens | thinking_budget |

deepseek-v3.2 | 1,0 | 0,95 | - | - | 65.536 | 32.768 |

deepseek-v3.2-exp | 0,6 | 0,95 | 1,0 | - | 65.536 | 32.768 |

deepseek-v3.1 | 0,6 | 0,95 | 1,0 | - | 65.536 | 32.768 |

deepseek-r1 | 0,6 | 0,95 | - | 1 | 16.384 | 32.768 |

deepseek-r1-0528 | 0,6 | 0,95 | - | 1 | 16.384 | 32.768 |

Model hasil penyulingan | 0,6 | 0,95 | - | 1 | 16.384 | 16.384 |

deepseek-v3 | 0,7 | 0,6 | - | - | 16.384 | - |

Tanda hubung (-) menunjukkan parameter tidak memiliki nilai default dan tidak dapat diatur.

Model deepseek-r1, deepseek-r1-0528, dan model hasil penyulingan tidak mendukung parameter ini.

Untuk informasi lebih lanjut tentang definisi parameter, lihat OpenAI Chat.

Penagihan

Penagihan didasarkan pada jumlah token input dan output. Untuk detail harga, lihat Daftar model dan harga.

Dalam mode berpikir, token CoT ditagih sebagai token output.

FAQ

Apakah saya dapat mengunggah gambar atau dokumen untuk mengajukan pertanyaan?

Model DeepSeek hanya menerima input teks. Model ini tidak mendukung input gambar atau dokumen. Qwen-VL mendukung input gambar, dan Qwen-Long mendukung input dokumen.

Bagaimana cara melihat penggunaan token dan jumlah panggilan?

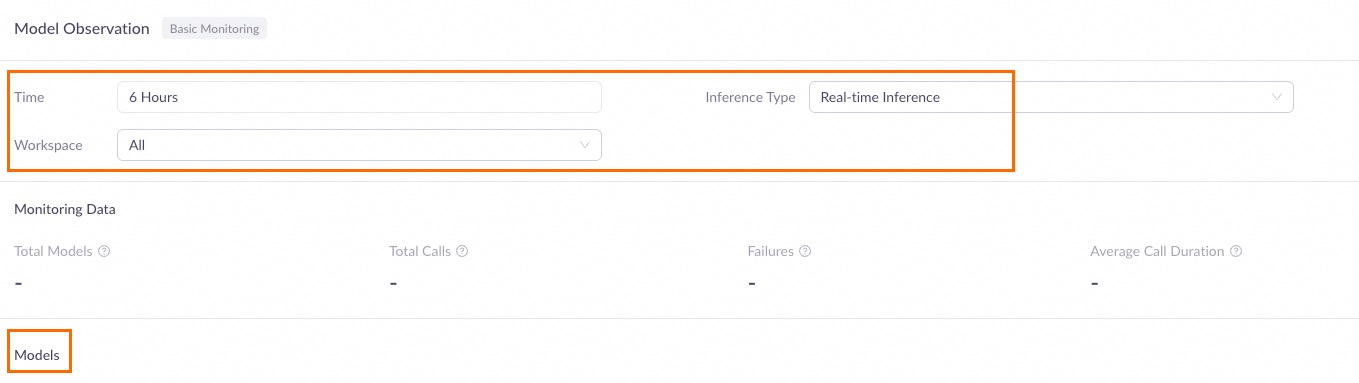

Satu jam setelah memanggil model, buka Pemantauan, atur filter (rentang waktu, ruang kerja), temukan model Anda di Models, lalu klik Monitor di Actions untuk melihat statistik. Untuk informasi lebih lanjut, lihat Pemantauan penggunaan dan kinerja.

Data diperbarui setiap jam. Selama jam sibuk, pembaruan mungkin tertunda hingga satu jam.

Kode kesalahan

Jika terjadi kesalahan, lihat Pesan kesalahan untuk troubleshooting.