Topik ini menggunakan contoh sederhana untuk menunjukkan cara membuat, menyebarkan, dan menjalankan pekerjaan Flink SQL. Anda akan mempelajari alur kerja dasar dalam mengembangkan pekerjaan Flink SQL.

Prasyarat

-

Jika Anda menggunakan pengguna Resource Access Management (RAM) atau peran RAM untuk mengakses Realtime Compute for Apache Flink, pastikan pengguna atau peran tersebut memiliki izin yang diperlukan. Untuk informasi selengkapnya, lihat Manajemen izin.

-

Ruang kerja Flink telah dibuat. Untuk informasi selengkapnya, lihat Aktifkan Realtime Compute for Apache Flink.

Langkah 1: Buat pekerjaan

-

Buka halaman pembuatan pekerjaan SQL.

-

Masuk ke Konsol Realtime Compute for Apache Flink.

-

Klik Console di kolom Actions untuk ruang kerja yang dituju.

-

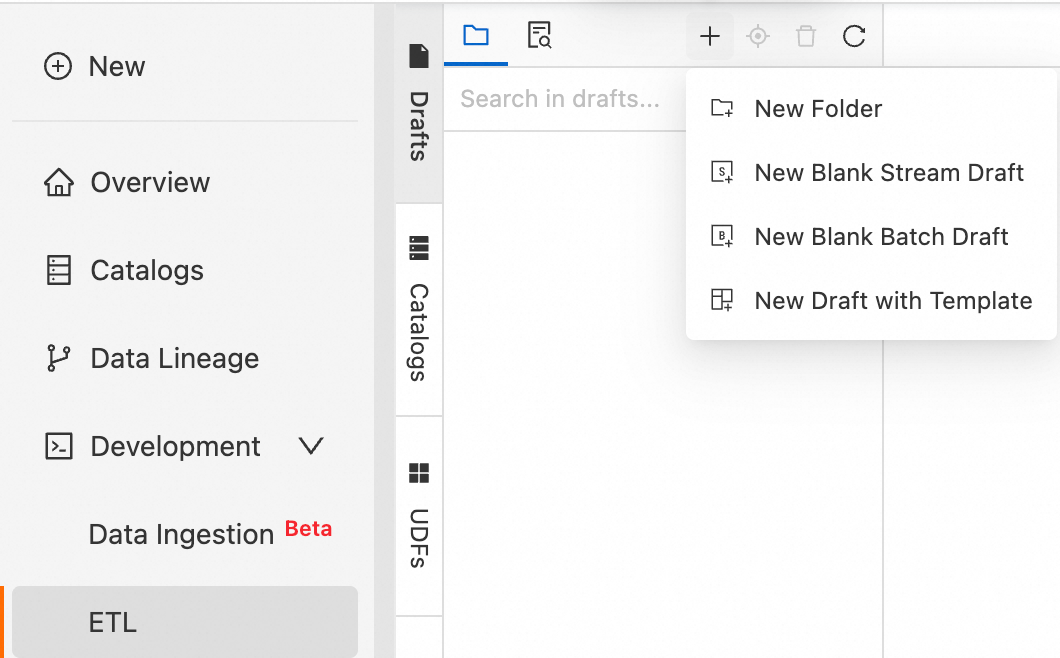

Di panel navigasi sebelah kiri, pilih .

-

-

Klik ikon

, lalu pilih New Stream Job. Masukkan File Name dan pilih Engine Version.

, lalu pilih New Stream Job. Masukkan File Name dan pilih Engine Version.Realtime Compute for Apache Flink menyediakan berbagai templat kode dan sinkronisasi data. Setiap templat mencakup skenario tertentu, contoh kode, dan petunjuk. Anda dapat menggunakan templat ini untuk mempelajari fitur dan sintaks Flink secara cepat guna menerapkan logika bisnis Anda. Untuk informasi selengkapnya, lihat Templat Kode dan Templat sinkronisasi data.

Parameter pekerjaan

Deskripsi

Contoh

File Name

Nama pekerjaan.

CatatanNama pekerjaan harus unik dalam proyek saat ini.

flink-test

Engine Version

Versi mesin Flink untuk pekerjaan saat ini.

Gunakan versi yang memiliki tag Recommended atau Stable. Versi-versi ini menawarkan keandalan dan performa yang lebih tinggi. Untuk informasi selengkapnya tentang versi mesin, lihat Catatan rilis dan Versi mesin.

vvr-8.0.8-flink-1.17

-

Klik Create.

Langkah 2: Tulis pekerjaan SQL dan lihat informasi konfigurasi

-

Tulis pekerjaan SQL.

Salin kode SQL berikut ke editor SQL. Contoh ini menggunakan konektor Datagen untuk menghasilkan aliran data acak dan konektor Print untuk mencetak hasil ke konsol pengembangan. Untuk informasi selengkapnya tentang konektor yang didukung, lihat Konektor yang didukung.

-- Buat tabel sumber sementara bernama datagen_source. CREATE TEMPORARY TABLE datagen_source( randstr VARCHAR ) WITH ( 'connector' = 'datagen' -- Konektor Datagen ); -- Buat tabel sink sementara bernama print_table. CREATE TEMPORARY TABLE print_table( randstr VARCHAR ) WITH ( 'connector' = 'print', -- Konektor Print 'logger' = 'true' -- Tampilkan hasil di konsol. ); -- Potong field randstr dan cetak hasilnya. INSERT INTO print_table SELECT SUBSTRING(randstr,0,8) from datagen_source;Catatan-

Contoh SQL ini menunjukkan cara menggunakan

INSERT INTOuntuk menulis data ke satu sink. Anda juga dapat menggunakanINSERT INTOuntuk menulis data ke beberapa sink. Untuk informasi selengkapnya, lihat Pernyataan INSERT INTO. -

Untuk pekerjaan produksi, minimalkan penggunaan tabel sementara. Sebagai gantinya, gunakan tabel yang telah terdaftar di Data Management. Untuk informasi selengkapnya, lihat Data Management.

-

-

Lihat informasi konfigurasi.

Di tab-tab di sebelah kanan editor SQL, Anda dapat melihat atau mengunggah konfigurasi.

Nama tab

Deskripsi

More Configurations

-

Engine Version: Untuk informasi selengkapnya tentang versi mesin, lihat Versi mesin dan Kebijakan siklus hidup. Kami menyarankan Anda menggunakan versi yang direkomendasikan atau stabil. Berikut penjelasan tag pada versi mesin:

-

Recommend: versi minor terbaru dari versi utama terbaru.

-

Stable: versi minor terbaru dari versi utama yang masih dalam layanan. Bug pada versi sebelumnya telah diperbaiki.

-

Normal: versi minor lainnya yang masih dalam layanan.

-

Deprecated: versi yang sudah tidak dalam layanan.

-

-

Additional Dependencies: dependensi tambahan untuk pekerjaan, seperti fungsi sementara.

-

Otentikasi Kerberos: Aktifkan otentikasi Kerberos. Konfigurasikan kluster Kerberos terdaftar dan informasi principal. Jika Anda belum mendaftarkan kluster Kerberos, lihat Daftarkan kluster Hive Kerberos.

Code Structure

-

Data Flow: Lihat alur data.

-

Tree Structure: Lihat sumber data dalam struktur pohon.

Version Information

Anda dapat melihat informasi versi pekerjaan di sini. Untuk informasi selengkapnya tentang fungsi di kolom Actions, lihat Kelola versi pekerjaan.

-

Langkah 3 (Opsional): Lakukan pemeriksaan mendalam dan debug pekerjaan

-

Lakukan pemeriksaan mendalam pada pekerjaan.

Pemeriksaan mendalam memverifikasi semantik SQL pekerjaan, konektivitas jaringan, dan metadata tabel yang digunakan oleh pekerjaan. Anda juga dapat mengklik SQL Optimization di area hasil untuk melihat peringatan risiko SQL dan saran optimasi.

-

Di pojok kanan atas editor SQL, klik Deep Check.

-

Di kotak dialog Deep Check, klik Confirm.

CatatanGalat timeout dapat terjadi selama pemeriksaan mendalam pekerjaan. Pesan galat berikut dikembalikan:

The RPC times out maybe because the SQL parsing is too complicated. Please consider enlarging the `flink.sqlserver.rpc.execution.timeout` option in flink-configuration, which by default is `120 s`.

Solusi: Tambahkan konfigurasi parameter berikut di bagian atas halaman pengeditan pekerjaan.

SET 'flink.sqlserver.rpc.execution.timeout' = '600s'; -

-

Debug pekerjaan.

Anda dapat menggunakan fitur debugging untuk mensimulasikan eksekusi pekerjaan, memeriksa output, dan memverifikasi logika pernyataan SELECT atau INSERT Anda. Hal ini meningkatkan efisiensi pengembangan dan mengurangi risiko kualitas data.

CatatanFitur debugging tidak menulis data ke tabel sink hilir.

-

Di pojok kanan atas editor SQL, klik Debug.

-

Di kotak dialog Debug, pilih kluster debug dan klik Next.

Jika tidak tersedia kluster, Anda harus membuat session cluster. Session cluster harus menggunakan versi mesin yang sama dengan pekerjaan SQL dan berada dalam status Running. Untuk informasi selengkapnya, lihat Langkah 1: Buat session cluster.

-

Konfigurasikan data debugging dan klik OK.

Untuk informasi selengkapnya tentang konfigurasi, lihat Langkah 2: Debug pekerjaan.

-

Langkah 4: Sebarkan pekerjaan

Di pojok kanan atas editor SQL, klik Deploy. Di kotak dialog Deploy New Version, konfigurasikan parameter sesuai kebutuhan dan klik OK.

Saat menyebarkan pekerjaan, Anda dapat mengatur Deployment Target menjadi Resource Queue atau Session Cluster. Rincian setiap opsi adalah sebagai berikut:

|

Deployment Target |

Lingkungan yang Sesuai |

Fitur Inti |

|

Resource Queue |

Lingkungan produksi |

|

|

Session Cluster |

Lingkungan pengembangan dan pengujian |

Penting

Anda tidak dapat melihat log pekerjaan yang berjalan di session cluster. |

Langkah 5: Jalankan pekerjaan dan lihat hasilnya

-

Di panel navigasi sebelah kiri, pilih .

-

Untuk pekerjaan yang dituju, klik Start di kolom Actions.

Pilih Stateless Start dan klik Start. Pekerjaan berjalan sebagaimana mestinya ketika statusnya berubah menjadi Running. Untuk informasi selengkapnya tentang parameter startup pekerjaan, lihat Jalankan pekerjaan.

-

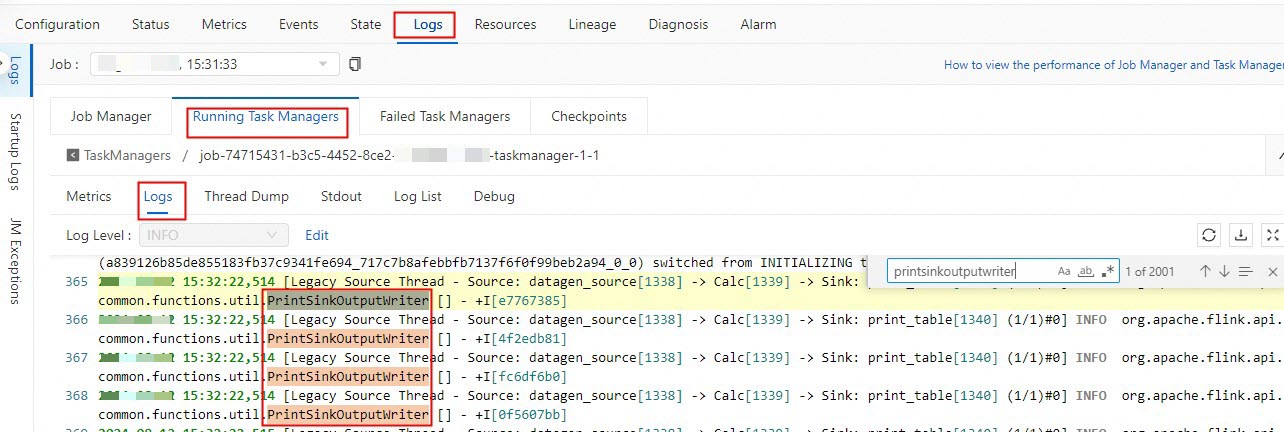

Di halaman detail Job O&M, Anda dapat melihat hasil komputasi Flink.

-

Buka halaman dan klik pekerjaan yang dituju.

-

Di tab Job Logs, klik tab Running Task Managers, lalu klik tugas di kolom Path, ID.

-

Klik Logs dan cari log terkait PrintSinkOutputWriter.

-

Langkah 6 (Opsional): Hentikan pekerjaan

Jika Anda mengubah pekerjaan dan ingin perubahan tersebut berlaku, Anda harus menyebarkan ulang pekerjaan, lalu menghentikan dan menjalankannya kembali. Contoh perubahan termasuk mengubah kode, menambah atau menghapus parameter WITH, atau mengganti versi pekerjaan. Anda juga perlu menghentikan dan menjalankan ulang pekerjaan jika pekerjaan tidak dapat menggunakan kembali state, jika Anda ingin menjalankan pekerjaan baru, atau jika Anda memperbarui parameter yang tidak berlaku secara dinamis. Untuk informasi selengkapnya tentang cara menghentikan pekerjaan, lihat Hentikan pekerjaan.

-

Di halaman , klik Stop di kolom Actions untuk pekerjaan yang dituju.

-

Klik OK.

Referensi

-

FAQ pengembangan dan O&M pekerjaan

-

Konfigurasi informasi pekerjaan

-

Anda dapat mengonfigurasi sumber daya pekerjaan sebelum menjalankannya atau mengubah sumber daya pekerjaan setelah pekerjaan online. Anda dapat menggunakan mode dasar (coarse-grained) atau mode ahli (fine-grained) untuk mengalokasikan sumber daya. Untuk informasi selengkapnya, lihat Konfigurasi sumber daya pekerjaan.

-

Anda dapat mengonfigurasi tingkat log untuk pekerjaan dan mengatur output untuk log dengan tingkat berbeda. Untuk informasi selengkapnya, lihat Konfigurasi output log pekerjaan.

-

-

Alur kerja pengembangan untuk jenis pekerjaan lainnya

-

Praktik terbaik Flink