Pemrosesan berbantuan AI mengintegrasikan inferensi model bahasa besar (LLM) langsung ke dalam pipeline Integrasi Data DataWorks. Alih-alih memindahkan data apa adanya, pipeline tersebut memanggil model AI secara real-time untuk menganalisis, memperkaya, atau mentransformasi setiap record saat berpindah dari sumber ke tujuan—mengungkap nilai dari teks tidak terstruktur tanpa perlu menulis kode pemanggilan AI.

Fitur ini dirancang untuk pengguna perusahaan yang memerlukan analisis dan pemrosesan tingkat lanjut pada data selama proses sinkronisasi. Fitur ini sangat berguna bagi organisasi yang ingin memanfaatkan AI guna meningkatkan kualitas data dan mengekstraksi nilai darinya.

Tugas NLP yang didukung

| Task | Apa yang dilakukan |

|---|---|

| Sentiment analysis | Mengklasifikasikan sentimen teks |

| Summary generation | Merangkum dokumen panjang menjadi poin-poin utama |

| Keyword extraction | Mengekstraksi istilah dan frasa yang paling relevan |

| Text translation | Mengonversi teks dari satu bahasa ke bahasa lain |

Kasus penggunaan

| Industri | Bagaimana pemrosesan AI membantu |

|---|---|

| Layanan pelanggan / E-dagang | Menganalisis sentimen dalam komentar pengguna dan tiket dukungan; mengekstraksi isu inti dan poin umpan balik utama |

| Kepatuhan / Hukum / Penelitian ilmiah | Menghasilkan ringkasan dan mengekstraksi informasi penting dari dokumen kebijakan, kontrak hukum, dan makalah penelitian selama proses sinkronisasi |

| Manufaktur / Rantai pasok / Kesehatan | Menganalisis log perangkat, umpan balik rantai pasok, dan catatan dokter-pasien untuk mengidentifikasi peringatan ancaman dan indikator kualitas layanan |

| Kolaborasi lintas bahasa | Menerjemahkan komentar media sosial, artikel berita, atau dokumen bisnis ke dalam satu bahasa untuk analisis terpusat |

Prasyarat

Sebelum memulai, pastikan Anda telah:

-

Ruang kerja yang menggunakan Data Studio (versi baru)

-

Layanan model besar yang dikonfigurasi dari salah satu penyedia yang didukung:

-

Alibaba Cloud DataWorks model service — Deploy model dan mulai layanan model di Model Service Management

-

Alibaba Cloud Model Studio — Aktifkan Alibaba Cloud Model Studio dan dapatkan Kunci API

-

PAI Model Gallery — Aktifkan Platform for AI (PAI) dan dapatkan token untuk layanan model

-

-

Informasi sumber data yang dikonfigurasi secara manual atau sebagai sumber data yang sudah ada untuk tugas sinkronisasi offline

-

kelompok sumber daya yang disambungkan ke ruang kerja dengan konektivitas ke sumber data

Penagihan

Selain biaya langganan DataWorks dan biaya kelompok sumber daya, pemrosesan berbantuan AI akan dikenakan biaya inferensi model.

Contoh: menerjemahkan umpan balik pelanggan selama sinkronisasi Hologres-ke-Hologres

Contoh ini menjelaskan langkah-langkah mengonfigurasi pemrosesan berbantuan AI dalam tugas sinkronisasi offline yang menyalin data dari satu tabel Hologres ke tabel lainnya. Tugas ini menerjemahkan setiap nilai pada kolom feedback_info ke dalam bahasa Inggris dan menuliskan hasilnya ke tabel tujuan.

Apa yang dilakukan pemrosesan AI dalam contoh ini:

| Source field | Processing description | Output field |

|---|---|---|

feedback_info |

Translate '#{feedback_info}' into English |

feedback_processed |

Langkah 2: Buat tugas sinkronisasi offline

-

Buka halaman Workspaces di Konsol DataWorks. Di bilah navigasi atas, pilih Wilayah. Temukan ruang kerja target dan pilih Shortcuts > Data Studio di kolom Actions.

-

Di panel navigasi kiri, klik

untuk membuka Data Studio. Di sebelah kanan Workspace Directories, klik

untuk membuka Data Studio. Di sebelah kanan Workspace Directories, klik  dan pilih Create Node > Data Integration > Batch Synchronization. Kotak dialog New Node akan muncul.

dan pilih Create Node > Data Integration > Batch Synchronization. Kotak dialog New Node akan muncul. -

Atur Path, Data Source and Destination, dan Name untuk node tersebut, lalu klik OK.

Langkah 3: Konfigurasi tugas sinkronisasi

Setelah node dibuat, halaman konfigurasi tugas akan terbuka. Konfigurasikan setiap bagian secara berurutan.

Data source

-

Type — Diatur saat pembuatan node dan tidak dapat diubah. Untuk menggunakan jenis sumber data yang berbeda, buat node baru.

-

Data Source — Pilih sumber data yang sudah ada dari daftar drop-down, atau klik Add Data Source untuk membuat yang baru.

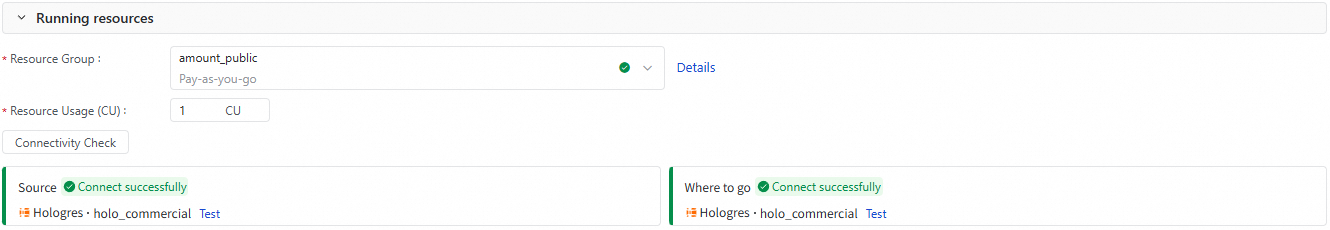

Runtime resource

-

Pilih Resource Group untuk tugas sinkronisasi. Untuk kelompok sumber daya arsitektur tanpa server, tentukan jumlah CU di bidang Resource Usage(CU).

-

Setelah memilih kelompok sumber daya, Integrasi Data akan secara otomatis memeriksa konektivitas ke sumber dan tujuan. Klik Connectivity Check untuk menjalankan pemeriksaan secara manual.

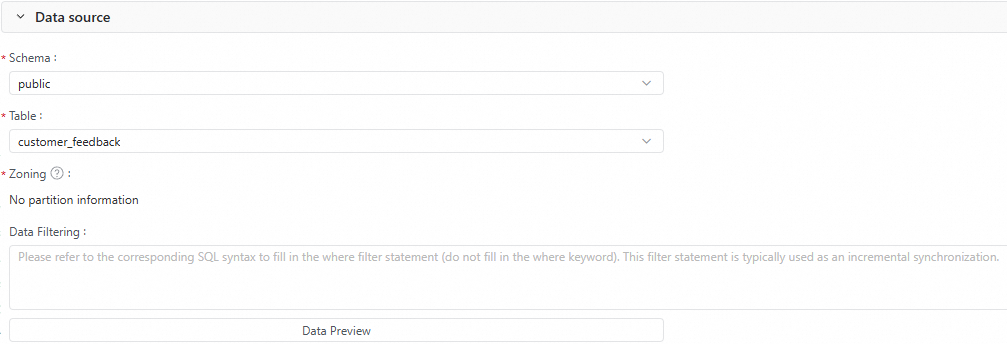

Source

Konfigurasikan pengaturan tabel sumber: Schema, Table, Partition, dan kondisi Data Filtering. Klik Data Preview untuk melihat pratinjau record yang akan disinkronkan.

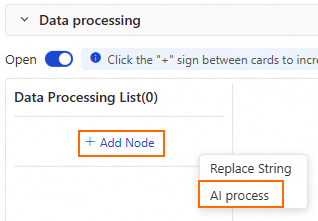

Data processing

-

Di bagian pemrosesan data, aktifkan toggle Enable untuk mengaktifkan pemrosesan data. Ini memerlukan sumber daya komputasi tambahan.

-

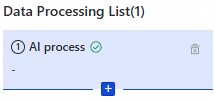

Klik Add Node dan pilih AI Process.

-

Konfigurasikan node AI Process. Parameter utamanya adalah:

Parameter Description Model Provider Pilih penyedia: DataWorks Model Service, Aliyun Bailian, atau PAI Model Gallery Model Endpoint Berlaku ketika Model Provider adalah PAI Model Gallery. Masukkan titik akhir pemanggilan model. Untuk mendapatkan titik akhir tersebut, lihat Test service invocation Model Name Model yang digunakan untuk pemrosesan data cerdas. Pilih salah satu dari daftar API Key Kredensial untuk mengakses model. Untuk Alibaba Cloud Model Studio, lihat Obtain a Model Studio API key. Untuk PAI Model Gallery, buka tugas EAS yang telah dideploy, mulai online debugging, dan gunakan token akses sebagai Kunci API Processing Description Instruksi dalam bahasa alami yang menjelaskan cara memproses field sumber. Referensikan nama field menggunakan format #{column_name}. Untuk contoh ini, masukkanTranslate '#{feedback_info}' into EnglishOutput Field Field tempat hasil pemrosesan disimpan. Jika field belum ada, field tersebut akan dibuat secara otomatis. Untuk contoh ini, masukkan feedback_processed -

Klik Data Output Preview di pojok kanan atas bagian pemrosesan data untuk melihat pratinjau output yang telah diproses.

-

(Opsional) Tambahkan lebih banyak node pemrosesan. Beberapa node pemrosesan data dieksekusi secara berurutan.

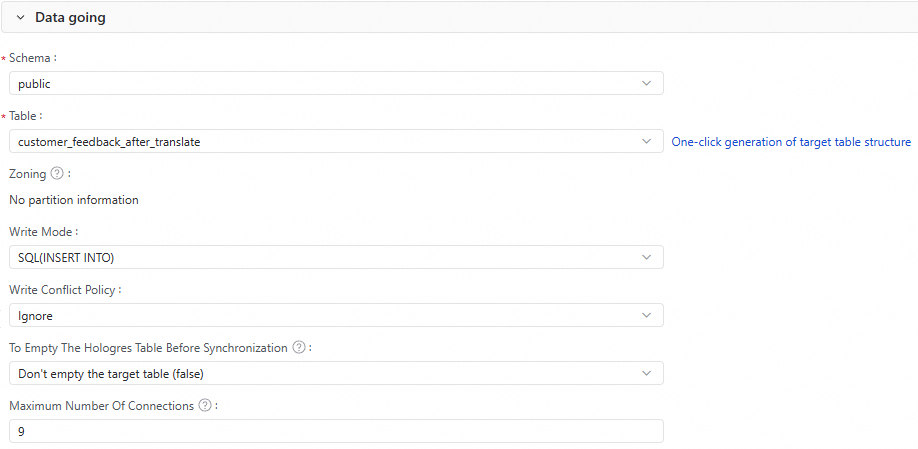

Destination

-

Konfigurasikan tabel tujuan: Schema, Table, dan Partition.

-

Klik Generate Target Table Schema untuk menghasilkan skema secara otomatis.

-

Pilih tabel yang sudah ada jika tersedia.

-

-

Atur Write Mode dan Write Conflict Strategy.

-

Konfigurasikan apakah akan menghapus data yang sudah ada di tabel Hologres sebelum sinkronisasi.

-

(Opsional) Atur Maximum Connections.

Maximum Connections hanya berlaku ketika Write Mode adalah

SQL(INSERT INTO). Satu tugas dapat menggunakan hingga sembilan koneksi. Pastikan instans Hologres memiliki cukup koneksi idle sebelum memulai tugas.

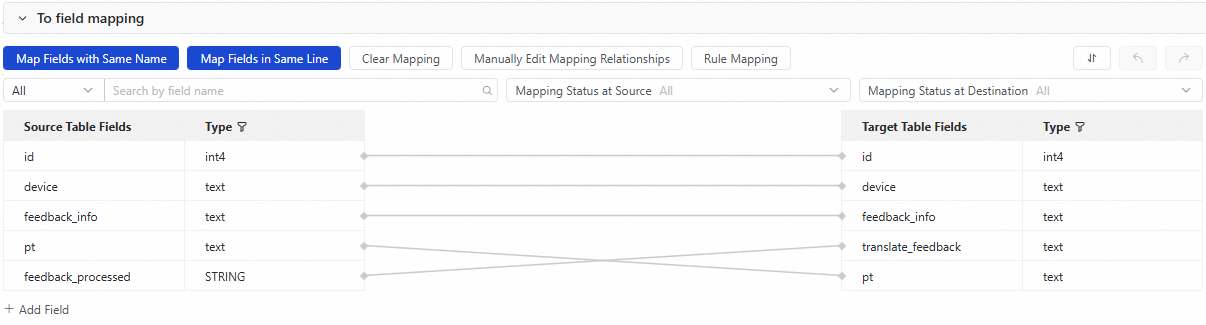

Destination field mapping

Setelah mengonfigurasi sumber, pemrosesan data, dan tujuan, pemetaan field antara tabel sumber dan tujuan akan ditampilkan. Field dipetakan berdasarkan nama dan posisi secara default.

Untuk contoh ini, selain pemetaan default untuk id, device, feedback_info, dan pt, petakan secara manual feedback_processed (field output AI dari sumber) ke translate_feedback di tabel tujuan.

Langkah 4: Uji tugas

-

Di panel kanan, klik Run Configuration. Atur Resource Group dan parameter Script Parameters untuk pengujian ini.

-

Di bilah alat, klik Save lalu Run. Setelah tugas selesai, verifikasi bahwa hasilnya berhasil dan periksa tabel tujuan untuk memastikan data sudah benar.

Langkah 5: Konfigurasi penjadwalan

Untuk menjalankan tugas sinkronisasi sesuai jadwal, atur Scheduling Policies di bagian Scheduling di sisi kanan halaman dan konfigurasikan properti penjadwalan node.

Langkah 6: Publikasikan node

Klik ikon Publish di bilah alat untuk memulai alur publikasi. Ini akan mempublikasikan tugas ke lingkungan produksi. Penjadwalan periodik hanya berlaku setelah node dipublikasikan.

Langkah selanjutnya

Setelah node dipublikasikan, Anda dapat melakukan pengisian ulang data historis atau memantau dan mengelola tugas di Operation Center.

-

Backfill Data — Melakukan pengisian ulang data untuk node saat ini. Untuk alur kerja pengisian ulang yang lebih canggih, gunakan Operation Center. Lihat Run a data backfill task and view the data backfill instance (New).

-

Perform O&M — Setelah dipublikasikan, tugas akan dikelola secara otomatis oleh Operation Center. Lihat status berjalan atau picu eksekusi secara manual. Lihat Operation Center.