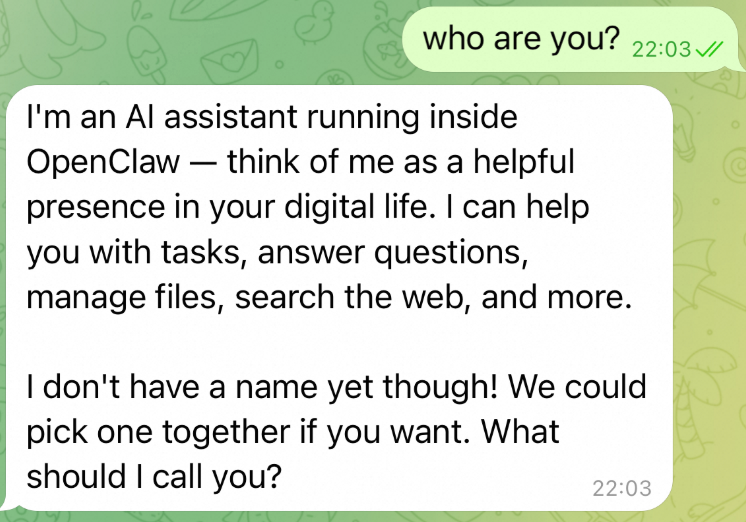

在OpenClaw接入阿里云 Coding Plan。OpenClaw (原名Moltbot/Clawdbot )是一个开源的个人 AI 助手平台,支持通过多种消息渠道与 AI 交互。

安装 OpenClaw

手动安装

安装或更新 Node.js

检查当前版本:在终端运行以下命令查看:

Node.js的版本(需 v22.0 或更高版本)。如果提示“找不到命令”,说明未安装;如果显示版本号低于 v22.0,说明需要更新。进入终端的方法: Mac 系统按 Command + Space(空格) → 输入 Terminal 或 终端 → 回车,Windows系统按 Win 键 → 输入 终端/PowerShell/cmd → 回车。

node -v下载并安装:访问Node.js,在页面中选择“LTS” 且

版本号 >= 22.x.x,并根据系统下载安装包。下载完安装即可。例如:Windows 系统找到并下载 Windows Installer(.msi),Mac 系统找到并下载 macOS Installer(.pkg)。

执行以下命令开始安装OpenCLaw。

macOS/Linux:

按键盘上的 Command + Space(空格)组合键, 输入终端并回车,打开终端后运行以下命令:

curl -fsSL https://openclaw.ai/install.sh | bashWindows:

在任务栏搜索框里输入

PowerShell,选择以管理员身份运行,在PowerShell中运行以下命令:iwr -useb https://openclaw.ai/install.ps1 | iex

安装结束后会自动出现提示信息,请根据提示信息完成 OpenClaw 配置,参考配置如下:

配置项

配置内容

I understand this is powerful and inherently risky. Continue?

选择 ”Yes”

Onboarding mode

选择 “QuickStart”

Model/auth provider

选择 “Skip for now”,后续可以配置

Filter models by provider

选择 “All providers”

Default model

使用默认配置

Select channel (QuickStart)

选择 “Skip for now”,后续可以配置

Configure skills now? (recommended)

选择 “No”,后续可以配置。

Enable hooks?

按空格键选中 “Skip for now”,按回车键进入下一步。

How do you want to hatch your bot?

选择 “Hatch in TUI”。

Qwen Code 引导安装

OpenClaw 安装依赖于 Node.js 环境,手动安装可能会遇到环境配置问题。您可以使用 Qwen Code 来完成安装和验证。

安装并配置Qwen Code。

在终端输入以下命令启动 Qwen Code。

qwen在 Qwen Code 对话框中输入以下指令。

macOS/Linux:

请帮我安装 OpenClaw,依次执行以下命令完成安装和初始配置: 1. 前置条件:需要先安装 Node.js(v22.0 或更高版本),可通过 node --version 检查是否已安装。版本较低时需升级或安装更高版本,注意不能卸载已有的Node.js。 2. curl -fsSL https://openclaw.ai/install.sh | bash -s -- --no-onboard 3. openclaw gateway install 4. openclaw onboard --non-interactive --accept-risk --flow quickstart --auth-choice skip --skip-channels --skip-skills 5. 通过执行openclaw status,确保OpenClaw状态正常Windows:

请帮我在 Windows 上安装 OpenClaw,按以下步骤依次执行: ## 执行说明 所有 PowerShell 命令请使用以下格式执行: ``` powershell -ExecutionPolicy Bypass -Command "<命令>" ``` ### 注意事项: 1. 多行内容请使用 `write_file` 工具创建文件,避免 here-string 语法 2. 环境变量修改后,需要显式刷新 `$env:Path` 才能在同一会话中使用 3. 涉及网络下载的命令请设置较长 timeout(≥120000ms) --- ## 步骤 1:检测前置环境 检查以下工具是否已安装,并输出版本号: - `node --version`(需要 v22 或更高) - `npm --version` - `git --version` 如果全部已安装且 Node.js 版本 ≥ 22,直接跳到步骤 4。 --- ## 步骤 2:安装 Node.js(如未安装或版本低于 22) 1. 检测系统架构(x64 / x86 / ARM64) 2. 从官方源下载 Node.js zip 包并解压: ``` powershell -ExecutionPolicy Bypass -Command "$ProgressPreference = 'SilentlyContinue'; Invoke-WebRequest -Uri 'https://nodejs.org/dist/v24.0.0/node-v24.0.0-win-x64.zip' -OutFile \"$env:TEMP\node24.zip\"; Expand-Archive \"$env:TEMP\node24.zip\" -DestinationPath \"$env:LOCALAPPDATA\nodejs-v24\" -Force; Remove-Item \"$env:TEMP\node24.zip\"" ``` 3. 添加到系统 PATH(永久生效,新终端可直接使用): ``` powershell -ExecutionPolicy Bypass -Command "$nodePath = \"$env:LOCALAPPDATA\nodejs-v24\node-v24.0.0-win-x64\"; $machinePath = [Environment]::GetEnvironmentVariable('PATH', 'Machine'); [Environment]::SetEnvironmentVariable('PATH', \"$nodePath;$machinePath\", 'Machine'); $env:Path = \"$nodePath;$env:Path\"; node --version; npm --version" ``` --- ## 步骤 3:安装 Git(如未安装) 1. 从官方源下载 Git 安装包并静默安装: ``` powershell -ExecutionPolicy Bypass -Command "$ProgressPreference = 'SilentlyContinue'; Invoke-WebRequest -Uri 'https://github.com/git-for-windows/git/releases/download/v2.53.0.windows.2/Git-2.53.0.2-64-bit.exe' -OutFile \"$env:TEMP\Git-Installer.exe\"; Start-Process -FilePath \"$env:TEMP\Git-Installer.exe\" -ArgumentList '/VERYSILENT','/NORESTART','/NOCANCEL','/SP-','/CLOSEAPPLICATIONS','/RESTARTAPPLICATIONS','/COMPONENTS=icons,ext\reg\shellhere,assoc,assoc_sh' -Wait; Remove-Item \"$env:TEMP\Git-Installer.exe\"" ``` 2. 刷新 PATH 并验证安装: ``` powershell -ExecutionPolicy Bypass -Command "$machinePath = [Environment]::GetEnvironmentVariable('PATH', 'Machine'); $env:Path = \"$machinePath;$env:Path\"; git --version" ``` --- ## 步骤 4:安装 OpenClaw 刷新 PATH 并全局安装: ``` powershell -ExecutionPolicy Bypass -Command "$machinePath = [Environment]::GetEnvironmentVariable('PATH', 'Machine'); $userPath = [Environment]::GetEnvironmentVariable('PATH', 'User'); $env:Path = \"$machinePath;$userPath;$env:Path\"; npm install -g openclaw@latest" ``` --- ## 步骤 5:验证安装 ``` powershell -ExecutionPolicy Bypass -Command "$machinePath = [Environment]::GetEnvironmentVariable('PATH', 'Machine'); $userPath = [Environment]::GetEnvironmentVariable('PATH', 'User'); $env:Path = \"$machinePath;$userPath;$env:Path\"; openclaw --version" ``` --- ## 步骤 6:安装 Gateway ``` openclaw gateway install ``` --- ## 步骤 7:自动完成初始配置 使用 `write_file` 工具创建配置文件,自动完成所有配置项(QuickStart 模式): 配置文件路径:`%USERPROFILE%\.openclaw\config.yaml` 配置文件内容: ```yaml # OpenClaw Configuration - QuickStart mode workspace: name: default directory: . gateway: mode: local auth: token: openclaw-quickstart-token session: scope: personal dmScope: per-channel channels: - type: tui enabled: true skills: enabled: false hooks: enabled: false security: acknowledged: true mode: personal ui: hatch: tui ``` 创建配置文件后执行: ``` powershell -ExecutionPolicy Bypass -Command "[Environment]::SetEnvironmentVariable('OPENCLAW_GATEWAY_TOKEN', 'openclaw-quickstart-token', 'User')" ``` --- ## 步骤 8:启动并使用 ``` # 启动 TUI 界面 openclaw tui # 或查看状态 openclaw status # 查看 Dashboard(浏览器访问) # http://127.0.0.1:18789/ ```

授权允许 Qwen Code 执行命令,直至完成安装。

输入

/exit退出Qwen Code。/exit

在 OpenClaw 中配置 Coding Plan

如果OpenClaw部署在轻量应用服务器,请参考方式二通过图形化界面配置。

如果OpenClaw部署在您本地或云服务器ECS,建议参考方式一通过AI Agent(如Qwen Code)引导完成配置。如果熟悉OpenClaw配置,也可以采用方式三直接修改配置文件。

方式一:通过 Qwen Code 引导配置

安装并配置Qwen Code。

在终端输入以下命令启动 Qwen Code。

qwen在 Qwen Code 对话框中输入以下指令。

请帮我配置 OpenClaw 接入 Coding Plan,按以下步骤操作: ## 第一步:获取 API Key 请先询问用户:"请提供您的 Coding Plan API Key" 等待用户回复 API Key 后再继续下一步。 ## 第二步:修改配置文件 1. 打开配置文件:~/.openclaw/openclaw.json - 如果文件不存在,请先创建该文件 - 重要:必须使用 .json 格式,不要使用其他格式 2. 找到或创建以下字段,合并配置(保留原有配置不变,若字段不存在则新增): - 使用 "mode": "merge" 确保不会覆盖已有配置 - 将 YOUR_API_KEY 替换为用户提供的实际 API Key { "models": { "mode": "merge", "providers": { "bailian": { "baseUrl": "https://coding-intl.dashscope.aliyuncs.com/v1", "apiKey": "YOUR_API_KEY", "api": "openai-completions", "models": [ { "id": "qwen3.5-plus", "name": "qwen3.5-plus", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536, "compat": { "thinkingFormat": "qwen" } }, { "id": "qwen3-max-2026-01-23", "name": "qwen3-max-2026-01-23", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536, "compat": { "thinkingFormat": "qwen" } }, { "id": "qwen3-coder-next", "name": "qwen3-coder-next", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536 }, { "id": "qwen3-coder-plus", "name": "qwen3-coder-plus", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "MiniMax-M2.5", "name": "MiniMax-M2.5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 196608, "maxTokens": 32768 }, { "id": "glm-5", "name": "glm-5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384, "compat": { "thinkingFormat": "qwen" } }, { "id": "glm-4.7", "name": "glm-4.7", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384, "compat": { "thinkingFormat": "qwen" } }, { "id": "kimi-k2.5", "name": "kimi-k2.5", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 32768, "compat": { "thinkingFormat": "qwen" } } ] } } }, "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" }, "models": { "bailian/qwen3.5-plus": {}, "bailian/qwen3-max-2026-01-23": {}, "bailian/qwen3-coder-next": {}, "bailian/qwen3-coder-plus": {}, "bailian/MiniMax-M2.5": {}, "bailian/glm-5": {}, "bailian/glm-4.7": {}, "bailian/kimi-k2.5": {} } } }, "gateway": { "mode": "local" } } 3. 保存文件 ## 第三步:重启并验证 1. 运行 `openclaw gateway restart` 重启网关使配置生效 2. 运行 `openclaw models list` 验证配置是否成功 - 检查输出中是否包含 `bailian/` 开头的模型 - 检查每个模型是否有 `configured` 标签 - 如果有错误,请根据错误信息修复授权允许 Qwen Code 执行命令,直至完成配置。

配置完成后,Qwen Code 会输出

openclaw models list的结果。若bailian/qwen3.5-plus等模型都标记为 configured 表示配置成功。

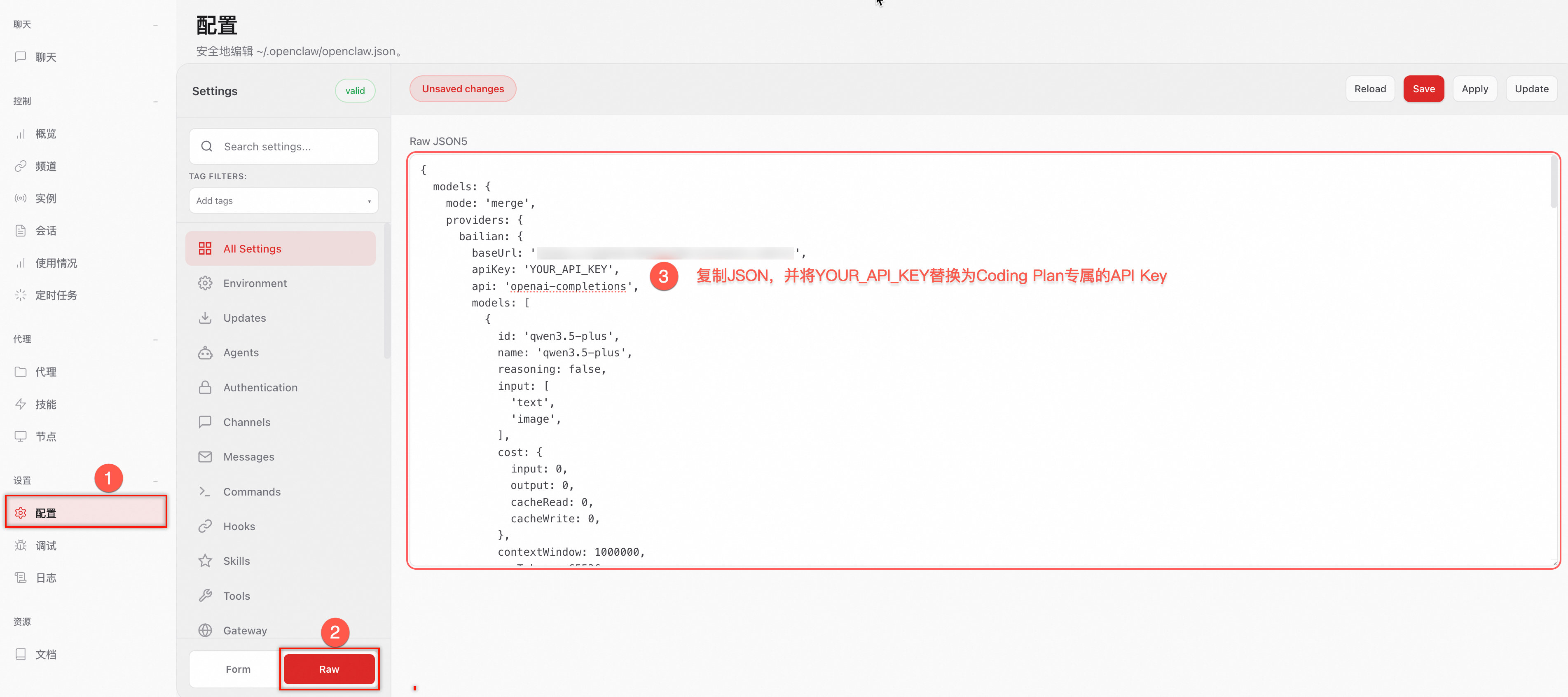

方式二:通过图形化界面配置

如果使用轻量应用服务器部署方案部署的 OpenClaw,可以通过其产品的图形化界面配置 Coding Plan。详情请参考轻量服务器配置方式。

方式三:直接修改配置文件

通过终端修改配置文件

在终端执行以下命令打开配置文件。

nano ~/.openclaw/openclaw.json首次配置:复制以下内容到配置文件。将

YOUR_API_KEY替换为Coding Plan 专属 API Key。已有配置:若需保留已有配置,请勿直接全量替换,详见已有配置如何安全修改?

{ "models": { "mode": "merge", "providers": { "bailian": { "baseUrl": "https://coding-intl.dashscope.aliyuncs.com/v1", "apiKey": "YOUR_API_KEY", "api": "openai-completions", "models": [ { "id": "qwen3.5-plus", "name": "qwen3.5-plus", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536, "compat": { "thinkingFormat": "qwen" } }, { "id": "qwen3-max-2026-01-23", "name": "qwen3-max-2026-01-23", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536, "compat": { "thinkingFormat": "qwen" } }, { "id": "qwen3-coder-next", "name": "qwen3-coder-next", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536 }, { "id": "qwen3-coder-plus", "name": "qwen3-coder-plus", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "MiniMax-M2.5", "name": "MiniMax-M2.5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 196608, "maxTokens": 32768 }, { "id": "glm-5", "name": "glm-5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384, "compat": { "thinkingFormat": "qwen" } }, { "id": "glm-4.7", "name": "glm-4.7", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384, "compat": { "thinkingFormat": "qwen" } }, { "id": "kimi-k2.5", "name": "kimi-k2.5", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 32768, "compat": { "thinkingFormat": "qwen" } } ] } } }, "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" }, "models": { "bailian/qwen3.5-plus": {}, "bailian/qwen3-max-2026-01-23": {}, "bailian/qwen3-coder-next": {}, "bailian/qwen3-coder-plus": {}, "bailian/MiniMax-M2.5": {}, "bailian/glm-5": {}, "bailian/glm-4.7": {}, "bailian/kimi-k2.5": {} } } }, "gateway": { "mode": "local" } }保存文件并退出,运行以下命令来使配置生效。

openclaw gateway restart

通过网页浏览器修改配置文件

在终端执行以下命令,浏览器将自动打开 OpenClaw 的操作界面(地址通常为

http://127.0.0.1/:xxxx),您可以在该页面进行对话和配置。openclaw dashboard在左侧菜单栏中选择(或)。

首次配置:复制以下内容到Raw JSON5输入框,替换已有内容。

已有配置:若需保留已有配置,请勿直接全量替换,详见已有配置如何安全修改?

将

YOUR_API_KEY替换为Coding Plan 专属 API Key。

{ "models": { "mode": "merge", "providers": { "bailian": { "baseUrl": "https://coding-intl.dashscope.aliyuncs.com/v1", "apiKey": "YOUR_API_KEY", "api": "openai-completions", "models": [ { "id": "qwen3.5-plus", "name": "qwen3.5-plus", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536, "compat": { "thinkingFormat": "qwen" } }, { "id": "qwen3-max-2026-01-23", "name": "qwen3-max-2026-01-23", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536, "compat": { "thinkingFormat": "qwen" } }, { "id": "qwen3-coder-next", "name": "qwen3-coder-next", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536 }, { "id": "qwen3-coder-plus", "name": "qwen3-coder-plus", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "MiniMax-M2.5", "name": "MiniMax-M2.5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 196608, "maxTokens": 32768 }, { "id": "glm-5", "name": "glm-5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384, "compat": { "thinkingFormat": "qwen" } }, { "id": "glm-4.7", "name": "glm-4.7", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384, "compat": { "thinkingFormat": "qwen" } }, { "id": "kimi-k2.5", "name": "kimi-k2.5", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 32768, "compat": { "thinkingFormat": "qwen" } } ] } } }, "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" }, "models": { "bailian/qwen3.5-plus": {}, "bailian/qwen3-max-2026-01-23": {}, "bailian/qwen3-coder-next": {}, "bailian/qwen3-coder-plus": {}, "bailian/MiniMax-M2.5": {}, "bailian/glm-5": {}, "bailian/glm-4.7": {}, "bailian/kimi-k2.5": {} } } }, "gateway": { "mode": "local" } }单击右上角 Save 保存,然后单击 Update使配置生效。

保存成功后,apiKey将显示为“__OPENCLAW_REDACTED__”。脱敏保护,仅用于前端界面隐藏,不影响实际调用。

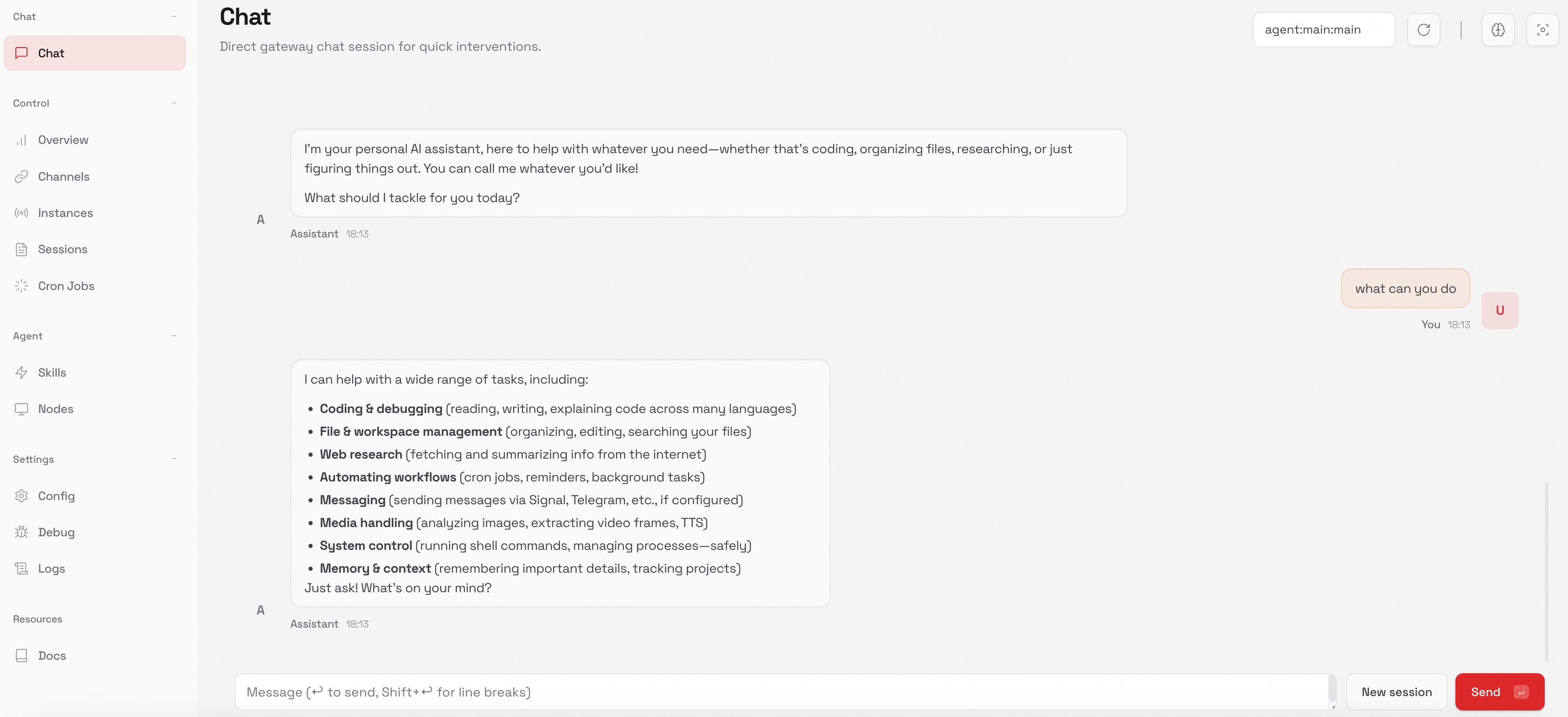

使用 OpenClaw

支持通过网页浏览器和终端命令行的方式使用 OpenClaw。

网页浏览器

新开一个终端,运行以下命令,浏览器将自动打开 OpenClaw 的操作界面。

openclaw dashboard开始对话。

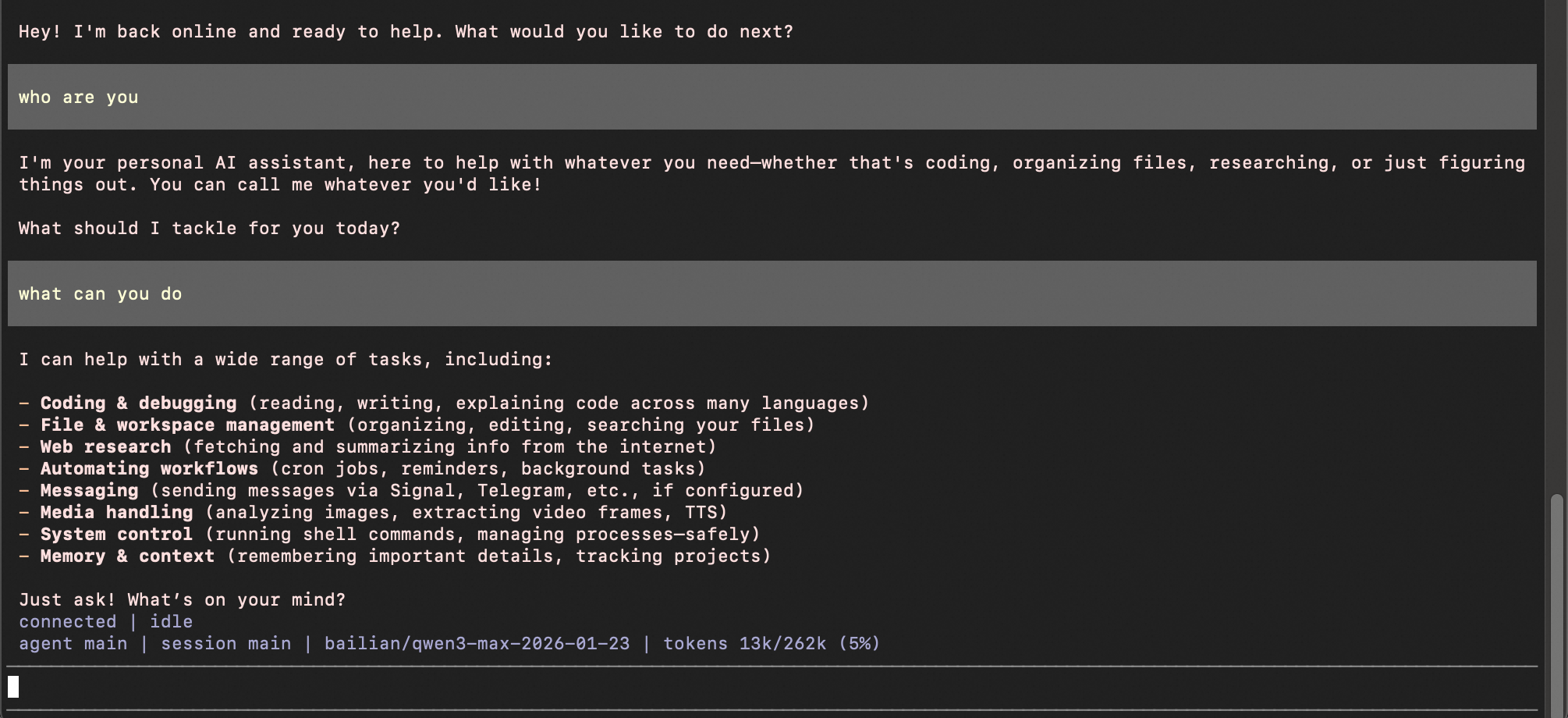

终端命令行

新开一个终端,运行以下命令。

openclaw tui开始对话。

常见命令

命令 | 说明 | 示例 |

/help | 显示可用命令的快速摘要。 | /help |

/status | 查看当前模型、会话、网关等状态信息。 | /status |

/model <模型名称> | 切换当前会话使用的模型。 | /model qwen3.5-plus |

/new | 开始一个新会话。 | /new |

/compact | 压缩对话历史,释放上下文窗口空间。 | /compact |

/think <级别> | 设置思考(推理)深度级别,可选 off、low、medium、high 等。 | /think high |

/skills | 展示所有可用的 Skill。 | /skills |

切换模型

在当前会话切换模型(临时有效)

在终端输入

openclaw tui,进入 OpenClaw 终端命令行,使用/model <模型名称>在当前会话中切换模型。/model qwen3-coder-next界面返回提示“model set to qwen3-coder-next” 即表示生效。

切换默认模型(永久有效)

如需在每次新会话中使用指定模型,修改

agents.defaults.model.primary字段为目标模型。请参考修改配置文件。{ "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" } } } }

接入消息渠道

Telegram

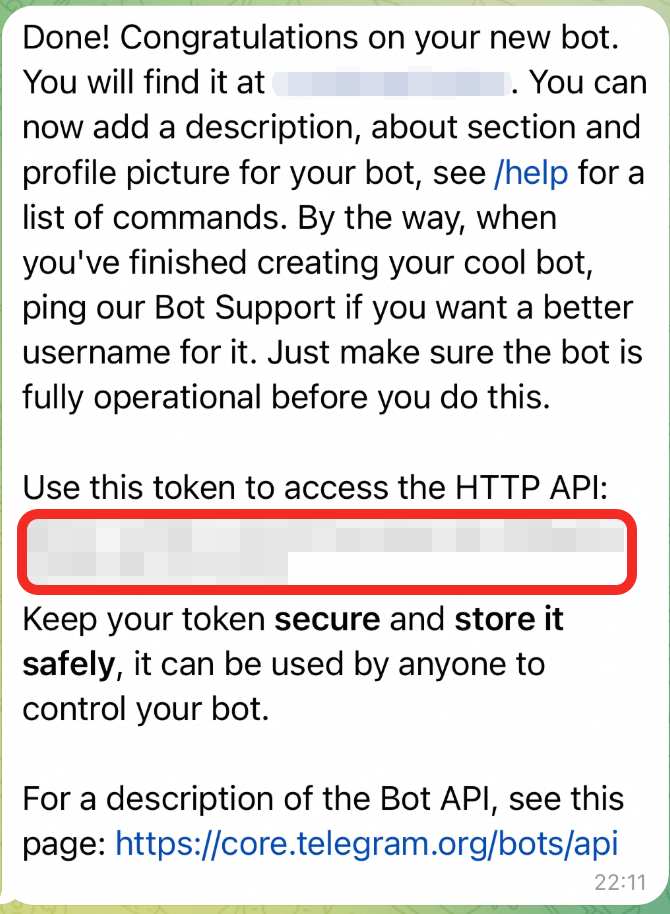

步骤一:配置 Telegram 机器人

通过 BotFather 创建机器人

发送

/newbot命令,按提示输入机器人名称和用户名(用户名必须以bot结尾),复制并保存返回的 Bot Token(格式为:123456789:ABCdefGHIjklMNOpqrsTUVwxyz)。

在 OpenClaw 对话中输入如下内容,并将 xxxx 替换为实际的 Bot Token。OpenClaw 会自动完成配置。

请帮我配置Telegram,配置项如下,我的Bot Token是xxxx。 { "channels": { "telegram": { "enabled": true, "botToken": "xxxx", "dmPolicy": "pairing" } } }配置完成后,重启网关。

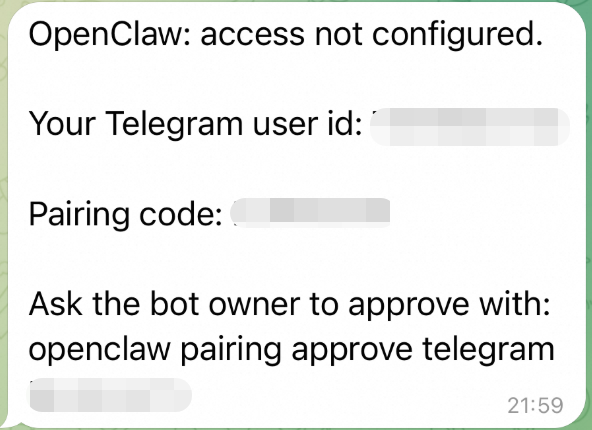

openclaw gateway restart在 Telegram 中发送消息给机器人,首次发送消息会收到配对码。

在终端执行以下命令,将 xxx 替换为实际的配对码。

openclaw pairing approve telegram xxx

步骤二:测试

在终端执行以下命令重启网关。

openclaw gateway restart执行以下命令检查 Telegram 渠道状态

openclaw status在 Channels 部分,Telegram 应显示为

ON且状态为OK。在 Telegram 中发送消息进行测试。

了解更多

Skill

Skill 是可扩展的能力模块,Agent 会根据请求自动匹配并加载对应的 Skill。OpenClaw 支持查看和启用内置 Skill,从 ClawHub安装社区 Skill,或创建自定义 Skill。

查看已有 Skill

执行以下命令查看已安装的 Skill 及其状态。

# 列出已安装的 Skill openclaw skills list # 查看 Skill 状态(已启用、已禁用、缺少依赖等) openclaw skills check # 查看特定 Skill 的详细信息 openclaw skills info <skill-name>内置 Skill 默认未启用,需在

~/.openclaw/openclaw.json中通过skills.allowBundled白名单启用,只有列在其中的内置 Skill 才会被加载。{ "skills": { "allowBundled": [ "github", "weather", "summarize", "coding-agent", "clawhub", "nano-pdf", "google-web-search", "image-lab" ] } }部分内置 Skill需要配置对应的第三方 API Key 才能使用,请在

~/.openclaw/openclaw.json的skills.entries中配置,具体请参考 Skills 配置文档。

查找更多 Skill

可以通过以下两种方式查找并安装更多 Skill。

通过 ClawHub 搜索安装

ClawHub 提供 3,000+ 个社区 Skill,可以在网站上浏览,也可以通过命令行搜索。

# 按关键词搜索 npx clawhub search [关键词] # 浏览最近更新的 Skill npx clawhub explore找到合适的 Skill 后,执行以下命令安装,安装完成后重启网关即可使用。

npx clawhub install <skill-name>直接在 OpenClaw 中提问

在对话中直接描述需求,例如

帮我找一个可以查天气的 Skill,OpenClaw 会自动搜索并安装。

创建自定义 Skill

创建 Skill 目录。

mkdir -p ~/.openclaw/workspace/skills/my-custom-skill在该目录下创建

SKILL.md文件。文件由 YAML 前置元数据和 Markdown 指令两部分组成,其中name和description为必填字段。Agent 根据description判断是否加载该 Skill,请确保描述准确。--- name: my-custom-skill description: 简短描述 --- # My Custom Skill 当用户请求 XXX 时,执行以下操作: 1. 使用 bash 工具运行 xxx 命令 2. 解析输出结果 3. 以表格形式返回给用户重启网关使 Skill 生效。

# 重启网关 openclaw gateway restart # 查看 Skill 是否生效 openclaw skills list

更多 Skill 配置说明请参考OpenClaw 官方文档。

常见问题

如何查看coding plan已配置的模型?

在终端输入openclaw tui,进入 OpenClaw 终端命令行,接着输入/model查看模型列表。按回车键选中模型,按Esc键退出模型列表。

OpenClaw报错“API rate limit reached”怎么办?

请按以下顺序排查:

OpenClaw 配置错误

若 Base URL 或模型提供商配置有误,导致请求未进入 Coding Plan 专属通道,而是被路由到了 通用的API 调用,从而触发限流。

若使用 Coding Plan 套餐,请核对OpenClaw 配置文件中的

models、agents、gateway(含嵌套字段),确保与文档配置一致。例如:模型服务提供商的结构为{ "models": { "providers": { "bailian": {...} } } }。若当前未使用 Coding Plan 套餐,建议切换至 Coding Plan 以获取专属额度。

超出套餐限额:在Coding Plan页面查看套餐用量情况。

若额度已用尽,在该页面查看下一次额度重置的时间。

若频繁触达限额,建议升级至 Pro 套餐以获取更多调用次数。

尝试重置 API Key:若完成上述排查后问题仍未解决,请前往Coding Plan页面重置 API Key。

为什么报错"HTTP 401: Incorrect API key provided."或"No API key found for provider xxx"?

可能原因:

API Key 无效、过期、为空、格式错误,或与端点环境不匹配,请检查 API Key 是否为 Coding Plan 套餐专属 Key,复制完整且无空格;确认订阅状态有效。

OpenClaw的历史配置缓存导致配置错误,请删除

~/.openclaw/agents/main/agent/models.json文件中的providers配置项,并重启OpenClaw。

我已经配置过钉钉等其他渠道,如何安全地添加 Coding Plan 模型(防止原有配置丢失)?

请勿直接全量覆盖。直接“全部替换”会覆盖掉你的自定义配置,请进行局部修改。

您可以选择以下方式完成配置:

若OpenClaw 可正常对话:直接在 OpenClaw 对话中输入以下指令完成配置合并。

若OpenClaw 未配置模型或无法对话:请参考Qwen Code 引导配置。

指令内容(请将 YOUR_API_KEY 替换为实际的 API Key):

请在OpenClaw 中接入Coding Plan,步骤如下: 1. 打开配置文件:~/.openclaw/openclaw.json 2. 找到或创建以下字段,合并配置(保留原有配置不变,若字段不存在则新增): { "models": { "mode": "merge", "providers": { "bailian": { "baseUrl": "https://coding-intl.dashscope.aliyuncs.com/v1", "apiKey": "YOUR_API_KEY", "api": "openai-completions", "models": [ { "id": "qwen3.5-plus", "name": "qwen3.5-plus", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536, "compat": { "thinkingFormat": "qwen" } }, { "id": "qwen3-max-2026-01-23", "name": "qwen3-max-2026-01-23", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536, "compat": { "thinkingFormat": "qwen" } }, { "id": "qwen3-coder-next", "name": "qwen3-coder-next", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536 }, { "id": "qwen3-coder-plus", "name": "qwen3-coder-plus", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "MiniMax-M2.5", "name": "MiniMax-M2.5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 196608, "maxTokens": 32768 }, { "id": "glm-5", "name": "glm-5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384, "compat": { "thinkingFormat": "qwen" } }, { "id": "glm-4.7", "name": "glm-4.7", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384, "compat": { "thinkingFormat": "qwen" } }, { "id": "kimi-k2.5", "name": "kimi-k2.5", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 32768, "compat": { "thinkingFormat": "qwen" } } ] } } }, "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" }, "models": { "bailian/qwen3.5-plus": {}, "bailian/qwen3-max-2026-01-23": {}, "bailian/qwen3-coder-next": {}, "bailian/qwen3-coder-plus": {}, "bailian/MiniMax-M2.5": {}, "bailian/glm-5": {}, "bailian/glm-4.7": {}, "bailian/kimi-k2.5": {} } } }, "gateway": { "mode": "local" } } 3. 保存配置文件 4. 运行openclaw gateway restart,重启Openclaw的网关,使配置生效。配置完成后,新开一个 OpenClaw 或 Qwen Code 会话,输入以下指令验证配置是否生效:

openclaw models status。重启网关后,已有会话可能无法正常对话,请重启会话。

如果通过轻量应用服务器安装的OpenClaw,可直接使用图形化界面添加 Coding Plan 模型。详情请参考轻量应用服务器添加方式。

更多问题请参考常见问题。