マルチクラウド環境では、セキュリティログが異なるクラウドプラットフォームに分散しているため、統合的な脅威検知およびインシデント対応が困難になります。Security Center の Agentic SOC 機能により、Web Application Firewall (WAF) や Cloud Firewall (CFW) など Huawei Cloud の製品から発行されるセキュリティログを一元的にインポート・分析できます。これにより、すべてのクラウド環境におけるセキュリティ管理を単一の場所から実施できます。

本ガイドでは、以下の手順について説明します。

Huawei Cloud WAF または CFW のログを Log Tank Service (LTS) に送信します。

インポート方法を選択します:Kafka(DMS)または OBS。

データチャネルおよびインポートタスクを構成します。

インポートポリシーおよび脅威検知ルールを設定し、ログの分析を開始します。

仕組み

ログは、Huawei Cloud から Security Center へ以下のステージを経て流れます。

ログ集約:WAF および CFW のログが Huawei Cloud の Log Tank Service (LTS) に集約されます。

データエクスポート:LTS は、クロスクラウド転送の中継ポイントとして機能する Distributed Message Service (DMS) for Kafka または Object Storage Service (OBS) へログデータをエクスポートします。

クロスクラウドインポート:Agentic SOC が DMS for Kafka(Kafka プロトコルを使用)または OBS(S3 プロトコルを使用)からログデータをサブスクライブ・プルし、指定されたデータソースへインポートします。

インポートおよび標準化:Agentic SOC 内部で、インポートポリシーが標準化ルールを適用して生ログを解析・正規化した後、データウェアハウスに格納します。

サポート対象のログタイプ

Agentic SOC では、Huawei Cloud からの以下のログタイプのインポートに対応しています。

Web Application Firewall (WAF) アラートログ

Cloud Firewall (CFW) アラートログ

ステップ 1:ログを LTS へ送信

ログのインポートを開始する前に、Huawei Cloud のすべてのセキュリティ製品から出力されるログを LTS へ送信してください。

Web Application Firewall

詳細な手順については、Huawei Cloud ドキュメントの「LTS を使用して WAF ログを記録する」をご参照ください。

Web Application Firewall コンソールにログインします。左上隅でリージョンまたはプロジェクトを選択し、左側のナビゲーションウィンドウで [イベント] をクリックします。

ログ設定 タブで、LTS への接続 をクリックし、以下のパラメーターを構成します。

重要構成の有効化には約 10 分かかります。

パラメーター 値 ログタイプ WAF アクセスログおよび WAF 攻撃ログ ロググループ ログを保存するロググループを選択します。新しいロググループを作成する場合は、ロググループの作成 をクリックします。 WAF アクセスログストリーム 「WAF アクセスログ」を選択した場合、WAF アクセスログストリームを選択します。新しいストリームを作成する場合は、ログストリームの作成 をクリックします。 WAF 攻撃ログストリーム 「WAF 攻撃ログ」を選択した場合、WAF 攻撃ログストリームを選択します。新しいストリームを作成する場合は、ログストリームの作成 をクリックします。

Cloud Firewall

詳細な手順については、Huawei Cloud ドキュメントをご参照ください: CFW ログを LTS に取り込む。

ロググループおよびログストリームの作成

Cloud Log Service コンソールCloud Log Service コンソール にログインします。ログインジェスト ページで、ロググループの作成 をクリックします。

ロググループの作成 ページで、ロググループ名 および ログ保持期間(日) を設定します。注: 識別を容易にするために、ロググループ名に接尾辞

-cfwを追加します(例:mylog-cfw)。ロググループを作成したら、リストでそのロググループを見つけ、

アイコンの下にある[ログストリームの作成]をクリックします。

アイコンの下にある[ログストリームの作成]をクリックします。ログストリームの作成 ページで、ログストリーム名 および ログ保存期間(日) を設定します。

重要注: 攻撃イベントログ、アクセス制御ログ、トラフィックログそれぞれに対して、接尾辞

-attack、-access、-flowを使用します。CFW では、以下の 3 種類のログストリームがサポートされています。

ログタイプ 説明 攻撃ログ 攻撃アラート(イベントタイプ、保護ルール、アクション、5 次元ルール、攻撃ペイロードなど)を記録します。 アクセスログ ACL ポリシーに一致するトラフィック(ヒット時刻、5 次元ルール、応答アクション、アクセス制御ルールなど)を記録します。 トラフィックログ Cloud Firewall を通過するすべてのトラフィック(開始時刻、終了時刻、5 次元ルール、バイト数、パケット数など)を記録します。

LTS 同期の設定

Cloud Firewall コンソールにログインします。左上隅でリージョンとファイアウォールインスタンスを選択し、左側のナビゲーションウィンドウで [ログ監査] > [ログ管理] を選択します。

ログ管理 ページで、LTS 同期の構成 をクリックします。ロググループ および ログソース に、前述で作成したロググループおよびログストリームを設定します。

ステップ 2:インポート方法の選択

Huawei Cloud LTS ログを Security Center へインポートするには、2 種類の方法があります。リアルタイム性の要件、コスト制約、構成の複雑さに応じて選択してください。

| 観点 | Kafka(DMS) | OBS |

|---|---|---|

| リアルタイム性能 | ニアリアルタイム(リアルタイム転送も設定可能) | 分単位の遅延 |

| 構成の複雑さ | 高い。Kafka インスタンス、EIP(Elastic IP Address)、セキュリティグループなどの構成が必要です。 | 低い。転送タスクの構成のみで済みます。 |

| コスト(Huawei Cloud) | Kafka インスタンス、EIP およびトラフィック、Log Service | OBS ストレージ、Log Service |

| コスト(Alibaba Cloud) | Agentic SOC ログインジェストトラフィック | Agentic SOC ログインジェストトラフィック |

| 推奨ユースケース | ストリームベースのセキュリティ処理や迅速なアラート対応など、ニアリアルタイムのログ分析を必要とするシナリオ | リアルタイム性能が必須でなく、コスト効率性、ログアーカイブ、バッチ形式のオフライン分析を重視するシナリオ |

ステップ 3:データインポートの構成

選択したインポート方法に従って手順を実行してください。

Kafka(DMS)を使用したデータインポート

Huawei Cloud での Kafka データチャネルの準備

Kafka インスタンスの構成

Kafka インスタンスの作成

Kafka インスタンスの購入ページに移動します。Kafka インスタンスの購入ページ。「[クイック設定]」タブで、インスタンスの仕様および仮想プライベートクラウド (VPC) を含む基本構成とネットワーク構成を完了します。

アクセスモード 領域で、パブリックネットワークアクセス を選択し、以下のパラメーターを構成します。

パラメーター 値 パブリックネットワークアクセス 暗号化アクセス を選択します。 パブリック IP アドレス 利用可能な Elastic IP Address(EIP)を選択します。EIP が不足している場合は、EIP の作成EIP の申請  をクリックして EIP 購入ページに移動します。詳細については、Huawei Cloud ドキュメントをご参照ください:。購入後、Elastic IP Address の横にある アイコンをクリックし、ドロップダウンリストから新しく購入した EIP を選択します。

をクリックして EIP 購入ページに移動します。詳細については、Huawei Cloud ドキュメントをご参照ください:。購入後、Elastic IP Address の横にある アイコンをクリックし、ドロップダウンリストから新しく購入した EIP を選択します。Kafka セキュリティプロトコル SASL_SSL:認証に SASL を使用し、SSL 証明書でデータを暗号化します。SASL_PLAINTEXT:認証に SASL を使用し、パフォーマンス向上のためデータをプレーンテキストで送信します。 SASL PLAIN メカニズム Kafka セキュリティプロトコル を SASL_PLAINTEXT に設定した場合、CRAM-SHA-512 を選択します。 ユーザー名 / パスワード Kafka インスタンスへの接続にクライアントが使用する認証情報です。暗号化アクセスを有効化した後は、ユーザー名を変更できません。 重要重要: 少なくとも 3 つの EIP を購入してください。ユーザー名およびパスワードは必ず保存してください。これらは、後ほど Security Center が Kafka へアクセスする際に必要になります。

詳細については、Huawei Cloud ドキュメントの「Kafka インスタンスの購入」をご参照ください。

トピックの作成

「Huawei Cloud - Kafka 管理」ページに移動します。左上隅で、Kafka インスタンスが配置されているリージョンを選択します。

左側ナビゲーションウィンドウで Kafka インスタンス をクリックし、対象のインスタンス名をクリックして詳細ページを開き、トピック管理 をクリックします。

トピックの作成 をクリックし、パラメーターを構成します。ほとんどのユースケースでは、デフォルト設定で問題ありません。

詳細については、Huawei Cloud ドキュメントのトピックパラメーターの説明をご参照ください。

セキュリティグループルールの構成:パブリックアクセスを有効化した後、Kafka への接続を許可するセキュリティグループルールを構成します。

Kafka インスタンスの詳細ページで、左側のナビゲーションウィンドウにある[概要]をクリックします。[ネットワーク]セクションで、[セキュリティグループ]の横にある

アイコンをクリックします。

アイコンをクリックします。ポリシー構成ページで、受信ルール タブをクリックし、ルールの追加 をクリックして、以下の内容を設定します。

フィールド 値 ポリシー 許可 タイプ IPv4 プロトコル カスタム TCP ポート 9095 送信元 0.0.0.0/0

Kafka 接続パラメーターの確認:Kafka インスタンスの 概要 ページで、アドレス(パブリックネットワーク、暗号化)、有効化された セキュリティプロトコル、および SASL PLAIN メカニズム をメモしてください。これらの情報は、Security Center から Kafka へ接続する際に必要になります。

LTS から Kafka への転送タスクの作成

詳細な手順については、Huawei Cloud のドキュメント「ログデータをDMSに転送する」をご参照ください。

Log Service コンソール にログインします。左側ナビゲーションウィンドウで ログ転送 をクリックし、右上隅の ログ転送の構成 をクリックします。

以下の転送パラメーターを設定します。

パラメーター 値 転送モード 定期転送 転送先 DMS ロググループ名 / ログストリーム名 ステップ 1 で構成したロググループおよびストリーム(例:WAF 攻撃ログ) Kafka インスタンス 構成済みの Kafka インスタンス トピック 作成済みのトピック 転送間隔 リアルタイム フォーマット 生ログフォーマットまたは JSON

Alibaba Cloud での Kafka ログインポートの構成

Security Center による Kafka へのアクセス権限の付与

Security Center コンソール > Agentic SOC > インテグレーションセンター に移動します。左上隅で資産リージョンを選択します:中国本土 または 中国本土以外。

マルチクラウド構成管理 タブで、マルチクラウド資産 を選択し、権限の付与 をクリックして、ドロップダウンリストから IDC を選択します。表示されるパネルで、以下のパラメーターを設定します。

パラメーター 値 ベンダー Apache 接続タイプ Kafka エンドポイント Huawei Cloud で記録した Kafka の IPv4 暗号化パブリックエンドポイント ユーザー名 / パスワード Huawei Cloud で構成した Kafka の認証情報 通信プロトコル Huawei Cloud で有効化したセキュリティプロトコル SASL 認証メカニズム Huawei Cloud で構成した SASL PLAIN メカニズム 同期ポリシーの構成 の下で、AK サービスステータスチェック を、Security Center が Huawei Cloud のアクセスキーの有効性を確認する間隔に設定します。無効化 を選択すると、このチェックを無効化できます。

データインポートタスクの作成

Huawei Cloud のログデータ用の データソース を作成します。既に作成済みの場合は、このステップをスキップできます。

Security Center コンソール > Agentic SOC > インテグレーションセンター に移動します。左上隅で資産リージョンを選択します。

[データソース] タブで、Huawei Cloud のログ用のデータソースを作成します。 手順については、「データソースの作成: ログが Simple Log Service (SLS) に取り込まれない」をご参照ください。

パラメーター 値 ソースデータソースタイプ ユーザーログサービス または Agentic SOC 専用収集チャネル を選択します。 インスタンスの追加 データを分離するために新しい Logstore を作成します。

データインポート タブで、データの追加 をクリックします。表示されるパネルで、以下の 転送フォーマットから値タイプへのマッピング を設定します。

パラメーター 値 エンドポイント Kafka の IPv4 暗号化パブリックエンドポイント トピック Huawei Cloud で作成した トピック 値タイプ 以下のマッピングをご参照ください 転送フォーマット 値タイプ JSON 形式 json 生ログフォーマット text 宛先データソースの構成 の下で、以下の項目を設定します。

データソース名:作成済みのデータソースを選択します。

宛先 Logstore:選択したデータソース配下の Logstore が自動的に読み込まれます。

OK をクリックします。Security Center が Huawei Cloud からログを自動的にプルし始めます。

OBS を使用したデータインポート

Huawei Cloud での OBS データの準備

LTS による OBS へのログ転送の構成

転送タスクの作成

にログインします。左側ナビゲーションウィンドウで ログ転送 をクリックし、右上隅の ログ転送の構成 をクリックします。

以下の転送パラメーターを設定します。

パラメーター 値 転送モード 定期転送 転送先 OBS バケット ロググループ名 / ログストリーム名 ステップ 1 で構成したロググループおよびストリーム(例:WAF アクセスログストリーム) OBS バケット 既存の OBS バケットを選択するか、Huawei Cloud - バケット一覧 ページで新しいバケットを作成します カスタムログ転送パス 有効:カスタムパスを /LogTanks/RegionName/%GroupName/%StreamName/<custom_transfer_path>の形式で設定(デフォルト:lts/%Y/%m/%d)。無効:ログはデフォルトパスLogTanks/RegionName/2019/01/01/<Log_Group>/<Log_Stream>/<log_file_name>へ送信されます。圧縮フォーマット uncompressed、gzip、またはzip説明注: LTS は、標準ストレージまたは復元済みアーカイブストレージクラスを使用する OBS バケットへのログ転送に対応しています。

警告警告: Security Center は、

snappy形式で圧縮されたログファイルの解析をサポートしていません。

詳細な手順については、Huawei Cloud ドキュメントをご参照ください:OBS へのログ転送。

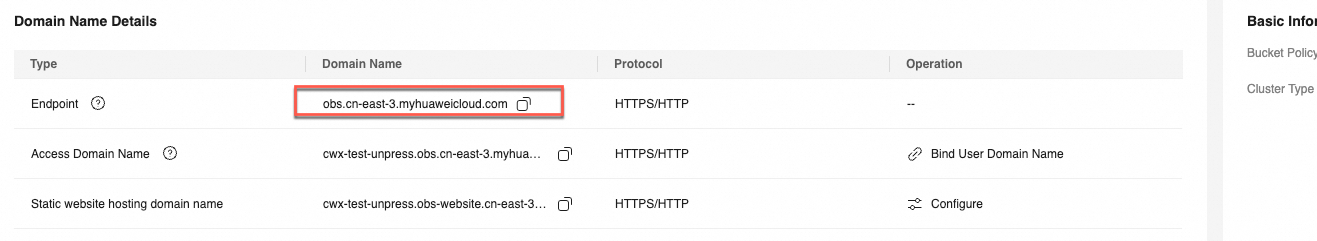

OBS バケットエンドポイントの取得

Huawei Cloud バケットリスト ページに移動します。LTS ログ転送用に設定した OBS バケットを見つけ、その詳細ページを開きます。左側のナビゲーションウィンドウで、[概要] をクリックします。

ドメイン名 セクションで、エンドポイント をメモします。形式は

obs.${region}.myhuaweicloud.comです。

アクセスキーの作成

「Huawei Cloud - マイクレデンシャル」ページに移動します。左側のナビゲーションウィンドウで、[Access Keys] をクリックします。

クリックして、[アクセスキーの作成] を選択します。 「[CSVファイルのダウンロード]」をクリックするか、AccessKey ID および Secret Access Key をローカルファイルにコピーして安全に保管してください。 詳細については、「Access KeyAccess Key」をご参照ください。

Alibaba Cloud での OBS ログインポートの構成

Security Center による Huawei Cloud OBS へのアクセス権限の付与

Security Center コンソール > Agentic SOC > インテグレーションセンター に移動します。左上隅で資産リージョンを選択します:中国本土 または 中国本土以外。

マルチクラウド構成管理 タブで、マルチクラウド資産 を選択し、権限の付与 をクリックして、ドロップダウンリストから IDC を選択します。表示されるパネルで、以下のパラメーターを設定します。

パラメーター 値 ベンダー AWS-S3 接続タイプ S3 エンドポイント OBS バケットエンドポイント(形式: obs.${region}.myhuaweicloud.com)アクセスキー ID / シークレットアクセスキー Huawei Cloud で作成したアクセスキー 同期ポリシーの構成 の下で、AK サービスステータスチェック を、Security Center が Huawei Cloud のアクセスキーの有効性を確認する間隔に設定します。無効化 を選択すると、このチェックを無効化できます。

データインポートタスクの作成

Security Center コンソール > Agentic SOC > インテグレーションセンター に移動します。左上隅で資産リージョンを選択します:中国本土 または 中国本土以外。

データインポート タブで、データの追加 をクリックします。表示されるパネルで、以下のパラメーターを設定します。

パラメーター 値 エンドポイント OBS バケットエンドポイント OBS バケット LTS がログを転送する OBS バケット 宛先データソースの構成 の下で、以下の項目を設定します。

データソース名:正常なステータスのカスタムデータソース(カスタムログ機能 または Agentic SOC 専用データ収集チャネル)を選択します。適切なデータソースがない場合は、新たに作成してください。手順については、「データソース」をご参照ください。

宛先 Logstore:選択したデータソース配下の Logstore が自動的に読み込まれます。

OK をクリックします。Security Center が Huawei Cloud からログを自動的にプルし始めます。

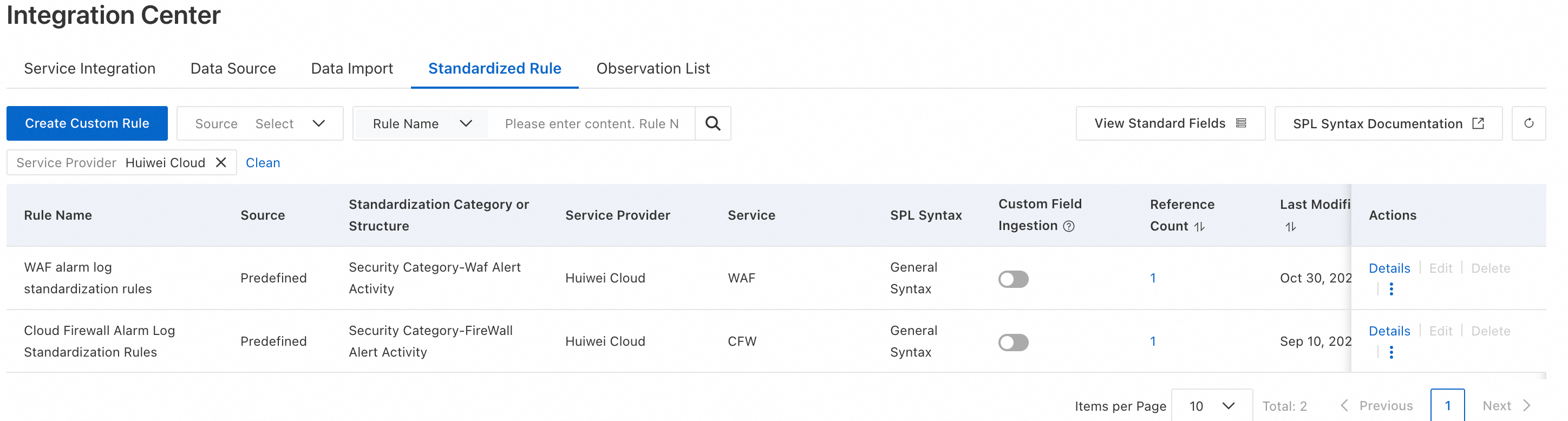

ステップ 4:インポート済みデータの分析

データがインポートされた後、解析および検知ルールを設定します。

インジェストポリシーを作成します。 「Agentic SOC 2.0 にプロダクトを接続する」の指示に従って、次の設定でインジェストポリシーを作成します:

パラメーター 値 データソース データインポートタスクで構成した宛先データソースを選択します。 標準化ルール Huawei Cloud 製品向けに事前定義された標準化ルールから選択します。 標準化方法 アラートログの場合、デフォルトで リアルタイム消費 に設定されており、変更できません。

脅威検知ルールの構成:ルール管理でログ検知ルールを有効化または作成し、ログの分析、アラートの生成、セキュリティイベントの作成を行います。手順については、「脅威検知ルールの構成」をご参照ください。

課金

本ソリューションでは、両クラウドプラットフォームで課金が発生します。実施前に各製品の課金ドキュメントを確認してください。

Huawei Cloud の課金(データ転送およびストレージ):

| サービス | 課金項目 | 課金ドキュメント |

|---|---|---|

| LTS | ログストレージ、読み書き操作など | Huawei Cloud LTS - 課金概要 |

| DMS for Kafka | インスタンスの仕様、パブリックネットワークトラフィックなど | Huawei Cloud Kafka :課金概要 |

| OBS | ストレージ容量、リクエスト数、パブリックネットワークトラフィックなど | Huawei Cloud OBS - 課金概要 |

Alibaba Cloud の課金(選択したデータストレージ方法によって異なります):

Agentic SOC の課金については、「課金の詳細」および「脅威分析および対応の従量課金制」をご参照ください。Simple Log Service (SLS) の課金については、「SLS の課金概要」をご参照ください。

| データソースタイプ | Agentic SOC の課金項目 | SLS の課金項目 | 備考 |

|---|---|---|---|

| Agentic SOC 専用収集チャネル | ログインジェスト料金 + ログストレージおよび書き込み料金(いずれも ログインジェストトラフィック を消費) | ログストレージおよび書き込み以外の料金(パブリックネットワークトラフィックなど) | Agentic SOC が SLS リソースを作成および管理します。ログストレージおよび書き込み料金は Agentic SOC 経由で課金されます。 |

| ユーザーログサービス | ログインジェスト料金(ログインジェストトラフィック を消費) | すべてのログ関連料金(ストレージ、書き込み、パブリックネットワークトラフィックなど) | すべてのログリソースは SLS が管理します。すべてのログ関連料金は SLS 経由で課金されます。 |

よくある質問

データインポートタスクを作成した後に SLS にログデータが表示されない

以下の順序で確認してください。

Huawei Cloud 側:Huawei Cloud コンソールにログインし、ログが生成され、構成済みの LTS ログストリーム、Kafka トピック、または OBS バケットへ配信されていることを確認します。

認証情報:Security Center で マルチクラウド資産 ページに移動し、権限付与ステータスが正常であることを確認し、アクセスキーが有効であることを確認します。

ネットワーク接続性(Kafka 方法のみ):Kafka サービスのパブリックアクセスが有効化されていること、およびセキュリティグループルールが Security Center のサービス IP アドレスからのインバウンドトラフィックを許可していることを確認します。

データインポートタスク:Security Center の データインポート ページに移動し、タスクのステータスおよびエラーログを確認して、必要に応じて修正を行います。

権限付与時に `Huawei Cloud` ではなく `Apache` または `AWS-S3` を選択する理由は何ですか?

ログインポート機能は、ベンダー固有の API ではなく、標準的かつプロトコル互換性のあるインターフェイスを使用します。

IDC は、プロトコルベンダーを表すドロップダウン値です。

Apacheは Kafka プロトコルを、AWS-S3は S3 互換オブジェクトストレージプロトコルを表します。Huawei Cloud をベンダーとして権限付与すると、Agentic SOC が Huawei Cloud と連携してセキュリティイベント対応(例:「脅威検知ルール」を使用した IP アドレスのブロックなど)を実施できますが、ログインポートは有効になりません。

次のステップ

脅威検知ルールを設定する — インポートしたログを分析し、セキュリティアラートを生成する検知ルールを作成します。

Agentic SOC 2.0 にプロダクトを接続する — 他のログソース向けの追加の取り込みポリシーを設定します。

データソース — Agentic SOC のデータソースおよび Logstore を管理します。