このドキュメントでは、OpenAI 互換コンテンツ生成サービスの API パラメーターについて説明します。

URL

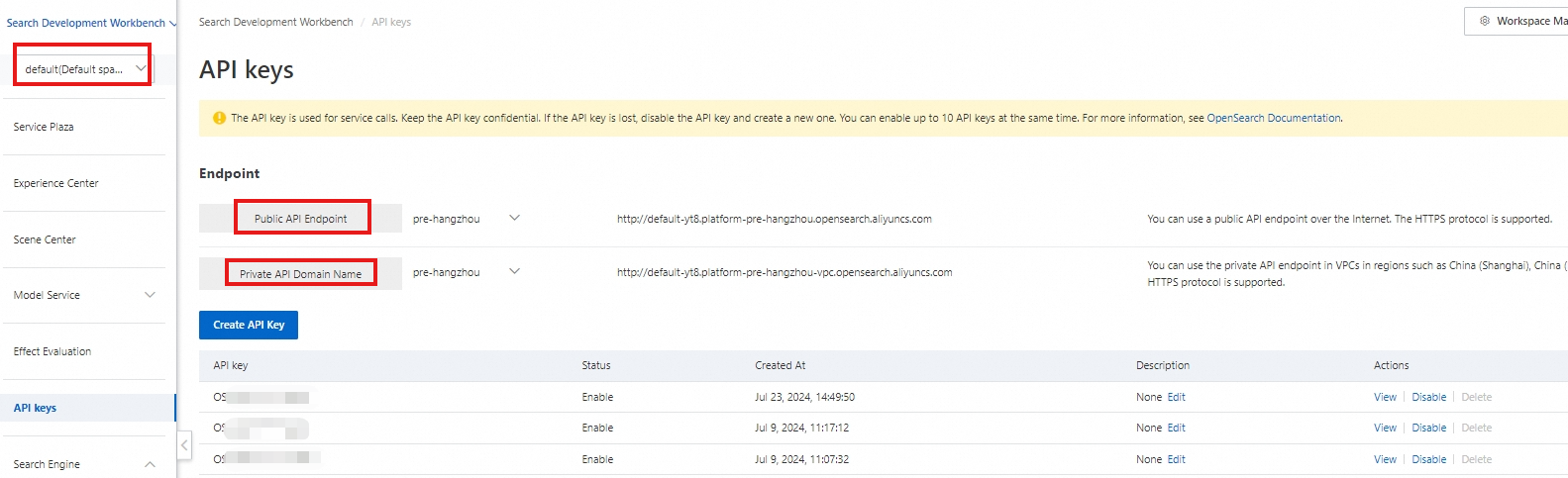

{host}/compatible-mode/v1/chat/completionshost:サービスを呼び出すためのアドレス。インターネットまたは VPC のいずれかを使用して API サービスを呼び出すことができます。 詳細については、「サービスアクセスアドレスのクエリ」をご参照ください。

リクエストパラメーター

パラメータ | タイプ | 必須 | 説明 | 値の例 |

messages | List[Dict] | はい | これまでの会話におけるメッセージのリスト:

| [ {"role": "system", "content": "あなたはロボットアシスタントです"}, {"role": "user", "content": "河南省の省都はどこですか?"}, {"role": "assistant", "content": "鄭州市です"}, {"role": "user", "content": "そこにはどんな楽しい場所がありますか?"} ] |

model | String | はい | サービスID。サポートされているサービスIDのリストについては、 サービス ID。サポートされているサービス ID のリストについては、サポートされているサービスのリスト を参照してください。 | ops-qwen-turbo |

max_tokens | Int | いいえ | チャットの完了時に生成されるトークンの最大数。この制限に達しても会話が終了しない場合、「finish_reason」は「length」になります。それ以外の場合は「stop」になります。 | 1024 |

temperature | Float | いいえ | テキスト生成時に各候補語の確率分布を制御し、モデルの応答のランダム性と多様性を制御するために使用されます。範囲は [0, 2) です。 0 は意味がありません。 温度値が高いほど確率分布のピークが低くなり、確率の低い単語が選択される可能性が高くなり、出力の多様性が高まります。温度値が低いほど確率分布のピークが強くなり、確率の高い単語が選択される可能性が高くなり、より決定的な出力になります。 | 1 |

top_p | Float | いいえ | 生成中のニュークリアスサンプリングの確率しきい値。範囲は (0, 1.0) です。値が大きいほど生成のランダム性が高まり、値が小さいほど決定論が高まります。 | 0.8 |

presence_penalty | Float | いいえ | モデルがテキストを生成するときのシーケンス全体の繰り返しを制御します。範囲は [-2.0, 2.0] で、デフォルト値は 0 です。 presence_penalty を増やすと、モデルの出力の繰り返しを減らすことができます。 | 0 |

frequency_penalty | Float | いいえ | 頻度ペナルティ値。範囲は [-2.0, 2.0] で、デフォルト値は 0 です。 正の値は、テキスト中の現在の頻度に基づいて新しい単語にペナルティを課し、モデルが同じフレーズを繰り返す可能性を低減します。 | 0 |

stop | String, List[String] | いいえ | 指定された「stop」単語またはトークンは、そのようなコンテンツが差し迫っているときにモデルにコンテンツの生成を停止するように促します。生成されたコンテンツには、指定された「stop」要素は含まれません。これは単一の文字列または文字列の配列にすることができます。デフォルトは null です。 | デフォルト null |

stream | Boolean | いいえ | ストリーミング出力を使用するかどうかを決定します。ストリームモードでは、インターフェイスは結果をジェネレーターとして返します。これは、増分シーケンスを取得するために反復処理する必要があります。デフォルトは false です。 | false |

レスポンスパラメーター

パラメータ | タイプ | 説明 | 値の例 |

id | String | システムによって生成された呼び出しの一意の ID。 | 2244F3A8-4201-4F37-BF86-42013B1026D6 |

object | String | オブジェクトのタイプ。常に「chat.completion」に設定されます。 | chat.completion |

created | Long | レスポンスが作成されたUnixタイムスタンプ(秒単位)。 | 1719313883 |

model | String | レスポンスの生成に使用されたモデル。 | ops-qwen-turbo |

choices.index | Int | 生成された結果のインデックス。0 は最初の結果を示します。 | 0 |

choices.message | Map | モデルによって生成されたメッセージの内容。 | { "role":"assistant", "content":"これは例です" } |

choices.finish_reason | String | セグメント化 + ストリーミング

| stop |

usage.completion_tokens | Int | モデルがレスポンスを生成するために使用したトークンの数。 | 150 |

usage.prompt_tokens | Int | モデルへのユーザー入力のトークン数。 | 180 |

usage.total_tokens | Int | ユーザー入力とモデルのレスポンスに使用されたトークンの合計。 | 330 |

Curl リクエスト例

curl http://xxxx-cn-shanghai.opensearch.aliyuncs.com/compatible-mode/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer Your-API-Key" \

-d '{

"model":"ops-qwen-turbo",

"messages":[

{"role": "system", "content": "You are a robot assistant"},

{"role": "user", "content": "Recommend 1 science fiction book"}

]

}'サンプルレスポンス

{

"id":"fb4b3860e051ecad0b019971******",

"object":"chat.completion",

"created":1749804786,

"model":"ops-qwen-turbo",

"choices":

[

{

"index":0,

"message":

{

"role":"assistant",

"content":"The 'Three-Body Problem' series by Liu Cixin. This is a story about......"

},

"finish_reason":"stop"

}

],

"usage":

{

"prompt_tokens":22,

"completion_tokens":48,

"total_tokens":70

}

} ステータスコード

状態コードの詳細については、「状態コード」をご参照ください。