DMS でノートブックワークスペースをセットアップし、Spark または Python を使用してデータをクエリおよび分析します。このガイドでは、ワークスペースの作成、ストレージの構成、計算リソースの追加、およびデータへのアクセスについて説明します。

前提条件

開始する前に、以下があることを確認してください。

シンガポールリージョンに標準ストレージクラスの Object Storage Service (OSS) バケットがあること。バケットがない場合は、まずバケットを作成してください。

DMS に登録済みの AnalyticDB for MySQL クラスター(Spark イメージを使用する場合にのみ必要)。クラスターが登録されていない場合は、「Alibaba Cloud データベースインスタンスの登録」を参照してください。

構成済みの vSwitch とセキュリティグループを持つ Virtual Private Cloud (VPC) があること。

ステップ 1: ワークスペースの作成

DMS コンソール V5.0 にログインします。

左上隅の

アイコンをクリックし、[すべての機能] > [データ開発] > [ノートブック] を選択します。説明

アイコンをクリックし、[すべての機能] > [データ開発] > [ノートブック] を選択します。説明DMS をシンプルモードで使用していない場合は、上部ナビゲーションバーで [データ開発] > [ノートブック] を選択します。

[ワークスペースの作成] をクリックします。[ワークスペースの作成] ダイアログボックスで、[ワークスペース名] および [リージョン] を設定し、[OK] をクリックします。

説明ワークスペース名には、文字、数字、アンダースコア (_) を含めることができます。

ワークスペースにはシンガポールリージョンのみを選択できます。

ワークスペースリストで、[操作] 列の [ワークスペースに移動] をクリックします。

説明デフォルトでは、ワークスペース作成者のみがワークスペースにアクセスできます。共同開発を有効にするには、アクセスが必要なユーザーに開発権限を付与します。

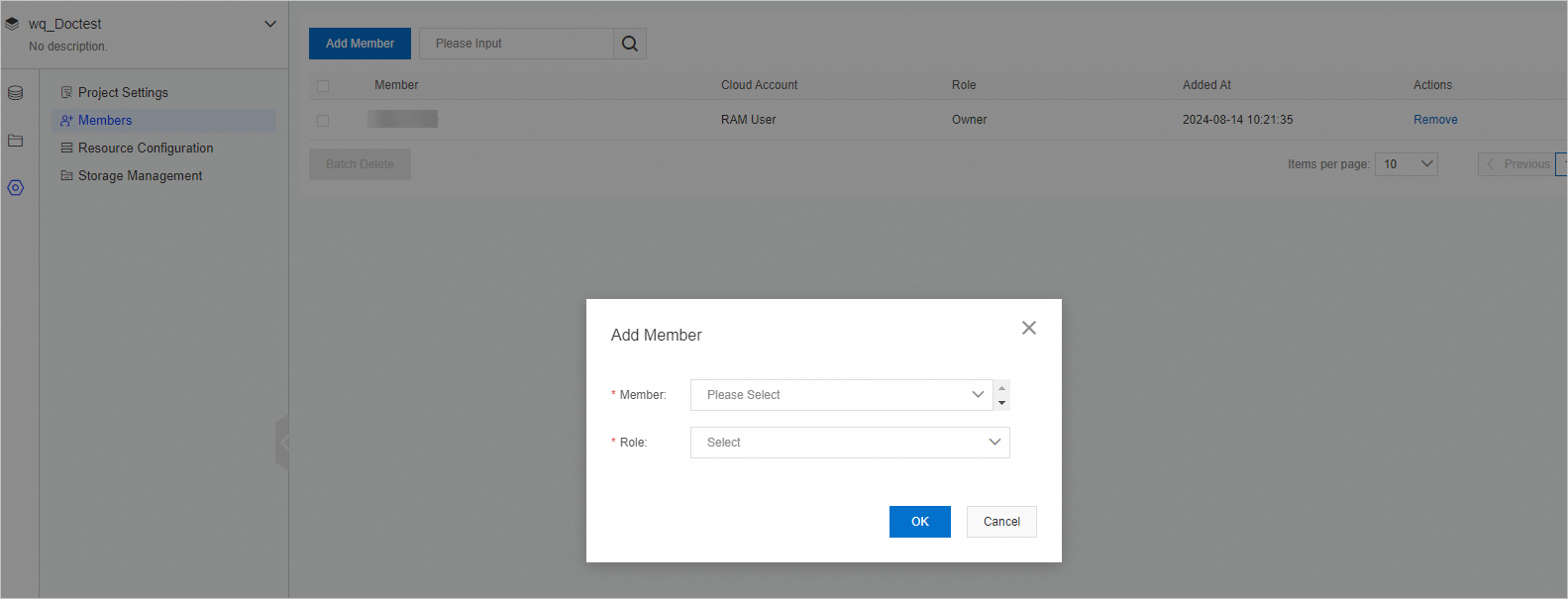

ステップ 2: ワークスペースメンバーの追加 (オプション)

単独で作業している場合は、このステップをスキップしてください。

複数のユーザーがアクセスする必要がある場合は、各ユーザーにロールを割り当てます。ロールを割り当てる前に、ユーザーを DMS に追加する必要があります。詳細については、「ユーザーの管理」をご参照ください。

ステップ 3: コードストレージ用の OSS バケットの構成

ワークスペースで、

タブの [ストレージ管理] をクリックします。

タブの [ストレージ管理] をクリックします。「コード保存領域」の横にある

アイコンをクリックします。

アイコンをクリックします。[OSS ディレクトリの選択] ダイアログボックスで、バケットを選択します。バケットは、ワークスペースと同じリージョンにあり、標準ストレージクラスを使用している必要があります。

[OK] をクリックします。

ステップ 4: 計算リソースの追加

ノートブックを使用してデータをクエリおよび分析する前に、計算リソースを追加して開始します。

すべてのノートブックカーネルが終了し、最大アイドル期間が経過すると、リソースは自動的にリリースされます。不要なコストを回避するために、ワークロードに基づいてリソースのサイズを決定してください。

「

」タブで、[リソース構成] をクリックします。

」タブで、[リソース構成] をクリックします。[リソースの追加] をクリックし、以下のパラメーターを設定します。

[パラメーター] [説明] Resource Name リソースの名前。 Resource Introduction リソースの説明。 Image 実行環境。オプション: Spark 3.5+Python 3.9、Spark 3.3+Python 3.9、Python 3.9。分散処理が必要な場合は Spark イメージを選択し、軽量データ探索には Python 3.9 を選択します。 AnalyticDB Instance 使用する AnalyticDB for MySQL クラスター。[Image] が Spark 3.3 または Spark 3.5 に設定されている場合に必要です。 AnalyticDB Resource Group AnalyticDB for MySQL クラスター内のリソースグループ。 Executor Spec 各 Spark エグゼキュータのリソース仕様。詳細については、「Spark アプリケーション構成パラメーター」の [タイプ] 列をご参照ください。 Executor Count Spark エグゼキュータの数。パブリックプレビュー期間中、ノートブックあたりの最大数は 6 エグゼキュータです。それ以上必要な場合は、DMS テクニカルサポートにお問い合わせください。 Driver Specifications Spark ドライバーのリソース仕様。有効な値: General_XSmall_v1 (2 CPU コア、8 GB メモリ)、General_Small_v1 (4 CPU コア、16 GB メモリ)、General_Medium_v1 (8 CPU コア、32 GB メモリ)、General_Large_v1 (16 CPU コア、64 GB メモリ)。軽量ワークロードの場合は General_XSmall_v1 で十分です。大規模 Spark ジョブの場合は、General_Medium_v1 以上を検討してください。 NotebookQuantity Python 3.9 ノートブックのコンピューティング仕様。[イメージ] が Python 3.9 に設定されている場合にのみ表示されます。ドライバー仕様 と同じ有効な値です。 VPC ID リソースが実行される VPC。 Zone ID VPC のゾーン。 vSwitch ID VPC 内の vSwitch。 Security Group ID リソースのセキュリティグループ。 「[保存]」をクリックします。

リストからリソースを見つけ、[開始] を [操作] 列でクリックし、次に [OK] をクリックします。リソースは約 1 分後に [実行中] 状態になります。

ステップ 5: ユーザーデータ用の OSS バケットの構成 (オプション)

DMS 内のデータにのみアクセスする必要がある場合は、このステップをスキップしてください。

ノートブックで外部の OSS バケットからデータを読み取るには、[User Storage Space] エリアで 1 つ以上の OSS パスを設定してください。

ワークスペースで、

タブの [ストレージ管理] をクリックします。

タブの [ストレージ管理] をクリックします。[ユーザーストレージ領域] エリアで、OSS パスを設定します。

説明マウントパスは

/mnt/で始まる必要があります。

アイコンをクリックしてパスを保存します。

アイコンをクリックしてパスを保存します。

ステップ 6: データの表示

ワークスペースで、

タブをクリックして SQL コンソールを開きます。

タブをクリックして SQL コンソールを開きます。SQL コンソールを使用してデータをクエリし、テーブル定義を探索します。

データのクエリ: SQL ステートメントを直接入力するか、Copilot を使用して生成します。SQL 構文は論理データウェアハウス標準に準拠しており、複数のデータベース (AnalyticDB for MySQL や ApsaraDB RDS for MySQL など) で MySQL 構文をサポートしています。DMS はステートメントを自動的に変換および最適化します。Copilot を使用すると、データベース、テーブル、および列のメタデータに基づいて SQL が生成されます。生成された結果が不正確な場合は、Copilot が使用する知識を編集して将来の精度を向上させることができます。また、正確な結果に「いいね」を付けて、時間の経過とともに品質をさらに向上させることもできます。

テーブルの使用メモを表示する: データベースをクリックして展開し、その後テーブル名をダブルクリックしてテーブルの詳細ページを開きます。[使用メモ] タブでテーブルの説明を表示または編集できます。

リソースの管理

「[リソース構成]」ページでは、いつでもリソースを管理できます。このページへの移動方法の詳細については、「手順 4: 計算リソースを追加する」をご参照ください。

| [操作] | [説明] |

|---|---|

| Stop | 実行中のリソースを手動で停止します。 |

| Edit | リソース構成を編集します。リソースを編集する前に停止する必要があります。 |

| Start | 停止したリソースを手動で開始します。 |

| Auto-release | すべてのノートブックカーネルが終了し、最大アイドル期間が経過すると、リソースは自動的にリリースされます。 |

| View Spark jobs | [操作] 列の [SparkUI] をクリックして History Server ページを開き、アプリケーション ID をクリックして Spark ジョブを表示します。SparkUI は、デフォルトリソースが使用され、リソースに Spark イメージが含まれている場合にのみ利用できます。 |