ログデータをリアルタイムでクエリおよび分析することで、ネットワークアクティビティを把握し、トラフィックの異常を特定できます。これにより、セキュリティ監視が強化され、セキュリティイベントへの応答効率が向上します。このトピックでは、ログ分析のためのクエリ文と分析文の使用方法、および結果の解釈方法について説明します。

前提条件

アセットからのトラフィックが収集されていることを確認してください。詳細については、「アクセス管理」をご参照ください。

ログ配信の有効化

-

Agentic NDR コンソールにログインします。

-

ナビゲーションウィンドウで、Logs を選択します。

-

Log Analysis ページの右上隅にある Log Settings をクリックします。

-

Log Settings パネルの Log Delivery タブで、[基本設定] を表示し、Log Delivery を有効にします。

-

[基本設定]:Region for Log Delivery と [ログ保持期間] を表示します。Region for Log Delivery と [ログ保持期間] を変更するには、Cloud Firewall コンソールに移動します。詳細については、「ログストレージ設定の変更」をご参照ください。

-

Log Delivery: Alert Logs および Protocol Log の両方を有効にする必要があります。

-

フィルター ルールと配信フィールドの設定

-

Log Analysis ページの右上隅にある Log Settings をクリックします。

-

[カスタムフィルター ルール] タブと [カスタム配信フィールド] タブで設定を行います。

-

[カスタムフィルター ルール]

-

フィルター ルールの作成

-

[カスタムフィルター ルール] タブで、[ルールの作成] をクリックします。

-

[プロトコルログフィルター ルール] パネルで、Filter Logic と Stream Information を設定し、OK をクリックします。

重要複数のログフィルター ルールを使用する場合は、次の点にご注意ください:

-

ホワイトリストまたはブラックリスト内の複数のルールは、

ORロジックで結合されます。 -

ブラックリストのルールは、ホワイトリストのルールよりも優先度が高くなります。競合が発生した場合は、ブラックリストのルールが適用されます。

-

-

-

フィルター ルールの編集

-

対象のフィルター ルールの [操作] 列で、Edit をクリックします。

-

[プロトコルログフィルター ルール] パネルでフィルター ルールを変更し、OK をクリックします。

-

-

フィルター ルールの削除

-

対象のフィルター ルールの Actions 列で、Delete をクリックします。

-

警告メッセージを確認し、OK をクリックします。

重要フィルター ルールを削除すると、以前そのルールに一致していたログはフィルターされなくなります。

-

-

-

[カスタム配信フィールド]

[カスタム配信フィールド] タブで、配信するフィールドを選択し、OK をクリックします。

-

ログのクエリ

-

ナビゲーションウィンドウで、Logs を選択します。

デフォルトでは、[ログ分析] ページを開くと、デフォルトのクエリが自動的に実行され、その結果が表示されます。

-

検索ボックスに、クエリ文と分析文を入力します。

-

クエリ文を使用すると、ログデータを表示、検索、フィルターできます。時間範囲、リクエストタイプ、キーワードなどの特定の条件を持つクエリ文を使用して、データをフィルターできます。クエリ文は単独で使用できます。構文の詳細については、「クエリ構文と機能」をご参照ください。

-

分析文は、ログデータのフィルター、変換、カウント、集計に使用されます。たとえば、特定の期間のデータの平均値を計算したり、前年比 (YoY) や前月比 (MoM) の結果を取得したりするために使用できます。分析文は、

クエリ文|分析文の形式でクエリ文と組み合わせて使用する必要があります。構文の詳細については、「集計関数」をご参照ください。 -

検索ボックスの右側にある

アイコンをクリックして、対話型クエリ分析モードに切り替えます。Data Explorer を使用すると、SQL コードを記述することなく、クエリと分析文を迅速かつ簡単に構築できます。詳細については、「高パフォーマンスかつ完全な精度のクエリと分析 (専用 SQL 版)」をご参照ください。

アイコンをクリックして、対話型クエリ分析モードに切り替えます。Data Explorer を使用すると、SQL コードを記述することなく、クエリと分析文を迅速かつ簡単に構築できます。詳細については、「高パフォーマンスかつ完全な精度のクエリと分析 (専用 SQL 版)」をご参照ください。

文

一般的なクエリ文

-

-

[クエリ/分析] をクリックしてクエリを実行し、結果を表示します。詳細については、「クエリと分析結果の表示」をご参照ください。

クエリ結果の分析

ヒストグラムや生ログなどのモジュールで、ログのクエリと分析の結果を表示できます。

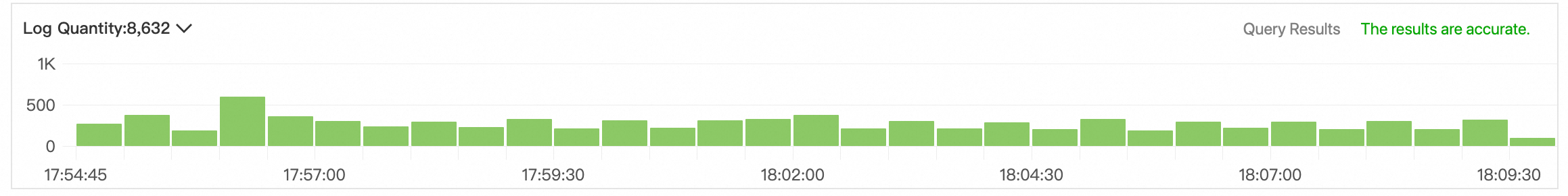

ヒストグラム

ヒストグラムには、ログの時間的な分布が表示されます。

-

緑色のバーにカーソルを合わせると、対応する時間範囲とログのヒット数が表示されます。

-

緑色のバーをダブルクリックすると、より細かい時間の粒度でログの分布が表示されます。[生ログ] タブが更新され、指定した時間範囲のクエリ結果が表示されます。

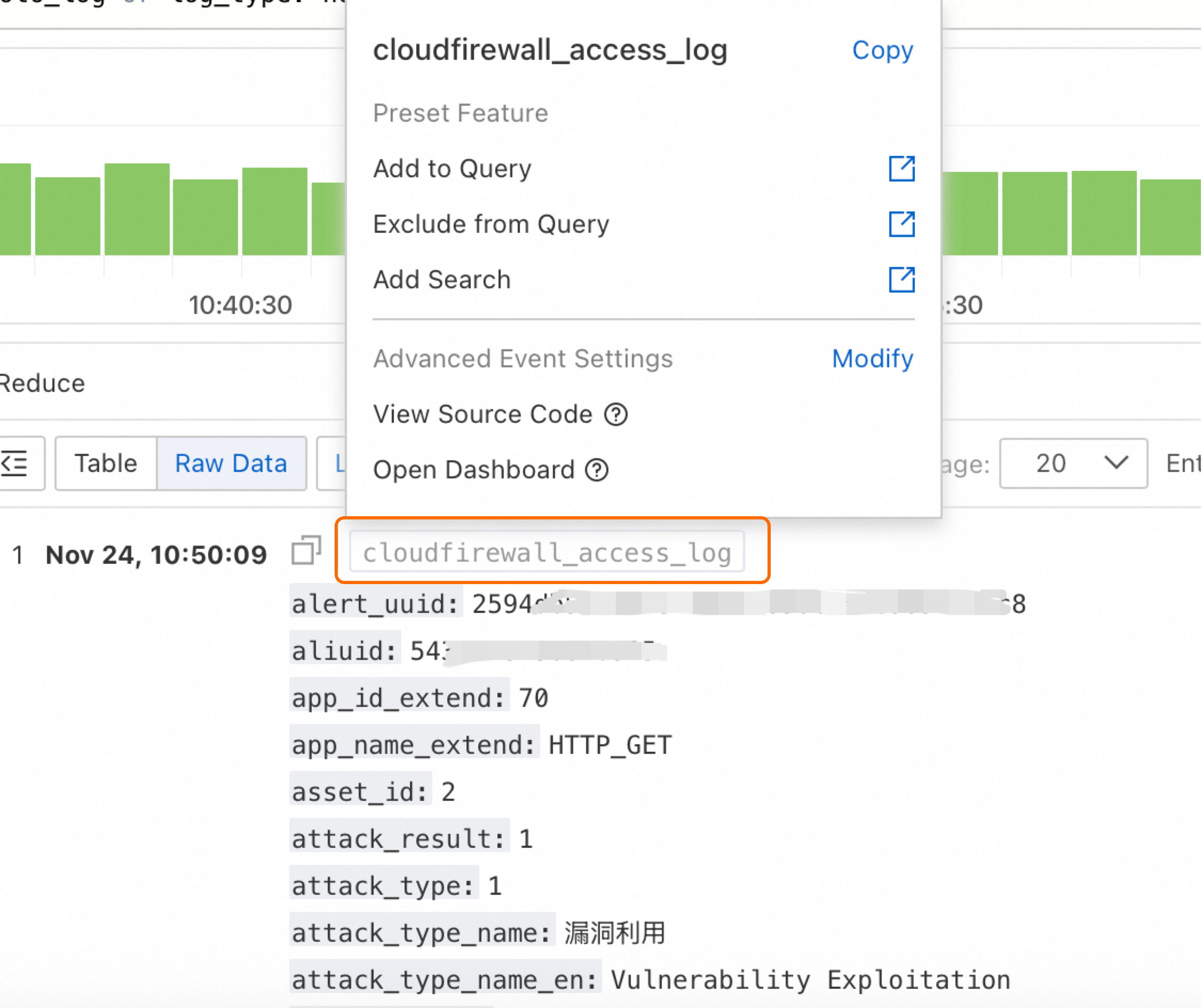

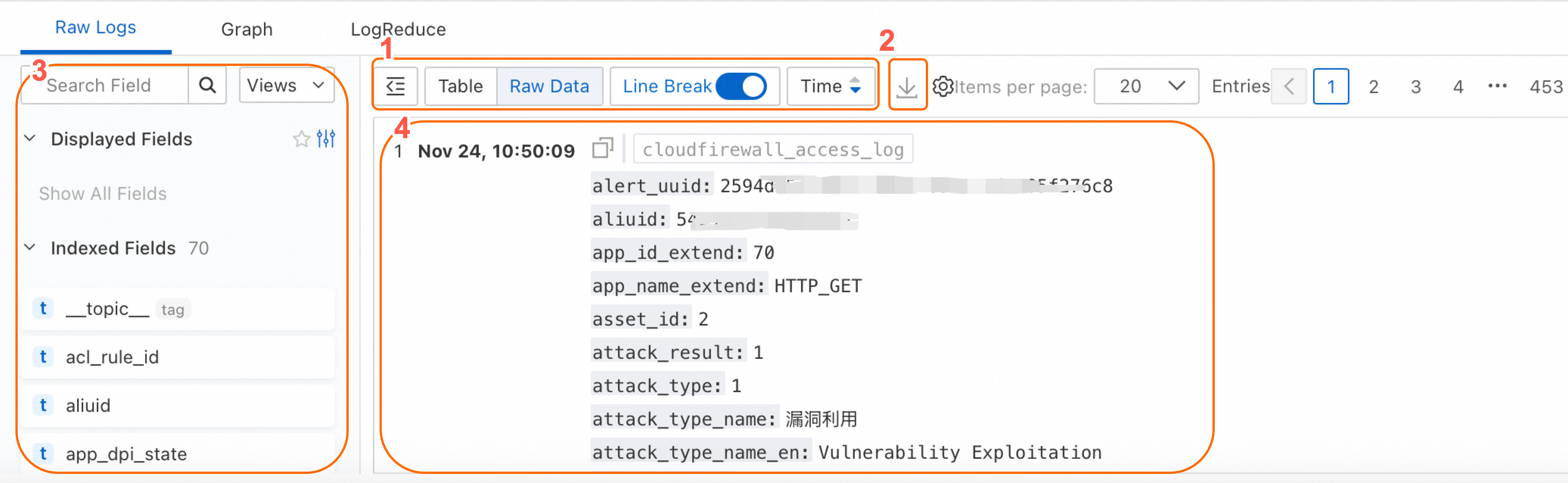

生ログ

[生ログ] タブには、クエリと分析の結果が表示されます。結果は生フォーマットまたはテーブルフォーマットで表示できます。

|

番号 |

説明 |

|

① |

ログの表示形式、ソート順、その他の設定を切り替えます。 |

|

② |

|

|

③ |

[表示フィールド]、[インデックス付きフィールド]、およびシステムフィールドを表示します。

|

|

④ |

関連トピック

-

ログフィールドの詳細な説明については、「ログフィールド」をご参照ください。

-

ログのクエリと分析の結果をローカルマシンにエクスポートして保存できます。詳細については、「ログのエクスポート」をご参照ください。

-

大量のログがあり、長期保存が必要な場合は、ログを OSS バケットに転送して保存および分析できます。詳細については、「OSS 転送タスクの作成 (新規)」をご参照ください。