このトピックでは、自然言語会話コンポーネントの設定詳細について説明します。このコンポーネントは、大規模言語モデル (LLM) と対話するユーザーからのモバイル発信メッセージ (ユーザー入力) を受信および処理します。このコンポーネントを設定することで、各ユーザー入力が送信された順序でLLMに正確に配信されるようにします。LLMは、コンテキスト情報を使用して一貫性のある応答を生成し、マルチターン対話の継続性と完全性を保証します。

コンポーネント情報

コンポーネントアイコン | コンポーネント名 |

| Natural Language Conversation |

前提条件

既存のフローのキャンバスページに移動するか、新しいフローを作成します。

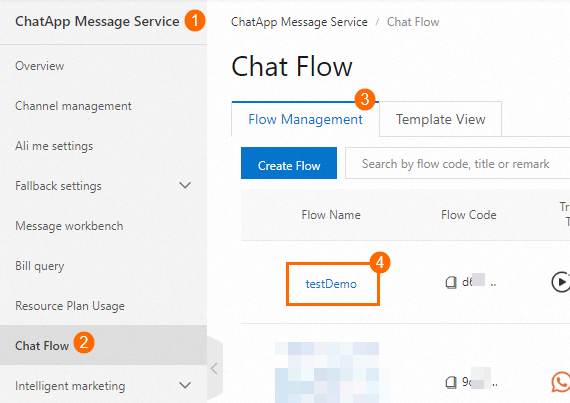

既存のフローのキャンバスページに移動します。

タブで、編集するフローの Flow Name をクリックして、フローオーケストレーションページに移動します。

新しいフローを作成してキャンバスページに移動します。詳細については、「フローの作成」をご参照ください。

操作手順

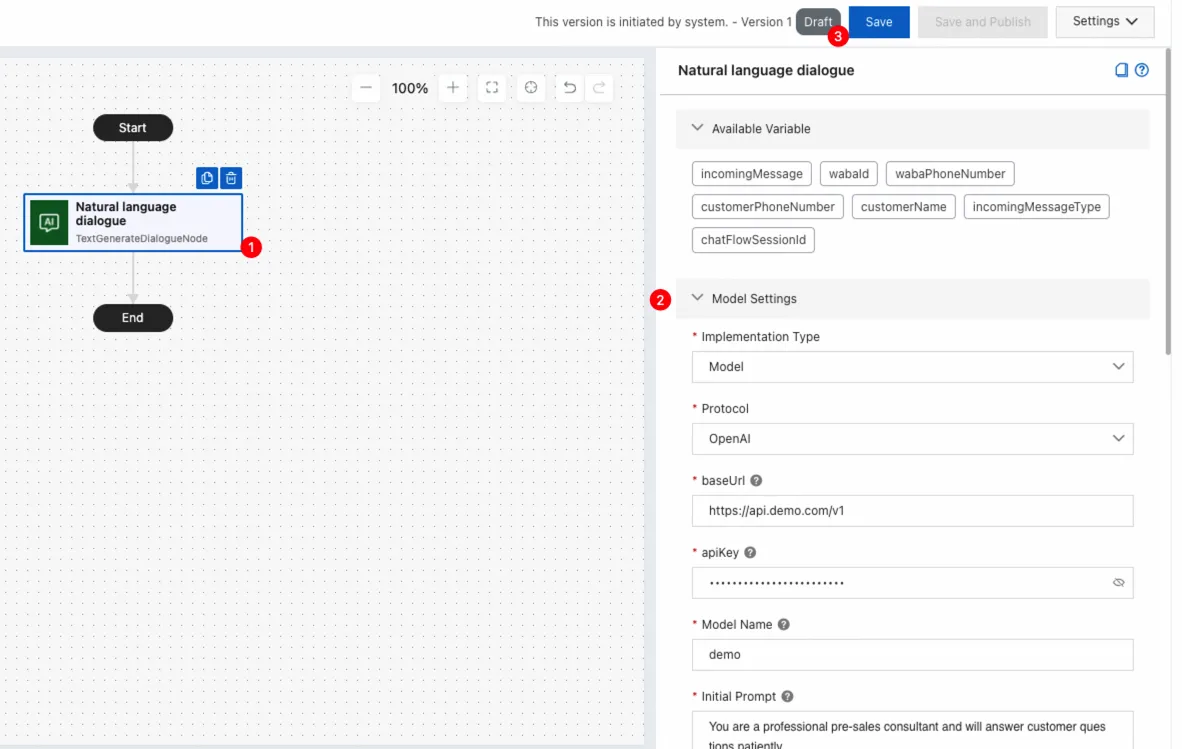

キャンバス上の [Natural Language Conversation] コンポーネントアイコンをクリックすると、右側にコンポーネント設定エリアが表示されます。

必要に応じてコンポーネントデータを設定します。詳細な設定手順については、「設定項目説明」をご参照ください。

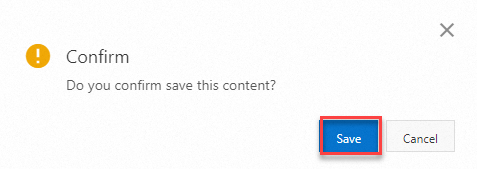

構成後、Save をクリックします。表示されるダイアログボックスで、Save をクリックします。

設定項目説明

1. モデル設定

[Implementation Type] を [Model] または [Application] に設定できます。各タイプの設定項目は異なり、以下で説明します。

実装タイプ - モデル

設定項目 | 説明 |

Protocol | 実装タイプがモデルの場合、現在ベンダーとしてOpenAIのみがサポートされています。 |

baseUrl | モデルサービスのネットワークアクセスポイントです。例: "https://api.openai.com/v1" またはその他のOpenAI互換のアクセスポイント。 |

apiKey | モデルサービスのキーです。 |

Model Name | 使用するモデルの名前です。例: "gpt-3.5-turbo" または "qwen-plus"。 |

Initial Prompt | モデルセッションの初期プロンプト入力です。これにより、モデルの出力がガイドされます。例: "あなたは機知に富んだコメディアンです。今後のQ&Aではユーモラスな言葉を使用してください。" |

Model Input | モデル会話の現在のラウンドの入力です。テキスト内で複数の変数を直接参照または埋め込むことができます。例: "{{incomingMessage}}" または "Please help me find information about {{topic}}." |

Model Output Variable Name | モデル会話の現在のラウンドの出力の変数名です。後続のワークフローで再利用し、メッセージ応答コンテンツとして使用します。 |

Fallback Text | モデルサービスが利用できない場合、このコンテンツが出力として使用されます。例: "申し訳ありませんが、現在ご質問にお答えできません。" |

実装タイプ - アプリケーション

設定項目 | 説明 |

Protocol | 実装タイプが Application の場合、現在ベンダーとして Dashscope のみがサポートされています。 説明 アプリケーションの詳細については、「アプリケーション開発」をご参照ください。 |

apiKey | アプリケーションサービスのキーです。 説明 詳細については、「API キーの取得」をご参照ください。 |

workspaceId | エージェント、ワークフロー、またはエージェントオーケストレーションアプリケーションが存在するワークスペースの ID です。サブワークスペース内のアプリケーションを呼び出す際には、この ID を渡してください。デフォルトのワークスペース内のアプリケーションを呼び出す際には、渡さないでください。 説明 ワークスペースについては、ワークスペースの権限管理をご参照ください。 |

appId | アプリケーションIDです。 |

Application Input | 現在のアプリケーション会話ラウンドの入力です。テキスト内に複数の変数を直接リファレンスまたは埋め込むことができます。例:「{{incomingMessage}}」や「{{topic}} に関する情報を検索してください。」 |

Custom Pass-through Parameters | カスタムパラメーターを渡します。例: {"city": "Hangzhou"} |

Application Output Variable Name | アプリケーション会話の現在のラウンドの出力の変数名です。後続のワークフローで再利用し、メッセージ応答コンテンツとして使用します。 |

Fallback Text | アプリケーションサービスが利用できない場合、このコンテンツが出力として使用されます。例: "申し訳ありませんが、現在ご質問にお答えできません。" |

2. リクエストヘッダー構成

モデル設定の Implementation Type が Application の場合、リクエストヘッダー構成は サポートされていません。

構成項目 | 説明 |

リクエストヘッダー構成 | HTTP リクエストヘッダーを設定します。次の情報を入力します。

|

3. メッセージ設定

大規模言語モデルが応答を生成した後のメッセージ配信を設定します。

設定項目 | 説明 |

Channel | メッセージを送信するためのチャンネルです。 説明 現在、WhatsApp チャンネルのみがサポートされています。 |

WhatsApp 入力ステータスの有効化 | 現在のセッションに入力中ステータスを表示して、ユーザーへの応答を準備中であることを示します。 |

Action | メッセージ操作です。現在、返信のみがサポートされています。これは、ユーザーからのメッセージに返信することを意味します。 |

Message Type | 送信するメッセージのタイプです。現在、プレーンテキストの返信のみがサポートされています。 |

4. タイムアウト設定

設定項目 | 説明 |

Waiting Time | ユーザーからのメッセージを待機するタイムアウト期間です。設定された時間を超過すると、現在のマルチターン対話は自動的に終了します。現在、セッションを終了するにはタイムアウトの設定のみが可能で、能動的に終了することはできません。 |

自然言語対話コンポーネントと自然言語生成コンポーネントの違い

どちらも大規模言語モデル (LLM) を利用して、インテリジェントなコンテンツ生成と応答を行う AI コンポーネントです。これらのコンポーネントは、ユーザーからのメッセージ処理を自動化し、インテリジェントな応答を提供することを目的としています。ただし、メッセージ処理のメカニズムと適用シナリオには、以下のような主な違いがあります:

自然言語対話コンポーネントは、複数ターンにわたる継続的な対話向けに設計されています。ユーザーがメッセージを送信すると、コンポーネントはそれを LLM に送信して応答を生成します。モデルが処理中にユーザーが新しいメッセージを送信した場合、これらのメッセージは破棄されず、内部キューに一時的に保存されます。モデルが現在の応答を完了した後、キュー内の後続メッセージが順番にモデルに送信され、対話コンテキストの継続性と完全性が保証されます。

自然言語生成コンポーネントは、単一ターンでコンテキストに依存しないコンテンツ生成シナリオに適しています。フローで設定された変数 (ユーザー入力、システムパラメーターなど) を入力として LLM に渡します。モデルは一度限りの応答を生成し、その結果は後続の利用や配信のためにビジネスフローに戻されます。このコンポーネントは最新のユーザーからのメッセージのみを処理し、その間に受信した新しいメッセージをキューに入れたり、処理を遅延させたりすることはありません。

項目 |

|

|

コンポーネント機能 | お客様がフローで設定した変数を LLM に渡します。応答を生成した後、LLM はそれをコンポーネントに返し、後続のノードで配信または利用されます。 |

|

メッセージ処理の範囲 | モデルが応答した後、最新のユーザーからのメッセージのみを処理します。 | 最初のメッセージを処理し、最初の応答の後、応答期間中に受信したキュー内のすべてのメッセージを継続して処理します。 |

応答中の新規メッセージ | 無視 (それ以上処理されない) | キューに追加 (キューに入り、後続のバッチ処理を待機) |

インタラクション形式 | 単一生成、固定されたフローのリズム | 継続的な対話、連続的なユーザー入力を処理 |

エクスペリエンスの特徴 | より安定的で、より制御可能。 ユーザーによる割り込みは現在の生成に影響しません。 | より人間らしい対話に近い。 ユーザー入力の損失を最小限に抑えます。 |

典型的なユースケース | 説明、要約、書き換え、構造化情報の自然言語への変換。 | 継続的な Q&A、追加の質問、補足情報の処理、マルチターン対話。 |

シナリオ | フロー制御が強く、ステップが固定されており、複数ターンの「割り込みキューイング」を望まないフローベースのシナリオ:

| ユーザーが頻繁に連続して発話し、すべてのメッセージを処理する必要がある対話ベースのシナリオ:

|