Panduan ini menjelaskan cara meningkatkan efisiensi pengembangan melalui praktik seperti penggunaan ulang kode, pemasangan dataset, dan manajemen parameter. Panduan ini juga mencakup praktik terbaik serta teknik debugging untuk menghubungkan ke mesin komputasi, termasuk MaxCompute Spark, EMR Serverless Spark, dan AnalyticDB for Spark.

Baca Pengembangan Notebook Dasar sebelum melanjutkan.

Lingkungan pengembangan vs. produksi

DataWorks Notebook dirancang sebagai tool pengembangan dan analisis yang dapat dijadwalkan untuk eksekusi. Tool ini beroperasi dalam dua lingkungan berbeda:

Lingkungan pengembangan: Kode dijalankan dalam instans lingkungan pengembangan pribadi, yang dirancang untuk memvalidasi dan mendebug kode secara cepat.

Lingkungan produksi: Dipicu oleh penjadwalan periodik atau pengisian ulang data, kode dijalankan dalam instans tugas yang terisolasi dan sementara, guna memastikan eksekusi yang stabil dan andal.

Kedua lingkungan tersebut berbeda dalam perilaku fitur-fitur utamanya:

| Fitur | Lingkungan pengembangan | Lingkungan produksi |

|---|---|---|

| Referensi resource proyek (file .py) | Referensi awal: Diunduh secara otomatis dan langsung berlaku. Setelah pembaruan: Klik Restart di bilah alat untuk memuat ulang modul .py yang telah diperbarui. Atur Dataworks › Notebook › Resource Reference: Download Strategy ke autoOverwrite di pengaturan DataStudio. | Langsung berlaku secara otomatis. |

| Baca/Tulis dataset (OSS/NAS) | Pasang dataset di lingkungan pengembangan pribadi. | Pasang dataset di scheduling configurations. |

| Referensi parameter ruang kerja (${...}) | Substitusi teks terjadi secara otomatis sebelum eksekusi kode. | Substitusi teks terjadi secara otomatis sebelum eksekusi tugas. |

| Manajemen Sesi Spark | Timeout idle default: dua jam. Session akan dilepas secara otomatis jika tidak ada kode baru yang dijalankan dalam periode tersebut. | Session berumur pendek pada level instans tugas—dibuat dan dihapus secara otomatis bersama instans tugas. |

Gunakan ulang kode dan data

Pilih metode penggunaan ulang kode

DataWorks Notebook mendukung beberapa cara untuk menggunakan ulang kode dan berbagi data lintas tugas. Gunakan tabel berikut untuk memilih pendekatan yang tepat:

| Metode | Gunakan saat | Catatan |

|---|---|---|

| Resource proyek (file .py) | Berbagi fungsi utilitas Python lintas tugas Notebook (direkomendasikan) | Dipublikasikan ke MaxCompute Resource Management; tersedia di lingkungan pengembangan maupun produksi. |

| Dataset (OSS/NAS) | Membaca atau menulis file besar selama eksekusi tugas | Dipasang secara terpisah untuk lingkungan pengembangan dan produksi. |

| Workspace Parameters | Berbagi nilai konfigurasi global lintas tugas | Tersedia di DataWorks Edisi Profesional dan versi lebih tinggi. Harus dibuat di Pusat Operasi. |

Referensi resource proyek

Enkapsulasi fungsi atau kelas umum ke dalam file .py dan referensikan sebagai resource MaxCompute menggunakan ##@resource_reference{"custom_name.py"}. Pendekatan ini memodularisasi kode, meningkatkan kemampuan penggunaan ulang, dan menyederhanakan pemeliharaan.

Buat dan publikasikan resource Python

Di panel navigasi kiri DataWorks DataStudio, klik

untuk membuka Resource Management.

untuk membuka Resource Management.Klik kanan direktori target atau klik ikon + di pojok kanan atas. Pilih Create Resource > MaxCompute Python, lalu beri nama file

my_utils.py.Di bagian File Content, klik Edit Online, tempel kode fungsi utilitas Anda, lalu klik Save.

# my_utils.py def greet(name): return f"Hello, {name} from resource file!"Klik Save, lalu Publish di bilah alat. Resource tersebut menjadi tersedia untuk tugas pengembangan maupun produksi.

Referensi resource di Notebook

Di baris pertama sel Python, gunakan ##@resource_reference untuk mereferensikan resource yang telah dipublikasikan:

##@resource_reference{"my_utils.py"}

# Jika resource berada di subdirektori (misalnya, my_folder/my_utils.py),

# referensikan tanpa nama direktori: ##@resource_reference{"my_utils.py"}

from my_utils import greet

message = greet('DataWorks')

print(message)Debug di lingkungan pengembangan

Jalankan sel Python tersebut. Output-nya adalah:

Hello, DataWorks from resource file!Di lingkungan pengembangan, sistem mendeteksi deklarasi ##@resource_reference dan secara otomatis mengunduh file tersebut ke workspace/_dataworks/resource_references di direktori pribadi Anda. Jika terjadi ModuleNotFoundError, klik Restart di bilah alat editor untuk memuat ulang resource.

Publikasikan ke lingkungan produksi

Setelah menyimpan dan mempublikasikan node Notebook, buka Operation Center > Recurring Tasks lalu klik Test. Setelah tugas berhasil, output Hello, DataWorks from resource file! muncul di log.

Jika muncul error There is no file with id ..., publikasikan terlebih dahulu resource Python ke lingkungan produksi.

Untuk informasi lebih lanjut, lihat Resource dan fungsi MaxCompute.

Baca dan tulis dataset

Tugas Notebook dapat membaca dari dan menulis ke file besar yang disimpan di OSS atau NAS selama eksekusi.

Debug di lingkungan pengembangan

Pasang dataset: Di halaman detail lingkungan pengembangan pribadi Anda, konfigurasikan dataset di bawah Storage Configuration > Dataset.

Akses dalam kode: Dataset dipasang ke path di lingkungan pengembangan pribadi. Baca atau tulis langsung ke path tersebut:

# Asumsikan dataset dipasang ke /mnt/data/dataset. import pandas as pd file_path = '/mnt/data/dataset/testfile.csv' df = pd.read_csv(file_path) # Tulis data ke MaxCompute menggunakan PyODPS. o = %odps o.write_table('mc_test_table', df, overwrite=True) print(f"Data berhasil ditulis ke tabel MaxCompute mc_test_table.")

Deploy ke produksi

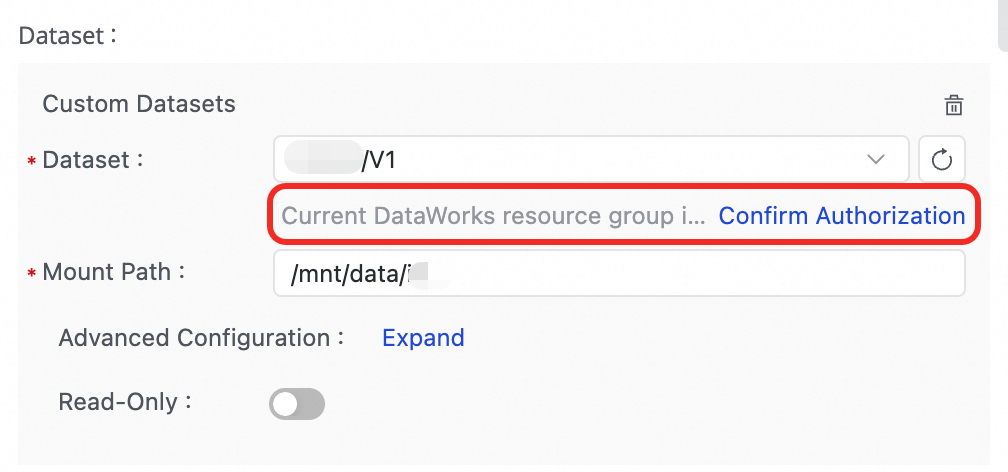

Pasang dataset: Di halaman pengeditan node Notebook, tambahkan dataset di bawah scheduling configurations > scheduling policy di panel navigasi kanan.

Akses dalam kode: Setelah melakukan commit dan mempublikasikan node, dataset dipasang ke path di lingkungan produksi. Gunakan path yang sama dalam kode Anda:

# Asumsikan dataset dipasang ke /mnt/data/dataset. import pandas as pd file_path = '/mnt/data/dataset/testfile.csv' df = pd.read_csv(file_path) # Tulis data ke MaxCompute menggunakan PyODPS. o = %odps o.write_table('mc_test_table', df, overwrite=True) print(f"Data berhasil ditulis ke tabel MaxCompute mc_test_table.")

Untuk informasi lebih lanjut, lihat Gunakan dataset di lingkungan pengembangan pribadi.

Referensi parameter ruang kerja

Fitur ini hanya tersedia di DataWorks Edisi Profesional dan versi lebih tinggi.

Parameter ruang kerja memungkinkan Anda menggunakan ulang konfigurasi global dan mengisolasi lingkungan lintas tugas dan node. Referensikan parameter ruang kerja di sel SQL atau Python menggunakan format ${workspace.param}, di mana param adalah nama yang Anda tetapkan saat membuat parameter tersebut.

Buat parameter ruang kerja: Buka Operation Center > Scheduling Settings > Workspace Parameters lalu buat parameter tersebut.

Referensi parameter dalam kode: Di sel SQL:

SELECT '${workspace.param}';Di sel Python:

print('${workspace.param}')Setelah sel dijalankan, nilai parameter ruang kerja yang telah diselesaikan akan dicetak.

Untuk informasi lebih lanjut, lihat Gunakan parameter ruang kerja.

Berinteraksi dengan mesin komputasi menggunakan perintah magic

Perintah magic adalah perintah khusus yang diawali dengan % atau %% yang menyederhanakan interaksi antara sel Python dan berbagai resource komputasi.

Satu node Notebook hanya dapat terhubung ke satu jenis resource komputasi menggunakan perintah magic.

Hubungkan ke MaxCompute

Bind a MaxCompute compute resource sebelum membuat koneksi.

%odps — Dapatkan objek entri PyODPS

Mengembalikan objek PyODPS terautentikasi yang terikat ke proyek MaxCompute saat ini. Ini menghindari hard-coding AccessKey dalam kode Anda.

o = %odpsSetelah menjalankan perintah, pemilih resource komputasi muncul di pojok kanan bawah dengan proyek yang dipilih secara otomatis. Klik nama proyek untuk mengganti proyek.

Gunakan objek tersebut untuk menjalankan skrip PyODPS. Misalnya, untuk menampilkan semua tabel di proyek saat ini:

with o.execute_sql('show tables').open_reader() as reader:

print(reader.raw)%maxframe — Buat koneksi MaxFrame

Membuat session MaxFrame untuk pemrosesan data terdistribusi bergaya pandas pada data MaxCompute.

# Hubungkan ke MaxCompute menggunakan MaxFrame.

mf_session = %maxframe

df = mf_session.read_odps_table('your_mc_table')

print(df.head())

# Hancurkan session secara manual untuk melepas resource setelah debugging.

mf_session.destroy()Hubungkan ke resource Spark

DataWorks Notebook mendukung koneksi ke beberapa mesin Spark. Mesin-mesin ini berbeda dalam metode koneksi, konteks eksekusi, dan manajemen resource.

Perbandingan mesin

| Fitur | MaxCompute Spark | EMR Serverless Spark | AnalyticDB for Spark |

|---|---|---|---|

| Perintah koneksi | %maxcompute_spark | %emr_serverless_spark | %adb_spark add |

| Prasyarat | Bind resource MaxCompute | Bind resource komputasi EMR dan buat Livy Gateway | Bind resource komputasi ADB Spark |

| Lingkungan pengembangan | Secara otomatis membuat atau menggunakan kembali session Livy | Terhubung ke Livy Gateway yang sudah ada untuk membuat session | Secara otomatis membuat atau menggunakan kembali Spark Connect Server |

| Lingkungan produksi | Mode Livy: mengirimkan pekerjaan Spark melalui layanan Livy | spark-submit mode pemrosesan batch: batch murni, tanpa retensi status session | Spark Connect Server mode: berinteraksi melalui layanan koneksi Spark |

| Pelepasan resource di lingkungan produksi | Session secara otomatis dilepas setelah instans tugas berakhir | Resource secara otomatis dibersihkan setelah instans tugas berakhir | Resource secara otomatis dilepas setelah instans tugas berakhir |

| Kasus penggunaan | Tugas pemrosesan batch dan ETL tujuan umum yang terintegrasi erat dengan ekosistem MaxCompute | Tugas analisis kompleks yang memerlukan konfigurasi fleksibel dan integrasi ekosistem open-source (misalnya, Hudi dan Iceberg) | Kueri interaktif berkinerja tinggi pada tabel C-Store |

Setelah terhubung ke mesin Spark, konteks eksekusi seluruh kernel Notebook beralih ke lingkungan PySpark remote. Tulis kode PySpark langsung di sel-sel berikutnya.

MaxCompute Spark

Bind a MaxCompute compute resource sebelum membuat koneksi.

Hubungkan melalui Livy ke mesin Spark yang tertanam di proyek MaxCompute Anda.

Buat koneksi: Jalankan perintah berikut di sel Python. Sistem secara otomatis membuat atau menggunakan ulang session Spark.

# Buat session Spark dan mulai Livy. %maxcompute_sparkEksekusi kode PySpark: Gunakan magic sel

%%sparkdi sel Python baru.# Sel Python yang menggunakan MaxCompute Spark harus dimulai dengan %%spark. %%spark df = spark.sql("SELECT * FROM your_mc_table LIMIT 10") df.show()Lepaskan koneksi: Setelah debugging, hentikan atau hapus session. Di lingkungan produksi, sistem secara otomatis menghentikan dan menghapus session Livy ketika instans tugas berakhir.

# Hentikan session Spark dan Livy. %maxcompute_spark stop # Hentikan Livy dan hapus. %maxcompute_spark delete

EMR Serverless Spark

Bind an EMR Serverless Spark compute resource ke ruang kerja Anda dan buat Livy Gateway sebelum membuat koneksi.

Berinteraksi dengan EMR Serverless Spark dengan menghubungkan ke Livy Gateway yang telah dibuat sebelumnya.

Buat koneksi: Pilih EMR compute resource dan Livy gateway di pojok kanan bawah sel, lalu jalankan salah satu perintah berikut:

Dipilih: konfigurasi global menggantikan parameter kustom session.

Tidak dipilih: parameter kustom session menggantikan konfigurasi global.

# Koneksi dasar %emr_serverless_sparkUntuk mengirimkan parameter Spark kustom, gunakan

%%emr_serverless_spark(dua tanda persen):%%emr_serverless_spark { "spark_conf": { "spark.emr.serverless.environmentId": "<EMR_Serverless_Spark_Runtime_Environment_ID>", "spark.emr.serverless.network.service.name": "<EMR_Serverless_Spark_Network_Connection_ID>", "spark.driver.cores": "1", "spark.driver.memory": "8g", "spark.executor.cores": "1", "spark.executor.memory": "2g", "spark.driver.maxResultSize": "32g" } }Parameter kustom hanya berlaku untuk session saat ini. Jika diabaikan, sistem menggunakan parameter global yang dikonfigurasi di Admin Center. Untuk berbagi konfigurasi lintas tugas dan pengguna, atur secara global di Admin Center > Serverless Spark > SPARK parameters. Opsi Prioritize Global Configurations di Admin Center mengontrol prioritas ketika parameter yang sama muncul di kedua tempat:

(Opsional) Sambung ulang: Jika administrator menghapus token di halaman Livy gateway, buat ulang dengan:

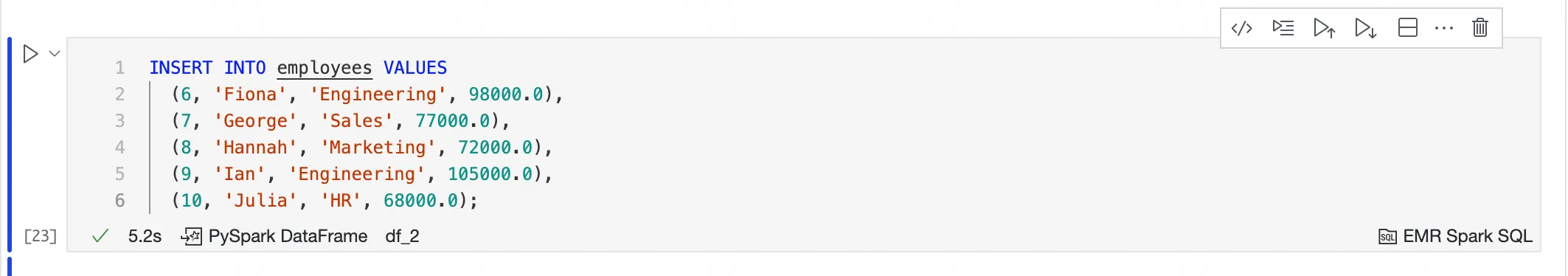

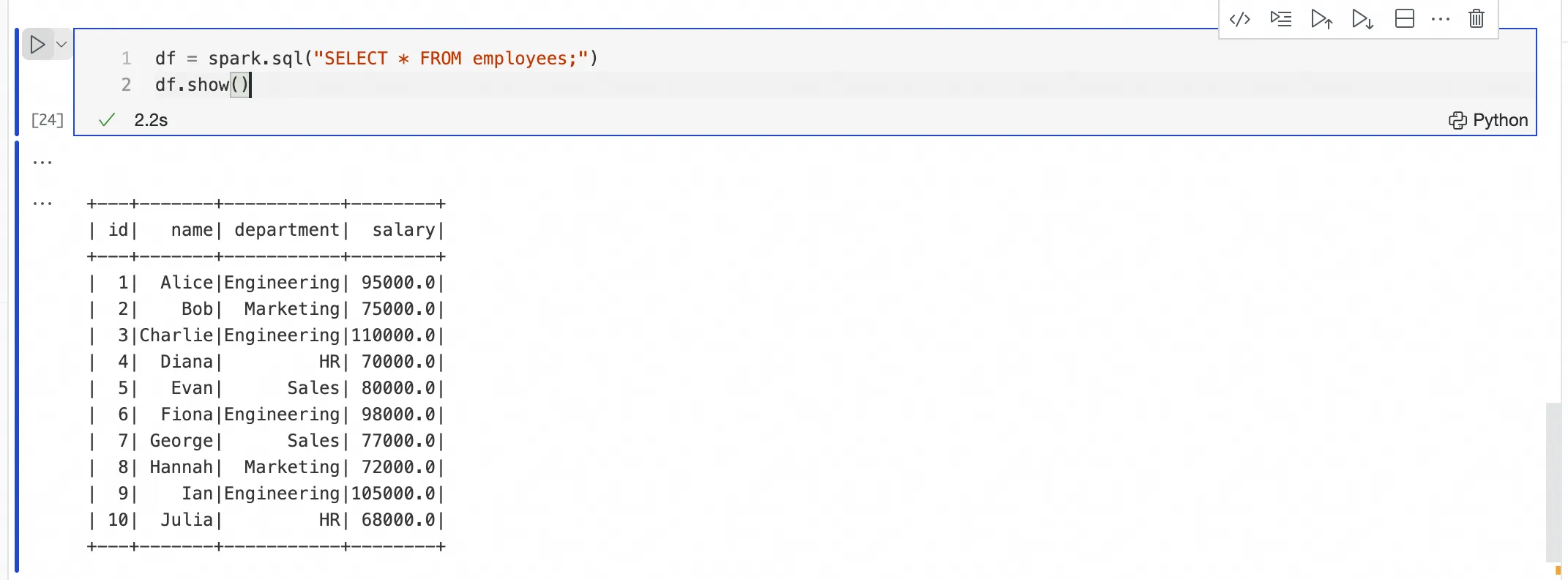

# Sambung ulang dan segarkan token Livy. %emr_serverless_spark refresh_tokenEksekusi kode PySpark atau SQL: Setelah koneksi berhasil, kernel beralih. Tulis kode PySpark langsung di sel Python, atau tulis SQL di sel EMR Spark SQL.

Kirim SQL ke EMR Serverless Spark menggunakan sel EMR Spark SQL — sel ini menggunakan ulang koneksi dari

%emr_serverless_sparkdan mengirimkan job secara otomatis. Tidak perlu memilih resource komputasi di dalam sel.

Kirim kode PySpark di sel Python — tidak perlu awalan

%%spark.

Lepaskan koneksi:

PentingJika beberapa pengguna berbagi Livy Gateway, perintah

stopataudeletememengaruhi semua pengguna yang sedang menggunakan gateway tersebut. Gunakan perintah ini dengan hati-hati.# Hentikan session Spark dan Livy. %emr_serverless_spark stop # Hentikan Livy dan hapus. %emr_serverless_spark delete

AnalyticDB for Spark

Bind an AnalyticDB for Spark compute resource ke ruang kerja Anda sebelum membuat koneksi.

Hubungkan ke mesin AnalyticDB for Spark dengan membuat Spark Connect Server.

Buat koneksi: Pilih ADB Spark compute resource di pojok kanan bawah sel. Konfigurasikan ID vSwitch dan ID Security Group untuk memastikan konektivitas jaringan, lalu jalankan:

ID vSwitch (vswitchId): Di konsol Alibaba Cloud AnalyticDB MySQL, lihat vSwitch ID di Network Information pada halaman detail instans.

ID Security Group (securityGroupId): Di Network Settings pada halaman detail lingkungan pengembangan pribadi Anda, temukan ID Security Group yang dipilih — ID tersebut diawali dengan

sg-.

PentingUntuk memastikan konektivitas jaringan, pilih Virtual Private Cloud (VPC) dan vSwitch yang sama dengan instans AnalyticDB for Spark Anda saat membuat lingkungan pengembangan pribadi.

# Konfigurasikan ID vSwitch dan ID Security Group untuk konektivitas jaringan. %adb_spark add --spark-conf spark.adb.version=3.5 --spark-conf spark.adb.eni.enabled=true --spark-conf spark.adb.eni.vswitchId=<vSwitch_ID_of_ADB> --spark-conf spark.adb.eni.securityGroupId=<Security_Group_ID_of_personal_development_environment>Cara menemukan ID vSwitch dan Security Group:

Eksekusi kode PySpark: Setelah koneksi terbentuk, jalankan PySpark di sel Python baru.

Mesin AnalyticDB for Spark hanya dapat memproses tabel C-Store yang memiliki atribut

'storagePolicy'='COLD'.# AnalyticDB for Spark hanya dapat memproses tabel C-Store. df = spark.sql("SELECT * FROM my_adb_cstore_table LIMIT 10") df.show()Lepaskan koneksi: Setelah debugging, bersihkan session koneksi untuk menghemat resource. Di produksi, sistem membersihkan secara otomatis.

%adb_spark cleanup

Hubungkan ke Lindorm Ray

Grup resource RAY dari mesin komputasi Lindorm menyediakan layanan komputasi terdistribusi yang mendukung beban kerja AI end-to-end. Hubungkan ke resource Lindorm Ray di Notebook untuk pengembangan interaktif, lalu publikasikan Notebook sebagai tugas penjadwalan produksi.

Buat koneksi

Jalankan %lindorm_ray di sel Python. Pemilih resource komputasi muncul di pojok kanan bawah — pilih Lindorm compute resource dan grup resource RAY yang telah dibuat.

# Hubungkan ke grup resource Lindorm Ray yang ditentukan.

%lindorm_raySetelah terhubung ke resource komputasi Lindorm Ray, sel SQL di Notebook yang sama tidak dapat dijalankan lagi. Lindorm Ray berfokus pada eksekusi kode Python dan Ray.

Menjalankan sel kode yang sama beberapa kali secara otomatis menghentikan job Ray sebelumnya dan memulai yang baru, mencegah pemborosan resource dan konflik tugas.

Eksekusi kode Ray

Setelah koneksi berhasil, tulis dan eksekusi kode Ray di sel Python baru. Log dialirkan kembali ke area output sel secara real time.

Contoh berikut mendefinisikan tugas remote menggunakan dekorator @ray.remote. Tugas tersebut dijalankan di kluster Ray, dan log serta hasilnya dikembalikan ke area output:

import ray

import time

@ray.remote

def hello_world():

print("Hello from Lindorm Ray!")

time.sleep(5)

return "Task finished."

# Kirim tugas remote.

result_ref = hello_world.remote()

print(ray.get(result_ref))Tentukan parameter startup kustom (opsional)

Untuk menginstal paket Python pihak ketiga atau mengunggah file kode lokal, gunakan %%lindorm_ray untuk membuat koneksi dengan konfigurasi lingkungan runtime kustom.

Contoh 1: Instal dependensi

Instal paket jieba di lingkungan Ray menggunakan parameter pip:

%%lindorm_ray

{

"runtime_env": {

"pip": ["jieba"]

}

}Setelah lingkungan siap, impor dan gunakan paket tersebut di tugas Ray berikutnya:

import ray

@ray.remote

def do_work(x):

import jieba

return "/".join(jieba.cut(x))

print(ray.get(do_work.remote("Welcome to the DataWorks+LindormRay solution")))Contoh 2: Unggah dan gunakan resource DataWorks

Gunakan parameter working_dir untuk mengunggah resource dari DataWorks Resource Management ke kluster Ray:

File yang diunggah melalui

working_dirberasal langsung dari lingkungan pengembangan Anda. Berlaku batas ukuran 100 MB. Untuk file yang lebih besar (di atas 100 MB), unggah ke OSS dan baca dari OSS dalam kode Anda, atau kemas ke dalam custom image.Di lingkungan pengembangan, setelah menjalankan sel yang berisi

##@resource_reference, jalankan ulang sel%%lindorm_rayuntuk menyertakan resource yang telah diunduh dalamworking_dir. Langkah ini tidak diperlukan di produksi.

# Referensi resource dari DataStudio Resource Management dan deklarasikan path-nya.

%%lindorm_ray

{

"runtime_env": {

"working_dir": "/mnt/workspace/_dataworks/resource_references"

}

}Asumsikan ray_resource.py telah diunggah ke DataStudio Resource Management:

ray_resource.py:

def fun():

print("This is a test function in ray_resource.py")Referensi dan gunakan dalam tugas Ray:

import ray

##@resource_reference{"ray_resource.py"}

@ray.remote

def do_work(x):

print('Ray says:', x)

from ray_resource import fun

fun()

return x

worker = do_work.remote("Welcome to the DataWorks+LindormRay solution")

print(ray.get(worker))Penjadwalan produksi dan O&M

Setelah pengembangan dan debugging selesai, lakukan commit dan publikasikan node Notebook. Node tersebut dijalankan sebagai node Lindorm Ray dalam DAG sesuai jadwal periodik.

Parameterisasi: Gunakan parameter penjadwalan DataWorks standar seperti

${bizdate}.Penampilan log: Untuk mencegah log berlebihan memengaruhi kinerja, sistem hanya memuat 1 MB log pertama secara default. Jika log terpotong, output mencakup tautan ke konsol Lindorm untuk log tugas lengkap.

Pelepasan resource: Setelah tugas produksi terjadwal selesai, tugas Lindorm Ray memasuki status yang diinginkan dan melepas resource. Selama pengembangan interaktif, restart kernel atau tutup Notebook untuk melepas resource.

Referensi cepat perintah magic

| Perintah magic | Contoh | Deskripsi | Mesin |

|---|---|---|---|

%odps | o = %odps | Mendapatkan objek entri PyODPS. | MaxCompute |

%maxframe | mf_session = %maxframe | Membuat koneksi MaxFrame. | MaxCompute |

%maxcompute_spark | %maxcompute_spark | Membuat session Spark. | MaxCompute Spark |

%maxcompute_spark stop | %maxcompute_spark stop | Membersihkan session Spark dan menghentikan Livy. | MaxCompute Spark |

%maxcompute_spark delete | %maxcompute_spark delete | Membersihkan session Spark, lalu menghentikan dan menghapus Livy. | MaxCompute Spark |

%%spark | %%spark | Di sel Python, terhubung ke resource komputasi Spark yang telah dibuat. | MaxCompute Spark |

%emr_serverless_spark | %emr_serverless_spark | Membuat session Spark. | EMR Serverless Spark |

%emr_serverless_spark info | %emr_serverless_spark info | Melihat informasi detail tentang Livy Gateway. | EMR Serverless Spark |

%emr_serverless_spark stop | %emr_serverless_spark stop | Membersihkan session Spark dan menghentikan Livy. | EMR Serverless Spark |

%emr_serverless_spark delete | %emr_serverless_spark delete | Membersihkan session Spark, lalu menghentikan dan menghapus Livy. | EMR Serverless Spark |

%emr_serverless_spark refresh_token | %emr_serverless_spark refresh_token | Menyegarkan token Livy untuk lingkungan pengembangan pribadi. | EMR Serverless Spark |

%adb_spark add | %adb_spark add --spark-conf ... | Membuat dan menghubungkan ke session ADB Spark yang dapat digunakan ulang. | AnalyticDB for Spark |

%adb_spark info | %adb_spark info | Melihat informasi session Spark. | AnalyticDB for Spark |

%adb_spark cleanup | %adb_spark cleanup | Menghentikan dan membersihkan session koneksi Spark saat ini. | AnalyticDB for Spark |

%lindorm_ray | %lindorm_ray | Membuat koneksi Lindorm Ray. | Lindorm Ray |

%%lindorm_ray | %%lindorm_ray dengan konfigurasi JSON | Membuat koneksi Lindorm Ray dan mengonfigurasi lingkungan runtime kustom. | Lindorm Ray |

FAQ

Mengapa saya mendapatkan error ModuleNotFoundError atau "There is no file with id ..." saat mereferensikan resource ruang kerja?

Buka Data Development > Resource Management dan pastikan resource Python MaxCompute telah disimpan.

Di produksi, pastikan resource telah dipublikasikan ke lingkungan produksi.

Klik Restart di bilah alat editor Notebook untuk memuat ulang resource.

Setelah memperbarui resource ruang kerja, mengapa versi lama masih digunakan?

Atur kebijakan penanganan konflik resource Dataworks › Notebook › Resource Reference: Download Strategy ke autoOverwrite di pengaturan DataStudio, lalu klik Restart Kernel di bilah alat Notebook.

Mengapa saya mendapatkan error FileNotFoundError di lingkungan pengembangan saat mereferensikan dataset?

Pastikan dataset dipasang di lingkungan pengembangan pribadi yang sedang dipilih di bawah Storage Configuration > Dataset.

Akses dataset berfungsi di pengembangan tetapi gagal di produksi dengan pesan Execute mount dataset exception! Please check your dataset config.

Pastikan dataset dipasang di scheduling configurations node Notebook.

Pastikan izin yang diperlukan telah diberikan untuk dataset OSS.

Bagaimana cara memeriksa versi lingkungan pengembangan pribadi saya?

Tekan Cmd+Shift+P dan ketik ABOUT untuk melihat versi. Jika diperlukan versi 0.5.69 atau lebih baru, gunakan opsi One-click Upgrade dari prompt peningkatan.

Mengapa koneksi ke mesin Spark gagal?

Mulailah dengan pemeriksaan umum: di halaman detail ruang kerja, pastikan resource komputasi (MaxCompute, EMR, atau ADB) telah di-bind dengan benar dan akun Anda memiliki izin yang diperlukan.

EMR Serverless Spark: Verifikasi bahwa Livy Gateway telah dibuat dan berjalan.

AnalyticDB for Spark: Pastikan

vswitchIddansecurityGroupIdbenar, jaringan antara lingkungan pengembangan pribadi dan instans ADB Spark terhubung, serta aturan Security Group mengizinkan komunikasi pada port yang diperlukan.