您可通过部署获得独立的、资源专享的推理服务,以满足您对高并发、低延迟等不同性能的业务需求。

本文档仅适用于“中国内地(北京)”地域。

计费方式

部署前可以在模型部署控制台(北京)查看不同模型的预估每小时费用。

计费方式在服务创建后无法更改。如需切换,必须下线已经部署的模型后再重新部署。

预置吞吐 (高吞吐;高性能) | 模型单元 (白名单开放,请联系商务经理;自定义性能指标;资源隔离;模型调优) | |||

定义 | 通过平台预留资源,保障特定TPM 吞吐能力的模型部署方式;在保障额度内不限速。 | 按使用时长与模型单元数量配置算力,资源独占的模型部署方式。 | ||

优势 |

|

| ||

支持模型 | 部分预置模型 | 调优后模型 | ||

使用场景 |

|

| ||

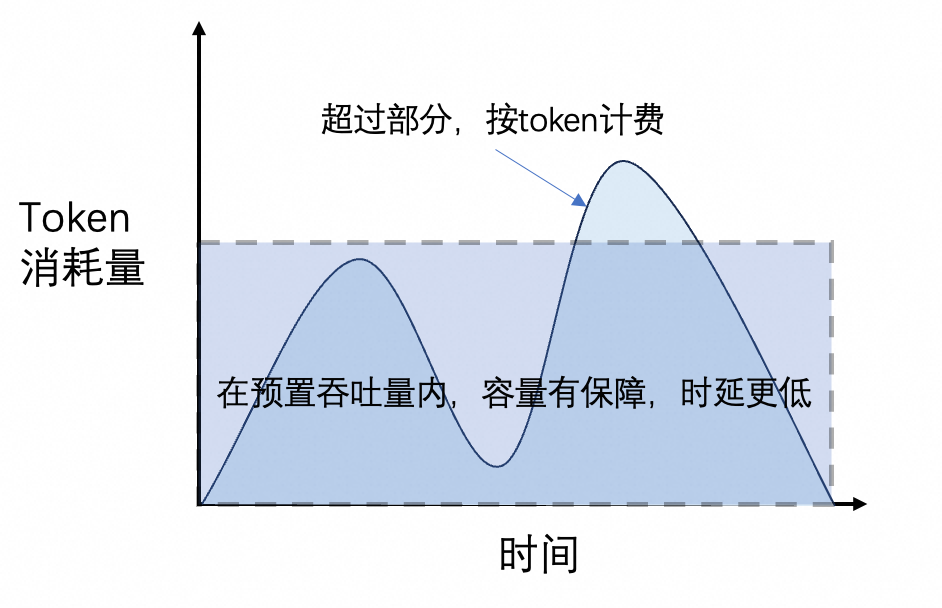

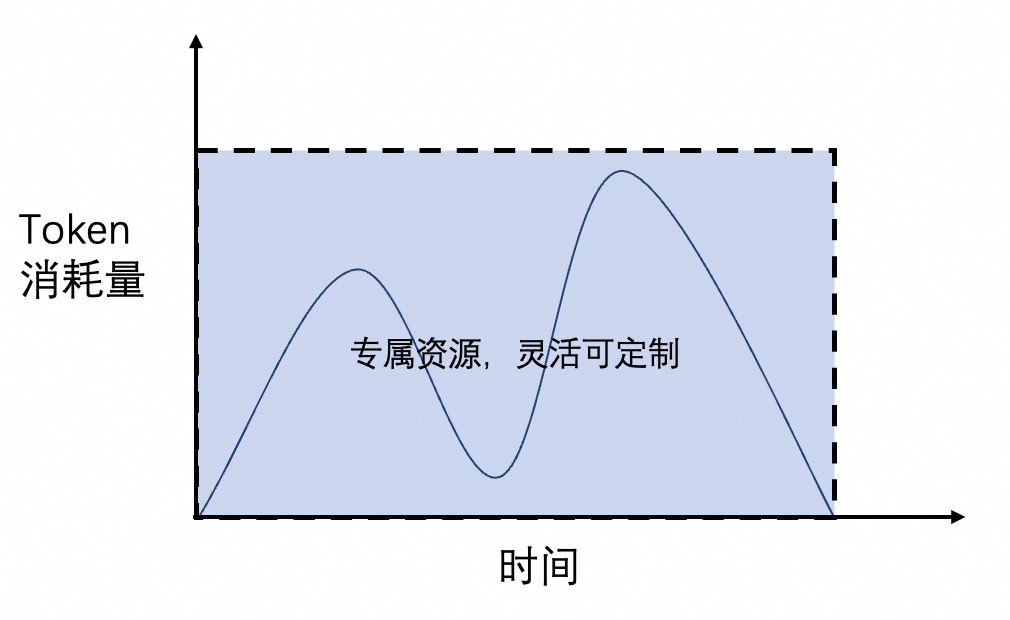

计费图示 |

|

| ||

计费方式 | 按使用时长和预置吞吐 随用随付、包天 | 按使用时长和模型单元数量 随用随付、包月 | ||

扩缩容方式 | 自助增减吞吐量 | 自助增减模型单元数量 | ||

产品约束 |

| 预付费购买后,若在首月内提前退订,日单价将按 1.2 倍计费 | ||

如需查看单次调用的 Token 使用量及调用次数历史统计,请前往:模型监控(北京)。

计费详情

按使用时长计费(预置吞吐)

费用 = 使用时长 × (输入 TPM 单价 × 输入 TPM + 输出 TPM 单价 × 输出 TPM)

预付费订单支付后实时生效,有效期 N 天至第 N 天 23:59 结束。若在 22:00 后下单,到期日将自动顺延1天。

预付费订单到期后,将延后2小时停止服务,停止后资源保留14小时后释放。

预付费订单无法提前终止服务。

后付费时,如果账户欠费,部署的资源将保留并继续计费 24 小时,之后自动释放资源。

当模型输入超过最长输入 Token 或 超出购买的 TPM 量,相关调用将自动切换为按量付费的模型调用,推理性能可能下降,限流占用业务空间的公共流量,费用按模型调用(按量付费)标准计收。

此时,调用 API 返回 Header 将包含:

x-dashscope-ptu-overflow:true。TPM 统计请前往:模型监控(北京)。

模型名称 | 模型类型 | 最长上下文 (输入 Token + 输出 Token) | 最长输入 Token | 后付费-按小时 | 预付费-按天 | ||

输入(Per 10k TPM) | 输出(Per 1k TPM) | 输入(Per 10k TPM) | 输出(Per 1k TPM) | ||||

千问3-max-2025-09-23 | Instruct | 128,000 | 128,000 | $1.11 | $0.45 | $13.32 | $5.40 |

千问-plus-2025-12-01 | Instruct | $0.28 | $0.07 | $3.36 | $0.84 | ||

Thinking | $0.28 | $3.36 | |||||

千问-flash-2025-07-28 | Instruct/Thinking | $0.06 | $0.06 | $0.72 | $0.72 | ||

千问3-vl-plus-2025-09-23 | Instruct/Thinking | $0.35 | $0.35 | $4.20 | $4.20 | ||

DeepSeek-v3.2 | Instruct/Thinking | 64,000 | $1.04 | $0.16 | $12.48 | $1.92 | |

模型类型:

Instruct - 模型部署后以非思考模式进行推理。

Thinking - 模型部署后以思考模式进行推理。

按使用时长计费(模型单元)

费用 = 使用时长(小时)× 模型单元数量 × 模型单元单价

预付费购买的首月,如在首月内提前退订,日单价将按 1.2 倍计费

模型单元-后付费方式的算力资源先买到先得。如购买不成功会全额退款。

千问

模型名称 | 模型类型 | 支持限流 | 模型单元规格 | 最长上下文 | 单价 (不满 1 分钟按 1 分钟计费) | 包月单价 (不满 1 天按 1 天计费) (如在首月内提前退订,日单价将按 1.2 倍计费) |

千问3-14B | Instruct | I 型模型单元(MU1) | 固定为: 详情请参考:qwen-3 | $40/小时 | $18,800/月 | |

千问3-32B | Instruct | I 型模型单元(MU1) | 固定为: 详情请参考:qwen-3 | $40/小时 | $18,800/月 |

模型类型:

Instruct - 模型部署后以非思考模式进行推理。

千问VL

模型名称 | 模型类型 | 支持限流 | 模型单元规格 | 最长上下文 | 单价 (不满 1 分钟按 1 分钟计费) | 包月单价 (不满 1 天按 1 天计费) (如在首月内提前退订,日单价将按 1.2 倍计费) |

千问3-VL-8B-Instruct | Instruct | I 型模型单元(MU1) | 固定为: | $20/小时 | $9,400/月 | |

千问3-VL-8B-Thinking | Thinking |

模型类型:

Instruct - 模型部署后以非思考模式进行推理。

Thinking - 模型部署后以思考模式进行推理。

如果需要部署更多模型,请参考此解决方案并结合具体业务需求选择最适合的部署方案。

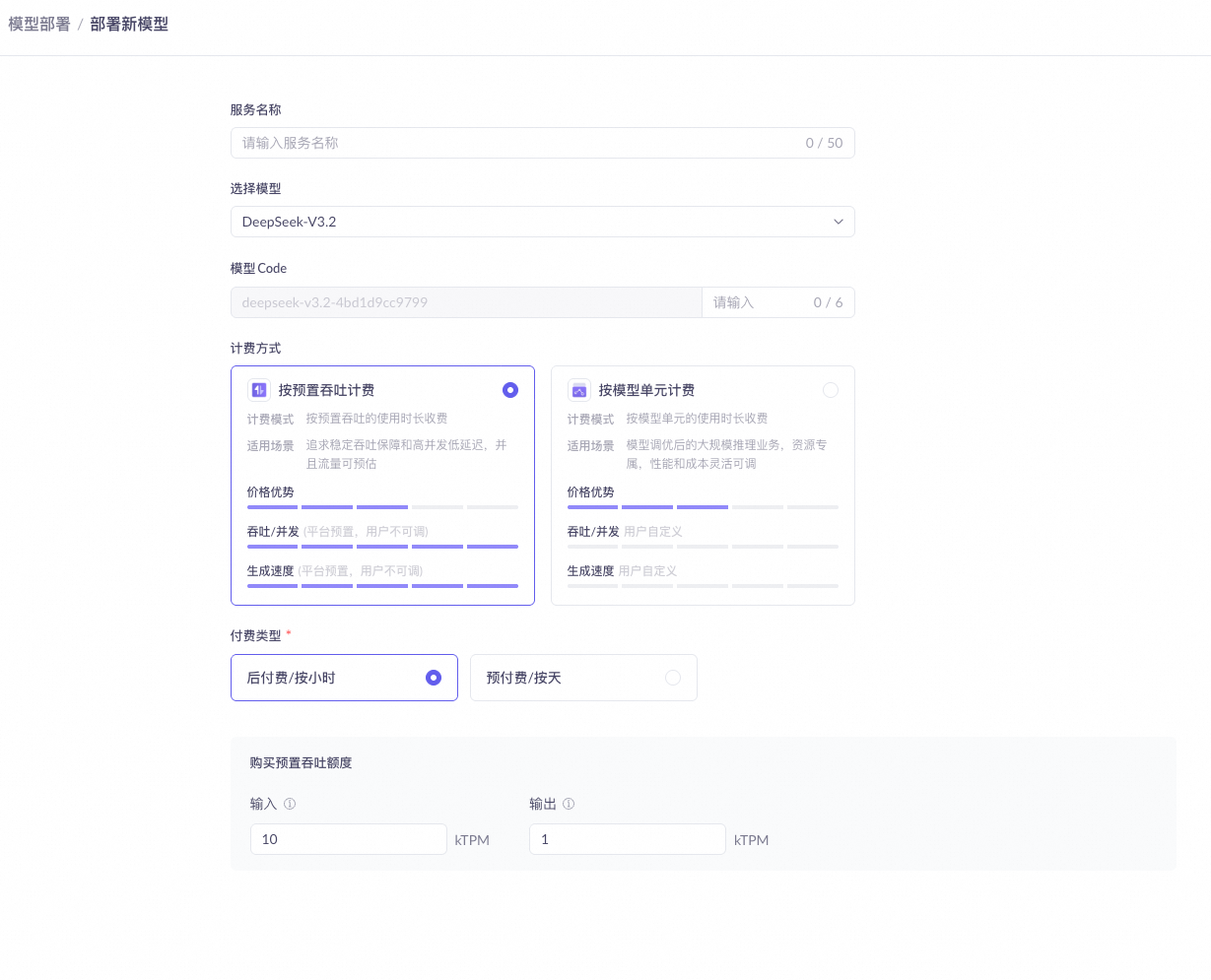

部署方法

您可以在控制台上部署模型,请参考以下操作步骤:

如果提示权限不足,请参考:部署时提示权限不足怎么办?

|

|

| |

重要 模型部署成功后将产生费用。 |

部署配置

模型单元

配置内容 | 配置详情 |

配置模型推理模式 | 部分模型在以模型单元方式部署时,可配置推理模式、最长上下文等。

|

最长上下文 | 部分模型的模型单元部署模式支持该设置。最长上下文长度基于模型类型。 |

服务限流 | 部分模型的模型单元部署模式支持该设置,可限制模型调用的 RPM、TPM。 |

部署后调用

模型部署成功后,支持通过 OpenAI 兼容、Dashscope及Assistant SDK进行调用。

在调用已部署成功的模型时,model的取值应为模型部署成功后的模型code。请前往模型部署控制台(北京)界面获取模型code。

DashScope

import os

import dashscope

messages = [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "你是谁?"},

]

dashscope.base_http_api_url = 'https://dashscope-intl.aliyuncs.com/api/v1'

response = dashscope.Generation.call(

# 若没有配置环境变量,请用百炼API Key将下一行替换为:api_key="sk-xxx",

api_key=os.getenv("DASHSCOPE_API_KEY"),

model="qwen3-max-xxx-xxx", # 请替换为模型部署成功后的code

messages=messages,

result_format="message",

enable_thinking=False,

)

print(response)

OpenAI兼容接口

import os

from openai import OpenAI

client = OpenAI(

# 若没有配置环境变量,请用百炼API Key将下一行替换为:api_key="sk-xxx",

api_key=os.getenv('DASHSCOPE_API_KEY'),

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

)

completion = client.chat.completions.create(

model="qwen3-max-xxx-xxx", # 请替换为模型部署成功后的code

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "你是谁?"},

],

extra_body={"enable_thinking": False},

)

print(completion)

部署服务扩缩容

预置吞吐(按时长):点击扩缩容按钮,自助、手动调节实例数量。

模型单元(按时长):点击扩缩容按钮,自助、手动调节实例数量。

部署服务下线

前往模型部署控制台(北京),找到要下线的部署服务,点击下线并确认。下线后将不再产生计费。

常见问题

可以上传和部署自己的模型吗?

暂不支持上传和部署自有模型,建议您持续关注阿里云百炼最新动态。

此外,阿里云人工智能平台 PAI 提供了部署自有模型的功能,您可以参考PAI-LLM大语言模型部署了解部署方法。

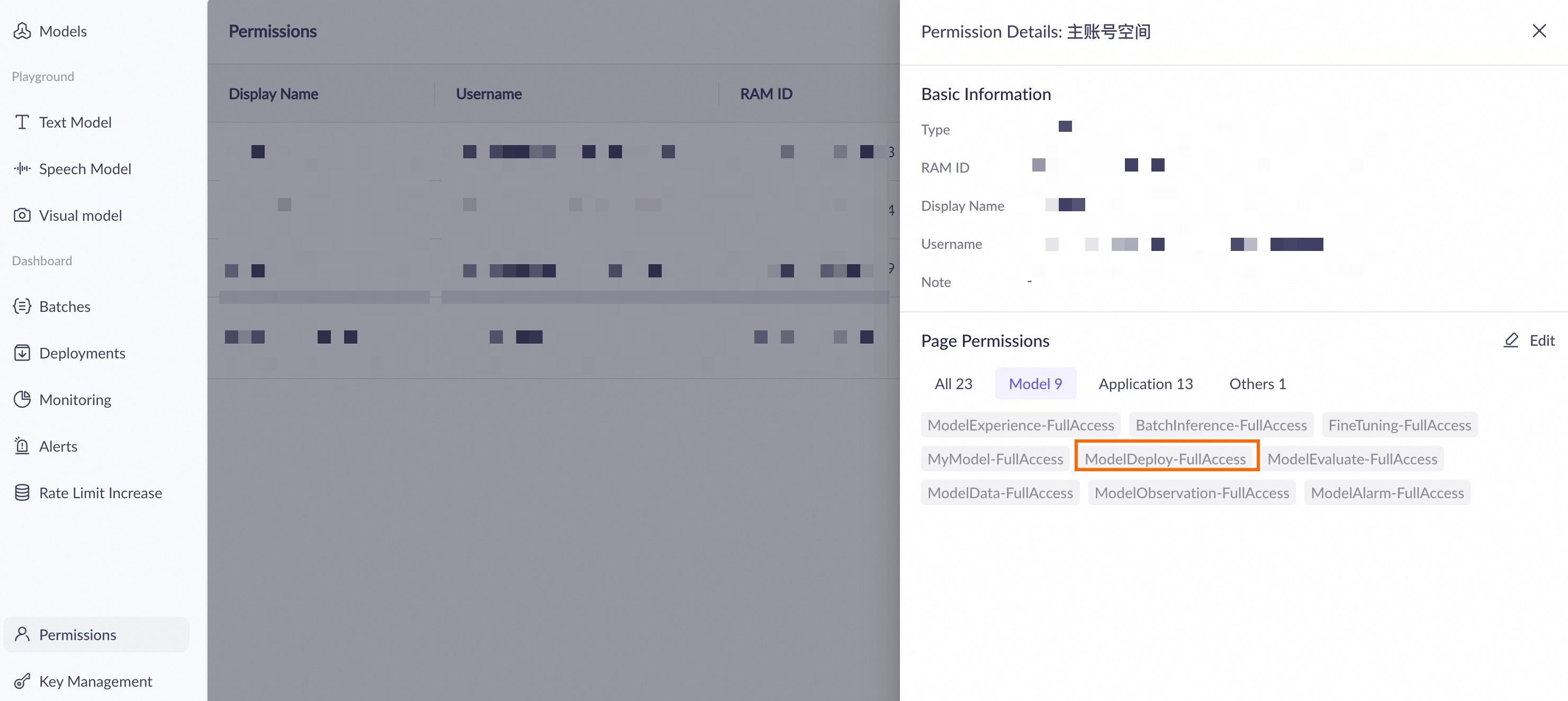

部署时提示权限不足怎么办?

如果显示“缺少该模块的权限”,请确保您的账号在该业务空间的权限管理页面中拥有模型部署-操作权限。

如果无法正常操作,请联系您的组织或 IT 管理员添加相关权限或代为检查权限问题。

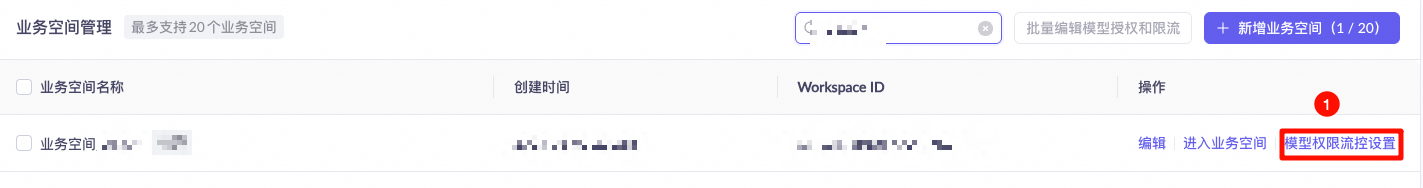

如果部署时报错“xx业务空间没有部署xx模型的权限”,请前往百炼的业务空间管理页面,为对应业务空间添加对应模型的部署权限。

API 调用报错:

Workspace xxx does not have deployment privilege for model xxxx。

如果提示权限不足,请联系您的组织或 IT 管理员添加相关权限或代为操作。