通過建立ArgoDB資料來源能夠實現Dataphin讀取ArgoDB的業務資料或向ArgoDB寫入資料。本文為您介紹如何建立ArgoDB資料來源。

許可權說明

僅支援具備建立資料來源許可權點的自訂全域角色和超級管理員、資料來源管理員、板塊架構師、專案系統管理員角色建立資料來源。

操作步驟

在Dataphin首頁,單擊頂部功能表列管理中心 > 資料來源管理。

在資料來源頁面,單擊+建立資料來源。

在建立資料來源頁面的巨量資料儲存地區,選擇ArgoDB。

如果您最近使用過ArgoDB,也可以在最近使用地區選取項目ArgoDB。同時,您也可以在搜尋方塊中,輸入ArgoDB的關鍵詞,快速搜尋。

在建立ArgoDB資料來源頁面中,配置資料來源的基本資料。

參數

描述

資料來源名稱

命名規則如下:

只能包含中文、英文字母大小寫、數字、底線(_)或短劃線(-)。

長度不能超過64字元。

資料來源編碼

配置資料來源編碼後,您可以在Flink_SQL任務中通過

資料來源編碼.表名稱或資料來源編碼.schema.表名稱的格式引用資料來源中的表;如果需要根據所處環境自動訪問對應環境的資料來源,請通過${資料來源編碼}.table或${資料來源編碼}.schema.table的變數格式訪問。更多資訊,請參見Dataphin資料來源表開發方式。重要資料來源編碼配置成功後不支援修改。

資料來源編碼配置成功後,才能在資產目錄和資產清單的對象詳情頁面進行資料預覽。

Flink SQL中,目前僅支援MySQL、Hologres、MaxCompute、Oracle、StarRocks、Hive、SelectDB資料來源。

版本

當前,版本僅支援選擇5.2。

資料來源描述

對資料來源的簡單描述。不得超過128個字元。

資料來源配置

選擇需要配置的資料來源:

如果資料來源區分生產資料來源和開發資料來源,則選擇生產+開發資料來源。

如果資料來源不區分生產資料來源和開發資料來源,則選擇生產資料來源。

標籤

您可根據標籤給資料來源進行分類打標,如何建立標籤,請參見管理資料來源標籤。

配置資料來源與Dataphin的串連參數。

若您的資料來源配置選擇生產+開發資料來源,則需配置生產+開發資料來源的串連資訊。如果您的資料來源配置為生產資料來源,僅需配置生產資料來源的串連資訊。

說明通常情況下,生產資料來源和開發資料來源需配置非同一個資料來源,以使開發資料來源與生產資料來源的環境隔離,降低開發資料來源對生產資料來源的影響。但Dataphin也支援配置成同一個資料來源,即相同參數值。

配置叢集配置地區的參數。

參數

描述

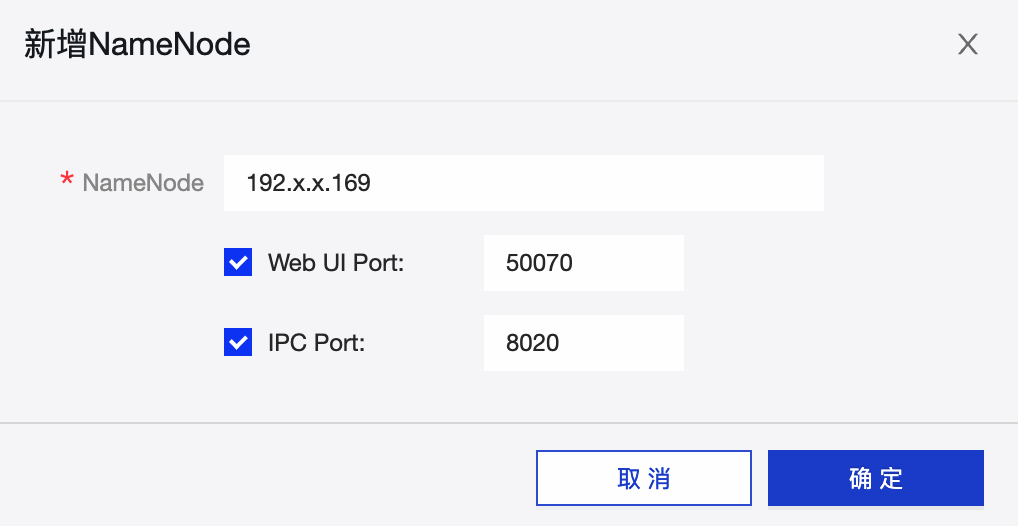

NameNode

NameNode為HDFS叢集中NameNode節點的HostName或者IP和連接埠。

配置範例:

host=192.x.x.169,webUiPort=,ipcPort=8020。其中,webUiPort和IPCport在TDH環境下預設是50070和8020,您可根據實際情況填寫對應的連接埠。

設定檔

用於上傳Hadoop的設定檔,例如

hdfs-site.xml、core-site.xml,設定檔可在Hadoop叢集匯出。認證方式

如果HDFS叢集無需認證,則選擇無認證;如果HDFS叢集需要認證,Dataphin支援Kerberos。

若選擇Kerbero認證方式需配置相關認證資訊:

Kerberos配置方式:

KDDC Server:KDC統一服務地址,支援多項配置,英文分號(;)分隔。

Krb5檔案配置:需上傳Krb5檔案。

HDFS配置:

HDFS keytab File:HDFS的keytab檔案,即Kerberos認證的檔案。

HDFS Principal:Kerberos認證Principal名。格式為

XXXX/hadoopclient@xxx.xxx。

配置ArgoDB配置地區的參數。

參數

描述

JDBC URL

配置串連ArgoDB的JDBC URL,格式為

jdbc:hive2//host:port/dbname。認證方式

如果ArgoDB叢集無需認證,則選擇無認證;如果Inceptor叢集需要認證,Dataphin支援選擇LDAP或Kerberos,您可以根據實際情況進行選擇,詳細內容說明如下:

Kerberos:選擇後需要上傳Keytab File及配置Principal。Keytab File即Kerberos認證的檔案;Principal格式為

XXXX/hadoopclient@xxx.xxx。LDAP:選擇後需要配置LDAP認證的使用者名稱和密碼。

使用者名稱

配置ArgoDB的使用者名稱。

配置中繼資料庫配置地區的參數。

參數

描述

中繼資料擷取方式

支援從中繼資料庫直接擷取和HMS擷取方式。

使用HMS需上傳hive-site.xml設定檔。認證方式支援無認證、LDAP、Kerberos。Kerberos認證方式還需上傳Keytab File及配置Principal。

資料庫類型

根據叢集中使用的中繼資料庫類型,選擇資料庫類型。支援選擇ArgoDB。

JDBC URL

填寫ArgoDB中繼資料庫的連結地址。格式為:

jdbc:hive2://hsot:port/dbname。認證方式

支援3種認證方式,無認證、LDAP、Kerberos。

Kerberos認證方式還需上傳Keytab File及配置Principal。

使用者名稱、密碼

登入中繼資料庫的使用者名稱和密碼。

選擇預設資源群組,該資源群組用於運行與當前資料來源相關任務,包括資料庫SQL、離線整庫遷移、資料預覽等。

進行測試連接或直接單擊確定進行儲存,完成ArgoDB資料來源的建立。

單擊測試連接,系統將測試資料來源是否可以和Dataphin進行正常的連通。若直接單擊確定,系統將自動對所有已選中的叢集進行測試連接,但即使所選中的叢集均串連失敗,資料來源依然可以正常建立。