PAI ArtLab には、AUTOMATIC1111 が開発した Stable Diffusion Web UI が含まれており、コードを記述することなくブラウザベースのインターフェイスで画像を生成・編集できます。Stable Diffusion 自体は、Stability AI が開発した Text-to-Image の AI モデルです。このガイドでは、Text-to-Image による画像生成、Image-to-Image による画像編集、インペインティング、ControlNet を用いた構造制御生成の 4 つの主要なワークフローについて説明します。

このモデルを、熟練したアーティストだと考えてみてください。アーティストに指示 (プロンプト)、参照画像、またはスケッチを与えると、アーティストが結果を生成します。このガイドの各セクションは、そのメンタルモデルに基づいて構成されており、読み進めるにつれてアーティストのツールがより精密になっていきます。

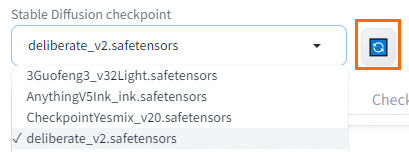

モデルの選択

Object Storage Service (OSS) のディレクトリにモデルをアップロードし、Web UI を更新します。アップロードしたモデルは、ページ上部のモデルセレクターに表示されます。

Civitai からモデルをダウンロードします。

Civitai にアクセスできない場合は、プロキシを設定して再度お試しください。

txt2img

txt2img タブは、テキストプロンプトを画像に変換します。これは、ほとんどの画像生成ワークフローの出発点となります。

プロンプトの構文

キーワードのカテゴリ

プロンプトは、AI に何を生成させるかを指示するキーワードのリストです。キーワードは通常、次の 3 つのグループに分類されます。

プレフィックス — 画像の品質、描画スタイル、レンズ効果、照明 (例:

HDR、8K、studio lighting)主題 — 主要な要素、そのポーズ、服装、または属性 (例:

1girl、brown hair、gloves)シーン — 環境と背景の詳細 (例:

outdoors、blue sky、forest)

プロンプトの先頭にあるキーワードほど、重みが大きくなります。主題を最初に、次に画材とスタイル、そして解像度と照明の順に、優先順位に従って配置します。学習済みモデルには、キーワードを上書きまたは補足できる組み込みのスタイルプリセットが用意されていることがよくあります。

重み付けの構文 (チートシート)

| 構文 | 効果 | 例 |

|---|---|---|

(word) | 重み × 1.1 | (beautiful) |

((word)) | 重み × 1.21 | ((beautiful)) |

{word} | 重み × 1.05 | {beautiful} |

[word] | 重み × 0.952 | [background] |

(word:1.5) | 重み × 1.5 (明示的) | (eyes:1.2) |

(word:0.5) | 重み × 0.5 (明示的) | (blurry:0.3) |

<lora:filename:multiplier> | LoRA モデルの呼び出し | <lora:hanfu_v29:1> |

<hypernet:filename:multiplier> | Hypernetwork モデルの呼び出し | <hypernet:style:0.8> |

[promptA:promptB:0.7] | ステップの 70% で A から B に遷移 | [apple:peach:0.9] |

重みは 0.4~1.6 の範囲に保ってください。この範囲外の値は、過学習を引き起こしたり、モデルがキーワードを無視したりする原因となる可能性があります。

一般的なプロンプト

これらのプロンプトを出発点として使用してください:

ポジティブプロンプト

| プロンプト | 効果 |

|---|---|

HDR, UHD, 8K, 4K | 画質を向上させます |

best quality | 画像を鮮やかにします |

masterpiece | 画像を傑作のように見せます |

highly detailed | 細かいディテールを追加します |

studio lighting | 質感のあるスタジオ照明を適用します |

ultra-fine painting | 超精細な絵画スタイルを適用します |

sharp focus | 画像にシャープなフォーカスを合わせます |

physically-based rendering | 物理ベースのレンダリングを使用します |

vivid colors | 色をより鮮やかにします |

(EOS R8, 50mm, F1.2, 8K, RAW photo:1.2) | プロフェッショナルな写真スタイルを取り入れます |

bokeh | 背景をぼかし、主題を際立たせます |

sketch | 描画方法としてスケッチを使用します |

painting | 描画方法としてペインティングを使用します |

ネガティブプロンプト

| プロンプト | 効果 |

|---|---|

mutated hands and fingers | 手や指の形状が崩れるのを防ぎます |

deformed | 変形を防ぎます |

bad anatomy | 解剖学的な誤りを防ぎます |

disfigured | 醜い形になるのを防ぎます |

poorly drawn face | 下手な顔の描画を防ぎます |

extra limb | 余分な手足を防ぎます |

ugly | 醜い要素を防ぎます |

missing limb | 手足の欠損を避けます |

floating limbs | 浮遊する手足を防ぎます |

disconnected limbs | 部位の分離を防ぐ |

malformed hands | 奇形の手を防ぎます |

long neck | 不自然に長い首を防ぎます |

long body | 不自然に長い体を防ぎます |

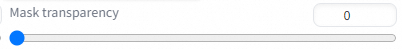

例:複雑なプロンプト

ポジティブプロンプト:

8k portrait of beautiful cyborg with brown hair, intricate, elegant, highly detailed, majestic, digital photography, art by artgerm and ruan jia and greg rutkowski surreal painting gold butterfly filigree, broken glass, (masterpiece, sidelighting, finely detailed beautiful eyes: 1.2), hdrネガティブプロンプト:

canvas frame, cartoon, 3d, ((disfigured)), ((bad art)), ((deformed)),((extra limbs)),((close up)),((b&w)), wired colors, blurry, (((duplicate))), ((morbid)), ((mutilated)), [out of frame], extra fingers, mutated hands, ((poorly drawn hands)), ((poorly drawn face)), (((mutation))), (((deformed))), ((ugly)), blurry, ((bad anatomy)), (((bad proportions))), ((extra limbs)), cloned face, (((disfigured))), out of frame, ugly, extra limbs, (bad anatomy), gross proportions, (malformed limbs), ((missing arms)), ((missing legs)), (((extra arms))), (((extra legs))), mutated hands, (fused fingers), (too many fingers), (((long neck))), Photoshop, video game, ugly, tiling, poorly drawn hands, poorly drawn feet, poorly drawn face, out of frame, mutation, mutated, extra limbs, extra legs, extra arms, disfigured, deformed, cross-eye, body out of frame, blurry, bad art, bad anatomy, 3d renderプロンプトのソース:Civitai

上記のリンクにアクセスできない場合は、プロキシを設定して再度お試しください。

パラメーター

| # | パラメーター | 説明 |

|---|---|---|

| ① | サンプリングメソッド | 生成中に使用されるノイズ除去アルゴリズム。Euler a、DPM++ 2s a、DPM++ 2s a Karras は同様の構図を生成します。Euler、DPM++ 2m、DPM++ 2m Karras は別のグループを形成します。DDIM は明らかに異なる構図を生成します。 |

| ② | サンプリングステップ | ノイズ除去の反復回数。ステップ数を増やすとディテールが追加されますが、時間と計算リソースをより多く消費します。Euler a は 30~40 ステップあたりで安定し、それ以上増やしてもディテールは追加されません。 |

| ③ | Hires. fix | 最初に低解像度で生成し、その後構図を維持しながらアップスケールします。[Hires steps] と [Denoising strength] の設定が必要です。詳細については、「PAI ArtLab を使用して画像をアップスケールする 3 つの方法」をご参照ください。 |

| ④ | 幅 / 高さ | 出力解像度。値を高くするとディテールが追加されますが、VRAM の消費量が増加します。デフォルト:512×512。 |

| ⑤ | バッチ回数 | 連続した生成バッチの数。結果はバッチごとに異なります。 |

| ⑥ | バッチサイズ | バッチごとに生成される画像数。値を大きくすると VRAM の消費量が増加します。 |

| ⑦ | CFG スケール | モデルがプロンプトにどれだけ厳密に従うか。高いほど文字通りに、低いほど創造的になります。 |

| ⑧ | シード | -1 は毎回異なる画像を生成します。他のすべてのパラメーターが変更されていない場合、他の任意の値 (負の数や小数を含む) は同じ画像を再現します。 |

| ⑨ | *(アイコン)* | プロンプトまたは以前に生成された画像から生成パラメーターを読み取ります。 |

| ⑩ | *(アイコン)* | プロンプトの内容をクリアします。 |

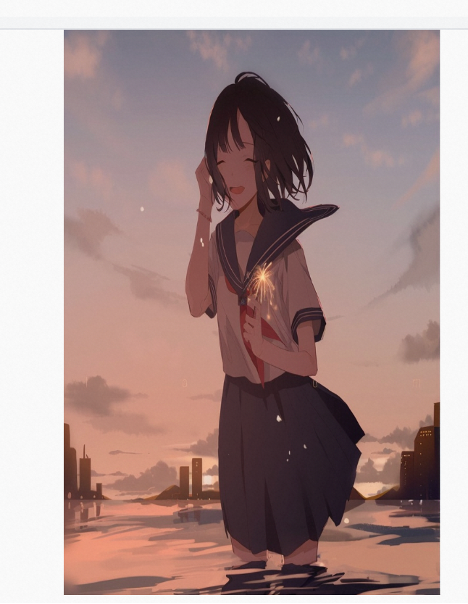

img2img

img2img タブは、既存の画像とプロンプトに基づいて新しい画像を生成します。これは、アーティストに参照写真を再解釈してもらうようなものです。これを使用して、写真をイラストに変換したり、下書きにスタイルを適用したり、既存のアートワークを再構築したりします。

システムは入力画像を分析し、CLIP モデル (リアルな画像に最適) または DeepBooru (イラストや漫画の画像に最適) を使用して、キーワードを自動的に提案することもできます。

基本的な img2img

ソース画像をアップロードします。縦横比をターゲットの出力ディメンションに合わせます。512×512 の出力の場合、1:1 の画像をアップロードします。

[Interrogate CLIP] または [Interrogate DeepBooru] を使用してプロンプトを自動生成するか、ポジティブプロンプトとネガティブプロンプトを手動で入力します。

[生成] をクリックします。

スケッチ

インペイント

インペイントスケッチ

インペイントアップロード

バッチインペインティング

共有マスクを使用して、ディレクトリ全体の画像を処理します。開始する前に、3 つのディレクトリを作成します。

入力ディレクトリ — 元の画像を保存します

出力ディレクトリ — 生成された結果を保存します

インペイントバッチマスクディレクトリ — マスク画像を保存します

マスクを特定の画像とペアにするには、両方のファイルに同じ名前を付けます (例:ali_sd.png)。画像に対応するマスクがない場合、モデルはマスクディレクトリの最初のファイルを使用します。その最初のファイルを全白画像に設定して画像全体のインペインティングを行うか、最も一般的に必要なマスクを使用します。

img2img パラメーター

Interrogation

| オプション | 動作 |

|---|---|

| Interrogate CLIP | 人が画像を説明するような自然言語でプロンプトを生成します。リアルな写真に最適です。 |

| Interrogate DeepBooru | タグ形式のプロンプト (例:beautiful woman、river、afternoon) を生成します。より詳細です。イラストに最適です。 |

リサイズモード

| モード | 動作 |

|---|---|

| 単純リサイズ | ターゲットのディメンションに直接リサイズします。画像が引き伸ばされたり圧縮されたりする可能性があります。 |

| 切り抜き & リサイズ | 最初に切り抜き、次にリサイズします。歪みを最小限に抑えますが、元の画像の一部が破棄されます。 |

| リサイズ & フィル | リサイズし、空の領域を色やパターンで埋めます。元の比率を維持しますが、フィル品質はさまざまです。 |

| 単純リサイズ (latent upscale) | 順伝播中に潜在空間でのみリサイズします。より速く、より安定していますが、細かいディテールへの忠実度は低くなります。 |

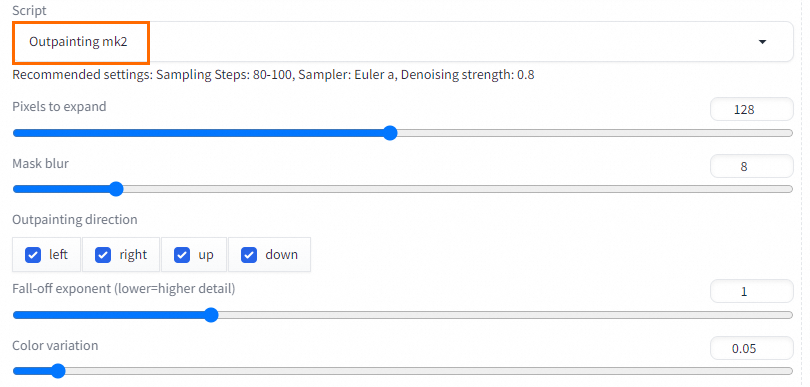

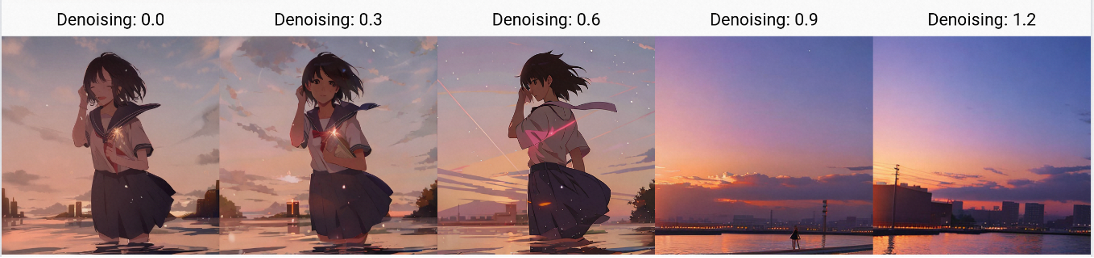

outpainting mk2 スクリプトを使用して画像キャンバスを拡張することもできます。ノイズ除去強度を調整して、新しい領域が元の領域からどれだけ逸脱するかを制御します。

ノイズ除去強度

出力が入力画像からどれだけ逸脱するかを制御します。値が高いほど滑らかな結果になりますが、元のディテールの多くが失われます。値が低いほど、元のディテールがより多く保持されます。

インペイント固有のパラメーター

マスクのぼかし

マスクの端をぼかして、再描画された領域を画像の残りの部分とブレンドします。値が高いほど、より柔らかく、より透明なエッジが作成されます。

以下の画像は、マスクのぼかしの値が 0、20、40、60 の場合を比較したものです。

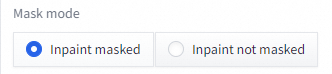

マスクモード

マスク領域のコンテンツ

モデルがマスクされた領域の開始点として何を使用するかを決定します。

| オプション | 動作 | 最適な用途 |

|---|---|---|

| 塗りつぶし | 生成前にマスクされた領域を塗りつぶします | 不要なオブジェクトの削除 |

| オリジナル | 元の画像コンテンツを参照として使用します | 欠陥 (傷、汚れ) の修復 |

| latent noise | マスクされた領域にランダムノイズをシードします | 芸術的な効果。より高いノイズ除去強度を使用します |

| latent nothing | 空白のピクセルで塗りつぶします | 空白や境界線の追加 |

塗りつぶし — 木の幹を削除します:

オリジナル — 木の幹を花に置き換えます:

latent noise (低いノイズ除去強度):

latent noise (高いノイズ除去強度):

latent nothing (低いノイズ除去強度):

latent nothing (高いノイズ除去強度):

インペイントエリア:全体 — ノイズ除去強度 0 と 0.6 での塗りつぶしとオリジナルを比較:

*塗りつぶし、ノイズ除去強度 0:*

*塗りつぶし、ノイズ除去強度 0.6:*

*オリジナル、ノイズ除去強度 0:*

*オリジナル、ノイズ除去強度 0.6:*

インペイントエリア:マスク領域のみ — ノイズ除去強度 0 と 0.6 での塗りつぶしとオリジナルを比較:

*塗りつぶし、ノイズ除去強度 0:*

*塗りつぶし、ノイズ除去強度 0.6:*

*オリジナル、ノイズ除去強度 0:*

*オリジナル、ノイズ除去強度 0.6:*

マスク領域のみのパディング (ピクセル)

[インペイントエリア] が [マスク領域のみ] に設定されている場合にのみ使用できます。マスクされた領域の周りにパディングを追加します。これは、マスクが顔を覆っている場合に便利で、顔を画像の残りの部分から分離し、全体的な構図の変更を減らします。この設定を有効にすると、latent noise はより良い芸術的な結果を生み出します。

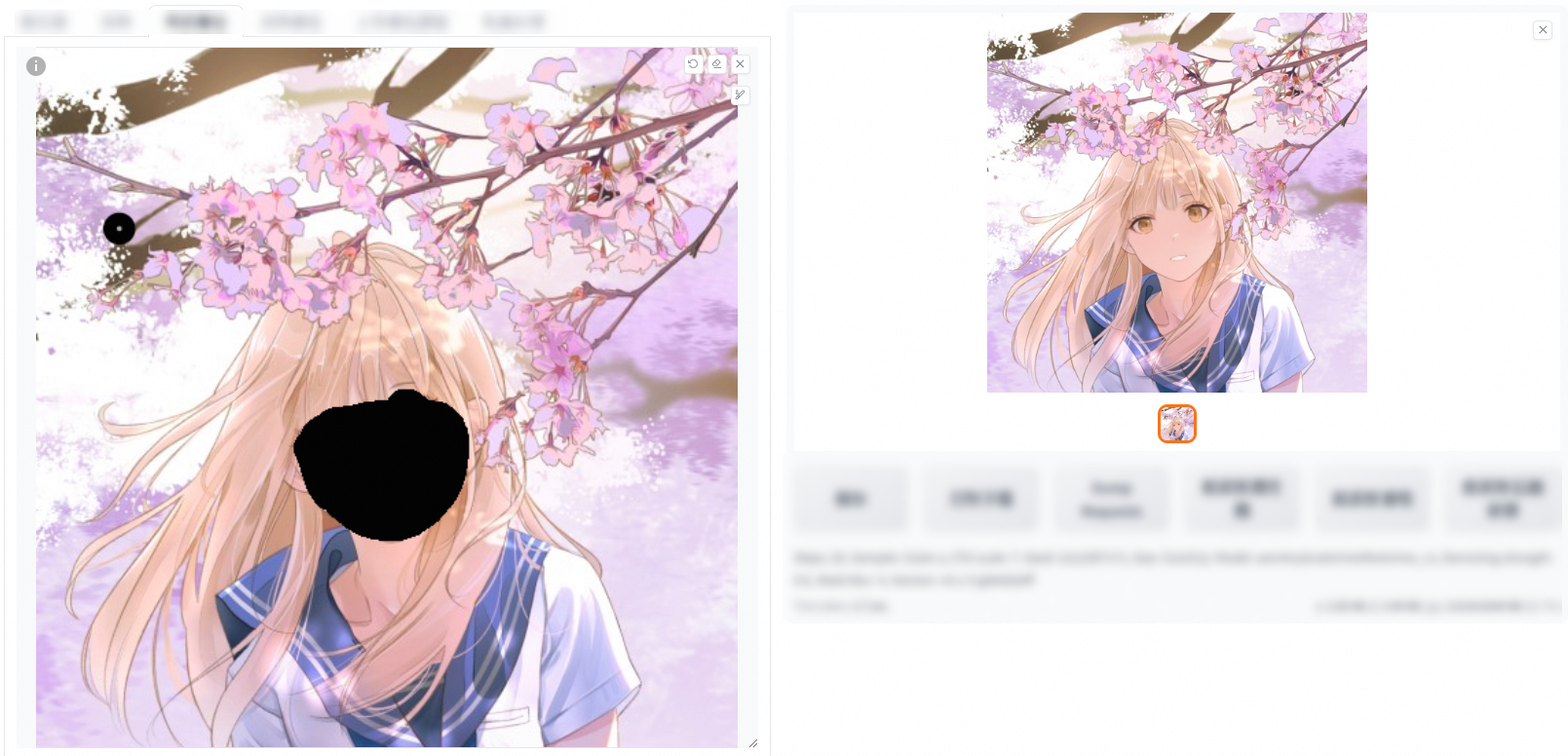

インペイントスケッチパラメーター:マスクの透明度

出力でペイントされたマスクの色がどれだけ見えるかを制御します。値が高いほどマスクの色が優勢になり、その領域での元の画像の影響が減少します。これはノイズ除去強度にも影響します。範囲:0~100。

以下の画像は、マスクの透明度の値が 0、30、60、90 の場合を比較したものです。

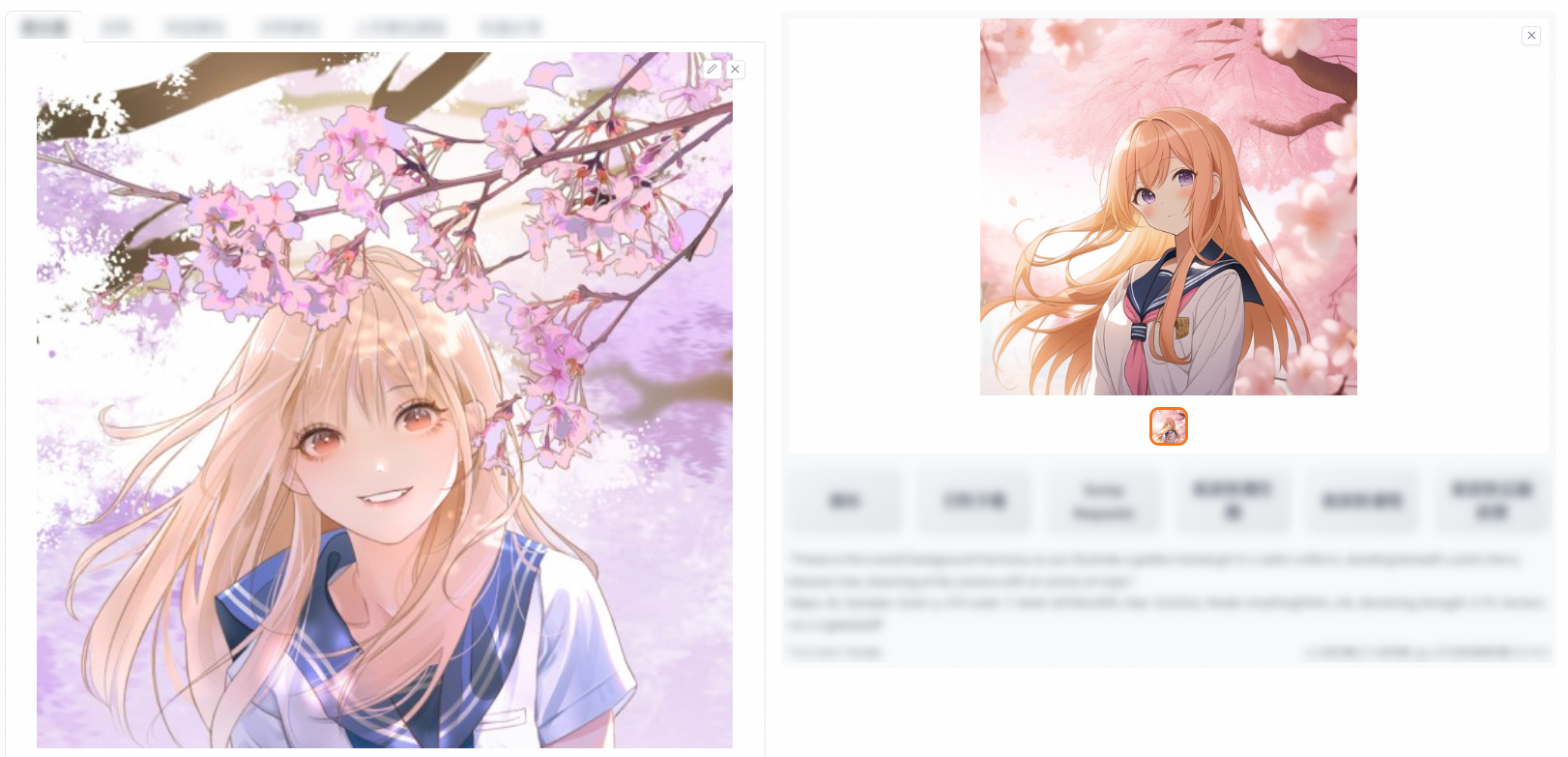

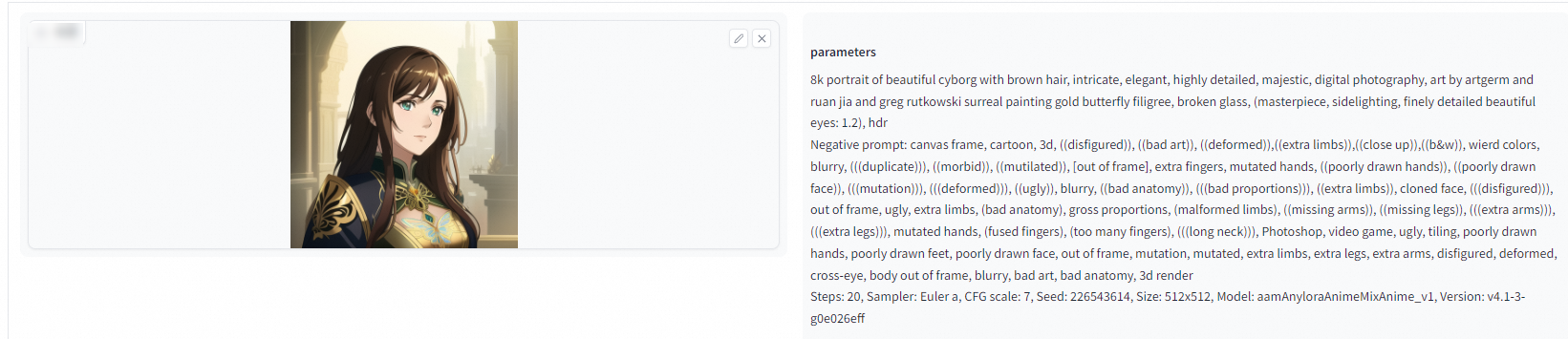

画像情報

Stable Diffusion によって生成された任意の画像を [画像情報] タブにアップロードすると、元のプロンプトと生成パラメーターを表示できます。

スクリーンショットや他のアプリケーションから保存された画像はこの方法では読み取れません。メタデータが削除されているためです。

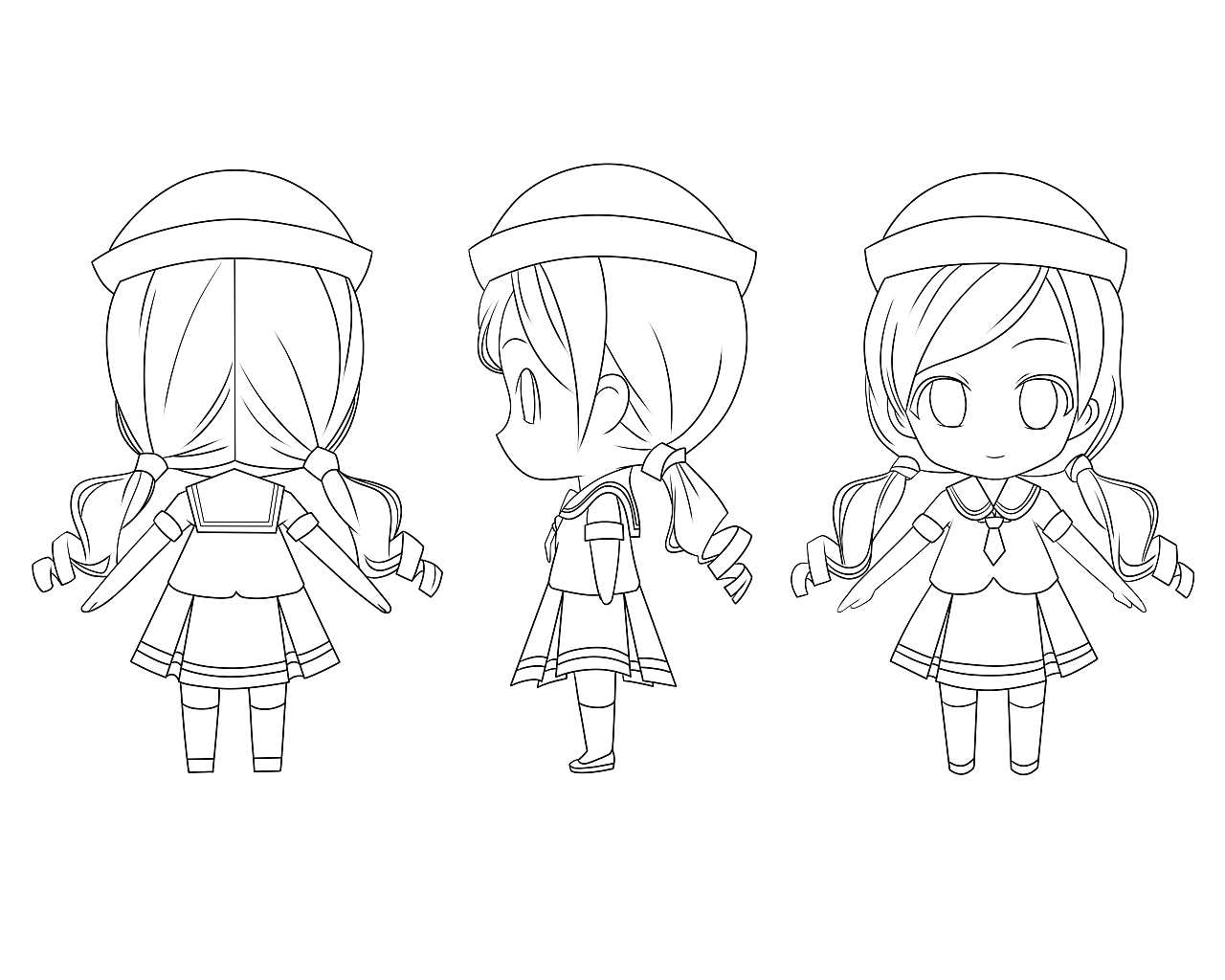

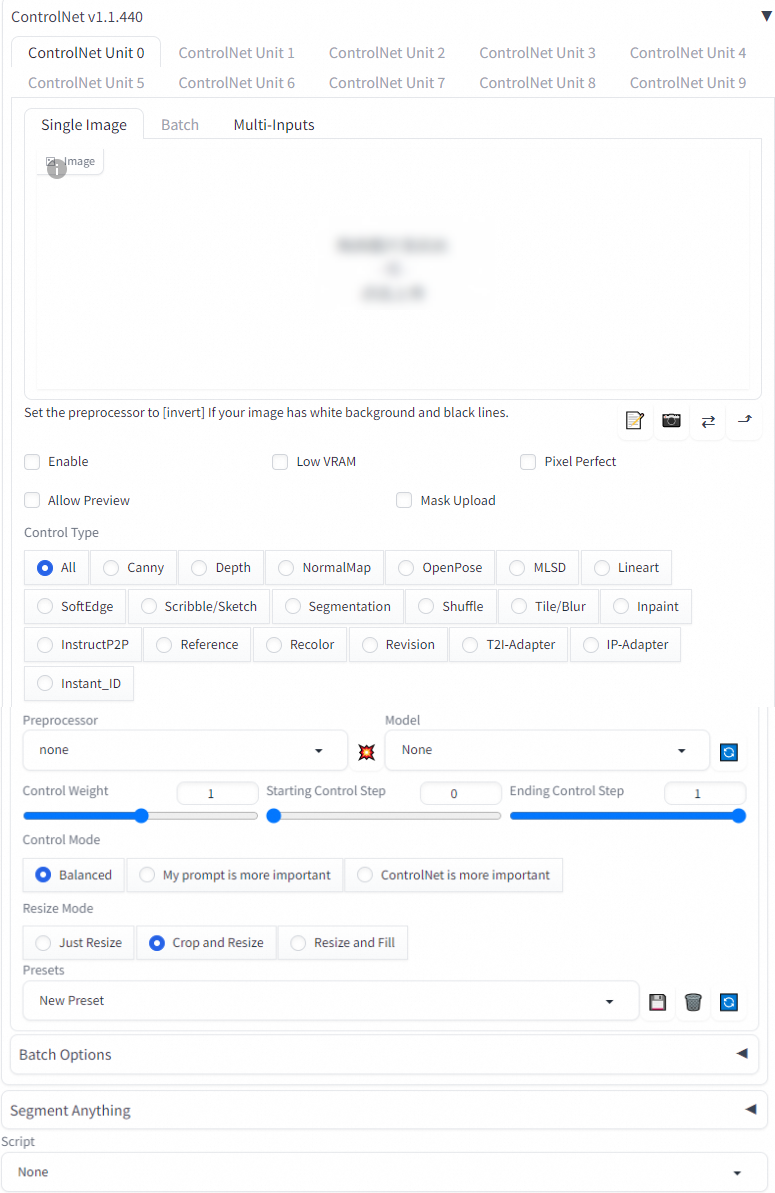

ControlNet プラグイン

TheMisto.ai が開発した MistoLine-SDXL-ControlNet プラグインは、PAI ArtLab の Stable Diffusion WebUI および ComfyUI のすべてのバージョンで利用可能です。

プロンプトベースの生成にはかなりのランダム性が伴います。何を望むかを記述しますが、モデルがそれをどのように配置するかを決定します。ControlNet は、構造的な制約を追加することでこの問題を解決します。モデルは、参照画像から抽出された形状、ポーズ、または線に従いながら、プロンプトからのスタイルとディテールを適用する必要があります。

パラメーター

| パラメーター | 説明 |

|---|---|

| 有効化 | 現在の生成に対して ControlNet を有効にします。 |

| 低 VRAM | GPU の VRAM が 4 GB 未満の場合はこれを有効にします。 |

| プリプロセッサ | 入力画像から構造情報 (エッジ、深度、ポーズなど) を抽出します。各プリプロセッサは対応するモデルと連携して動作します。 |

| モデル | プリプロセッサの出力を使用して生成をガイドする ControlNet モデル。モデルをダウンロードし、OSS の適切なディレクトリにアップロードします。 |

| コントロールの重み | ControlNet が出力にどれだけ強く影響するか。img2img の場合:低いノイズ除去強度 + 高いコントロールの重みは、ディテールを変更せずにスタイルを変更します。高いノイズ除去強度 + 低いコントロールの重みは、構造を維持しながらディテールを変更します。 |

| コントロール開始ステップ | ControlNet が拡散プロセスに影響を与え始めるタイミングを、総ステップ数の割合 (0~1) で示します。早期の介入は全体的な構図に影響し、後期の介入は細かいディテールに影響します。例:サンプリングステップが 20 で値が 0.3 の場合、ControlNet はステップ 6 (20 × 0.3) で開始します。 |

| 終了コントロールステップ | ControlNet が拡散プロセスへの影響を停止するタイミング (0~1)。 |

コントロールタイプ

| コントロールタイプ | 検出対象 | 最適な用途 | デフォルトモデル |

|---|---|---|---|

| Canny | エッジと輪郭 — 衣服のしわ、表情、アウトライン | キャラクターの線画、正確な輪郭制御 | control_sd15_canny |

| Depth | グレースケール値を使用したオブジェクトの距離 (明るい灰色 = 近い、暗い灰色 = 遠い) | 空間的な配置。顔のディテールにはあまり効果的ではありません | control_sd15_depth |

| NormalMap | RGB 値を使用した表面の粗さと方向 | キャラクターモデリング、複雑な表面のディテール | control_sd15_normal |

| OpenPose | 人体の骨格と関節の位置 | 異なるキャラクターやスタイルでポーズを再現する | control_sd15_openpose |

| MLSD | 直線とエッジ | 建築の内部と外部、幾何学的なオブジェクト | control_sd15_mlsd |

| Scribble/Sketch | 白黒のスケッチとラフな描画 | 手描きのスケッチから生成する。白背景の描画には [入力色を反転] を選択します | control_sd15_scribble |

| Segmentation | カテゴリ別のオブジェクト領域 | シーンの構図制御 | control_sd15_seg |

ControlNet ショーケース

内装仕上げ

推奨モデル:v1-5-pruned-emaonly.safetensors と LoRA

ポジティブプロンプト:

Interior advanced Design<lora:xsarchitectural9advanced_xsarchitectural:1>サンプリングメソッド:Euler a

ControlNet:空の部屋の画像をアップロードします。[コントロールタイプ] を [MLSD] に、[バッチサイズ] を 4 に設定します。

結果:

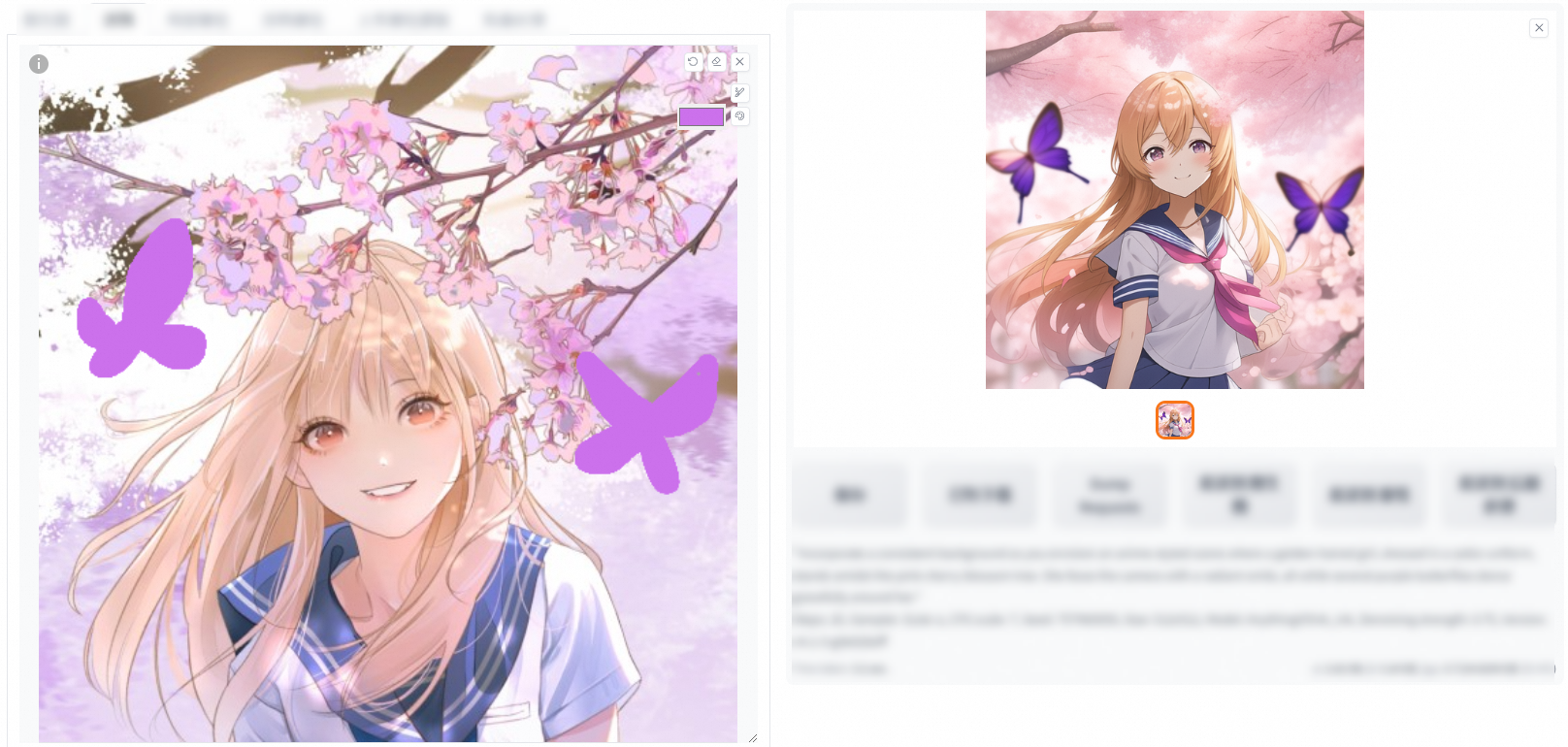

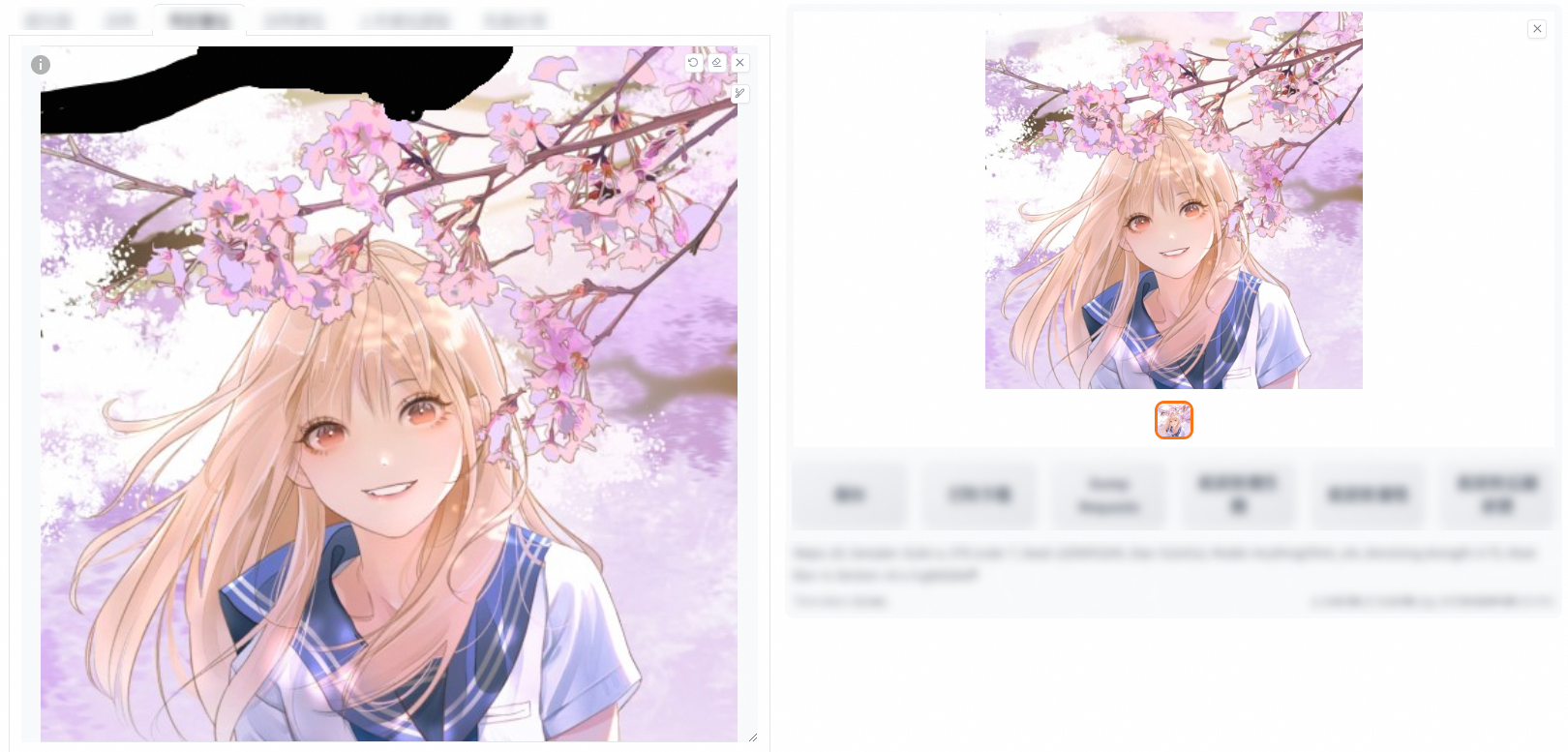

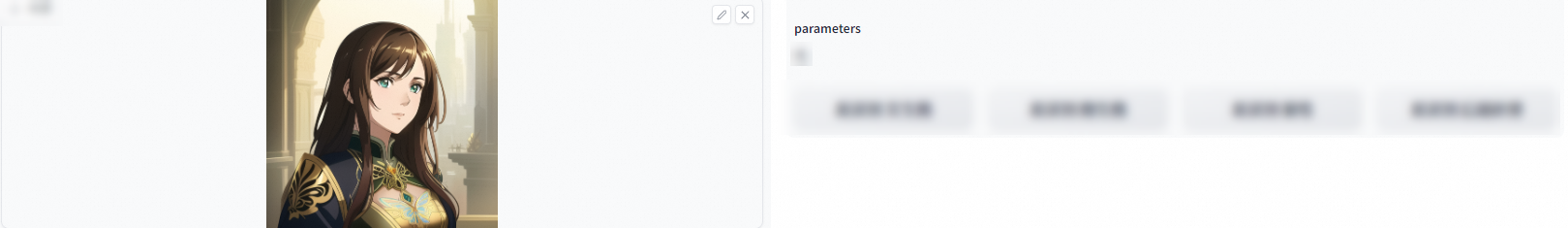

アニメ風プロフィール画像

推奨モデル:Checkpoint と LoRA

ポジティブプロンプト:

best quality, masterpiece, (realistic:1.2), 1 girl, brown hair, brown eyes,Front, detailed face, beautiful eyes <lora:hanfu_v29 Lora:1>ネガティブプロンプト:

(low quality, worst quality:1.4),nsfwサンプリングメソッド:Euler a

ControlNet:顔写真をアップロードします。[コントロールタイプ] を [Canny] に設定します。

結果:

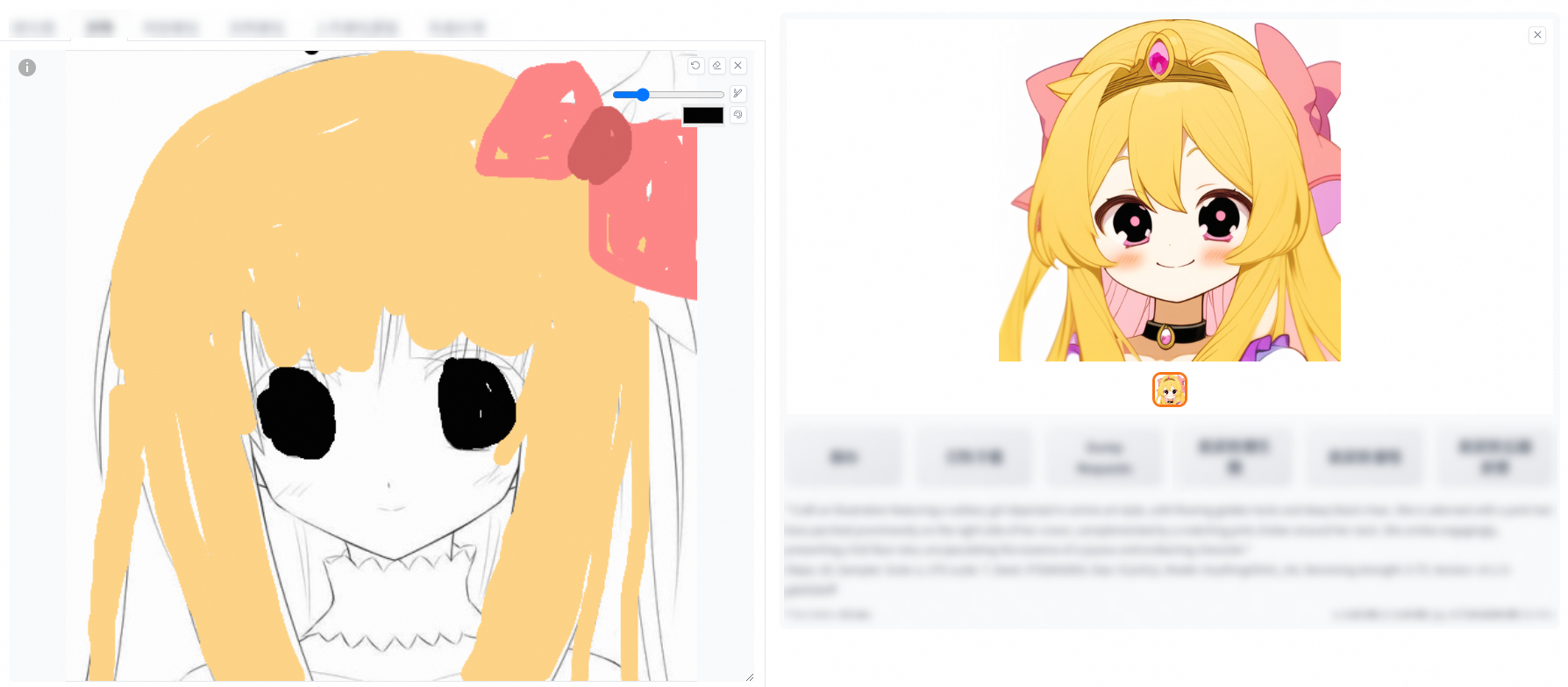

髪の色の変更

プロンプト:ポジティブプロンプトに black hair を追加します。

パラメーター:インペイント機能を使用します。髪の領域にマスクを描き、[ノイズ除去強度] を 0.6 に設定します。

結果:

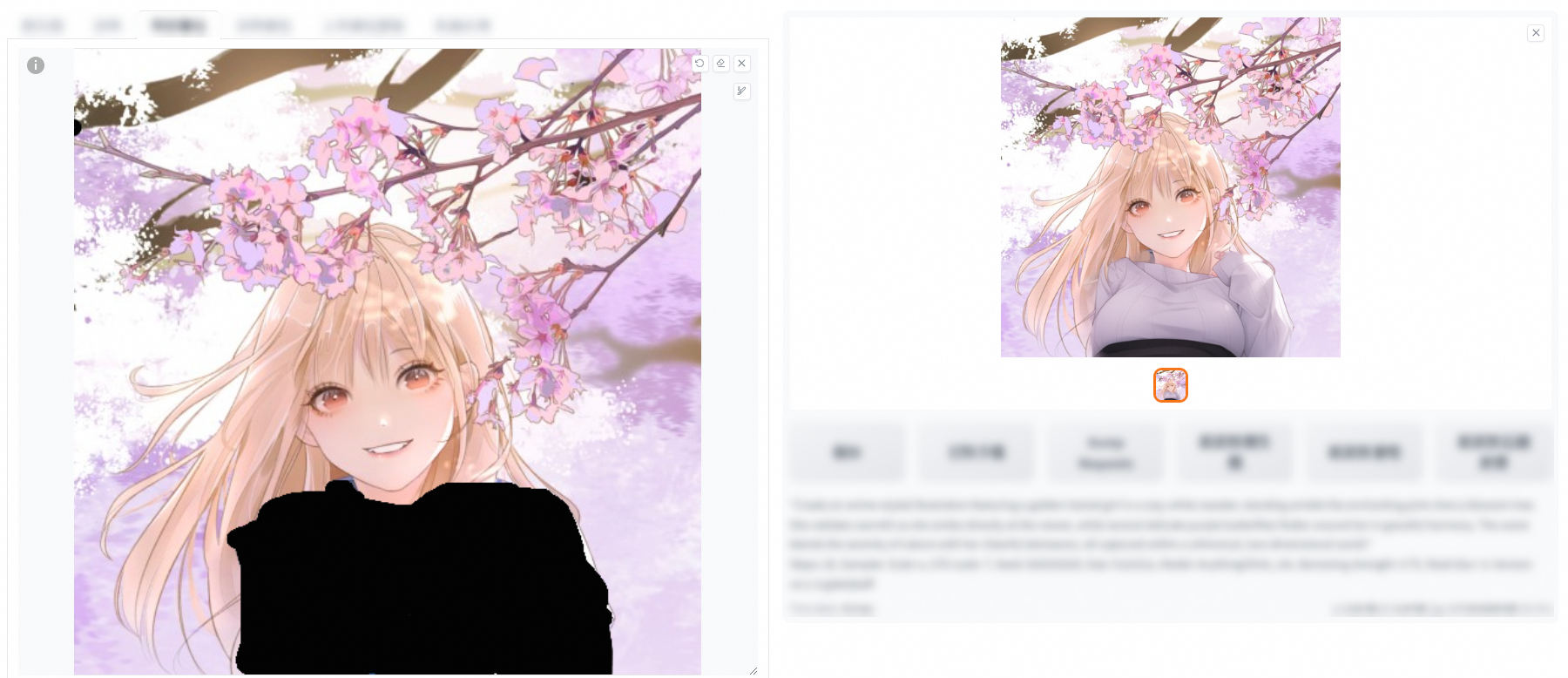

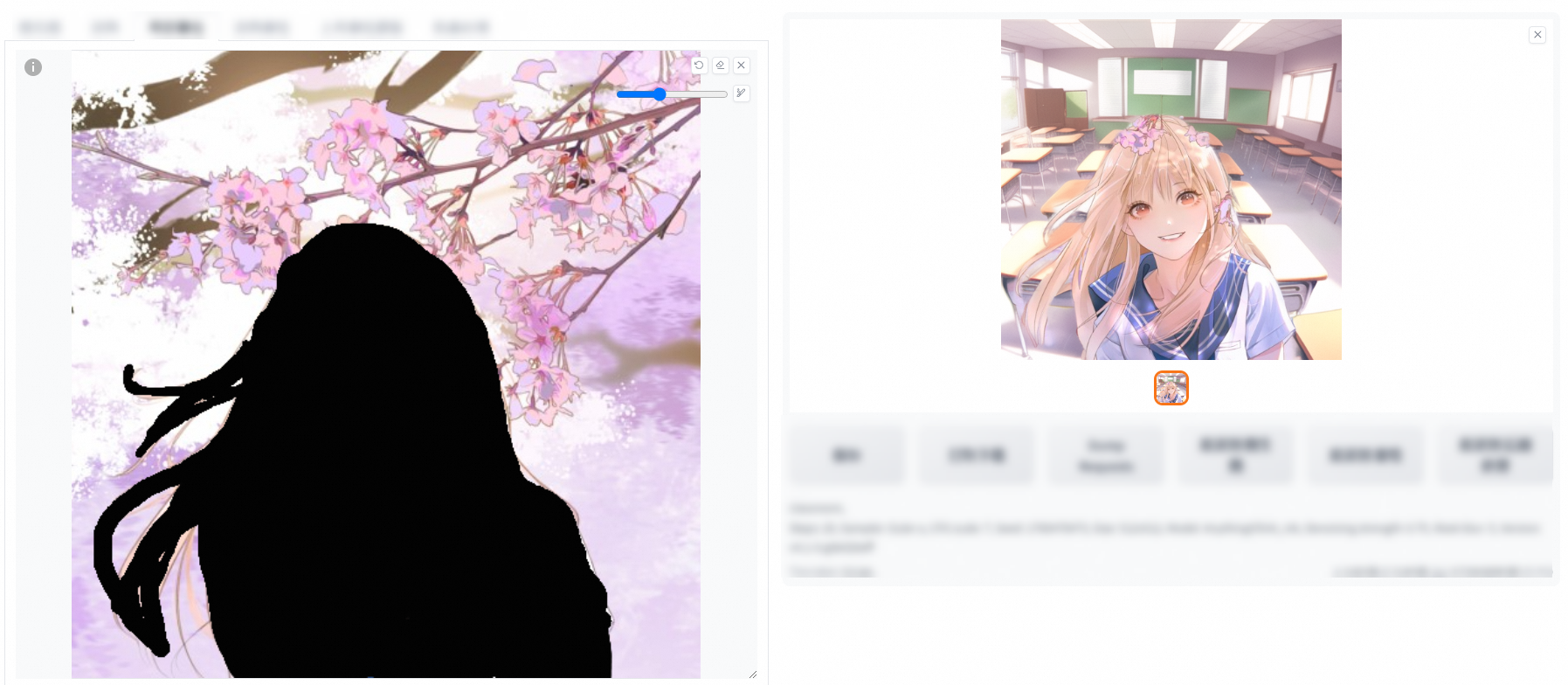

背景のインペインティング

プロンプト:ポジティブプロンプトに green trees,((beach)),((sea)),((blue sky)),black hair を追加します。括弧を使用して重みを調整し、重要な要素を強調します。

パラメーター:背景にマスクを描きます。置き換える領域に応じて [マスクモード] と [ノイズ除去強度] を調整します。

結果: