本ドキュメントは、中国 (北京) リージョンのみに適用されます。

課金方法

モデルをデプロイする前に、モデルデプロイメントコンソール (北京) で、各モデルの推定時間単位課金額をご確認ください。

サービス作成後に課金方法を変更することはできません。課金方法を切り替えるには、まずデプロイ済みのモデルを非公開にしてから、再度デプロイする必要があります。

|

プロビジョニング済みスループット

|

||

|

利用シーン |

安定したスループット、高い同時実行性、低いレイテンシが重要な、予測可能なトラフィックに最適です。 |

|

|

課金方法 |

使用期間およびプロビジョニングされたスループット |

|

|

スケーリング方法 |

スループットのセルフサービスによる増減 |

|

|

最小課金単位 |

ポストペイ:分 |

プリペイ:日 |

|

メリット |

|

|

|

プロダクト制限事項 |

|

|

コールごとのトークン使用量および過去のコール回数を確認するには、モデル監視 (北京) ページへ移動してください。

課金詳細

使用時間単位の従量課金(プロビジョニング済みスループット)

料金 = 使用時間 × (入力 TPM 単価 × 入力 TPM + 出力 TPM 単価 × 出力 TPM)

-

プリペイド注文は支払い完了後即時有効となり、N 日目の 23:59 まで有効です。22:00 以降に注文した場合、有効期限は 1 日延長されます。

-

プリペイド注文の有効期限が切れた後、サービスは 2 時間後に停止します。その後、リソースは 14 時間確保され、その後解放されます。

-

プリペイド注文を早期解約することはできません。

-

ポストペイ課金の場合、アカウントに支払い遅延があると、デプロイ済みリソースは引き続きアクティブな状態で 24 時間課金され続け、その後自動的に解放されます。

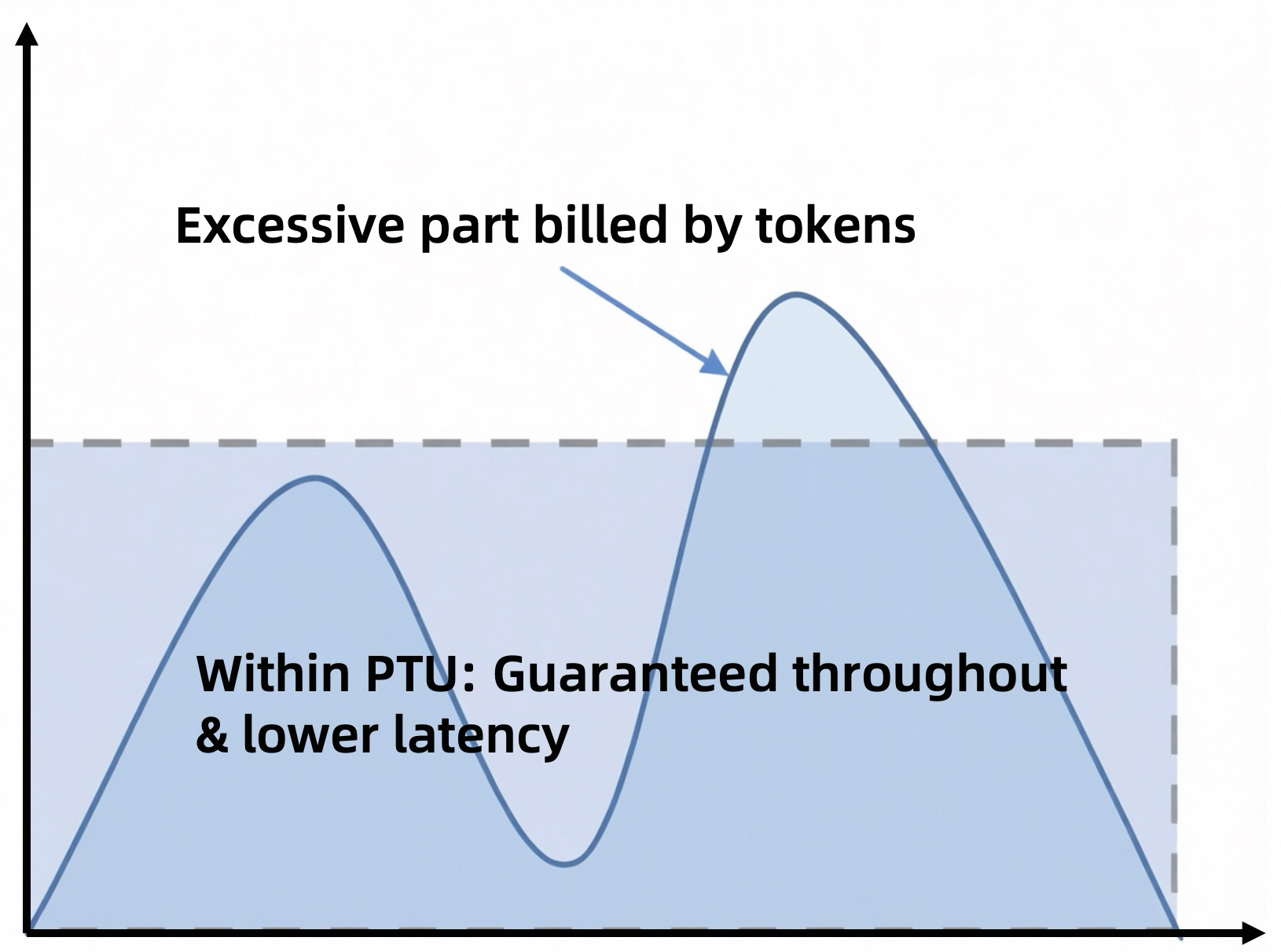

モデル入力が最大入力トークン長または購入済みの 1 分あたりトークン数 (TPM) 制限を超えた場合、関連するコールは自動的に従量課金のモデル呼び出しに切り替わります。これにより推論パフォーマンスが低下する可能性があります。これらのコールは、ワークスペース内のパブリックトラフィックに適用されるレート制限の対象となります。また、標準のモデル呼び出し(従量課金)料金で課金されます。

-

この場合、API 応答ヘッダーには

x-dashscope-ptu-overflow:trueが含まれます。 -

TPM メトリックを確認するには、モデル監視 (北京) ページへ移動してください。

|

モデル名 |

モデルタイプ |

最大コンテキスト長 (入力トークン+出力トークン) |

最大入力トークン数 |

ポストペイ – 時間単位 |

プリペイ – 日単位 |

||

|

入力(10,000 TPM あたり) |

出力(1,000 TPM あたり) |

入力(10,000 TPM あたり) |

出力(1,000 TPM あたり) |

||||

|

Qwen3-Max-2025-09-23 |

Instruct |

128,000 |

128,000 |

$1.11 |

$0.45 |

$13.32 |

$5.40 |

|

Qwen-Plus-2025-12-01 |

Instruct |

$0.28 |

$0.07 |

$3.36 |

$0.84 |

||

|

Thinking |

$0.28 |

$3.36 |

|||||

|

Qwen-Flash-2025-07-28 |

Instruct/Thinking |

$0.06 |

$0.06 |

$0.72 |

$0.72 |

||

|

Qwen3-VL-Plus-2025-09-23 |

Instruct/Thinking |

$0.35 |

$0.35 |

$4.20 |

$4.20 |

||

|

DeepSeek-v3.2 |

Instruct/Thinking |

64,000 |

$1.04 |

$0.16 |

$12.48 |

$1.92 |

|

モデルタイプ:

-

Instruct — デプロイ後にノンシンキングモードで推論を実行します。

-

Thinking — デプロイ後にシンキングモードで推論を実行します。

さらに多くのモデルをデプロイする方法については、「ソリューション」をご参照ください。お客様のビジネスニーズに最も適したデプロイオプションをお選びください。

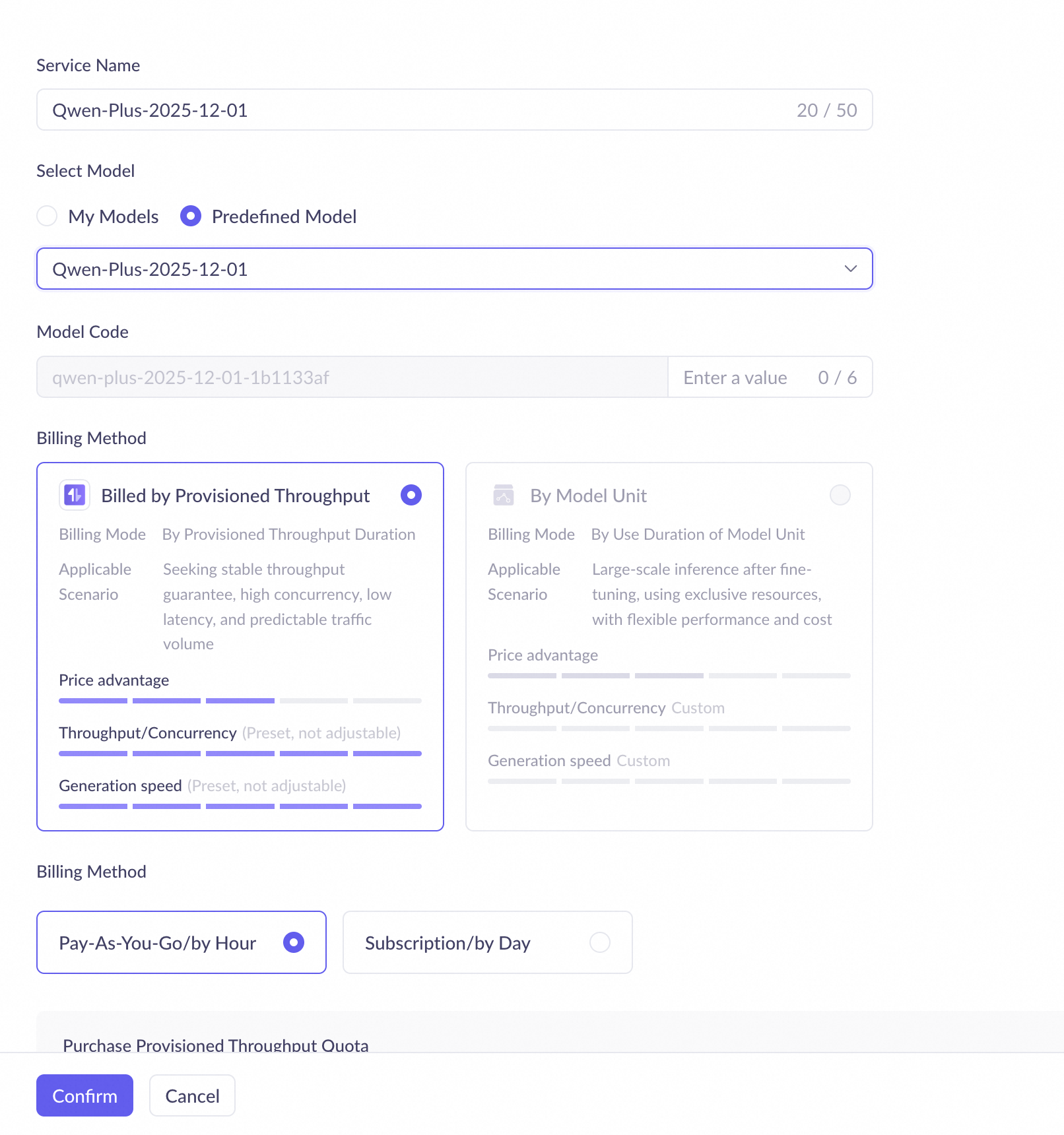

デプロイ方法

コンソールから次の手順に従ってモデルをデプロイできます。

権限エラーが発生した場合は、「デプロイ時に権限エラーが発生した場合の対処方法

|

|

|

|

重要

モデルが正常にデプロイされた時点で課金が開始されます。 |

デプロイ済みモデルの呼び出し

モデルが正常にデプロイされた後、OpenAI 互換 API、DashScope SDK、またはAssistant SDK を使用して呼び出すことができます。

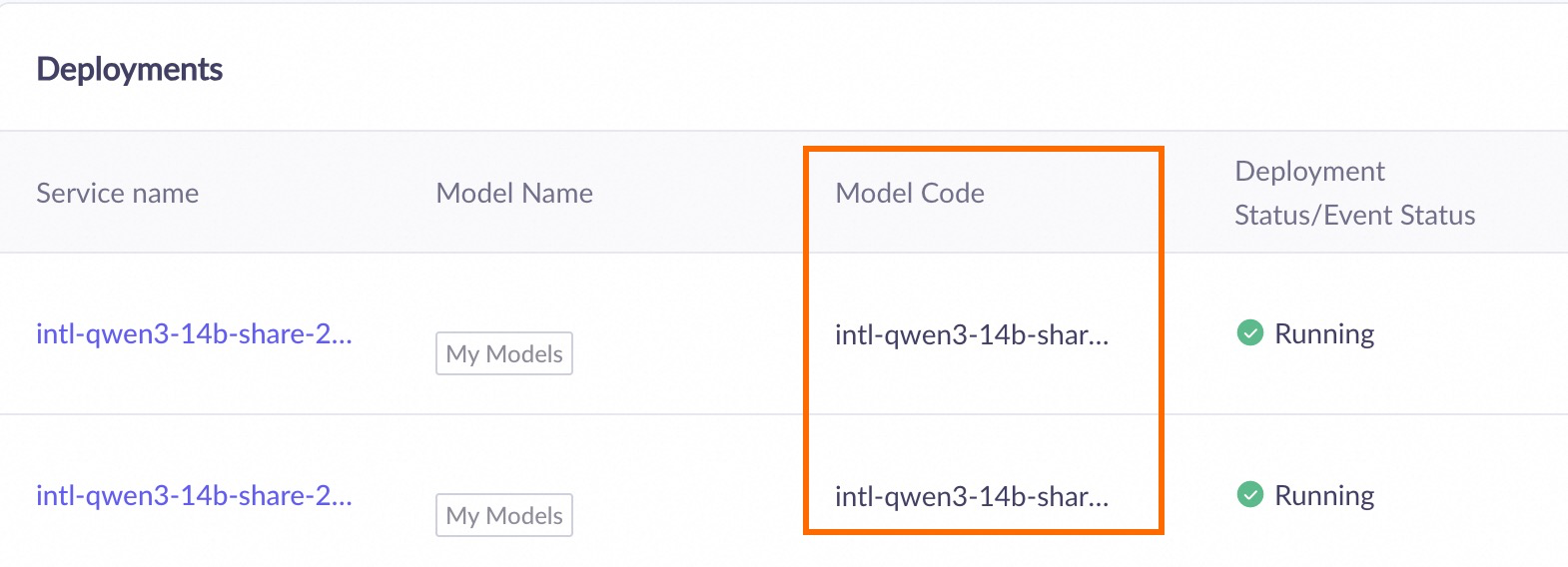

正常にデプロイされたモデルを呼び出す際は、model パラメーターの値をモデルの code にする必要があります。モデルコードを取得するには、モデルデプロイコンソール (北京) ページにアクセスして、モデルコード を取得できます。

DashScope

import os

import dashscope

messages = [

{"role": "system", "content": "あなたは親切なアシスタントです。"},

{"role": "user", "content": "あなたは誰ですか?"},

]

dashscope.base_http_api_url = 'https://dashscope-intl.aliyuncs.com/api/v1'

response = dashscope.Generation.call(

# 環境変数を設定していない場合は、次の行を Model Studio API キーに置き換えてください:api_key="sk-xxx",

api_key=os.getenv("DASHSCOPE_API_KEY"),

model="qwen3-max-xxx-xxx", # デプロイ済みモデルのコードに置き換えます

messages=messages,

result_format="message",

enable_thinking=False,

)

print(response)

OpenAI 互換インターフェース

import os

from openai import OpenAI

client = OpenAI(

# 環境変数を設定していない場合は、次の行を Model Studio API キーに置き換えてください:api_key="sk-xxx",

api_key=os.getenv('DASHSCOPE_API_KEY'),

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

)

completion = client.chat.completions.create(

model="qwen3-max-xxx-xxx", # デプロイ済みモデルのコードに置き換えます

messages=[

{"role": "system", "content": "あなたは親切なアシスタントです。"},

{"role": "user", "content": "あなたは誰ですか?"},

],

extra_body={"enable_thinking": False},

)

print(completion)

デプロイ済みサービスのスケーリング

-

プロビジョニング済みスループット(時間単位の従量課金): Scaling ボタンをクリックして、インスタンス数を手動で調整します。

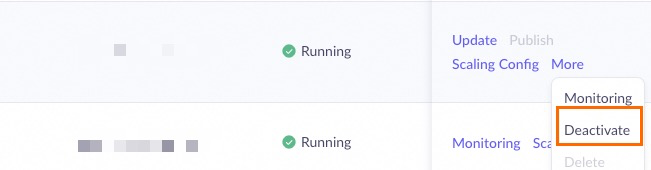

デプロイ済みサービスの非公開

「モデルデプロイメントコンソール(北京)」に移動します。非公開にしたいサービスを見つけ、「オフライン」をクリックし、操作を確認します。サービスが非公開になると、以降の課金は発生しません。

よくある質問

独自のモデルをアップロードしてデプロイできますか?

現時点では、独自のモデルをアップロードまたはデプロイすることはできません。最新情報については、Alibaba Cloud Model Studio のアナウンスをご確認ください。

または、Alibaba Cloud Platform for AI (PAI) は独自のモデルのデプロイをサポートしています。詳細については、「PAI-LLM 大規模言語モデルデプロイメント」をご参照ください。

デプロイ時に権限エラーが発生した場合、どうすればよいですか?

-

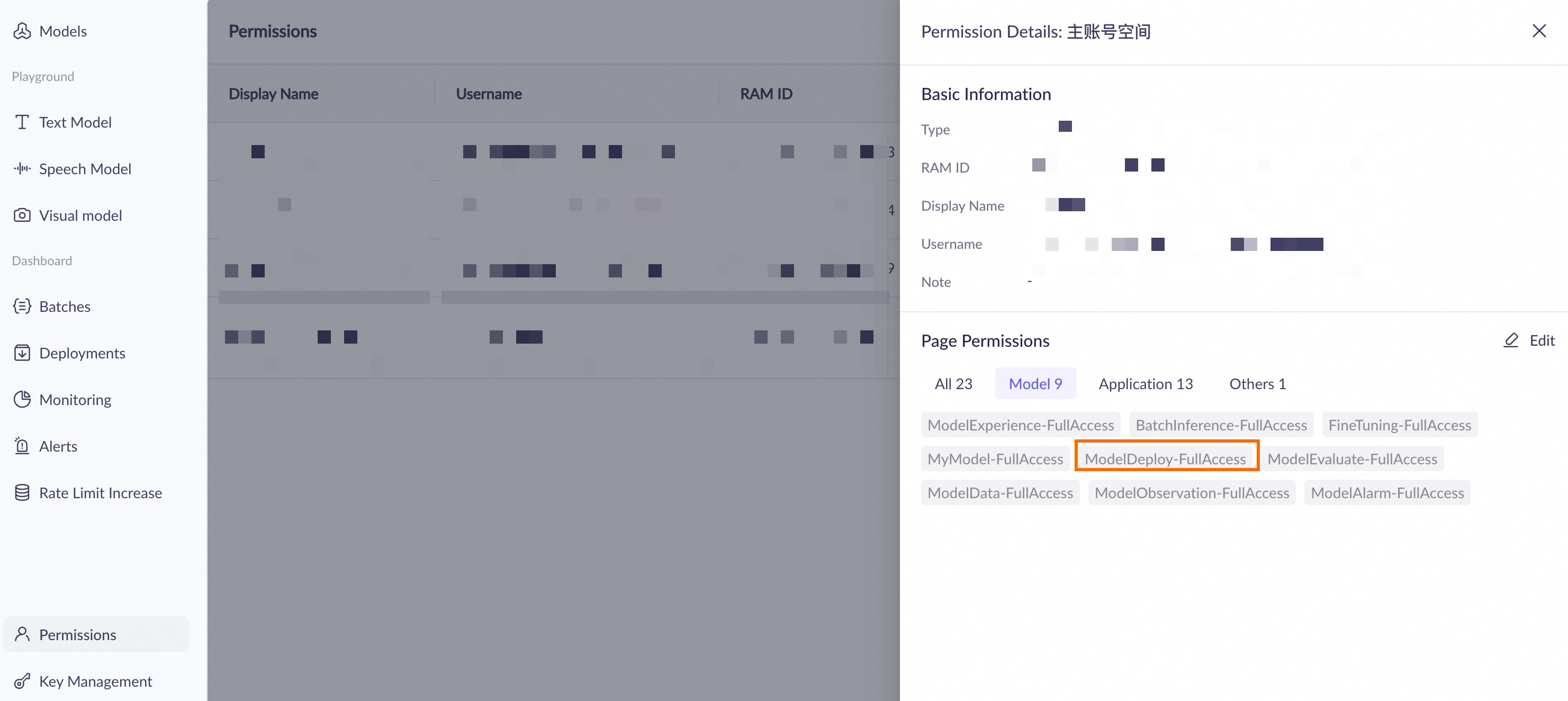

[このモジュールに対する権限がありません] エラーが表示された場合は、お使いのアカウントに、ワークスペースの権限管理ページで [モデルデプロイメント - 操作] 権限があることを確認してください。

それでも続行できない場合は、組織または IT 管理者に連絡して、必要な権限を追加してもらうか、問題のトラブルシューティングを依頼してください。

-

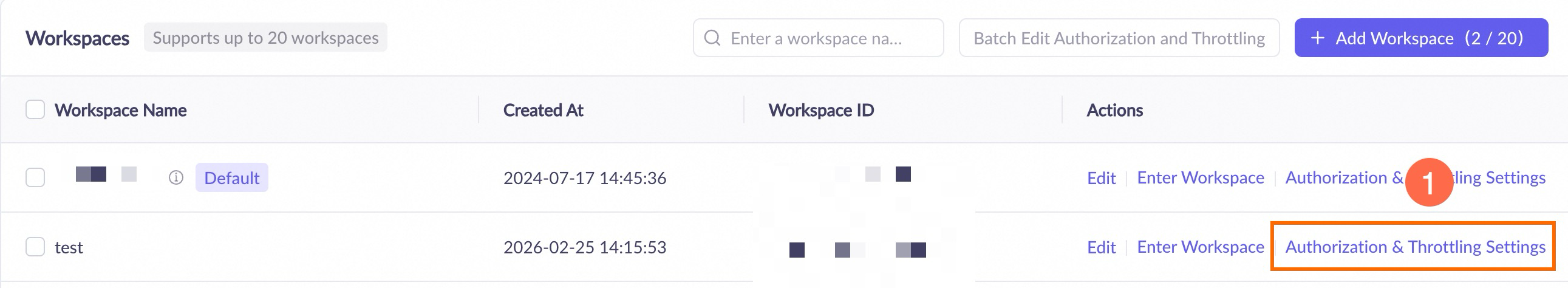

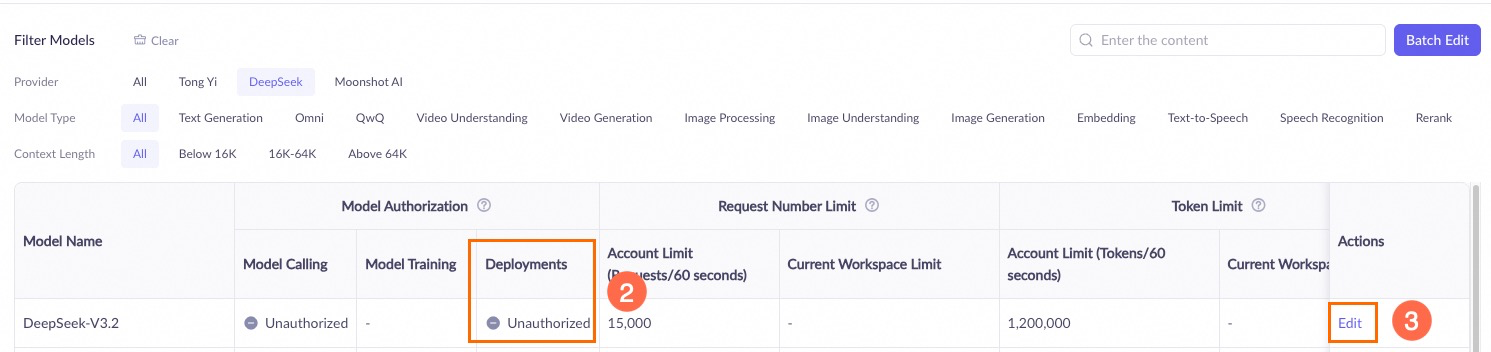

「ワークスペース X にはモデル Y をデプロイする権限がありません」というエラーでデプロイが失敗した場合は、Model Studio のワークスペース管理ページに移動し、対象のワークスペースにモデルをデプロイする権限を付与してください。

API エラーメッセージ:

Workspace xxx does not have deployment privilege for model xxxx。

必要な権限がない場合は、組織または IT 管理者に連絡して、権限を付与してもらうか、アクションを実行してもらってください。