このトピックでは、training-nv-pytorch 25.06 のリリースノートの概要について説明します。

主な機能とバグ修正

更新されたフレームワーク

PyTorch と関連コンポーネントが V2.7.1.8 にアップグレードされました

Triton Inference Server が V3.3.0 にアップグレードされました

vLLM バージョン互換性が強化され、 0.9.1 がサポートされるようになりました

NVIDIA の Blackwell GPU アーキテクチャのサポートが追加され、次世代ハードウェアでの将来を見据えた開発が可能になりました

バグ修正

PyTorch を V2.7.1.8 にアップグレードすることで、従来のコンテナイメージにおけるビデオランダムアクセスメモリ (VRAM) 最適化効率の低下が解決されました。

イメージの詳細

シナリオ | トレーニング/推論 |

フレームワーク | PyTorch |

ドライバー要件 | NVIDIA ドライバー ≥ 575 (データセンター GPU の互換性については以下を参照) |

コアコンポーネント |

|

利用可能な イメージ

V25.06

パブリックイメージ: egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/training-nv-pytorch:25.06-serverless

VPC イメージ

acs-registry-vpc.{region-id}.cr.aliyuncs.com/egslingjun/{image:tag}

{region-id}: Alibaba Cloud Container Compute Service (ACS) がアクティブ化されているリージョン (例: cn-beijing、cn-wulanchabu)。{image:tag}: イメージ名とタグ。

VPC イメージのプルは、現在、中国 (北京) リージョンでのみサポートされています。

このイメージは、ACS クラスタと Lingjun マルチテナントクラスタに適していますが、Lingjun シングルテナントクラスタではサポートされていません。

ドライバー要件

V25.06 リリースは CUDA 12.8.0 に基づいており、NVIDIA ドライバー 575 以降が必要です。 データセンター GPU (T4 など) の場合、次のドライバーバージョンと互換性があります。

470.57+ (R470 ブランチ)

525.85+ (R525 ブランチ)

535.86+ (R535 ブランチ)

545.23+ (R545 ブランチ)

重要: CUDA ドライバー互換性パッケージは、特定のドライバーブランチのみをサポートしています。 互換性のないブランチ (R418、R440、R450、R460、R510、R520、R530、R545、R555、R560) を使用しているユーザーは、CUDA 12.8 との上位互換性がないため、アップグレードする必要があります。 詳細については、「CUDA 互換性」および「CUDA 互換性とアップグレード」をご参照ください。

主な機能と拡張機能

PyTorch コンパイル最適化

torch.compile() は、単一 GPU シナリオでは大幅なパフォーマンス向上を実現しますが、FSDP や DeepSpeed などの分散フレームワークが原因で、大規模 LLM トレーニングではその利点が制限されます。

より広範なコンパイラの最適化を実現するために、次のことを行いました。

DeepSpeed 内の通信粒度を最適化し、より大きく、より一貫性のある計算グラフをコンパイラに公開しました。

コンパイラのフロントエンドを強化して、任意のグラフの中断を処理できるようにしました。

安定したコンパイルパフォーマンスのために、パターンマッチングと動的形状のサポートを改善しました。

結果: 8B パラメータ LLM トレーニングで、エンドツーエンド (E2E) スループットが約 20% 一貫して向上しました。

勾配チェックポイントの最適化

モデル、クラスタ構成、システムメトリック (メモリ使用率を含む) にわたる広範なベンチマークを通じて、最適なアクティベーション再計算レイヤーを特定するための予測モデルを開発しました。 この最適化は PyTorch にネイティブに統合され、DeepSpeed でサポートされるようになったため、高度なメモリ最適化手法を簡単に採用できます。

ACCL

Alibaba Cloud Communication Library (ACCL) は、Lingjun 向けに設計された高性能ネットワーキング (HPN) ライブラリのスイートです。

その主要コンポーネントの 1 つは ACCL-N で、これは NVIDIA Collective Communications Library (NCCL) からカスタマイズされた GPU アクセラレーション通信ライブラリです。 ACCL-N は NCCL との完全な API 互換性を維持しながら、いくつかの拡張機能を提供します。

パフォーマンスの向上: 特に大規模なマルチノードトレーニング環境において、スループットの大幅な向上と安定性の向上を実現します。

安定性の向上: 標準の NCCL バージョンではまだ利用できない、対象を絞ったバグ修正が含まれています。

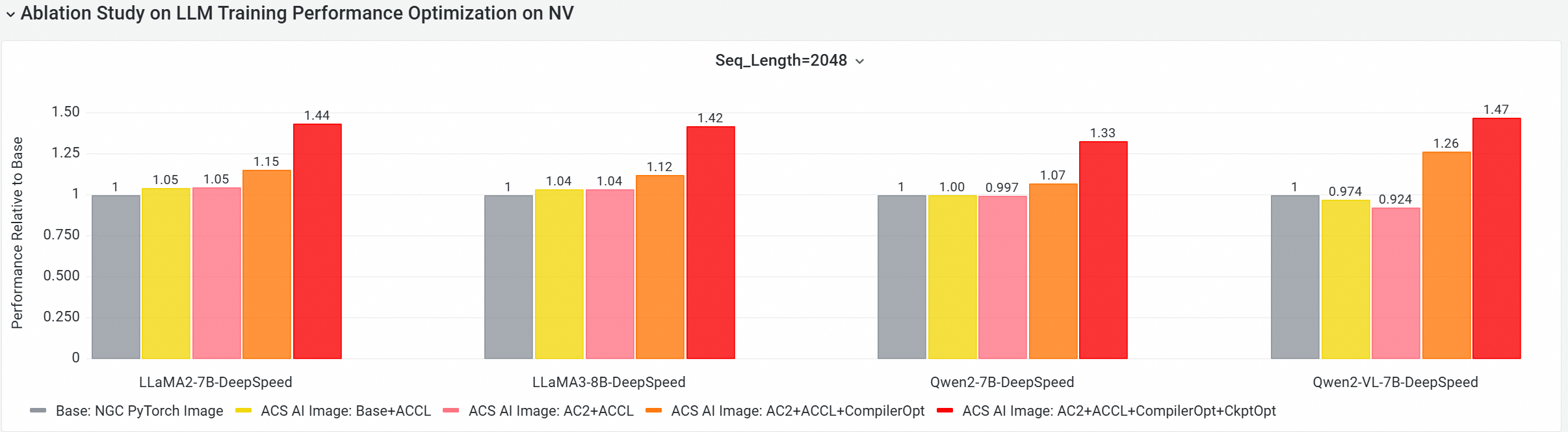

E2E パフォーマンスゲイン評価

Cloud Native Platform (CNP) AI パフォーマンス分析ツールを使用して、標準ベースイメージ (NGC PyTorch など) との包括的な E2E 比較を実施しました。 テストでは、主流のオープンソースモデルとフレームワークを使用し、各最適化の貢献度を定量化するためのアブレーションスタディを行いました。

テスト構成 (マルチノード GPU クラスタ)

テストケース | 構成 |

1. ベースライン | NGC PyTorch イメージ |

2. ACS AI イメージ: Base + ACCL | ACCL 通信ライブラリを使用したベースイメージ |

3. ACS AI イメージ: AC2+ACCL | AC2 BaseOS を使用したゴールデンイメージ (最適化なし) |

4. ACS AI イメージ: AC2 + ACCL + CompilerOpt |

|

5. ACS AI イメージ: AC2 + ACCL + CompilerOpt + CkptOpt | torch.compile と選択的勾配チェックポイントの両方の最適化を有効にした AC2 BaseOS |

クイックスタート

この例では、Docker を使用して training-nv-pytorch イメージをプルして実行します。

ACS ユーザーの場合: ACS にデプロイする場合は、コンソールの [アーティファクトセンター] からイメージを選択するか、YAML 構成でイメージを指定します。

1. イメージをプルする

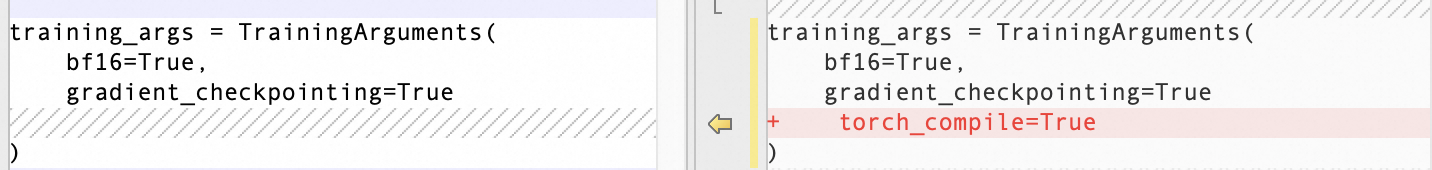

docker pull egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/training-nv-pytorch:[tag]2. コンパイラとメモリ最適化を有効にする

Transformers Trainer API を使用したコンパイル最適化

勾配チェックポイントの最適化を有効にする

export CHECKPOINT_OPTIMIZATION=true

3. コンテナを起動する

イメージには、組み込みトレーニングツール ljperf が含まれています。

LLM トレーニングの例

# コンテナを起動する

docker run --rm -it --ipc=host --net=host --privileged egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/training-nv-pytorch:[tag]

# トレーニングデモを実行する

ljperf benchmark --model deepspeed/llama3-8b 4. 使用上の推奨事項

PyTorch、DeepSpeed、または関連ライブラリを再インストールしないでください。イメージには、事前に最適化されたバイナリが含まれています。

deepspeed 構成では、

zero_optimization.stage3_prefetch_bucket_sizeを空のままにするか、autoに設定します。イメージは

NCCL_SOCKET_IFNAMEを事前に設定します。単一のポッドがトレーニング/推論タスクに 1/2/4/8 カードを要求する場合、

NCCL_SOCKET_IFNAME=eth0を設定します。 これはイメージのデフォルト構成です。16 GPU ノードトレーニングの場合: HPN を活用するには、

NCCL_SOCKET_IFNAME=hpn0を手動で設定します。

既知の問題

報告されていません。