Container Compute Service (ACS) は、基盤となるハードウェアやノード構成を管理することなく、オンデマンドの GPU コンピューティングを提供します。ACS はデプロイが容易で、従量課金制をサポートしており、大規模言語モデル (LLM) の推論タスクに最適で、推論コストの削減に役立ちます。このガイドでは、ACS に ComfyUI サービスをデプロイし、deepgpu-comfyui プラグインを使用して Wan2.1 のテキスト-to-ビデオおよび画像-to-ビデオ生成を高速化する手順を説明します。

このガイドを完了すると、次のことができるようになります。

Wan2.1 モデルファイルを永続 NAS ボリュームにダウンロードする

ACS GPU クラスターに ComfyUI サービスをデプロイする

ApplyDeepyTorch ノードを使用して高速化されたテキスト-to-ビデオ ワークフローを実行する

背景情報

ComfyUI

ComfyUI は、Stable Diffusion パイプラインを実行およびカスタマイズするためのオープンソースのノードベース UI です。コードを記述する代わりに、ビジュアルキャンバス上でノードを接続して生成ワークフローを構築します。

Wan モデル

Tongyi Wanxiang (Wan とも呼ばれる) は、Alibaba の Tongyi Lab が提供する大規模な AI アートおよび Text-to-Image (AI-Generated Content (AIGC)) モデルです。これは、Tongyi Qianwen large model series のビジュアル生成ブランチです。Wan は、中国語のプロンプトをサポートする世界初の AI アートモデルです。マルチモーダル機能を備えており、テキスト記述、手描きスケッチ、または画像スタイル変換から高品質のアートワークを生成できます。

前提条件

開始する前に、次のことを確認してください。

ACS アカウントの権限付与。ACS を初めて使用する場合は、ACS が Elastic Compute Service (ECS)、Object Storage Service (OSS)、Apsara File Storage NAS、Cloud Parallel File Storage (CPFS)、および Server Load Balancer (SLB) にアクセスできるように、デフォルトロールを割り当ててください。詳細については、「初めての ACS ユーザー向けクイックスタート」をご参照ください。

L20 (GN8IS) または G49E GPU カードを搭載した ACS GPU クラスター

モデルファイルを保存するための NAS または OSS 永続ボリューム。このガイドでは NAS ボリュームを使用します。設定手順については、「NAS ファイルシステムをボリュームとして作成する」または「静的にプロビジョニングされた OSS ボリュームを使用する」をご参照ください。

ローカル環境に Git がインストールされていること。詳細については、「Git ダウンロード」をご参照ください。

ステップ 1: モデルデータの準備

NAS ボリュームがマウントされているディレクトリで、次のコマンドを実行します。

ComfyUI リポジトリをクローンします。

git clone https://github.com/comfyanonymous/ComfyUI.git3 つの Wan2.1 モデルファイルを対応する ComfyUI ディレクトリにダウンロードします。ファイルは ModelScope の Wan_2.1_ComfyUI_repackaged プロジェクトでホストされています。

拡散モデル (

wan2.1_t2v_14B_fp16.safetensors):cd ComfyUI/models/diffusion_models wget https://modelscope.cn/models/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/master/split_files/diffusion_models/wan2.1_t2v_14B_fp16.safetensorsVAE (

wan_2.1_vae.safetensors):cd ComfyUI/models/vae wget https://modelscope.cn/models/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/master/split_files/vae/wan_2.1_vae.safetensorsテキストエンコーダー (

umt5_xxl_fp8_e4m3fn_scaled.safetensors):cd ComfyUI/models/text_encoders wget https://modelscope.cn/models/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/master/split_files/text_encoders/umt5_xxl_fp8_e4m3fn_scaled.safetensors

ダウンロードには約 30 分かかります。接続が遅い場合は、開始する前にピークパブリック帯域幅を増やしてください。

ComfyUI-deepgpu プラグインをダウンロードして抽出します。

cd ComfyUI/custom_nodes wget https://aiacc-inference-public-v2.oss-cn-hangzhou.aliyuncs.com/deepgpu/comfyui/nodes/20250513/ComfyUI-deepgpu.tar.gz tar zxf ComfyUI-deepgpu.tar.gz

ステップ 2: ComfyUI サービスのデプロイ

ACS コンソールにログインします。左側のナビゲーションウィンドウで、[クラスター] を選択します。対象のクラスター名をクリックします。次に、[ワークロード] > [デプロイメント] を選択し、[YAML から作成] をクリックします。

次の YAML マニフェストを貼り付けて、[Create] をクリックします。

persistentVolumeClaim.claimNameを、お使いの永続ボリューム要求 (PVC) の名前に置き換えます。 この例では、イメージのプル時間を最小化するために、cn-beijingリージョンから inference-nv-pytorch 25.07 イメージを使用します。 このイメージを他のリージョンから使用するには、使用方法apiVersion: apps/v1 kind: Deployment metadata: labels: app: wanx-deployment name: wanx-deployment-test namespace: default spec: replicas: 1 selector: matchLabels: app: wanx-deployment template: metadata: labels: alibabacloud.com/compute-class: gpu alibabacloud.com/compute-qos: default alibabacloud.com/gpu-model-series: L20 #Supported GPU card types: L20 (GN8IS), G49E app: wanx-deployment spec: containers: - command: - sh - -c - DEEPGPU_PUB_LS=true python3 /mnt/ComfyUI/main.py --listen 0.0.0.0 --port 7860 image: acs-registry-vpc.cn-beijing.cr.aliyuncs.com/egslingjun/inference-nv-pytorch:25.07-vllm0.9.2-pytorch2.7-cu128-20250714-serverless imagePullPolicy: Always name: main resources: limits: nvidia.com/gpu: "1" cpu: "16" memory: 64Gi requests: nvidia.com/gpu: "1" cpu: "16" memory: 64Gi terminationMessagePath: /dev/termination-log terminationMessagePolicy: File volumeMounts: - mountPath: /dev/shm name: cache-volume - mountPath: /mnt #/mnt is the path in the pod where the NAS volume claim is mapped name: data dnsPolicy: ClusterFirst restartPolicy: Always schedulerName: default-scheduler securityContext: {} terminationGracePeriodSeconds: 30 volumes: - emptyDir: medium: Memory sizeLimit: 500G name: cache-volume - name: data persistentVolumeClaim: claimName: wanx-nas #wanx-nas is the volume claim created from the NAS volume --- apiVersion: v1 kind: Service metadata: name: wanx-test spec: type: LoadBalancer ports: - port: 7860 protocol: TCP targetPort: 7860 selector: app: wanx-deploymentこのマニフェストの主要なパラメーター:

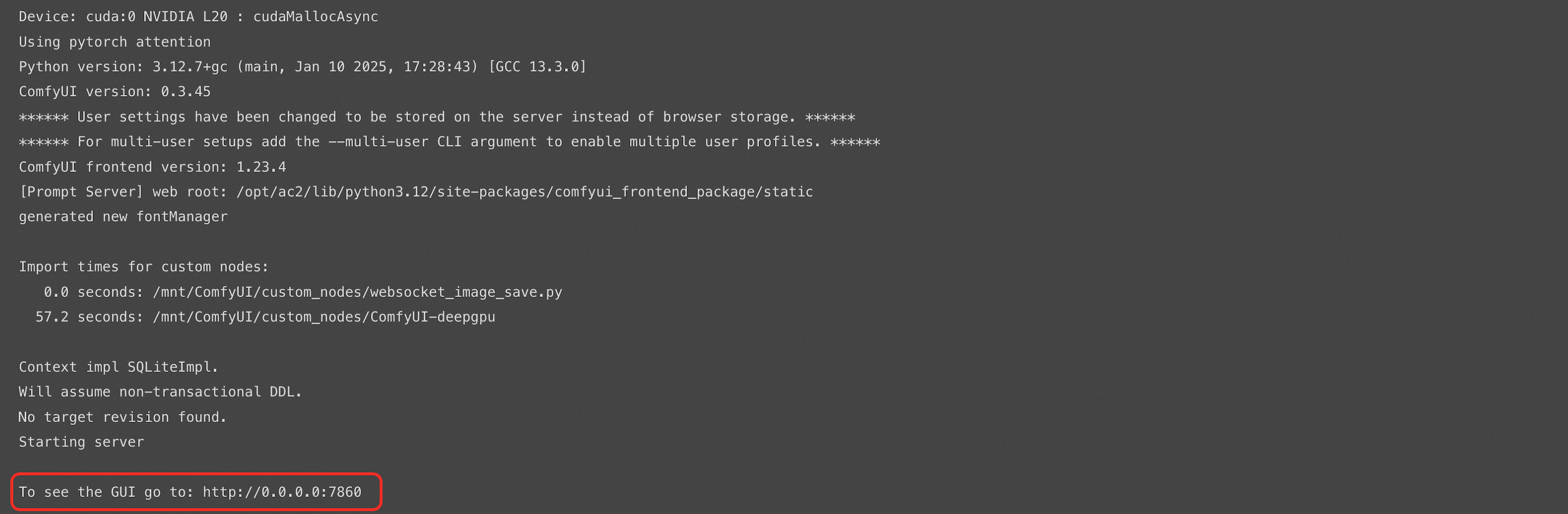

パラメーター 説明 alibabacloud.com/gpu-model-seriesGPU カードタイプ。サポートされている値: L20(GN8IS インスタンス) およびG49E。nvidia.com/gpu: "1"コンテナに 1 つの GPU を要求します。 resources.limits/requestsCPU を 16 コア、メモリを 64 GiB に設定します。 /dev/shmemptyDir (sizeLimit: 500G)共有メモリボリュームは /dev/shmにマウントされます。大規模モデル推論に必要です。mountPath: /mntNAS ボリュームがマッピングされる Pod 内のパスです。ComfyUI およびモデルファイルはこのパスからアクセスされます。 persistentVolumeClaim.claimNameご利用の PVC の名前です。 wanx-nasを実際の PVC 名に置き換えてください。表示されたダイアログで、[表示] をクリックして、ワークロードの詳細ページを開きます。[ログ] タブをクリックします。サービスが正常に起動すると、ログ出力は次のようになります:

ステップ 3: ComfyUI インターフェイスへのアクセス

ワークロード詳細ページで、[アクセス方法] タブをクリックして、サービスの外部エンドポイント (

8.xxx.xxx.114:7860など) を取得します。

ブラウザで

http://8.xxx.xxx.114:7860/を開きます。初めて URL にアクセスする場合、ロードに約 5 分かかる場合があります。

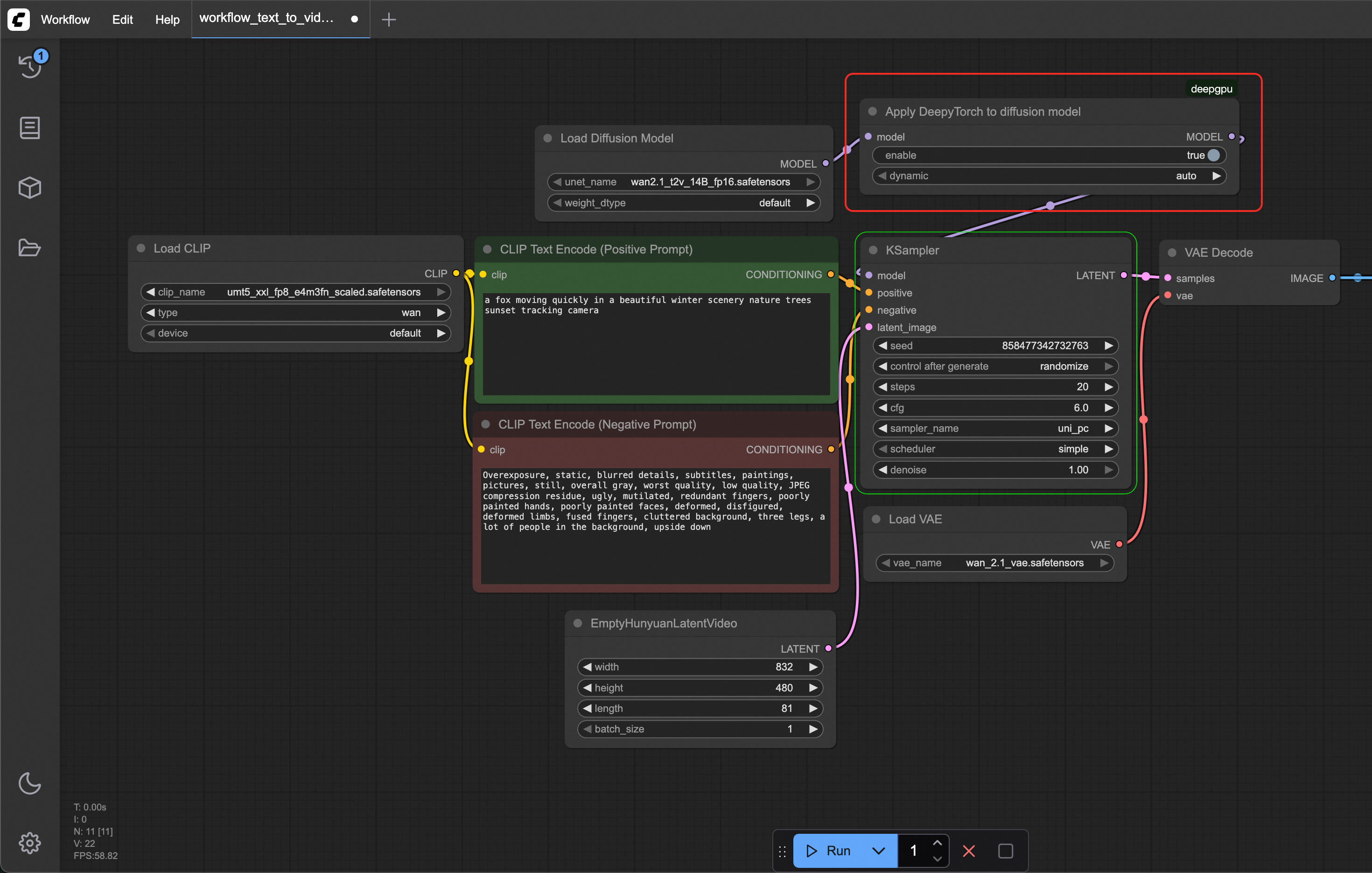

ComfyUI インターフェイスで任意の場所を右クリックし、[ノードの追加] をクリックすると、プラグインから利用可能な [DeepGPU] ノードを閲覧できます。ApplyDeepyTorch ノードは、GPU レベルのアクセラレーションを適用することで、拡散モデルの推論を最適化します。ワークフロー内の最後のモデル読み込みノードの後に挿入します。ノードは次のようになります:

ステップ 4: 高速化されたワークフローの実行

次の事前に構築された Wan2.1 ワークフローのいずれか、または両方をローカルマシンにダウンロードします。

画像-to-ビデオ ワークフロー:

https://aiacc-inference-public-v2.oss-cn-hangzhou.aliyuncs.com/deepgpu/comfyui/wan/workflows/workflow_image_to_video_wan_1.3b_deepytorch.jsonテキスト-to-ビデオ ワークフロー:

https://aiacc-inference-public-v2.oss-cn-hangzhou.aliyuncs.com/deepgpu/comfyui/wan/workflows/workflow_text_to_video_wan_deepytorch.json

次の手順では、高速化されたテキスト-to-ビデオ ワークフローを例として使用します。

ComfyUI で、ワークフロー > 開く を選択し、ダウンロード済みの

workflow_text_to_video_wan_deepytorch.jsonファイルを選択します。「[DeepyTorch を拡散モデルに適用]」ノードを見つけます。その[有効]パラメーターを[true]に設定します。

DeepyTorch で高速化されたワークフローは、Load Diffusion Model ノードの後に ApplyDeepyTorch ノードを挿入します。

[実行] をクリックして、動画の生成を待ちます。

左側にある [キュー] ボタンをクリックして、生成時間を表示し、出力のプレビューを確認します。

最初の実行は、モデルがウォームアップするため、その後の実行よりも時間がかかります。安定したパフォーマンスを確認するには、ワークフローをさらに 2、3 回実行してください。

(オプション) 高速化なしで生成時間を比較するには、ComfyUI サービスを再起動し、高速化されていないワークフロー (

https://aiacc-inference-public-v2.oss-cn-hangzhou.aliyuncs.com/deepgpu/comfyui/wan/workflows/workflow_text_to_video_wan.json) を実行します。