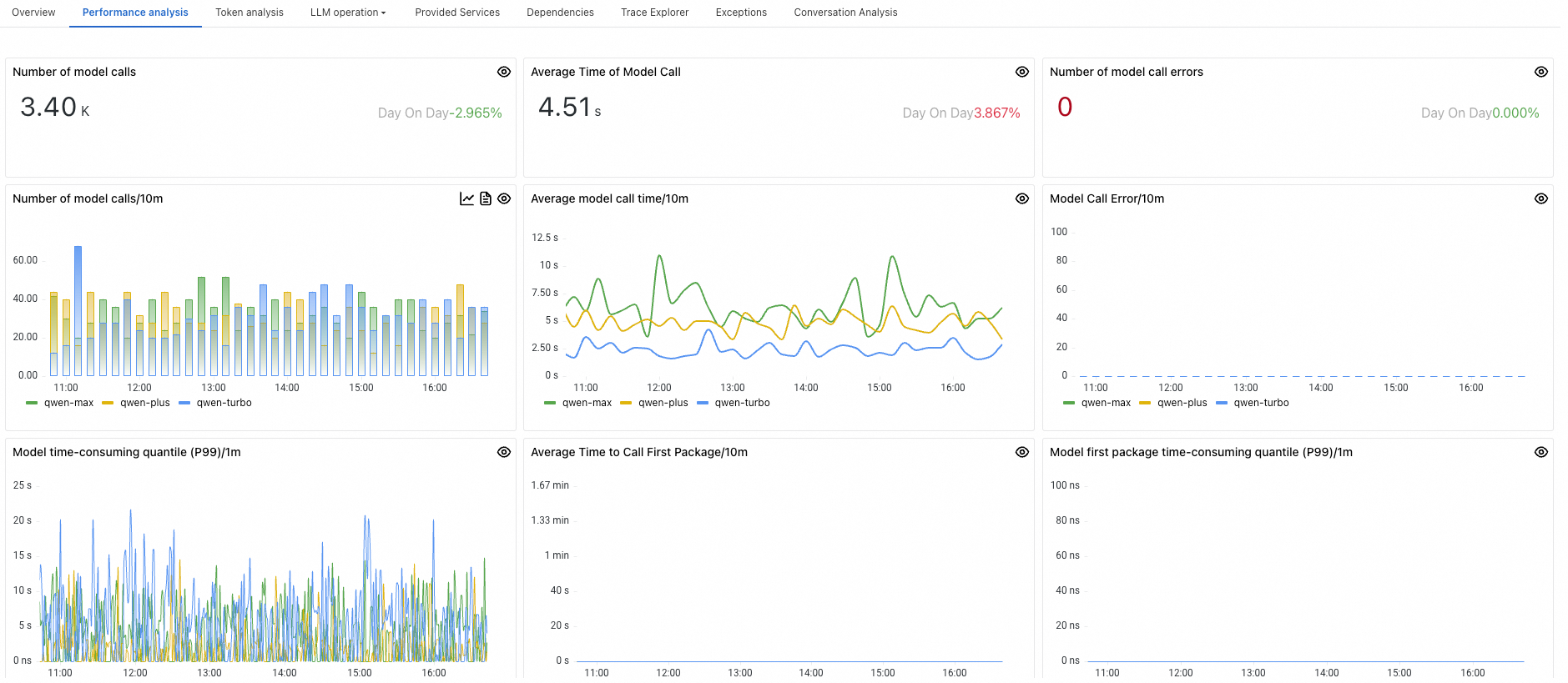

LLM(大規模言語モデル)アプリケーション用に Python プローブをインストールすると、ARMS はパフォーマンスの監視を開始します。 パフォーマンス分析 ページで、呼び出し回数、平均応答時間、エラー率などのメトリックにアクセスできます。

前提条件

プローブは LLM アプリケーションにインストールされている必要があります。 詳細については、「参照ドキュメント」をご参照ください。

LLM アプリケーションのパフォーマンス分析の表示

-

上部のナビゲーションバーで、パフォーマンス分析 をクリックします。

パネル

説明

モデル呼び出し回数

指定された期間内にアプリケーションによって大規模言語モデルが呼び出された回数。

平均モデル呼び出し時間

指定された期間内にアプリケーションが大規模言語モデルを呼び出すのにかかった平均時間。

モデル呼び出しエラー回数

指定された期間内にアプリケーションが大規模言語モデルの呼び出しに失敗した回数。

モデル呼び出し回数/1m

アプリケーションによる大規模言語モデルの呼び出し頻度(1 分あたり)。

平均モデル呼び出し時間/1m

大規模言語モデルの呼び出しにかかる平均時間(1 分あたり)。

モデル呼び出しエラー/1m

1 分あたりに発生する呼び出しエラーの数。

モデル呼び出し時間分位数(P99)/1m

呼び出し時間の P99 分位数。呼び出しの 99% が 1 分あたりこの期間内に完了することを示します。

平均ファーストパケットモデル呼び出し時間/1m

アプリケーションが大規模言語モデルから最初のデータパケットを受信するまでの平均時間(1 分あたり)。

ファーストパケットモデル呼び出し時間分位数(P99)/1m

大規模言語モデルの呼び出し時に最初のデータパケットを受信するまでの時間の P99 分位数(1 分あたり)。

上位 5 件のモデル呼び出しランキング

呼び出し回数の上位 5 件のモデルのリスト(多い順)。

上位 5 件の平均モデル呼び出し時間ランキング

平均呼び出し時間の上位 5 件のモデルのリスト(長い順)。

上位 5 件のモデル呼び出しエラーランキング

呼び出しエラー回数の上位 5 件のモデルのリスト(多い順)。