モデル API は、人工知能 (AI) アプリケーションを開発するチーム向けに設計されており、柔軟でインテリジェントな AI ゲートウェイの構成とデバッグを提供します。AI プロキシ、AI 可観測性、コンシューマー権限付与、Content Moderation などのさまざまなプラグインをプリセットできます。このトピックでは、モデル API の作成、編集、デバッグ、削除方法について説明します。

モデル API の作成

左側のナビゲーションウィンドウで、[LLM API] をクリックします。次に、[LLM API の作成] をクリックします。

シナリオを選択し、対応する [作成] ボタンをクリックします。

選択したシナリオによって、利用可能な [プロトコル] オプションと、システムが自動的に作成する デフォルトルート が決まります。次のシナリオがサポートされています。

テキスト生成 (テキスト): OpenAI 互換および Anthropic プロトコルをサポートします。

イメージ生成

ビデオ生成 (ビデオ)

音声合成 (オーディオ)

埋め込み

テキストランキング (Rerank)

その他

基本情報を構成します。

ポップアップウィンドウで、まず [シナリオの選択] セクションを完了します。開いた [モデル API の作成] フォームで、次のように設定を構成します:

プロトコル: 各プロトコルは、選択したシナリオ向けに組み込みの デフォルトルート のセットを提供します。これにより、OpenAI、DashScope、vLLM などの一般的なサービスと互換性のある API を迅速に生成できます。

API 名: API のカスタム名。名前はアカウント内でグローバルに一意である必要があり、最大 64 文字までです。名前には、文字、数字、アンダースコア (_)、ハイフン (-) を使用できます。

ドメイン名: API へのアクセスに使用されるドメイン名。複数選択できます。ドメイン名とベースパス

BasePathの組み合わせは一意である必要があります。ドメイン名がない場合は、右側の [ドメイン名の追加] ボタンをクリックして作成します。

ベースパス: API のベースリクエストパス。デフォルト値は

/です。[バックエンドサービスへの転送時にベースパスを削除] を有効にすることもできます。説明[バックエンドサービスへの転送時に削除] を有効にすると、システムはリクエストをバックエンドサービスに転送する前に、リクエスト URI からベースパスを自動的に削除します。例:

ベースパスは /api に設定されています。

元のリクエストパスは /api/users です。

バックエンドサービスに転送されるパスは /users です。

AI リクエストの可観測性: この機能を有効にすると、メトリック、ロギング、およびトレース情報を表示できます。ロギングとトレースは、SLS ログ配信サービスに依存します。[リクエスト内容の記録] と [応答内容の記録] を選択して、large モデルに送信されたリクエストや large モデルから返されたコンテキストを記録できます。

重要この機能を有効にすると、システムはリクエストボディを含むすべての AI リクエストコンテンツをアクセスログに記録します。SLS を適切に構成し、データセキュリティ保護対策を実装していることを確認してください。

Large モデルサービス: [単一モデルサービス]、[複数モデルサービス (モデル名による)]、および [複数モデルサービス (重みによる)] をサポートします。

単一モデルサービス: 1 つの AI サービスを選択し、[モデル名] を設定します。モデル名は、パススルーまたは書き換えが可能です。

複数モデルサービス (モデル名による): リクエストボディのモデル名とルールを照合して、リクエストを異なるサービスにルーティングします。ルールは、ワイルドカード文字

?と*をサポートします。たとえば、qwen-*はqwen-maxとqwen-longに一致します。複数モデルサービス (重みによる): 複数の AI サービスを選択し、その重みを設定します。このサービスは、モデル名のパススルーまたは書き換えをサポートします。

フォールバック: この機能を [有効化] し、複数のフォールバックポリシーを順番に構成できます。同じサービスを再利用できます。

最初のパッケージのタイムアウト: ストリーミング応答で最初の応答パッケージを待機する最大時間 (ミリ秒単位)。この設定は、応答レイテンシーに敏感なストリーミングインタラクションシナリオに適しています。値 0 はこの機能を無効にします。

リソースグループ: デフォルトのリソースグループ、既存のリソースグループを選択するか、新しいリソースグループを作成できます。リソースグループは、アカウント内のリソースをグループ化、権限付与、およびモニターするために使用されます。

新しいリソースグループを作成するには、[リソースグループの作成] をクリックします。

パラメーターを確認し、[OK] をクリックしてモデル API を作成します。

デフォルトルートの詳細

このセクションでは、さまざまな シナリオ に対してさまざまな プロトコル を選択したときにシステムが自動的に作成する デフォルトルート について説明します。

テキスト生成 (テキスト)

プロトコル: OpenAI 互換 (OpenAI/v1)

ルート名 | パス | メソッド | 説明 |

|

| POST | 指定されたチャット会話に対するモデルの応答を作成します。 |

|

| POST | 提供されたプロンプトとパラメーターの補完を作成します。 |

プロトコル: Anthropic (Anthropic)

Anthropic プロトコルは、Claude などの Anthropic シリーズのモデル用に設計されています。ネイティブのメッセージフォーマットとインタラクションメソッドを提供します。このプロトコルは、ネイティブの Anthropic API フォーマットを必要とするアプリケーションシナリオに適しています。

このプロトコルをサポートする Large モデルプロバイダーには、Alibaba Cloud Model Studio (Qwen)、Claude、Moonshot AI (Moonshot)、Zhipu AI が含まれます。これらのプロバイダーの AI サービスは、追加の構成を必要とせずに Anthropic プロトコルを自動的にサポートします。

ルート名 | パス | メソッド | 説明 |

|

| POST | Anthropic のネイティブメッセージフォーマットを使用して、指定されたチャット会話のメッセージを作成します。 |

イメージ生成 (イメージ)

プロトコル: Alibaba Cloud Model Studio イメージ生成

ルート名 | パス | メソッド | 説明 |

|

| POST | text-to-image 合成イメージを生成します。 |

|

| POST | image-to-image 合成イメージを生成します。 |

|

| POST | image-to-image アウトペインティングイメージを生成します。 |

|

| POST | 仮想モデルイメージを生成します。 |

|

| POST | バックグラウンド生成イメージを生成します。 |

|

| GET/POST/PUT/PATCH/DELETE | 非同期タスクを管理します。 |

プロトコル: OpenAI 互換

ルート名 | パス | メソッド | 説明 |

|

| POST | イメージを生成します。 |

|

| POST | イメージを編集します。 |

|

| POST | 指定されたイメージのバリエーションを作成します。 |

プロトコル: ComfyUI

ルート名 | パス | メソッド | 説明 |

|

| GET | サーバーとのリアルタイム通信用の WebSocket エンドポイント。 |

|

| GET | 利用可能な埋め込みのリストを取得します。 |

|

| GET | Web ディレクトリを登録する拡張機能のリストを取得します。 |

|

| GET | サーバーの特徴と機能を取得します。 |

|

| GET | 利用可能なモデルタイプのリストを取得します。 |

|

| GET | 特定のフォルダ内のモデルを取得します。 |

|

| GET | カスタムノードモジュールと関連するテンプレートワークフローのマップを取得します。 |

|

| POST | イメージをアップロードします。 |

|

| POST | マスクをアップロードします。 |

|

| GET | イメージを表示します。多くのオプションがあります。 |

|

| GET | モデルのメタデータを取得します。 |

|

| GET | Python バージョン、デバイス、VRAM などのシステム情報を取得します。 |

|

| GET/POST | 現在のキューステータスと実行情報を取得するか、プロンプトをキューに送信します。 |

|

| GET | すべてのノードタイプの詳細を取得します。 |

|

| GET | 1 つのノードタイプの詳細を取得します。 |

|

| GET/POST | キューの履歴を取得します。 |

|

| GET | 特定のプロンプトのキュー履歴を取得します。 |

|

| GET/POST | 実行キューの現在の状態を取得するか、キュー操作を管理します。 |

|

| POST | 現在のワークフローの実行を停止します。 |

|

| POST | 指定されたモデルをアンロードしてメモリを解放します。 |

|

| GET | 指定されたディレクトリ内のユーザーデータファイルをリストします。 |

|

| GET | ファイルとディレクトリを構造化されたフォーマットでリストします。 |

|

| GET/POST/DELETE | 特定のユーザーデータファイルの取得、アップロード、更新、または削除を行います。 |

|

| POST | ユーザーデータファイルを移動または名前変更します。 |

|

| GET/POST | ユーザー情報を取得するか、新しいユーザーを作成します。 |

ビデオ生成 (ビデオ)

プロトコル: Alibaba Cloud Model Studio ビデオ生成

ルート名 | パス | メソッド | 説明 |

|

| POST | ビデオ生成合成ビデオを生成します。 |

|

| POST | image-to-video 合成ビデオを生成します。 |

|

| GET/POST/PUT/PATCH/DELETE | 非同期タスクを管理します。 |

音声合成 (オーディオ)

プロトコル: Alibaba Cloud Model Studio 音声合成

ルート名 | パス | メソッド | 説明 |

|

| GET | text-to-audio 合成オーディオを生成します。 |

プロトコル: OpenAI 互換 (OpenAI/v1)

ルート名 | パス | メソッド | 説明 |

|

| POST | 音声オーディオを生成します。 |

ベクトル化 (埋め込み)

プロトコル: OpenAI 互換 (OpenAI/v1)

ルート名 | パス | メソッド | 説明 |

|

| POST | 入力テキストを表す埋め込みベクトルを作成します。 |

テキスト再ランキング (Rerank)

プロトコル: Alibaba Cloud Model Studio テキスト再ランキング

ルート名 | パス | メソッド | 説明 |

|

| POST | クエリの関連性に基づいて、指定されたドキュメントを再ランキングします。 |

プロトコル: vLLM (vLLM)

ルート名 | パス | メソッド | 説明 |

|

| POST | クエリの関連性に基づいて、指定されたドキュメントを再ランキングします。 |

その他

プロトコル: OpenAI 互換 (OpenAI/v1)

ルート名 | パス | メソッド | 説明 |

|

| GET/POST/PUT/PATCH/DELETE | モデルを管理します。 |

|

| GET/POST/PUT/PATCH/DELETE | ファイルを管理します。 |

|

| GET/POST/PUT/PATCH/DELETE | バッチを管理します。 |

|

| GET/POST/PUT/PATCH/DELETE | ファインチューニングタスクを管理します。 |

互換性: Alibaba Cloud Model Studio、Claude、Moonshot AI、Zhipu AI など、Anthropic プロトコルをサポートする large モデルプロバイダー用の AI サービスを作成すると、複数のプロトコルが自動的にサポートされます。これらのプロトコルには、OpenAI 互換プロトコルと Anthropic プロトコルが含まれます。その後、モデル API を作成するときに適切なプロトコルを選択できます。

モデル API の編集

左側のナビゲーションウィンドウで [モデル API] をクリックし、対象の API の [操作] 列にある [編集] をクリックします。[モデル API の編集] パネルで、パラメーターを変更します。パラメーターの詳細については、「モデル API の作成」をご参照ください。

変更を確認し、[OK] をクリックします。

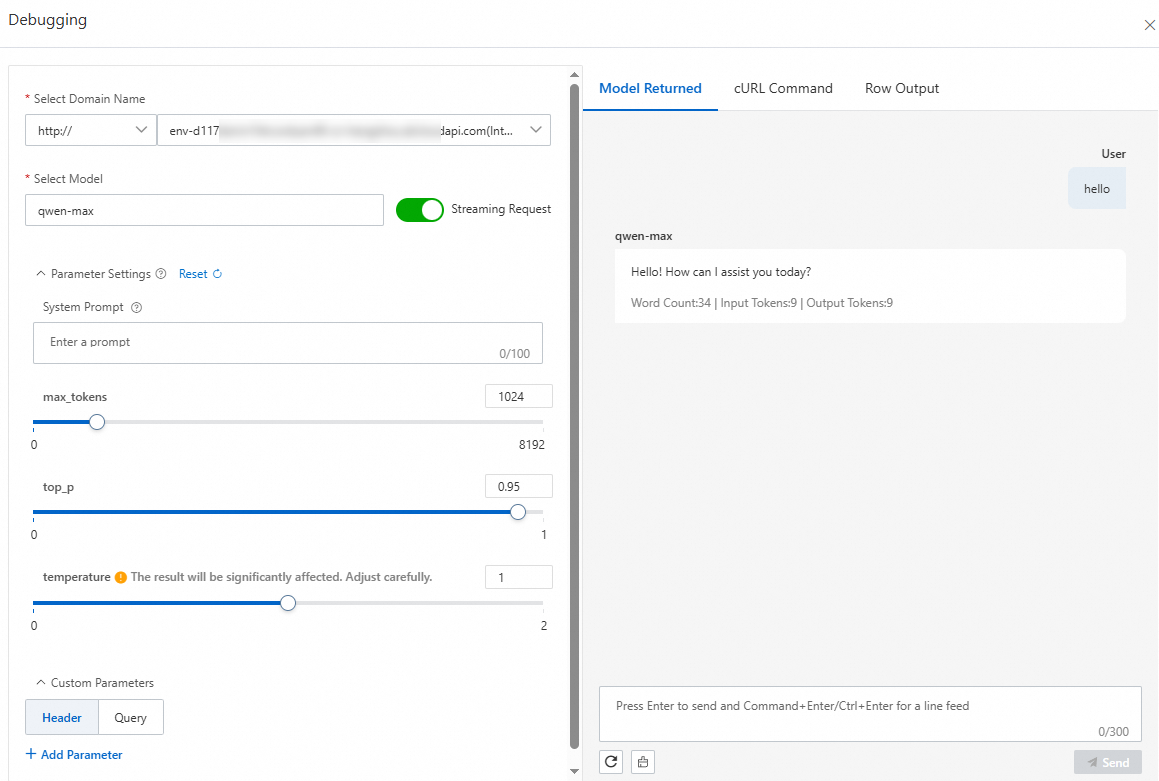

モデル API のデバッグ

現在、テキスト生成は /v1/chat/completions エンドポイントを使用してのみデバッグできます。

左側のナビゲーションウィンドウで [モデル API] を選択し、対象の API の [操作] 列にある [デバッグ] をクリックします。

[デバッグ] パネルで、ドメイン名とモデルを選択し、必要に応じて [ストリーミングリクエスト] スイッチを有効にし、パラメーターとカスタムパラメーターを構成します。[モデル応答] タブで、コンテンツを入力し、[送信] をクリックしてデバッグを開始します。

モデル API の削除

左側のナビゲーションウィンドウで [モデル API] を選択し、対象の API の [操作] 列にある [削除] をクリックします。表示される確認ダイアログボックスで、API 名を入力し、[削除] をクリックします。