Topik ini menjelaskan metrik waktu proses untuk tugas transformasi data (versi baru), cara melihat dasbor transformasi data, serta cara mengonfigurasi pemantauan tugas.

Data metrik

Untuk melihat metrik tugas transformasi data (versi baru), Anda harus mengaktifkan Task Run Logs di SLS. Untuk informasi selengkapnya tentang cara mengaktifkan Task Run Logs, lihat Kelola log layanan.

Dasbor

Setelah membuat tugas transformasi data, Simple Log Service secara otomatis membuat dasbor untuk tugas tersebut. Dasbor ini tersedia di halaman detail tugas dan memungkinkan Anda melihat metrik terkait tugas tersebut.

Prosedur

Masuk ke Konsol Simple Log Service.

Pada bagian Proyek, klik proyek yang diinginkan.

Di panel navigasi sebelah kiri, pilih .

Klik tugas transformasi data yang dituju. Di bagian Execution Status, lihat dasbor.

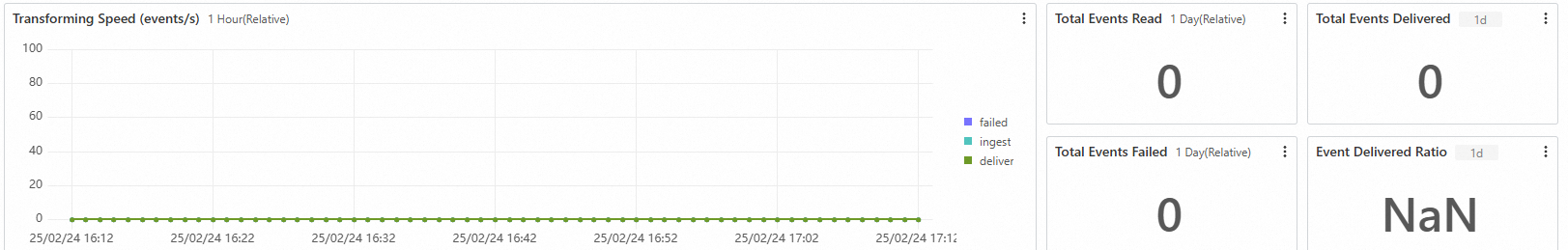

Metrik ikhtisar

Bagian berikut menjelaskan metrik ikhtisar.

Laju pemrosesan: Periode statistik default adalah 1 jam dengan jendela statistik 1 menit. Laju diukur dalam jumlah entri data per detik.

ingest: Jumlah entri data yang dibaca dari shard penyimpanan log sumber.

deliver: Jumlah entri data yang berhasil ditulis ke penyimpanan log tujuan.

failed: Jumlah entri data yang dibaca dari shard penyimpanan log sumber tetapi gagal diproses.

Total log yang dibaca: Total jumlah entri data yang dibaca dari shard penyimpanan log sumber. Periode statistik default adalah 1 hari.

Total log yang ditulis: Total jumlah entri data yang berhasil ditulis ke semua penyimpanan log tujuan. Periode statistik default adalah 1 hari.

Total log gagal: Total jumlah entri data yang dibaca dari shard penyimpanan log sumber tetapi gagal diproses. Periode statistik default adalah 1 hari.

Rasio keberhasilan penulisan: Rasio antara jumlah entri data yang berhasil dikirim ke penyimpanan log tujuan terhadap jumlah entri data yang dibaca dari penyimpanan log sumber. Periode statistik default adalah 1 hari.

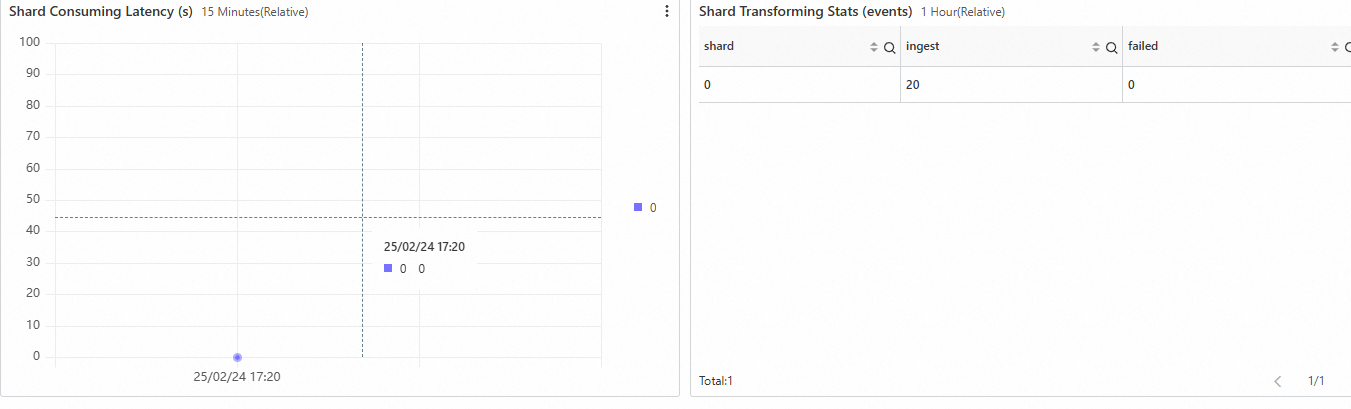

Analisis detail shard

Bagian ini menyediakan metrik untuk setiap shard tempat tugas transformasi data membaca data. Metrik dihitung dalam jendela 1 menit.

Latensi konsumsi shard (detik): Selisih waktu dalam detik antara saat entri data terakhir ditulis ke shard dan saat tugas transformasi data memproses data dari shard tersebut.

Statistik shard aktif: Periode statistik default adalah 1 jam.

shard: ID shard yang sedang dipantau.

ingest: Jumlah entri data mentah yang dibaca dari shard.

failed: Jumlah entri data mentah yang dibaca dari shard tetapi gagal diproses.

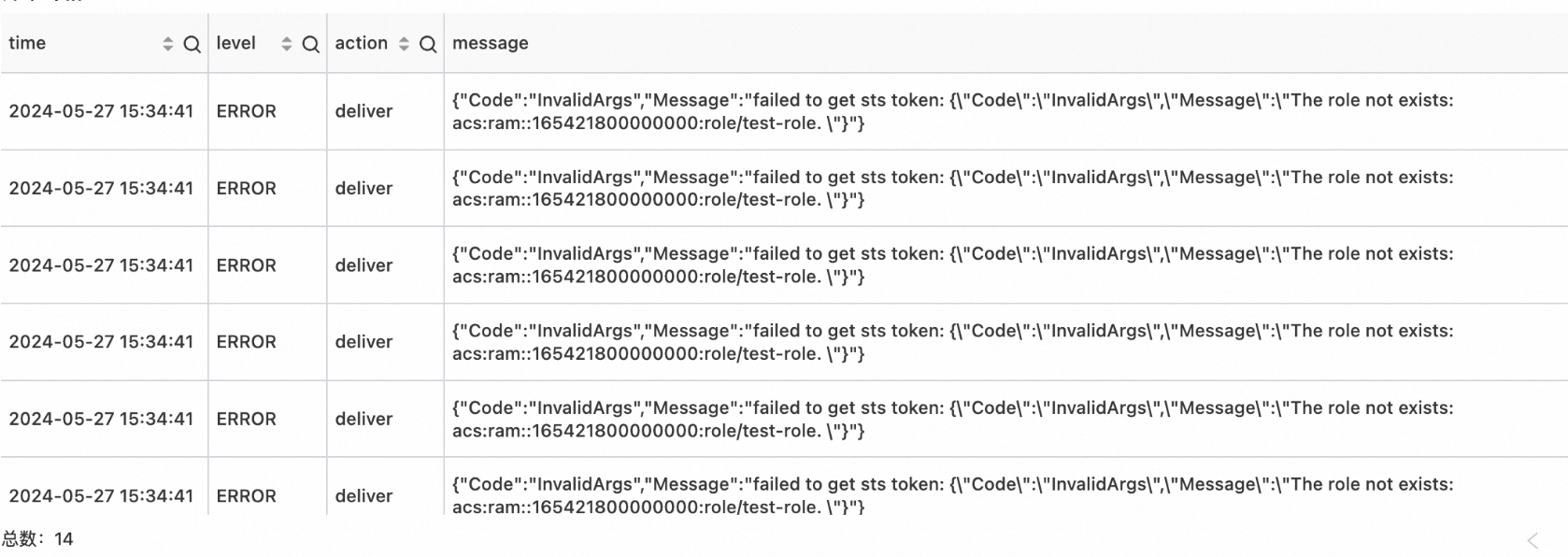

Eksespsi waktu proses

Anda dapat melihat detail kesalahan waktu proses di bidang message.

Aturan peringatan

Pemantauan untuk tugas transformasi data (versi baru) bergantung pada metrik waktu proses tugas. Untuk informasi selengkapnya, lihat Data metrik. Anda dapat menggunakan fitur peringatan di Simple Log Service untuk memantau tugas. Untuk informasi selengkapnya, lihat Peringatan. Bagian ini menjelaskan aturan peringatan untuk tugas transformasi data (versi baru), seperti aturan untuk memantau latensi pemrosesan, kesalahan pemrosesan, serta lalu lintas pemrosesan (baik nilai absolut maupun komparatif). Untuk informasi selengkapnya tentang cara membuat aturan peringatan, lihat Buat aturan peringatan berbasis log.

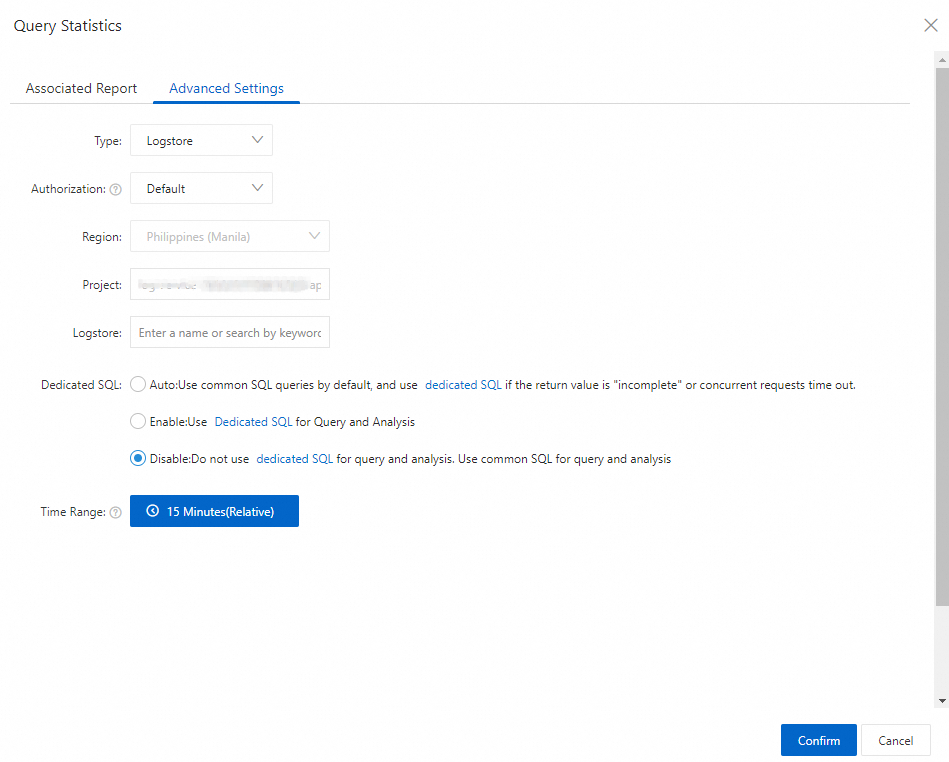

Saat membuat aturan peringatan untuk tugas transformasi data (versi baru), proyek dan Logstore yang ditentukan dalam kueri harus sama dengan lokasi penyimpanan log eksekusi tugas. Untuk informasi selengkapnya tentang cara menyimpan log eksekusi tugas, lihat Kelola log layanan.

Pemantauan latensi pemrosesan

Item | Deskripsi |

Tujuan | Memantau latensi konsumsi shard dari tugas transformasi data. Peringatan dipicu jika latensi pemrosesan melebihi ambang batas yang ditentukan. |

Dasbor terkait | Untuk informasi selengkapnya, lihat Latensi konsumsi shard. |

Contoh SQL analisis | Dalam templat berikut, ganti |

Aturan pemantauan |

Catatan Untuk mencegah positif palsu akibat pembaruan metrik setiap 1 menit atau lonjakan latensi karena lonjakan lalu lintas, konfigurasikan aturan seperti dijelaskan di atas. |

Resolusi | Ikuti langkah-langkah berikut untuk menyelesaikan masalah:

|

Pemantauan kesalahan pemrosesan

Item | Deskripsi |

Tujuan | Memantau kesalahan pemrosesan dalam tugas transformasi data. Peringatan dipicu ketika terjadi kesalahan pemrosesan. |

Dasbor terkait | Untuk informasi selengkapnya, lihat Eksespsi waktu proses. |

Contoh SQL analisis | Dalam templat berikut, ganti |

Aturan pemantauan |

|

Resolusi | Selesaikan masalah berdasarkan pesan kesalahan:

|

Pemantauan rasio volume data tertulis (komparatif)

Item | Deskripsi |

Tujuan | Memantau rasio data hasil pemrosesan yang ditulis ke penyimpanan log tujuan terhadap data mentah yang dibaca dari penyimpanan log sumber. Peringatan dipicu jika rasio meningkat atau menurun melebihi ambang batas harian atau mingguan yang ditentukan. |

Dasbor terkait | Rasio keberhasilan penulisan: Rasio antara jumlah entri data yang berhasil dikirim ke penyimpanan log tujuan terhadap jumlah entri data yang dibaca dari penyimpanan log sumber. Periode statistik default adalah 1 hari. |

Contoh Analisis SQL | Masukkan pernyataan SQL berikut di kotak dialog Query and Statistics saat membuat aturan peringatan. Dalam templat berikut, ganti |

Aturan pemantauan |

Catatan Untuk mencegah positif palsu akibat fluktuasi periodik pada lalu lintas data mentah, tetapkan ambang batas kenaikan dan penurunan harian serta mingguan minimal 20%, atau sesuaikan periode perbandingan agar sesuai dengan siklus lalu lintas data mentah. |

Resolusi | Ikuti langkah-langkah berikut untuk menyelesaikan masalah:

|

Pemantauan volume data baca sumber (komparatif)

Item | Deskripsi |

Tujuan | Memantau volume data yang dibaca oleh tugas transformasi data. Peringatan dipicu jika volume meningkat atau menurun melebihi ambang batas harian atau mingguan yang ditentukan. |

Dasbor terkait | Total log yang dibaca: Total jumlah entri data yang dibaca dari shard penyimpanan log sumber. Periode statistik default adalah 1 hari. |

Contoh Analisis SQL | Masukkan pernyataan SQL berikut di kotak dialog Query and Statistics saat membuat aturan peringatan. Dalam templat berikut, ganti |

Aturan pemantauan |

Catatan Untuk mencegah positif palsu akibat fluktuasi periodik pada lalu lintas data mentah, tetapkan ambang batas kenaikan dan penurunan harian serta mingguan minimal 20%, atau sesuaikan periode perbandingan agar sesuai dengan siklus lalu lintas data mentah. |

Resolusi | Ikuti langkah-langkah berikut untuk menyelesaikan masalah:

|

Pemantauan volume data hasil tertulis (komparatif)

Item | Deskripsi |

Tujuan | Memantau volume data yang ditulis oleh tugas transformasi data. Peringatan dipicu jika volume meningkat atau menurun melebihi ambang batas harian atau mingguan yang ditentukan. |

Dasbor terkait | Total log yang ditulis: Total jumlah entri data yang berhasil ditulis ke semua penyimpanan log tujuan. Periode default adalah 1 hari. |

Contoh Analisis SQL | Masukkan pernyataan SQL berikut di kotak dialog Query and Statistics saat membuat aturan peringatan. Dalam templat berikut, ganti |

Aturan pemantauan |

Catatan Untuk mencegah positif palsu akibat fluktuasi periodik pada lalu lintas data mentah, tetapkan ambang batas kenaikan dan penurunan harian serta mingguan minimal 20%, atau sesuaikan periode perbandingan agar sesuai dengan siklus lalu lintas data mentah. |

Resolusi | Ikuti langkah-langkah berikut untuk menyelesaikan masalah:

|