Topik ini menjelaskan cara menggunakan Pusat Integrasi Alibaba Cloud Simple Log Service (SLS) untuk mengintegrasikan log OpenClaw AI Agent hanya dalam satu klik. Anda dapat menggunakan dasbor audit dan observabilitas bawaan untuk membuat solusi siap pakai guna keperluan audit keamanan dan pemantauan operasional.

Informasi latar belakang

Risiko keamanan OpenClaw: Mengapa operasi terkendali sangat penting

OpenClaw adalah salah satu platform AI Agent open source paling terkemuka pada tahun 2026. Platform ini memungkinkan model bahasa besar (LLM) untuk secara langsung memanipulasi sistem file, menjalankan perintah Shell, menjelajahi web, dan mengirim pesan. Kemampuan ini mengubah kapabilitas inferensi LLM menjadi operasi sistem nyata. Kemampuan “eksekusi otonom” ini sekaligus menjadi nilai inti sekaligus risiko utamanya.

Insiden keamanan industri: Risiko bersifat nyata, bukan hipotetis

Pada awal 2026, beberapa vendor keamanan mengungkap serangkaian kerentanan dan insiden terkait OpenClaw.

Sumber

Temuan

Statistik riset keamanan

Lebih dari 40.000 instans OpenClaw dapat diakses melalui internet publik di berbagai negara. Sekitar 15.000 di antaranya belum dipatch atau menggunakan konfigurasi default, sehingga berisiko dikendalikan dari jarak jauh. Sekitar 93% instans yang terekspos memiliki kerentanan parah berupa bypass otentikasi.

GitHub Security Advisory

(GHSA-g8p2-7wf7-98mq)

UI Control mempercayai gatewayUrl dalam parameter URL dan terhubung secara otomatis. Jika pengguna mengklik tautan berbahaya, token gerbang dapat dicuri dan dikirim ke server penyerang. Hal ini menyebabkan eksekusi kode jarak jauh (RCE) hanya dalam satu klik dengan skor CVSS 8,8, bahkan jika gerbang hanya mendengarkan pada mesin lokal. Masalah ini telah diperbaiki pada v2026.1.29.

Rantai pasok Skills

Lebih dari 800 Skills berbahaya ditemukan dalam registri Skills OpenClaw, mencakup sekitar 20% dari seluruh paket yang dipublikasikan. Skills berbahaya ini mencakup pencurian kredensial dan implantasi back door. Menginstal Skills yang belum ditinjau setara dengan meningkatkan hak istimewa Agent.

Riset dari Unit 42 dan lainnya

Indirect Prompt Injection (IDPI) telah teramati dalam skenario dunia nyata. Penyerang menyematkan instruksi tersembunyi dalam konten halaman web. Saat Agent mengambil konten tersebut, instruksi tersebut secara keliru dijalankan, menyebabkan eksfiltrasi data atau operasi tidak sah.

Regulasi dan peringatan

Regulator di berbagai negara mulai fokus pada risiko agen AI. Kementerian Industri dan Teknologi Informasi (MIIT) mengeluarkan peringatan mengenai risiko keamanan agen AI open source OpenClaw, serta merekomendasikan pembaruan tepat waktu dan penguatan keamanan.

Data audit kode: Frekuensi perbaikan keamanan pada OpenClaw sendiri

Laporan industri menggambarkan lanskap ancaman eksternal. Audit repositori kode OpenClaw sendiri mengungkap dimensi lain: proyek ini sendiri sering memperbaiki isu keamanan. Dengan menganalisis semantik keamanan dari riwayat Git dan pesan commit, Anda dapat mengukur skala dan distribusi perubahan kode terkait keamanan dalam periode tertentu. Hal ini membantu menentukan di mana permukaan serangan terkonsentrasi.

Menyaring dan mengklasifikasikan commit terbaru di OpenClaw menunjukkan bahwa risiko sangat terkonsentrasi pada lapisan entri dan eksekusi:

Modul

Jumlah perbaikan keamanan

Percentage

Risiko utama

src/tools/52

35%

Command injection, directory traversal

src/gateway/38

26%

Kontrol akses, otentikasi dan otorisasi

src/auth/18

12%

Bypass otentikasi, CSRF

src/sandbox/15

10%

Directory traversal, SSRF

src/hooks/12

8%

Prompt injection, kebocoran informasi

Lapisan eksekusi tool (

tools/) dan lapisan gerbang masuk (gateway/) merupakan tempat manifestasi risiko “operasi otonom” dan “akses multi-entri”. Audit kode statis hanya dapat mencakup perubahan yang telah dikomit. Audit tersebut tidak dapat memperhitungkan variasi perilaku runtime, kombinasi konfigurasi, atau jalur serangan yang didorong oleh input eksternal.Mengapa perlindungan runtime saja tidak cukup

Jika dikonfigurasi dengan benar, arsitektur OpenClaw dapat secara efektif mengurangi permukaan serangan. Namun, dari perspektif rekayasa keamanan, arsitektur ini bergantung pada pemeriksaan runtime dalam domain kepercayaan yang sama, yang memiliki beberapa keterbatasan inheren:

Lapisan Perlindungan

Mekanisme dan Kemampuan

Keterbatasan Inheren

Tool Policy Pipeline

Sebelum tool dipanggil, kebijakan berdasarkan faktor seperti pengirim, channel, dan nama tool menentukan apakah akan mengizinkan, menolak, atau memerlukan persetujuan manual. Mendukung alur persetujuan ACP.

Kesalahan konfigurasi kebijakan, kelalaian aturan, atau bypass kebijakan (misalnya mencapai efek berisiko tinggi secara tidak langsung melalui rantai alat yang sah) dapat menyebabkan eksekusi tidak sah. Kurangnya audit independen setelah perubahan kebijakan menyulitkan atribusi pasca-insiden.

Deteksi Macet/Perulangan

Mendeteksi ketika sesi tidak menghasilkan kemajuan substansial selama beberapa putaran (misalnya tidak ada pesan baru dari pengguna atau asisten, hanya panggilan tool berulang) dan memicu peringatan atau penghentian.

Fitur ini hanya dapat mengidentifikasi loop “tanpa kemajuan”. Fitur ini tidak dapat mengidentifikasi rantai operasi multi-langkah yang secara logis konsisten tetapi menghasilkan dampak buruk (misalnya induksi bertahap untuk menghapus atau mengekstraksi data). Positif palsu dan negatif palsu bergantung pada penyetelan ambang batas.

Daftar izin/daftar larang perintah

Menyaring perintah yang dapat dieksekusi untuk tool seperti

execdanshellmenggunakan daftar izin atau daftar larang untuk mengurangi eksekusi perintah arbitrer.Perintah yang diobfuscate atau diencode (seperti eksekusi hasil decode base64 atau penggabungan multi-baris dengan alias) secara historis berhasil melewati filter, menyebabkan CVE dan perbaikan terkait. Daftar tersebut sering kali tertinggal dari teknik serangan baru.

Instruksi konteks dan keamanan

Menyuntikkan batasan seperti "Jangan lakukan X" atau "Butuh persetujuan sebelum melakukan Y" melalui System Prompt, mengandalkan model untuk mematuhi.

Dalam percakapan panjang, kompresi jendela konteks, ringkasan, atau pemotongan dapat melemahkan atau menyebabkan model “lupa” instruksi keamanan kunci. Input adversarial dapat mencoba mengganti atau melemahkan batasan ini (Prompt Injection).

Oleh karena itu, perlindungan runtime bertindak seperti tembok kota. Perlindungan ini dapat memblokir sebagian besar jalur serangan yang dikenal tetapi tidak dapat menjamin konfigurasi selalu benar. Perlindungan ini juga tidak dapat mencegah bypass yang tidak dikenal atau penyalahgunaan logis. Dalam arsitektur keamanan, Anda memerlukan "penjaga" pelengkap untuk terus-menerus mengamati dan mengaudit pemanggilan Agent, konsumsi, urutan pemanggilan tool, dan hasilnya.

Ikhtisar solusi

Observabilitas bertindak sebagai "penjaga" ini. Observabilitas menggunakan log, metrik, dan jejak untuk terus-menerus memantau perilaku Agent. Hal ini mendukung ketertelusuran audit dan kepatuhan penggunaan. Dengan deteksi anomali, observabilitas membantu menjawab pertanyaan seperti "Siapa yang melakukan panggilan?", "Berapa biayanya?", dan "Apa yang sebenarnya dilakukan?". Hal ini memungkinkan deteksi dan respons dini ketika kebijakan gagal atau jenis serangan baru muncul, sebelum dampaknya meluas.

Pemetaan tiga pilar observabilitas ke AI Agent

Observabilitas dibangun di atas tiga pilar Log, Metrik, dan Jejak. Dalam skenario OpenClaw, hubungan antara pilar-pilar ini, sumber datanya, dan pertanyaan inti yang dijawabnya adalah sebagai berikut:

Pilar | Sumber data OpenClaw | Pertanyaan inti yang dijawab |

Log (log audit sesi) |

| Apa yang dilakukan Agent? Tool apa yang dipanggilnya? Berapa banyak token dan biaya yang dikonsumsi? |

Log (log operasional aplikasi) |

| Apa yang salah dengan sistem? Kegagalan webhook, penolakan otentikasi, anomali gerbang? |

Metrik | Output OTLP dari plugin | Apakah biaya dan latensi saat ini normal? Apakah ada sesi macet atau retry abnormal? |

Jejak | Output OTLP dari plugin | Langkah apa saja yang dilalui satu pesan dari penerimaan hingga tanggapan lengkap? Bagaimana rantai panggilan terhubung? |

Ketiga pilar ini tidak dapat dipisahkan. Hanya dengan Metrik, Anda tidak dapat menjawab "siapa" atau "mengapa" biaya melonjak. Hanya dengan log Sesi, Anda tidak dapat menilai kesehatan sistem secara keseluruhan dan titik infleksi anomali. Hanya dengan log operasional aplikasi, Anda tidak dapat melihat perilaku bisnis Agent dan urutan pemanggilan tool. Bekerja sama, ketiga pilar ini dapat mendukung audit keamanan, manajemen biaya, troubleshooting, serta operasi dan pemeliharaan (O&M).

Kemampuan dan keunggulan Alibaba Cloud SLS

Sebagai platform dasar untuk observabilitas, SLS memiliki keunggulan alami berikut dalam skenario OpenClaw:

Kemampuan ingest data kuat yang secara native selaras dengan tumpukan teknologi OpenClaw

LoongCollector memiliki kemampuan koleksi OneAgent yang kuat dengan dukungan native untuk log dan Protokol OpenTelemetry (OTLP). Log Sesi Agent sering kali panjang karena membawa konteks interaksi model. LoongCollector menyediakan koleksi berkinerja tinggi untuk log teks panjang. LoongCollector terintegrasi mulus dengan plugin bawaan OpenClaw

diagnostics-otel, memungkinkan Metrik dan Jejak ditulis langsung ke SLS menggunakan OTLP.Operator kueri, analisis, dan pemrosesan yang kaya

Log sesi berformat JSON bersarang (seperti

message.content,message.usage.cost, danmessage.toolName). SLS menyediakan Mesin komputasi SQL + SPL dan kumpulan operator parsing, penyaringan, dan agregasi yang kaya. Anda dapat mengindeks dan menganalisis bidang bersarang secara real-time tanpa pemrosesan ekstrak, transformasi, dan muat (ETL) tambahan.Kemampuan keamanan dan kepatuhan

Kontrol akses RAM, penyembunyian data sensitif, dan penyimpanan terenkripsi memenuhi persyaratan jejak audit dan kepatuhan. SLS telah tersertifikasi untuk produk keamanan jaringan, menjadikannya fondasi observabilitas dan audit yang sesuai untuk skenario perlindungan terklasifikasi dan kepatuhan industri. Saluran peringatan mendukung DingTalk, pesan teks, dan email, yang memfasilitasi notifikasi dan respons tepat waktu terhadap insiden keamanan serta peringatan biaya atau anomali.

Terkelola penuh, bayar sesuai penggunaan, dan skalabilitas elastis

Analisis log adalah proses all-in-one yang mencakup koleksi, penyimpanan, pengindeksan, kueri, dasbor, dan peringatan, serta dikelola sepenuhnya oleh Logstore dan Metricstore. Untuk Agent skala kecil, volume log tidak besar, sehingga biaya bayar sesuai penggunaan rendah. Seiring peningkatan trafik, layanan ini menskalakan secara elastis, sehingga menghilangkan kebutuhan untuk menyediakan kapasitas cadangan atau penskalaan manual. Anda tidak perlu membangun sistem Elasticsearch, Prometheus, atau lainnya sendiri.

Oleh karena itu, SLS sangat cocok sebagai fondasi observabilitas dan audit untuk operasi terkendali OpenClaw, mendukung audit, manajemen biaya, deteksi anomali, kepatuhan keamanan, dan O&M di berbagai skenario.

SLS kini menawarkan solusi integrasi satu atap untuk OpenClaw:

Gunakan Pusat Integrasi untuk mengonfigurasi jalur koleksi dan metode parsing melalui wizard. Konfigurasi dihasilkan, dikirim, dan diterapkan secara otomatis. Hal ini menciptakan titik masuk terpadu dan proyek terpadu untuk log Sesi, log aplikasi, dan telemetri OTLP. Integrasi satu atap ini secara signifikan mengurangi kompleksitas dan biaya O&M yang terkait dengan sumber data terfragmentasi.

Satu set data Sesi dapat digunakan untuk audit keamanan, serta analisis biaya dan perilaku, melayani berbagai skenario.

Dasbor bawaan untuk audit, analisis biaya, dan metrik operasional menyediakan solusi tertutup siap pakai untuk mengamati operasi terkendali.

Prosedur

Langkah 1: Ingesti log (menggunakan log sesi sebagai contoh)

Log sesi merupakan sumber data inti untuk audit keamanan. Log ini mencatat setiap giliran percakapan, setiap pemanggilan tool, dan setiap token yang dikonsumsi.

Prasyarat

Anda telah membuat Proyek (seperti

openclaw-observability) dan membuat Logstore.Pastikan LoongCollector telah diinstal pada Instance ECS atau server on-premises tempat OpenClaw berjalan.

Prosedur

Masuk ke Konsol Simple Log Service. Di panel kanan, klik Quick Data Import. Pada kartu integrasi, pilih OpenClaw-Session Log, lalu pilih proyek dan Logstore tujuan.

Pada tab Machine Group Configurations, pilih kelompok mesin yang Anda buat saat menginstal LoongCollector dari daftar Source Machine Group dan tambahkan ke daftar Applied Machine Group.

Troubleshoot abnormal heartbeats

Pada halaman Logtail Configuration, Simple Log Service secara otomatis mengisi konfigurasi koleksi bawaan. Jika tidak perlu perubahan, klik Next.

Configuration Name diatur secara default. Anda dapat mengubahnya sesuai kebutuhan.

Di bawah Other Global Configurations, Log Topic Type diatur secara default.

Tentang mode pembuatan topik: LoongCollector dapat secara otomatis mengekstrak topik dan session_id dari path file. Jika Anda menggunakan path file kustom yang tidak sesuai dengan path yang telah diisi sebelumnya, Anda harus memodifikasi konfigurasi.

File Path diisi secara otomatis secara default.

Tentang path file teks: Path file yang telah diisi sebelumnya mengasumsikan instalasi default oleh pengguna non-root pada host Linux. Jika path aktual Anda berbeda, Anda harus memodifikasinya.

Pada bagian Processing Method, kombinasi plugin pemrosesan dikonfigurasi secara default.

Tentang parsing waktu: Secara default, OpenClaw mengeluarkan log dalam zona waktu UTC+0. Jika Anda telah menyesuaikan zona waktu, Anda juga harus memodifikasi zona waktu dalam plugin parsing waktu untuk menghindari ketidaksesuaian waktu.

Pada halaman Query and Analysis Configurations, Simple Log Service secara otomatis membuat indeks dan laporan bawaan. Anda dapat melihatnya nanti di antarmuka kueri dan analisis serta pada halaman Dashboard.

Indeks bawaan adalah sebagai berikut:

Dasbor adalah sebagai berikut:

OpenClaw Behavior Analysis Dashboard

OpenClaw Audit Dashboard

OpenClaw Metrics Dashboard

OpenClaw Token Analysis Dashboard

Langkah 2: Audit dan amati

SLS menyediakan dasbor bawaan untuk OpenClaw yang mencakup empat dimensi: audit keamanan, analisis biaya, analisis perilaku, dan metrik operasional.

Masuk ke Konsol Simple Log Service. Di bagian Projects, pilih proyek tujuan.

Di bagian Log Storage, temukan Logstore tujuan dan klik Search & Analyze untuk memverifikasi integrasi dan memeriksa format log.

Di Dashboard, lihat dasbor preset.

Dasbor audit keamanan

Visibilitas terhadap perilaku Agent secara langsung terkait dengan risiko keamanan dan kepatuhan sistem. Perilaku abnormal sering kali menunjukkan tanda-tanda sebelum kerusakan aktual terjadi. Dasbor audit keamanan adalah dasbor inti untuk operasi terkendali OpenClaw. Dasbor ini berfokus menjawab pertanyaan inti: "Apa yang dilakukan Agent, apakah ada tindakan berisiko tinggi, dan siapa yang melakukan operasi tidak sah?". Dasbor ini menyediakan pemantauan perilaku real-time, deteksi ancaman, dan kemampuan ketertelusuran pasca-insiden di berbagai dimensi seperti ikhtisar perilaku, perintah berisiko tinggi, prompt injection, dan eksfiltrasi data.

Halaman ikhtisar statistik audit keamanan:

Halaman ini memberikan snapshot risiko tunggal mengenai postur keamanan OpenClaw, berpusat pada hitungan multi-dimensi operasi berisiko tinggi dalam jendela waktu tertentu. Enam metrik ditampilkan berdampingan: eksekusi perintah berisiko tinggi, permintaan web arah keluar, operasi command-line arah keluar, penggunaan tool komunikasi arah keluar, akses file sensitif, dan prompt injection. Dipasangkan dengan data perbandingan hari-ke-hari, hal ini membantu tim keamanan dengan cepat menentukan apakah tingkat risiko saat ini abnormal tanpa perlu menyelidiki detail.

Berikan perhatian khusus pada jumlah operasi berisiko tinggi setelah kejadian prompt injection. Operasi berisiko tinggi biasa mungkin berasal dari kebutuhan sah suatu tugas. Namun, perilaku berisiko tinggi yang dipicu setelah injection merupakan sinyal ancaman kuat. Hal ini menunjukkan bahwa instruksi berbahaya yang disuntikkan telah mendorong Agent untuk bertindak. Bahkan jika terdapat positif palsu, sinyal semacam ini harus memicu tinjauan manual tingkat tertinggi, bukan menunggu konfirmasi lebih lanjut. Oleh karena itu, "jumlah sesi dengan pemanggilan tool setelah injection" adalah sinyal dengan tingkat kepercayaan ancaman tertinggi dalam keseluruhan ikhtisar. Tiga sesi semacam ini sering kali memiliki prioritas lebih tinggi daripada ratusan perintah berisiko tinggi biasa.

Tabel sesi berisiko tinggi mengagregasi jumlah risiko untuk setiap dimensi berdasarkan sesi. Tabel ini secara otomatis mengurutkan sesi berdasarkan skor risiko komprehensif, membawa sesi yang paling memerlukan intervensi manual ke posisi teratas. Tim keamanan tidak perlu menyaring log satu per satu. Mereka dapat langsung memulai ketertelusuran dari sesi berisiko tertinggi, yang secara signifikan mempersingkat jendela waktu dari deteksi hingga respons.

Analisis Penggunaan Keterampilan

Analisis penggunaan Skills mengkaji batas kemampuan OpenClaw dari perspektif permukaan serangan. Skills merupakan mekanisme ekstensi kemampuan native OpenClaw sekaligus vektor serangan utama untuk prompt injection berbahaya. Pengguna sering kali tanpa sadar menginstal Skills dengan kerentanan keamanan atau instruksi berbahaya yang tertanam, yang memberikan penyerang titik masuk kemampuan yang dapat dikendalikan. Oleh karena itu, distribusi pemanggilan Skills bukan hanya statistik penggunaan, tetapi juga dasar penting untuk analisis jalur serangan.

Grafik pai distribusi penggunaan membantu tim keamanan dengan cepat membangun pemahaman garis dasar mengenai pemanggilan Skills: Skills mana yang merupakan panggilan utama berfrekuensi tinggi, dan mana yang marginal dan berfrekuensi rendah. Jika proporsi Skills yang tidak umum tiba-tiba meningkat, atau muncul Skills baru yang belum pernah dilihat sebelumnya, hal ini sering kali berarti Agent sedang diarahkan ke jalur kemampuan yang tidak diinginkan dan memerlukan investigasi segera.

Konten dalam tabel Skills baru sangat kritis. Skills yang baru diperkenalkan belum menjalani penilaian keamanan menyeluruh. Batas izin dan pola perilakunya merupakan titik buta bagi tim keamanan. Dengan mengurutkan berdasarkan urutan kronologis terbalik dari waktu panggilan pertama, Anda dapat menangkap Skills baru yang muncul di lingkungan pada kesempatan paling awal dan menyelesaikan tinjauan sebelum disalahgunakan.

Pemantauan eksekusi perintah berisiko tinggi

Salah satu kemampuan inovatif OpenClaw adalah eksekusi otonom perintah sistem, yang juga menjadikannya landasan ideal bagi penyerang. Begitu Agent mengalami prompt injection atau dikendalikan oleh Skill berbahaya, penyerang dapat menggunakan izin akses sistem Agent untuk melakukan operasi destruktif seperti menghapus file, menaikkan hak istimewa, atau mengekstraksi data. Semua tindakan ini dimulai atas identitas Agent, yang membuatnya sangat sulit dibedakan dari perilaku tugas normal.

Nilai inti pemantauan eksekusi perintah berisiko tinggi adalah membangun lapisan observabilitas independen di luar perlindungan runtime. Sistem izin tool OpenClaw telah menerapkan kontrol di tingkat runtime. Namun, kesalahan konfigurasi kebijakan, batas izin yang didefinisikan secara samar, atau kasus tepi yang tidak tercakup semuanya dapat menyebabkan perintah berisiko tinggi lolos di tingkat runtime tanpa terdeteksi. Lapisan observabilitas beroperasi secara independen dari mekanisme perlindungan, yang memastikan bahwa bahkan jika terdapat kelalaian di runtime, operasi berisiko tinggi tidak akan sepenuhnya luput dari deteksi.

Makna tampilan garis waktu bukan hanya menghitung, tetapi membantu tim keamanan mengidentifikasi pola perilaku. Perintah berisiko tinggi tunggal yang terisolasi memiliki makna risiko berbeda dibandingkan rangkaian padat panggilan dalam periode singkat. Yang terakhir sering kali merupakan ciri khas Agent yang dikendalikan untuk secara sistematis mengeksekusi instruksi berbahaya dan memerlukan intervensi segera. Tabel detail menyediakan konteks ketertelusuran lengkap, yang memungkinkan tim keamanan dengan cepat melacak dari sinyal abnormal ke sesi dan perintah asli spesifik.

Deteksi prompt injection

Prompt injection adalah metode serangan inti untuk mendorong AI melakukan tindakan berbahaya. Terlepas dari jalur serangan, baik itu input pengguna langsung, respons dari panggilan Skills, atau data eksternal yang dibaca oleh tool seperti

web_fetchatauread, instruksi berbahaya pada akhirnya harus dimasukkan ke dalam prompt untuk memengaruhi Agent. Prompt merupakan titik konvergensi akhir untuk semua jalur serangan.Distribusi sumber injection dapat membantu menentukan sifat sebenarnya dari risiko. Injection dari input pengguna langsung biasanya disengaja, sedangkan injection yang dibawa oleh

toolResultsering kali tidak diketahui pengguna. Untuk Agent jenis asisten pribadi seperti OpenClaw, injection tidak langsung merupakan ancaman utama. Skills yang diinstal pengguna atau konten eksternal yang diakses semuanya dapat menjadi vektor injection dan sulit bagi pengguna untuk secara proaktif mengidentifikasi dan menghindarinya.Nilai klasifikasi injection terletak pada mengidentifikasi maksud serangan, bukan hanya menandai anomali. Untuk kejadian injection yang sama,

ROLE_HIJACKdanJAILBREAKberarti penyerang mencoba menembus batas perilaku Agent.HIDDEN_INSTRUCTIONmerepresentasikan teknik implantasi yang lebih terselubung. Prioritas respons dan metode penanganan untuk jenis-jenis ini berbeda. Mengamati perubahan berkelanjutan dalam distribusi klasifikasi juga membantu menemukan upaya terkonsentrasi pada permukaan serangan tertentu.Tabel detail mencatat tool pemicu, konteks sesi, dan konten asli untuk setiap kejadian injection. Hal ini memungkinkan tim keamanan dengan cepat menyelidiki lebih dalam dari statistik terklasifikasi ke kejadian spesifik, yang melengkapi siklus penuh dari pengenalan pola hingga ketertelusuran dan respons.

Deteksi eksfiltrasi data sensitif

Dalam konteks Agent, eksfiltrasi data sering kali bukan peristiwa tunggal, tetapi rantai perilaku yang terdiri dari beberapa langkah: Agent diarahkan untuk membaca file sensitif, kontennya masuk ke konteks model, lalu dikirim keluar melalui panggilan tool berikutnya. Mengamati setiap langkah secara terpisah menyulitkan penilaian ancaman. Hanya dengan mengaitkan akses file dengan perilaku arah keluar, niat penuh serangan dapat direkonstruksi.

Deteksi eksfiltrasi data sensitif menggunakan pendekatan analisis corong, yang secara progresif mempersempit noise untuk secara akurat menemukan ancaman nyata. Lapisan pertama melakukan pencatatan lengkap akses file sensitif, diklasifikasikan berdasarkan jenis aset: SSH_KEY, ENV_FILE, CREDENTIALS, CONFIG_SECRET, dan HISTORY, untuk membangun garis dasar akses. Lapisan kedua secara independen melacak perilaku arah keluar berdasarkan saluran (API_CALL, MESSAGE_SEND, WEB_ACCESS, EMAIL) untuk mengidentifikasi potensi titik keluar data. Lapisan ketiga mengkorelasikan keduanya dalam dimensi waktu. Jika akses file sensitif dan operasi arah keluar terjadi berurutan dalam jendela waktu singkat dalam sesi yang sama, hal tersebut ditandai sebagai kejadian eksfiltrasi prioritas tinggi.

Nilai inti mekanisme ini terletak pada penentuan posisi sebab-akibat daripada peringatan titik tunggal. Agent membaca SSH_KEY belum tentu merupakan ancaman. Memulai API_CALL belum tentu merupakan ancaman. Namun, ketika keduanya terjadi dalam sesi yang sama dalam interval tingkat menit, dan parameter arah keluar membawa konten file sensitif, tingkat kepercayaan ancaman meningkat secara signifikan. Tabel analisis rantai perilaku secara langsung menampilkan selisih waktu antara access_time dan outbound_time serta parameter panggilan lengkap, yang memungkinkan tim keamanan menyelesaikan ketertelusuran dan penilaian tanpa perlu mengkorelasikan log secara manual.

Dasbor analisis token

Konsumsi token secara langsung terkait dengan biaya operasional, dan fluktuasinya sering kali merupakan sinyal dini anomali sistem (seperti ekspansi konteks akibat prompt injection). Dasbor analisis token berfokus pada pertanyaan inti "Uang dihabiskan untuk apa?", "Apakah pengeluaran wajar?", dan "Apakah ada anomali?". Dasbor ini menyediakan pemantauan penggunaan, analisis biaya, dan kemampuan deteksi anomali dari perspektif ikhtisar keseluruhan, tren dimensi model, dan sesi.

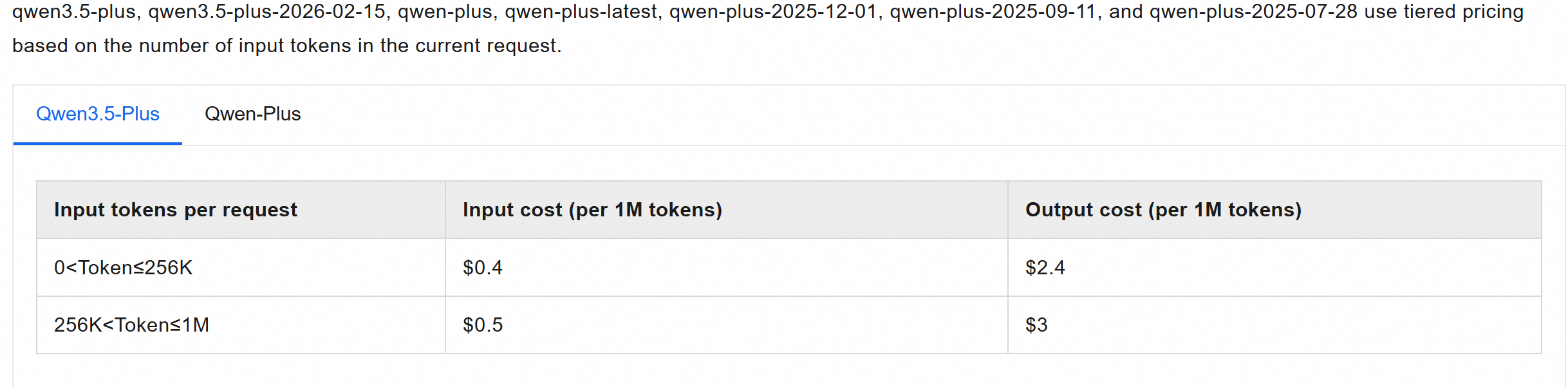

Tentang data biaya: Bidang

costdi dasbor berasal dariusage.costOpenClaw. OpenClaw tidak mendukung penagihan bertingkat secara native, dan logika perhitungan cacheRead + cacheWrite tidak dapat diselaraskan dengan penyedia. Biaya hanya diperkirakan berdasarkaninputTokens × input + outputTokens × output + .... Oleh karena itu, biaya di dasbor harus dianggap sebagai garis dasar untuk estimasi biaya, bukan tagihan pasti. Untuk model yang tidak mengonfigurasicost, kolom biaya menunjukkan 0.Ringkasan keseluruhan dan distribusi model

Bagian atas dasbor memberikan perbandingan 1 hari untuk total token dan total biaya: penggunaan hari ini vs. kemarin (satuan: 10.000 token), biaya hari ini vs. kemarin (satuan: CNY), dan rasio perbandingan hari-ke-hari. Hal ini memudahkan untuk dengan cepat menentukan apakah terjadi lonjakan penggunaan atau biaya. Perbandingan hari-ke-hari merupakan sinyal pertama anomali biaya. Jika rasio hari-ke-hari melebihi ambang batas yang telah ditetapkan (misalnya ±30%), biasanya berarti terjadi ekspansi prompt, loop panggilan, atau sesi abnormal, dan Anda harus segera menyelidiki lebih dalam.

Tren konsumsi berdasarkan penyedia/model (deret waktu)

Grafik tren token model dan tren biaya model adalah dua grafik deret waktu (relatif terhadap 1 minggu) yang berbagi garis waktu dan legenda. Grafik ini menunjukkan konsumsi token dan perubahan biaya setiap model dari waktu ke waktu, dibedakan berdasarkan warna. Berikan perhatian khusus pada lonjakan token. Hal ini sering kali bukan hanya masalah biaya, tetapi juga sinyal risiko keamanan dan stabilitas. Prompt injection yang menyebabkan konteks diisi secara berbahaya, panggilan tool yang macet dalam loop tak terbatas, atau sesi yang terus berkembang karena deteksi loop tidak dipicu akan semuanya muncul sebagai kenaikan curam pada salah satu kurva di grafik tren. Kedua grafik dikodekan warna berdasarkan model. Pergantian model secara langsung tercermin sebagai perubahan komposisi warna, yang memungkinkan Anda mengonfirmasi waktu pergantian dan model yang terlibat tanpa inferensi tambahan, sehingga memudahkan untuk menentukan apakah perubahan tersebut diharapkan.

Konsumsi teratas berdasarkan sesi dan host/pod (grafik kolom)

Grafik kolom membentuk tata letak 2×2, menjawab "Siapa yang menghabiskan uang?" dan "Mesin atau kontainer mana yang menghabiskan uang?" dari dimensi sesi dan host (atau pod, dalam skenario kontainer), mengaitkan data dengan entitas yang bertanggung jawab spesifik:

Top Tokens By Session / Top Cost By Session: Total token dan biaya untuk setiap sesi selama seminggu terakhir diurutkan secara menurun. Dalam praktiknya, distribusi biaya Agent sering kali menunjukkan karakteristik ekor panjang, di mana beberapa sesi menyumbang sebagian besar konsumsi. Mengidentifikasi "sesi kepala" ini merupakan langkah pertama dalam optimalisasi biaya.

Top Tokens By Host / Top Cost By Host: Token dan biaya yang diagregasi berdasarkan host (instans) atau pod, digunakan untuk analisis biaya dan lokalisasi risiko dalam penyebaran multi-instans. Di lingkungan perusahaan, host atau pod biasanya terkait dengan tim tertentu, lini bisnis, atau pengguna. Dengan menggabungkan ini dengan kepemilikan aset, Anda dapat memetakan data konsumsi ke pihak yang bertanggung jawab spesifik. Hal ini tidak hanya mendukung alokasi biaya tetapi juga membantu dengan cepat mengunci potensi pengguna berisiko atau sesi yang tidak terkendali ketika konsumsi instans abnormal.

Tabel detail token model (rincian biaya)

Tabel detail (relatif terhadap 1 minggu) mencantumkan hal berikut untuk setiap model:

totalTokens,inputTokens,outputTokens,cacheReadTokens,cacheWriteTokens, dantotalCost,inputCost,outputCost,cacheReadCost, dancacheWriteCostyang sesuai. Tabel ini mendukung pengurutan dan penyaringan, yang memungkinkan Anda langsung menjawab "Model mana yang paling banyak menghabiskan uang?" dan "Berapa kontribusi input/output?". RasioinputTokensterhadapoutputTokensmencerminkan pola interaksi Agent: rasio input tinggi menunjukkan prompt atau konteks redundan, sedangkan rasio output tinggi mungkin berarti model menghasilkan banyak konten tidak valid. RasiocacheReadTokenssecara langsung mencerminkan manfaat kebijakan cache. Rasio yang lebih tinggi berarti penagihan aktual lebih rendah, yang memberikan dasar kuantitatif untuk rekayasa prompt dan penyetelan cache.

Dasbor analisis perilaku

Dasbor analisis perilaku menggunakan sesi sebagai unit dasar untuk mencatat dan mengklasifikasikan perilaku operasional OpenClaw, menjawab pertanyaan dasar namun kritis, "Apa yang dilakukan Agent dalam jendela waktu saat ini?".

Statistik sesi

Kartu hitungan di bagian atas memecah pemanggilan tool berdasarkan jenis perilaku ke dalam dimensi seperti eksekusi perintah, proses latar belakang, permintaan web, tool komunikasi, dan baca/tulis file, yang memberikan snapshot cepat komposisi perilaku keseluruhan. Pengecualian panggilan dicantumkan secara terpisah, memudahkan penilaian stabilitas sistem sekilas.

Tabel statistik sesi diperluas berdasarkan sesi, mencatat jumlah panggilan untuk setiap sesi di setiap dimensi perilaku. Dalam tangkapan layar, total jumlah pemanggilan tool untuk sesi pertama mencapai 1.925, termasuk 1.364 eksekusi perintah dan 561 baca/tulis file, yang berbeda satu orde dari sesi lainnya. Sesi yang sangat aktif seperti ini sering kali layak diprioritaskan untuk ditinjau. Tabel diurutkan berdasarkan waktu aktif terakhir. Dikombinasikan dengan distribusi panggilan setiap dimensi, Anda dapat dengan cepat mengidentifikasi sesi dengan pola perilaku abnormal.

Statistik volume pemanggilan tool dan analisis error

Pemanggilan tool adalah satu-satunya saluran bagi Agent untuk berinteraksi dengan dunia luar. Perubahan volume panggilan dan tingkat error secara langsung mencerminkan kesehatan operasional Agent. Garis waktu pemanggilan tool menunjukkan komposisi frekuensi panggilan untuk setiap periode waktu, dikodekan warna berdasarkan jenis tool. Lonjakan abnormal merupakan titik masuk pertama untuk troubleshooting. Dikombinasikan dengan perubahan komposisi jenis tool, Anda dapat dengan cepat menentukan jenis operasi mana yang mendorong lonjakan panggilan. Grafik tren tingkat error berbagi garis waktu dengan garis waktu volume panggilan. Puncak tingkat error tidak selalu bertepatan dengan puncak volume panggilan. Selisih waktu antara keduanya sering kali dapat mengungkap sumber masalah sebenarnya: apakah jenis tool tertentu terus gagal selama periode tertentu, atau apakah tugas tertentu telah memperkenalkan pola panggilan abnormal.

Log pemanggilan tool lengkap menyediakan error protokol, status eksekusi, dan konten balasan untuk setiap panggilan, yang memungkinkan Anda dengan cepat menyelidiki lebih dalam dari anomali tren ke panggilan gagal spesifik untuk menemukan akar penyebab.

Interaksi eksternal

Interaksi eksternal mencatat semua perilaku arah keluar yang diprakarsai oleh Agent selama operasinya, termasuk panggilan API, akses web, pengiriman pesan, dan pengiriman email, disajikan dan diklasifikasikan berdasarkan sesi, nama tool, dan jenis interaksi.

Bagi Agent, interaksi eksternal sekaligus merupakan sarana yang diperlukan untuk menyelesaikan tugas dan titik keluar risiko potensial. Catatan lengkap perilaku interaksi eksternal, di satu sisi, membantu tim memahami batas kemampuan aktual dan kebiasaan penggunaan Agent. Di sisi lain, catatan ini menyediakan konteks perilaku lengkap ketika terjadi anomali, yang mendukung analisis asosiasi dan ketertelusuran lintas tool dan lintas sesi.

Langkah 3: Jelajahi data yang dapat diamati dengan kueri kustom

Dasbor bawaan menyediakan tampilan audit dan pengamatan tujuan umum. Dalam operasi keamanan aktual, dasbor sering kali merupakan titik awal untuk "menemukan masalah", bukan titik akhir. Ketika dasbor audit menandai sesi berisiko tinggi, grafik tren token menunjukkan lonjakan abnormal, atau peringatan metrik operasional dipicu, Anda sering kali perlu lebih lanjut menyelidiki lebih dalam dari ikhtisar statistik ke kejadian spesifik untuk merekonstruksi rantai perilaku lengkap dan mengonfirmasi akar penyebab. Mesin kueri dan analisis SLS menyediakan kemampuan eksplorasi kustom fleksibel untuk proses ini.

Model data log: Dasar untuk analisis kustom

Memahami struktur data merupakan prasyarat untuk eksplorasi kustom. Solusi integrasi SLS telah membuat indeks bawaan berdasarkan kebutuhan analisis audit, sehingga pengguna dapat melakukan kueri langsung tanpa konfigurasi tambahan. Dua jenis log berikut membentuk sumber data inti untuk analisis kustom:

Log sesi — Mencatat perilaku bisnis lengkap Agent dan merupakan dasar utama untuk audit keamanan dan analisis biaya. Ini adalah log yang diingesti dalam Langkah 1: Ingest log (menggunakan log sesi sebagai contoh).

Field path

Tipe

Tujuan analisis audit

__tag__:__session_id__teks

Identifikasi sesi unik. Bidang kunci untuk mengisolasi dan mengagregasi berdasarkan sesi.

typeteks

Jenis entri:

session(metadata sesi),message(pesan dialog), ataucompaction(ringkasan kompresi konteks). Digunakan untuk menyaring catatan dialog yang dapat diaudit.message.roleteks

Peran pesan:

user(input pengguna),assistant(respons model), atautoolResult(balasan tool). Digunakan untuk menemukan entitas yang bertindak.message.contentteks

Konten pesan. Termasuk input pengguna, output model, dan parameter/nilai balik tool. Mendukung deteksi injection, pencocokan data sensitif, dan pencarian teks lengkap.

message.providermessage.modelteks

Penyedia model dan nama model. Digunakan untuk analisis biaya dan statistik perilaku berdasarkan model.

message.usage.totalTokensmessage.usage.cost.totallong / double

Penggunaan token dan perkiraan biaya. Digunakan untuk deteksi konsumsi abnormal dan pengurutan biaya tingkat sesi.

message.stopReasonteks

Alasan penghentian respons:

stop(akhir normal),toolUse(panggilan tool dipicu, entri berikutnya biasanya toolResult),error/aborted/timeout(akhir abnormal). Bidang kunci untuk menyaring sesi abnormal.message.toolNamemessage.isErrorteks / bool

Nama pemanggilan tool dan status eksekusi. Digunakan dengan peran

toolResultuntuk audit tingkat tool.id,parentIdteks

ID entri dan ID induk. Digunakan untuk membangun pohon dialog dan memulihkan urutan pesan.

iddari entri tipesessionadalah sessionId.timestampteks

Timestamp kejadian. Digunakan untuk penyaringan jendela waktu, pengurutan, dan menentukan cakupan peringatan.

Log runtime — Mencatat status operasional gerbang dan berbagai subsistem. Log ini merupakan dasar data untuk troubleshooting dan analisis kesehatan sistem.

CatatanPilih kartu OpenClaw-Runtime Log dan ikuti langkah-langkah dalam Langkah 1: Ingest log (menggunakan log sesi sebagai contoh) untuk mengingesti log.

Field Path

Type

Tujuan analisis audit

_meta.logLevelNameteks

Tingkat log (TRACE / DEBUG / INFO / WARN / ERROR / FATAL). Digunakan untuk fokus pada ERROR dan FATAL guna troubleshooting anomali.

_meta.pathteks

Jalur file kode sumber dan nomor baris. Mengkorelasikan secara tepat ke lokasi kode untuk analisis stack.

Kunci numerik

"0"objek (JSON)

Konteks terstruktur. Biasanya berisi bidang

subsystem(sepertigateway,channels,telegram, atauplugins).Kunci numerik

"1"dan kunci berikutnyateks

Konten pesan log dan konten stack. Mendukung pencarian teks lengkap dan pencocokan kata kunci.

Penyelidikan tingkat sesi: Dari sesi berisiko tinggi ke rantai perilaku lengkap

Skenario khas: Daftar "Sesi Berisiko Tinggi" di dasbor audit menandai sesi berisiko tinggi. Tim keamanan perlu merekonstruksi proses interaksi lengkap sesi tersebut untuk mengonfirmasi apakah ancaman tersebut nyata.

Dalam lingkungan penyebaran multi-instans, log setiap instans OpenClaw ditulis terpusat ke Logstore SLS yang sama. Langkah pertama dalam eksplorasi kustom adalah mengisolasi berdasarkan ID Sesi untuk mempersempit tampilan ke satu sesi. Hal ini memperjelas "siapa yang memicu permintaan mana, memanggil tool mana, dan bagaimana model merespons pada waktu apa", yang memberikan batas jelas untuk bukti kepatuhan.

Masuk ke Konsol Simple Log Service. Di bagian Projects, pilih proyek tujuan.

Di bagian Log Storage, temukan Logstore tujuan dan klik Search & Analyze untuk menjelajahi data. Gunakan kueri

* AND __tag__:__session_id__:<Session_Id>untuk menyaring log. Ganti<Session_Id>dengan ID sesi aktual.Setelah Anda menyaring sesi, di halaman Raw Logs, buka tab Raw Data, temukan log target, dan klik ikon

. Anda kemudian dapat melihat pratinjau konteks dan merekonstruksi rantai perilaku lengkap dalam sesi tersebut dalam urutan aslinya: input pengguna, inferensi model, permintaan pemanggilan tool, dan hasil eksekusi tool. Urutan kejadian terlihat jelas. Kemampuan ini sangat penting dalam skenario audit. Kemampuan ini tidak hanya membantu Anda mengidentifikasi urutan panggilan abnormal (seperti membaca file sensitif segera diikuti operasi eksfiltrasi), tetapi juga memberikan tampilan kontekstual lengkap untuk mereproduksi insiden keamanan dan menyimpan bukti.

. Anda kemudian dapat melihat pratinjau konteks dan merekonstruksi rantai perilaku lengkap dalam sesi tersebut dalam urutan aslinya: input pengguna, inferensi model, permintaan pemanggilan tool, dan hasil eksekusi tool. Urutan kejadian terlihat jelas. Kemampuan ini sangat penting dalam skenario audit. Kemampuan ini tidak hanya membantu Anda mengidentifikasi urutan panggilan abnormal (seperti membaca file sensitif segera diikuti operasi eksfiltrasi), tetapi juga memberikan tampilan kontekstual lengkap untuk mereproduksi insiden keamanan dan menyimpan bukti.

Troubleshooting runtime: Pencarian kata kunci dan analisis agregasi

Skenario khas: Dasbor metrik operasional memberi peringatan mengenai peningkatan tiba-tiba pada tingkat error. Anda perlu dengan cepat menemukan modul yang rusak dan akar penyebabnya dari volume besar log runtime.

SLS mendukung kombinasi pencarian teks lengkap dan pencarian bidang terstruktur. Dikombinasikan dengan rentang waktu, Anda dapat secara progresif mempersempit cakupan investigasi. Jalur troubleshooting khas melibatkan dua langkah: pertama, mempersempit cakupan, lalu mengkuantifikasi distribusi.

Langkah 1: Saring secara progresif untuk mengunci masalah

Saring berdasarkan tingkat log: Gunakan kueri

_meta.logLevelName: ERROR OR _meta.logLevelName: WARN OR _meta.logLevelName: FATALuntuk menyaring semua log error dan peringatan, memfokuskan perhatian Anda pada kejadian abnormal.Selidiki lebih dalam berdasarkan subsistem: Tambahkan kondisi bidang ke log error. Misalnya,

"0.subsystem": plugins. Pernyataan analitiknya adalah(_meta.logLevelName: ERROR OR _meta.logLevelName: WARN OR _meta.logLevelName: FATAL) AND "0.subsystem": plugins. Hal ini mempersempit cakupan ke subsistem tertentu. Dua langkah penyaringan ini dapat dengan cepat menemukan log error.

Langkah 2: Gunakan agregasi SQL untuk mengkuantifikasi distribusi global

Penyaringan kata kunci menemukan kejadian individual, sedangkan analisis agregasi SQL meningkatkan log individual ke tampilan statistik global. Misalnya, mengelompokkan dan mengagregasi bidang subsystem dengan pernyataan analitik _meta.logLevelName: ERROR OR _meta.logLevelName: WARN OR _meta.logLevelName: FATAL | SELECT "0.subsystem" AS subsystem, count(1) AS c GROUP BY subsystem dapat secara visual menyajikan distribusi error di berbagai subsistem. Hal ini membantu dengan cepat mengidentifikasi anomali terkonsentrasi dan menunjukkan arah untuk investigasi lebih lanjut.

Langkah 4: Korelasikan berbagai sumber data untuk proses tertutup dari deteksi anomali hingga analisis akar penyebab

Sejauh ini, kami telah memperkenalkan ingest data, dasbor bawaan, dan eksplorasi kustom berdasarkan data yang dapat diamati. Dalam O&M dan audit aktual, sumber data yang dapat diamati tidak digunakan secara terisolasi. Sebaliknya, sumber data tersebut mengikuti pola kolaboratif tetap, secara progresif menyatu dan saling memverifikasi:

Metrik OTEL → Log aplikasi (konteks error) → Log audit sesi (rantai perilaku lengkap). Jalur investigasi khas adalah sebagai berikut: Metrik OTEL mendeteksi anomali (seperti lonjakan latensi, lonjakan token, atau peningkatan tiba-tiba tingkat error). Anda kemudian menemukan detail error di log aplikasi untuk jendela waktu yang sesuai (timeout webhook, kegagalan otentikasi, anomali gerbang). Terakhir, Anda menyelidiki lebih dalam ke log audit sesi untuk merekonstruksi urutan pemanggilan tool lengkap, konten interaksi model, dan konsumsi biaya untuk sesi tersebut guna mengonfirmasi akar penyebab dan menyimpan bukti audit.