Setelah mengonfigurasi pemetaan untuk tabel yang diimpor, Anda perlu mengeksekusi tugas penjadwalan berdasarkan sumber komputasi dan melakukan perhitungan ID Mapping secara bersamaan. Setelah penjadwalan selesai, hasil perhitungan akan disimpan dalam sumber analisis.

Berikut adalah tiga metode untuk memulai penjadwalan:

Penjadwalan Manual: Penjadwalan dimulai secara manual setelah tabel dasar diperbarui.

Penjadwalan Berkala: Penjadwalan dimulai secara otomatis setiap hari atau setiap jam. Metode ini digunakan ketika tabel dasar diperbarui secara berkala.

Penjadwalan Terpicu: Anda dapat memanggil Operasi API untuk mengirim permintaan penjadwalan guna memulai penjadwalan. Metode ini digunakan untuk memicu penjadwalan melalui Operasi API setelah tugas pemrosesan tabel dasar selesai.

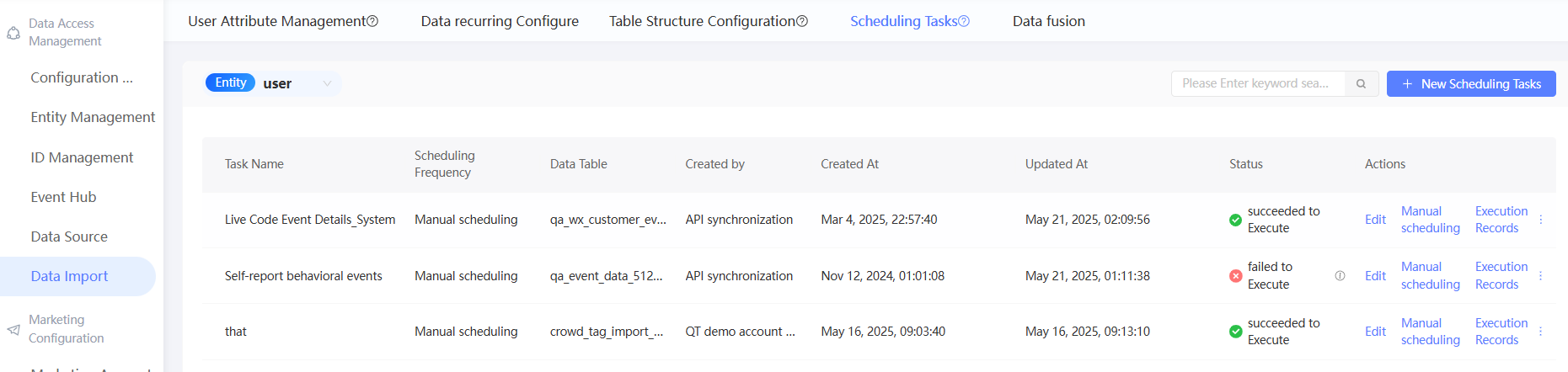

Jenis tugas penjadwalan yang diimpor menggunakan API dibuat oleh Sinkronisasi API. Metode penjadwalannya adalah penjadwalan berkala atau penjadwalan manual. Anda dapat melihat catatan eksekusi, tetapi tidak dapat mengedit atau menghapusnya. Penjadwalan manual untuk catatan eksekusi juga tidak didukung.

Buat pekerjaan

Setiap kali tugas dijadwalkan, ID pengguna dari semua tabel data harus dihitung ulang. Untuk menghindari konsumsi sumber daya komputasi yang berlebihan, disarankan untuk membuat tugas yang sama untuk menjadwalkan seluruh tabel data.

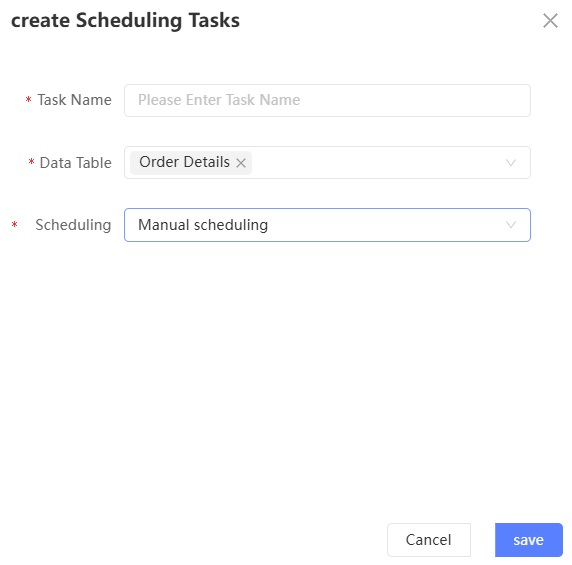

Buat tugas penjadwalan manual

Prosedur:

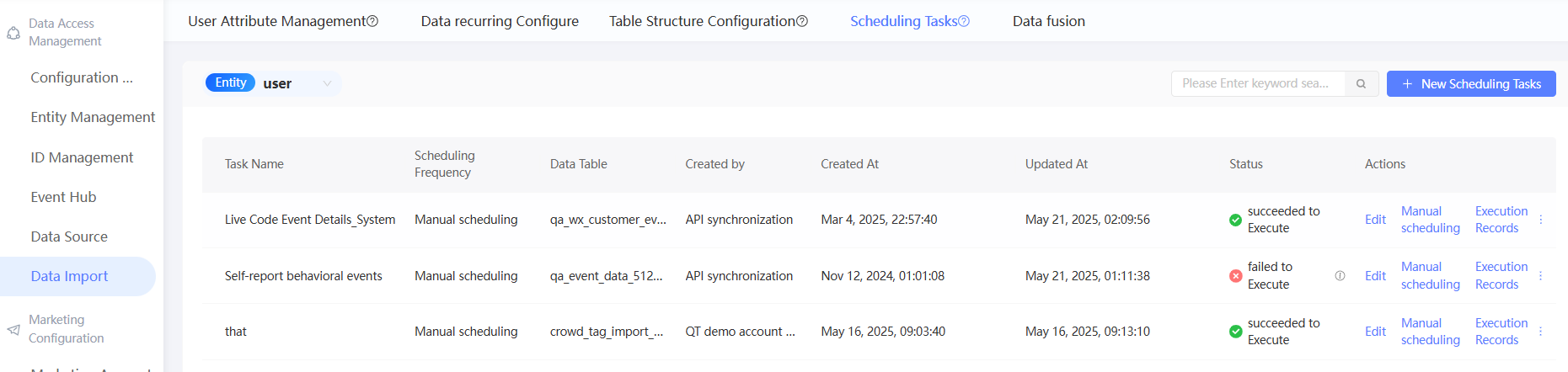

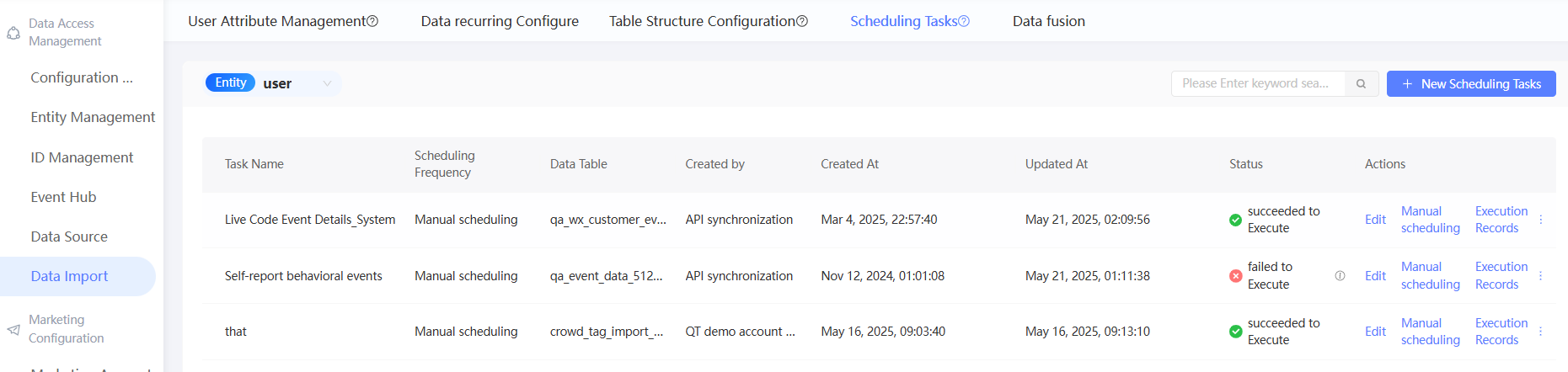

Di panel navigasi kiri, pilih Manajemen Konfigurasi > Impor Data > Impor Data > Tugas Penjadwalan.

Di sudut kanan atas, klik Buat Tugas Penjadwalan.

Di kotak dialog yang muncul, masukkan nama tugas dan pilih tabel data yang akan dijadwalkan dan diimpor. Anda dapat memilih beberapa atau semua tabel data.

Atur parameter Frekuensi Penjadwalan ke Penjadwalan Manual.

Klik Simpan.

Tugas penjadwalan akan ditambahkan ke daftar tugas. Untuk menjalankan penjadwalan secara manual, klik ikon  .

.

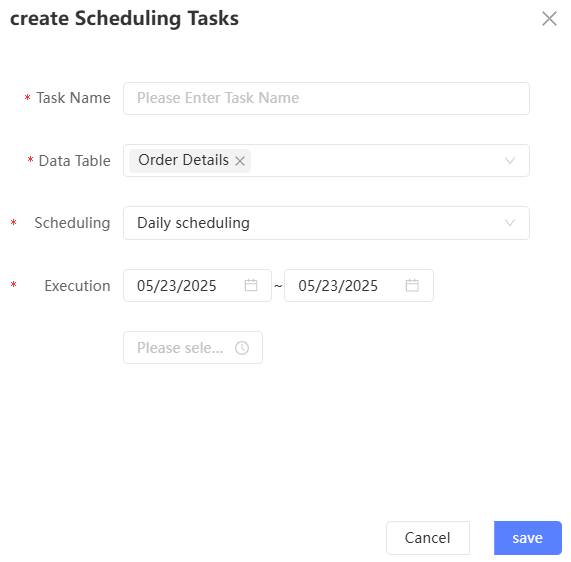

Buat tugas penjadwalan berkala

Prosedur:

Di panel navigasi kiri, pilih Manajemen Konfigurasi > Impor Data > Impor Data > Tugas Penjadwalan.

Di sudut kanan atas, klik Buat Tugas Penjadwalan.

Di kotak dialog yang muncul, masukkan nama tugas dan pilih tabel data yang akan dijadwalkan dan diimpor. Anda dapat memilih beberapa atau semua tabel data.

Atur Frekuensi Penjadwalan ke Penjadwalan Harian atau Penjadwalan Per Jam, serta atur siklus eksekusinya.

Klik Simpan.

Tugas penjadwalan akan ditambahkan ke daftar tugas dan dijalankan secara otomatis pada waktu periodik yang telah ditentukan.

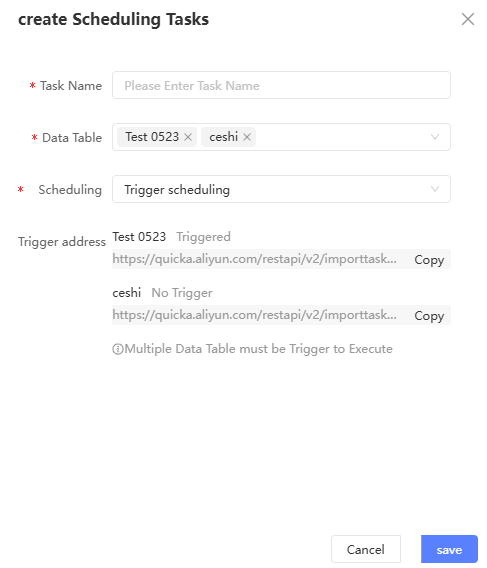

Buat tugas penjadwalan terpicu

Prosedur:

Pilih Workspace > Manajemen Konfigurasi > Impor Data > Impor Data > Tugas Penjadwalan.

Di sudut kanan atas, klik Buat Tugas Penjadwalan.

Di kotak dialog yang muncul, masukkan nama tugas dan pilih tabel data yang akan dijadwalkan dan diimpor. Anda dapat memilih beberapa atau semua tabel data.

Atur parameter Frekuensi Penjadwalan ke Penjadwalan Terpicu. URL yang berisi token akan dihasilkan untuk setiap tabel. Klik Salin untuk menyimpan URL tersebut.

Klik Simpan.

Tugas penjadwalan akan ditambahkan ke daftar tugas. Ketika perlu menjalankan penjadwalan, Anda dapat menggunakan URL ini untuk memulainya. Aturan spesifik adalah sebagai berikut:

Ketika menggunakan Dataphin, DataWorks, atau alat ETL lainnya untuk memproses tabel dasar, Anda dapat menulis kode atau memanggil operasi ini menggunakan webhook.

Untuk informasi lebih lanjut tentang skrip contoh untuk Dataphin dan DataWorks, lihat Lampiran: Skrip Contoh untuk Memicu Penjadwalan.

Jika beberapa tabel berada dalam tugas penjadwalan yang sama, setiap tabel perlu dijadwalkan sekali melalui permintaan URL yang sesuai. Tugas penjadwalan hanya akan dieksekusi jika semua tabel dipicu.

Di daftar tugas, klik Edit untuk melihat status pemicuan setiap tabel. Tabel yang telah dijadwalkan menggunakan URL akan ditampilkan sebagai "Dipicu". Jika beberapa tabel ditampilkan sebagai "Tidak Dipicu", Anda perlu memicunya melalui URL yang sesuai. Penjadwalan akan mulai dieksekusi ketika semua tabel ditampilkan sebagai "Dipicu".

Selama proses penjadwalan suatu tugas, permintaan penjadwalan tambahan yang diterima akan diabaikan.

Modifikasi tugas penjadwalan

Klik Edit untuk memodifikasi tugas penjadwalan. Mulai penjadwalan berikutnya, penjadwalan akan dieksekusi berdasarkan pengaturan yang telah diedit.

Penjadwalan manual

Selain penjadwalan otomatis, Anda juga dapat memulai penjadwalan secara manual untuk penjadwalan berkala dan terpicu.

Klik Penjadwalan Manual untuk memulai penjadwalan secara manual.

Lihat hasil

Setelah tugas terjadwal dieksekusi minimal sekali, daftar akan menampilkan status eksekusi terakhir (eksekusi berhasil / gagal).

Jika eksekusi gagal, gerakkan pointer ke Eksekusi Gagal. Penyebab kegagalan akan ditampilkan di halaman untuk membantu Anda menyelesaikan masalah.

Klik Catatan Eksekusi untuk melihat catatan eksekusi dan status setiap eksekusi tugas, seperti yang ditunjukkan pada gambar berikut.

Klik ikon  untuk menampilkan status eksekusi semua tabel yang termasuk dalam jadwal eksekusi.

untuk menampilkan status eksekusi semua tabel yang termasuk dalam jadwal eksekusi.

Hapus tugas penjadwalan

Pilih  /> Hapus. Setelah mengonfirmasi penghapusan, tugas penjadwalan akan dihapus, tetapi data yang diperoleh oleh tugas tersebut tetap dipertahankan.

/> Hapus. Setelah mengonfirmasi penghapusan, tugas penjadwalan akan dihapus, tetapi data yang diperoleh oleh tugas tersebut tetap dipertahankan.

Lampiran: Skrip contoh untuk memicu penjadwalan

Skrip contoh berikut digunakan untuk memicu tugas penjadwalan impor di Dataphin dan DataWorks.

Dataphin

Di Dataphin, lakukan langkah-langkah berikut untuk memicu tugas penjadwalan impor menggunakan tugas Shell periodik:

Tambahkan daftar putih sandbox dan masukkan semua URL yang dihasilkan saat Anda Membuat Tugas Penjadwalan Terpicu sebagai alamat IP yang ingin Anda akses. Untuk informasi lebih lanjut, lihat Dataphin Menambahkan Daftar Izin Sandbox.

Buat tugas shell. Untuk informasi lebih lanjut, lihat Buat Tugas Shell. Pilih Tugas Periodik sebagai jenis penjadwalan.

Jika tugas penjadwalan yang sama berisi beberapa tabel, beberapa URL pemicu akan dihasilkan, dan beberapa tugas Shell periodik harus dibuat sesuai.

Contoh skrip Shell adalah sebagai berikut:

#!/bin/bash # {URL Pemicu} Ganti dengan URL pemicu. QA_TRIGGER_URL="{URL Pemicu}" echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience Memulai Penjadwalan Pemicu." echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience URL Penjadwalan Pemicu:" $QA_TRIGGER_URL result=$(curl -k -s ${QA_TRIGGER_URL}) if [ ! -n "$result" ]; then echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience Pemicu Gagal" $result else echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience Respon Penjadwalan Pemicu:" $result echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience Mengakhiri Penjadwalan Pemicu." fiOpsional. Anda dapat mengklik Jalankan Tugas Shell untuk menguji apakah tugas penjadwalan impor dapat dipicu dan memeriksa apakah log keluaran berisi informasi sukses berikut:

Respon Penjadwalan Pemicu QuickAudience: {"data":"true","errorCode":null,"errorDesc":null,"exStack":null,"opers":[],"solution":null,"success":true,"traceId":"0bc1409e16667784903588235e2ef1"}Konfigurasikan penjadwalan untuk tugas Shell. Untuk informasi lebih lanjut, lihat Konfigurasi Penjadwalan.

Klik Buat Ketergantungan Hulu untuk mengaitkan ketergantungan hulu yang digunakan untuk menghasilkan data di tabel saat ini. Ketika ketergantungan hulu telah menghasilkan data dan waktu penjadwalan yang dikonfigurasi tercapai, penjadwalan tugas Shell dipicu.

Jika semua tugas Shell yang sesuai dengan URL tugas penjadwalan impor dipicu, tugas penjadwalan impor dipicu.

DataWorks

DataWorks memungkinkan Anda memicu tugas penjadwalan impor pada node Shell atau pada node PyODPS 3.

Membuat Node Shell

Untuk memicu tugas penjadwalan impor menggunakan node Shell di DataWorks, lakukan langkah-langkah berikut:

Node Shell perlu menggunakan sumber daya eksklusif untuk grup penjadwalan agar dapat dijadwalkan. Untuk informasi lebih lanjut, lihat Sumber Daya Eksklusif untuk Grup Penjadwalan.

Jika tidak, node Shell gagal dijadwalkan dan pesan kesalahan berikut akan ditampilkan:

curl: (1) Protokol https tidak didukung atau dinonaktifkan di libcurlBuat node Shell. Untuk informasi lebih lanjut, lihat Buat Node Shell.

Jika tugas penjadwalan yang sama berisi beberapa tabel, beberapa URL pemicu akan dihasilkan dan beberapa node Shell harus dibuat sesuai.

Contoh skrip Shell adalah sebagai berikut:

#!/bin/bash # {URL Pemicu} Ganti dengan URL pemicu. QA_TRIGGER_URL="{URL Pemicu}" echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience Memulai Penjadwalan Pemicu." echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience URL Penjadwalan Pemicu:" $QA_TRIGGER_URL result=$(curl -k -s ${QA_TRIGGER_URL}) if [ ! -n "$result" ]; then echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience Pemicu Gagal" $result else echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience Respon Penjadwalan Pemicu:" $result echo $(date "+%Y-%m-%d %H:%M:%S") "QuickAudience Mengakhiri Penjadwalan Pemicu." fiOpsional. Anda dapat mengklik Jalankan Shell untuk menguji apakah tugas penjadwalan impor dipicu dan memeriksa apakah log keluaran berisi informasi sukses berikut:

Respon Penjadwalan Pemicu QuickAudience: {"data":"true","errorCode":null,"errorDesc":null,"exStack":null,"opers":[],"solution":null,"success":true,"traceId":"0bc1409e16667784903588235e2ef1"}Konfigurasikan penjadwalan untuk node Shell. Untuk informasi lebih lanjut, lihat Konfigurasikan Dependensi Penjadwalan.

Sebagaimana ditunjukkan pada gambar berikut, buat dependensi hulu dan kaitkan dengan node hulu yang menghasilkan data di tabel data saat ini. Ketika node hulu telah menghasilkan data dan waktu penjadwalan yang dikonfigurasi tercapai, node Shell dijadwalkan.

Jika semua node Shell yang sesuai dengan URL tugas penjadwalan impor dipicu, tugas penjadwalan impor dipicu.

Node PyODPS 3

Di DataWorks, gunakan node PyODPS 3 untuk memicu tugas penjadwalan impor. Prosedurnya adalah sebagai berikut:

Node PyODPS 3 dapat dijadwalkan menggunakan grup sumber daya publik atau sumber daya eksklusif untuk grup penjadwalan.

Grup sumber daya publik diaktifkan secara otomatis. Untuk informasi lebih lanjut, lihat Grup Sumber Daya Publik.

Untuk informasi lebih lanjut tentang sumber daya eksklusif untuk grup penjadwalan, lihat Sumber Daya Eksklusif untuk Grup Penjadwalan.

Buat node PyODPS 3. Untuk informasi lebih lanjut, lihat Node PyODPS 3.

Jika tugas penjadwalan yang sama berisi beberapa tabel, beberapa URL pemicu akan dihasilkan dan beberapa node PyODPS 3 harus dibuat sesuai.

Contoh skrip Python 3 adalah sebagai berikut:

import requests from datetime import datetime # {Alamat yang memicu penjadwalan} Ganti dengan alamat yang memicu penjadwalan. QA_TRIGGER_URL = "{Alamat yang memicu penjadwalan}" print(datetime.now().strftime("%Y-%m-%d %H:%M:%S") + " QuickAudience Memulai Penjadwalan Pemicu.") print(datetime.now().strftime("%Y-%m-%d %H:%M:%S") + " QuickAudience URL Penjadwalan Pemicu:" + QA_TRIGGER_URL) response = requests.get(QA_TRIGGER_URL) print(datetime.now().strftime("%Y-%m-%d %H:%M:%S") + " QuickAudience Respon Penjadwalan Pemicu:" + response.text) print(datetime.now().strftime("%Y-%m-%d %H:%M:%S") + " QuickAudience Mengakhiri Penjadwalan Pemicu.")Opsional. Anda dapat mengklik Jalankan PyODPS 3 untuk menguji apakah tugas penjadwalan impor dipicu dan memeriksa apakah log keluaran berisi informasi sukses berikut:

Respon Penjadwalan Pemicu QuickAudience: {"data":"true","errorCode":null,"errorDesc":null,"exStack":null,"opers":[],"solution":null,"success":true,"traceId":"0bc1409e16667784903588235e2ef1"}Konfigurasikan penjadwalan untuk node PyODPS 3. Untuk informasi lebih lanjut, lihat Konfigurasikan Dependensi Penjadwalan.

Sebagaimana ditunjukkan pada gambar berikut, buat dependensi hulu dan kaitkan dengan node hulu yang menghasilkan data di tabel data saat ini. Ketika node hulu telah menghasilkan data dan mencapai waktu penjadwalan yang dikonfigurasi, penjadwalan node PyODPS 3 dipicu.

Jika semua node PyODPS 3 yang sesuai dengan URL tugas penjadwalan impor dipicu, tugas penjadwalan impor dipicu.