Tentang model

Alibaba Cloud merilis model penalaran QwQ-32B secara open-source pada 6 Maret. Dengan memanfaatkan Pembelajaran Penguatan (reinforcement learning) skala besar, QwQ-32B memberikan peningkatan signifikan dalam kemampuan matematika, pemrograman, dan kemampuan umum. Performa keseluruhannya setara dengan DeepSeek-R1, namun dengan biaya penerapan dan penggunaan yang jauh lebih rendah.

-

Pada AIME24—benchmark untuk kemampuan matematika—dan LiveCodeBench—benchmark untuk kemampuan pemrograman—QwQ-32B berkinerja setara dengan DeepSeek-R1 dan jauh melampaui model o1-mini serta model hasil distilasi R1 dengan ukuran yang sama.

-

Pada LiveBench—“leaderboard LLM terberat” yang dipimpin oleh Yann LeCun, Chief AI Scientist Meta—IFEval—benchmark untuk kepatuhan instruksi yang diusulkan oleh Google—dan BFCL—benchmark untuk akurasi pemanggilan fungsi atau tool yang dikembangkan oleh UC Berkeley dan pihak lain—QwQ-32B mencatat skor lebih tinggi daripada DeepSeek-R1.

-

QwQ-32B secara inovatif mengintegrasikan kemampuan agen. Model ini mampu berpikir kritis saat menggunakan tool dan menyesuaikan proses penalarannya berdasarkan umpan balik dari lingkungan.

PAI Model Gallery kini mendukung penuh penerapan satu-klik, fine-tuning, dan evaluasi model QwQ-32B. Penerapan memerlukan GPU dengan VRAM sebesar 96 GB. Versi terkuantisasi—QwQ-32B-GGUF dan QwQ-32B-AWQ—juga didukung. Anda dapat menerapkan model-model terkuantisasi ini pada GPU berbiaya lebih rendah seperti satu unit A10.

Terapkan model

-

Buka halaman Model Gallery.

-

Masuk ke Konsol PAI. Di pojok kiri atas, pilih Wilayah yang sesuai kebutuhan Anda. Ganti Wilayah jika diperlukan untuk mengakses sumber daya komputasi yang tersedia.

-

Di panel navigasi sebelah kiri, klik Workspace List. Lalu klik nama ruang kerja Anda untuk membukanya.

-

Di panel navigasi sebelah kiri, klik Getting Started > Model Gallery.

-

-

Di halaman Model Gallery, temukan kartu model QwQ-32B dan klik untuk membuka halaman detail model.

-

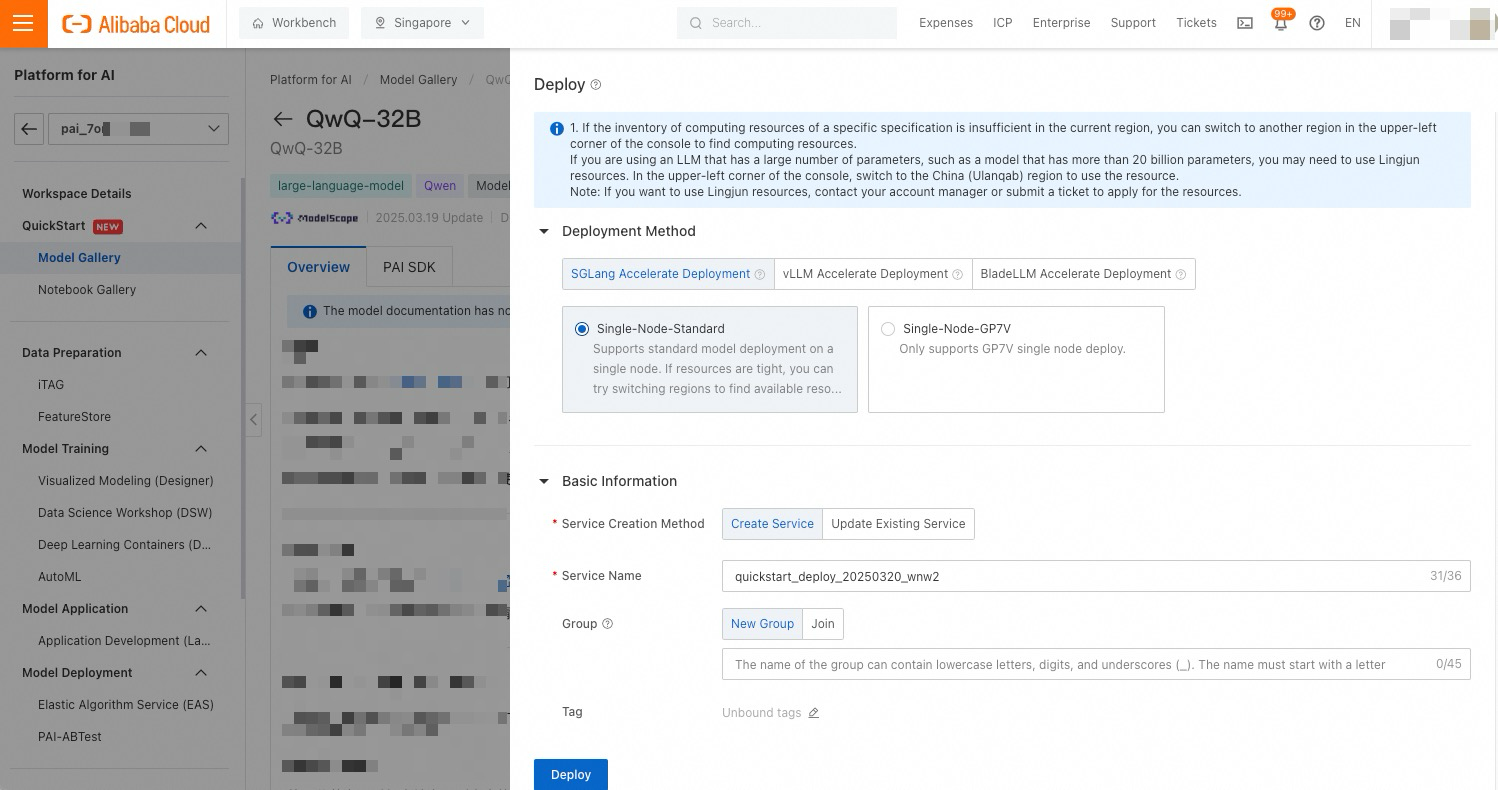

Klik Deploy di pojok kanan atas. Pilih framework penerapan, masukkan nama untuk layanan inferensi Anda, dan konfigurasikan sumber daya yang diperlukan. Lalu klik Deploy untuk menjalankan layanan di PAI-EAS—platform inferensi AI Alibaba Cloud. Framework yang didukung mencakup SGLang, vLLM, dan BladeLLM—framework inferensi berkinerja tinggi yang dikembangkan oleh PAI Alibaba Cloud.

-

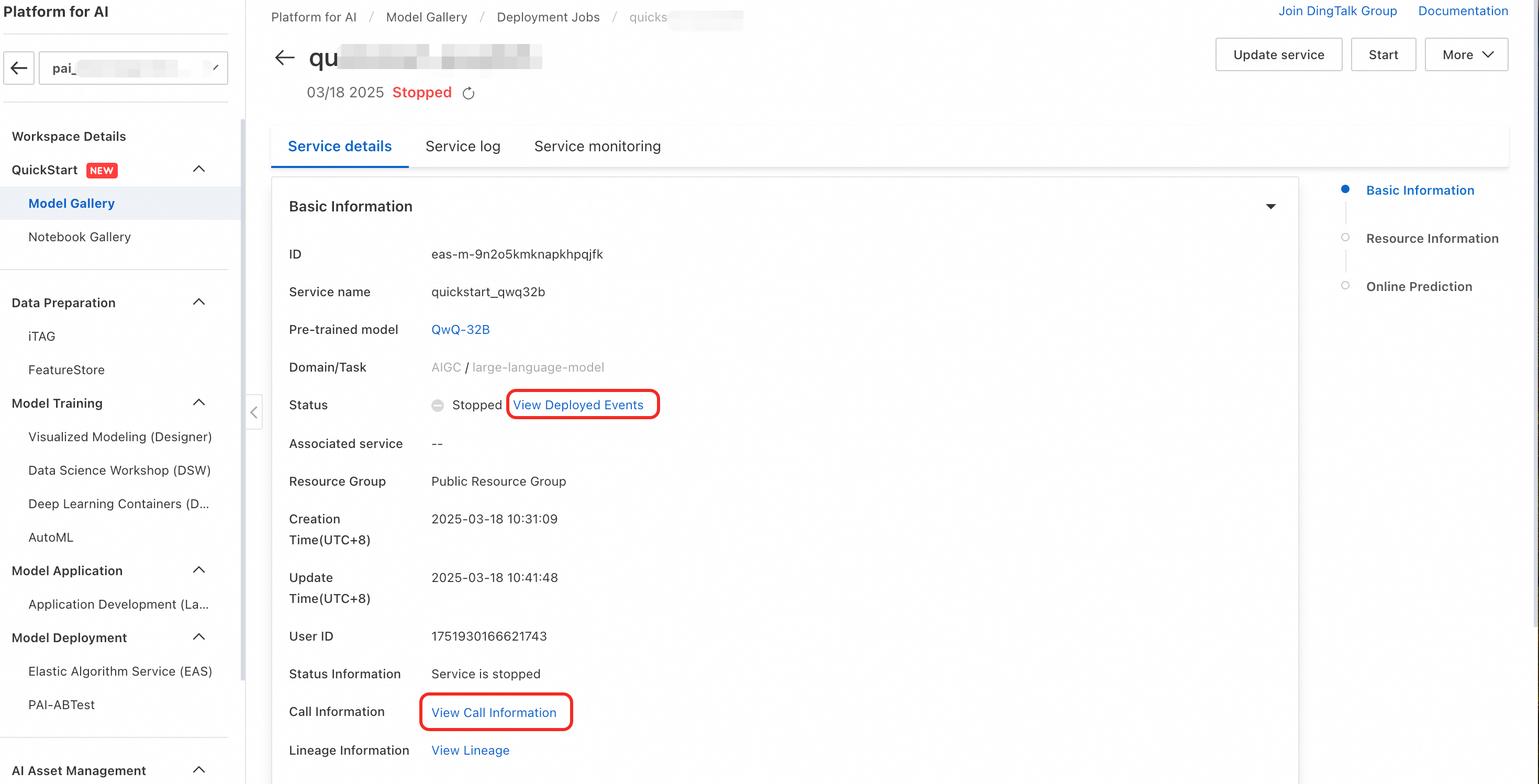

Gunakan layanan inferensi. Setelah penerapan berhasil, buka halaman layanan dan klik View Endpoint Information untuk mendapatkan URL titik akhir dan token. Untuk mempelajari cara memanggil layanan, klik tautan pre-trained model untuk kembali ke halaman perkenalan model dan baca petunjuk pemanggilan.

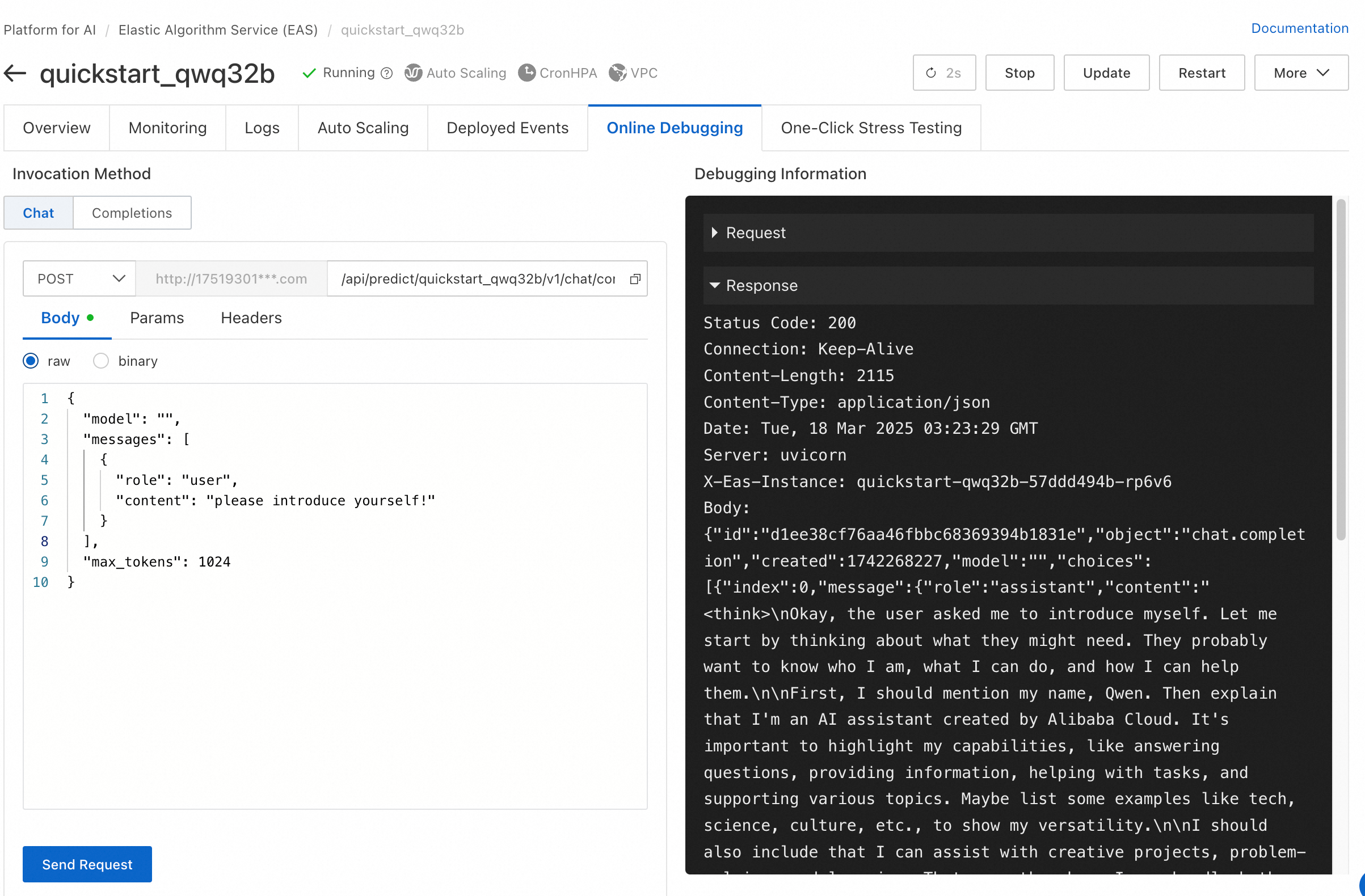

Anda juga dapat melakukan debug model QwQ-32B yang telah diterapkan secara online di platform inferensi PAI-EAS.

Fine-tune model

PAI Model Gallery menyediakan supervised fine-tuning (SFT) untuk QwQ-32B. Anda dapat menggunakan fine-tuning LoRA atau fine-tuning parameter penuh—keduanya siap pakai.

-

Siapkan data pelatihan. Algoritma SFT menerima set data pelatihan dalam format JSONL dan format lainnya. Untuk persyaratan format lebih lanjut, lihat dokumentasi model. Berikut contoh data pelatihan dalam format JSONL:

{"messages": [{"role": "system", "content": "You are a helpful and harmless assistant"}, {"role": "user", "content": "Who are you?"}, {"role": "assistant", "content": "I am Xiao Pai, an AI assistant trained by PAI. My goal is to provide useful, accurate, and timely information and help users communicate effectively. How can I help you today?"}]} {"messages": [{"role": "system", "content": "You are a helpful and harmless assistant"}, {"role": "user", "content": "Who are you!"}, {"role": "assistant", "content": "Hello! I am Xiao Pai, an AI language model developed by PAI. I can answer questions, provide information, hold conversations, and help solve problems. If you have any questions or need assistance, feel free to ask!"}]} -

Konfigurasikan parameter pelatihan. Setelah menyiapkan data, unggah ke bucket Object Storage Service (OSS). Karena QwQ-32B berukuran besar, algoritma ini memerlukan GPU dengan VRAM minimal 96 GB. Pastikan kuota sumber daya Anda mencakup sumber daya komputasi yang cukup.

Tabel berikut mencantumkan hiperparameter yang didukung. Sesuaikan berdasarkan set data dan sumber daya komputasi Anda—atau gunakan nilai default.

Nama Parameter

Deskripsi

Catatan

learning_rate

Tingkat pembelajaran. Mengontrol seberapa besar bobot model berubah selama pelatihan.

Tingkat pembelajaran yang terlalu tinggi menyebabkan pelatihan tidak stabil dan fluktuasi loss besar. Tingkat pembelajaran yang terlalu rendah memperlambat konvergensi. Pilih nilai yang memungkinkan model konvergen dengan cepat dan stabil.

num_train_epochs

Jumlah kali iterasi penuh terhadap set data pelatihan.

Epoch terlalu sedikit dapat menyebabkan underfitting. Epoch terlalu banyak dapat menyebabkan overfitting. Untuk set data kecil, tambahkan epoch untuk menghindari underfitting. Tingkat pembelajaran yang lebih kecil biasanya memerlukan lebih banyak epoch.

per_device_train_batch_size

Jumlah sampel yang diproses per GPU dalam satu langkah pelatihan.

Ukuran batch yang lebih besar mempercepat pelatihan tetapi menggunakan lebih banyak VRAM. Gunakan ukuran batch terbesar yang muat dalam memori GPU Anda. Periksa penggunaan memori GPU di halaman pemantauan tugas.

gradient_accumulation_steps

Jumlah langkah untuk mengakumulasi gradien sebelum memperbarui bobot model.

Ukuran batch kecil meningkatkan varians gradien dan memperlambat konvergensi. Akumulasi gradien memungkinkan Anda menjumlahkan gradien dari beberapa batch sebelum setiap pembaruan. Atur nilai ini sebagai kelipatan jumlah GPU Anda.

max_length

Panjang token maksimum untuk data masukan dalam satu langkah pelatihan.

Setelah tokenisasi, data pelatihan Anda menjadi urutan token. Gunakan tool estimasi token untuk memperkirakan panjang teks.

lora_rank

Rank LoRA.

lora_alpha

Bobot LoRA.

Koefisien penskalaan LoRA. Biasanya diatur ke lora_rank × 2.

lora_dropout

Laju dropout untuk pelatihan LoRA. Secara acak menghilangkan neuron selama pelatihan untuk mencegah overfitting.

lorap_lr_ratio

Rasio tingkat pembelajaran LoRA+ (λ = ηB/ηA), di mana ηA dan ηB adalah tingkat pembelajaran untuk matriks adapter A dan B.

Dibandingkan dengan LoRA, LoRA+ menggunakan tingkat pembelajaran berbeda untuk bagian-bagian kunci dalam proses fine-tuning. Hal ini meningkatkan performa dan mempercepat fine-tuning tanpa biaya komputasi tambahan. Atur lorap_lr_ratio ke 0 untuk menggunakan LoRA standar alih-alih LoRA+

advanced_settings

Gunakan bidang ini untuk menambahkan argumen kustom dalam format "--key1 value1 --key2 value2". Biarkan kosong jika tidak diperlukan.

-

save_strategy: Strategi penyimpanan checkpoint model. Opsi: "steps", "epoch", atau "no". Default: "steps".

-

save_steps: Jumlah langkah antar penyimpanan. Default: 500.

-

save_total_limit: Jumlah maksimum checkpoint yang disimpan. Checkpoint lama akan dihapus secara otomatis. Default: 2. Atur ke None untuk menyimpan semua checkpoint.

-

warmup_ratio: Rasio langkah pelatihan yang digunakan untuk pemanasan tingkat pembelajaran. Selama pemanasan, tingkat pembelajaran meningkat secara bertahap dari nilai kecil ke tingkat pembelajaran awal. Default: 0.

-

-

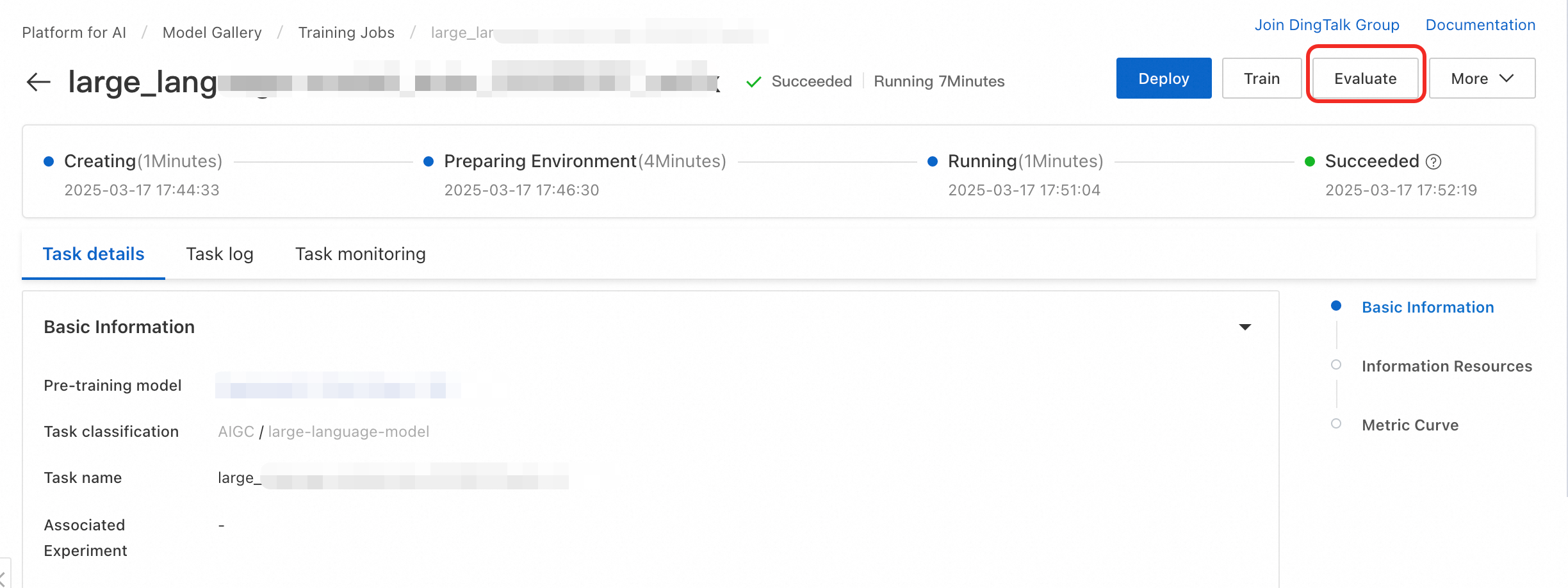

Klik Train untuk memulai pelatihan. Pantau status dan log pekerjaan pelatihan. Setelah pelatihan selesai, terapkan model hasil fine-tuning sebagai layanan online.

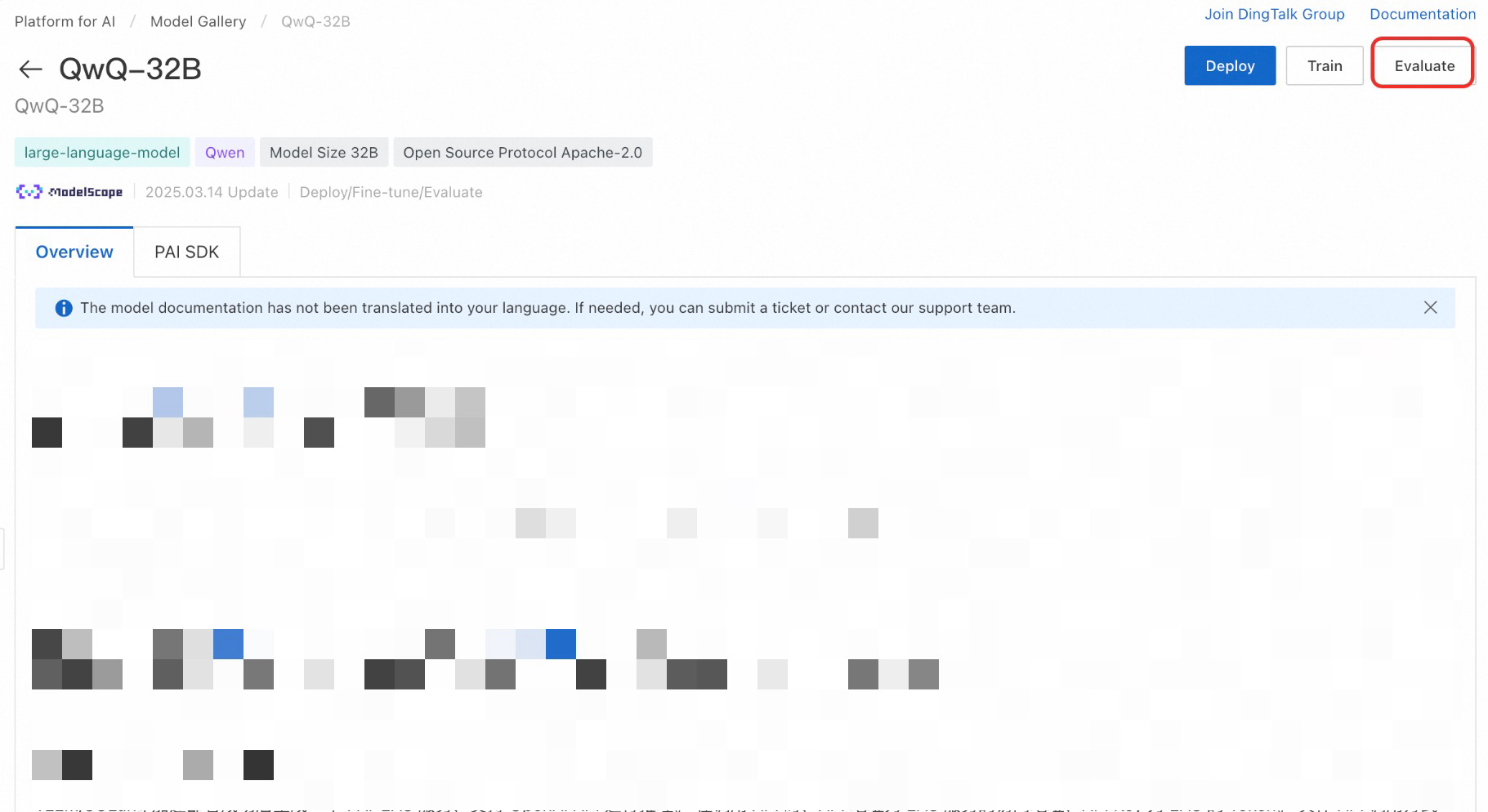

Evaluasi model

PAI Model Gallery mencakup algoritma evaluasi umum. Anda dapat langsung mengevaluasi model pra-latih dan hasil fine-tuning. Evaluasi membantu Anda menilai performa model dan membandingkan beberapa model untuk memilih yang paling sesuai dengan kasus penggunaan Anda.

Titik masuk evaluasi:

|

Evaluasi model pra-latih secara langsung |

|

|

Evaluasi model hasil fine-tuning di halaman detail pekerjaan pelatihan |

|

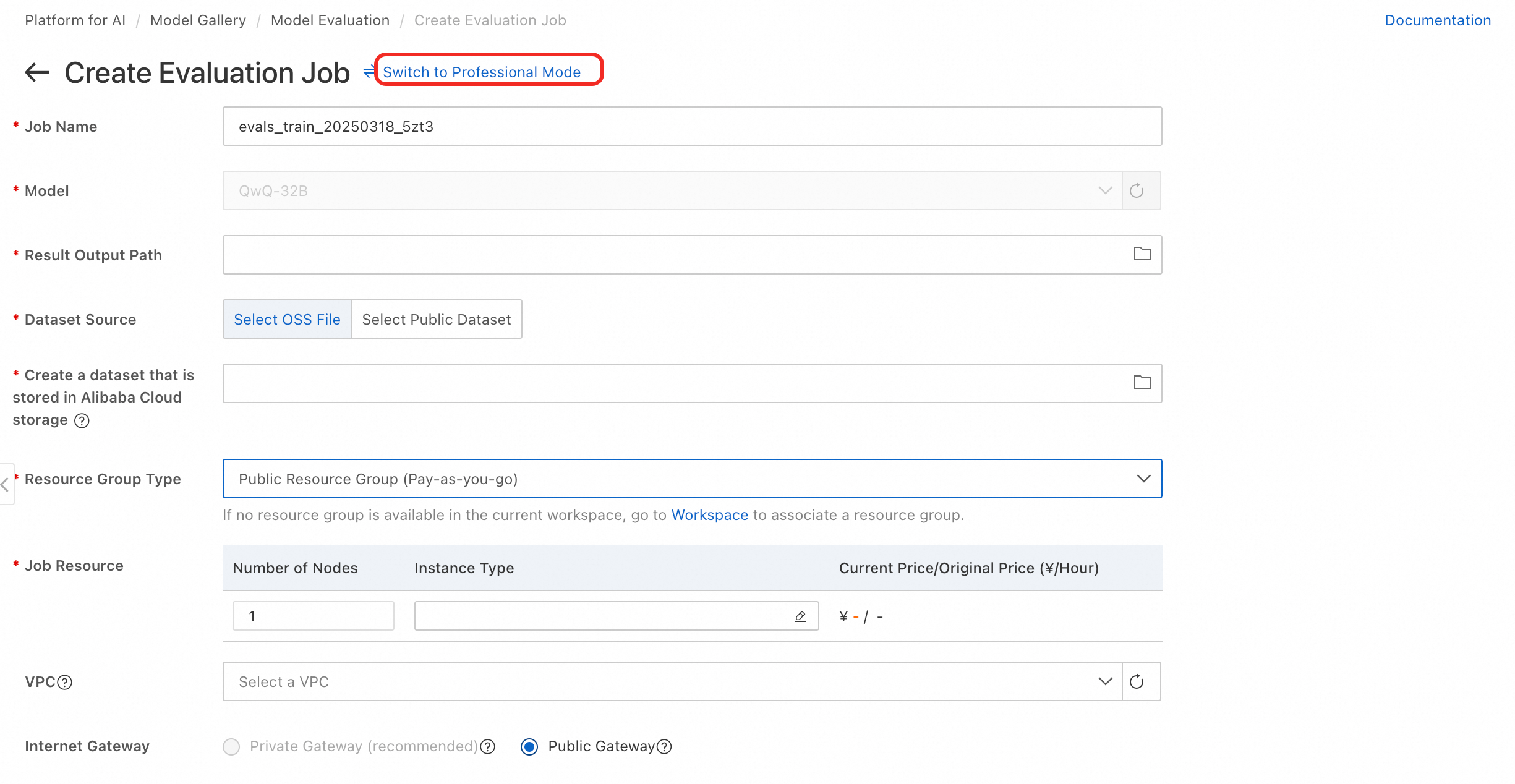

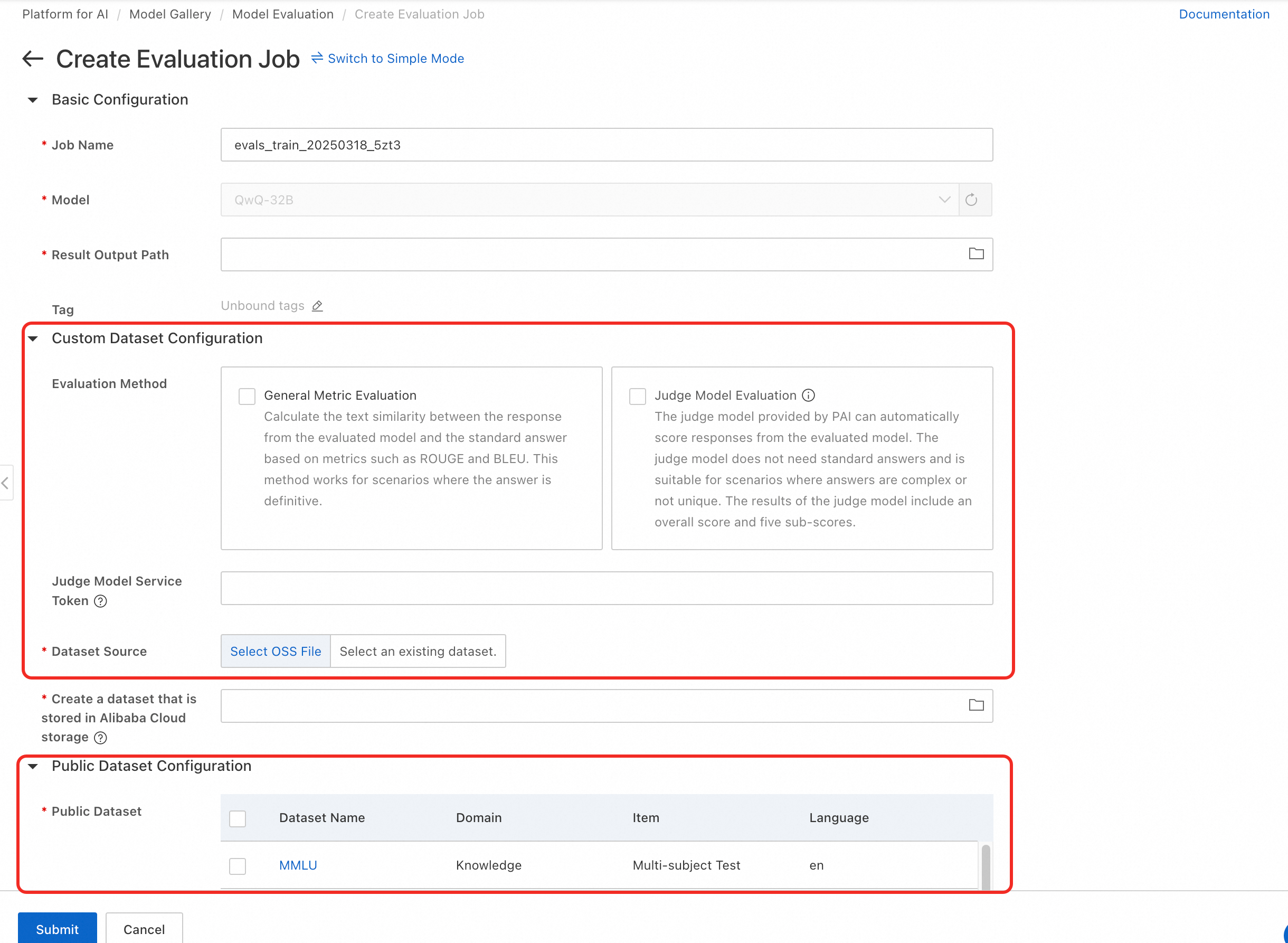

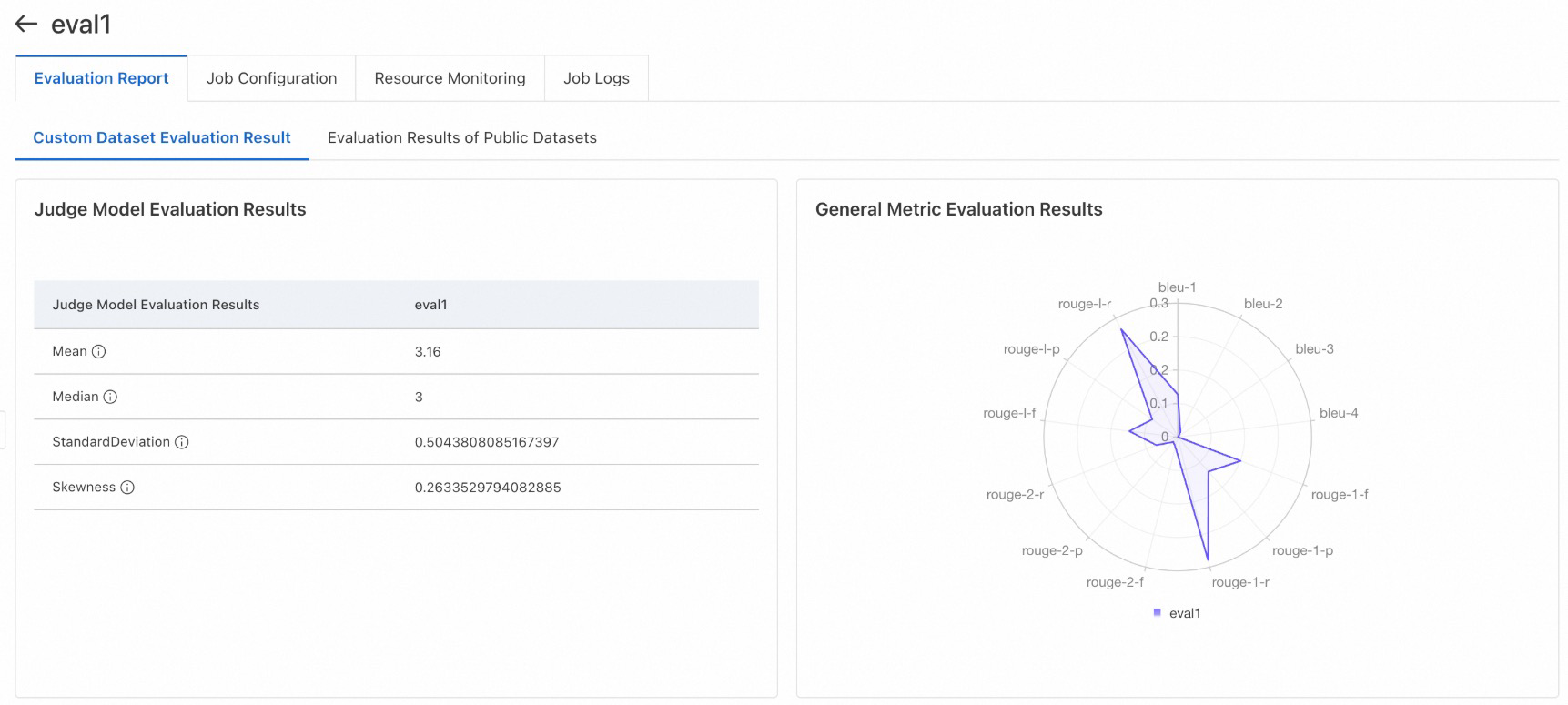

Evaluasi mendukung dataset publik maupun dataset kustom:

-

Evaluasi dataset kustom

Metrik yang didukung mencakup BLEU dan ROUGE—skor pencocokan teks NLP umum—serta evaluasi LLM-as-a-Judge (hanya tersedia dalam Expert Mode). LLM-as-a-Judge menggunakan LLM lain untuk memberi skor dan menjelaskan hasil. Gunakan metode ini untuk menguji apakah model sesuai dengan skenario unik Anda.

Sediakan set data evaluasi dalam format JSONL. Setiap baris harus berupa objek JSON dengan field question dan answer. Contoh file: evaluation_test.jsonl.

-

Evaluasi dataset publik

Pendekatan ini memungkinkan evaluasi kemampuan komprehensif Large Language Models (LLMs) dengan mengkategorikan dataset evaluasi open-source berdasarkan domain. PAI saat ini menyediakan dataset seperti CMMLU, GSM8K, TriviaQA, MMLU, C-Eval, TruthfulQA, dan HellaSwag, yang mencakup berbagai domain seperti matematika, pengetahuan, dan penalaran. Dataset publik lainnya sedang dalam proses integrasi bertahap. Catatan: Evaluasi menggunakan dataset GSM8K, TriviaQA, dan HellaSwag memerlukan waktu signifikan; pilih sesuai kebutuhan.

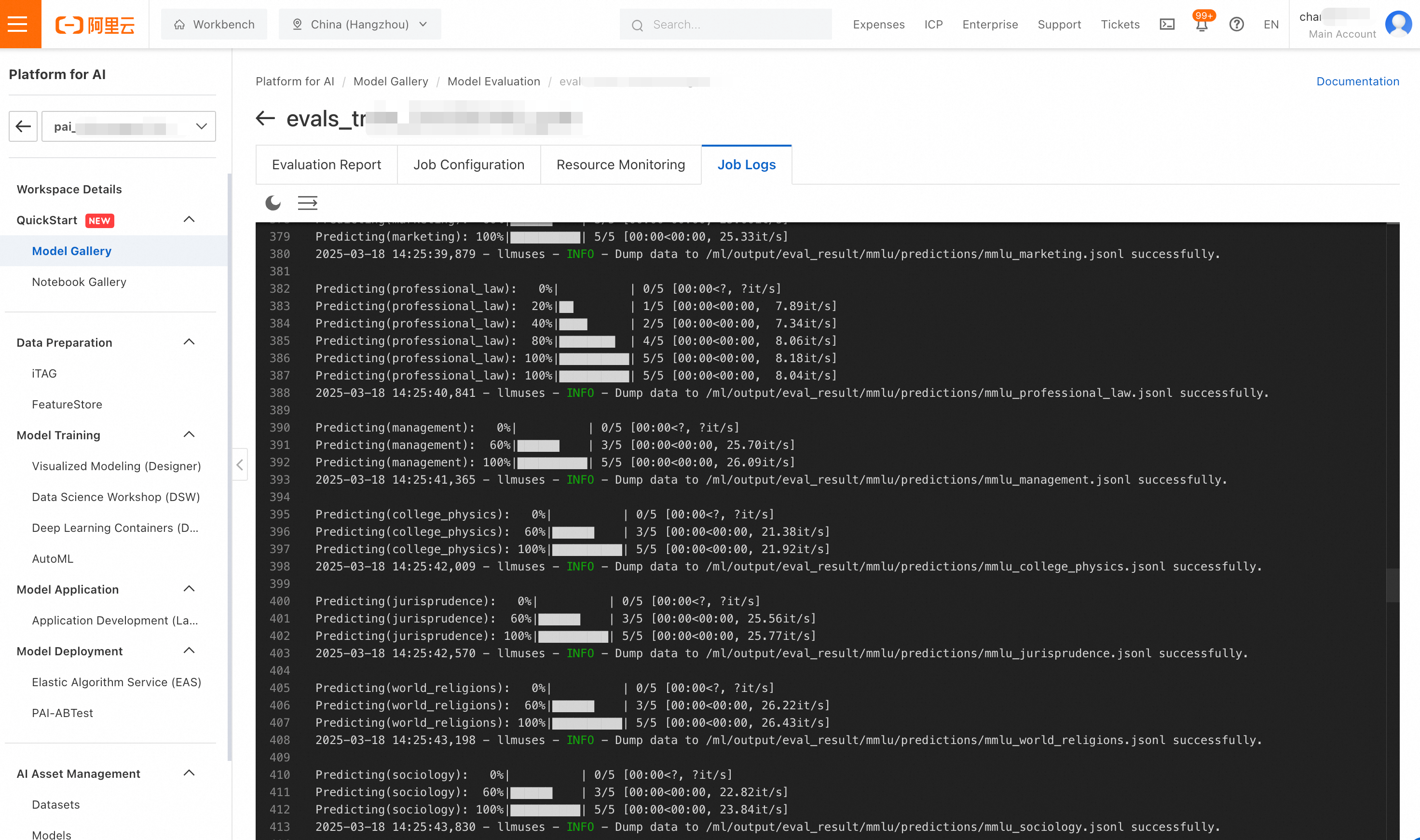

Pilih jalur output untuk hasil evaluasi. Pilih sumber daya komputasi berdasarkan rekomendasi sistem. Lalu kirimkan pekerjaan evaluasi. Setelah selesai, lihat hasilnya di halaman pekerjaan. Jika Anda memilih banyak dataset, model akan menjalankannya satu per satu—sehingga waktu tunggu mungkin lama. Periksa log untuk melihat dataset mana yang sedang berjalan.

Lihat laporan evaluasi. Contoh untuk evaluasi dataset kustom dan publik:

Hubungi kami

Kami menyambut penggunaan berkelanjutan Anda terhadap PAI Model Gallery. Kami secara rutin menambahkan model teknologi terkini (SOTA). Jika Anda memiliki permintaan model, hubungi kami. Bergabunglah dengan grup pengguna PAI Model Gallery di DingTalk dengan mencari nomor grup 79680024618.