Dokumen ini hanya berlaku untuk wilayah China (Beijing).

Metode Penagihan

Sebelum menerapkan model, Anda dapat memeriksa perkiraan biaya per jam untuk berbagai model di Konsol Penerapan Model (Beijing).

Anda tidak dapat mengubah metode penagihan setelah layanan dibuat. Untuk mengganti metode tersebut, Anda harus terlebih dahulu membatalkan penerapan model dan menerapkannya kembali.

|

Provisioned Throughput

|

||

|

Kasus Penggunaan |

Paling cocok untuk trafik yang dapat diprediksi di mana throughput stabil, konkurensi tinggi, dan latensi rendah sangat penting. |

|

|

Metode Penagihan |

Berdasarkan durasi penggunaan dan throughput yang disediakan |

|

|

Metode Penskalaan |

Peningkatan atau penurunan throughput mandiri |

|

|

Unit Penagihan Minimum |

Pasca bayar: menit |

Prabayar: hari |

|

Manfaat |

|

|

|

Batasan Produk |

|

|

Untuk melihat penggunaan token per panggilan dan jumlah panggilan historis, buka halaman Pemantauan Model (Beijing).

Rincian Penagihan

Bayar Sesuai Penggunaan Berdasarkan Durasi (Provisioned Throughput)

Biaya = Durasi × (Harga satuan TPM input × TPM input + Harga satuan TPM output × TPM output)

-

Pesanan prabayar langsung berlaku setelah pembayaran dan berlaku hingga pukul 23.59 pada hari ke-N. Jika Anda melakukan pemesanan setelah pukul 22.00, tanggal kedaluwarsa diperpanjang satu hari.

-

Setelah pesanan prabayar kedaluwarsa, layanan berhenti dua jam kemudian. Sumber daya dicadangkan selama 14 jam sebelum dilepas.

-

Anda tidak dapat menghentikan pesanan prabayar sebelum waktunya.

-

Untuk penagihan pasca bayar, jika akun Anda memiliki pembayaran tertunda, sumber daya yang diterapkan tetap aktif dan terus ditagih selama 24 jam sebelum secara otomatis dilepas.

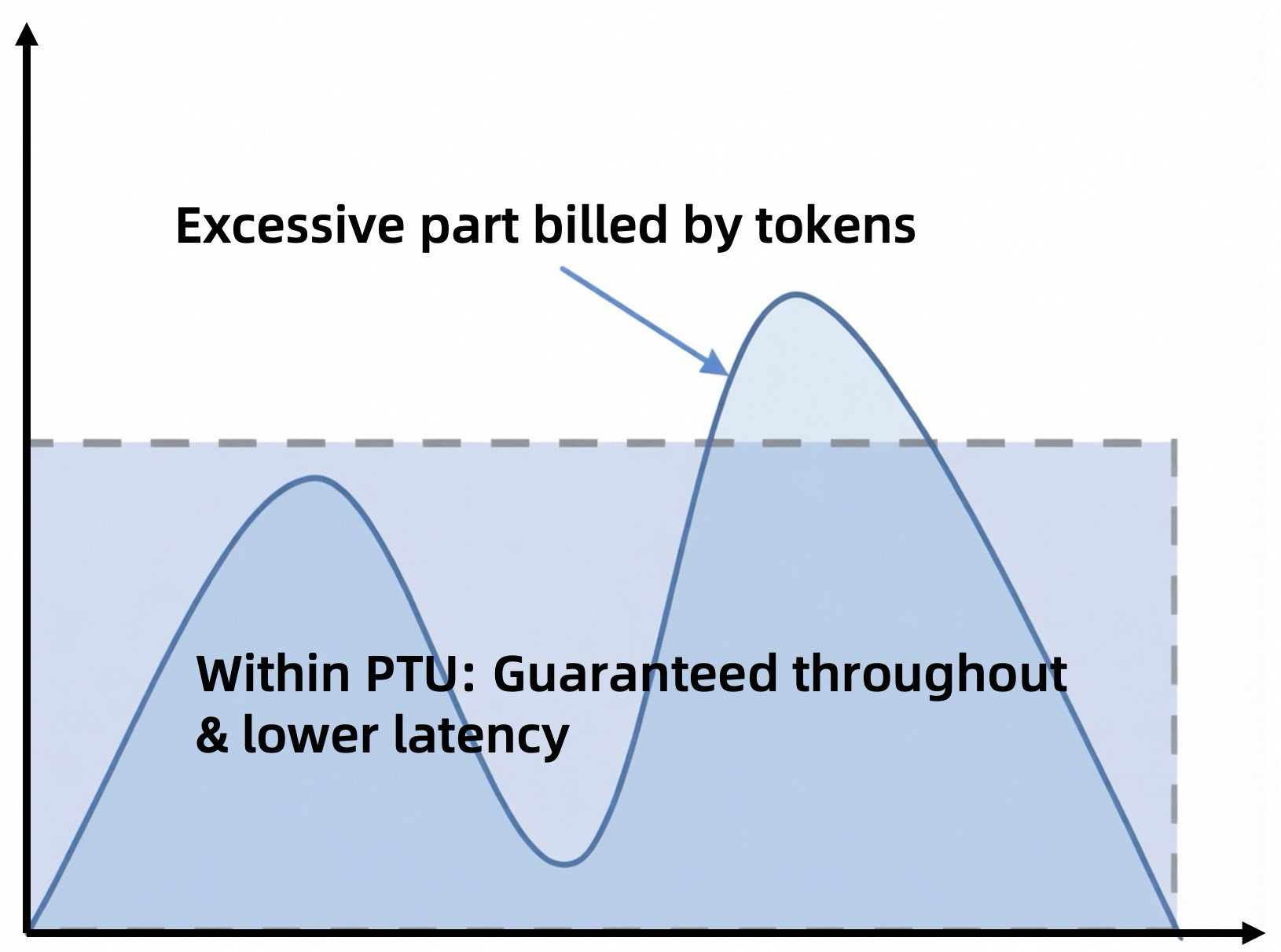

Jika input model melebihi panjang token input maksimum atau batas Tokens Per Minute (TPM) yang Anda beli, panggilan terkait tersebut secara otomatis beralih ke panggilan model bayar sesuai penggunaan. Hal ini dapat menyebabkan penurunan performa inferensi. Panggilan tersebut tunduk pada pembatasan laju yang diterapkan pada trafik publik di ruang kerja Anda. Anda ditagih berdasarkan tarif standar model call (bayar sesuai penggunaan).

-

Dalam kasus ini, header respons API mencakup:

x-dashscope-ptu-overflow:true. -

Untuk melihat metrik TPM, buka halaman Pemantauan Model (Beijing).

|

Nama Model |

Jenis Model |

Panjang Konteks Maksimum (Token Input + Token Output) |

Token Masukan Maksimum |

Pasca Bayar – Per Jam |

Prabayar – Harian |

||

|

Input (Per 10k TPM) |

Output (Per 1k TPM) |

Input (Per 10k TPM) |

Output (Per 1k TPM) |

||||

|

Qwen3-Max-2025-09-23 |

Instruct |

128.000 |

128.000 |

$1,11 |

$0,45 |

$13,32 |

$5,40 |

|

Qwen-Plus-2025-12-01 |

Instruct |

$0,28 |

$0,07 |

$3,36 |

$0,84 |

||

|

Thinking |

$0,28 |

$3,36 |

|||||

|

Qwen-Flash-2025-07-28 |

Instruct/Thinking |

$0,06 |

$0,06 |

$0,72 |

$0,72 |

||

|

Qwen3-VL-Plus-2025-09-23 |

Instruct/Thinking |

$0,35 |

$0,35 |

$4,20 |

$4,20 |

||

|

DeepSeek-v3.2 |

Instruct/Thinking |

64.000 |

$1,04 |

$0,16 |

$12,48 |

$1,92 |

|

Jenis model:

-

Instruct — Model menjalankan inferensi dalam mode non-thinking setelah diterapkan.

-

Thinking — Model menjalankan inferensi dalam mode thinking setelah diterapkan.

Untuk informasi tentang cara menerapkan lebih banyak model, lihat solusi ini. Anda dapat memilih opsi penerapan yang paling sesuai dengan kebutuhan bisnis Anda.

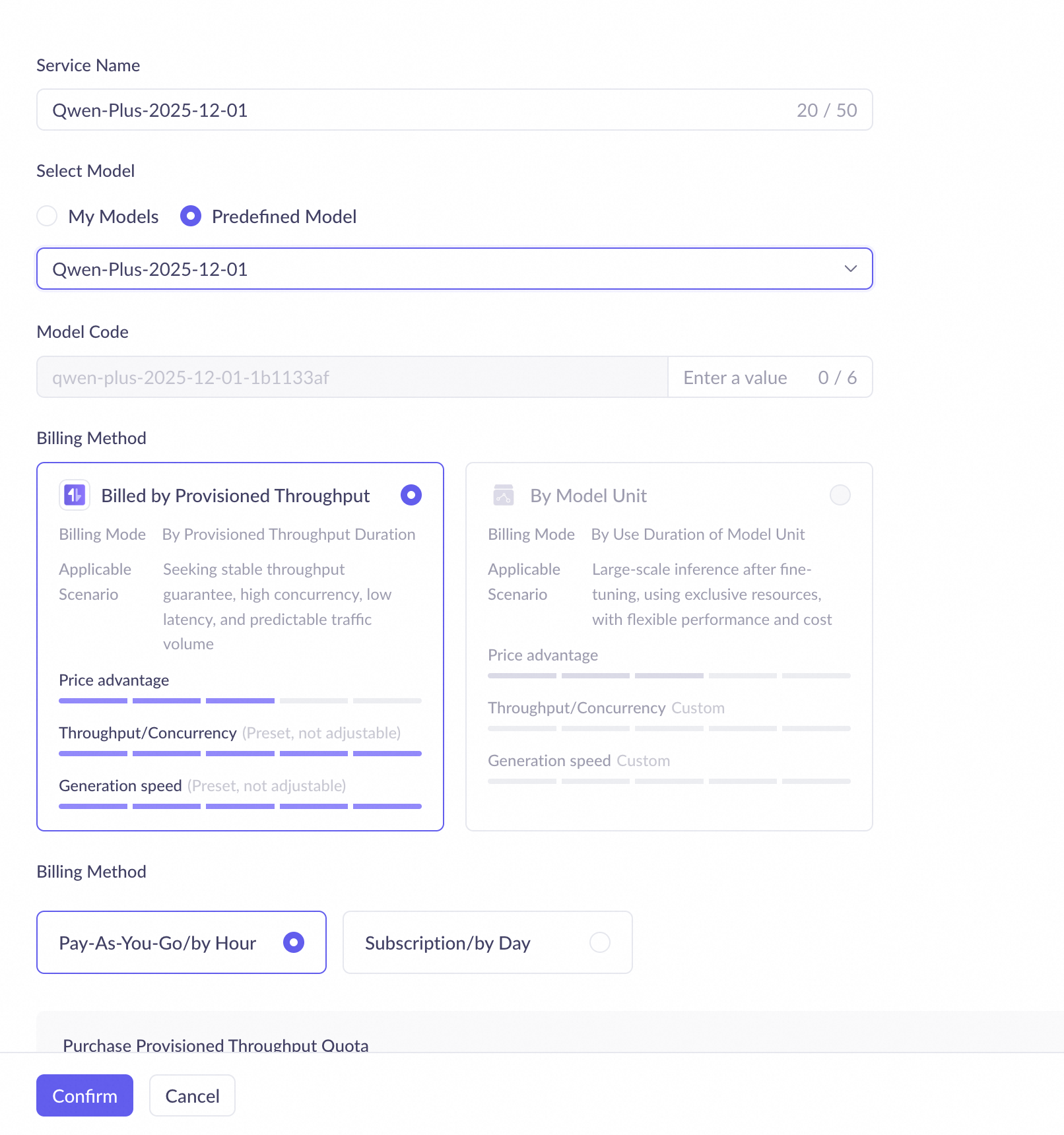

Metode Penerapan

Anda dapat menerapkan model di konsol dengan mengikuti langkah-langkah berikut:

Jika Anda mengalami error izin, lihat Apa yang harus saya lakukan jika mendapatkan error izin saat penerapan?

|

|

|

|

|

Penting

Anda dikenai biaya setelah model berhasil diterapkan. |

Memanggil Model yang Diterapkan

Setelah model berhasil diterapkan, Anda dapat memanggilnya menggunakan API kompatibel OpenAI, SDK DashScope, atau SDK Assistant.

Saat Anda memanggil model yang berhasil diterapkan, nilai parameter model harus berupa kode model. Anda dapat membuka halaman Konsol Penerapan Model (Beijing) untuk mendapatkan Model Code.

DashScope

import os

import dashscope

messages = [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Who are you?"},

]

dashscope.base_http_api_url = 'https://dashscope-intl.aliyuncs.com/api/v1'

response = dashscope.Generation.call(

# Jika Anda belum mengatur variabel lingkungan, ganti baris berikut dengan Kunci API Model Studio Anda: api_key="sk-xxx",

api_key=os.getenv("DASHSCOPE_API_KEY"),

model="qwen3-max-xxx-xxx", # Ganti dengan kode model yang diterapkan Anda

messages=messages,

result_format="message",

enable_thinking=False,

)

print(response)

Antarmuka Kompatibel OpenAI

import os

from openai import OpenAI

client = OpenAI(

# Jika Anda belum mengatur variabel lingkungan, ganti baris berikut dengan Kunci API Model Studio Anda: api_key="sk-xxx",

api_key=os.getenv('DASHSCOPE_API_KEY'),

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

)

completion = client.chat.completions.create(

model="qwen3-max-xxx-xxx", # Ganti dengan kode model yang diterapkan Anda

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Who are you?"},

],

extra_body={"enable_thinking": False},

)

print(completion)

Penskalaan Layanan yang Diterapkan

-

Provisioned throughput (bayar sesuai penggunaan berdasarkan durasi): Klik tombol Scaling untuk menyesuaikan jumlah instans secara manual.

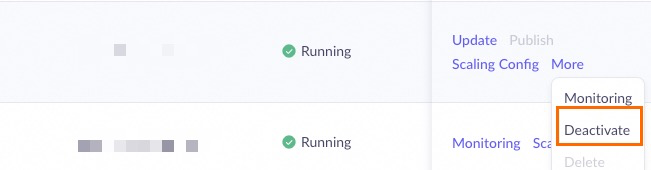

Membatalkan Publikasi Layanan yang Telah Diterapkan

Buka Konsol Penerapan Model (Beijing). Temukan layanan yang ingin Anda batalkan penerapannya, klik Deactivate, lalu konfirmasi tindakan tersebut. Anda tidak lagi dikenai biaya setelah layanan dibatalkan penerapannya.

FAQ

Apakah saya dapat mengunggah dan menerapkan model saya sendiri?

Saat ini Anda tidak dapat mengunggah atau menerapkan model Anda sendiri. Untuk pembaruan, ikuti pengumuman di Alibaba Cloud Model Studio.

Alternatifnya, Alibaba Cloud Platform for AI (PAI) mendukung penerapan model Anda sendiri. Untuk informasi lebih lanjut, lihat Penerapan Model Bahasa Besar PAI-LLM.

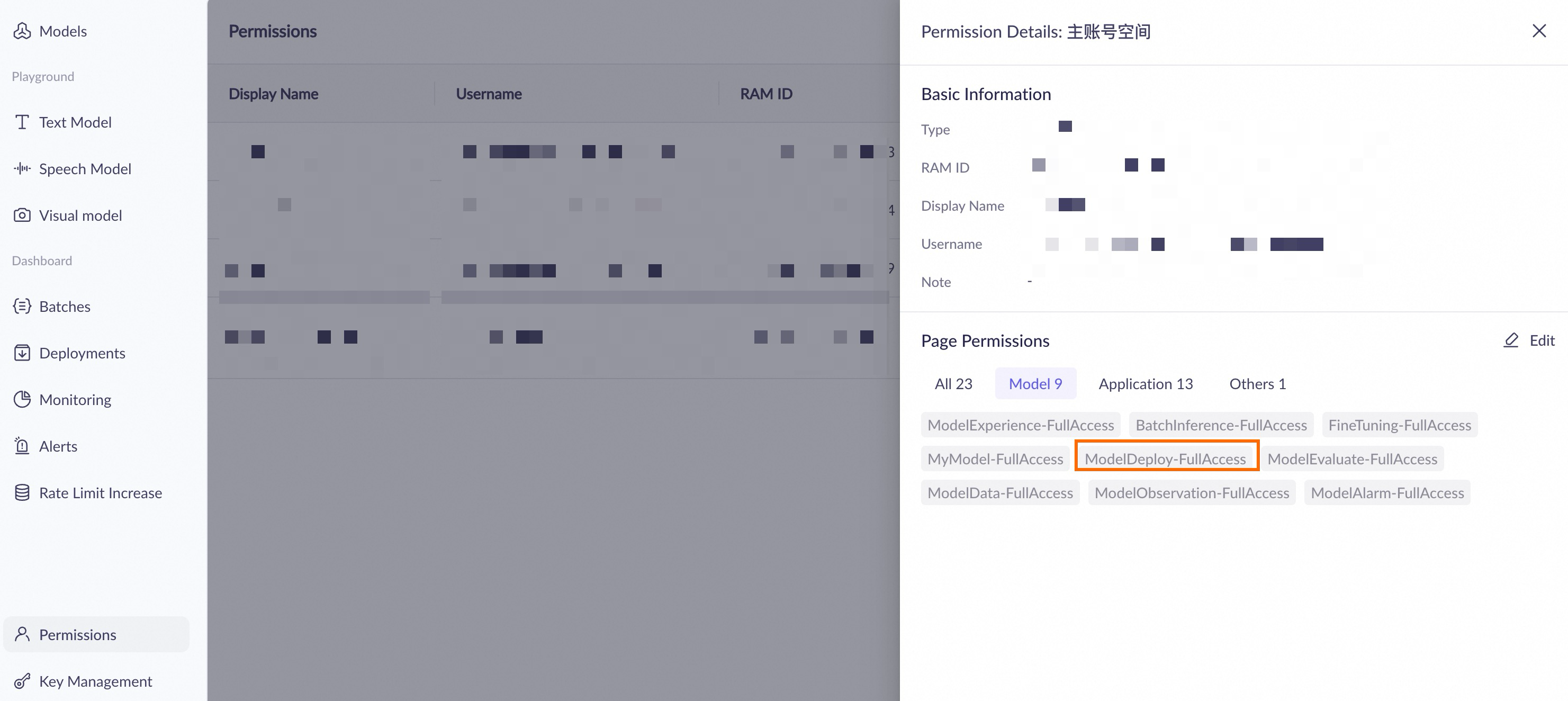

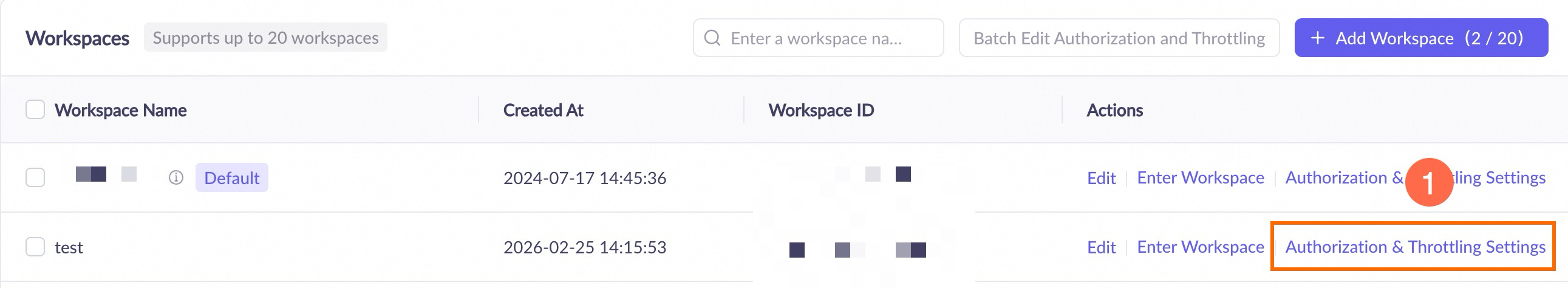

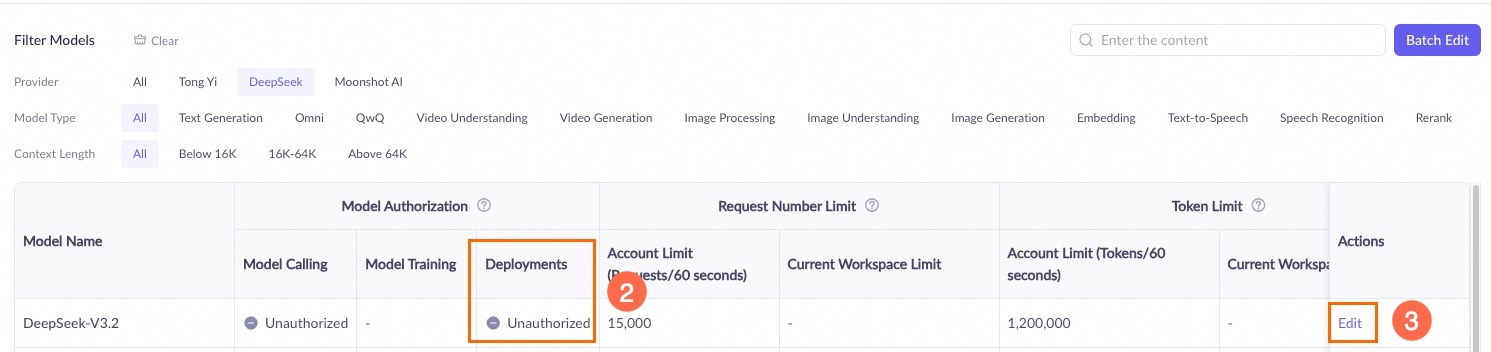

Apa yang harus saya lakukan jika mendapatkan error izin saat penerapan?

-

Jika Anda melihat error “Missing permissions for this module”, pastikan akun Anda memiliki izin Model Deployment – Operation di halaman manajemen izin ruang kerja Anda.

Jika Anda masih tidak dapat melanjutkan, hubungi organisasi atau administrator IT Anda untuk menambahkan izin yang diperlukan atau membantu Anda memecahkan masalah tersebut.

-

Jika penerapan gagal dengan error “Workspace X does not have permission to deploy model Y”, buka halaman Manajemen Ruang Kerja di Model Studio dan berikan izin kepada ruang kerja target untuk menerapkan model tersebut.

Pesan error API:

Workspace xxx does not have deployment privilege for model xxxx.

Jika Anda tidak memiliki izin yang diperlukan, hubungi organisasi atau administrator IT Anda untuk memberikan izin atau melakukan tindakan tersebut untuk Anda.