Setelah mengirimkan pekerjaan Spark pada MaxCompute, Anda dapat menggunakan alat LogView yang disediakan oleh MaxCompute atau Spark web UI untuk mendapatkan log pekerjaan dan memeriksa apakah pekerjaan telah dikirimkan dan berjalan sesuai harapan.

Informasi latar belakang

Setelah mengirimkan pekerjaan Spark menggunakan spark-submit pada MaxCompute, MaxCompute membuat instance dan menampilkan URL LogView serta pelacakan instance dalam log. Anda dapat melacak status pekerjaan berdasarkan LogView atau URL pelacakan. Log juga dihasilkan ketika menggunakan DataWorks untuk menjalankan pekerjaan Spark.

URL LogView: URL yang dimulai dengan

logview.odps.aliyun.com. LogView adalah alat pelacakan pekerjaan terdistribusi yang dikembangkan untuk MaxCompute.URL Pelacakan: URL yang memungkinkan Anda mengakses Spark web UI.

Berikut adalah contoh cara melihat URL LogView dan pelacakan dari sebuah instance.

Kirimkan pekerjaan.

CatatanSpark on MaxCompute mendukung tiga mode operasi: Mode Lokal, Mode Kluster, dan Mode Eksekusi DataWorks. Anda dapat memilih mode operasi yang sesuai berdasarkan kebutuhan bisnis Anda.

cd $SPARK_HOME bin/spark-submit --master yarn-cluster --class SparkPi /tmp/spark-2.x-demo/target/AliSpark-2.x-quickstart-1.0-SNAPSHOT-shaded.jarLihat log instance.

19/01/05 20:36:47 INFO YarnClientImplUtil: url logview: http://logview.odps.aliyun.com/logview/?h=http://service.cn.maxcompute.aliyun.com/api&p=qn_beijing&i=xxx&token=xxx <Jika keluaran berikut ini diterima, operasi berhasil. Informasi log lainnya mungkin juga ditampilkan.> 19/01/05 20:37:34 INFO Client: token klien: N/A diagnosis: N/A host ApplicationMaster: 11.220.xxx.xxx port RPC ApplicationMaster: 30002 antrian: antrian waktu mulai: 1546691807945 status akhir: BERHASIL URL pelacakan: http://jobview.odps.aliyun.com/proxyview/jobview/?h=http://service.cn.maxcompute.aliyun-inc.com/api&p=nama_proyek&i=xxx&t=spark&id=aplikasi_xxx&metaname=xxx&token=xxx

Gunakan LogView untuk melakukan diagnostik pada pekerjaan

URL yang dimulai dengan logview.odps.aliyun.com adalah URL LogView. LogView adalah alat pelacakan pekerjaan terdistribusi yang dikembangkan untuk MaxCompute. LogView dapat digunakan untuk melakukan operasi berikut:

Mendapatkan status pekerjaan.

Mendapatkan informasi startup, terminasi, dan penjadwalan setiap node dalam pekerjaan.

Mendapatkan log input dan output standar setiap node dalam pekerjaan. Kami merekomendasikan agar output Spark ditulis ke stdout. Secara default, log Spark log4j ditulis ke stderr.

Menyimpan data log eksekusi. Data disimpan selama tiga hingga lima hari. Ketika disk lokal penuh, log stdout dan stderr akan dihapus.

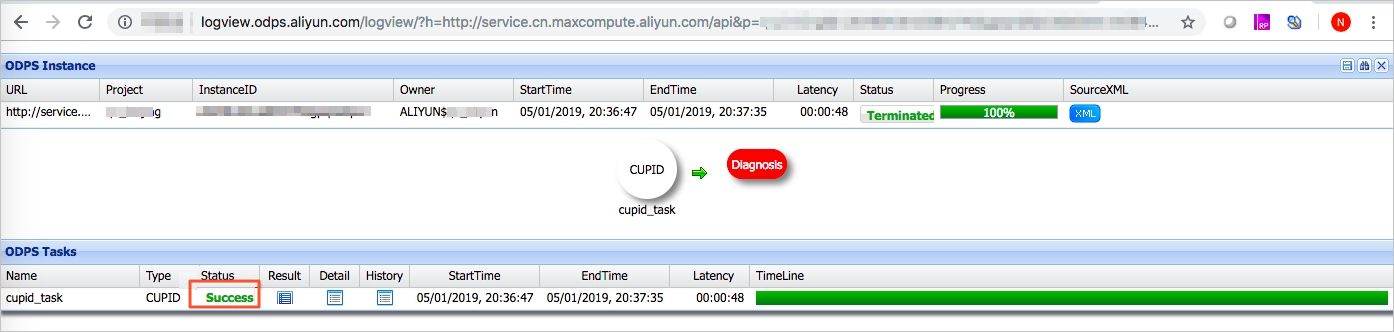

Masukkan URL LogView di bilah alamat browser dan lihat informasi eksekusi tentang pekerjaan tipe CUPID.

Di halaman yang muncul, lakukan langkah-langkah berikut:

Klik Detail untuk melihat detail pekerjaan. master-0 menunjukkan node tempat Spark Driver berada.

Klik master-0 dan pilih Semua Tab untuk melihat informasi tentang node tersebut.

Klik StdOut untuk melihat output dari node.

Klik StdErr untuk melihat log log4j dari node.

Gunakan Spark web UI untuk melakukan diagnostik pada pekerjaan

Jika URL pelacakan dihasilkan dalam log pekerjaan, pekerjaan tersebut telah dikirimkan ke MaxCompute. Anda dapat menggunakan URL pelacakan untuk mengakses Spark web UI atau History Server. Spark web UI dapat digunakan untuk melakukan operasi berikut:

Mendapatkan informasi tentang Spark web UI asli.

Melihat informasi tentang pekerjaan yang sedang berjalan secara real-time.

Mentransfer peristiwa dari Spark Driver ke History Server setelah pekerjaan selesai. Proses ini mungkin memerlukan waktu 1 hingga 3 menit untuk diselesaikan. Jika Anda membuka URL pelacakan segera setelah pekerjaan selesai, pesan kesalahan

Aplikasi application_1560240626712_2078769635 tidak ditemukan.mungkin ditampilkan. Jika pesan kesalahan tersebut muncul, coba lagi nanti.

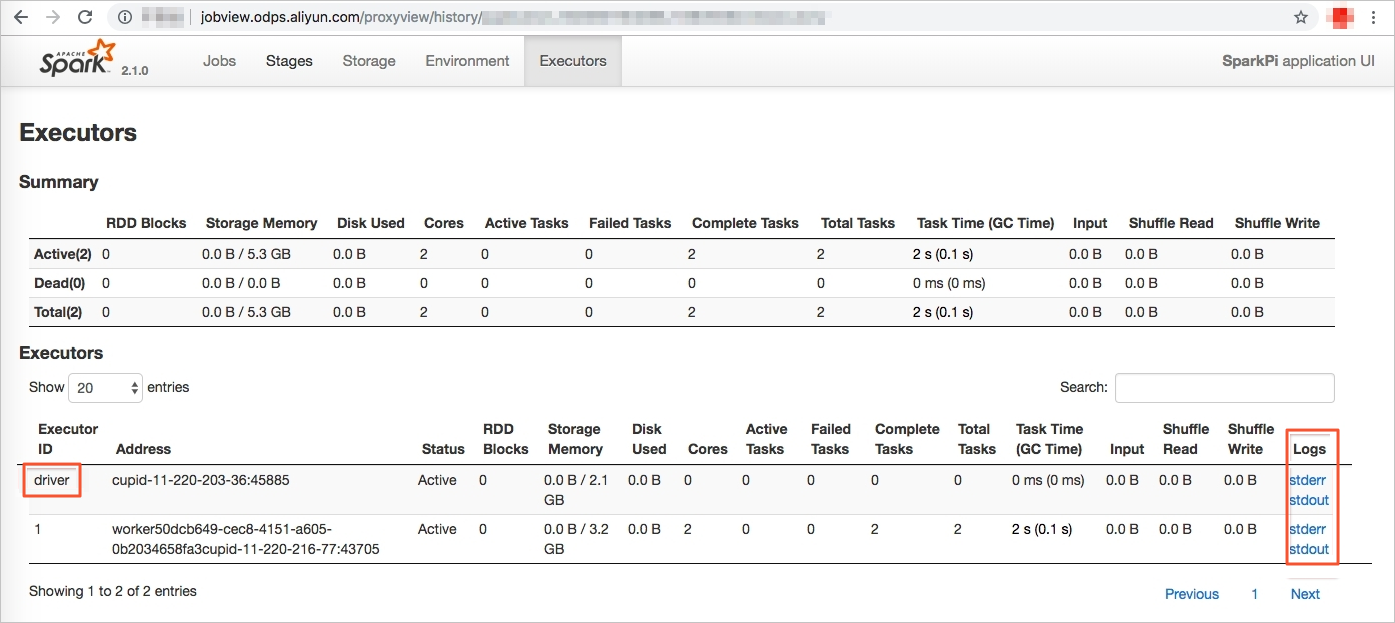

Masukkan URL pelacakan di bilah alamat browser dan lihat informasi eksekusi tentang pekerjaan Spark.

Di halaman yang muncul, lakukan langkah-langkah berikut:

Klik tab Environment untuk memeriksa apakah parameter pekerjaan Spark dikonfigurasi dengan benar.

Klik tab Executors untuk memeriksa node yang mati serta log stdout dan stderr yang dihasilkan untuk Spark Driver.

Klik stdout untuk melihat output dari node.

Klik stderr untuk melihat log log4j dari node.