Ikhtisar

Fitur ini saat ini berada dalam pratinjau undangan. Untuk menggunakannya, isi formulir permintaan pratinjau undangan fitur.

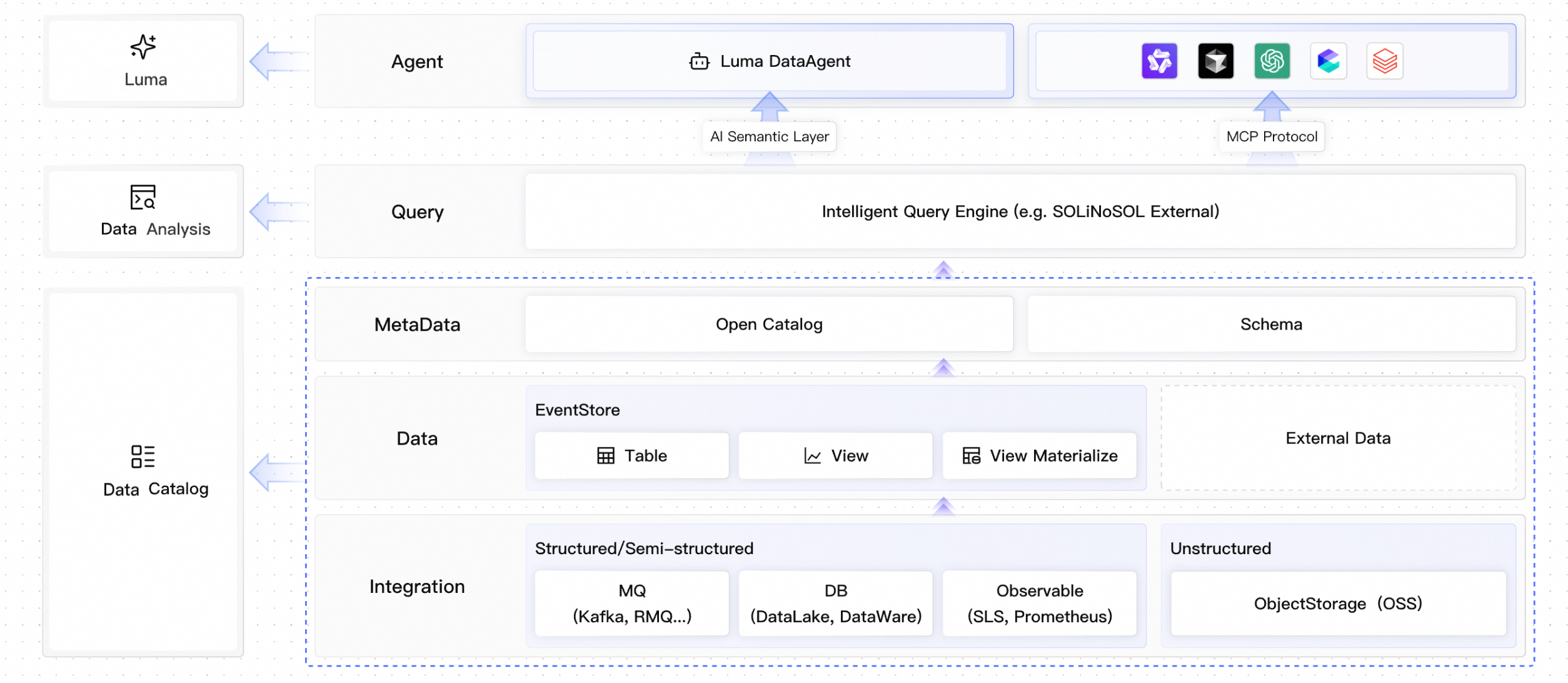

EventHouse adalah event lakehouse cloud-native milik EventBridge yang menangani penyimpanan, tata kelola, dan analitik cerdas untuk data event.

Event bus EventBridge menangani perutean dan pengiriman event. EventHouse memperluas kemampuan tersebut dengan menjawab pertanyaan tentang pengelolaan data event setelah disimpan. EventHouse menyatukan data terstruktur, semi-terstruktur, dan tidak terstruktur dari antrian pesan (seperti Kafka dan RocketMQ), database relasional (seperti MySQL), serta penyimpanan objek (seperti OSS) ke dalam model event standar. Dengan memanfaatkan Open Catalog bawaan dan lapisan semantik AI-nya, EventHouse mengelola sumber data heterogen melalui Zero-ETL dan memungkinkan analisis real-time melalui kueri SQL atau agen AI.

Komponen inti

EventHouse terdiri dari tiga komponen inti yang masing-masing beroperasi secara independen namun saling berkolaborasi erat:

Component | Location | Core capabilities |

Metadata management center | Multi-source metadata registration, schema evolution management, data lineage tracking, fine-grained access control | |

Compute engine layer | Unified stream and batch SQL, federated query, materialized view, real-time anomaly detection | |

AI analytics layer | AI semantic layer, MCP protocol integration, autonomous DataAgent analysis, natural language querying |

Nilai inti

Zero-ETL (integrasi data tanpa hambatan)

Petakan langsung sumber data eksternal (seperti RDS dan OSS) dan jalankan kueri terfederasi tanpa memindahkan data ke dalam EventHouse. Pendekatan ini mengurangi latensi data dan biaya penyimpanan.

Tata kelola terpadu

Gunakan Open Catalog untuk mengelola metadata dan melacak alur data dari “dark data” pada antrian pesan yang tidak memiliki definisi skema, sehingga menghilangkan silodata.

Analitik Agentik

Integrasikan secara native MCP (Model Context Protocol). Agen AI memahami struktur data event dan melakukan analisis berdasarkan pertanyaan dalam bahasa alami.

Data catalog

Data catalog merupakan pusat manajemen metadata EventHouse yang mengelola metadata, definisi skema, izin akses, dan alur data untuk seluruh sumber data yang terhubung.

Manajemen metadata terpadu

Pemetaan multi-sumber: Katalog secara otomatis menemukan dan mendaftarkan metadata dari sumber data seperti Kafka, RocketMQ, dan RDS.

Evolusi skema: Secara otomatis melakukan inferensi dan mengelola versi skema untuk data event. Ketika bidang hulu berubah, kompatibilitas tetap dipertahankan agar tugas analisis hilir tidak terganggu.

Pelacakan alur data: Lacak event sepanjang siklus hidupnya—mulai dari produksi (producer) dan penyimpanan (eventstore) hingga analisis—untuk mendukung troubleshooting dan penilaian dampak.

Kompatibilitas ekosistem terbuka

Open Catalog mendukung format tabel terbuka seperti Iceberg, Hudi, dan Delta Lake, sehingga menghindari vendor lock-in dan memungkinkan pemilihan mesin komputasi secara bebas.

Izin dan keamanan

Sediakan kontrol akses detail halus (ACL) pada tingkat database, tabel, dan kolom.

Skenario: Tampilan data terpadu

Dalam E-dagang, data pesanan sering terpisah antara RocketMQ (aliran real-time) dan MySQL (persistensi). Gunakan katalog untuk membuat tampilan terpadu yang secara logis menggabungkan aliran pesanan real-time di MQ dengan tabel informasi pengguna di database. Kueri tampilan ini secara langsung tanpa perlu mengetahui lokasi fisik penyimpanan data.

Data analysis

Data analysis adalah lapisan mesin komputasi EventHouse yang menyediakan kueri SQL berkinerja tinggi, pemrosesan aliran, serta kemampuan kueri terfederasi.

Mesin kueri cerdas

Kueri multimodal: Mendukung tiga mode kueri—SQL (terstruktur), NoSQL (berbasis dokumen), dan External (kueri sumber data eksternal).

Aliran dan batch terpadu: Gunakan sintaksis SQL yang sama untuk mengkueri data arsip historis (batch) dan aliran event real-time (streaming).

Tampilan yang di-materialisasi: Lakukan pra-komputasi dan cache hasil kueri yang sering digunakan dalam tampilan yang di-materialisasi untuk mencapai waktu respons tingkat milidetik.

Kueri terfederasi

Analisis gabungan lintas sumber: Tanpa migrasi data, gunakan

JOINSQL untuk langsung menghubungkan tabel internal di EventHouse dengan sumber eksternal seperti file log OSS atau tabel dimensi RDS.Predicate pushdown: Dorong kondisi filter ke sumber asal untuk mengambil hanya data yang diperlukan, sehingga meningkatkan efisiensi kueri.

Deteksi anomali real-time

Gunakan fungsi jendela waktu bawaan (Tumble, Hop, Session) untuk menghitung metrik real-time seperti laju keberhasilan transaksi dan distribusi latensi.

Gabungkan dengan mesin aturan. Saat hasil analisis melewati ambang batas (misalnya, “lebih dari 100 pesanan gagal dalam satu menit”), picu event peringatan secara otomatis.

Keunggulan teknis

Feature | Description |

Storage-compute separation | Simpan data di penyimpanan objek berbiaya rendah. Skalakan sumber daya komputasi secara elastis untuk menangani lonjakan lalu lintas. |

High compression ratio | Terapkan kompresi kolom yang dioptimalkan untuk data event (JSON/CloudEvents). Kurangi biaya penyimpanan lebih dari 50% dibandingkan database tradisional. |

Data intelligence (Luma)

Luma adalah lapisan analitik AI EventHouse yang memanfaatkan lapisan semantik AI dan protokol MCP untuk memungkinkan model bahasa besar (LLM) memahami serta menganalisis data event secara langsung.

DataAgent

Luma mencakup DataAgent bawaan yang secara otonom menjalankan siklus “sense–plan–act”:

Sense: Deteksi penurunan tidak biasa pada volume transaksi.

Plan: Putuskan untuk mengkueri log gerbang pembayaran dan status kolam koneksi database.

Act: Hasilkan SQL untuk analisis korelasi dan keluarkan laporan akar penyebab.

Lapisan semantik AI

Bidang database tradisional (seperti col_1 dan status_code) tidak memiliki makna bisnis bagi model AI. Luma memungkinkan Anda menambahkan deskripsi bisnis, sinonim, dan logika perhitungan ke bidang-bidang dalam katalog. Informasi semantik ini digunakan untuk meningkatkan akurasi Text-to-SQL.

Contoh: Ajukan pertanyaan dalam bahasa alami, “Tampilkan pesanan yang gagal dibayar dari Beijing kemarin.” Luma secara otomatis menghasilkan SQL yang sesuai dan mengembalikan hasilnya.

Skenario: Pengendalian risiko E-dagang

Seorang operator bertanya, “Apakah ada perilaku brushing abnormal dalam 30 menit terakhir?”

Agen Luma menggunakan MCP untuk mengambil informasi katalog dan mengidentifikasi

Transaction_TabledanUser_Behavior_Log.Agen tersebut secara otomatis menghasilkan kueri SQL terkorelasi (dengan jendela waktu, agregasi IP, dan analisis sidik jari perangkat) serta menjalankannya di mesin analisis EventHouse.

Kembalikan daftar UserID pelaku brushing yang dicurigai dan hasilkan laporan risiko menggunakan basis pengetahuan.

Integrasi protokol MCP

EventHouse mendukung secara native MCP (Model Context Protocol). Setiap agen AI yang kompatibel dengan MCP (seperti LangChain, Dify, atau agen kustom) dapat terhubung ke EventHouse:

Kueri berbasis tool: Bungkus kemampuan kueri sebagai tool MCP yang dipanggil agen berdasarkan maksud pengguna.

Kesadaran konteks: Agen menggunakan skema data sebagai konteks untuk menghasilkan analisis yang lebih akurat.

Integrasi protokol MCP belum tersedia. Pantau pembaruan produk untuk tanggal rilisnya.