Anda dapat membuat pekerjaan untuk mengembangkan tugas dalam sebuah proyek. Topik ini menjelaskan operasi terkait pekerjaan.

Informasi latar belakang

Prasyarat

Proyek telah dibuat. Untuk informasi lebih lanjut, lihat Kelola Proyek.

Buat pekerjaan

- Buka tab Platform Data.

- Masuk ke Konsol EMR Alibaba Cloud menggunakan akun Alibaba Cloud Anda.

- Di bilah navigasi atas, pilih wilayah tempat kluster Anda berada dan pilih grup sumber daya sesuai dengan kebutuhan bisnis Anda.

- Klik tab Data Platform.

- Pada bagian Proyek di halaman yang muncul, temukan proyek yang ingin Anda kelola dan klik Edit Job di kolom Tindakan.

- Buat pekerjaan.

- Di panel Edit Pekerjaan di sebelah kiri halaman yang muncul, klik kanan folder tempat Anda ingin melakukan operasi dan pilih Create Job.null Anda juga dapat mengklik kanan folder dan memilih Create Subfolder, Rename Folder, atau Delete Folder untuk melakukan operasi yang sesuai.

- Di kotak dialog Create Job, tentukan Name dan Description, lalu pilih jenis pekerjaan tertentu dari daftar drop-down Job Type.

E-MapReduce (EMR) mendukung jenis pekerjaan berikut dalam pengembangan data: Shell, Hive, Hive SQL, Spark, Spark SQL, Spark Shell, Spark Streaming, MapReduce, Sqoop, Pig, Flink, Streaming SQL, Presto SQL, dan Impala SQL.

null Setelah pekerjaan dibuat, Anda tidak dapat mengubah type of the job. - Klik OK.Setelah pekerjaan dibuat, Anda dapat mengonfigurasi dan mengedit pekerjaan tersebut.

- Di panel Edit Pekerjaan di sebelah kiri halaman yang muncul, klik kanan folder tempat Anda ingin melakukan operasi dan pilih Create Job.

Konfigurasi pekerjaan

Untuk informasi lebih lanjut tentang cara mengembangkan dan mengonfigurasi setiap jenis pekerjaan, lihat Pekerjaan. Bagian ini menjelaskan cara mengonfigurasi parameter pekerjaan pada tab Basic Settings, Advanced Settings, Shared Libraries, dan Alert Settings di panel Pengaturan Pekerjaan.

- Di sudut kanan atas halaman job, klik Job Settings.

- Di panel Job Settings, konfigurasikan parameter pada tab Pengaturan Dasar.

Bagian dan parameter Deskripsi Job Overview Name Nama pekerjaan. Job Type Jenis pekerjaan. Retries Jumlah percobaan ulang yang diizinkan jika pekerjaan gagal. Nilai parameter ini berkisar antara 0 hingga 5. Actions on Failures Tindakan yang dapat Anda lakukan jika pekerjaan gagal. Nilai valid: - Pause: Menangguhkan alur kerja saat ini jika pekerjaan gagal.

- Run Next Job: Lanjutkan untuk menjalankan pekerjaan berikutnya jika pekerjaan saat ini gagal.

Anda dapat menentukan apakah akan mengaktifkan sakelar Use Latest Job Content and Parameters berdasarkan kebutuhan bisnis Anda.- Jika Anda mematikan sakelar ini, instans pekerjaan dihasilkan berdasarkan konten dan parameter pekerjaan asli setelah Anda menjalankan ulang pekerjaan yang gagal.

- Jika Anda menghidupkan sakelar ini, instans pekerjaan dihasilkan berdasarkan konten dan parameter pekerjaan terbaru setelah Anda menjalankan ulang pekerjaan yang gagal.

Description Deskripsi pekerjaan. Jika Anda ingin memodifikasi deskripsi pekerjaan, Anda dapat mengklik Edit di sebelah kanan parameter ini. Resources Sumber daya yang diperlukan untuk menjalankan pekerjaan, seperti paket JAR dan fungsi yang ditentukan pengguna (UDF). Klik ikon  di sebelah kanan untuk menambahkan sumber daya.

di sebelah kanan untuk menambahkan sumber daya.Unggah sumber daya ke Object Storage Service (OSS) terlebih dahulu. Kemudian, Anda dapat menambahkannya ke pekerjaan.

Configuration Parameters Variabel yang ingin Anda referensikan dalam skrip pekerjaan. Anda dapat merujuk variabel dalam skrip pekerjaan Anda dalam format ${Nama Variabel}. Klik ikon

di sebelah kanan untuk menambahkan variabel dalam format pasangan kunci-nilai. Anda dapat menentukan apakah akan memilih Kata Sandi untuk menyembunyikan nilai berdasarkan kebutuhan bisnis Anda. Kunci menunjukkan nama variabel. Nilai menunjukkan nilai variabel. Selain itu, Anda dapat mengonfigurasi variabel waktu berdasarkan waktu penjadwalan mulai. Untuk informasi lebih lanjut, lihat Konfigurasi waktu dan tanggal pekerjaan.

di sebelah kanan untuk menambahkan variabel dalam format pasangan kunci-nilai. Anda dapat menentukan apakah akan memilih Kata Sandi untuk menyembunyikan nilai berdasarkan kebutuhan bisnis Anda. Kunci menunjukkan nama variabel. Nilai menunjukkan nilai variabel. Selain itu, Anda dapat mengonfigurasi variabel waktu berdasarkan waktu penjadwalan mulai. Untuk informasi lebih lanjut, lihat Konfigurasi waktu dan tanggal pekerjaan. - Klik tab Advanced Settings dan konfigurasikan parameter.

Bagian Parameter dan deskripsi Mode - Job Submission Node: mode untuk mengirimkan pekerjaan. Untuk informasi lebih lanjut, lihat Mode pengiriman pekerjaan. Nilai valid:

- Worker Node: Pekerjaan dikirimkan ke YARN menggunakan peluncur, dan YARN mengalokasikan sumber daya untuk menjalankan pekerjaan.

- Header/Gateway Node: Pekerjaan berjalan sebagai proses pada node yang dialokasikan.

- Estimated Maximum Duration: durasi maksimum perkiraan pekerjaan berjalan. Nilai valid: 0 hingga 10800. Unit: detik.

Environment Variables Variabel lingkungan yang digunakan untuk menjalankan pekerjaan. Anda juga dapat mengekspor variabel lingkungan dari skrip pekerjaan. - Contoh 1: Konfigurasikan pekerjaan Shell dengan kode

echo ${ENV_ABC}. Jika Anda mengatur variabel ENV_ABC menjadi12345, nilai12345dikembalikan setelah Anda menjalankan perintahecho. - Contoh 2: Konfigurasikan pekerjaan Shell dengan kode

java -jar abc.jar. Isi paket abc.jar:public static void main(String[] args) {System.out.println(System.getEnv("ENV_ABC"));}Jika Anda mengatur variabel ENV_ABC menjadi 12345, nilai12345dikembalikan setelah Anda menjalankan pekerjaan. Efek mengatur variabel ENV_ABC di bagian Variabel Lingkungan setara dengan menjalankan skrip berikut:export ENV_ABC=12345 java -jar abc.jar

Scheduling Parameters Parameter yang digunakan untuk menjadwalkan pekerjaan, termasuk Antrian, Memori (MB), vCore, Prioritas, dan Jalankan Oleh. Jika Anda tidak mengonfigurasi parameter ini, pengaturan default kluster Hadoop digunakan. null Parameter Memori (MB) menentukan kuota memori untuk peluncur. - Job Submission Node: mode untuk mengirimkan pekerjaan. Untuk informasi lebih lanjut, lihat Mode pengiriman pekerjaan. Nilai valid:

- Klik tab Shared Libraries.Di bagian Dependent Libraries, tentukan Libraries.

Pelaksanaan pekerjaan bergantung pada beberapa file perpustakaan yang terkait dengan sumber data. EMR menerbitkan perpustakaan ke repositori pusat penjadwalan sebagai perpustakaan dependensi. Anda harus menentukan perpustakaan dependensi saat membuat pekerjaan. Untuk menentukan perpustakaan dependensi, masukkan string referensinya, seperti

sharedlibs:streamingsql:datasources-bundle:2.0.0. - Klik tab Alert Settings dan konfigurasikan parameter peringatan.

Parameter Deskripsi Execution Failed Menentukan apakah akan mengirimkan notifikasi ke grup kontak peringatan atau grup peringatan DingTalk jika pekerjaan gagal. Action on Startup Timeout Menentukan apakah akan mengirimkan notifikasi ke grup kontak peringatan atau grup peringatan DingTalk jika waktu mulai pekerjaan habis. Job execution timed out. Menentukan apakah akan mengirimkan notifikasi ke grup kontak peringatan atau grup peringatan DingTalk jika eksekusi pekerjaan habis waktu.

Tambahkan anotasi

!!! @<Nama Anotasi>: <Isi Anotasi>!!!) yang memulai anotasi. Tambahkan satu anotasi dalam satu baris.| Nama Anotasi | Deskripsi | Contoh |

| rem | Menambahkan komentar. | |

| env | Menambahkan variabel lingkungan. | |

| var | Menambahkan variabel kustom. | |

| resource | Menambahkan file sumber daya. | |

| sharedlibs | Menambahkan perpustakaan dependensi. Anotasi ini hanya valid dalam pekerjaan Streaming SQL. Pisahkan beberapa perpustakaan dependensi dengan koma (,). | |

| scheduler.queue | Menentukan antrian tempat pekerjaan dikirimkan. | |

| scheduler.vmem | Menentukan memori yang diperlukan untuk menjalankan pekerjaan. Unit: MiB. | |

| scheduler.vcores | Menentukan jumlah vCore yang diperlukan untuk menjalankan pekerjaan. | |

| scheduler.priority | Menentukan prioritas pekerjaan. Nilai valid: 1 hingga 100. | |

| scheduler.user | Menentukan pengguna yang mengirimkan pekerjaan. | |

- Anotasi yang tidak valid secara otomatis dilewati. Misalnya, anotasi yang tidak dikenal atau anotasi yang isinya dalam format tidak valid akan dilewati.

- Parameter pekerjaan yang ditentukan dalam anotasi memiliki prioritas lebih tinggi daripada parameter pekerjaan yang ditentukan di panel Pengaturan Pekerjaan. Jika parameter ditentukan baik dalam anotasi maupun di panel Pengaturan Pekerjaan, pengaturan parameter yang ditentukan dalam anotasi yang berlaku.

Jalankan pekerjaan

- Jalankan pekerjaan yang Anda buat.

- Di halaman pekerjaan, klik Run di sudut kanan atas untuk menjalankan pekerjaan.

- Di kotak dialog Run Job, pilih grup sumber daya dan kluster yang Anda buat.

- Klik OK.

- Lihat detail yang sedang berjalan.

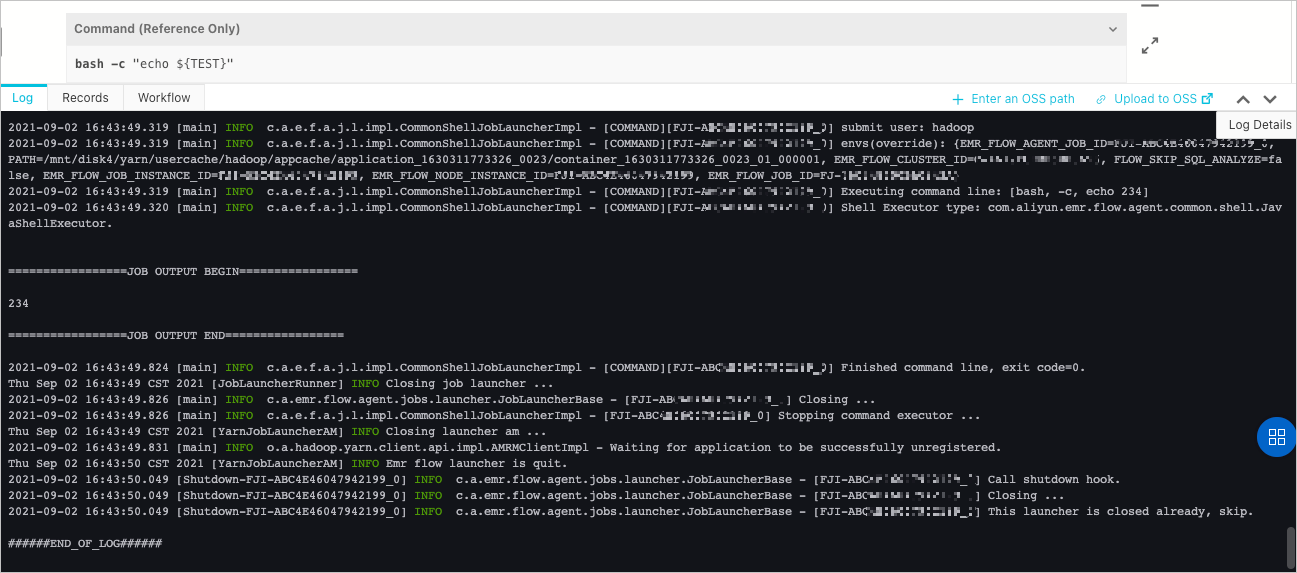

- Klik tab Log di bagian bawah halaman pekerjaan untuk melihat log operasional.

- Klik tab Records untuk melihat catatan eksekusi instans pekerjaan.

- Klik Details di kolom Tindakan instans pekerjaan untuk pergi ke tab Scheduling Center. Di tab ini, Anda dapat melihat detail tentang instans pekerjaan.

- Klik tab Log di bagian bawah halaman pekerjaan untuk melihat log operasional.

Operasi yang dapat Anda lakukan pada pekerjaan

| Operasi | Deskripsi |

| Clone Job | Mengkloning konfigurasi pekerjaan untuk menghasilkan pekerjaan baru di folder yang sama. |

| Rename Job | Mengubah nama pekerjaan. |

| Delete Job | Menghapus pekerjaan. Anda hanya dapat menghapus pekerjaan jika pekerjaan tersebut tidak terkait dengan alur kerja atau alur kerja terkait tidak sedang berjalan atau dijadwalkan. |

Mode pengiriman pekerjaan

Proses spark-submit, yang merupakan peluncur dalam modul pengembangan data, digunakan untuk mengirimkan pekerjaan Spark. Dalam kebanyakan kasus, proses ini menggunakan lebih dari 600 MiB memori. Parameter Memori (MB) di panel Pengaturan Pekerjaan menentukan ukuran memori yang dialokasikan untuk peluncur.

| Mode pengiriman pekerjaan | Deskripsi |

| Header/Gateway Node | Dalam mode ini, proses spark-submit berjalan di node master dan tidak dipantau oleh YARN. Proses spark-submit meminta sejumlah besar memori. Sejumlah besar pekerjaan mengonsumsi banyak sumber daya node master, yang merusak stabilitas kluster. |

| Worker Node | Dalam mode ini, proses spark-submit berjalan di node inti, menempati wadah YARN, dan dipantau oleh YARN. Mode ini mengurangi penggunaan sumber daya di node master. |

Memori yang dikonsumsi oleh instans pekerjaan = Memori yang dikonsumsi oleh peluncur + Memori yang dikonsumsi oleh pekerjaan yang sesuai dengan instans pekerjaanMemori yang dikonsumsi oleh pekerjaan = Memori yang dikonsumsi oleh modul logis spark-submit (bukan proses) + Memori yang dikonsumsi oleh driver + Memori yang dikonsumsi oleh executor| Mode Peluncuran Aplikasi Spark | Proses di mana spark-submit dan driver berjalan | Deskripsi Proses | |

| mode yarn-client | Kirim pekerjaan dalam mode LOCAL. | Driver berjalan di proses yang sama dengan spark-submit. | Proses yang digunakan untuk mengirimkan pekerjaan berjalan di node master dan tidak dipantau oleh YARN. |

| Kirim pekerjaan dalam mode YARN. | Proses yang digunakan untuk mengirimkan pekerjaan berjalan di node inti, menempati wadah YARN, dan dipantau oleh YARN. | ||

| mode yarn-cluster | Driver berjalan di proses yang berbeda dari spark-submit. | Driver menempati wadah YARN. | |