Elastic GPU Service menyediakan instans yang dipercepat GPU dengan kepadatan komputasi tinggi, jaringan berlatensi rendah, dan metode penagihan fleksibel—ditambah DeepGPU, toolkit gratis yang mempercepat beban kerja pelatihan dan inferensi tanpa perlu mengubah kode.

Elastic GPU Service

Penerapan global di 17 wilayah. Terapkan instans yang dipercepat GPU secara skala besar di 17 wilayah di seluruh dunia. Provisioning otomatis dan auto scaling menangani lonjakan permintaan mendadak tanpa intervensi manual.

Hingga 1.000 TFLOPS komputasi presisi campuran. Saat dikombinasikan dengan platform CPU berkinerja tinggi, instans yang dipercepat GPU menghadirkan hingga 1.000 triliun operasi floating point per detik (TFLOPS) kinerja komputasi presisi campuran—cukup untuk pelatihan model bahasa besar (LLM) skala besar dan inferensi berthroughput tinggi.

Jaringan dua tingkat untuk setiap jenis beban kerja. Setiap instans yang dipercepat GPU terhubung ke virtual private cloud (VPC) dengan bandwidth internal hingga 32 Gbit/s dan 4,5 juta paket per detik (Mpps) untuk beban kerja umum. Untuk tugas pelatihan terdistribusi, pasangkan instans dengan Super Computing Cluster (SCC) untuk menambahkan bandwidth Remote Direct Memory Access (RDMA) hingga 50 Gbit/s antar node—menjauhkan sinkronisasi gradien dari bottleneck.

Metode penagihan yang sesuai pola penggunaan Anda. Pilih dari langganan, bayar sesuai penggunaan, instans preemptible, instans terjadwal, dan unit kapasitas penyimpanan (SCU) agar sesuai dengan model biaya Anda. Kombinasikan metode penagihan untuk mencakup beban kerja steady-state maupun burst.

DeepGPU

DeepGPU adalah toolkit gratis yang mempercepat beban kerja GPU pada Elastic GPU Service. Toolkit ini mencakup Deepytorch, AIACC-ACSpeed (ACSpeed), AIACC-AGSpeed (AGSpeed), FastGPU, dan cGPU.

FastGPU

FastGPU adalah tool penerapan kluster yang mengotomatiskan penyiapan infrastruktur sehingga Anda dapat menjalankan tugas pelatihan dan inferensi AI tanpa perlu provisioning sumber daya komputasi, penyimpanan, atau jaringan secara manual.

Kluster siap dalam 5 menit. FastGPU menerapkan kluster yang telah terkonfigurasi penuh dalam waktu 5 menit. Semua sumber daya diprovisioning di lapisan infrastruktur dan dapat diakses langsung untuk debugging.

Siklus hidup sumber daya terikat pada siklus hidup tugas. FastGPU melepas instans yang dipercepat GPU secara otomatis ketika tugas pelatihan atau inferensi selesai. Instans preemptible didukung untuk mengurangi biaya.

Observabilitas penuh. FastGPU menyediakan visualisasi, manajemen log, dan pelacakan tugas sehingga setiap eksekusi dapat diaudit.

cGPU

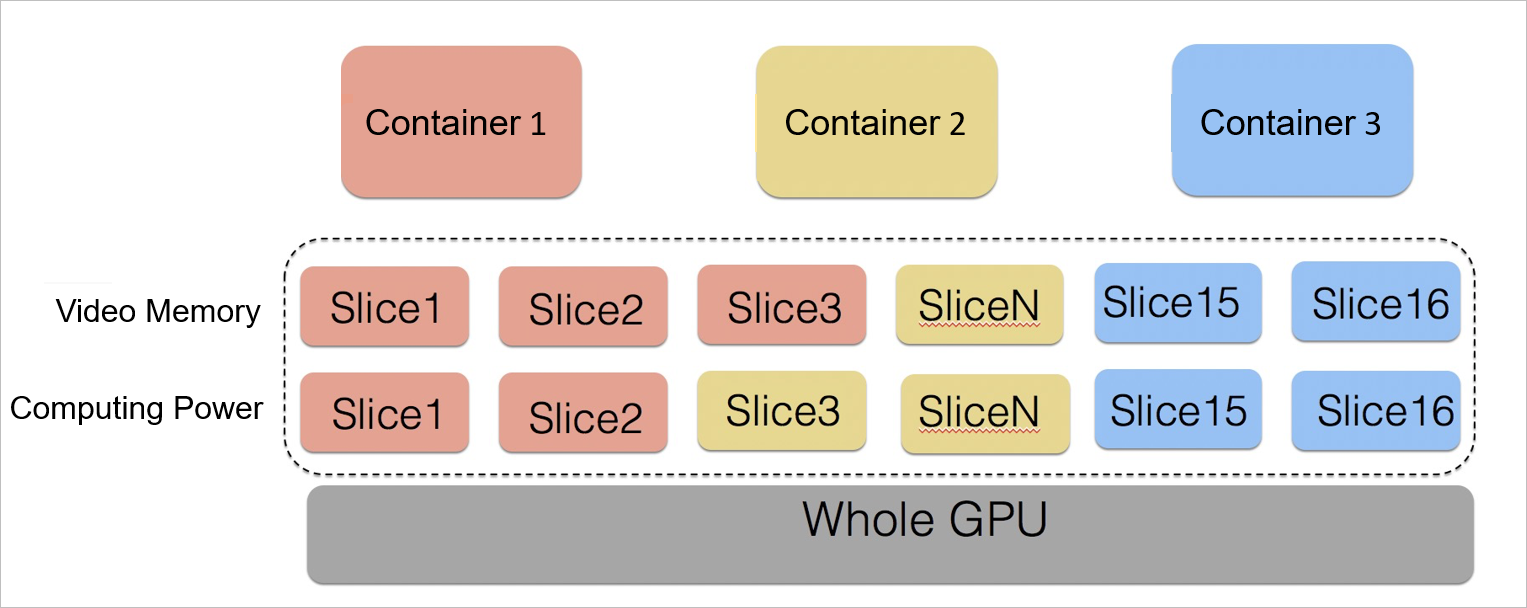

cGPU memungkinkan beberapa kontainer berbagi satu GPU fisik dengan isolasi sumber daya yang ketat, meningkatkan pemanfaatan GPU, mengurangi biaya, dan meningkatkan keamanan.

Bagikan satu GPU ke beberapa kontainer tanpa mengekspos data bisnis. Sebagian besar beban kerja AI tidak memerlukan seluruh GPU. cGPU mengalokasikan sumber daya GPU ke berbagai kontainer sekaligus mengisolasi data tiap kontainer, sehingga Anda hanya membayar memori GPU dan daya komputasi yang benar-benar digunakan oleh setiap beban kerja.

Alokasi fleksibel berdasarkan memori GPU atau daya komputasi. Alokasikan sumber daya berdasarkan rasio memori GPU atau daya komputasi agar sesuai dengan kebutuhan tiap kontainer.

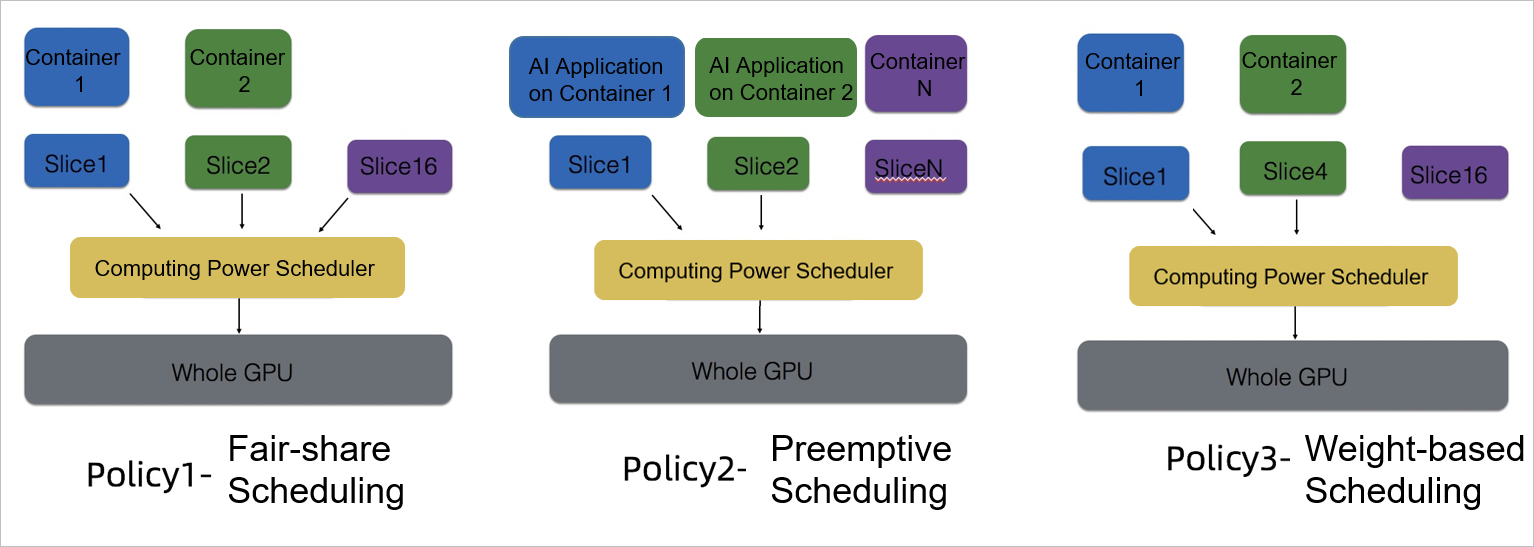

Three switchable scheduling policies for peak and off-peak hours. Alihkan secara real time antara tiga kebijakan alokasi daya komputasi untuk menyesuaikan intensitas beban kerja—tanpa perlu restart.