AnalyticDB for MySQL adalah gudang data real-time berskala petabyte yang dihosting di cloud, dirancang untuk pemrosesan analitik online (OLAP) berkonkurensi tinggi. Topik ini memandu Anda membuat dan menggunakan kluster AnalyticDB for MySQL, mulai dari penyiapan hingga pengembangan tugas.

Data Lakehouse Edition tidak lagi tersedia untuk pembelian baru. Jika Anda telah membeli kluster Data Lakehouse Edition, Anda masih dapat mengikuti topik ini untuk menggunakannya.

Persiapan

Anda memiliki Akun Alibaba Cloud.

Jika belum memilikinya, kunjungi atau website Alibaba Cloud untuk mendaftar. Jika organisasi Anda memerlukan beberapa pengguna untuk mengakses resource secara kolaboratif, buat Pengguna Manajemen Akses Sumber Daya (RAM) di bawah Akun Alibaba Cloud Anda (akun root) dan berikan izin kepada mereka. Hal ini memungkinkan setiap RAM user hanya mengakses resource yang dibutuhkan.

Jika Anda menggunakan AnalyticDB for MySQL Enterprise Edition, Basic Edition, atau Data Lakehouse Edition untuk pertama kalinya, baca Pengenalan Produk untuk memahami konsep produk, manfaat, dan skenario umum penggunaan AnalyticDB for MySQL.

Biaya

Pembuatan kluster akan menimbulkan biaya komputasi dan penyimpanan. Untuk detailnya, lihat Harga untuk Enterprise Edition dan Basic Edition serta Harga untuk Data Lakehouse Edition.

Prosedur

Langkah 1: Buat kluster

Login ke Konsol AnalyticDB for MySQL. Di pojok kanan atas halaman, klik Create Cluster.

Pada halaman pembelian, konfigurasikan parameter utama untuk memilih jenis kluster Anda dengan cepat. Biarkan parameter lain pada nilai default-nya. Untuk detail parameter lebih lanjut, lihat Buat kluster.

Item Konfigurasi

Deskripsi

Product Type

Pay-as-you-go: Bayar per jam setelah penggunaan. Paling cocok untuk kebutuhan jangka pendek. Hentikan kluster setelah selesai untuk menghemat biaya.

Subscription: Bayar di muka saat membuat kluster. Paling cocok untuk kebutuhan jangka panjang. Menawarkan harga lebih rendah dibanding pay-as-you-go, dengan diskon lebih besar untuk durasi langganan yang lebih lama.

Edition

Enterprise Edition: Edisi multi-replika. Menggunakan penyimpanan multi-replika dan komputasi terdistribusi. Menyediakan ketersediaan tinggi (HA).

Basic Edition: Edisi single-replika. Menggunakan penyimpanan single-replika. Tidak menyediakan HA.

Untuk informasi lebih lanjut tentang Enterprise Edition dan Basic Edition, lihat Edisi.

Deployment Mode

Enterprise Edition: Mendukung single-zone deployment atau multi-zone deployment.

PentingMulti-zone deployment hanya didukung di China (Hangzhou), China (Shanghai), China (Beijing), China (Zhangjiakou), China (Shenzhen), China (Hong Kong), dan Singapura.

Basic Edition: Tetap menggunakan single-zone deployment.

Region

Lokasi geografis tempat kluster berjalan. Anda tidak dapat mengubah wilayah setelah pembelian. Pilih wilayah yang paling dekat dengan bisnis Anda untuk meningkatkan kecepatan akses.

Primary Zone

Pilih zona primer untuk kluster Anda.

Secondary Zone

Pilih zona sekunder untuk kluster Anda. Jika zona primer gagal, layanan secara otomatis beralih ke zona sekunder. Selama proses peralihan, kluster mungkin tidak tersedia untuk operasi baca atau tulis, atau mengalami timeout.

PentingAtur parameter ini hanya jika Deployment Mode diatur ke multi-zone deployment.

Virtual private cloud (VPC)

vSwitch in primary zone

vSwitch in secondary zone

Jika Anda telah membuat VPC yang sesuai dengan paket jaringan Anda, pilih VPC tersebut. Misalnya, jika Anda telah membuat Instance ECS dalam VPC yang sesuai dengan rencana Anda, pilih VPC tersebut.

Jika Anda belum membuat VPC yang sesuai dengan rencana Anda, gunakan VPC dan vSwitch default.

Jika VPC dan vSwitch default tidak memenuhi kebutuhan Anda, buat sendiri VPC dan vSwitch.

PentingJika Anda menggunakan layanan Alibaba Cloud lain seperti Elastic Compute Service (ECS) atau ApsaraDB RDS, pastikan kluster AnalyticDB for MySQL Anda dan layanan tersebut berada dalam VPC yang sama. Jika tidak, mereka tidak dapat saling terhubung melalui jaringan internal dan tidak akan berkinerja optimal.

Atur vSwitch in secondary zone hanya jika Deployment Mode diatur ke multi-zone deployment.

Reserved resource node specifications

Spesifikasi node resource reservasi default adalah 8 ACU. Ini mendukung:

Komputasi data. Meningkatkan resource reservasi akan mempercepat kueri.

Setiap kelompok resource reservasi mendukung hingga 8 TB penyimpanan data hot. Anda membayar penyimpanan data hot berdasarkan penggunaan aktual.

CatatanJika Anda sebelumnya membeli Data Warehouse Edition atau Data Lakehouse Edition, lihat Pemetaan antara spesifikasi Enterprise Edition dan Data Lakehouse Edition atau Data Warehouse Edition saat memilih spesifikasi Enterprise Edition.

Number of reserved resource nodes

Kluster Enterprise Edition: Default 3 node. Ukuran langkahnya 3.

CatatanDiEnterprise Edition, Anda dapat mengatur jumlah node resource reservasi menjadi 0. Saat Anda melakukannya, harga pembelian tidak lagi ditampilkan di pojok kanan bawah halaman. Perhatikan hal berikut:

Jika jumlah node resource reservasi adalah 0, Anda hanya dapat menggunakan tabel eksternal. Untuk menggunakan tabel internal di AnalyticDB for MySQL, atur jumlahnya lebih dari 0.

Jika Anda mengatur jumlah node resource reservasi menjadi 0 saat membuat kluster, Anda dapat menambahkan resource reservasi nanti dengan melakukan scaling out. Untuk detailnya, lihat Scaling untuk Enterprise Edition dan Basic Edition.

Kluster Basic Edition: Default 1 node. Ukuran langkahnya 1.

Selesaikan langkah pembelian yang tersisa sesuai petunjuk di konsol.

Setelah pembayaran berhasil, tunggu sekitar 10–15 menit. Di halaman Clusters, status kluster berubah menjadi Running saat pembuatan selesai.

Langkah 2: Buat akun database

AnalyticDB for MySQL mendukung akun database berikut:

Privileged account: Dapat mengelola semua akun standar dan database. Setara dengan akun root di MySQL.

Standard account: Memerlukan pemberian izin manual. Untuk perbedaan antara akun istimewa dan akun standar serta cara membuatnya, lihat Akun istimewa dan akun standar.

Topik ini menggunakan akun istimewa untuk menjelaskan langkah-langkah pembuatannya.

Di halaman Clusters, klik ID kluster target Anda untuk membuka halaman detail kluster.

Di panel navigasi sebelah kiri, klik Accounts.

Di tab Database Accounts, klik Create Account.

Di panel Create Account, atur parameter-parameter berikut.

Parameter

Deskripsi

Database Account

Nama untuk akun istimewa. Masukkan nama yang valid sesuai petunjuk.

Account Type

Pilih Privileged Account.

New Password

Password untuk akun istimewa. Masukkan password yang valid sesuai petunjuk.

Confirm Password

Masukkan ulang password akun istimewa.

Description

Catatan opsional tentang akun untuk membantu pengelolaan di masa depan.

Klik OK untuk membuat akun.

CatatanSetelah membuat akun standar, klik Actions di samping akun tersebut, lalu klik Permissions untuk mengatur izinnya.

Langkah 3: Buat kelompok sumber daya

AnalyticDB for MySQL mengisolasi resource komputasi di seluruh kelompok sumber daya. Hal ini melindungi beban kerja inti dari komputasi kompleks dan lonjakan tak terduga.

Untuk mempermudah pengembangan dan pengujian tugas selanjutnya, bagian ini menggunakan Job resource group sebagai contoh untuk menjelaskan langkah-langkah pembuatannya. Anda juga dapat membuat kelompok sumber daya untuk engine yang sesuai berdasarkan jenis pengembangan tugas Anda. Jenis kelompok sumber daya yang didukung tercantum di bawah ini. Untuk informasi lebih lanjut tentang kelompok sumber daya dan engine komputasi, lihat Buat dan kelola kelompok sumber daya dan Fitur.

Jenis | Tugas yang dieksekusi | Skenario umum |

Interactive resource group | Anda harus menentukan engine saat pembuatan. Tugas yang didukung:

| Skema analitik online atau interaktif dengan QPS tinggi dan waktu respons (RT) rendah. |

Job resource group | Tidak perlu menentukan engine saat pembuatan. Mendukung:

| Skema offline throughput tinggi. |

AI resource group | Eksekusi model MLSQL dan komputasi yang dikelola Ray. | Skema komputasi heterogen. |

Di panel navigasi sebelah kiri halaman detail kluster, klik Cluster Management > Resource Management.

Klik tab Resource Groups. Di pojok kiri atas daftar kelompok sumber daya, klik Create Resource Group.

Masukkan Resource Group Name. Untuk Job Type, pilih Job.

CatatanDalam tutorial ini, atur Minimum Computing Resources menjadi 0 ACU dan Maximum Computing Resources menjadi 8 ACU. Nilai-nilai ini hanya untuk pengujian quick-start.

Klik OK.

Langkah 4: (Opsional) Jalankan skrip uji bawaan di editor SQL

Jika Anda hanya ingin mencoba atau menguji kluster dengan cepat, ikuti bagian ini untuk memuat dan menganalisis dataset bawaan.

Di panel navigasi sebelah kiri halaman detail kluster, klik .

Di tab Databases and Tables, klik Load Built-in Dataset.

Di tab Scripts, klik ganda skrip tersebut dan jalankan pernyataan SQL di SQLConsole untuk menguji kluster.

CatatanUntuk detail tabel dalam dataset bawaan, lihat Detail tabel dataset bawaan.

Langkah 5: Membuat Pekerjaan

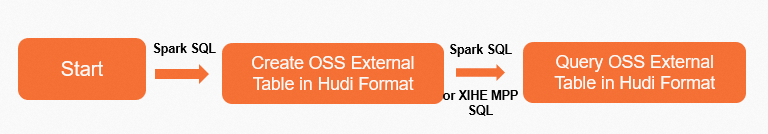

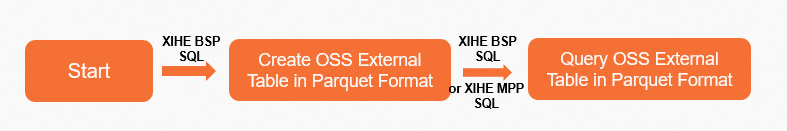

Jenis | Prasyarat | |

Appearance | Pengembangan tugas Spark SQL | Anda telah membuat Job resource group atau Interactive resource group dengan engine Spark. |

Pengembangan tugas Xihe BSP SQL | Anda telah membuat Job resource group. | |

Tabel internal | Pengembangan tugas Spark SQL | Anda telah membuat Job resource group atau Interactive resource group dengan engine Spark.

|

Pengembangan tugas Xihe BSP SQL | Anda telah membuat Job resource group. Data Lakehouse Edition kluster harus memiliki minimal 16 ACU resource komputasi reservasi dan 24 ACU resource penyimpanan reservasi. | |

Langkah selanjutnya

Setelah menyelesaikan tutorial ini, lihat Impor data untuk informasi lebih lanjut tentang langkah-langkah berikutnya.