Jika bisnis Anda memerlukan startup workload yang cepat dan tidak perlu mempertimbangkan batasan sumber daya node, gunakan komponen ack-autoscaling-placeholder. Komponen ini menyediakan buffer untuk auto-scaling kluster. Saat sumber daya node tidak mencukupi, workload aktual akan mengambil alih sumber daya yang dicadangkan oleh workload placeholder agar dapat segera dimulai. Fitur ini dapat dikombinasikan dengan node autoscaling untuk memicu ekspansi di tingkat node dalam kluster. Topik ini menjelaskan cara mencapai skala kontainer dalam hitungan detik menggunakan ack-autoscaling-placeholder.

Operation Flow

Prasyarat

-

Aktifkan Auto Scaling untuk kluster ACK dan konfigurasikan node pool elastis. Untuk informasi selengkapnya, lihat Enable Node Autoscaling.

-

Tetapkan label node untuk node pool elastis menggunakan item konfigurasi Node Labels. Hal ini menjadwalkan workload ke node pool tertentu, yang membantu memverifikasi hasil. Untuk informasi selengkapnya, lihat Create and Manage Node Pools.

Topik ini menggunakan label

demo=yessebagai contoh.

Langkah 1: Deploy komponen ack-autoscaling-placeholder dan buat workload placeholder

ack-autoscaling-placeholder menyediakan buffer untuk auto-scaling kluster, memungkinkan over-provisioning dan pre-warming node kluster. Hal ini memastikan bahwa workload dapat melakukan scale-out dengan cepat tanpa menunggu node baru dibuat dan bergabung ke kluster.

Masuk ke Container Service Management Console . Di panel navigasi sebelah kiri, klik .

-

Pada tab App Catalog, cari ack-autoscaling-placeholder, lalu klik ack-autoscaling-placeholder.

-

Pada halaman ack-autoscaling-placeholder, klik Deploy.

-

Pada panel pembuatan, lengkapi konfigurasi sesuai petunjuk, lalu klik OK.

Ganti konten Parameters pada tab Parameter dengan contoh YAML berikut.

Setelah pembuatan selesai, buka halaman dan verifikasi bahwa status aplikasi adalah Deployed.

Langkah 2: Buat PriorityClass untuk workload aktual

-

Buat file bernama

priorityClass.yamlmenggunakan contoh YAML berikut.apiVersion: scheduling.k8s.io/v1 kind: PriorityClass metadata: name: high-priority value: 1000000 # Konfigurasikan prioritas, yang harus lebih tinggi daripada prioritas default Pod placeholder pada langkah sebelumnya. globalDefault: false description: "This priority class should be used for XYZ service pods only." -

Jalankan perintah berikut untuk deploy PriorityClass untuk workload aktual.

kubectl apply -f priorityClass.yamlExpected output:

priorityclass.scheduling.k8s.io/high-priority created

Langkah 3: Buat workload aktual

-

Buat file bernama

workload.yamlmenggunakan contoh YAML berikut. -

Jalankan perintah berikut untuk deploy workload aktual.

kubectl apply -f workload.yamlExpected output:

deployment.apps/placeholder-test created

Verifikasi Hasil

-

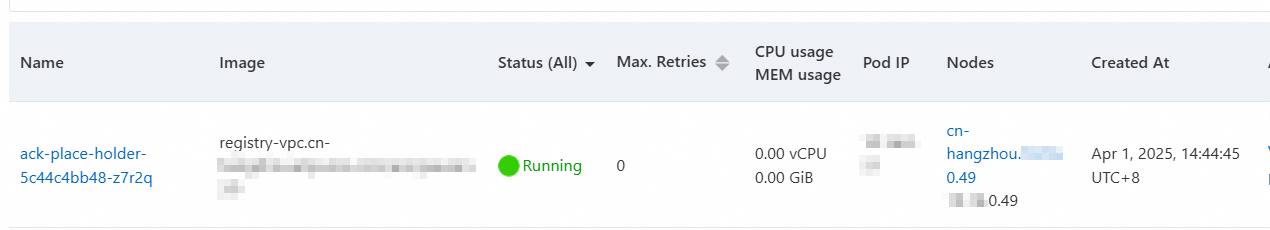

Setelah workload placeholder ack-place-holder dibuat, status Pod-nya adalah Running.

-

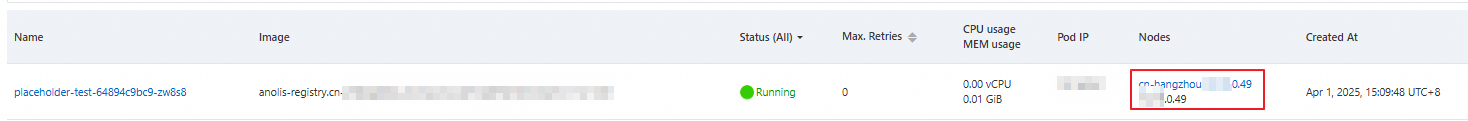

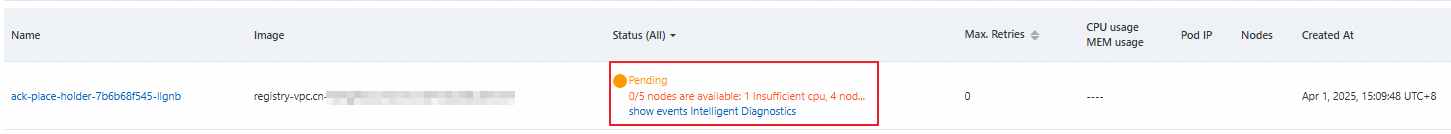

Saat workload aktual dideploy, workload tersebut mengambil alih sumber daya dari workload placeholder untuk startup cepat karena PriorityClass dengan prioritas tinggi telah dikonfigurasi. Pod workload placeholder dievict dan tetap dalam status Pending karena sumber daya node tidak mencukupi.

-

Workload aktual placeholder-test dideploy dengan cepat pada node yang sama tempat workload placeholder berada.

-

Workload placeholder dievict dan masuk ke status Pending.

-

-

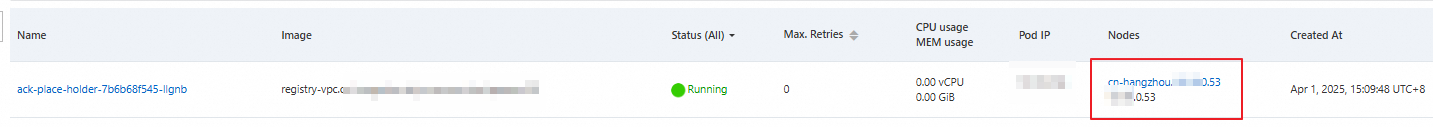

Karena node pool telah mengaktifkan auto-scaling, ketidakcukupan sumber daya node memicu scale-out node. Workload placeholder dijadwalkan ke node baru yang di-scale-out, dan statusnya menjadi Running.

Referensi

Untuk scale-out elastis dengan penerapan multi-zona dalam skenario ketersediaan tinggi, lihat Achieve Fast Elastic Scale-out in Multiple Zones Simultaneously.