Model Gallery預置了多種LLM預訓練模型並提供了全面的模型評測功能,協助您評測大語言模型(LLM)的能力。

功能概述

模型評測功能支援從兩個維度評測大語言模型:

自訂資料集評測

基於規則的評測:使用ROUGE和BLEU指標來衡量模型預測與標準答案之間的相似性。

裁判模型評測:利用PAI基於Qwen2的裁判模型對模型輸出進行逐題評分,特別適用於開放式和複雜的問答情境。

公開資料集評測

在行業標準的公開資料集上評測模型(如MMLU、TriviaQA、HellaSwag、GSM8K、C-Eval、TruthfulQA)。

提供與行業評測標準一致的基準分數。

支援的模型:目前支援所有HuggingFace AutoModelForCausalLM模型類型。

最新特性:現已支援球證模型打分,使用基於Qwen2定製的大模型作為球證,對被評測模型的產生結果進行打分,適用於開放性、複雜問答情境。限時免費中,歡迎在模型評測-專家模式中試用。[2024.09.01]

使用情境

模型評測是模型開發的關鍵組成部分。以下是您可以利用此功能的典型情境:

模型基準測試

使用公開資料集評測模型通用能力。

與行業模型或基準進行比較。

特定領域能力評測

將模型應用於特定領域。

比較預訓練模型和微調模型在不同領域的效能。

評測模型應用領域知識的能力。

模型迴歸測試

構建迴歸測試集。

評測模型在實際業務情境中的效能。

確定模型是否符合生產標準。

計費說明

資料準備

模型評測功能支援基於自訂資料集和公開資料集(例如C-Eval)完成評測。

公開資料集:

目前PAI維護了MMLU、TriviaQA、HellaSwag、GSM8K、C-Eval、TruthfulQA,可以直接使用。其他公開資料集陸續接入中。

自訂資料集:

需提供JSONL格式的自訂評測檔案,可自行上傳至OSS,並建立自訂資料集,詳情參見上傳OSS檔案和建立及管理資料集。檔案格式如下:

使用

question標識問題列,answer標識答案列,也可以在評測頁面選擇指定列。如果僅需要自訂資料集-球證模型評測,則answer列選填。{"question": "中國發明了造紙術,是否正確?", "answer": "正確"} {"question": "中國發明了火藥,是否正確?", "answer": "正確"}檔案樣本:eval.jsonl

工作流程

步驟一:選定模型

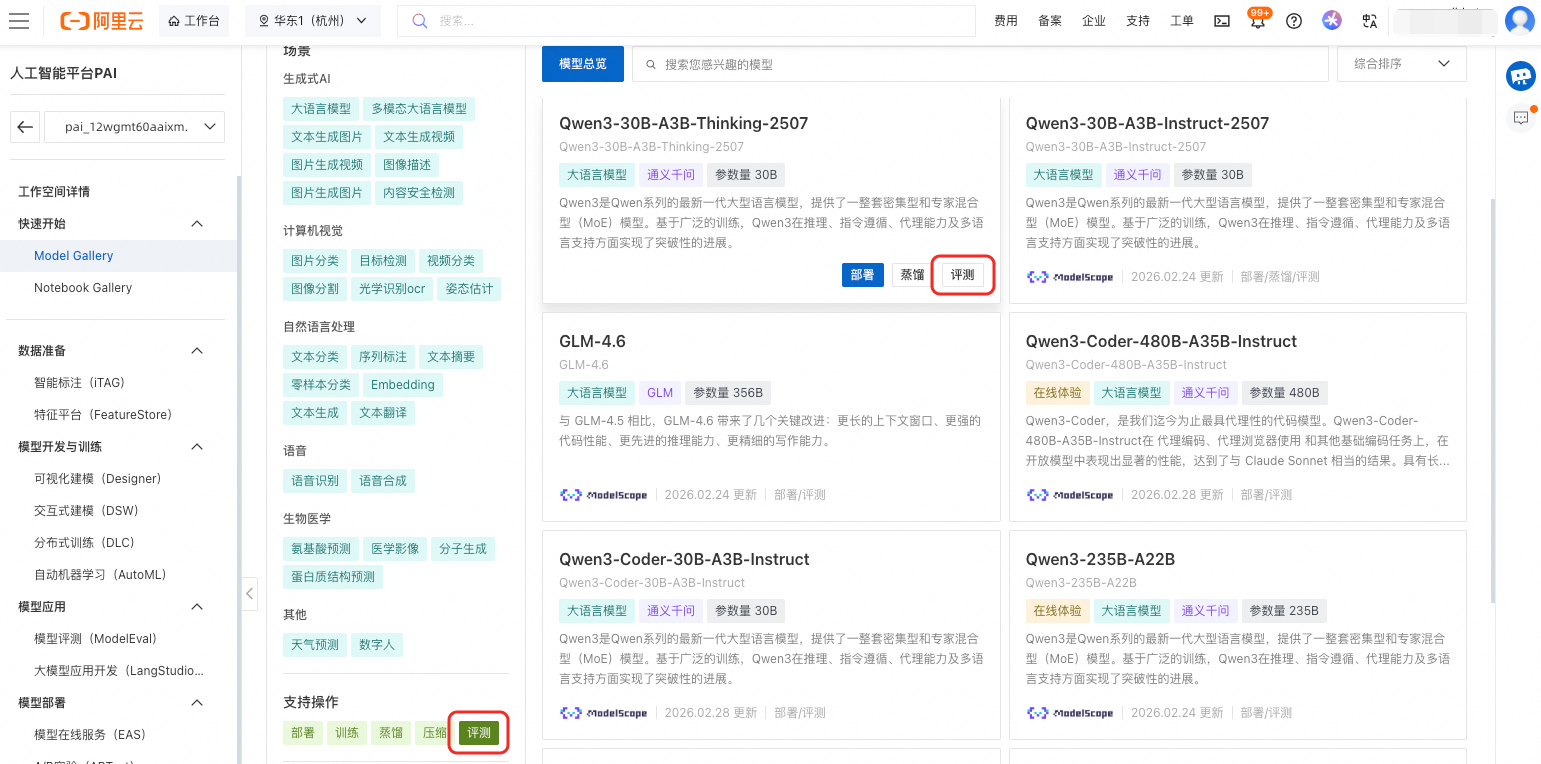

進入Model Gallery頁面。

登入PAI控制台。

在左側導覽列單擊工作空间列表,選擇並進入目標工作空間。

在左側導覽列選擇快速开始 > Model Gallery,進入Model Gallery頁面。

尋找可評測的模型。

從模型廣場篩選可評測模型。在支持操作篩選區域選擇评测即可過濾出可評測的模型。

評測二次訓練的模型。對於支援評測的模型,其二次訓練後的模型也支援評測。在Model Gallery頁面單擊左上方任务管理 > 训练任务,單擊目標任務名稱任務詳情頁,右上方可看到评测按鈕。

步驟二:配置評測任務

支援同時選擇公開資料集和自訂資料集完成評測,支援設定超參數,支援球證模型評測,支援選擇多個公開資料集。

配置基礎參數:

任务名称:自動產生的唯一名稱。

结果输出路径:評測結果儲存的OSS路徑。

标签:用於對資源進行多維度尋找、定位、大量操作、分賬。

配置評測方式:

评测方式:支援以下兩種

公开数据集:可同時選擇多個。

自定义数据集:自訂資料集支援指定問題和參考答案列,其中如果僅需要球證模型評測,則參考答案列可空。

数据集来源:支援选择OSS文件和选择现有数据集。

评测方法:支援裁判员模型评测和通用指标评测。

pai-judge裁判员模型服务Token:當使用球證模型評測時,會自動設定該參數,您也可以前往球證模型頁面進行擷取。

配置運行資源:

资源组类型:您可以選擇隨用隨付的公用資源群組,或者已經建立的訂用帳戶的資源配額。

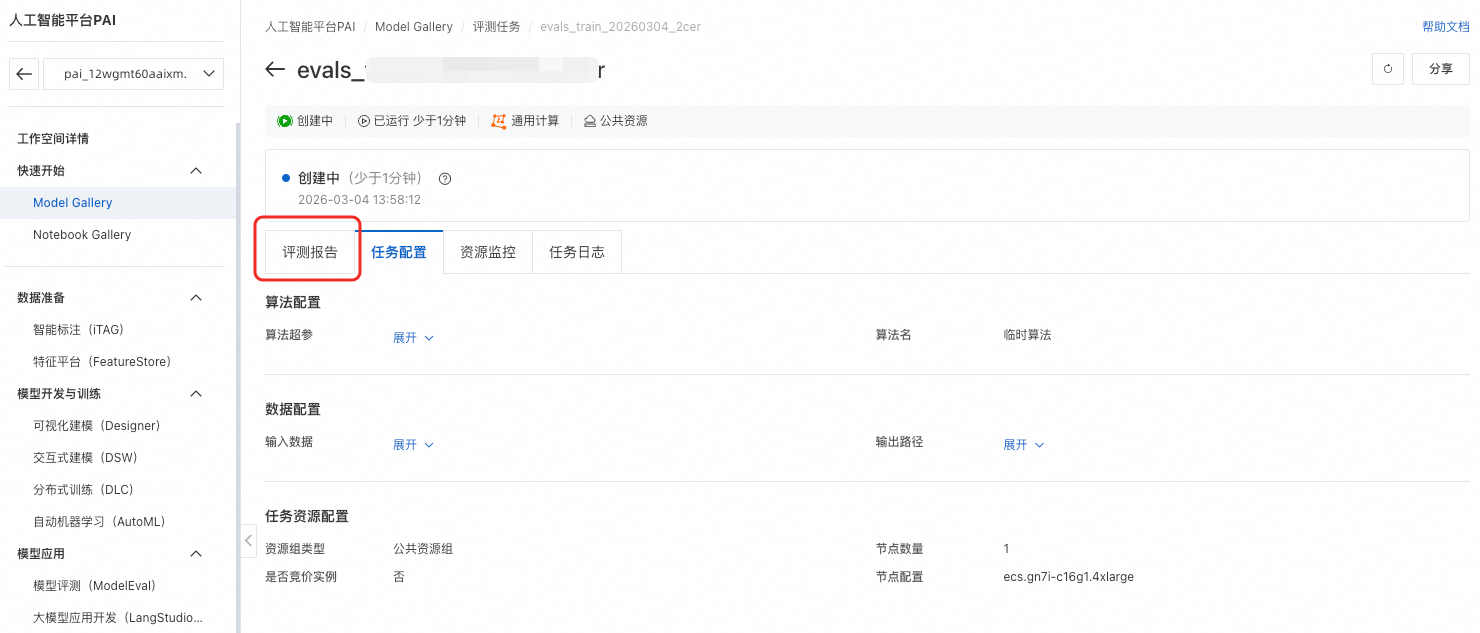

參數配置完成後,單擊确定提交任務,頁面將自動跳轉到任務詳情頁面。等待任務執行成功,單擊评测报告,即可查看評測報告。

查看評測結果

評測工作清單

在Model Gallery頁面,單擊任务管理,然後切換到评测任务標籤頁。

單任務結果

在評測工作清單頁,單擊目標評測任務操作列下的查看报告,即可進入評測任務詳情頁,在詳情頁評測報告一欄會展示模型在自訂資料集和公開資料集上的評測得分。

自訂資料集評測結果頁面

如果評測任務選中了通用指標評測,則通過雷達圖展示了該模型在ROUGE和BLEU系列指標上的得分。自訂資料集的預設評測指標包括:rouge-1-f,rouge-1-p,rouge-1-r,rouge-2-f,rouge-2-p,rouge-2-r,rouge-l-f,rouge-l-p,rouge-l-r,bleu-1,bleu-2,bleu-3,bleu-4。

rouge指標:

rouge-n類指標計算N-gram(連續的N個詞)的重疊度,其中rouge-1和rouge-2是最常用的,分別對應unigram和bigram:

rouge-1-p (Precision):系統摘要中的unigrams與參考摘要中的unigrams匹配的比例。

rouge-1-r (Recall):參考摘要中的unigrams在系統摘要中出現的比例。

rouge-1-f (F-score):精確率和召回率的調和平均數。

rouge-2-p (Precision):系統摘要中的bigrams與參考摘要中的bigrams匹配的比例。

rouge-2-r (Recall):參考摘要中的bigrams在系統摘要中出現的比例。

rouge-2-f (F-score):精確率和召回率的調和平均數。

rouge-l 指標基於最長公用子序列(LCS):

rouge-l-p (Precision):基於LCS的系統摘要與參考摘要的匹配程度的精確率。

rouge-l-r (Recall):基於LCS的系統摘要與參考摘要的匹配程度的召回率。

rouge-l-f (F-score):基於LCS的系統摘要與參考摘要的匹配程度的F-score。

bleu指標:

bleu (Bilingual Evaluation Understudy) 是另一種流行的評測機器翻譯品質的指標,它通過測量機器翻譯輸出與一組參考翻譯之間的N-gram重疊度來評分。

bleu-1:考察unigram的匹配。

bleu-2:考察bigram的匹配。

bleu-3:考察trigram(連續三個詞)的匹配。

bleu-4:考察4-gram的匹配。

如果評測任務選中了球證模型評測,則通過列表展示球證模型評分的統計指標。

球證模型是PAI基於Qwen2模型微調後得到,在開源的Alighbench等資料集上表現與GPT-4持平,部分情境優於GPT-4的評測效果。

頁面展示了球證模型對被評測模型的打分的四個統計指標:

Mean,表示球證大模型對模型產生結果打分的平均值(不含無效打分),最低值1,最大值5,越大表示模型回答越好。

Median,表示球證大模型對模型產生結果打分的中位元(不含無效打分),最低值1,最大值5,越大表示模型回答越好。

StandardDeviation,表示球證大模型對模型產生結果打分的標準差(不含無效打分),在均值和中位元相同情況下,標準差越小,模型越好。

Skewness,表示球證大模型打分結果的分布偏度(不含無效打分),正偏度表示分布右側(高分段)有較長尾部;負偏度則表示左側(低分段)有較長尾部。

此外還會在頁面底部展示評測檔案每條資料的評測詳情。

公開資料集評測結果頁面

如果評測任務選擇了公開資料集,則在雷達圖展示該模型在公開資料集上的得分。

左側圖片展示了模型在不同領域的得分情況。每個領域可能會有多個與之相關的資料集,對屬於同一領域的資料集,我們會把模型在這些資料集上的評測得分取均值,作為領域得分。

右側圖片展示模型在各個公開資料集的得分情況。每個公開資料集的評測範圍見資料集官方介紹。

多評測任務對比

當需要對比多個模型的評測結果時,可以將它們在彙總在一個頁面上展示,以便於比較效果。具體操作為在評測工作清單頁左側選擇想要對比的模型評測任務,右上方點擊對比,進入對比頁面:

自訂資料集對比結果

公開資料集對比結果

結果分析

自訂資料集評測

通用指標評測:使用標準的NLP文本匹配方法,計算模型輸出與標準答案之間的相似性,數值越高表示模型效能越好。適用於使用特定領域資料評測模型對特定情境的適配度。

裁判模型評測:利用大語言模型的優勢在語義層面評測輸出品質。均值和中位元越高,標準差越低,表示模型效能越好。與簡單的文本匹配相比,能更準確地評測輸出品質。

公開資料集評測

這是LLM領域最常見的評測方法,使用涵蓋各個領域(如數學、編碼)的開源評測資料集,為LLM模型提供全面的能力評測,分數越高表示模型效能越好。

相關文檔

除了控制台頁面,也可以通過PAI Python SDK使用模型評測功能,詳情可參考如下NoteBook: