E-MapReduce (EMR) を使用すると、EMR コンソールで Hadoop 分散ファイルシステム (HDFS)、YARN、Spark などのサービスの設定項目を表示・変更・追加できます。

前提条件

作業を開始する前に、次の要件を満たしていることを確認してください。

EMR クラスターが存在すること。詳細については、「クラスターの作成」をご参照ください。

仕組み

EMR では、設定項目をクラスター、ノードグループ、ノードの 3 つのレベルで管理します。同じ設定項目が複数のレベルで設定されている場合、優先度の最も高いレベルの値が有効になります。優先度の順序は、ノード > ノードグループ > クラスター です。

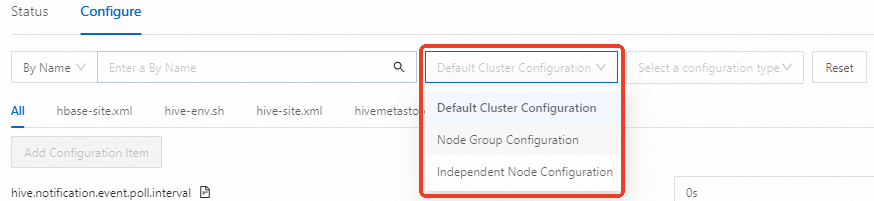

デフォルトでは、構成 タブにはクラスターレベルの設定項目が表示されます。ノードグループまたはノードレベルの設定項目を表示または変更するには、デフォルトクラスター構成 ドロップダウンリストを使用してスコープを切り替えてください。

ノードグループ構成 — ノードグループ内のすべてのノードに設定を適用します。

個別ノード構成 — 特定のノードに設定を適用します。

デフォルトクラスター構成 が選択されている場合にのみ、ノードグループおよびノードレベルの設定項目を表示できます。これらの設定項目を変更するには、まず適切なスコープに切り替えてください。

設定項目の表示

EMR コンソール にログインします。左側のナビゲーションウィンドウで、EMR on ECS をクリックします。

上部のナビゲーションバーで、リージョン およびリソースグループ を選択します。

クラスターを見つけ、[サービス] を [操作] 列でクリックします。

[サービス] タブで対象のサービスを見つけ、[構成] をクリックします。

検索ボックスに設定項目の名前を入力します。

ノードグループまたはノードレベルの設定項目が変更された場合、またはその設定がクラスターレベルのデフォルト設定と異なる場合、[構成] タブには デフォルトクラスター構成 が選択された状態で、ノードグループまたはノードレベルの設定が表示されます。

ノードグループまたはノードレベルの設定項目を表示するには、デフォルトクラスター構成 ドロップダウンリストから ノードグループ構成 または 個別ノード構成 を選択し、その後、特定のノードグループまたはノードを選択します。

設定項目の変更

EMR コンソール にログインします。左側のナビゲーションウィンドウで、EMR on ECS をクリックします。

上部のナビゲーションバーで、リージョン およびリソースグループ を選択します。

クラスターを探し、[アクション] 列の [サービス] をクリックします。

[サービス] タブで対象のサービスを見つけ、[構成] をクリックします。

(オプション)ノードグループまたはノードレベルの設定項目を変更するには、デフォルトクラスター構成 ドロップダウンリストから ノードグループ構成 または 個別ノード構成 を選択します。

検索ボックスに設定項目の名前を入力し、検索アイコンをクリックします。

設定項目の値を変更します。> ヒント: たとえば、NodeManager のメモリを増やすには、

yarn.nodemanager.resource.memory-mbを8192などのより大きな値に設定します。[保存] をクリックします。[保存] ダイアログボックスで、実行理由 を設定し、[保存] をクリックします。

[構成の保存と配信] スイッチはデフォルトでオンになっています。このスイッチがオンの場合、構成は保存直後にクライアントに送信され、プロンプトモードで有効化できます。手動モードで構成を手動で有効化するには、このスイッチをオフにしてください。

構成を有効化します。詳細については、「構成の有効化」をご参照ください。

設定項目の追加

EMR コンソール にログインします。左側のナビゲーションウィンドウで、EMR on ECS をクリックします。

上部のナビゲーションバーで、リージョン およびリソースグループ を選択します。

クラスターを探し、[操作] 列の [サービス] をクリックします。

[サービス] タブで対象のサービスを見つけ、[構成] をクリックします。

設定項目を追加するタブをクリックし、[設定項目の追加] をクリックします。

設定の詳細を入力します。複数の項目を一度に追加できます。

フィールド 説明 キー 設定項目の名前 値 設定項目の値 説明 設定項目の説明 [操作] 設定項目を削除 [OK] をクリックします。ダイアログボックスで、実行理由 を設定し、[保存] をクリックします。

構成を有効化します。詳細については、「構成の有効化」をご参照ください。

構成の有効化

保存後、構成の種類と希望のモードに基づいて構成を有効化します。

プロンプトモード

プロンプトモードは、EMR V5.12.1、EMR V3.46.1 以降のマイナーバージョンでのみ利用可能です。

クライアント側の構成

保存後、

(配信待ち) プロンプトをクリックします。

(配信待ち) プロンプトをクリックします。配信待ちの構成 メッセージで、[配信] をクリックします。

YARN サービスの場合、変更された項目にキュー関連の設定項目が含まれている場合は、

(まだ有効になっていません) プロンプトをクリックするか、YARN サービスページの [リソースキューの編集] タブで [デプロイ] をクリックして変更を有効化します。

(まだ有効になっていません) プロンプトをクリックするか、YARN サービスページの [リソースキューの編集] タブで [デプロイ] をクリックして変更を有効化します。

サーバー側の構成

保存後、

(まだ有効になっていません) プロンプトをクリックします。

(まだ有効になっていません) プロンプトをクリックします。[有効化する構成] ダイアログボックスで、各コンポーネントの種類に応じて有効化します。

カスタム操作が必要な構成:各コンポーネントの [操作] 列で対応する操作をクリックします。

再起動が必要な構成:コンポーネントの [操作] 列で restart をクリックするか、複数のコンポーネントを選択して [一括再起動] をクリックします。ダイアログボックスで、実行理由 を設定し、[OK] をクリックします。

手動モード

クライアント側の構成

ページ下部の [保存] の横にある [クライアント構成のデプロイ] をクリックします。

ダイアログボックスで、実行理由 を設定し、[OK] をクリックします。

[確認] メッセージで、[OK] をクリックします。

サーバー側の構成

[構成] タブの右上隅で、[その他] > [再起動] を選択します。

ダイアログボックスで、実行理由 を設定し、[OK] をクリックします。

[確認] メッセージで、[OK] をクリックします。

変更可能な設定項目

次の表は、EMR V5.17.1 クラスターでノードおよびノードグループレベルで変更可能な設定項目の一覧です。

Kerberos 関連の設定項目は、Kerberos 認証が有効になっている場合にのみ利用可能です。

<table> <thead> <tr> <td><p><b>サービス名</b></p></td> <td><p><b>ファイル</b></p></td> <td><p><b>設定項目</b></p></td> </tr> </thead> <colgroup></colgroup> <colgroup></colgroup> <colgroup></colgroup> <tbody> <tr> <td><p>Hadoop-Common</p></td> <td><p>core-site.xml</p></td> <td><p>fs.oss.tmp.data.dirs</p><p>hadoop.tmp.dir</p></td> </tr> <tr> <td><p>HDFS</p></td> <td><p>hdfs-env.sh</p></td> <td><p>hadoop_datanode_heapsize</p><p>hadoop_secondarynamenode_opts</p><p>hadoop_namenode_heapsize</p></td> </tr> <tr> <td><p>hdfs-site.xml</p></td> <td><p>dfs.datanode.data.dir</p><p>dfs.datanode.failed.volumes.tolerated</p><p>dfs.datanode.du.reserved</p><p>dfs.datanode.balance.max.concurrent.moves</p></td> </tr> <tr> <td><p>OSS-HDFS</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Hive</p></td> <td><p>hive-env.sh</p></td> <td><p>hive_metastore_heapsize</p><p>hive_server2_heapsize</p></td> </tr> <tr> <td><p>Spark2</p></td> <td><p>hiveserver2-site.xml</p></td> <td><p>hive.server2.authentication.kerberos.principal</p></td> </tr> <tr> <td><p>spark-env.sh</p></td> <td><p>spark_history_daemon_memory</p><p>spark_thrift_daemon_memory</p></td> </tr> <tr> <td><p>spark-thriftserver.conf</p></td> <td><p>spark.yarn.historyServer.address</p><p>spark.hadoop.hive.server2.thrift.bind.host</p><p>spark.yarn.principal</p></td> </tr> <tr> <td><p>spark-defaults.conf</p></td> <td><p>spark.yarn.historyServer.address</p><p>spark.history.kerberos.principal</p></td> </tr> <tr> <td><p>Spark3</p></td> <td><p>hiveserver2-site.xml</p></td> <td><p>hive.server2.authentication.kerberos.principal</p></td> </tr> <tr> <td><p>spark-env.sh</p></td> <td><p>spark_history_daemon_memory</p><p>spark_thrift_daemon_memory</p></td> </tr> <tr> <td><p>spark-thriftserver.conf</p></td> <td><p>spark.yarn.historyServer.address</p><p>spark.hadoop.hive.server2.thrift.bind.host</p><p>spark.kerberos.principal</p></td> </tr> <tr> <td><p>spark-defaults.conf</p></td> <td><p>spark.yarn.historyServer.address</p><p>spark.history.kerberos.principal</p></td> </tr> <tr> <td><p>Tez</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Trino</p></td> <td><p>iceberg.properties</p></td> <td><p>hive.hdfs.trino.principal</p><p>hive.metastore.client.principal</p></td> </tr> <tr> <td><p>delta.properties</p></td> <td><p>hive.hdfs.trino.principal</p><p>hive.metastore.client.principal</p></td> </tr> <tr> <td><p>config.properties</p></td> <td><p>coordinator</p><p>node-scheduler.include-coordinator</p><p>query.max-memory</p><p>query.max-total-memory</p><p>query.max-memory-per-node</p><p>http-server.authentication.type</p><p>http-server.authentication.krb5.user-mapping.pattern</p><p>http-server.authentication.krb5.service-name</p><p>http-server.authentication.krb5.keytab</p><p>http.authentication.krb5.config</p><p>http-server.https.enabled</p><p>http-server.https.port</p><p>http-server.https.keystore.key</p><p>http-server.https.keystore.path</p><p>event-listener.config-files</p> <div> <div> <i></i> </div> <div> <strong>Note </strong> <p>event-listener.config-files は、イベントリスナーの設定ファイルが格納されているパスを指定します。この設定項目は、EmrEventListener を有効にした場合にのみ利用可能です。 </p> </div> </div></td> </tr> <tr> <td><p>jvm.config</p></td> <td><p>jvm parameter</p></td> </tr> <tr> <td><p>hudi.properties</p></td> <td><p>hive.hdfs.trino.principal</p><p>hive.metastore.client.principal</p></td> </tr> <tr> <td><p>password-authenticator.properties</p></td> <td><p>ldap.url</p><p>ldap.user-bind-pattern</p></td> </tr> <tr> <td><p>hive.properties</p></td> <td><p>hive.hdfs.trino.principal</p><p>hive.metastore.client.principal</p></td> </tr> <tr> <td><p>DeltaLake</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Hudi</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Iceberg</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>JindoData</p></td> <td><p>storage.yaml</p></td> <td><p>jindofsx.storage.cache-mode</p><p>storage.watermark.high.ratio</p><p>storage.watermark.low.ratio</p><p>storage.handler.threads</p> <div> <div> <i></i> </div> <div> <strong>Note </strong> <ul> <li><p>JindoData は、EMR V5.14.0 以降のマイナーバージョンおよび EMR V3.48.0 以降のマイナーバージョンのクラスターに適用されます。 </p></li> <li><p>JindoData は、EMR V5.15.0 以降のマイナーバージョンおよび EMR V3.49.0 以降のマイナーバージョンのクラスターでは利用できません。データキャッシュには <a href="https://www.alibabacloud.com/help/ja/document_detail/2579701.html">JindoCache</a> を、認証には <a href="https://www.alibabacloud.com/help/ja/document_detail/455181.html">DLF-Auth</a> を使用できます。 </p></li> </ul> </div> </div></td> </tr> <tr> <td><p>Flume</p></td> <td><p>flume-conf.properties</p></td> <td><p>agent_name</p><p>flume-conf.properties</p></td> </tr> <tr> <td><p>Kyuubi</p></td> <td><p>kyuubi-env.sh</p></td> <td><p>kyuubi_java_opts</p></td> </tr> <tr> <td><p>YARN</p></td> <td><p>yarn-site.xml</p></td> <td><p>yarn.nodemanager.resource.memory-mb</p><p>yarn.nodemanager.local-dirs</p><p>yarn.nodemanager.log-dirs</p><p>yarn.nodemanager.resource.cpu-vcores</p><p>yarn.nodemanager.address</p><p>yarn.nodemanager.node-labels.provider.configured-node-partition</p></td> </tr> <tr> <td><p>yarn-env.sh</p></td> <td><p>YARN_RESOURCEMANAGER_HEAPSIZE</p><p>YARN_TIMELINESERVER_HEAPSIZE</p><p>YARN_PROXYSERVER_HEAPSIZE</p><p>YARN_NODEMANAGER_HEAPSIZE</p><p>YARN_RESOURCEMANAGER_HEAPSIZE_MIN</p><p>YARN_TIMELINESERVER_HEAPSIZE_MIN</p><p>YARN_PROXYSERVER_HEAPSIZE_MIN</p><p>YARN_NODEMANAGER_HEAPSIZE_MIN</p></td> </tr> <tr> <td><p>mapred-env.sh</p></td> <td><p>HADOOP_JOB_HISTORYSERVER_HEAPSIZE</p></td> </tr> <tr> <td><p>mapred-site.xml</p></td> <td><p>mapreduce.cluster.local.dir</p></td> </tr> <tr> <td><p>Impala</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>OpenLDAP</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Ranger</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Ranger-Plugin</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>DLF-Auth</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Presto</p></td> <td><p>iceberg.properties</p></td> <td><p>hive.hdfs.presto.principal</p><p>hive.metastore.client.principal</p></td> </tr> <tr> <td><p>delta.properties</p></td> <td><p>hive.hdfs.presto.principal</p><p>hive.metastore.client.principal</p></td> </tr> <tr> <td><p>hive.properties</p></td> <td><p>hive.hdfs.presto.principal</p><p>hive.metastore.client.principal</p></td> </tr> <tr> <td><p>config.properties</p></td> <td><p>coordinator</p><p>node-scheduler.include-coordinator</p><p>query.max-memory-per-node</p><p>query.max-total-memory-per-node</p><p>http-server.authentication.type</p><p>http.authentication.krb5.principal-hostname</p><p>http.server.authentication.krb5.service-name</p><p>http.server.authentication.krb5.keytab</p><p>http.authentication.krb5.config</p><p>http-server.https.enabled</p><p>http-server.https.port</p><p>http-server.https.keystore.key</p><p>http-server.https.keystore.path</p></td> </tr> <tr> <td><p>jvm.config</p></td> <td><p>jvm parameter</p></td> </tr> <tr> <td><p>hudi.properties</p></td> <td><p>hive.hdfs.presto.principal</p><p>hive.metastore.client.principal</p></td> </tr> <tr> <td><p>password-authenticator.properties</p></td> <td><p>ldap.url</p><p>ldap.user-bind-pattern</p></td> </tr> <tr> <td><p>Starrocks2</p></td> <td><p>fe.conf</p></td> <td><p>JAVA_OPTS</p><p>meta_dir</p></td> </tr> <tr> <td><p>be.conf</p></td> <td><p>storage_root_path</p><p>JAVA_OPTS</p></td> </tr> <tr> <td><p>Starrocks3</p></td> <td><p>fe.conf</p></td> <td><p>JAVA_OPTS</p><p>meta_dir</p></td> </tr> <tr> <td><p>be.conf</p></td> <td><p>storage_root_path</p><p>JAVA_OPTS</p></td> </tr> <tr> <td><p>Doris</p></td> <td><p>fe.conf</p></td> <td><p>JAVA_OPTS</p><p>JAVA_OPTS_FOR_JDK_9</p><p>meta_dir</p></td> </tr> <tr> <td><p>be.conf</p></td> <td><p>storage_root_path</p></td> </tr> <tr> <td><p>ClickHouse</p></td> <td><p>server-config</p></td> <td><p>interserver_http_host</p></td> </tr> <tr> <td><p>server-metrika</p></td> <td><p>macros.shard</p><p>macros.replica</p></td> </tr> <tr> <td><p>ZooKeeper</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Sqoop</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Knox</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Celeborn</p></td> <td><p>celeborn-env.sh</p></td> <td><p>CELEBORN_WORKER_MEMORY</p><p>CELEBORN_WORKER_OFFHEAP_MEMORY</p><p>CELEBORN_MASTER_MEMORY</p></td> </tr> <tr> <td><p>celeborn-defaults.conf</p></td> <td><p>celeborn.worker.storage.dirs</p><p>celeborn.worker.flusher.threads</p></td> </tr> <tr> <td><p>Flink</p></td> <td><p>flink-conf.yaml</p></td> <td><p>security.kerberos.login.principal</p><p>security.kerberos.login.keytab</p></td> </tr> <tr> <td><p>HBase</p></td> <td><p>hbase-env.sh</p></td> <td><p>hbase_master_opts</p><p>hbase_thrift_opts</p><p>hbase_rest_opts</p><p>hbase_regionserver_opts</p></td> </tr> <tr> <td><p>hbase-site.xml</p></td> <td><p>hbase.regionserver.handler.count</p><p>hbase.regionserver.global.memstore.size</p><p>hbase.regionserver.global.memstore.lowerLimit</p><p>hbase.regionserver.thread.compaction.throttle</p><p>hbase.regionserver.thread.compaction.large</p><p>hbase.regionserver.thread.compaction.small</p></td> </tr> <tr> <td><p>HBASE-HDFS</p></td> <td><p>hdfs-env.sh</p></td> <td><p>hadoop_secondarynamenode_opts</p><p>hadoop_namenode_heapsize</p><p>hadoop_datanode_heapsize</p></td> </tr> <tr> <td><p>hdfs-site.xml</p></td> <td><p>dfs.datanode.data.dir</p><p>dfs.datanode.failed.volumes.tolerated</p><p>dfs.datanode.du.reserved</p><p>dfs.datanode.balance.max.concurrent.moves</p></td> </tr> <tr> <td><p>JindoCache</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Kafka</p></td> <td><p>server.properties</p></td> <td><p>broker.id</p><p>num.network.threads</p><p>num.io.threads</p><p>kafka.heap.opts</p><p>log.dirs</p><p>kafka.public-access.ip</p><p>listeners</p><p>advertised.listeners</p> <div> <div> <i></i> </div> <div> <strong>Note </strong> <p><code>kafka.public-access.ip</code> は Kafka ブローカーのパブリック IP アドレスを指定します。この設定項目を使用して、パブリック IP アドレスを持つリスナーを構成できます。 </p> </div> </div></td> </tr> <tr> <td><p>kafka-internal-config</p></td> <td><p>broker_id</p></td> </tr> <tr> <td><p>user_params</p></td> <td><p>is_local_disk_instance</p></td> </tr> <tr> <td><p>Kudu</p></td> <td><p>master.gflags</p></td> <td><p>fs_data_dirs</p><p>fs_wal_dir</p><p>fs_metadata_dir</p><p>log_dir</p></td> </tr> <tr> <td><p>tserver.gflags</p></td> <td><p>fs_data_dirs</p><p>fs_wal_dir</p><p>fs_metadata_dir</p><p>log_dir</p></td> </tr> <tr> <td><p>Paimon</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> <tr> <td><p>Phoenix</p></td> <td><p>None</p></td> <td><p>None</p></td> </tr> </tbody> </table>