Setelah Simple Log Service mengumpulkan data, Anda dapat mengirimkannya ke Object Storage Service (OSS) untuk penyimpanan dan analisis. Topik ini menjelaskan cara membuat tugas pengiriman OSS (versi lama).

Versi lama pengiriman log ke OSS telah dihentikan. Lihat versi baru.

Prasyarat

-

Proyek dan logstore sudah ada. Untuk informasi selengkapnya, lihat Buat proyek dan logstore.

-

Data log telah dikumpulkan. Untuk informasi selengkapnya, lihat Pengumpulan data.

-

Bucket OSS sudah ada di wilayah yang sama dengan proyek SLS Anda. Untuk informasi selengkapnya, lihat Buat bucket.

-

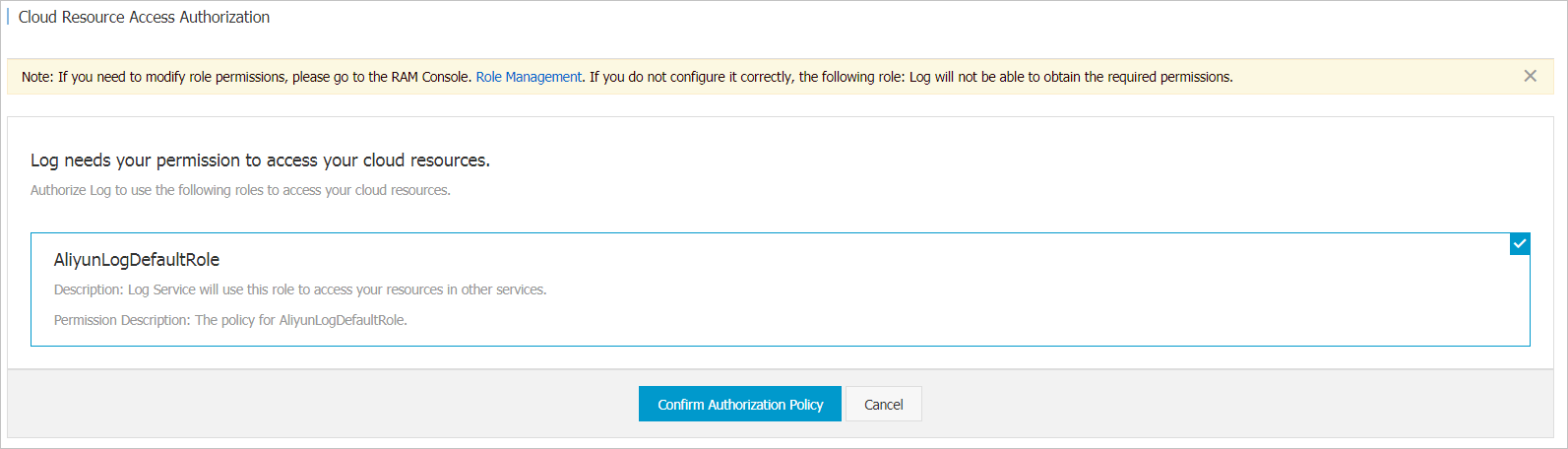

Anda telah menyelesaikan Cloud Resource Access Authorization.

Jika Anda ingin mengirimkan data lintas akun Alibaba Cloud atau menggunakan RAM user untuk membuat tugas pengiriman, Anda harus memberikan izin RAM yang diperlukan. Untuk informasi selengkapnya, lihat Kelola izin RAM untuk pengiriman log ke OSS.

Informasi latar belakang

Simple Log Service memungkinkan Anda mengarsipkan data dari Logstore ke OSS secara otomatis untuk membuka lebih banyak nilai dari data Anda.

-

OSS memungkinkan Anda mengonfigurasi aturan lifecycle untuk menyimpan data dalam jangka waktu panjang.

-

Anda dapat menggunakan platform pemrosesan data, seperti E-MapReduce dan Data Lake Analytics (DLA), atau program kustom untuk mengonsumsi data dari OSS.

Prosedur

-

Setelah Anda mengaktifkan fitur pengiriman, Simple Log Service menjalankan beberapa instans pengiriman secara paralel.

-

Setelah instans pengiriman dibuat, Anda dapat memverifikasi tugas pengiriman dengan memeriksa statusnya dan data di OSS.

Masuk ke Konsol Simple Log Service.

Pada bagian Projects, klik proyek yang diinginkan.

-

Di tab , klik > di sebelah kiri logstore target, lalu pilih .

-

Arahkan kursor ke Object Storage Service (OSS), lalu klik ikon +.

-

Di panel OSS LogShipper, konfigurasikan parameter berikut, lalu klik OK.

Atur Shipping Version ke Old Version. Tabel berikut menjelaskan parameter utama.

Parameter

Deskripsi

OSS shipper name

Nama tugas pengiriman.

OSS bucket

Nama bucket OSS tujuan.

Penting-

Bucket harus sudah ada, memiliki kebijakan Write-Once-Read-Many (WORM) yang dinonaktifkan, dan berada di wilayah yang sama dengan proyek SLS. Untuk informasi selengkapnya tentang WORM, lihat Retention Policy (WORM).

-

Anda dapat mengirimkan data ke bucket dengan kelas penyimpanan Standard, Infrequent Access (IA), Archive, Cold Archive, dan Deep Cold Archive. Secara default, kelas penyimpanan objek OSS yang dihasilkan sama dengan kelas penyimpanan bucket tersebut. Untuk informasi selengkapnya, lihat Storage class.

-

Kelas penyimpanan selain Standard memiliki durasi penyimpanan minimum dan ukuran tagihan minimum. Pilih kelas penyimpanan untuk bucket tujuan yang sesuai dengan kebutuhan Anda. Untuk informasi selengkapnya, lihat Storage class comparison.

File delivery directory

Direktori di bucket OSS. Nama direktori tidak boleh diawali dengan garis miring (/) atau backslash (\).

Setelah tugas pengiriman OSS dibuat, data dari Logstore akan dikirimkan ke direktori ini di bucket OSS tujuan.

Partition format

Format untuk menghasilkan subdirektori bucket OSS secara dinamis berdasarkan waktu pembuatan tugas pengiriman. Format tidak boleh diawali dengan garis miring (/). Nilai default adalah %Y/%m/%d/%H/%M. Untuk contoh, lihat Partition format. Untuk detail parameter, lihat strptime API.

OSS write RAM role

Memberikan izin kepada tugas pengiriman OSS untuk menulis data ke bucket OSS.

-

Default Role: Memberikan otorisasi kepada pekerjaan untuk menggunakan peran sistem Alibaba Cloud AliyunLogDefaultRole guna menulis data ke bucket OSS. Masukkan ARN dari AliyunLogDefaultRole. Untuk informasi tentang cara mendapatkan ARN, lihat Access data using a default role.

-

Custom Role: Memberikan otorisasi kepada pekerjaan untuk menggunakan peran kustom guna menulis data ke bucket OSS.

Anda harus terlebih dahulu memberikan izin kepada peran kustom untuk menulis data ke bucket OSS. Kemudian, masukkan ARN peran kustom tersebut di bidang OSS write RAM role. Untuk mendapatkan ARN:

-

Jika logstore dan bucket OSS berada dalam satu akun Alibaba Cloud yang sama, lihat Step 2: Grant a RAM role permissions to write data to an OSS bucket.

-

Jika logstore dan bucket OSS berada dalam akun Alibaba Cloud yang berbeda, lihat Step 2: Grant the RAM role role-b permissions to write data to an OSS bucket.

-

Shipping size

Jumlah data yang dikirimkan dari setiap shard. Nilai ini mengontrol ukuran data yang belum dikompresi dalam setiap objek OSS. Nilainya harus berupa bilangan bulat antara 5 hingga 256. Satuan: MB.

Ketika data yang akan dikirimkan dari sebuah shard mencapai ukuran ini, instans pengiriman baru akan dibuat secara otomatis.

Storage format

Format penyimpanan untuk data yang dikirimkan ke OSS. Untuk informasi selengkapnya, lihat JSON format, CSV format, dan Parquet format.

Compress

Metode kompresi untuk data yang disimpan di OSS.

-

No Compress: Data tidak dikompresi.

-

Compress(snappy): Data dikompresi menggunakan algoritma snappy. Hal ini mengurangi penggunaan penyimpanan di bucket OSS.

Shipping interval

Interval pengiriman untuk setiap shard. Nilainya harus berupa bilangan bulat antara 300 hingga 900. Nilai default: 300. Satuan: detik.

Ketika interval pengiriman untuk sebuah shard tercapai, instans pengiriman baru akan dibuat secara otomatis.

-

Lihat data di OSS

Setelah data berhasil dikirimkan ke OSS, Anda dapat mengaksesnya melalui Konsol OSS, API, SDK, atau alat lainnya. Untuk informasi selengkapnya, lihat Object management.

Jalur objek OSS memiliki format berikut:

oss://OSS-BUCKET/OSS-PREFIX/PARTITION-FORMAT_RANDOM-IDOSS-BUCKET adalah nama bucket OSS, OSS-PREFIX adalah awalan direktori, PARTITION-FORMAT adalah format partisi (dihitung dari waktu pembuatan tugas pengiriman menggunakan strptime API), dan RANDOM-ID adalah ID unik tugas pengiriman.

Direktori bucket OSS ditentukan oleh waktu pembuatan tugas pengiriman. Misalnya, tugas pengiriman dibuat pada pukul 00:00:00 tanggal 23 Juni 2016 untuk mengirimkan data yang ditulis ke Simple Log Service setelah pukul 23:55 tanggal 22 Juni 2016. Asumsikan data dikirimkan ke OSS setiap 5 menit. Jika Anda ingin menganalisis semua data untuk tanggal 22 Juni 2016, Anda harus memeriksa semua objek di direktori 2016/06/22 dan memeriksa apakah objek yang dibuat dalam 10 menit pertama di direktori 2016/06/23/00/ berisi data dari tanggal 22 Juni 2016.

Partition format

Satu tugas pengiriman berkaitan dengan direktori bucket OSS dengan format oss://OSS-BUCKET/OSS-PREFIX/PARTITION-FORMAT_RANDOM-ID. PARTITION-FORMAT berasal dari waktu pembuatan tugas pengiriman. Tabel berikut memberikan contoh untuk tugas pengiriman yang dibuat pada pukul 19:50:43 tanggal 20 Januari 2017.

|

OSS bucket |

OSS prefix |

Partition format |

OSS file path |

|

test-bucket |

test-table |

%Y/%m/%d/%H/%M |

oss://test-bucket/test-table/2017/01/20/19/50_1484913043351525351_2850008 |

|

test-bucket |

log_ship_oss_example |

year=%Y/mon=%m/day=%d/log_%H%M%S |

oss://test-bucket/log_ship_oss_example/year=2017/mon=01/day=20/log_195043_1484913043351525351_2850008.parquet |

|

test-bucket |

log_ship_oss_example |

ds=%Y%m%d/%H |

oss://test-bucket/log_ship_oss_example/ds=20170120/19_1484913043351525351_2850008.snappy |

|

test-bucket |

log_ship_oss_example |

%Y%m%d/ |

oss://test-bucket/log_ship_oss_example/20170120/_1484913043351525351_2850008 Catatan

Format ini dapat menyebabkan platform seperti Hive gagal saat mengurai konten OSS. Kami menyarankan agar Anda tidak menggunakan format ini. |

|

test-bucket |

log_ship_oss_example |

%Y%m%d%H |

oss://test-bucket/log_ship_oss_example/2017012019_1484913043351525351_2850008 |

Ketika Anda menganalisis data OSS menggunakan platform data besar seperti Hive, MaxCompute, atau Data Lake Analytics (DLA), Anda dapat menggunakan informasi partisi dengan mengatur format partisi ke format key=value. Sebagai contoh, jalur oss://test-bucket/log_ship_oss_example/year=2022/mon=01/day=20/log_195043_1484913043351525351_2850008.parquet menggunakan tiga kolom partisi: year, mon, dan day.

Operasi tambahan

Setelah membuat tugas pengiriman, Anda dapat membuka halaman OSS Shipper untuk memodifikasi tugas, menonaktifkan pengiriman, melihat status tugas dan pesan kesalahan, serta mencoba ulang tugas yang gagal.

-

Modifikasi tugas pengiriman

Klik Settings untuk memodifikasi tugas pengiriman. Untuk informasi selengkapnya tentang parameter, lihat Prosedur dalam topik ini.

-

Nonaktifkan pengiriman

Klik Disable untuk menonaktifkan tugas pengiriman.

-

Lihat status tugas dan pesan kesalahan

Simple Log Service memungkinkan Anda melihat semua tugas pengiriman dari dua hari terakhir beserta statusnya.

-

Status tugas

Status

Deskripsi

Succeeded

Tugas pengiriman berhasil diselesaikan.

Running

Tugas pengiriman sedang berlangsung. Periksa kembali statusnya nanti.

Failed

Tugas pengiriman gagal karena kesalahan yang tidak dapat diselesaikan melalui percobaan ulang otomatis. Atasi masalah berdasarkan pesan kesalahan, lalu coba ulang tugas tersebut.

-

Pesan kesalahan

Jika tugas pengiriman gagal, pesan kesalahan yang sesuai akan muncul di konsol.

Pesan kesalahan

Penyebab

Solusi

UnAuthorized

Izin yang diperlukan belum diberikan.

Verifikasi pengaturan berikut:

-

Periksa apakah pemilik bucket OSS telah membuat peran AliyunLogDefaultRole.

-

Periksa apakah ID akun Alibaba Cloud dalam isi kebijakan peran sudah benar.

-

Periksa apakah peran AliyunLogDefaultRole telah diberikan izin menulis ke bucket OSS.

-

Periksa apakah ARN peran RAM dikonfigurasi dengan benar.

ConfigNotExist

Konfigurasi tidak ada.

Kesalahan ini biasanya terjadi karena tugas pengiriman telah dinonaktifkan. Aktifkan kembali tugas tersebut, lalu coba ulang.

InvalidOssBucket

Bucket OSS tidak ada.

Verifikasi pengaturan berikut:

-

Periksa apakah bucket OSS dan proyek Simple Log Service berada di wilayah yang sama.

-

Periksa apakah nama bucket sudah dieja dengan benar.

InternalServerError

Terjadi kesalahan internal di Simple Log Service.

Coba ulang tugas tersebut.

-

-

Coba ulang tugas

Secara default, Simple Log Service secara otomatis mencoba ulang tugas yang gagal sesuai kebijakan tertentu. Anda juga dapat mencoba ulang tugas secara manual. Simple Log Service mencoba ulang semua tugas yang gagal dari dua hari terakhir. Ketika suatu tugas gagal, sistem menunggu 15 menit sebelum percobaan ulang otomatis pertama, 30 menit sebelum yang kedua, 60 menit sebelum yang ketiga, dan seterusnya.

Untuk mencoba ulang tugas yang gagal segera, klik Retry All Failed Tasks, atau klik Retry pada baris tugas yang dimaksud. Anda juga dapat mencoba ulang tugas tertentu menggunakan API atau SDK.

-