Anda dapat menggunakan Alibaba Cloud Filebeat untuk mengumpulkan log klaster Container Service for Kubernetes (ACK) dan mengirimkan log tersebut ke Alibaba Cloud Elasticsearch untuk dianalisis dan disajikan. Topik ini menjelaskan cara mengonfigurasi pengirim Filebeat untuk mengumpulkan log klaster ACK serta cara melihat sumber daya yang diterapkan di klaster ACK untuk pengirim tersebut.

Prasyarat

Sebuah klaster Elasticsearch Alibaba Cloud telah dibuat.

Untuk informasi lebih lanjut, lihat Buat Klaster Elasticsearch Alibaba Cloud.

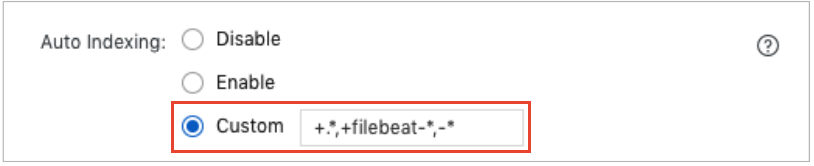

Fitur Auto Indexing diaktifkan untuk klaster Elasticsearch, dengan awalan yang disesuaikan untuk nama indeks yang akan dibuat secara otomatis berdasarkan fitur tersebut.

Untuk menghindari konflik antara alias indeks yang dihasilkan selama rollover dengan nama indeks, kami menyarankan Anda menyesuaikan awalan filebeat- untuk nama indeks. Anda dapat memasukkan +.*,+filebeat-*,-* di Bidang Kustom. Untuk informasi lebih lanjut, lihat Konfigurasikan File YML.

Penting

PentingJika Anda mengaktifkan fitur Rolling Update saat mengonfigurasi manajemen siklus hidup untuk indeks di klaster Elasticsearch Anda, Anda harus menonaktifkan fitur Auto Indexing untuk menghindari konflik antara alias indeks yang dihasilkan setelah pembaruan bergulir dengan nama indeks. Jika Anda tidak mengaktifkan fitur Rolling Update untuk indeks, Anda harus mengaktifkan fitur Auto Indexing. Kami menyarankan Anda menyesuaikan awalan untuk nama indeks.

Izin pada Beats dan klaster ACK diberikan kepada pengguna RAM.

Untuk informasi lebih lanjut, lihat Buat Kebijakan Kustom dan Berikan Izin kepada Pengguna RAM.

Sebuah klaster ACK telah dibuat, dan sebuah pod telah dibuat di dalam klaster. Dalam contoh ini, kontainer NGINX digunakan.

Untuk informasi lebih lanjut, lihat Buat Klaster ACK yang Dikelola.

Perhatian

Pengirim Filebeat Alibaba Cloud hanya mendukung kontainer Docker. Pengirim tersebut tidak mendukung kontainer seperti kontainer containerd atau kontainer sandbox. Jika Anda menggunakan kontainer selain Docker, pengirim Filebeat akan macet dalam status aktif setelah pengirim dibuat.

Pengirim Filebeat Alibaba Cloud hanya dapat diinstal pada klaster ACK khusus atau klaster ACK yang dikelola.

PentingPengirim Filebeat hanya dapat diinstal pada klaster Kubernetes versi 1.18 atau 1.20.

Prosedur

Masuk ke Konsol Elasticsearch Alibaba Cloud.

Navigasikan ke halaman Pengirim Data Beats.

Di bilah navigasi atas, pilih wilayah.

Di panel navigasi sisi kiri, klik Beats Data Shippers.

Opsional: Jika ini adalah pertama kalinya Anda mengunjungi halaman Beats Data Shippers, lihat informasi yang ditampilkan dalam pesan yang muncul dan klik OK untuk mengotorisasi sistem membuat peran layanan tertaut untuk akun Anda.

CatatanSaat Beats mengumpulkan data dari berbagai sumber data, Beats bergantung pada peran layanan tertaut dan aturan yang ditentukan untuk peran tersebut. Jangan hapus peran layanan tertaut. Jika tidak, penggunaan Beats akan terpengaruh. Untuk informasi lebih lanjut, lihat Peran Layanan Tertaut Elasticsearch.

Di bagian Create Shipper, arahkan penunjuk ke Filebeat dan klik ACK Logs.

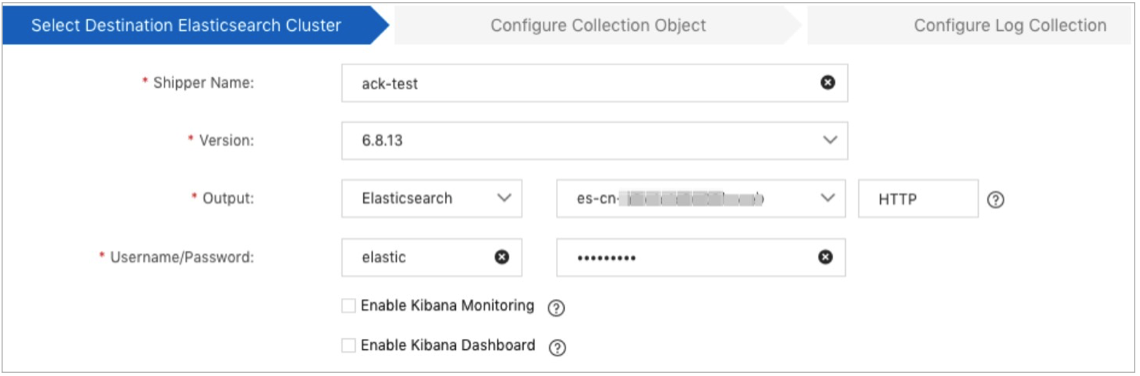

Di langkah Select Destination Elasticsearch Cluster, konfigurasikan parameter.

Parameter

Deskripsi

Shipper Name

Nama pengirim. Nama tersebut harus memiliki panjang 1 hingga 30 karakter dan dapat berisi huruf, angka, garis bawah (_), dan tanda hubung (-). Nama harus dimulai dengan huruf.

Version

Atur parameter ini ke 6.8.13, satu-satunya versi yang didukung oleh Filebeat.

Output

Tujuan untuk data yang dikumpulkan oleh pengirim. Tujuannya adalah klaster Elasticsearch yang Anda buat. Protokolnya harus sama dengan protokol klaster Elasticsearch yang dipilih.

PentingKlaster Elasticsearch V8.X tidak didukung.

Username/Password

Nama pengguna dan kata sandi yang digunakan untuk mengakses klaster Elasticsearch. Nama pengguna default adalah elastic. Kata sandi ditentukan saat Anda membuat klaster Elasticsearch. Jika Anda lupa kata sandi, Anda dapat menyetel ulang. Untuk informasi lebih lanjut tentang prosedur dan perhatian untuk menyetel ulang kata sandi, lihat Setel ulang kata sandi akses klaster Elasticsearch.

Enable Kibana Monitoring

Menentukan apakah akan memantau metrik pengirim. Jika Anda memilih Elasticsearch untuk Output, monitor Kibana menggunakan klaster Elasticsearch yang Anda konfigurasikan untuk parameter Output sebagai tujuan.

Enable Kibana Dashboard

Menentukan apakah akan mengaktifkan dasbor Kibana default. Kibana Alibaba Cloud diterapkan di virtual private cloud (VPC). Anda harus mengaktifkan fitur Akses Jaringan Pribadi untuk Kibana di halaman Konfigurasi Kibana. Untuk informasi lebih lanjut, lihat Konfigurasikan daftar putih alamat IP publik atau pribadi untuk Kibana.

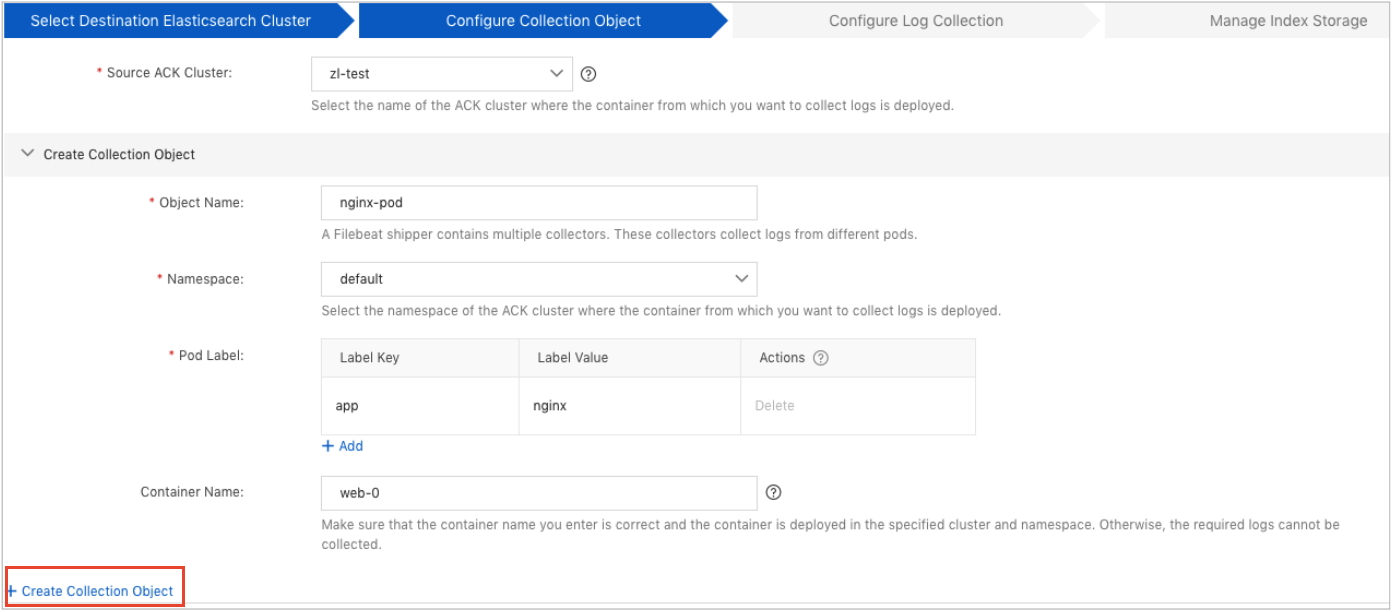

Klik Next. Di langkah Configure Collection Object, konfigurasikan objek koleksi.

Pilih klaster ACK sumber yang diinginkan dari daftar drop-down Source ACK Cluster.

PentingAnda harus memilih klaster ACK yang sedang berjalan dan berada di VPC yang sama dengan klaster Elasticsearch serta bukan klaster ACK edge. Untuk informasi lebih lanjut, lihat Apa itu ACK Edge?

Klik Install untuk menginstal ES-operator untuk klaster ACK. Beats bergantung pada ES-operator.

Jika tombol Install tidak ditampilkan, ES-operator sudah diinstal. Jika tombol Install tidak ditampilkan setelah Anda menginstal ES-operator, instalasi berhasil.

Klik Create Collection Object di pojok kiri bawah untuk mengonfigurasi objek koleksi. Anda dapat mengonfigurasi beberapa objek koleksi.

Parameter

Deskripsi

Object Name

Nama objek koleksi. Anda dapat membuat beberapa objek koleksi. Nama setiap objek koleksi harus unik.

Namespace

Namespace klaster ACK tempat pod yang ingin Anda kumpulkan lognya diterapkan. Secara default, namespace default digunakan jika Anda tidak menentukan namespace saat membuat pod.

Pod Label

Label pod. Anda dapat menentukan beberapa label. Label yang ditentukan memiliki hubungan logika DAN.

PentingAnda dapat menghapus label yang Anda tentukan hanya jika setidaknya dua label ditentukan.

Anda hanya dapat menentukan label yang didefinisikan untuk pod. Jika Anda menentukan label yang didefinisikan untuk objek lain seperti Deployment, pengirim gagal dibuat.

Container Name

Nama lengkap kontainer. Jika Anda membiarkan parameter ini kosong, pengirim mengumpulkan log dari semua kontainer di namespace yang sesuai dengan label yang ditambahkan ke pod.

CatatanUntuk informasi lebih lanjut tentang cara mendapatkan konfigurasi pod, seperti namespace, label, dan nama, lihat Kelola Pod.

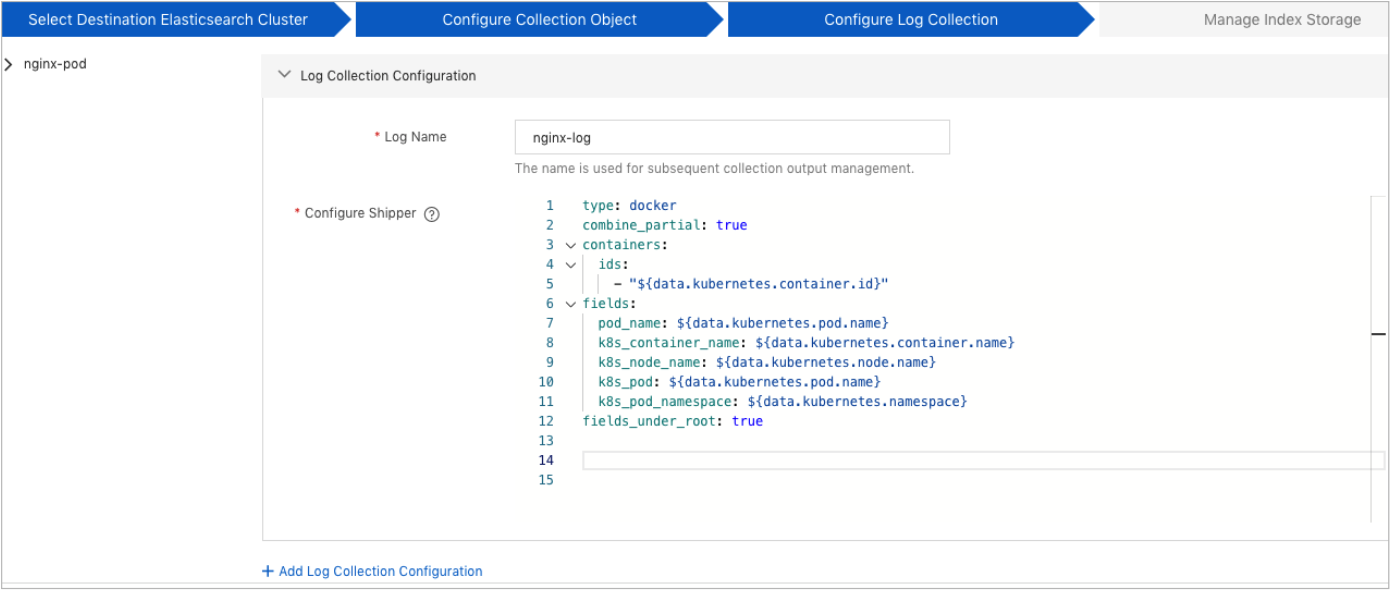

Klik Next. Di langkah Configure Log Collection, klik Add Log Collection Configuration di pojok kiri bawah untuk mengonfigurasi informasi pengumpulan log. Anda dapat menentukan beberapa kontainer dari mana Anda ingin mengumpulkan log.

Parameter

Deskripsi

Log Name

Anda dapat menentukan beberapa kontainer untuk setiap pod. Setiap kontainer sesuai dengan nama log. Setiap nama log harus unik. Nama log dapat menjadi bagian dari nama indeks dan digunakan untuk output koleksi berikutnya.

Configure Shipper

Template umum untuk mengumpulkan log dari kontainer Docker digunakan. Penyedia Autodiscover diintegrasikan ke dalam konfigurasi pengumpulan log. Konfigurasi pengumpulan mendukung Input Docker.

type: jenis input. Jika Anda ingin mengumpulkan log dari kontainer, nilai parameter ini adalah docker. Nilai parameter ini bervariasi berdasarkan jenis input. Untuk informasi lebih lanjut, lihat Konfigurasikan input.

combine_partial: menentukan apakah akan mengaktifkan penggabungan pesan parsial. Untuk informasi lebih lanjut, lihat Input Docker (combine_partial).

container ids: ID kontainer Docker dari mana Anda ingin mengumpulkan log. Untuk informasi lebih lanjut, lihat Input Docker (containers.ids).

fields.k8s_container_name: Tambahkan bidang k8s_container_name ke informasi keluaran pengirim untuk merujuk variabel ${data.kubernetes.container.name}.

CatatanPenyedia Autodiscover diintegrasikan ke dalam konfigurasi kontainer Docker. Anda dapat merujuk konfigurasi penyedia Autodiscover untuk mengonfigurasi kontainer Docker.

fileds.k8s_node_name: Tambahkan bidang k8s_node_name ke informasi keluaran pengirim untuk merujuk variabel ${data.kubernetes.node.name}.

fileds.k8s_pod: Tambahkan bidang k8s_pod ke informasi keluaran pengirim untuk merujuk variabel ${data.kubernetes.pod.name}.

fileds.k8s_pod_namespace: Tambahkan bidang k8s_pod_namespace ke informasi keluaran pengirim untuk merujuk variabel ${data.kubernetes.namespace}.

fields_under_root: Jika Anda mengatur parameter ini ke true, bidang-bidang tersebut disimpan sebagai bidang tingkat atas dalam dokumen keluaran. Untuk informasi lebih lanjut, lihat Input Docker (fields_under_root).

CatatanJika template umum tidak dapat memenuhi kebutuhan Anda, Anda dapat memodifikasi konfigurasi. Untuk informasi lebih lanjut, lihat Input Docker Filebeat.

Anda hanya dapat mengonfigurasi satu kontainer Docker dalam setiap konfigurasi koleksi. Jika Anda ingin mengonfigurasi beberapa kontainer Docker, klik Add Log Collection Configuration untuk melakukan operasi tersebut.

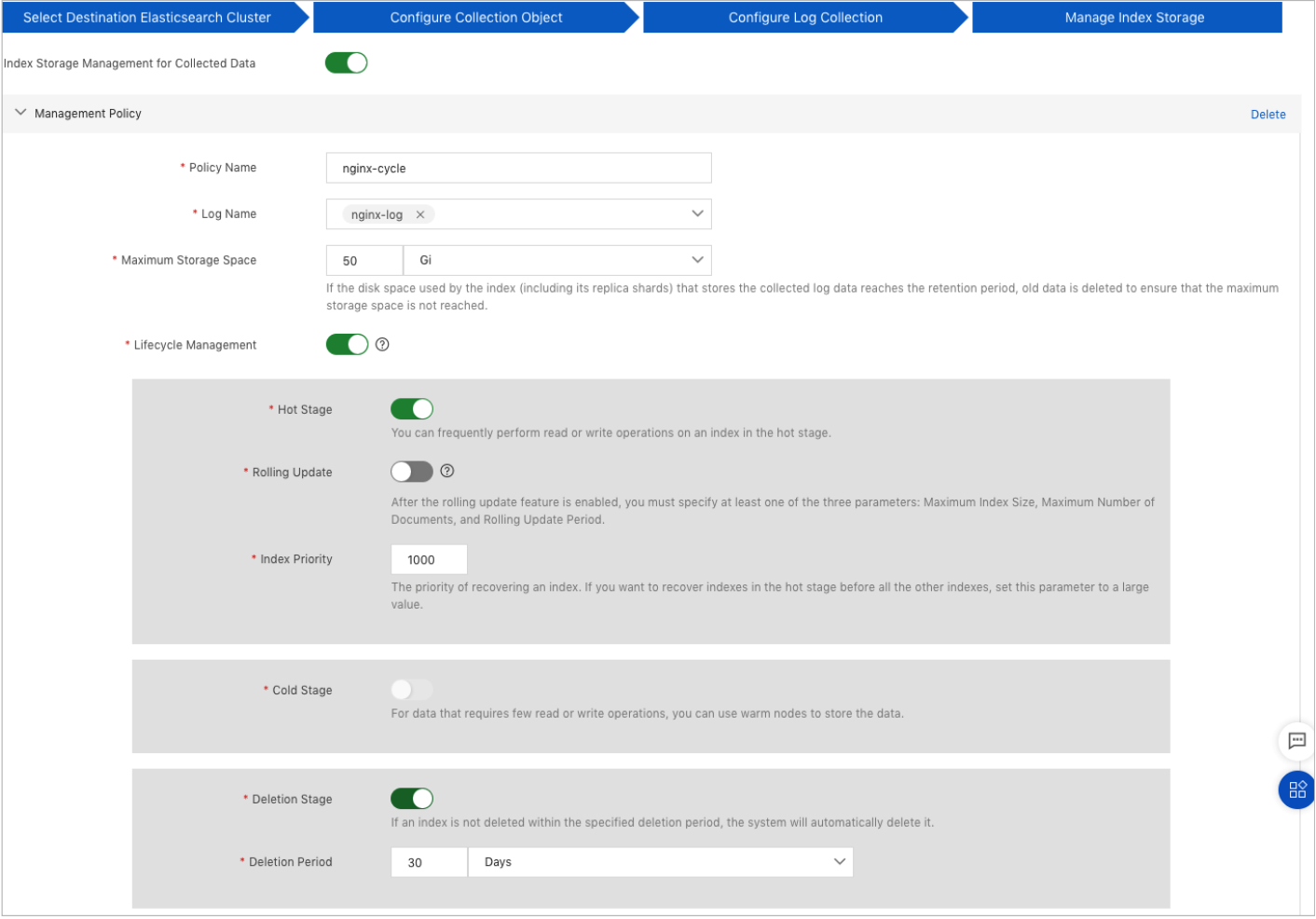

(Opsional) Klik Next. Di langkah Manage Index Storage, aktifkan dan konfigurasikan fitur Manajemen Penyimpanan Indeks untuk Data Terkumpul berdasarkan kebutuhan bisnis Anda.

Setelah Anda mengaktifkan fitur Manajemen Penyimpanan Indeks untuk Data Terkumpul, klik Add Management Policy untuk membuat dan mengonfigurasi kebijakan manajemen indeks. Anda dapat mengonfigurasi beberapa kebijakan manajemen indeks. Untuk membuat dan mengonfigurasi kebijakan manajemen indeks, konfigurasikan parameter berikut.

Parameter

Deskripsi

Policy Name

Nama kebijakan. Anda dapat menyesuaikan nama.

Log Name

Nama file log yang ingin Anda asosiasikan dengan kebijakan. Anda harus memilih setidaknya satu nama. Beberapa file log dapat diasosiasikan dengan kebijakan yang sama, tetapi setiap file log hanya dapat diasosiasikan dengan satu kebijakan.

Maximum Storage Space

Jika ruang disk yang dikonsumsi oleh indeks (termasuk shard replika dari indeks) mencapai nilai parameter ini, sistem akan menghapus data lama untuk menghemat ruang disk.

Lifecycle Management

Menentukan apakah akan mengaktifkan manajemen siklus hidup untuk indeks. Setelah Anda mengaktifkan Manajemen Siklus Hidup, sistem memisahkan data panas dari data dingin untuk node data dan secara otomatis menghapus data lama.

PentingJika Anda mengaktifkan Rolling Update, pengirim menulis data ke indeks yang namanya dalam format <Nama Log>-<Tanggal>-<Nomor Seri>, seperti log-web-2021.01.22-000001.

Jika Anda tidak mengaktifkan Rolling Update, pengirim menulis data ke indeks yang namanya dalam format filebeat-<Nama Log>-<Tanggal>.

Klik Enable.

Setelah pengirim diaktifkan, Anda dapat melihat informasi tentang pengirim di bagian Kelola Pengirim. Anda juga dapat melakukan operasi yang disediakan dalam tabel berikut.

CatatanSecara default, sumber daya untuk pengirim diterapkan di namespace logging klaster ACK. Setelah sumber daya diterapkan, Anda dapat mengakses klaster ACK untuk melihat sumber daya tersebut, seperti kontainer untuk manajemen indeks dan kebijakan pembaruan bergulir untuk siklus hidup indeks. Untuk informasi lebih lanjut, lihat Lihat Sumber Daya yang Diterapkan di Klaster ACK untuk Pengirim.

Operasi

Deskripsi

View Configuration

Lihat informasi seperti klaster Elasticsearch tujuan, klaster ACK sumber, dan nama tugas pengumpulan log pengirim. Anda tidak dapat memodifikasi informasi tersebut.

Modify Configuration

Modifikasi objek koleksi, konfigurasi pengumpulan log, dan kebijakan manajemen penyimpanan indeks.

More

Aktifkan, nonaktifkan, mulai ulang, atau hapus tugas pengumpulan log, serta lihat informasi tentang tugas tersebut di dasbor dan helm chart.

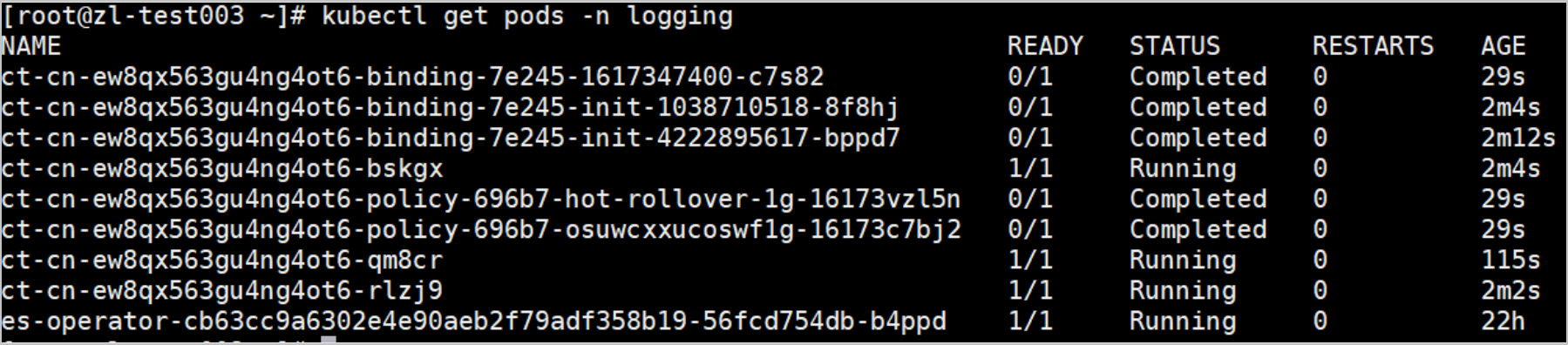

Lihat sumber daya yang diterapkan di klaster ACK untuk pengirim

Jalankan perintah berikut, gunakan kubectl untuk terhubung ke klaster ACK, dan lihat sumber daya untuk pengirim di namespace logging. Untuk informasi lebih lanjut, lihat Dapatkan File kubeconfig Klaster dan Gunakan kubectl untuk Terhubung ke Klaster.

kubectl get pods -n logging

Anda tidak diizinkan menghapus sumber daya yang diterapkan di namespace logging atau melakukan operasi lain pada sumber daya tersebut. Jika Anda melakukan operasi pada sumber daya tersebut, pengirim tidak dapat berjalan sesuai harapan.

Nama Pod | Deskripsi | Contoh |

Nama Klaster-binding-Nomor Seri | Kontainer yang digunakan untuk mengelola indeks, seperti kontainer yang digunakan untuk menghapus data lama secara berkala. | ct-cn-ew8qx563gu4ng4ot6-binding-7e245-1617347400-c**** |

Nama Klaster-policy-Nomor Seri | Kebijakan untuk pembaruan bergulir pada indeks. | ct-cn-ew8qx563gu4ng4ot6-policy-696b7-hot-rollover-1g-16173v**** |

Nama Klaster-Nomor Seri | Kontainer tempat pengirim diinstal. | ct-cn-ew8qx563gu4ng4ot6-q**** |

es-operator-Nomor Seri | Kontainer tempat ES-operator diinstal. | es-operator-cb63cc9a6302e4e90aeb2f79adf358b19-56fcd754db-b**** |