E-MapReduce (EMR) memungkinkan Anda untuk menambahkan, memodifikasi, dan melihat item konfigurasi layanan seperti Hadoop Distributed File System (HDFS), YARN, dan Spark di Konsol EMR. Topik ini menjelaskan cara mengelola item konfigurasi pada tingkat kluster, grup node, dan node.

Prasyarat

Kluster EMR telah dibuat. Untuk informasi lebih lanjut, lihat Buat Kluster.

Melihat item konfigurasi

Masuk ke Konsol EMR. Di panel navigasi kiri, klik EMR on ECS.

Di bilah navigasi atas, pilih wilayah dan grup sumber daya sesuai dengan kebutuhan bisnis Anda.

Di halaman EMR on ECS, cari kluster yang diinginkan dan klik Services pada kolom Aksi.

Di tab Layanan, cari layanan yang diinginkan dan klik Configure.

Masukkan nama item konfigurasi di kotak pencarian.

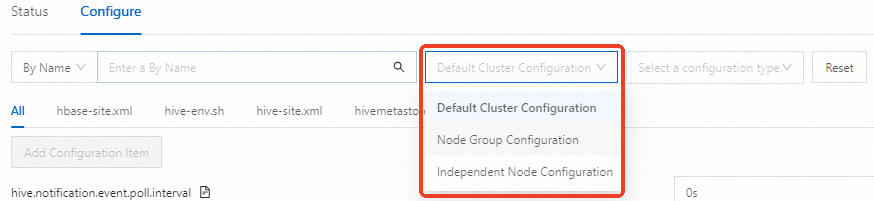

Jika item konfigurasi pada tingkat grup node atau node dimodifikasi, atau pengaturannya tidak konsisten dengan pengaturan default tingkat kluster, pengaturan tersebut akan ditampilkan di tab Konfigurasi dengan Default Cluster Configuration dipilih.

Anda harus memilih grup node atau node tertentu untuk melihat nilai item konfigurasi pada tingkat grup node atau node.

Nilai item konfigurasi dapat ditimpa berdasarkan prioritas tingkat berikut: node > grup node > kluster.

Secara default, tab Configure menampilkan item konfigurasi tingkat kluster default. Pada tab Configure dengan Default Cluster Configuration dipilih, item konfigurasi pada tingkat grup node atau node hanya dapat dilihat. Untuk memodifikasi item konfigurasi pada tingkat grup node atau node, pilih Node Group Configuration atau Independent Node Configuration dari daftar drop-down Default Cluster Configuration, modifikasi item konfigurasi, lalu simpan konfigurasinya. Untuk informasi lebih lanjut, lihat Item Konfigurasi yang Dapat Dimodifikasi.

Memodifikasi item konfigurasi

Buka tab Konfigurasi Layanan.

Masuk ke Konsol EMR. Di panel navigasi kiri, klik EMR on ECS.

Di bilah navigasi atas, pilih wilayah dan pilih grup sumber daya sesuai dengan kebutuhan bisnis Anda.

Di halaman EMR pada ECS, temukan kluster yang diinginkan dan klik Services di kolom Aksi.

Pada tab Layanan, cari layanan yang diinginkan dan klik Configure.

Ubah item konfigurasi.

Di kotak pencarian, masukkan nama item konfigurasi yang ingin dimodifikasi, lalu klik ikon pencarian.

Ubah nilai item konfigurasi.

Simpan konfigurasi.

Pada tab Configure, klik Save.

Dalam kotak dialog Save, atur parameter Execution Reason dan klik Save.

CatatanDi kotak dialog Save , saklar Save and Deliver Configuration diaktifkan secara default. Setelah menyimpan konfigurasi, konfigurasi juga dikirim ke klien. Anda dapat membuat konfigurasi berlaku dalam mode manual. Jika Anda mematikan Save and Deliver Configuration di kotak dialog Save, Anda dapat membuat konfigurasi berlaku dalam mode prompt.

Terapkan konfigurasi.

Untuk memungkinkan modifikasi berlaku, lakukan operasi berikut berdasarkan jenis item konfigurasi yang dimodifikasi:

Mode Prompt

CatatanMode ini hanya tersedia untuk EMR V5.12.1, EMR V3.46.1, atau versi minor setelah EMR V5.12.1 atau EMR V3.46.1.

Konfigurasi Sisi Klien

Setelah menyimpan konfigurasi, prompt

muncul.

muncul.Klik prompt To Be Delivered.

Dalam pesan Konfigurasi yang Akan Dikirim, klik Deliver.

CatatanUntuk layanan YARN, jika item konfigurasi yang dimodifikasi mencakup item terkait antrian, Anda perlu mengklik prompt

atau klik Deploy di tab Edit Antrian Sumber Daya halaman layanan YARN untuk membuat modifikasi berlaku setelah menyimpan dan mengirim modifikasi.

atau klik Deploy di tab Edit Antrian Sumber Daya halaman layanan YARN untuk membuat modifikasi berlaku setelah menyimpan dan mengirim modifikasi.

Konfigurasi Sisi Server

Setelah menyimpan konfigurasi, prompt

muncul.

muncul.Klik prompt Not Effective Yet.

Di kotak dialog Konfigurasi yang Harus Berlaku, konfigurasikan pengaturan berdasarkan mode di mana Anda dapat membuat konfigurasi berlaku.

Configurations That Require Custom Operations

Secara manual klik item di kolom Aksi yang sesuai dengan komponen untuk membuat konfigurasi berlaku.

Configurations That Require Restart

Klik restart di kolom Aksi yang sesuai dengan komponen. Atau, pilih beberapa komponen dan klik Batch Restart.

Di kotak dialog yang muncul, konfigurasikan parameter Execution Reason dan klik OK.

Mode Manual

Konfigurasi Sisi Klien

Klik Deploy Client Configuration di sebelah tombol Save di bagian bawah halaman.

Di kotak dialog yang muncul, konfigurasikan parameter Execution Reason dan klik OK.

Di Pesan Confirm, klik OK.

Konfigurasi Sisi Server

Pilih di sudut kanan atas tab Configure.

Di kotak dialog yang muncul, konfigurasikan parameter Execution Reason dan klik OK.

Di Pesan Confirm, klik OK.

Menambahkan item konfigurasi

Buka tab Konfigurasi Layanan.

Masuk ke Konsol EMR. Di panel navigasi kiri, klik EMR on ECS.

Di bilah navigasi atas, pilih wilayah dan grup sumber daya sesuai dengan kebutuhan bisnis Anda.

Di halaman EMR pada ECS, temukan kluster yang diinginkan dan klik Services di kolom Aksi.

Di tab Layanan, cari layanan yang diinginkan dan klik Configure.

Tambahkan item konfigurasi.

Klik tab tempat Anda ingin menambahkan item konfigurasi.

Klik Add Configuration Item.

Tambahkan item konfigurasi sesuai dengan kebutuhan bisnis Anda.

Anda dapat menambahkan beberapa item konfigurasi sekaligus.

Item

Deskripsi

Key

Nama item konfigurasi.

Value

Nilai item konfigurasi.

Description

Deskripsi item konfigurasi.

Actions

Anda dapat menghapus item konfigurasi.

Klik OK.

Di kotak dialog yang muncul, konfigurasikan parameter Execution Reason, lalu klik Save.

Terapkan konfigurasi yang telah dibuat.

Untuk memungkinkan modifikasi berlaku, lakukan operasi berikut berdasarkan jenis item konfigurasi yang dimodifikasi:

Mode Prompt

CatatanMode ini hanya tersedia untuk EMR V5.12.1, EMR V3.46.1, atau versi minor setelah EMR V5.12.1 atau EMR V3.46.1.

Konfigurasi Sisi Klien

Setelah menyimpan konfigurasi, prompt

muncul.

muncul.Klik prompt To Be Delivered.

Dalam pesan Konfigurasi yang Akan Dikirim, klik Deliver.

CatatanUntuk layanan YARN, jika item konfigurasi yang dimodifikasi mencakup item terkait antrian, Anda perlu mengklik prompt

atau klik Deploy di tab Edit Antrian Sumber Daya halaman layanan YARN untuk membuat modifikasi berlaku setelah menyimpan dan mengirim modifikasi.

atau klik Deploy di tab Edit Antrian Sumber Daya halaman layanan YARN untuk membuat modifikasi berlaku setelah menyimpan dan mengirim modifikasi.

Konfigurasi Sisi Server

Setelah menyimpan konfigurasi, prompt

muncul.

muncul.Klik prompt Not Effective Yet.

Di kotak dialog Konfigurasi yang Harus Berlaku, konfigurasikan pengaturan berdasarkan mode di mana Anda dapat membuat konfigurasi berlaku.

Configurations That Require Custom Operations

Secara manual klik item di kolom Aksi yang sesuai dengan komponen untuk membuat konfigurasi berlaku.

Configurations That Require Restart

Klik restart di kolom Aksi yang sesuai dengan komponen. Atau, pilih beberapa komponen dan klik Batch Restart.

Di kotak dialog yang muncul, konfigurasikan parameter Execution Reason dan klik OK.

Mode Manual

Konfigurasi Sisi Klien

Klik Deploy Client Configuration di sebelah Save di bagian bawah halaman.

Di kotak dialog yang muncul, konfigurasikan parameter Execution Reason dan klik OK.

Di Pesan Confirm, klik OK.

Konfigurasi Sisi Server

Pilih di sudut kanan atas tab Configure.

Di kotak dialog yang muncul, konfigurasikan parameter Execution Reason dan klik OK.

Di Pesan Confirm, klik OK.

Item konfigurasi yang dapat dimodifikasi

Tabel berikut menjelaskan item konfigurasi yang dapat dimodifikasi pada tingkat node dan grup node, atau pada tingkat node atau grup node di kluster EMR V5.17.1.

Item konfigurasi terkait Kerberos hanya tersedia jika otentikasi Kerberos diaktifkan.

Nama layanan | File | Item konfigurasi |

Hadoop-Common | core-site.xml | fs.oss.tmp.data.dirs hadoop.tmp.dir |

HDFS | hdfs-env.sh | hadoop_datanode_heapsize hadoop_secondarynamenode_opts hadoop_namenode_heapsize |

hdfs-site.xml | dfs.datanode.data.dir dfs.datanode.failed.volumes.tolerated dfs.datanode.du.reserved dfs.datanode.balance.max.concurrent.moves | |

OSS-HDFS | Tidak ada | Tidak ada |

Hive | hive-env.sh | hive_metastore_heapsize hive_server2_heapsize |

Spark2 | hiveserver2-site.xml | hive.server2.authentication.kerberos.principal |

spark-env.sh | spark_history_daemon_memory spark_thrift_daemon_memory | |

spark-thriftserver.conf | spark.yarn.historyServer.address spark.hadoop.hive.server2.thrift.bind.host spark.yarn.principal | |

spark-defaults.conf | spark.yarn.historyServer.address spark.history.kerberos.principal | |

Spark3 | hiveserver2-site.xml | hive.server2.authentication.kerberos.principal |

spark-env.sh | spark_history_daemon_memory spark_thrift_daemon_memory | |

spark-thriftserver.conf | spark.yarn.historyServer.address spark.hadoop.hive.server2.thrift.bind.host spark.kerberos.principal | |

spark-defaults.conf | spark.yarn.historyServer.address spark.history.kerberos.principal | |

Tez | Tidak ada | Tidak ada |

Trino | iceberg.properties | hive.hdfs.trino.principal hive.metastore.client.principal |

delta.properties | hive.hdfs.trino.principal hive.metastore.client.principal | |

config.properties | coordinator node-scheduler.include-coordinator query.max-memory query.max-total-memory query.max-memory-per-node http-server.authentication.type http-server.authentication.krb5.user-mapping.pattern http-server.authentication.krb5.service-name http-server.authentication.krb5.keytab http.authentication.krb5.config http-server.https.enabled http-server.https.port http-server.https.keystore.key http-server.https.keystore.path event-listener.config-files Catatan event-listener.config-files menentukan jalur tempat file konfigurasi listener acara disimpan. Item konfigurasi ini hanya tersedia jika Anda mengaktifkan EmrEventListener. | |

jvm.config | parameter jvm | |

hudi.properties | hive.hdfs.trino.principal hive.metastore.client.principal | |

password-authenticator.properties | ldap.url ldap.user-bind-pattern | |

hive.properties | hive.hdfs.trino.principal hive.metastore.client.principal | |

DeltaLake | Tidak ada | Tidak ada |

Hudi | Tidak ada | Tidak ada |

Iceberg | Tidak ada | Tidak ada |

JindoData | storage.yaml | jindofsx.storage.cache-mode storage.watermark.high.ratio storage.watermark.low.ratio storage.handler.threads Catatan

|

Flume | flume-conf.properties | agent_name flume-conf.properties |

Kyuubi | kyuubi-env.sh | kyuubi_java_opts |

YARN | yarn-site.xml | yarn.nodemanager.resource.memory-mb yarn.nodemanager.local-dirs yarn.nodemanager.log-dirs yarn.nodemanager.resource.cpu-vcores yarn.nodemanager.address yarn.nodemanager.node-labels.provider.configured-node-partition |

yarn-env.sh | YARN_RESOURCEMANAGER_HEAPSIZE YARN_TIMELINESERVER_HEAPSIZE YARN_PROXYSERVER_HEAPSIZE YARN_NODEMANAGER_HEAPSIZE YARN_RESOURCEMANAGER_HEAPSIZE_MIN YARN_TIMELINESERVER_HEAPSIZE_MIN YARN_PROXYSERVER_HEAPSIZE_MIN YARN_NODEMANAGER_HEAPSIZE_MIN | |

mapred-env.sh | HADOOP_JOB_HISTORYSERVER_HEAPSIZE | |

mapred-site.xml | mapreduce.cluster.local.dir | |

Impala | Tidak ada | Tidak ada |

OpenLDAP | Tidak ada | Tidak ada |

Ranger | Tidak ada | Tidak ada |

Ranger-Plugin | Tidak ada | Tidak ada |

DLF-Auth | Tidak ada | Tidak ada |

Presto | iceberg.properties | hive.hdfs.presto.principal hive.metastore.client.principal |

delta.properties | hive.hdfs.presto.principal hive.metastore.client.principal | |

hive.properties | hive.hdfs.presto.principal hive.metastore.client.principal | |

config.properties | coordinator node-scheduler.include-coordinator query.max-memory-per-node query.max-total-memory-per-node http-server.authentication.type http.authentication.krb5.principal-hostname http.server.authentication.krb5.service-name http.server.authentication.krb5.keytab http.authentication.krb5.config http-server.https.enabled http-server.https.port http-server.https.keystore.key http-server.https.keystore.path | |

jvm.config | parameter jvm | |

hudi.properties | hive.hdfs.presto.principal hive.metastore.client.principal | |

password-authenticator.properties | ldap.url ldap.user-bind-pattern | |

Starrocks2 | fe.conf | JAVA_OPTS meta_dir |

be.conf | storage_root_path JAVA_OPTS | |

Starrocks3 | fe.conf | JAVA_OPTS meta_dir |

be.conf | storage_root_path JAVA_OPTS | |

Doris | fe.conf | JAVA_OPTS JAVA_OPTS_FOR_JDK_9 meta_dir |

be.conf | storage_root_path | |

ClickHouse | server-config | interserver_http_host |

server-metrika | macros.shard macros.replica | |

Zookeeper | Tidak ada | Tidak ada |

Sqoop | Tidak ada | Tidak ada |

Knox | Tidak ada | Tidak ada |

Celeborn | celeborn-env.sh | CELEBORN_WORKER_MEMORY CELEBORN_WORKER_OFFHEAP_MEMORY CELEBORN_MASTER_MEMORY |

celeborn-defaults.conf | celeborn.worker.storage.dirs celeborn.worker.flusher.threads | |

Flink | flink-conf.yaml | security.kerberos.login.principal security.kerberos.login.keytab |

HBase | hbase-env.sh | hbase_master_opts hbase_thrift_opts hbase_rest_opts hbase_regionserver_opts |

hbase-site.xml | hbase.regionserver.handler.count hbase.regionserver.global.memstore.size hbase.regionserver.global.memstore.lowerLimit hbase.regionserver.thread.compaction.throttle hbase.regionserver.thread.compaction.large hbase.regionserver.thread.compaction.small | |

HBASE-HDFS | hdfs-env.sh | hadoop_secondarynamenode_opts hadoop_namenode_heapsize hadoop_datanode_heapsize |

hdfs-site.xml | dfs.datanode.data.dir dfs.datanode.failed.volumes.tolerated dfs.datanode.du.reserved dfs.datanode.balance.max.concurrent.moves | |

JindoCache | Tidak ada | Tidak ada |

Kafka | server.properties | broker.id num.network.threads num.io.threads kafka.heap.opts log.dirs kafka.public-access.ip listeners advertised.listeners Catatan

|

kafka-internal-config | broker_id | |

user_params | is_local_disk_instance | |

Kudu | master.gflags | fs_data_dirs fs_wal_dir fs_metadata_dir log_dir |

tserver.gflags | fs_data_dirs fs_wal_dir fs_metadata_dir log_dir | |

Paimon | Tidak ada | Tidak ada |

Phoenix | Tidak ada | Tidak ada |