Terapkan model langsung dari Hugging Face tanpa perlu mengunduhnya secara manual.

Prasyarat

Sebelum memulai, pastikan Anda telah menyiapkan hal berikut:

Hugging Face Model ID: Identifier unik untuk model yang ingin Anda terapkan.

Hugging Face Access Token: (Opsional) Diperlukan hanya jika model bersifat privat atau gated.

Langkah 1: Tentukan Informasi Model

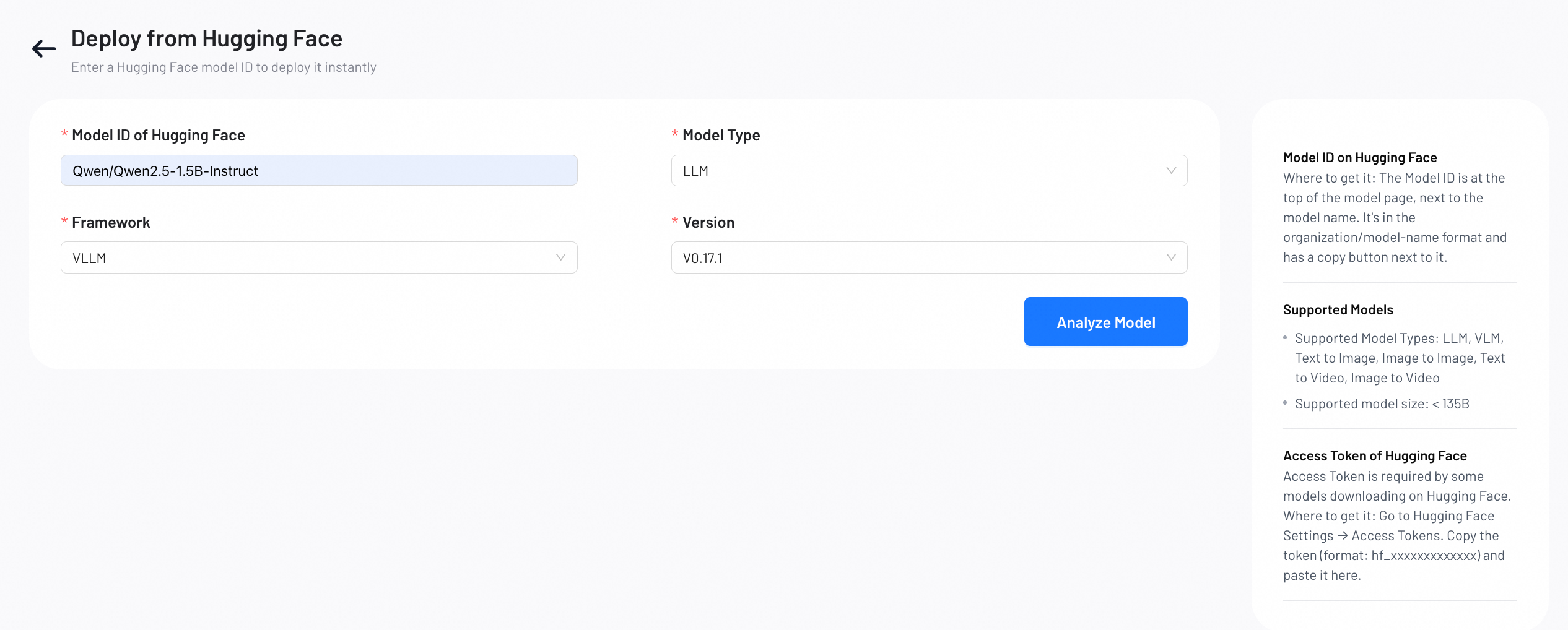

Model ID: Masukkan Hugging Face Model ID.

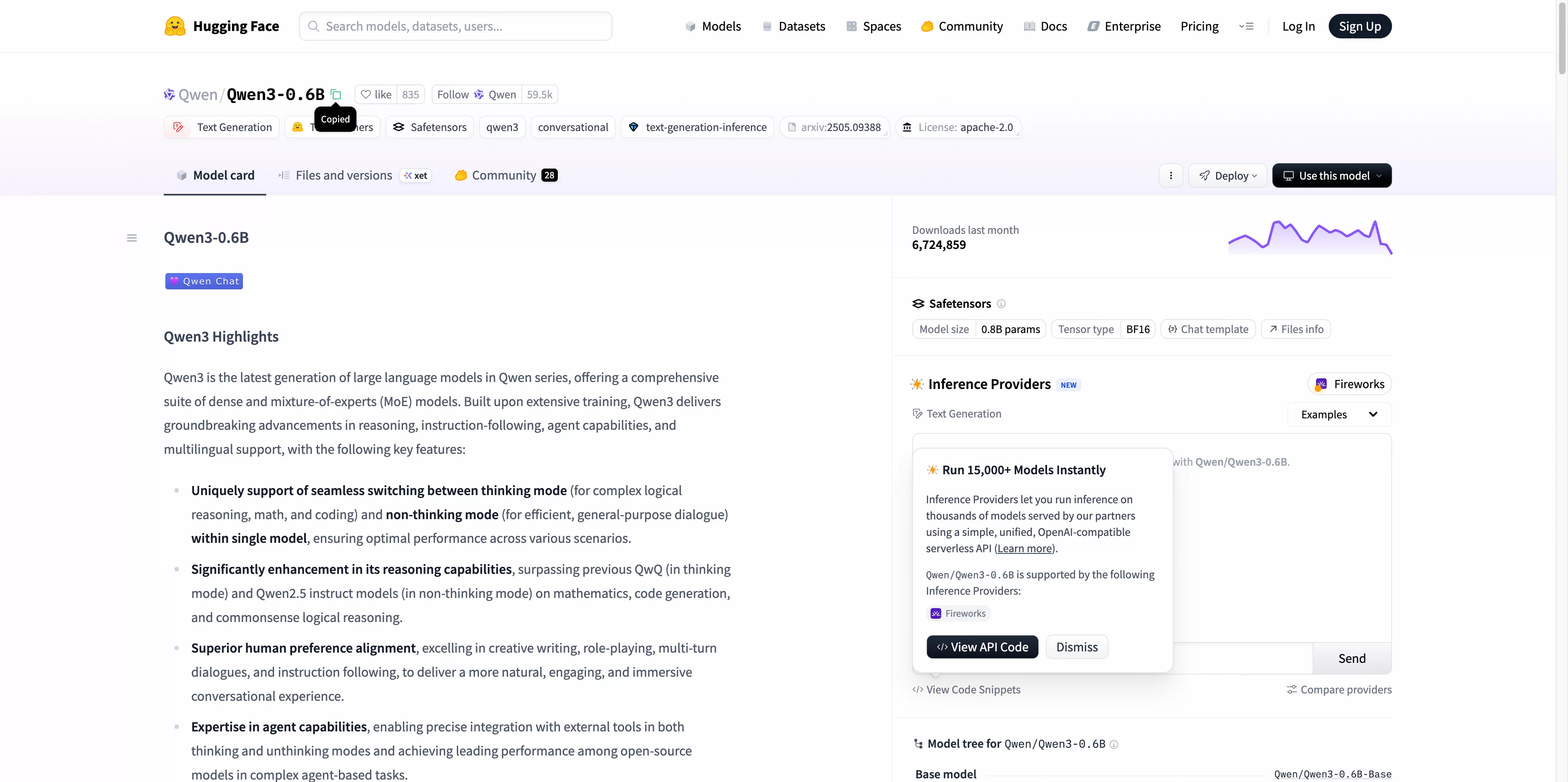

Jelajahi model di Hugging Face Model Hub.

Klik model yang ingin Anda gunakan.

Salin nama repositori dari URL halaman—formatnya: org-or-username/model-name.

Type: Pilih

LLM,VLM,Text-to-Image,Image-to-Image,Text-to-Video, atauImage-to-Video.Framework: Pilih framework inferensi (misalnya,

vLLM,SGLang).Version: Pilih versi framework.

Access Token (Opsional): Jika model bersifat privat, tempel token akses Anda di sini.

Setelah selesai, klik Analyze Model untuk melanjutkan.

Setelah selesai, klik Analyze Model untuk melanjutkan.

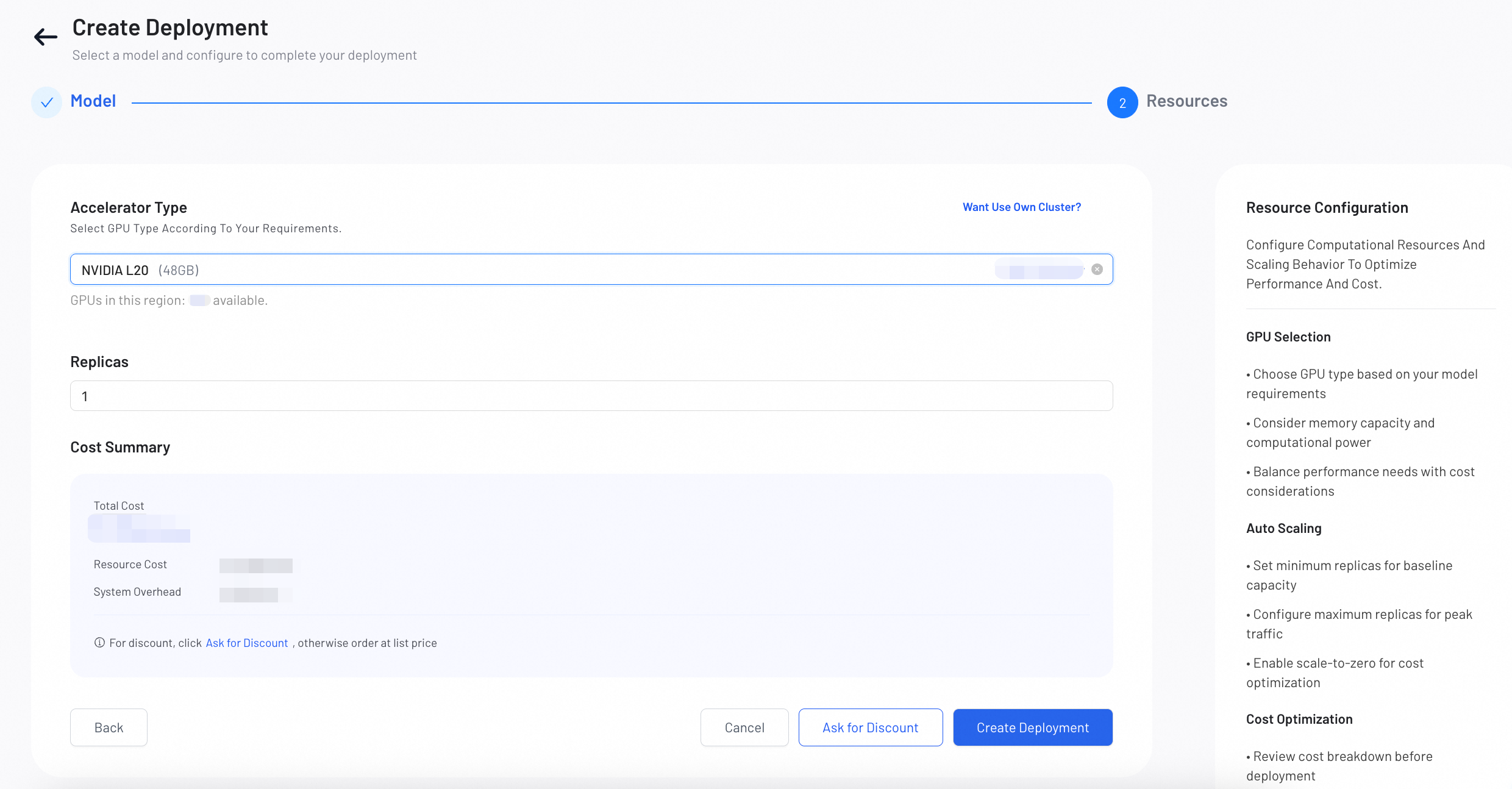

Langkah 2: Konfigurasikan dan Tinjau Penerapan

Tinjau informasi model dan konfigurasikan pengaturan penerapan Anda.

Display Name: Berikan nama deskriptif untuk penerapan Anda.

GPU Type: Pilih jenis GPU yang sesuai untuk model Anda.

Catatan: Jenis GPU yang tersedia dan stoknya dapat berbeda tergantung wilayah. Jika GPU tidak tersedia di wilayah Anda, Anda dapat menghubungi kami untuk bantuan.

Deploy Command: Perintah yang digunakan untuk menjalankan layanan model Anda.

Cara mengonfigurasi:

Lihat dokumentasi gambar kontainer Anda untuk mengetahui perintah startup yang diperlukan.

Untuk gambar Hugging Face Text Generation Inference, contoh umumnya adalah: text-generation-launcher --model-id <model-id> --port 8080Ganti <model-id> dengan ID repositori model Hugging Face Anda.Container Image: Gambar Docker atau OCI yang berisi seluruh lingkungan runtime untuk menerapkan model Anda. Anda dapat memilih dari opsi berikut:

Recommended Image: Gambar yang telah dioptimalkan oleh platform dan dipilih secara otomatis berdasarkan model dan framework Anda. Direkomendasikan untuk sebagian besar pengguna.

Hugging Face Image: Gambar inferensi resmi dari Hugging Face Container Registry (ghcr.io). Untuk detail lebih lanjut, lihat dokumentasi.

Contoh: ghcr.io/huggingface/text-generation-inference:latest

Custom Image: Anda dapat menggunakan gambar buatan sendiri selama memenuhi persyaratan runtime model.

Replicas: Jumlah instans model yang akan dijalankan. Semakin banyak replicas, semakin baik load balancing dan ketersediaannya.

Tinjau dan Terapkan

Rincian Biaya

Biaya Komputasi GPU

Overhead Sistem (saat ini $0)

Catatan: Biaya unduh dan penyimpanan model tidak termasuk dalam Rincian Biaya.

Untuk meminta diskon, klik "Ask for Discount." Jika tidak, harga daftar akan berlaku.

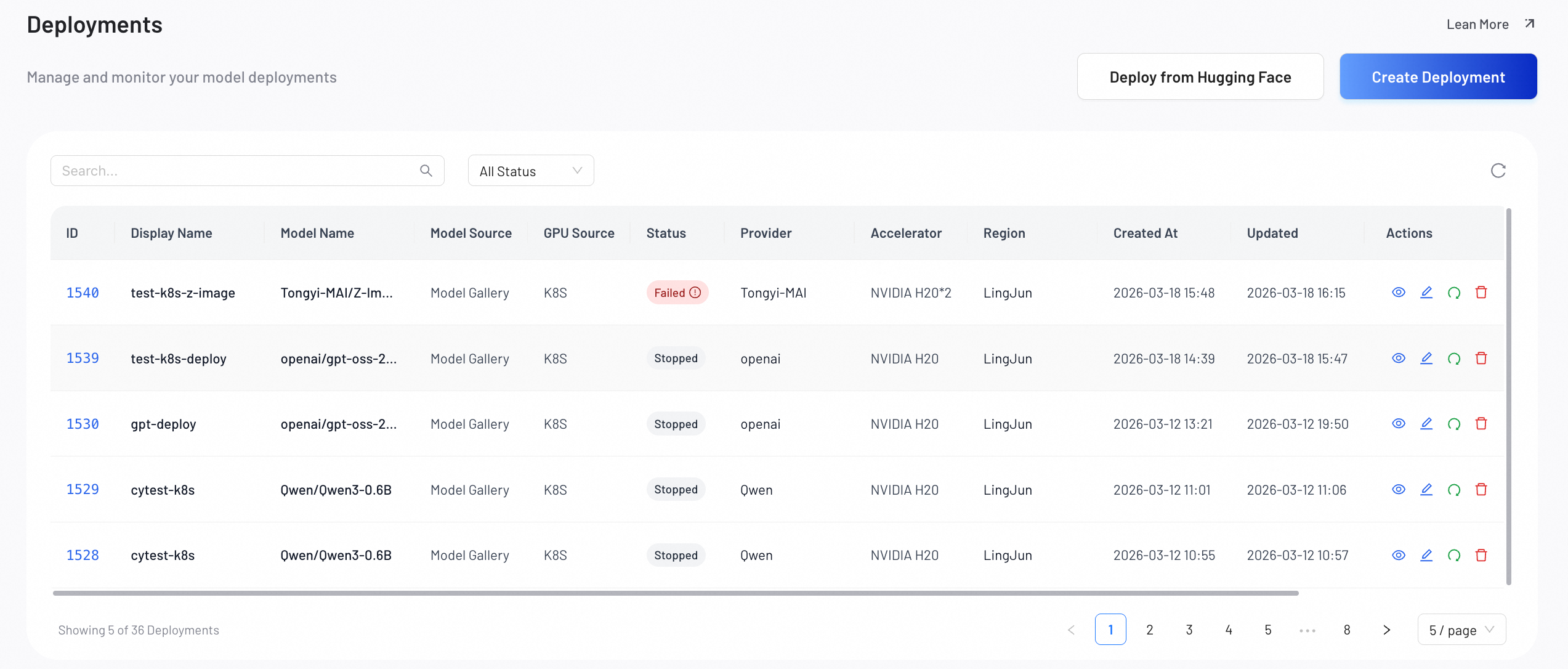

Langkah 3: Pantau Status dan Pemecahan Masalah

Setelah penerapan, bagian ini memandu Anda dalam memeriksa status penerapan dan memecahkan masalah jika layanan mengalami kendala.

Memahami Status Penerapan

Berikut adalah status yang mungkin dialami penerapan Anda:

Downloading: Sistem sedang mengunduh file model dari sumbernya.

Deploying: Sistem sedang menyediakan GPU, menjalankan kontainer, dan mengeksekusi perintah deploy.

Ready: Layanan Anda sudah aktif, sehat, dan siap menerima permintaan inferensi.

Failed: Penerapan mengalami error dan tidak dapat dimulai.

Stopping: Layanan sedang dalam proses dimatikan dan melepaskan sumber dayanya.

Stopped: Layanan tidak aktif dan tidak mengonsumsi sumber daya GPU apa pun.

Pemecahan Masalah

1. Error 404: Model Hugging Face Tidak Ditemukan

Hugging Face Model Download Failed: Request failed with status code 404 (Not Found).Penyebab: Hugging Face Model ID yang diberikan salah, atau mengarah ke model yang telah diubah menjadi privat atau dihapus.

Solusi:

Verifikasi bahwa Model ID ditulis dengan benar (misalnya,

Qwen/Qwen2.5-1.5B-Instruct) dan bahwa halaman model di Hugging Face Hub bersifat publik serta dapat diakses.

2. Error 401: Otorisasi Hugging Face Gagal

Hugging Face Model Download Failed: Request failed with status code 401 (Unauthorized).Penyebab: Hugging Face Access Token yang diberikan salah, telah kedaluwarsa, atau Anda belum diberikan akses ke model privat atau gated.

Solusi:

Pastikan Access Token Hugging Face Anda benar. Jika Anda mengakses model gated, konfirmasi di halaman Hugging Face-nya bahwa akun Anda telah diberikan akses.

3. Error 403: Penjualan resource ini untuk sementara dihentikan

403: Sales of this resource are temporarily suspended.Penyebab: Jenis GPU yang dipilih untuk sementara tidak tersedia di wilayah saat ini karena permintaan tinggi dan sumber daya tidak mencukupi.

Solusi:

Coba terapkan model di wilayah lain yang mungkin memiliki sumber daya tersedia.

Jika masalah tetap berlanjut, hubungi tim dukungan kami untuk bantuan.

4. Error: Akun memiliki saldo tertunggak

Account has an outstanding balance.Penyebab: Saldo akun Anda tidak mencukupi untuk menutupi biaya pembuatan atau pengoperasian penerapan.

Solusi:

Buka bagian Billing di dasbor akun Anda dan tambahkan dana ke saldo Anda.

5. Error: Informasi akun Anda belum lengkap

Your account information is incomplete.Penyebab: Akun Anda belum menyelesaikan proses verifikasi identitas atau informasi yang diperlukan.

Solusi:

Buka halaman Pengaturan Akun Alibaba Cloud dan lengkapi proses verifikasi identitas yang diperlukan.