Topik ini menjelaskan konsep dasar modul-modul DataWorks, termasuk Data Integration, Data Modeling, Data Development, Data Analysis, dan Data Service.

Topik ini juga menjelaskan istilah-istilah yang digunakan dalam pengembangan data di berbagai modul DataWorks, seperti Data Integration, Data Modeling, DataStudio, DataAnalysis, dan DataService Studio.

Istilah umum

Workspace

Workspace adalah unit dasar untuk mengelola task, anggota, peran, dan izin di DataWorks. Administrator workspace dapat menambahkan pengguna serta memberikan salah satu peran berikut: Administrator Workspace, Develop, O&M, Deploy, Administrator Keamanan, atau Visitor. Anggota dengan peran berbeda kemudian dapat berkolaborasi dalam workspace tersebut.

Buat workspace berdasarkan departemen atau unit bisnis untuk mengisolasi resource.

Resource group

Resource group adalah layanan DataWorks yang menyediakan resource komputasi untuk berbagai fitur DataWorks. Sebelum melakukan operasi pengembangan data menggunakan DataWorks, Anda harus memiliki resource group. Status resource group memengaruhi status berjalan fitur terkait, sedangkan kuotanya memengaruhi efisiensi task dan layanan.

Resource group di DataWorks berbeda dari resource group di Akun Alibaba Cloud—yang terakhir mengelola resource dan izin akun, sedangkan resource group DataWorks menjalankan task.

Detail penting:

Kecuali dinyatakan lain, resource group di DataWorks mengacu pada serverless resource groups, bukan resource group versi lama. Serverless resource groups bersifat umum.

Serverless resource groups dapat digunakan untuk data synchronization, data scheduling, dan DataService Studio.

Mode dasar dan mode standar

DataWorks menyediakan dua mode workspace—mode dasar dan mode standar—untuk memenuhi kebutuhan kontrol keamanan yang berbeda. Di mode standar, penambahan sumber data akan membuat dua sumber data terpisah untuk lingkungan pengembangan dan produksi, sehingga keduanya terisolasi satu sama lain.

Computing resource

Computing resource adalah instans resource yang digunakan mesin komputasi untuk menjalankan task pemrosesan dan analisis data. Contohnya mencakup proyek MaxCompute dengan grup kuota yang telah dikonfigurasi dan instans Hologres.

Anda dapat mengasosiasikan beberapa computing resource dengan sebuah workspace untuk mengembangkan dan menjadwalkan task yang menggunakan resource tersebut.

Data Integration

Data source

Data source menghubungkan DataWorks ke layanan penyimpanan data eksternal. Sebelum mengonfigurasi task sinkronisasi, Anda harus mendefinisikan informasi tentang data source yang ingin digunakan di DataWorks. Saat mengonfigurasi task sinkronisasi, Anda dapat memilih nama data source untuk menentukan database tempat membaca data dan database tempat menulis data. Berbagai jenis data source dapat ditambahkan ke dalam workspace.

Data synchronization

Fitur data synchronization di Data Integration memindahkan data antar sistem penyimpanan. Fitur ini mendukung data terstruktur (seperti ApsaraDB RDS dan PolarDB-X 1.0), data semi-terstruktur, dan data tidak terstruktur (seperti Object Storage Service (OSS) dan file teks). Namun, Data Integration hanya dapat menyinkronkan data yang dapat diabstraksikan menjadi tabel logis dua dimensi—data sepenuhnya tidak terstruktur seperti file MP3 di OSS tidak didukung.

Metode sinkronisasi yang didukung meliputi:

Batch synchronization

Real-time synchronization

Sinkronisasi data penuh dan inkremental untuk satu tabel atau seluruh database

Data Integration juga mendukung task sinkronisasi serverless, yang tidak memerlukan konfigurasi resource group.

Data Modeling

Data modeling

Seiring pesatnya perkembangan bisnis perusahaan, volume data tumbuh secara eksponensial, kompleksitas data meningkat, dan muncul berbagai standar data yang tidak konsisten. Hal ini secara signifikan meningkatkan kesulitan dalam manajemen data. Data Modeling membantu perusahaan mengstruktur dan mengelola volume besar data kompleks yang tidak teratur serta mengekstraksi lebih banyak nilai bisnis.

Reverse modeling

Reverse modeling menghasilkan model data dari tabel fisik yang sudah ada, sehingga tidak perlu membuat tabel secara manual di Dimensional Modeling. Pendekatan ini membantu mengurangi waktu yang dibutuhkan untuk menghasilkan model.

Modeling workspace

Jika sistem data Anda mencakup beberapa workspace dan Anda ingin menerapkan rencana gudang data terpadu di semua workspace tersebut, gunakan fitur modeling workspace. Fitur ini membagikan satu set alat pemodelan data di berbagai workspace, memungkinkan perencanaan gudang data terpadu, pemodelan dimensional, dan definisi metrik.

Dimension table

Dimension table menyimpan dimensi dan atributnya, yang diekstraksi dari domain data untuk tujuan analitis. Misalnya, dalam analitik e-commerce, dimensi umum meliputi pesanan, pengguna, dan komoditas—masing-masing memiliki atribut sendiri (seperti ID pesanan dan waktu pembuatan untuk dimensi pesanan, atau ID komoditas dan nama untuk dimensi komoditas). Atribut setiap dimensi menjadi bidang dalam dimension table.

Fact table

Fact table menyimpan data aktual yang dihasilkan oleh aktivitas bisnis. Misalnya, fact table untuk pemesanan pesanan mungkin mencakup bidang seperti ID pesanan, waktu pembuatan pesanan, ID komoditas, jumlah komoditas, dan jumlah penjualan. Operasi ETL mengisi fact table sehingga tim bisnis dapat mengkuerinya untuk analisis data hilir.

Aggregate table

Aggregate table menyimpan data statistik untuk beberapa metrik turunan yang memiliki periode statistik dan dimensi yang sama dalam suatu domain data. Aggregate table berasal dari abstraksi bisnis data mentah dan berfungsi sebagai fondasi untuk kueri bisnis, analisis OLAP (online analytical processing), dan distribusi data.

Application table

Application table mengorganisasi data statistik yang dikumpulkan oleh metrik atom dan metrik turunan yang memiliki periode statistik, dimensi, dan granularitas statistik yang sama. Struktur ini mendukung kueri bisnis yang efisien, analisis OLAP, dan distribusi data dalam skenario aplikasi tertentu.

Data mart

Data mart adalah organisasi data yang dibatasi pada kategori atau skenario bisnis tertentu. Data mart biasanya termasuk dalam lapisan aplikasi dan bergantung pada data agregat dari lapisan umum.

Data warehouse planning

Halaman data warehouse planning di Konsol DataWorks adalah tempat arsitek gudang data dan anggota grup model merancang struktur gudang data. Dari halaman ini, Anda dapat mendefinisikan lapisan data, kategori bisnis, domain data, proses bisnis, data mart, dan bidang subjek. Perancang model kemudian mengelola model berdasarkan objek struktural tersebut.

DataWorks mendukung lapisan gudang data berikut:

Lapisan impor data: Menyimpan data mentah dasar seperti catatan database, log, dan pesan. Data mentah diproses melalui operasi ETL sebelum disimpan di sini. Hanya tabel gudang data operasional (ODS) yang dapat disimpan di lapisan ini.

Lapisan umum: Memproses dan mengagregasi data dari lapisan impor data menjadi data fakta dan data agregat yang dapat digunakan kembali. Anda dapat membuat dimensi metrik terpadu serta data fakta dan data agregat yang dapat digunakan kembali untuk analisis dan pengumpulan data di lapisan umum. Lapisan ini menyimpan fact table, dimension table, dan aggregate table.

Application layer: Menyimpan data yang diproses di lapisan umum, dibatasi pada produk atau skenario aplikasi tertentu. Lapisan ini menyimpan application table dan dimension table.

Data layer

Secara default, gudang data DataWorks dibagi menjadi lima lapisan:

ODS (operational data store): Menerima dan menyimpan data mentah dengan struktur tabel yang sama seperti sumbernya. Berfungsi sebagai area staging untuk gudang data.

DWD (data warehouse detail): Membangun model data berdasarkan aktivitas bisnis individual. Membuat fact table pada granularitas tertinggi dan mendukung wide table yang mengurangi join antara fact table dan dimension table.

DWS (data warehouse summary): Membangun model data berdasarkan objek subjek analitis tertentu. Membuat aggregate table umum untuk aplikasi dan produk lapisan atas.

ADS (application data service): Menyimpan data metrik spesifik produk dan menghasilkan berbagai laporan.

DIM (dimension): Membangun model data berdasarkan dimensi. Menyimpan dimension table logis dan dimensi konseptual, mendefinisikan kunci primer dan atribut dimensi, serta mengasosiasikan dimensi berbeda untuk dimension table. Hal ini memastikan konsistensi dalam analisis data dan mengurangi risiko ketidaksesuaian spesifikasi dan algoritma perhitungan data.

Untuk informasi lebih lanjut, lihat Pelapisan gudang data.

Subject area

Subject area adalah kumpulan subjek bisnis yang digunakan untuk mengkategorikan data dalam data mart dari berbagai perspektif analitis. Misalnya, data e-commerce dapat diorganisasi menjadi subject area transaksi, subject area anggota, dan subject area komoditas.

Data domain

Data domain mengelompokkan data dengan tipe yang sama. Kriteria klasifikasi bervariasi berdasarkan penggunaan data—misalnya, data e-commerce dapat dibagi menjadi domain data transaksi, domain data anggota, dan domain data komoditas. Data domain mempercepat pencarian data yang relevan.

Business process

Business process adalah aktivitas bisnis yang dilakukan perusahaan dalam domain data tertentu, dan merupakan subjek logis utama untuk analisis di Data Modeling. Misalnya, domain data transaksi mungkin mencakup proses bisnis seperti menambahkan item ke keranjang, melakukan pemesanan, dan memproses pembayaran.

Composite metric

Composite metric dihitung dari metrik turunan tertentu dan aturan perhitungan kustom. Metrik turunan mengumpulkan statistik dalam jendela waktu tertentu tetapi tidak dapat menghitung ukuran relatif seperti tingkat pertumbuhan minggu-ke-minggu. Composite metric mengisi celah ini, memungkinkan analisis statistik detail halus seperti tingkat pertumbuhan dan selisih nilai.

Data metric

Sistem metrik Data Modeling menyediakan kerangka kerja terpadu untuk mendefinisikan dan mengelola metrik. Sistem ini terdiri dari empat komponen:

Atomic metric: Pengukuran tunggal yang terkait dengan proses bisnis. Misalnya, Jumlah Pembayaran untuk proses Pemesanan.

Modifier: Filter yang mempersempit cakupan statistik. Misalnya, Produk Ibu dan Bayi membatasi metrik Jumlah Pembayaran pada kategori produk tertentu.

Period: Rentang waktu atau titik waktu untuk pengumpulan data. Misalnya, Tujuh Hari Terakhir.

Derived metric: Kombinasi atomic metric, period, dan satu atau beberapa modifier. Misalnya, Jumlah Pembayaran Produk Ibu dan Bayi dalam Tujuh Hari Terakhir.

Lookup table

Lookup table mendefinisikan rentang nilai valid untuk bidang yang diatur oleh standar bidang. Misalnya, lookup table untuk standar bidang jenis kelamin mungkin berisi nilai "laki-laki" dan "perempuan."

Field standard

Field standard mengelola secara terpusat bidang-bidang yang memiliki makna sama tetapi muncul dengan nama berbeda di berbagai tabel. Field standard juga mendefinisikan rentang nilai dan satuan pengukuran untuk bidang tersebut. Ketika field standard berubah, DataWorks dapat dengan cepat mengidentifikasi semua tabel yang terpengaruh, meningkatkan konsistensi dan akurasi data.

DataStudio

Node

DataStudio memungkinkan Anda membuat node dengan tipe berbeda untuk menangani berbagai tahap pemrosesan data:

Data synchronization nodes: Memindahkan data antara sumber dan tujuan.

Compute engine nodes: Menjalankan logika transformasi data. Contohnya termasuk node ODPS SQL, node Hologres SQL, dan node EMR Hive.

General nodes: Mengoordinasi atau memperluas logika mesin komputasi. Contohnya termasuk zero load nodes (untuk mengelola grup node) dan do-while nodes (untuk mengulang kode node).

Gabungkan tipe node untuk memenuhi kebutuhan pemrosesan data spesifik Anda.

Auto triggered workflow

Auto triggered workflow adalah mode pengembangan yang menyediakan antarmuka visual grafik asiklik terarah (DAG) dari perspektif bisnis. Seret dan lepas berbagai tipe node ke kanvas untuk mengonfigurasi dependensi antar task secara visual. Hal ini memfasilitasi pemrosesan data, meningkatkan efisiensi pengembangan task, dan menyederhanakan manajemen proyek kompleks.

Notebook

Fitur Notebook menyediakan lingkungan interaktif yang mengintegrasikan kode SQL, kode Python, teks, hasil eksekusi, dan grafik visualisasi data dalam satu antarmuka. Gunakan Notebook untuk eksplorasi data, analisis data, dan pengembangan model AI.

SQL script template

SQL script template adalah blok logika yang dapat digunakan kembali yang diabstraksikan dari skrip SQL. SQL script template hanya berlaku untuk task MaxCompute.

Setiap templat melibatkan satu atau beberapa tabel sumber. Anda dapat memfilter, menggabungkan (join), dan mengagregasi tabel-tabel tersebut untuk menghasilkan tabel hasil. Templat menerima parameter input dan output, sehingga dapat disesuaikan dengan berbagai skenario bisnis.

Scheduling dependency

Scheduling dependency mendefinisikan urutan eksekusi antar task. Jika Node B hanya dapat berjalan setelah Node A selesai, maka Node A adalah ancestor dari Node B. Dalam DAG, panah merepresentasikan dependensi tersebut.

Data timestamp

Data timestamp adalah tanggal yang secara langsung relevan dengan aktivitas bisnis—mencerminkan waktu aktual saat data bisnis dihasilkan. Konsep ini sangat penting dalam skenario komputasi offline.

Misalnya, jika task ritel menghitung omset untuk 10 Oktober 2024, task tersebut berjalan pada dini hari 11 Oktober 2024. Data timestamp task tersebut adalah 20241010, bukan tanggal eksekusi aktual.

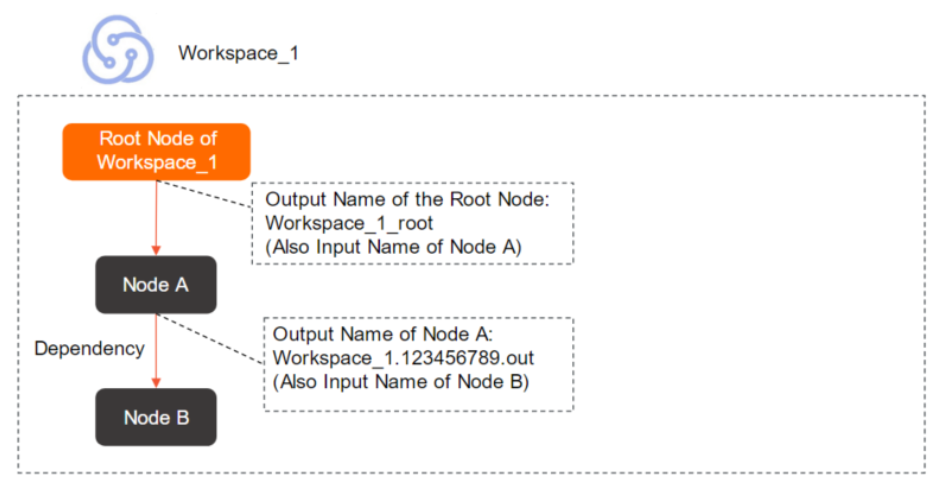

Output name

Output name mengidentifikasi output yang dihasilkan oleh sebuah task. Gunakan output name—bukan nama task atau ID-nya—saat mengonfigurasi dependensi antar task dalam Akun Alibaba Cloud Anda. Output name dari task hulu menjadi input name untuk task hilirnya.

Output name harus unik secara global dalam Akun Alibaba Cloud Anda. Format defaultnya adalah Nama workspace.Angka acak sembilan digit.out. Anda dapat menentukan output name kustom, tetapi harus tetap unik dalam Akun Alibaba Cloud Anda.Output table name

Output table name adalah pengenal yang digunakan untuk memverifikasi bahwa data dalam task turunan berasal dari tabel ancestor yang diharapkan saat mengonfigurasi dependensi. Gunakan nama tabel yang dihasilkan oleh task sebagai output table name, dan hindari memodifikasi output table name yang diurai secara otomatis.

output name harus unik secara global. output table name tidak memiliki persyaratan tersebut—hanya berfungsi sebagai pengenal. Memodifikasi output table name tidak memengaruhi nama tabel yang sebenarnya dihasilkan oleh pernyataan SQL.

Scheduling parameter

Scheduling parameter adalah variabel dalam kode task yang nilainya diganti secara dinamis saat runtime. Gunakan scheduling parameter ketika kode Anda memerlukan informasi kontekstual—seperti tanggal saat ini—setiap kali task dijalankan.

Data catalog

Data catalog adalah peta terstruktur dari semua aset data dalam organisasi Anda, termasuk database, tabel, dan file. Data catalog mencatat metadata aset tersebut di DataWorks.

Hubungan antara computing resources, data sources, dan data catalogs

Computing resources, data sources, dan data catalogs adalah objek independen tetapi saling terkait. Hubungan mereka adalah:

Mengasosiasikan computing resource dengan workspace secara otomatis menghasilkan data source dan data catalog.

Menambahkan data source ke workspace secara otomatis menghasilkan data catalog.

Membuat data catalog tidak menghasilkan data source atau computing resource.

Operation Center

Scheduling time

Scheduling time adalah titik waktu ketika task yang dipicu otomatis dijadwalkan untuk berjalan, akurat hingga menit.

Mencapai scheduling time tidak menjamin task langsung dimulai. Sebelum task berjalan, DataWorks memverifikasi tiga kondisi: task ancestor telah selesai sesuai harapan, scheduling time telah tiba, dan resource yang cukup tersedia. Task hanya berjalan ketika ketiga kondisi tersebut terpenuhi.

Data timestamp

Data timestamp adalah tanggal yang secara langsung relevan dengan aktivitas bisnis—mencerminkan waktu aktual saat data bisnis dihasilkan.

Misalnya, dalam ritel, jika Anda menghitung omset untuk 10 Oktober 2024, perhitungan tersebut berjalan pada dini hari 11 Oktober 2024. Data timestamp-nya adalah 20241010.

Auto triggered task

Auto triggered task dipicu oleh sistem penjadwalan berdasarkan properti penjadwalan yang dikonfigurasi pada task tersebut. Dari Operation Center, Anda dapat melakukan operasi O&M dan manajemen pada auto triggered task, termasuk melihat DAG, menjalankan pengujian, mengisi ulang data, dan mengubah pemilik task.

Auto triggered instance

Auto triggered instance dihasilkan secara otomatis dari properti penjadwalan auto triggered task setiap kali task tersebut dijadwalkan untuk berjalan. Misalnya, task yang dikonfigurasi untuk berjalan sekali per jam menghasilkan 24 instance per hari, dengan satu instance dipicu setiap jam. Hanya instance yang memiliki status runtime seperti status berjalan. Dari Operation Center, Anda dapat menghentikan, menjalankan ulang, atau menandai instance sebagai berhasil secara manual.

Data backfill

Operasi data backfill menghasilkan instance backfill untuk task tertentu berdasarkan rentang waktu yang dipilih. Gunakan data backfill untuk penulisan ulang data historis dan koreksi data—misalnya, untuk menghitung ulang data periode lalu atau memperbaiki data yang sebelumnya dihasilkan.

Baseline

Baseline mendefinisikan ekspektasi kualitas layanan untuk sekumpulan task. Setelah Anda mengasosiasikan task dengan baseline, DataWorks memantau task tersebut berdasarkan tiga properti: prioritas, waktu penyelesaian yang dijanjikan, dan ambang batas margin peringatan.

Prioritas: Angka yang lebih tinggi berarti prioritas lebih tinggi. DataWorks secara preferensial mengalokasikan resource ke baseline dengan prioritas lebih tinggi.

Waktu penyelesaian yang dijanjikan: Batas waktu akhir di mana task dalam baseline harus menghasilkan output.

Ambang batas margin peringatan: Buffer waktu yang dikurangkan dari waktu penyelesaian yang dijanjikan untuk menghitung waktu peringatan. Jika DataWorks mendeteksi bahwa task dalam baseline tidak dapat menghasilkan data sebelum waktu peringatan, sistem akan mengirim peringatan ke kontak yang dikonfigurasi.

Data Governance Center

Health score

Health score adalah metrik komposit yang mencerminkan efektivitas tata kelola tenant, workspace, atau pengguna. Skor berkisar dari 0 hingga 100—skor yang lebih tinggi menunjukkan aset data yang lebih sehat.

DataWorks menghitung health score menggunakan model penilaian kesehatan, yang mengevaluasi item tata kelola di lima dimensi: penyimpanan, komputasi, R&D, kualitas, dan keamanan. Setiap dimensi memiliki metrik spesifik, memberi Anda gambaran jelas tentang area yang memerlukan perhatian tata kelola.

Governance item

Governance item adalah aturan yang digunakan DataWorks untuk mendeteksi masalah dalam aset data selama tata kelola, seperti pelanggaran spesifikasi R&D, masalah kualitas data, celah kepatuhan keamanan, dan inefisiensi pemanfaatan resource.

Governance item bersifat wajib atau opsional:

Wajib: Diaktifkan secara global secara default dan tidak dapat dinonaktifkan.

Opsional: Diaktifkan sesuai kebutuhan Anda. Contohnya termasuk mendeteksi task yang timeout, node yang gagal berulang kali, atau leaf node yang tidak pernah diakses.

Check item

Check item adalah mekanisme tata kelola aktif yang memvalidasi kode task sebelum dikomit dan dideploy. Jika check item mendeteksi pelanggaran—seperti pemindaian tabel penuh atau dependensi penjadwalan yang hilang—DataWorks menghasilkan event pemeriksaan dan memblokir konten agar tidak dideploy.

Check item melengkapi governance item: governance item mendeteksi masalah dalam aset data yang sudah ada, sedangkan check item mencegah kode yang tidak sesuai masuk ke lingkungan produksi.

Data governance plan

Tata Kelola Aset Data menyediakan templat rencana tata kelola data untuk berbagai skenario, dengan fokus mencapai tujuan tata kelola yang telah ditentukan dalam periode tertentu. Gunakan templat rencana tata kelola data untuk dengan cepat mengidentifikasi governance item dan check item yang paling relevan, menemukan kandidat optimalisasi, dan melacak kemajuan menuju tujuan tata kelola melalui penilaian kuantitatif.

Knowledge base

Knowledge base berisi definisi, penjelasan akar penyebab, dan panduan remediasi untuk semua check item dan governance item bawaan di Data Governance Center. Gunakan knowledge base untuk dengan cepat memahami masalah dan mengambil tindakan.

Security Center

Data permission

Security Center mendukung permintaan izin detail halus, pemrosesan permintaan, dan audit izin berdasarkan prinsip hak istimewa minimal. Fitur ini juga memungkinkan Anda melacak dan menindaklanjuti permintaan izin secara real-time. Untuk informasi lebih lanjut, lihat Kontrol akses data.

Data security

Security Center menyediakan alat untuk mengidentifikasi dan mengelola risiko data di seluruh alur kerja Anda, termasuk klasifikasi data berdasarkan kategori dan tingkat sensitivitas, identifikasi data sensitif, audit akses data, dan pelacakan sumber data. Untuk informasi lebih lanjut, lihat Ikhtisar.

Data Quality

Data quality monitoring

Data quality monitoring secara terus-menerus melacak status objek data—seperti partisi tertentu dalam tabel partisi—untuk memverifikasi bahwa data tersebut memenuhi standar kualitas yang telah ditentukan. Picu pemantauan melalui event penjadwalan untuk pemeriksaan kualitas otomatis, dan konfigurasikan pemberitahuan peringatan yang dikirim ke penerima yang ditentukan saat masalah terdeteksi.

Monitoring rule

Monitoring rule adalah kondisi atau kriteria logis yang menentukan apakah data memenuhi ekspektasi kualitas. Misalnya, "Usia pelanggan tidak boleh kurang dari 0" adalah monitoring rule. Konfigurasikan monitoring rule untuk rentang data tertentu, dan DataWorks akan memberi peringatan saat data melanggarnya.

Rule template

Rule template adalah aturan kualitas yang dapat digunakan kembali dengan logika verifikasi yang telah ditentukan. Gunakan rule template secara langsung atau sesuaikan ambang batasnya untuk membuat monitoring rule untuk data Anda.

DataWorks menyediakan dua tipe:

Built-in rule templates: Templat siap pakai yang disediakan oleh DataWorks. Untuk informasi lebih lanjut, lihat Built-in rule templates.

Custom rule templates: Buat templat Anda sendiri menggunakan pernyataan SQL kustom, terutama untuk memantau data yang ditentukan oleh ekspresi filter partisi. Simpan aturan kustom yang sering digunakan sebagai templat untuk digunakan kembali. Untuk informasi lebih lanjut, lihat Custom rule templates.

Data Security Guard

Data category dan data sensitivity level

Data category dan data sensitivity level memungkinkan Anda mengklasifikasikan data berdasarkan nilainya, sensitivitas konten, dampak potensial, dan cakupan distribusi. Persyaratan manajemen data dan kontrol pengembangan bervariasi berdasarkan tingkat sensitivitas.

Sensitive data identification rule

Sensitive data identification rule mendefinisikan kategori data dan mengonfigurasi tipe bidang sensitif berdasarkan sumber dan penggunaan data. Hal ini membantu mengidentifikasi data sensitif di workspace saat ini. DataWorks menyediakan aturan identifikasi bawaan, dan Anda dapat membuat aturan kustom sesuai kebutuhan.

Data masking rule

Data masking rule menentukan cara data sensitif yang teridentifikasi disembunyikan. Perilaku penyembunyian bervariasi berdasarkan tingkat sensitivitas data untuk memenuhi persyaratan kontrol bisnis.

Risk identification rule

Risk identification rule memungkinkan Data Security Guard mendeteksi secara proaktif operasi berisiko pada data menggunakan analisis cerdas. Saat risiko teridentifikasi, sistem melaporkan peringatan untuk membantu Anda melakukan manajemen risiko secara komprehensif.

Data Map

Metadata

Metadata menggambarkan properti dan struktur aset data. Metadata mencakup:

Atribut data: Nama, ukuran, dan tipe data

Data structures: Nama bidang, tipe, dan panjang

Informasi lainnya: Lokasi, Pemilik, Tugas output, dan izin akses

Data lineage

Data lineage memetakan perjalanan data dari pembuatan hingga pemrosesan, sinkronisasi, dan konsumsi, menunjukkan semua objek data yang terlibat di setiap tahap. DataWorks menampilkan data lineage secara visual, sehingga mudah untuk melacak sumber masalah dan menilai dampak perubahan pada tabel atau bidang.

Data album

Data album mengorganisasi dan mengelola tabel berdasarkan kategori bisnis. Tambahkan tabel tertentu ke data album untuk mempermudah pencarian dan lokalisasi.

DataAnalysis

SQL query

DataAnalysis mendukung pernyataan SQL standar untuk mengkueri dan menganalisis data di berbagai tipe sumber data. Untuk informasi lebih lanjut, lihat SQL query.

Workbook

Workbook adalah alat online untuk mengedit dan mengelola data. Impor hasil kueri SQL atau file lokal ke workbook untuk analisis dan visualisasi lebih lanjut. Ekspor, unduh, atau bagikan data workbook dengan pengguna lain sesuai kebutuhan. Untuk informasi lebih lanjut, lihat Buat dan kelola workbook.

Data insight

Data insight mendukung eksplorasi dan visualisasi data menggunakan teknologi artificial intelligence (AI). Gunakan fitur ini untuk memahami distribusi data, membuat kartu data, dan menggabungkan kartu-kartu tersebut menjadi laporan data. Laporan dapat dibagikan sebagai gambar panjang. Analisis berbasis AI membantu menginterpretasikan data kompleks untuk pengambilan keputusan bisnis.

DataService Studio

API

API (Application Programming Interface) di DataService Studio adalah titik akhir akses data yang dengan cepat dikapsulkan oleh pengembang berdasarkan berbagai tipe sumber data. Setelah dibuat, API dapat dipanggil dari aplikasi bisnis, perangkat lunak, sistem, dan skenario pelaporan untuk memfasilitasi pengambilan dan konsumsi data.

Function

Function berfungsi sebagai filter untuk API—baik saat masuk maupun keluar:

Pre-filter: Memproses parameter permintaan masuk sebelum API dieksekusi. Misalnya, memodifikasi nilai parameter atau menetapkan nilai default.

Post-filter: Memproses hasil respons API. Misalnya, menyusun ulang data respons atau menambahkan konten tambahan.

Data push

Fitur data push memungkinkan Anda membuat task yang secara berkala mendorong data ke URL webhook tujuan. Tulis pernyataan SQL untuk kueri tabel tunggal atau multi-tabel guna menentukan data yang akan didorong, dan format output sebagai teks kaya atau tabel. Konfigurasikan properti penjadwalan untuk mengontrol frekuensi dorongan.

Open Platform

OpenAPI

Modul OpenAPI memungkinkan Anda memanggil operasi API DataWorks untuk menggunakan fitur DataWorks secara terprogram dan mengintegrasikan aplikasi Anda dengan DataWorks.

OpenEvent

Modul OpenEvent memungkinkan Anda berlangganan notifikasi event untuk perubahan di DataWorks. Misalnya, berlangganan event perubahan tabel untuk menerima peringatan real-time tentang perubahan pada tabel inti, atau berlangganan event perubahan task untuk membangun dasbor pemantauan kustom bagi status task sinkronisasi real-time.

Extensions

Modul Extensions adalah sistem plug-in yang bekerja dengan OpenAPI dan OpenEvent untuk memproses dan mengintersepsi operasi pengguna di DataWorks berdasarkan logika kustom. Misalnya, bangun ekstensi untuk menerapkan kontrol deployment task kustom.